零、docker 和 docker-compose 环境

略

一、使用Docker Compose 搭建ELK环境

可以参考文章 SpringBoot应用整合并使用Docker安装ELK实现日志收集 这种方式就是参考他的。

1.1、拉去elk 镜像

根据项目依赖的版本pull对应的版本,注意 ELK版本必须完全一致(建议一致)

docker pull elasticsearch:7.12.1

docker pull logstash:7.12.1

docker pull kibana:7.12.1

1.2、创建存放elk数据挂载位置

mkdir /opt/elk/logstash

mkdir /opt/elk/es

mkdir /opt/elk/kibana

1.3、创建logstash的数据转化格式配置

cd /opt/elk/logstash

vim logstash-springboot.conf

1、内容如下,注意这里的applicationName 就是后面我们可以在spring-boot的appender中可以自定义的参数,传到这里来,这个我在之前的原生elk搭建文章中有说过。 原生elk搭建和springBoot使用

2、注意TCP的那个prot 4560,我们可以配置多个,而且我们在 logback-spring.xml文件中也可以指定,你可以看到 参考的这个文章,里面有很多,不同的级别分到不同的端口中。

input {

tcp {

mode => "server"

host => "0.0.0.0"

port => 4560

codec => json_lines

}

}

output {

elasticsearch {

hosts => "es:9200"

index => "%{[applicationName]}-%{+YYYY.MM.dd}"

}

}

1.4、使用docker-compose.yml 脚本启动ELK服务

1、创建docker-compose启动文件

cd /opt/elk

vim docker-compose.yml

2、内容如下,具体内容注释的很清楚了,就不再阐述了

version: '3'

services:

elasticsearch:

image: elasticsearch:7.12.1

container_name: elasticsearch

environment:

- "cluster.name=elasticsearch" #设置集群名称为elasticsearch

- "discovery.type=single-node" #以单一节点模式启动

- "ES_JAVA_OPTS=-Xms512m -Xmx512m" #设置使用jvm内存大小

volumes:

- /opt/elk/es/plugins:/usr/share/elasticsearch/plugins #插件文件挂载

- /opt/elk/es/data:/usr/share/elasticsearch/data #数据文件挂载

ports:

- 9200:9200

- 9300:9300

kibana:

image: kibana:7.12.1

container_name: kibana

links:

- elasticsearch:es #可以用es这个域名访问elasticsearch服务

depends_on:

- elasticsearch #kibana在elasticsearch启动之后再启动

environment:

- "elasticsearch.hosts=http://es:9200" #设置访问elasticsearch的地址

ports:

- 5601:5601

logstash:

image: logstash:7.12.1

container_name: logstash

volumes:

- /opt/elk/logstash/logstash-springboot.conf:/usr/share/logstash/pipeline/logstash.conf #挂载logstash的配置文件

depends_on:

- elasticsearch #kibana在elasticsearch启动之后再启动

links:

- elasticsearch:es #可以用es这个域名访问elasticsearch服务

ports:

- 4560:4560

3、执行docker-compose命令运行elk,需要在docker-compose.yml文件目录下执行,默认找的就是这个文件名

docker-compose up -d

4、启动完成后 在logstash中安装json_lines插件,因为我们在2560端口使用的使用tcp,并配置了json_lines插件,所以需要安装一下

# 进入logstash容器

docker exec -it logstash /bin/bash

# 进入bin目录

cd /bin/

# 安装插件

logstash-plugin install logstash-codec-json_lines

# 退出容器

exit

# 重启logstash服务

docker restart logstash

5、访问 http://192.168.160.50:5601 kibana 页面。

1.4、将spring-boot 日志传输过去

1、我们可以在配置文件中自定义属性,在logback-spring.xml 文件中读取

2、配置es 地址

3、logback-spring.xml 文件,注意 destination ${LOG_STASH_HOST}:4560 destination ,这个里面是写了向4560的端口发的,和前面的logstahs.yml中一一对应。我们可以指定多个,看我们前面说的那个参考文章就有,他配置了很多个。

<?xml version="1.0" encoding="UTF-8"?>

<!DOCTYPE configuration>

<configuration>

<!--引用默认日志配置-->

<include resource="org/springframework/boot/logging/logback/defaults.xml"/>

<!--使用默认的控制台日志输出实现 其实和我们下面定义的CONSOLE 的appender 是一样的,只不过他没有设置编码为utf8 -->

<!-- <include resource="org/springframework/boot/logging/logback/console-appender.xml"/>-->

<!--应用名称-->

<springProperty scope="context" name="APP_NAME" source="spring.application.name" defaultValue="asurplus"/>

<!--日志文件保存路径-->

<!-- <property name="LOG_FILE_PATH" value="${LOG_FILE:-${LOG_PATH:-${LOG_TEMP:-${java.io.tmpdir:-/tmp}}}/logs}"/>-->

<!--LogStash访问host-->

<springProperty name="LOG_STASH_HOST" scope="context" source="logstash.host" defaultValue="192.168.160.50/"/>

<springProperty name="LOGSTASH_ENV" scope="context" source="logstash.env" defaultValue="pro"/>

<appender name="CONSOLE" class="ch.qos.logback.core.ConsoleAppender">

<encoder>

<pattern>${CONSOLE_LOG_PATTERN}</pattern>

<charset>utf8</charset>

</encoder>

</appender>

<!-- 所有级别 日志输出到 LogStash -->

<appender name="LOG_STASH" class="net.logstash.logback.appender.LogstashTcpSocketAppender">

<destination>${LOG_STASH_HOST}:4560</destination>

<!-- LoggingEventCompositeJsonEncoder 不支持 customFields 属性-->

<!-- <encoder charset="UTF-8" class="net.logstash.logback.encoder.LoggingEventCompositeJsonEncoder">-->

<encoder charset="UTF-8" class="net.logstash.logback.encoder.LogstashEncoder">

<providers>

<timestamp>

<timeZone>Asia/Shanghai</timeZone>

</timestamp>

</providers>

<customFields>{"applicationName":"${APP_NAME}-${LOGSTASH_ENV}"}</customFields>

</encoder>

</appender>

<!--控制框架输出日志-->

<logger name="org.slf4j" level="INFO"/>

<logger name="io.swagger" level="INFO"/>

<logger name="org.springframework" level="INFO"/>

<logger name="org.hibernate.validator" level="INFO"/>

<springProfile name="dev">

<root level="INFO">

<appender-ref ref="CONSOLE"/>

<appender-ref ref="LOG_STASH"/>

</root>

</springProfile>

<springProfile name="test">

<root level="INFO">

<appender-ref ref="CONSOLE"/>

<appender-ref ref="LOG_STASH"/>

</root>

</springProfile>

<springProfile name="pro">

<root level="INFO">

<appender-ref ref="CONSOLE"/>

<appender-ref ref="LOG_STASH"/>

</root>

</springProfile>

</configuration>

二、使用github docker开源的方式搭建ELK环境(更全-推荐)

可以参考:使用 Docker 搭建 ELK 环境,里面可以借鉴不少,但是他的不是 7.17.3

当然我非常建议你看下 github的官方文档,说的很详细。 elk7.X

2.1、安装

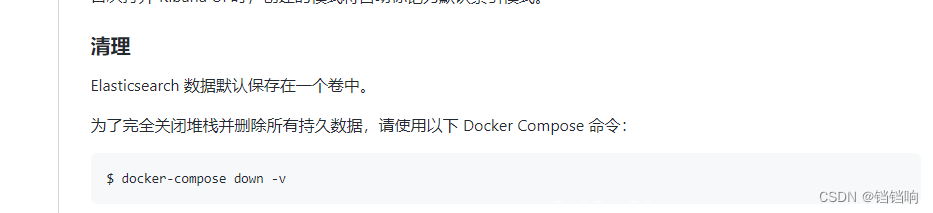

0、如果你前面电脑用这种方式安装过这个elk,可能使用的他二点7.16或者其他版本的,一定要使用以下命令 ,清除一下,不然你就发现还有上次安装的遗留痕迹,最明显的就是密码居然是上次的,我这次在写博客从新安装的时候,就发现这个问题。所以官方文档还是一定要看的

docker-compose down -v

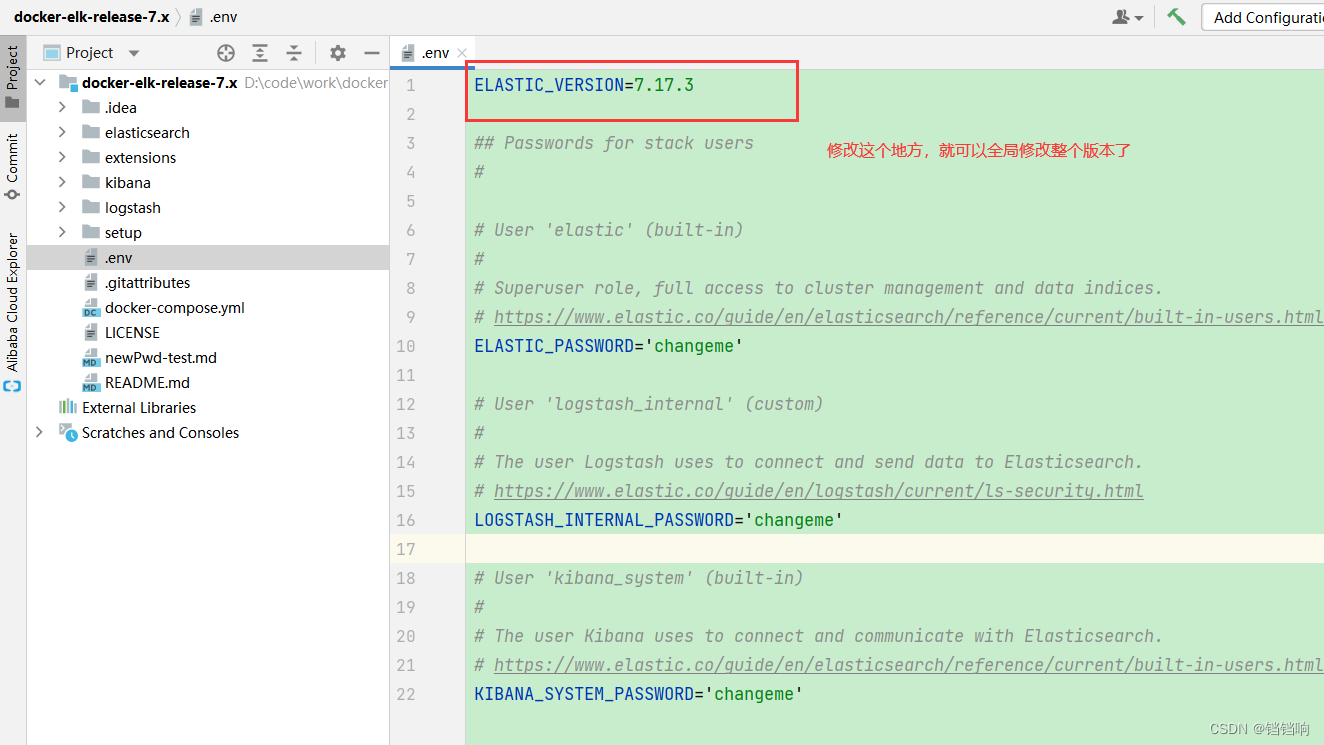

1、首先到github下载 elk7.X ,我这边安装的是7.X中最新的版本 7.17.3,当然也是可以修改版本的。在 .env 文件中。

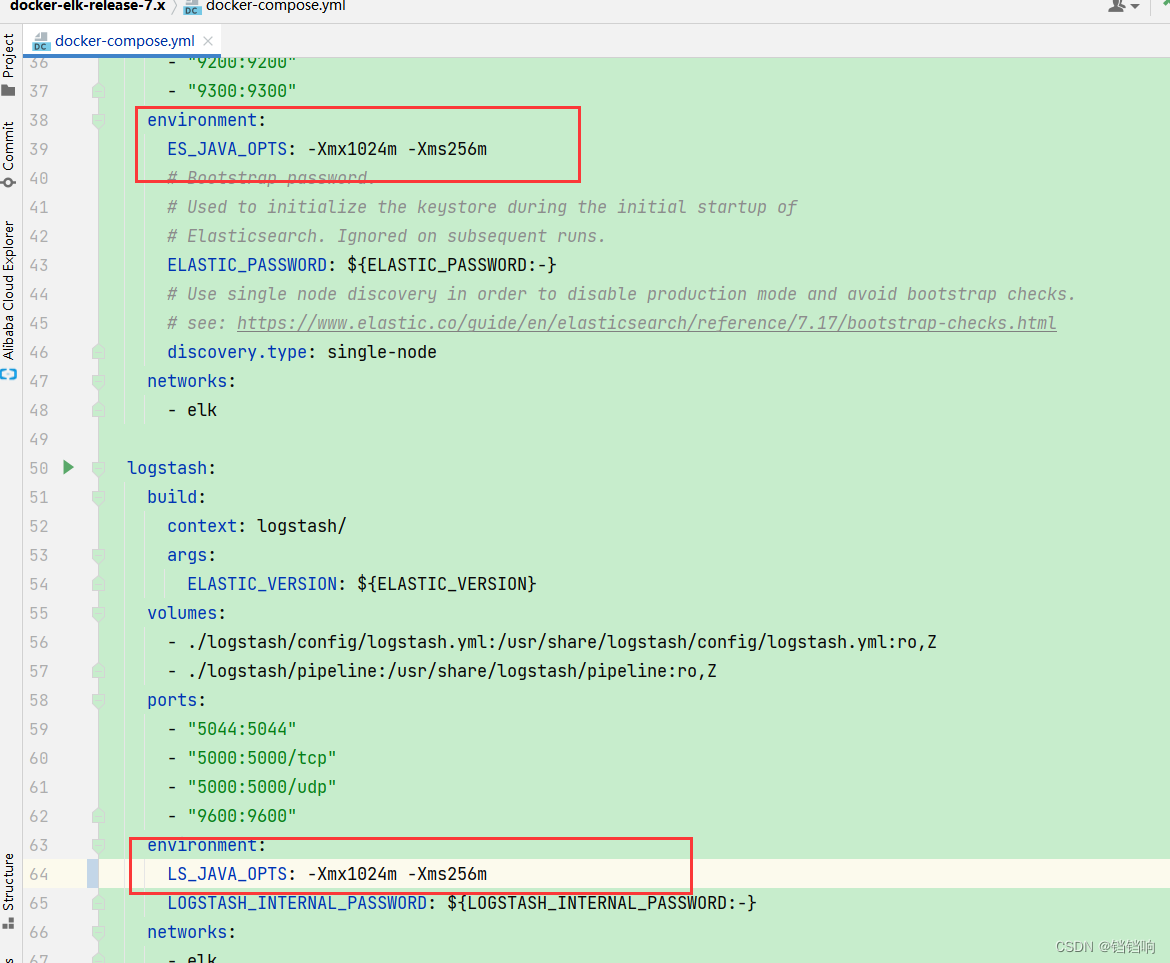

2、修改镜像内存,因为默认初始化内存是 -Xmx256m -Xms1024m,实在太小了,启动起来很慢,而且后续如果我们需要在里面安装一些其他的插件,这个内存根本就不够,会抛出内存不足的异常,所以我们这里提前把内存调整大一些。

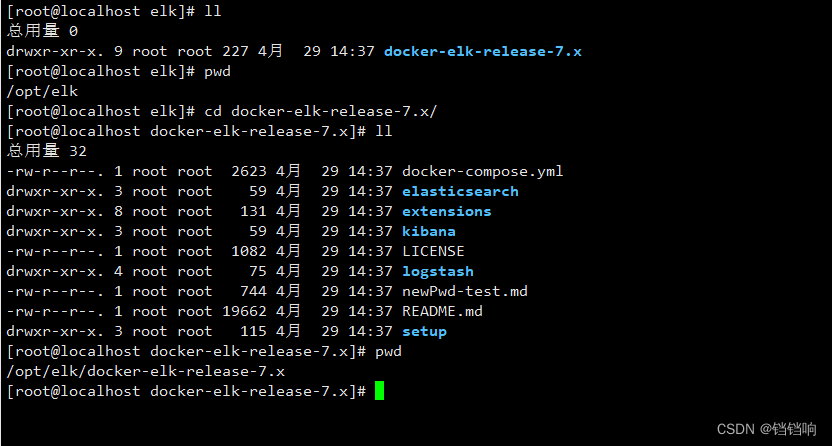

3、上传到Linux中,我将所有的内容都放到 /opt/elk 目录下

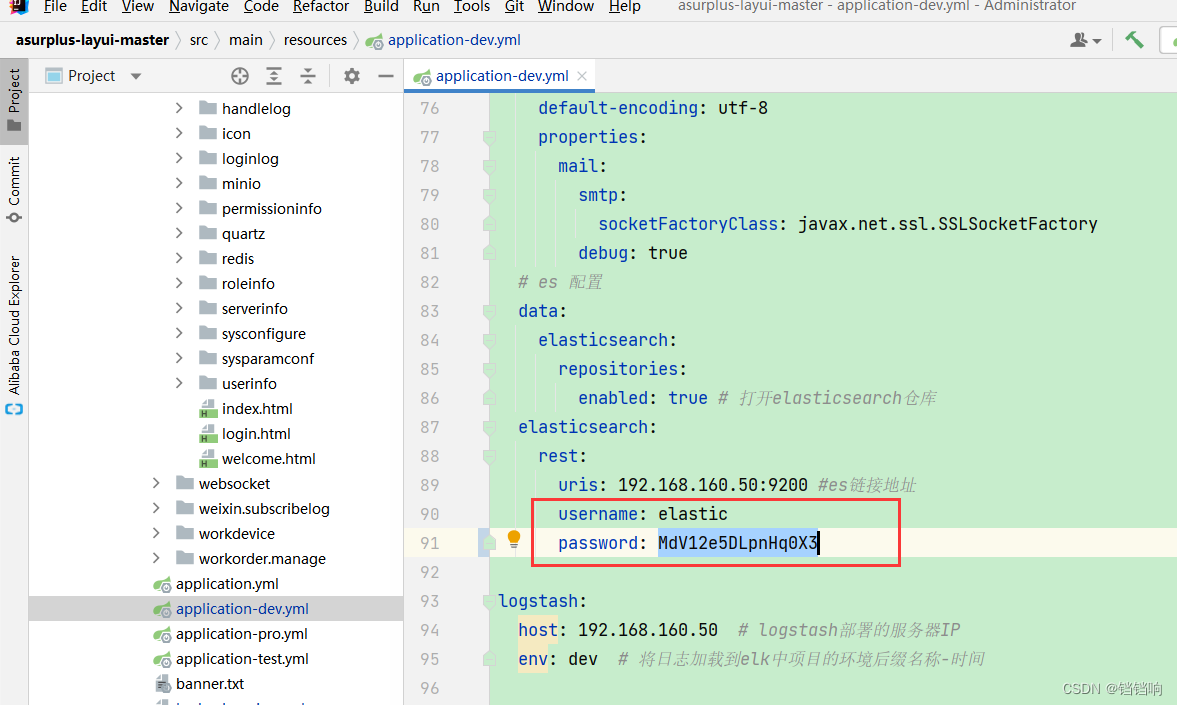

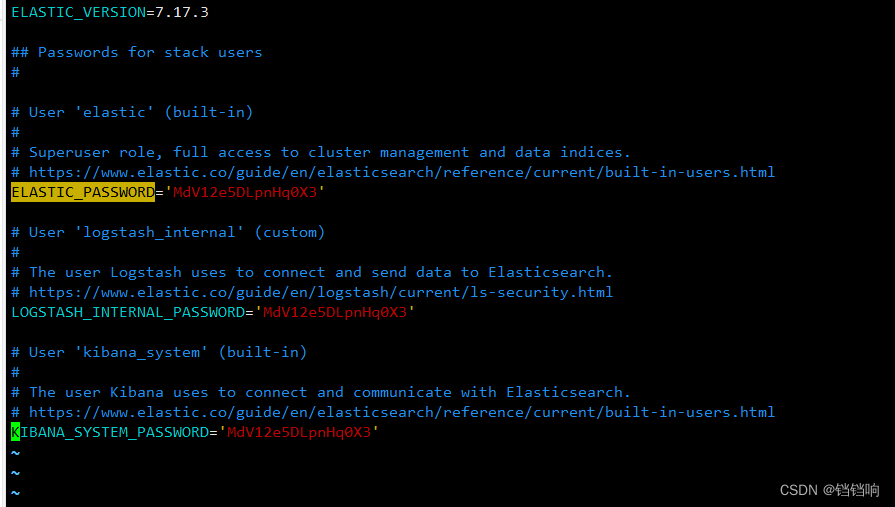

4、修改文件 .env 默认的密码,我们这样后续我们就不用重置密码了,当然你也可以不做这一步,后续按照官方的方式去重新随机设置密码,后面也有说。我这里直接修改.env 文件的默认初始密码换成 MdV12e5DLpnHq0X3

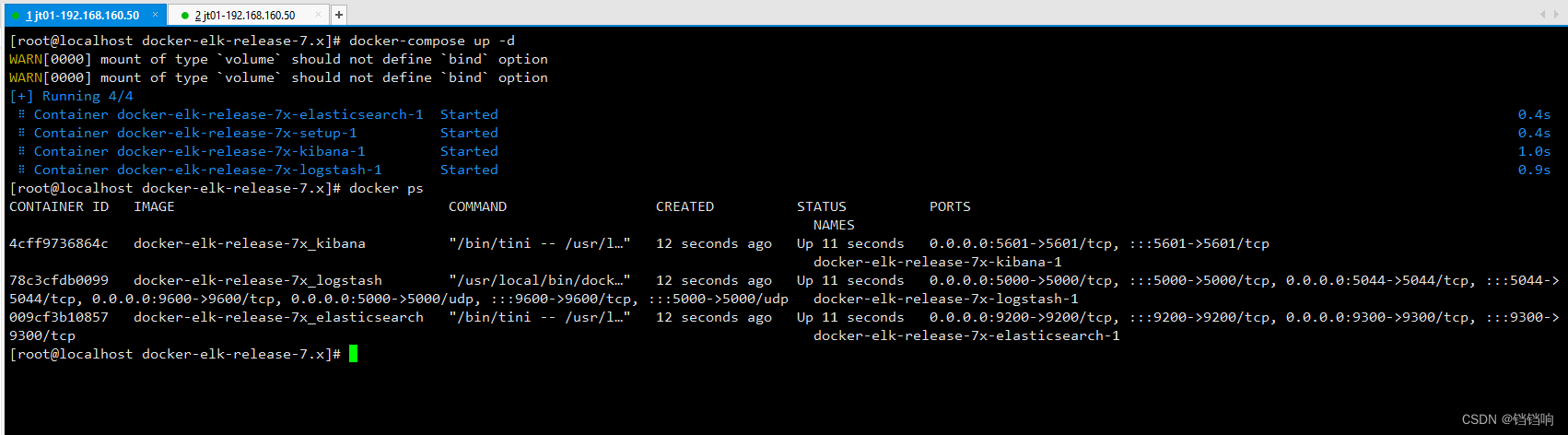

4、启动,在docker-compose.yml 目录下运行,因为我这个之前安装过一次,所以相关镜像都存在,所以这里没有显示下载镜像的步骤,如果你是第一次,就会有下载镜像的过程。

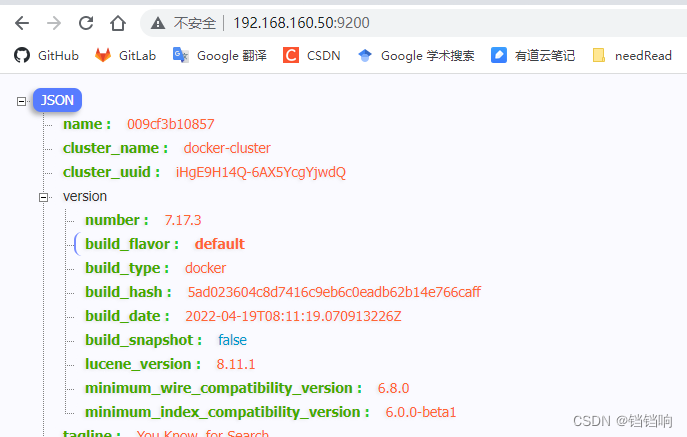

5、为了验证,我们可以使用浏览器或者 curl 等工具访问机器地址加端口号 9200,并使用默认用户名 elastic 和你前面设置的密码 (当然如果你这里没改那就是 changeme)来访问 Elasticsearch HTTP 端口,如果一切正常,你将看到类似下面的结果

2.2、使用 Kibana 控制台

1、启动之后,我们使用浏览器访问服务器IP+端口5601,打开 kibana 控制台

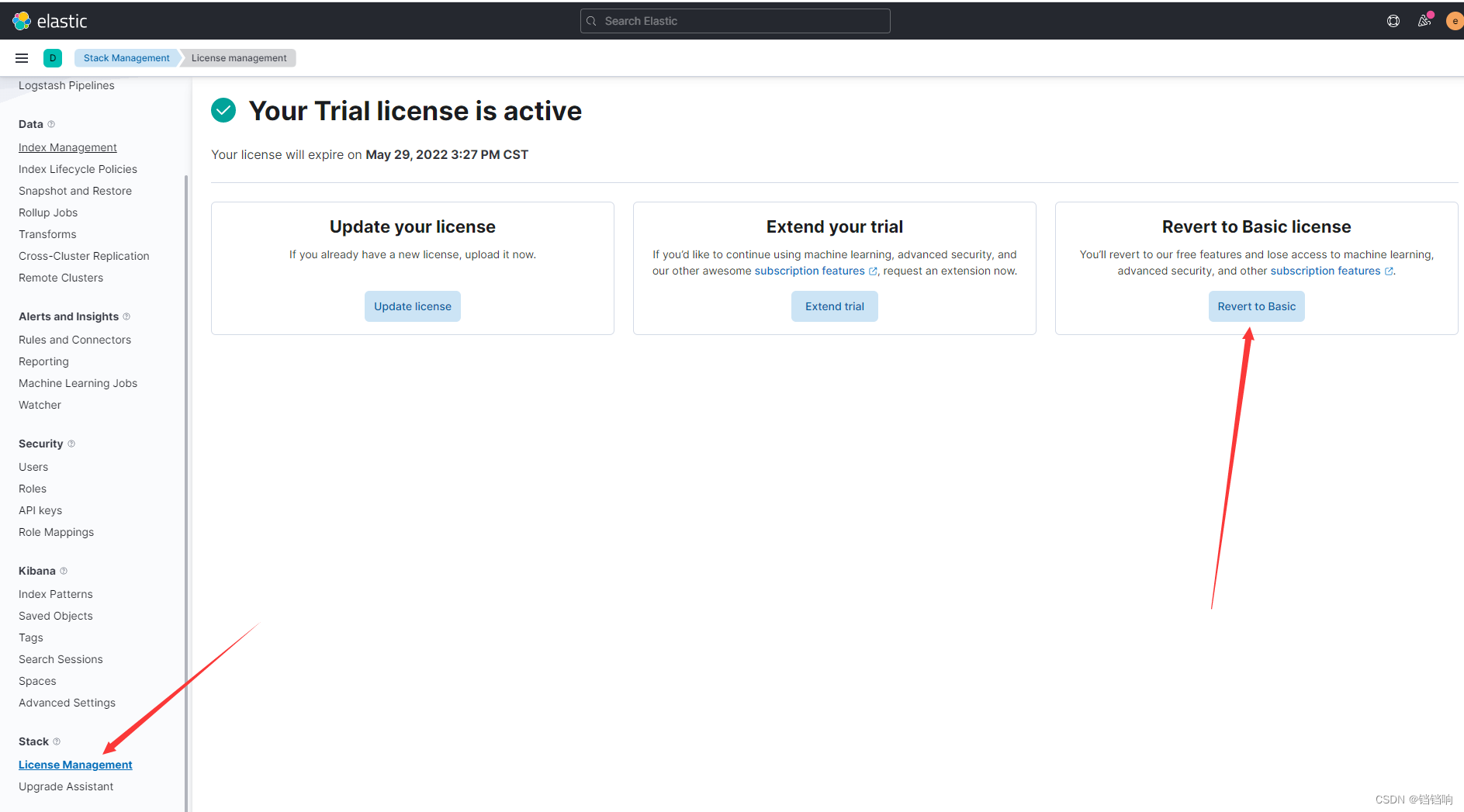

2、关闭付费组件,打开设置界面,选择 Elasticsearch 模块中的 License Management ,可以看到默认软件会启动为期一个月的高级功能试用,我们选择“Revert to Basic license”,选择回退到基础版本,可以看到整个界面都简洁了不少,至此如果不付费的话,就可以安心合法的使用软件了。

当然,你也可以在 elasticsearch.yml 配置文件中的 xpack.license.self_generated.type 修改为 basic 来禁用 X-Pack 相关功能。

xpack.license.self_generated.type: basic

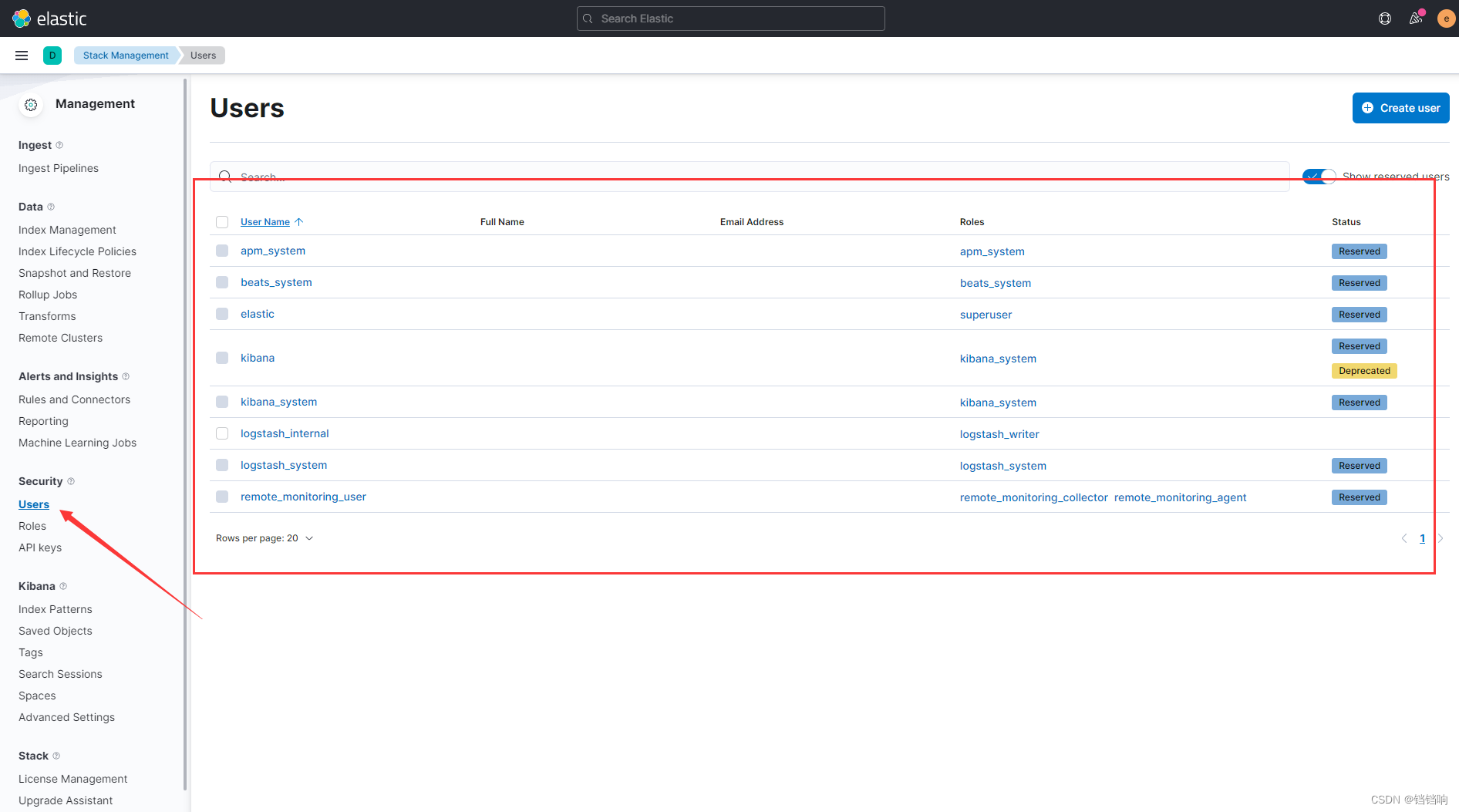

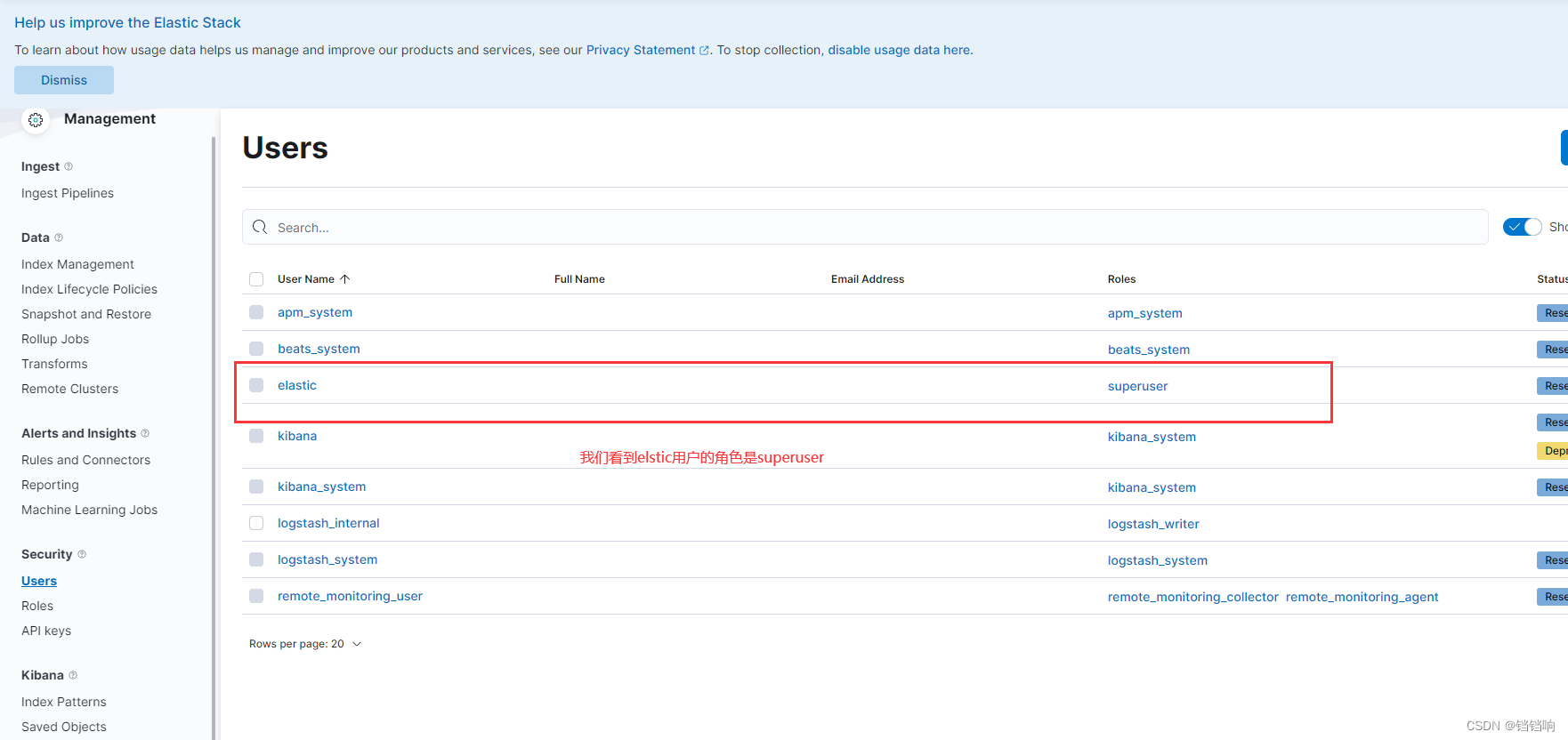

3、用户角色管理,在这里我们就可以修改用户,赋予权限,以及创建角色等等。

三、项目springBoot 日志集成进去

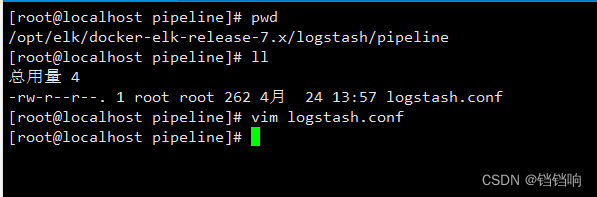

3.1、修改logstash的数据转化格式配置

1、文件挂载在/opt/elk/docker-elk-release-7.x/logstash/pipeline目录下

修改之后内容如下

input {

tcp {

mode => "server"

host => "0.0.0.0"

codec => json_lines

port => 4560

}

}

## Add your filters / logstash plugins configuration here

output {

elasticsearch {

hosts => "elasticsearch:9200"

user => "logstash_internal"

password => "${LOGSTASH_INTERNAL_PASSWORD}"

index => "%{[applicationName]}-%{+YYYY.MM.dd}"

}

}

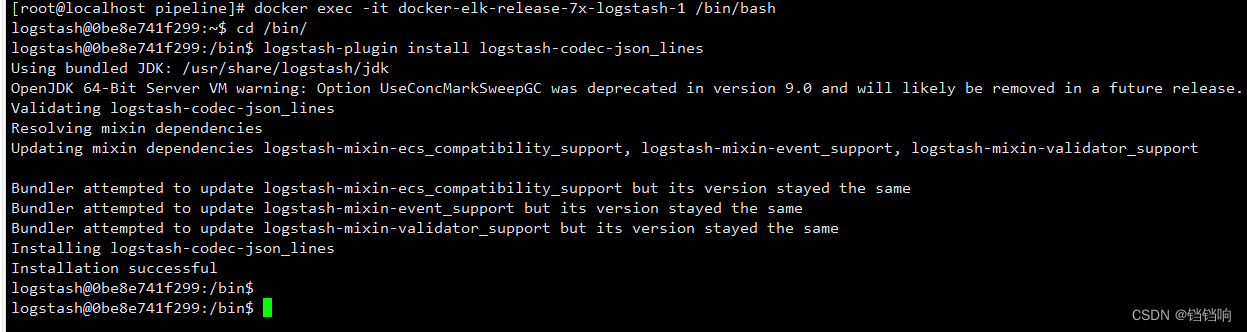

3.2、安装json_lines插件

1、在logstash中安装json_lines插件,因为我们在4560端口使用的使用tcp,并配置了json_lines插件,所以需要安装一下,安装时间较长,可以稍微等下。

# 进入logstash容器

docker exec -it docker-elk-release-7x-logstash-1 /bin/bash

# 进入bin目录

cd /bin/

# 安装插件

logstash-plugin install logstash-codec-json_lines

# 退出容器

exit

# 回到docker-compose.yml 目录下后 重启服务

cd /opt/elk/docker-elk-release-7.x

docker-compose restart

3.3、springBoot 日志传输

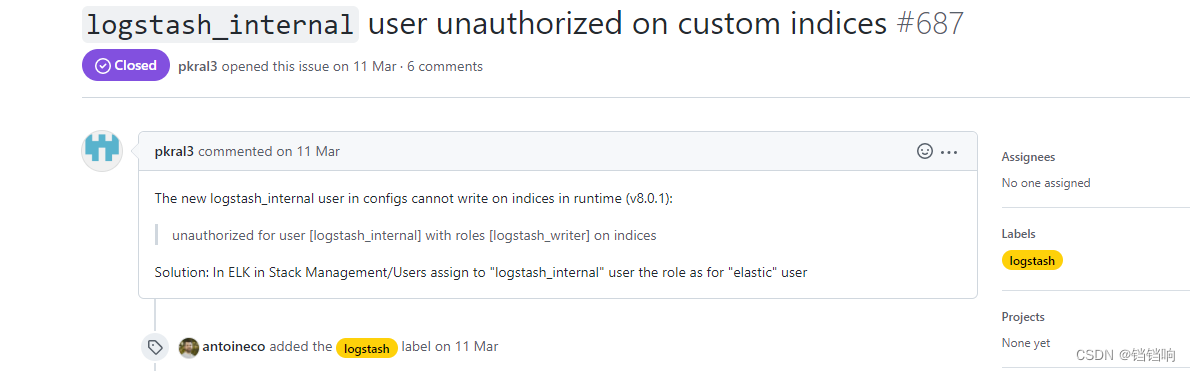

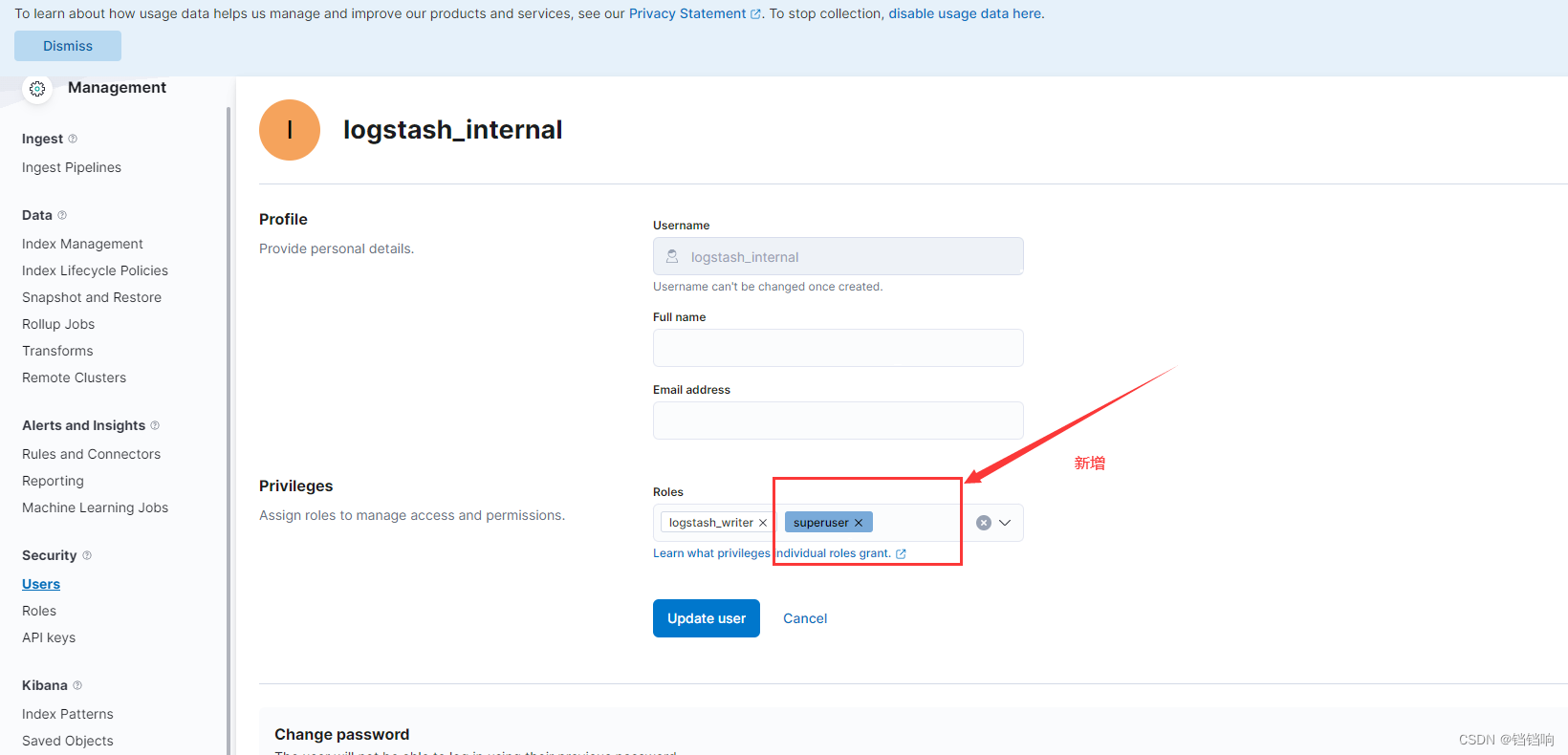

1、具体的 logback-spring.xml 文件内容和上面的一样,我就不再多说了。但是后面我发现一个问题,就是开启认证之后,我们传输数据也需要认证。这个是我看logstash的日志发现的,说 logstash_internal 这个用户没有对自动创建的索引写入的权限。因为内部默认使用的是这个用户,于是我当github官方下看了下,有人有遇到这个问题,并提出了,也解决了。

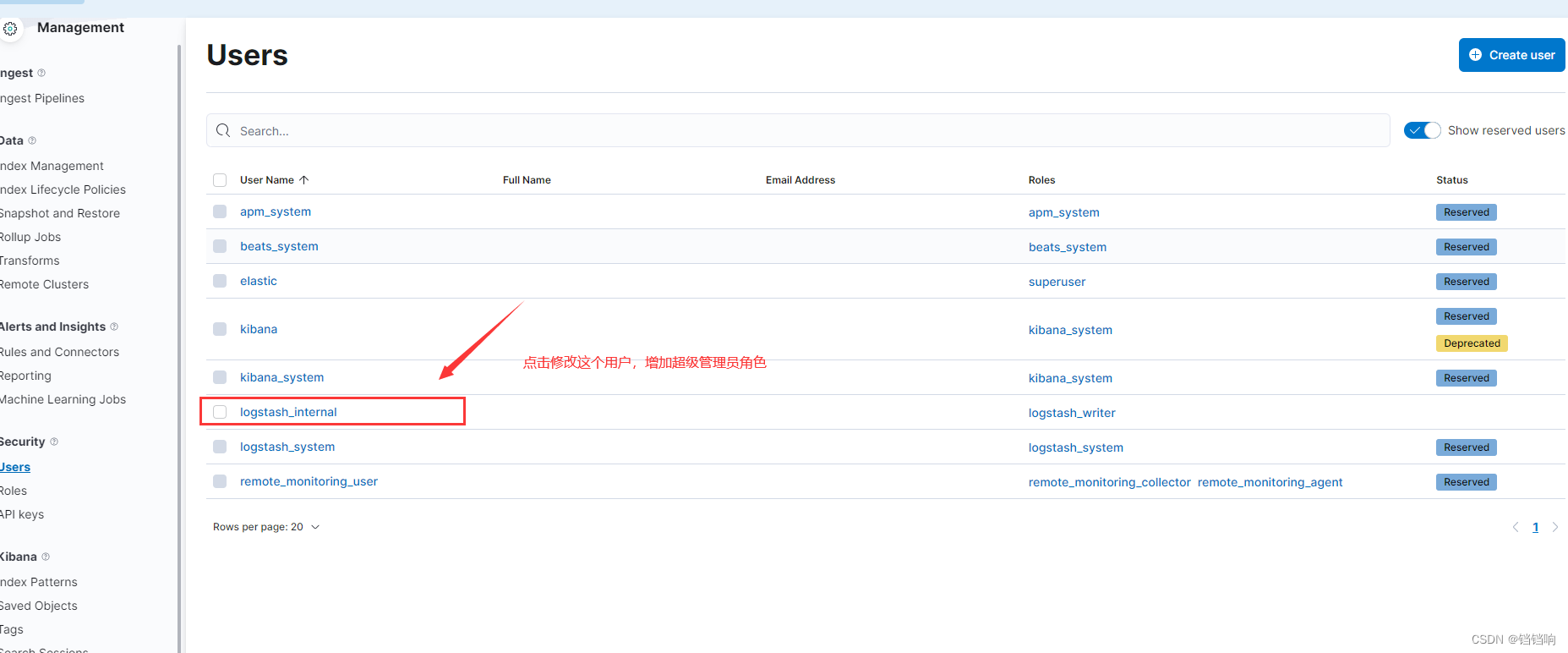

2、github 的issues 地址 : logstash_internal user unauthorized on custom indices #687,临时解决方案:在堆栈管理/用户中的 ELK 中,将“elstic”用户的角色分配给“logstash_internal”用户,因为elastic 用户用的角色是超级管理员。我们给 logstash_internal 这个用户超级管理员的角色就可以暂时解决了.

3、登录我们的kibana

4、那这个时候,我们链接elastic也是需要账号密码的,就是正常的springBoot链接elastic的方式配置就好。