НсАЭЗжДЪ javaАцБОЪЕЯжЗНЪН

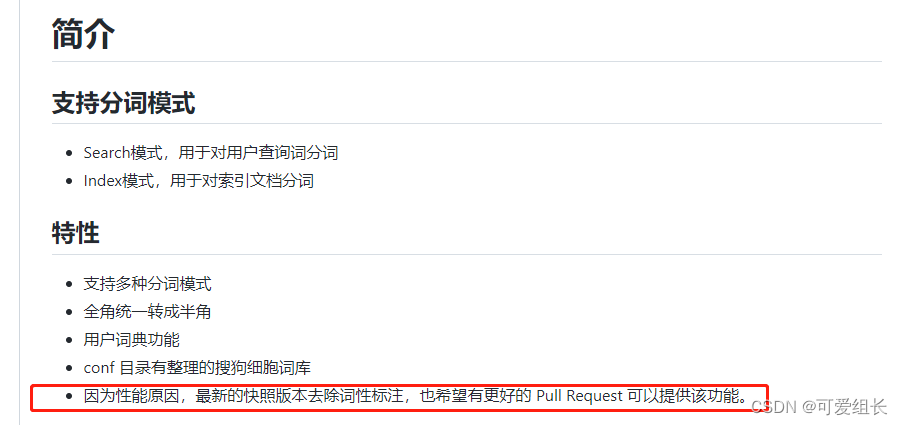

ЧАбд

зюНќвђЮЊашвЊбЇЯАаТЮХЭЦМіЯрЙиЕФжЊЪЖ,ЫљвдбЇЯАЗжДЪЯрЙиЕФжЊЪЖ

1в§Шы pom вРРЕ

<dependency>

<groupId>com.huaban</groupId>

<artifactId>jieba-analysis</artifactId>

<version>1.0.2</version>

</dependency>

ЦеЭЈЗжДЪЪЕЯжДњТы

import com.huaban.analysis.jieba.JiebaSegmenter;

import data.recomend.util.TextDealutil;

import org.apache.commons.io.FileUtils;

import java.io.File;

import java.io.IOException;

import java.util.List;

import java.util.stream.Collectors;

public class SplitWord {

private static String basePath = "C:\\project\\idea4\\dataRecommend\\src\\main\\resources\\data\\";

public static void main(String[] args) throws IOException {

String content = "ЁЖПЊЖЫЁЗЁЖОЕЫЋГЧЁЗЁЖЬдН№ЁЗШ§ВПШШВЅОчОљгаЫ§,ФуЗЂЯжСЫТ№?";

content = TextDealutil.specialCharacters(content);

List<String> stop_words = FileUtils.readLines(new File(basePath + "files\\stop_words.txt"));

JiebaSegmenter segmenter = new JiebaSegmenter();

List<String> result = segmenter.sentenceProcess(content);

System.out.println("УЛгаЙ§ТЫЭЃгУДЪ======" + result);

result = result.stream().map(o -> o.trim()).filter(o -> !stop_words.contains(o)).collect(Collectors.toList());

System.out.println("Й§ТЫЭЃгУДЪ=========" + result);

}

}

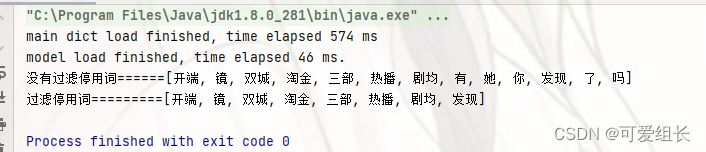

НсЙћеЙЪО:

stop_words.txt ЭЃгУДЪРрЫЦгквЛаЉЗћКХ,ЛђепгяЦјДЪжЎРрЕФ,ЭЈЙ§вдЩЯЕФВтЪдНсЙћПЩвдПДГіРД

!

"

#

$

%

&

'

(

)

*

+

TextDealutil,здЖЈвхЕФШЅГ§ЮФБОЕФЬиЪтзжЗћ,ПЩвдВЛашвЊетИіРр,ЛђепздМКжиаДЖдЬиЪтзжЗћНјааЬцЛЛвВаа

2 МгдиздЖЈвхДЪЕф

2.1 ЧщПі

ЖдгкФГаЉЗжДЪ,гІИУЪЧЗжГЩвЛИіДЪ,ЕЋЪЧЗжГіРДШЗЪЕЖрИіДЪЕФЧщПі,БШШчЫЕ

БШШчвЛаЉзЈвЕУћДЪ,ЛЙгавЛаЉШЫУћжЎРрЕФ,ЁАжмЖЌгъЁБ,ЮвУЧЯЃЭћЗжДЪжЎКѓЕФЪЧЁАжмЖЌгъЁБ,ЖјВЛЪЧЁАжмЁБЁЂЁАЖЌгъЁБетбљЕФЁЃ

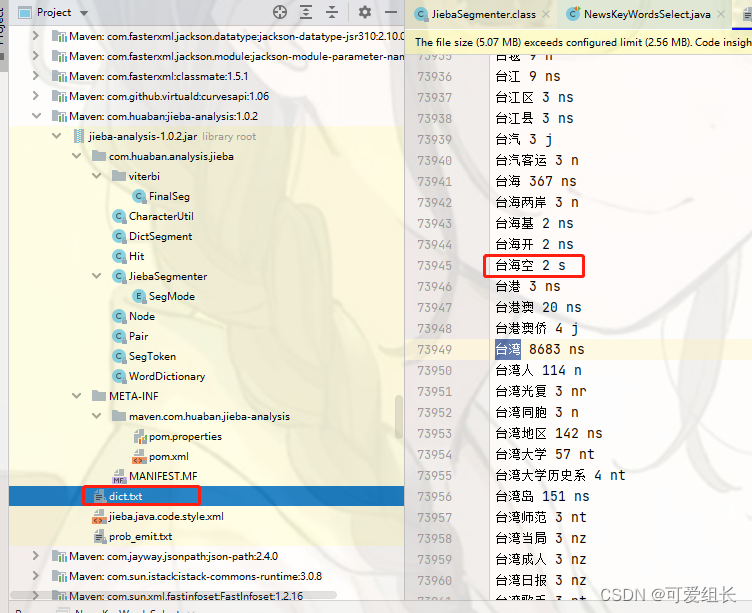

ЦфЪЕНсАЭЗжДЪФЌШЯЕФЪЧЪБКђ,ЛсМгдиАќЯТЕФвЛИіФЌШЯdict.txt

УПвЛИіЙиМќДЪвЛаа,УПвЛСаЗжБ№БэЪО:ЙиМќзж,ДЪЦЕ,ДЪад,гУПеИёЗжИєПЊЕФ

ЫљвдЮвУЧдкздЖЈвхДЪЕфЕФЪБКђ,вВашвЊАДееетИіИёЪН,ШЛКѓМгдиЕНЛЗОГжа

2.2здЖЈвх ДЪЕф dict.txt

жмЖЌгъ 3 n

ЙљАЌТз 3 n

еХгъі 3 nr

СжжЃдТ 3 nr

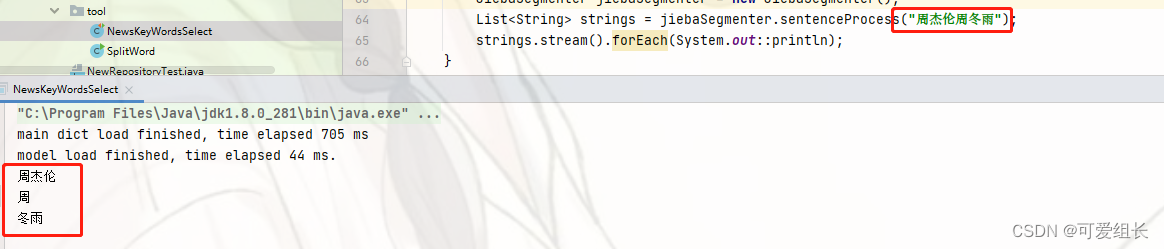

2.3 МгдиздЖЈвхДЪЕф

вВОЭЪЧЭЈЙ§ WordDictionaryМгдиздЖЈвхЕФДЪЕф

// МгдиздЖЈвхЕФДЪЕф

Path path = FileSystems.getDefault().getPath(basePath+"/files", "dict.txt");

WordDictionary.getInstance().loadUserDict(path);

JiebaSegmenter jiebaSegmenter = new JiebaSegmenter();

List<String> strings = jiebaSegmenter.sentenceProcess("жмНмТзжмЖЌгъ");

strings.stream().forEach(System.out::println);

НсЙћ

main dict load finished, time elapsed 578 ms

user dict C:\project\idea4\dataRecommend\src\main\resources\data\files\dict.txt load finished, tot words:4, time elapsed:0ms

model load finished, time elapsed 43 ms.

жмНмТз

жмЖЌгъ

ДђгЁЕФНсЙћАќКЌМгдиЯюФПТЗОЂЯТздЖЈвхЕФДЪЕфКЭНтЮіНсЙћ

3ЙигкДЪадЕФЮЪЬт

3.1 python жаЙигкДЪадЕФЪЙгУЗНЪН

jieba.analyse.extract_tags(

self.content,

topK=10,

withWeight=False,

allowPOS=('ns', 'n', 'vn', 'v')

)

## вдЯТЮЊзЂЪЭ

Extract keywords from sentence using TF-IDF algorithm.

Parameter:

- topK: return how many top keywords. `None` for all possible words.

- withWeight: if True, return a list of (word, weight);

if False, return a list of words.

- allowPOS: the allowed POS list eg. ['ns', 'n', 'vn', 'v','nr'].

if the POS of w is not in this list,it will be filtered.

- withFlag: only work with allowPOS is not empty.

if True, return a list of pair(word, weight) like posseg.cut

if False, return a list of words

Цфжа allowPOS,БэЪОЗжДЪНсЙћжЎКѓ,БЃСєЪВУДДЪадЕФЗжДЪ,

topKБэЪОИљОнХХађжЎКѓЕФНсЙћ,ШЁЧА TopKИіНсЙћ

if allowPOS:

allowPOS = frozenset(allowPOS)

words = self.postokenizer.cut(sentence)

else:

words = self.tokenizer.cut(sentence)

freq = {}

for w in words:

## ЛёШЁжИЖЈДЪадЕФЗжДЪНсЙћ

if allowPOS:

if w.flag not in allowPOS:

continue

elif not withFlag:

w = w.word

wc = w.word if allowPOS and withFlag else w

## ЭЃгУДЪЙ§ТЫЕФЕиЗН

if len(wc.strip()) < 2 or wc.lower() in self.stop_words:

continue

freq[w] = freq.get(w, 0.0) + 1.0

total = sum(freq.values())

for k in freq:

kw = k.word if allowPOS and withFlag else k

freq[k] *= self.idf_freq.get(kw, self.median_idf) / total

# ХХађ

if withWeight:

tags = sorted(freq.items(), key=itemgetter(1), reverse=True)

else:

tags = sorted(freq, key=freq.__getitem__, reverse=True)

# ШЁХХађКУЕФTopKИіНсЙћ

if topK:

return tags[:topK]

else:

return tags

3.2 java жаЕБЧААцБОВЛжЇГжДЪад

дкhuaban ЕФ github ЕижЗжа

https://github.com/huaban/jieba-analysis

гаЙигкНщЩм,вВОЭЪЧЫЕЕБЧАетИіАцБОУЛгаВЛжЇГжДЪадЗжДЪ