������:Pandas���ܽ��ܼ�Ӧ��

�ֶ�������,��ֹת��: ԭ����ַ https://blog.csdn.net/lys_828/article/details/119103730(CSDN����:Be_melting)

֪ʶ��������,�������Ͷ��ɹ�,���½�������CSDN��վ��,��������վ�����ò��ľ�����δ��������Ȩ�Ķ�����ȡ��Ϣ

1 Csv��Excel�ļ���ȡ��д��

1.1 Csv�ļ���ȡ��д��

1.1.1 Csv���ݶ�ȡ

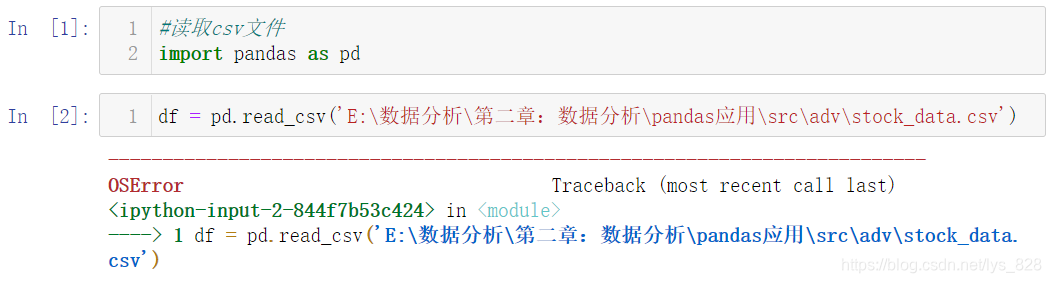

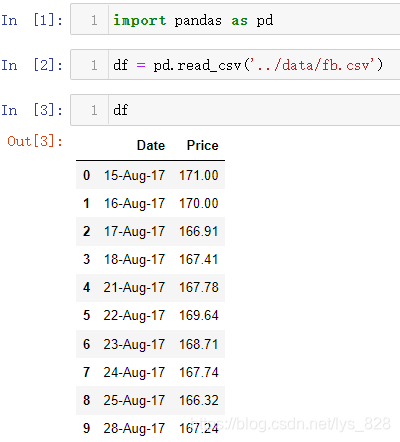

������һ�ݹ�Ʊ����Ϊ��,����Pandas�������ݶ�ȡ,�����������,ֱ�ӽ��ļ�����·�����Ƶ�������,ֱ�ӽ��ж�ȡ�ᷢ������

ԭ����������ķ�������:

- �ļ�·���в���ֻʹ��

\,��Ϊ\��python�ַ����б�ʾת���ַ�(��ʱ������ͻᱨ��) - �����ʽ������(����·��):

/��\\��r - ��ֱ��ķ�ʽ:���·��

(1)ʹ�þ���·��(���ļ���ȫ��·����Ϣ��������)��ȡCsv�ļ�����

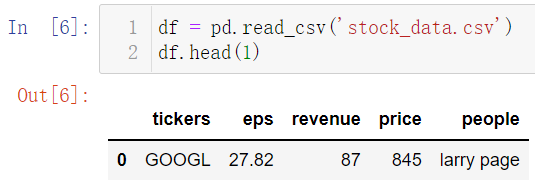

(2)ʹ�����·����ȡCsv�ļ�:��IJ������ǰ�Ҫ��ȡ�������ļ���python�ļ�����ͬһ�ļ�����,ֱ�Ӷ�ȡ�Ͳ��ᱨ��

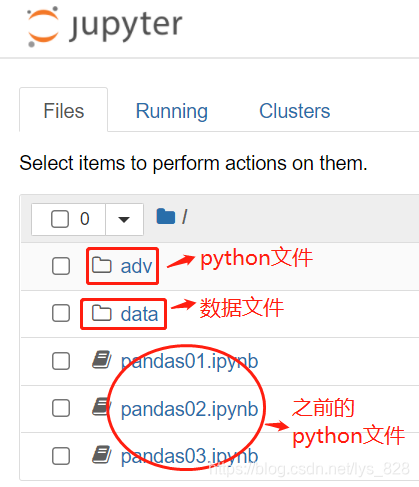

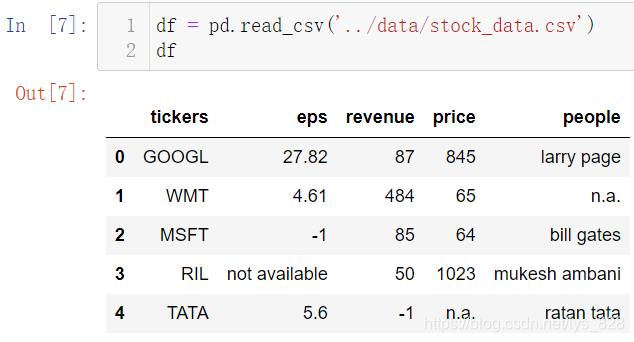

�����������ڴ��������ļ�ʱ��IJ���,����Ϊ������һ�����õ�ϰ��,֮�������������������ݺͷ��������ж����ʱ��,������Ѹ������̷�����python�ļ���������һ���ļ�,�����ٷ�����һ���������ļ�����,������������Ĺ���(�ر���������д��֮����������ļ���У��,���е����ݶ���һ���ļ����оͷ������),����������ǽ����е�pyhton�����ļ�����adv�ļ�����,���ݷ���data�ļ�����,�������ļ��ж�����src�ļ�����

��ʱ���ȡ���ݵķ�ʽ�������·���;���·�����(ǰ���..�����Ŵ��ļ����ڵ���һ���ļ���)

1.1.2 ����ָ���ж�ȡ����

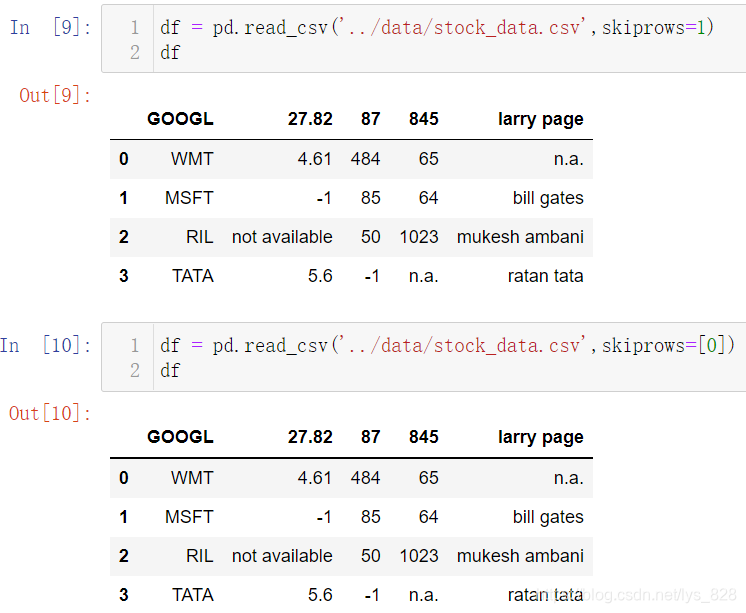

ǰ���ڽ���Pandas������ʱ���н���skiprows����,���ﲹ�佲һ��,�ò�����ֵ����ֱ������������,Ҳ�������б�����

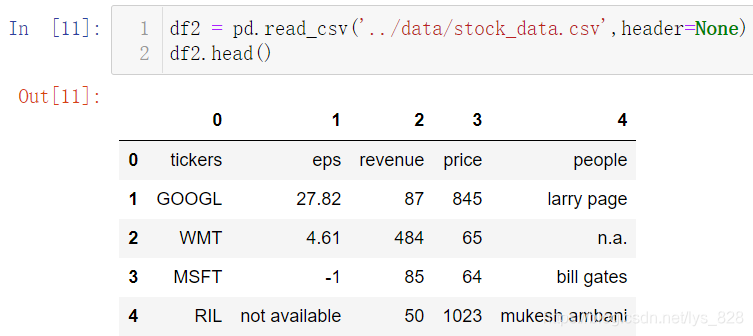

��Ҫע��ľ���������б�,�м�ȡֵ�Ǵ�0��ʼȡ��,������ʾskiprows=[0]��ͬ��skiprows=1����ʾ������һ���ٶ�ȡ���ݡ�ֱ�Ӹ�ֵ��������n,��������ǰn��;�����ֵ���б�,����ָ������һЩ�м䲻��Ҫ������,�������ܹ��˵�һЩ����Ҫ���С���������ָ����skiprows=[1,3,4],�൱��������2��4��5�������ٶ�ȡ(ע��:�˴��ֶ������ڵ���Ϊ��1��)

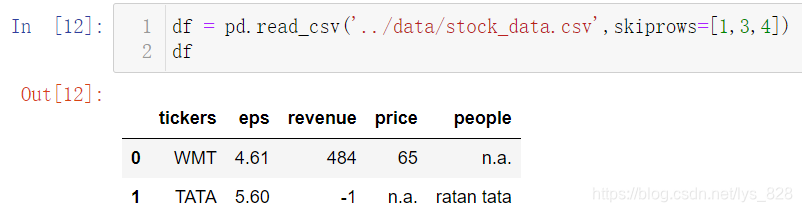

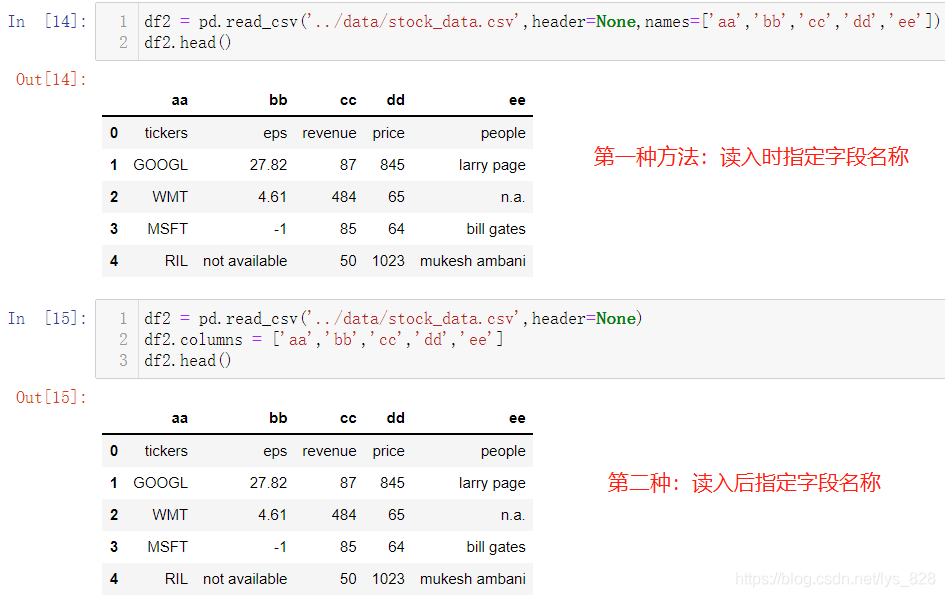

1.1.3 �ֶ����Ʋ���

֮ǰ�����headers=None����������,ֱ�ӽ��ֶ����ƺ���,�Զ������0��ʼ����������������,����

����֮��,��������������names��������ʹ��,�ٴ���û���ֶ����Ƶ�����ʱ��,ֱ��ָ��,�ٻع�һ��֮ǰ������,���߾������ֶ����ƴ��������ַ�ʽ

1.1.4 ��ȡָ������������

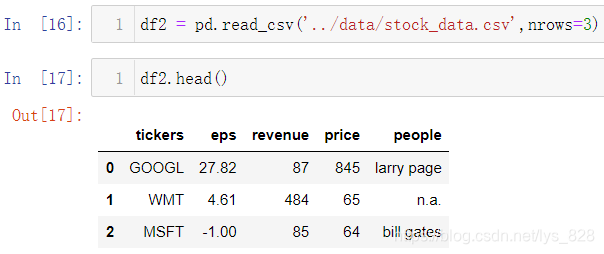

��ʱ������̫��,����Ҫ��ȡȫ��������,ֻҪ��������IJ������ݵ���ȡ�Ϳ���,��ô����Ҫֱ�Ӷ�ȡָ��Ҫ�������,����ոյ���������ֻ��5��,����ָ����ȡ3��

ͬʱҲ���������֮ǰ���ܵ�skiprows����ʹ��,����

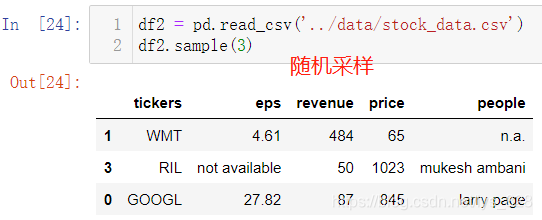

����ķ�ʽֻ�ܻ�ȡ�̶������µ�����,���˵��Ҫ�������,��ȡָ�����ȵ�����,����ʹ��sample(n)��ʽ,����n�ʹ�����������

1.1.5 ���ݴ���Csv

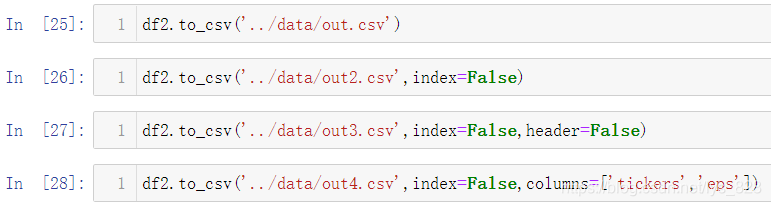

���ݴ�����Ϻ�,��Ҫ���浽����,����ʹ��to_csv()�ķ���

- (1)ֱ����д·�������κβ���,�������DataFrame���������ر����ڱ���

- (2)

index=False����,ȡ����һ�е�����ֵ,���������01234����Ĭ����ֵ,�����������,����������к����������,һ�㲻�����ȡ��,����Ҫ����ʵ���������� - (3)

header=False����,�����������ɵ������������ֶ�����,�Ϳ���ʹ����������趨 - (4)

columns=['xxx']����,����ֻ�����б��к��е������ֶ�,�൱�ڽ�������ָ���б���

1.2 Excel���ݶ�ȡ��д��

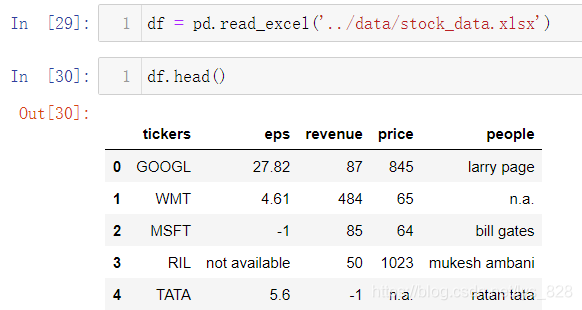

1.2.1 Excel����Ĭ�϶�ȡ

����ʹ�øոյĹ�Ʊ����,�ļ���ͨ��csv�ļ�����ΪExcel�ļ�,�����������������ڵĵ�ַ,��ȡ��������

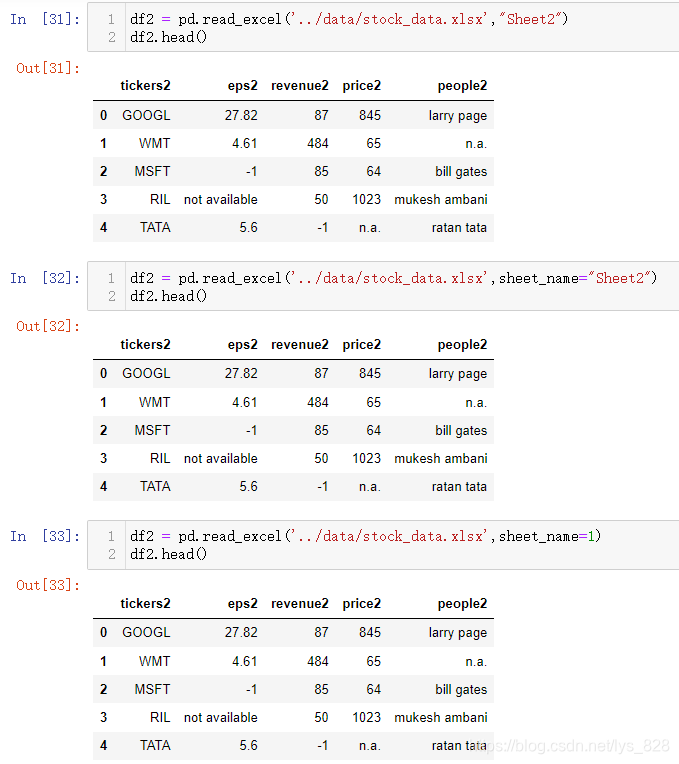

1.2.2 ָ��sheet���ж�ȡ

Excel�л���ڶ������(sheet),ÿ�������ж���������,��ʱ���ݲ�������Ĭ�ϵĵ�һ��������,��˾�����Ҫ���ݲ�ͬ�ı�����ȡ����,���罫ԭ���������ݸ���һ�ݵ��ڶ��ݱ�����,Ϊ��������,���ֶ����ƺ����Ӹ�2

�ؼ�����Ϊsheet_name,�ò���Ϊ�����еڶ���λ�õIJ����Ҹ�ֵ����Ϊ����Ҳ����Ϊ�ַ���,�������ļ�·������ֱ�������Ӧ�ı���ͨ��λ�ò������ݻ���ֱ��ͨ���������Ƹ�ֵ���ݱ���������,����(sheet_nameĬ��ֵΪ0,����ȡ��һ��sheet�е�����,�ڶ���sheet�����Ͷ�Ӧ��sheet_name=1)

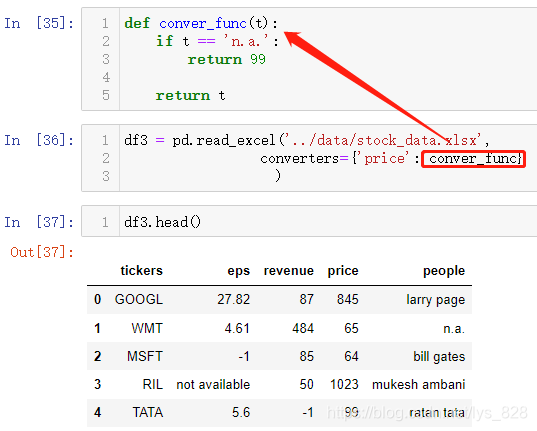

1.2.3 �������ݳ�������

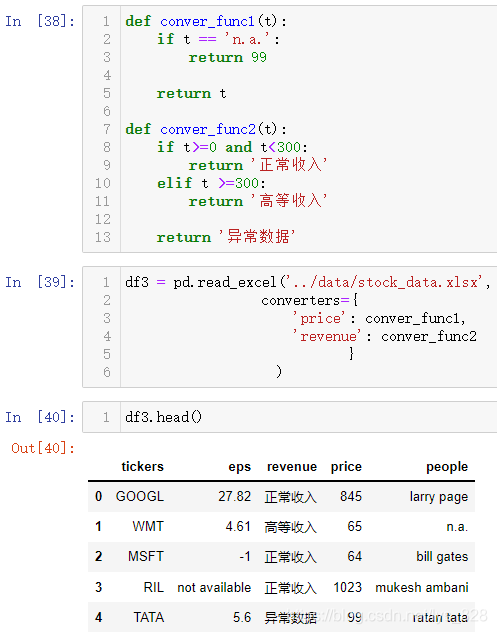

��ʱ���õ��������������ȱʧֵ�����쳣ֵ,�ڶ�ȡ���ݹ��̾;Ϳ���ֱ�ӽ��д���,����������ϴ�����������ݡ���Ҫʹ�õ�converters����,��ֵ��Ӧ��һ���ֵ�,����ļ�Ϊ�ֶ�����,ֵ��Ϊ�������ֶεķ���/����,����price�ֶ��д�����n.a.����(ȱʧֵ),����ֱ�ӽ����滻

���紦���쳣ֵ,������һ���ķ�Χ��������,��������300�趨Ϊ������(���ﲻ֪������ĵ�λ,ֻ��������ʾ),Ȼ������Ȼ���쳣���ݡ�ͨ��converters�����Ϳ���ʵ�����ݵij�����ϴ

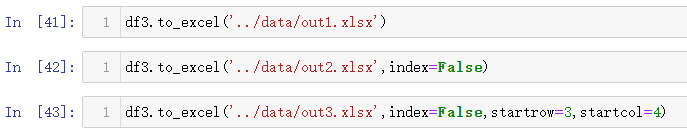

1.2.4 ���ݱ���ΪExcel�ļ�

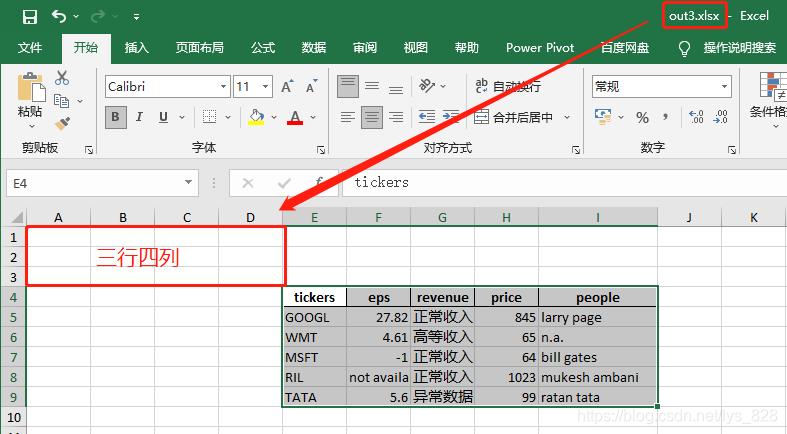

���ݴ�����Ϻ�Ϊԭ�����ļ���ʽ,����IJ�����֮ǰ����Csv�ļ����ơ�����Excel���Ǵ����к���,���Ը��Ӿ���ָ�����ݱ���λ�ÿ�ʼ�ķ�Χ,����Ҫ����ӵ�3�к͵����п�ʼ

���out3.xlsx�ļ�����������(startrow��startcol���������൱��ָ�����ݴ����Excel��ƽ�Ƶ�λ��)

1.2.5 �������ݵ�ͬһ�ļ��µIJ�ͬsheet��

ǰ������˶�ȡ��ͬsheet�е�����,��Ȼ��ʱҲ���н����ݱ��浽��ͬsheet������,�����ģ���������

with pd.ExcelWriter('../data/combine.xlsx') as writer:

df3.to_excel(writer,sheet_name='df1')

df3.to_excel(writer,sheet_name='df2',startrow=3,startcol=4)

���е�һ���е��ļ�·������Ҫ������ļ�����,Ȼ����������������ָ��sheet������,�����ⲿ�ֻ���ͦʵ��,����Ȥ���Բο�һ�²����е�������ƪ����:ɸѡͬһ�����µĶ��sheet������ݲ������ڶ�Ӧ��sheet�� �� ��python�칫�Զ�������Word�ı���Pdf����������ȡ�����ϵ�ͬһ��Exeel�µĶ�sheet��

2 ȱʧ���ݴ���

ȱʧֵ���������ַ�ʽ:

- ֱ��ɾ��:

dropna() - ��ϲ�ֵ:

interpolate() - ���:

fillna()

2.1 �������Ͳ鿴

��ʵս�н��������ַ�ʽ֪ʶ�Լ����ʹ��,���ȼ�������,����ʹ�ô�������������

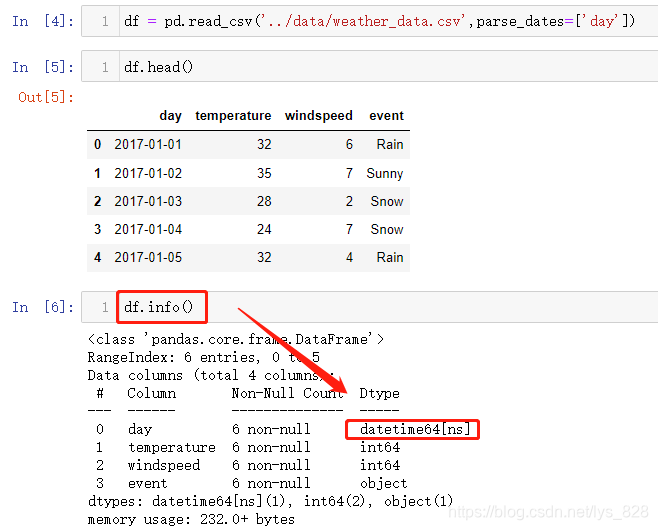

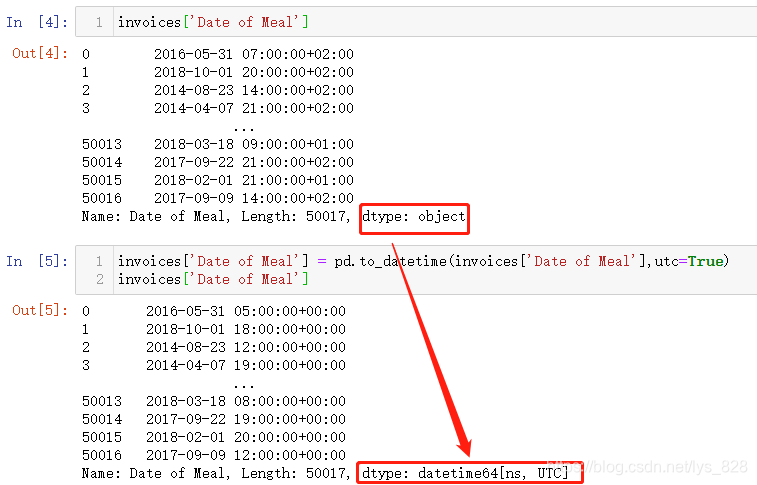

���Է��ֶ�ȡ�������а�����ʱ��,���Ƕ��������PandasĬ�Ͻ��䵱����object����(Ҳ�����ַ�����������),��˿����ڶ����ʱ��ʹ��parse_dates����,ָ��Ҫ�������ڴ������ֶ���,���ݶ�ȡ��Ϻ�,Ŀ���ֶξͻᱻ�Զ�����Ϊʱ�����������

�������ֱ�ӵ���ijһ�ֶλ���ʾ�����ֶε���������,ʹ��df.info()�����ͻ�������ֶε��������Ͷ���ʾ����

2.2 ����ȱʧֵ�鿴����ܼ���

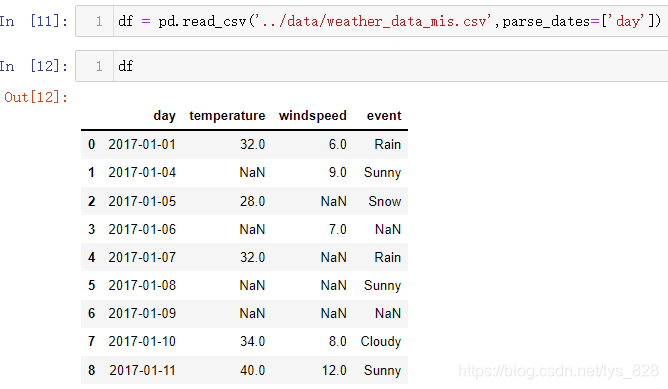

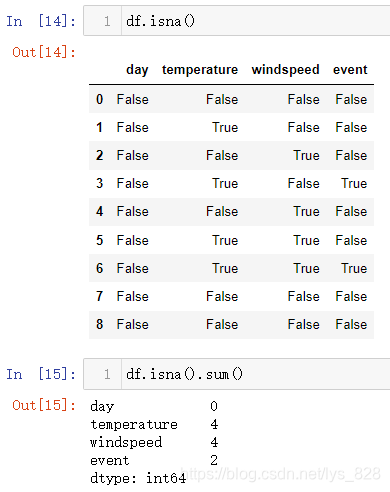

Ϊ�˻�ȡȱʧֵ,���ոյ�����������һЩ����,��Ϊ����ȱʧֵ,�ٽ��ж�ȡ����

����ͨ��isna()�������������鿴ÿ���ֶ��е������Ƿ�Ϊ��ֵ,���ʹ��sum()�������л���

2.3 ȱʧ�������

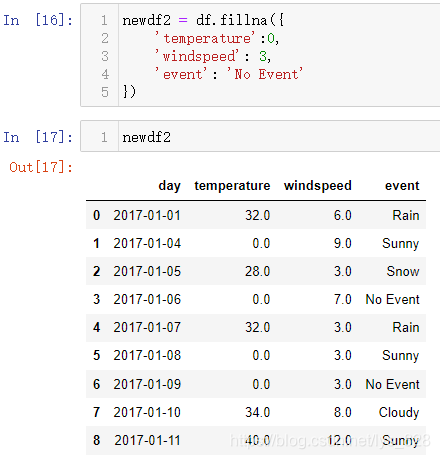

2.3.1 �̶�ֵ���

ֱ��ʹ��fillna()��������,�����֮ǰ��ȡ��������converters����ʹ��ԭ������,�����м����һ���ֵ�,��Ϊ�ֶ�����,ֵ��ΪҪ��������

2.3.2 ��ֵ̬���

�ո�ʵ�ֵ��ǰ��չ̶�����ֵ����ȱʧֵ���,����������Ҫ��һЩͳ�ƽ����������,ÿ������ֱ��û�к�ǿ�Ĺ�����,������ϵ�������һЩ�����й��ɵ�����,�����Ʊ,�����������͵�����,���Թ̶�ֵ���Ͳ�������,��˾����˶�̬��������

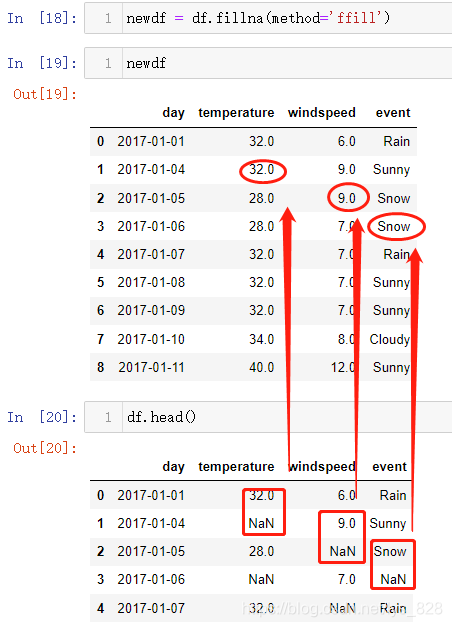

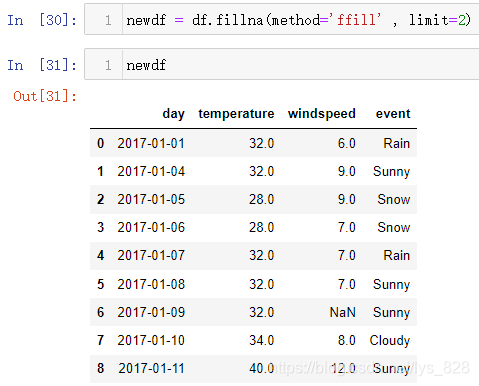

(1)��ǰ���:ffill

���յ�ǰ�ֶ���ǰһ��ֵ,�Ը�ȱʧֵֵ�������

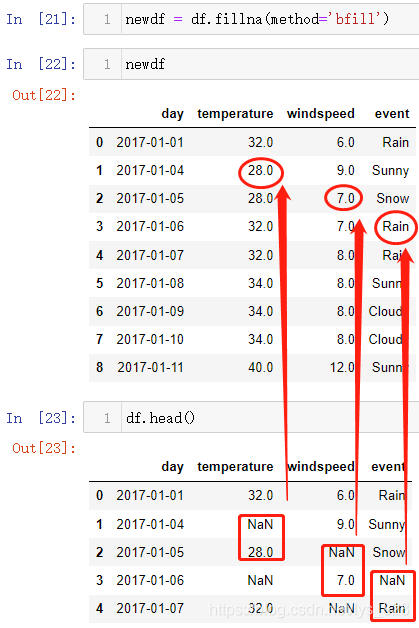

(2)������:bfill

ע���:��̬������覴�,�����ݵĵ�һ�л��ߵ����һ�д���ȱʧֵʱ(ǰ�漸������ȱʧ�������������ȱʧ),��̬����Ǵ������˵�,����Ҫ���֮ǰ�Ĺ̶�ֵ���ķ���,�������������,���������ʹ�þ������ȱʧֵ���IJ���

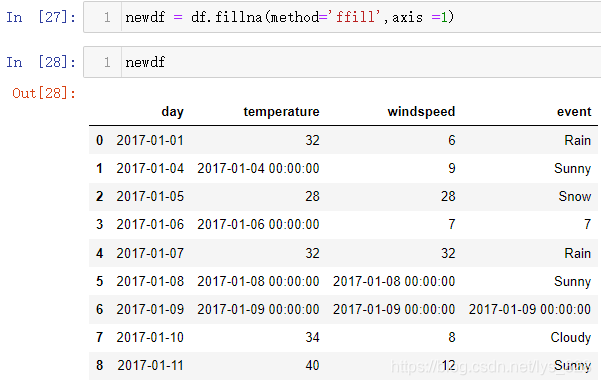

�����: �����Ҫ�Ժ��������Ϊ���������,�����ַ�ʽ,��һ�ֿ���ʹ��axis = 1 ����axis = ��columns������;�ڶ��ַ�ʽ���ǽ�df����ת��new_df = df.T,����֮ǰ�IJ����Ͷ�����ʹ��,����������ת�û�����ok��

����,����һ��limit����,�������ĸ���,����

2.4 ȱʧ������ϲ�ֵ

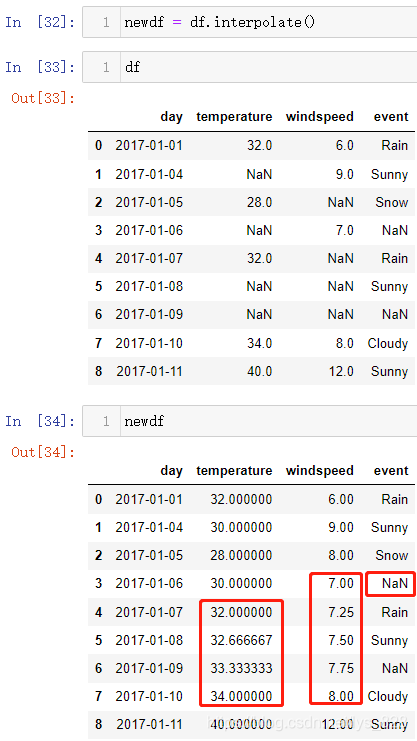

2.4.1 ֱ����ֵ����������ϲ�ֵ

interpolate()����Ĭ�Ͼ��Ǹ�����ֵ����������ȱʧֵ�Ĵ���,�������¡����������ܿ��Կ���,��Ȼ��������ֵ����,��ô�ַ����������͵�ȱʧֵ��û�а취����,������ֵ������,�����������е�����,���Ǹ���ȱʧֵǰ�������Ȼ���ټ����м�ȱ���ݵĸ���,�����еȱȴ���

2.4.2 ����ʱ������������ϲ�ֵ

ͨ��method='time'���в���,ע��������Ҫ��Ϊʱ����������,��Ҳ��ǰ��Ҫת��ʱ���������ݵ�ԭ��,���Ƚ���������Ϊday,�����ٽ�����ϲ�ֵ,�����������:

- ���ֱ��ָ��

newdf = df.interpolate(method='time'),ִ�лᱨ��,�������ַ���Ҫ������Ϊʱ������ - �ڶ����ֺ������ݺ�֮ǰ��ֱ����ϲ�ֵû���κ�����,��Ҫ����Ϊ�ⲿ������ʱ����������,û�г��ָ��������

- �������ֺ������ݾ���ʾ���������,��������29,֮ǰ������30,������Ϊ��һ����ֱ����ǰ�����ֵΪ����,�����ﻹ�ο���ǰ���ʱ������

2.5 ȱʧ����ɾ��

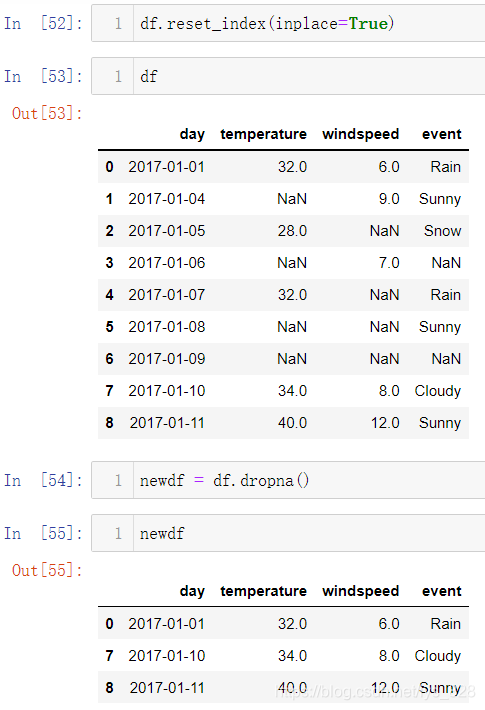

2.5.1 ��ȱʧֵ��ɾ��

���Ƚ�������ת��Ϊԭ��������,����һ������,���ֱ��ʹ��dropna()����,��ֱ�ӽ�ֻҪ���п�ֵ����ȫ��ɾ��,����������,����ֻʣ��3����Ч����

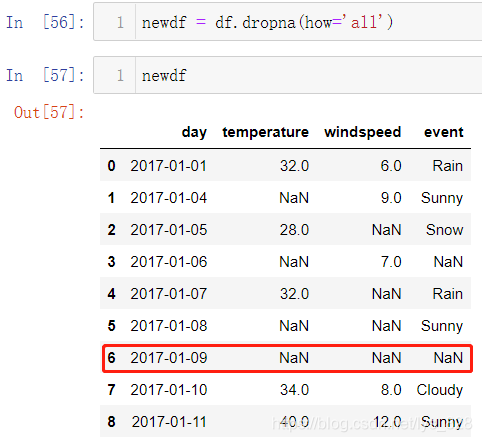

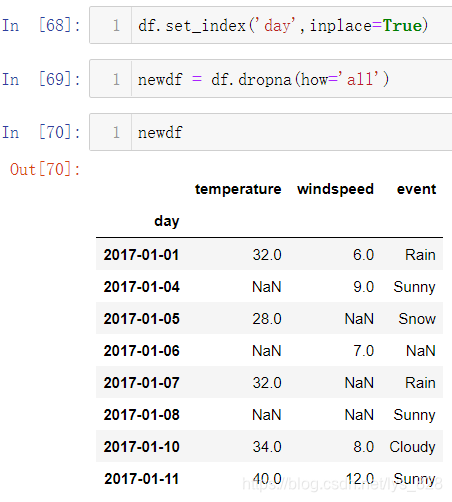

2.5.2 һ������ȫΪ�ղ�ɾ��

��ʵ��ɾ������ȫ�����ݶ�Ϊ�յ���,������Ҫ����ȱʧֵ��ɾ��,��ô�Ϳ���ʹ��how='all'�������,����������

����з�����һ��������������������ǿ�ֵ,ǰ����һ���ֶ���ʱ���ֶβ�λ��,˵�������allҪ����������ֶ�,��������ʱ�������������,���������¡��������2017-01-19���������ݾͱ������,�ٴ�֤�������all��������е��ֶ�,Ҳ���Ǵӵڶ��п�ʼ����������(��һ��Ϊ����)

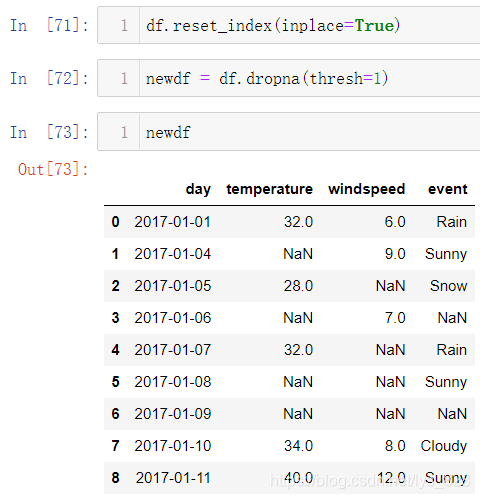

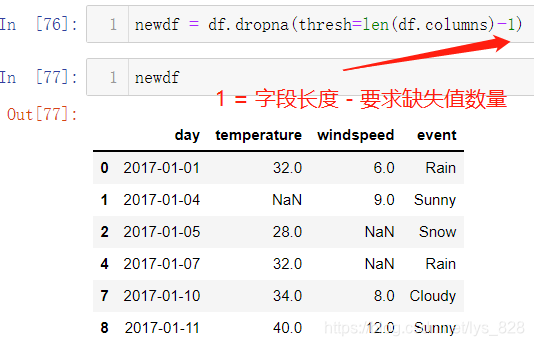

2.5.3 ָ��ȱʧֵ������������ɾ��

ǰ�������������̫������,��ʱ��ϣ�����Կ���һ��ȱʧֵ,����ȱʧֵ������ijijˮƽ,��ôÿ�г������ָ��ȱʧֵ�������вű�ɾ��,��ʱthresh�����Ϳ��Է�����Ҫ���á����ǿ����Լ�ָ���ò�����ֵ������,������������������Żᱻɾ��,��������ָ��thresh=1,����ָ�����ֶ��б���Ҫ��һ���ֶ���������,����ÿ�д��ڵ�ȱʧֵ������Ϊ:�ֶ����� - thresh

����Ҫ��ÿ�е�ȱʧֵ������Ҫ����n��,�����Ĵ���Ϊ:newdf = df.dropna(thresh=len(df.columns)-n)

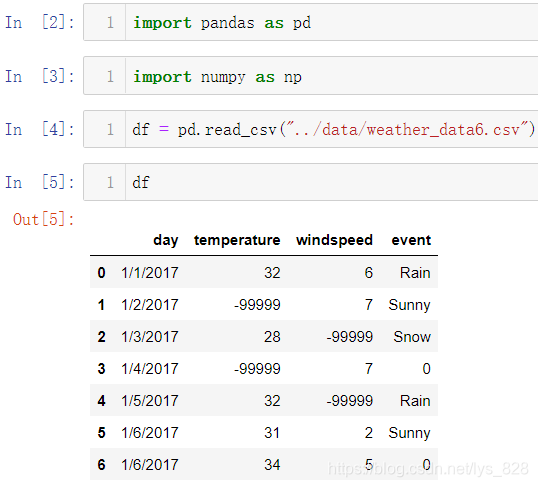

3 �����滻

���ķ���replace()

3.1 ��ֵ�滻

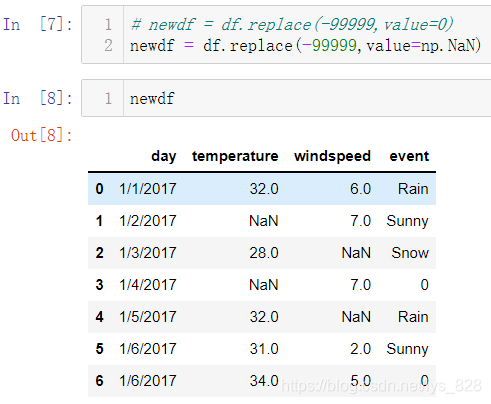

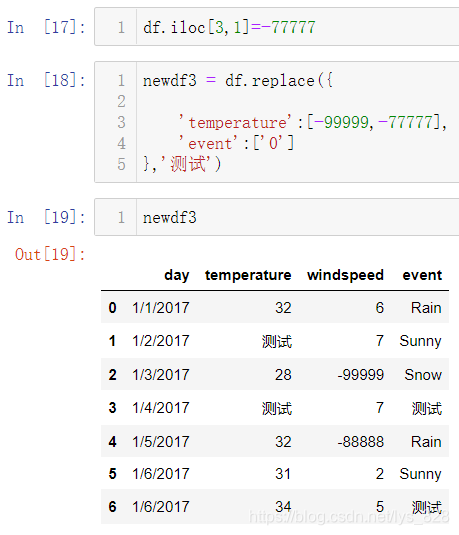

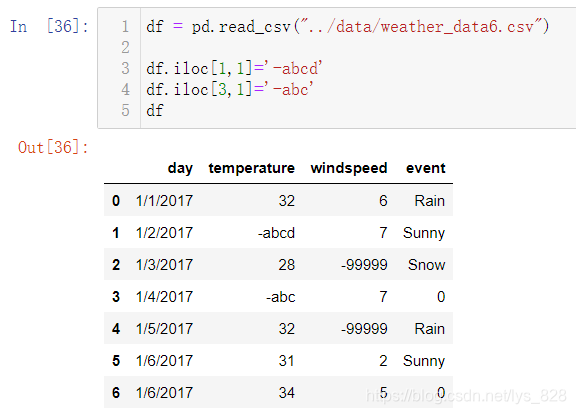

����˼����ǶԾ����ijһ��ֵ�����滻,ʹ�õ����ݻ��Ǹոյ�����,�����������ȱʧֵ��������,��ɡ��쳣ֵ����,��ȡ��������

���罫df����ֵΪ-99999�滻��Ϊָ��������(������ǰ���Ǵ��滻������,�������滻�������)

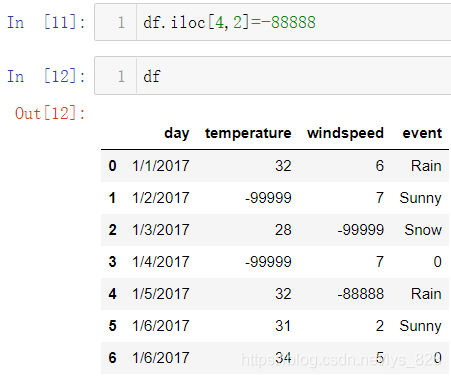

������������Ծ���ijһ��ֵ���滻,��ô������һ��Ҫ�����ijһ���嵥Ԫ�����ݵ��滻,���罫df�е�5�е�3�е�-99999�滻Ϊ-88888,����ʵ�ַ�ʽ����֮ǰѧ����iloc����ȡֵ�ķ�ʽ

3.2 ��ֵ�滻

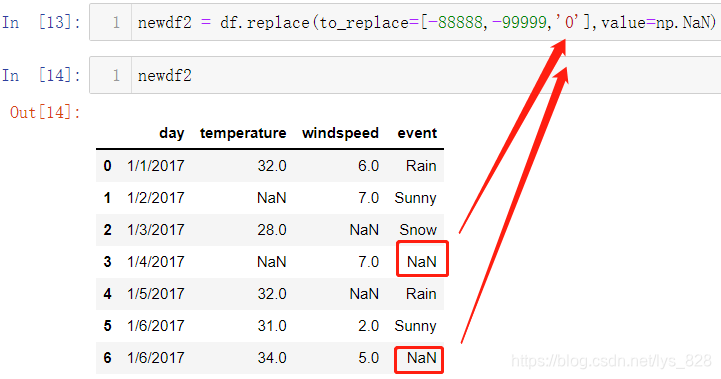

�ڵ�ֵ�滻�Ļ����ϸ���һ��,���ǽ��ж�ֵ�滻,Ҳ���ǰѶ������ͬʱת��Ϊָ��������,��Ҫͬʱʹ�õ�to_replace������value������������Ҫ�滻�����ݶ������б���Ȼ���Ƹ�to_replace����,ע������event�ֶ����ַ�����������,�����0��ȻҲ���ַ�������ʽ(�ر�����ֵ�滻ʱ,Ҫ���ĸ��ֶε���������)

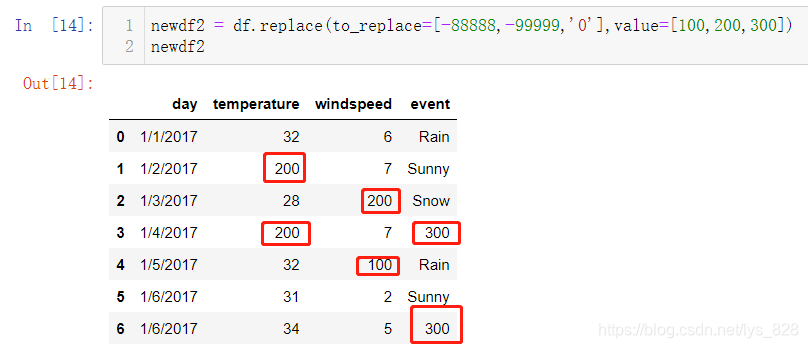

�滻���ֵ�����ǵ�һ��������Ҳ�������б�����,��Ҫ��ǰ����б�����������һ��,������Ĭ��ǰ��һһ�滻��Ӧ��

3.3 �������滻

������ʽ��֮ǰȱʧֵ���д����Լ����ݶ���Ԥ������ԭ����������,Ҳ��ͨ���ֵ����,����Ӧ�ֶ�����,ֵ��ӦҪ�滻������,������һ������Ϊ�滻�������,����������,����ֻ��temperature�ֶε�-99999��ֵ���滻����Ŀ������,windspeed�ֶ�û�з����仯,Ȼ��event�ֶ��ٴ�˵�����滻����Ҫע����������

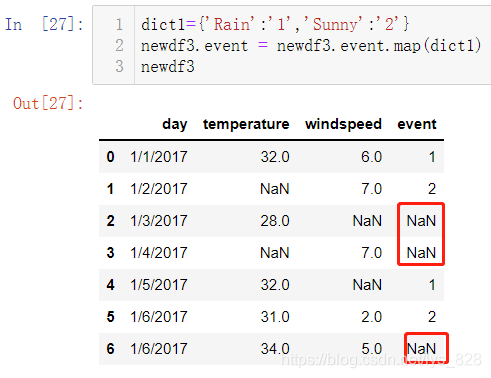

3.4 ʹ��map���������滻

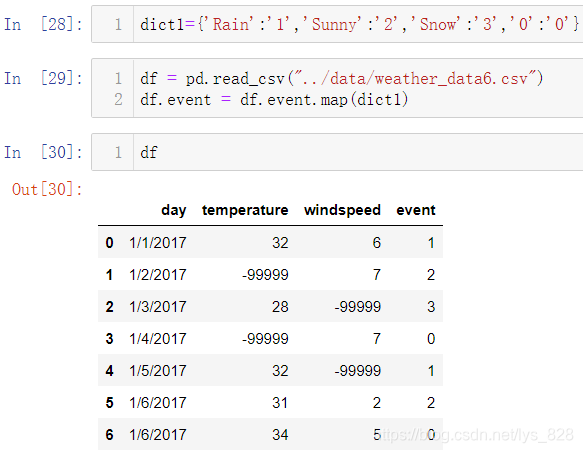

3.4.1 �����ֵ�

��һ�ַ�ʽ��ʹ���ֵ�ķ�ʽ���д���, ��Ҫע�����map����ʹ����Ե��������ij�ֶ��������滻,���ֵ��еļ�Ӧ�ð������ֶ����е�Ψһֵ,�����滻��ͻ��ɿ�ֵ,��������

����Ľ����������Ҫ��,������Ϊָ���滻�����Rain��Sunny,����Snow��0û��ָ��,���Ծ��ÿ�ֵ�������,ʹ��map�����ֵ���Ҫ�����Ե�Ψһֵ������

����Ҳ������,ʹ�����ַ���ֻ�������ֶ��е�Ψһֵ���ٵ����,������ֶ�����ķ�����������,��ô��Ҫһ��һ������,���Ҳ�Ǵ˷����ı�

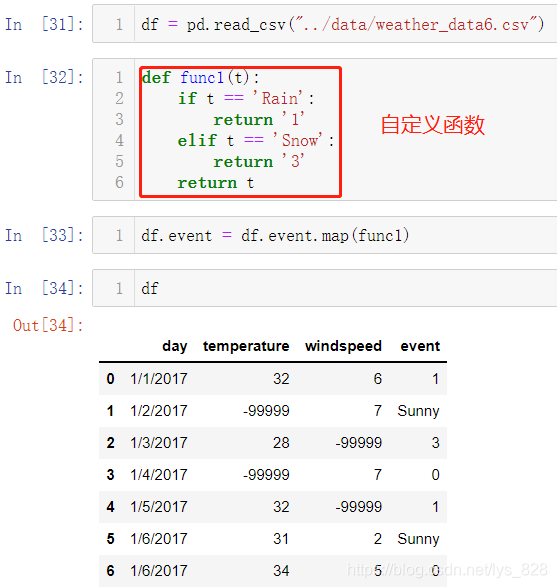

3.4.2 ���ݺ���

���ݺ����ķ�ʽ������ֵ���и������;,�൱��ʹ��һ�����������ֶ������е����ݽ��д���,���ܺ�ǿ��,������ǽ����滻�ľ���Ӧ��,��������

��������Ҳû�д����ֵ���������,û��ָ���滻�����ݻ���ԭ������ʽ���г���

3.5 ʹ���������ʽ�����滻

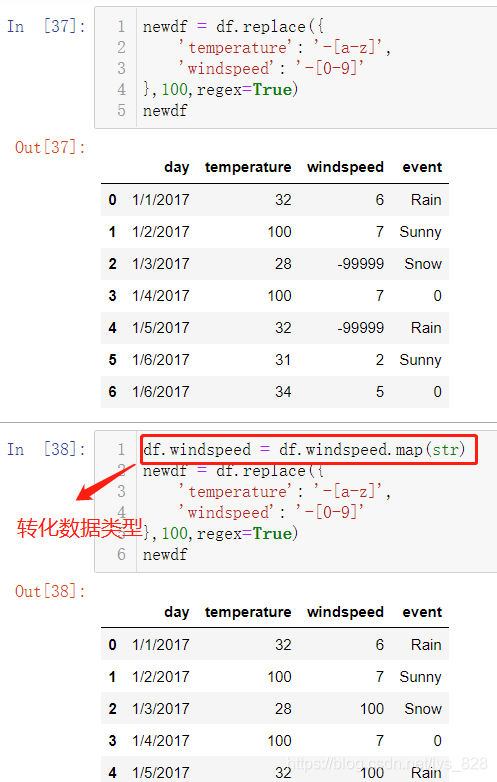

��Ҫ�ĵ����ݱȽ϶�,��������ķ�ʽ�͵�һ��һ������������,Ϊ�������Ǹ������,�Ϳ���ʹ���������ʽ�����滻�����罫temperature�ֶ��еĿ�ֵʹ���ַ������滻(������з��ŵ�����),����������

Ҫ���滻�������ŵ�����ͳһ�����滻Ϊ��ֵ(��������ֻҪ���и��ŵ�����ͳһ�滻Ϊ100),���Ӧ��ע������������ʽƥ���ǰ��������Ϊ�ַ�������,������Ч

��������ʾ���ֶ���������Ϊ�ַ���ʱ�������滻�IJ�������ʾ����,����ı��������͵�ʱ���ʹ���˸ոս������ֶε�map()������ʹ��(ֱ��ʹ��astype()Ҳ����)��֮ǰ���ܵ���map()�д��ݵ��Զ��庯��������ݵ��滻,�������ֱ��ʹ���Դ��ĺ�������ֶ��������͵�ת����map()�������Ӧ�ÿ���ʵ�ֺܶิ�Ӳ���,����������map()�����ڽ�����ݴ��������л�ʡ�ܶಽ��

4 ʱ����������

ʱ��������������ָ��DataFrame����������indexһ����ʱ������ݽ��в���,ǰ���Ѿ��й�ʱ���ֶ����ݵ�ת��������Ϊ����������,��������������һ�¾������ʱ����������һЩ����

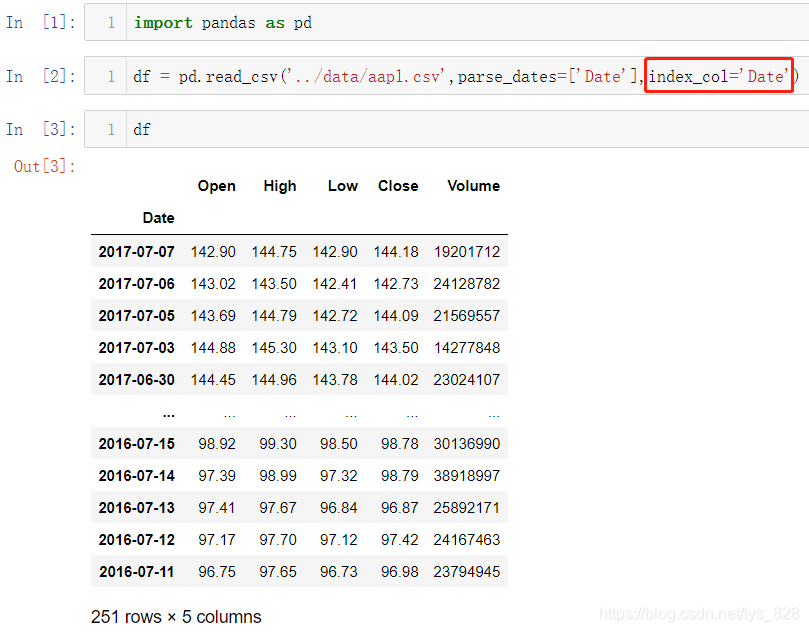

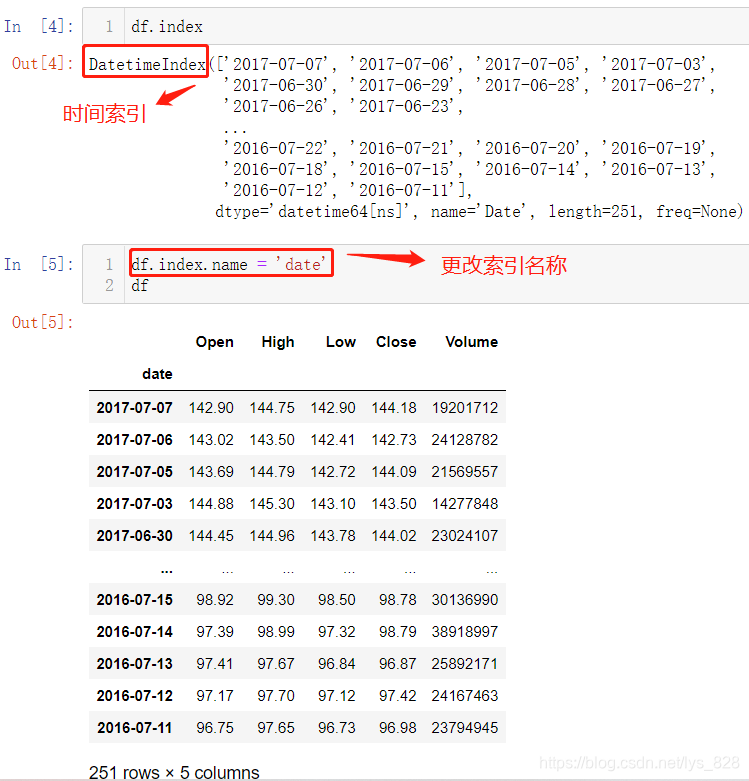

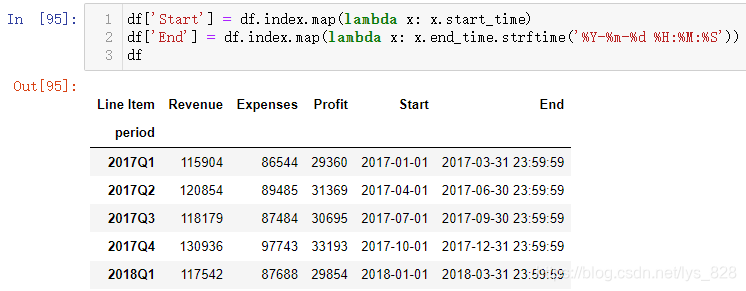

4.1 ��ȡ��ת��Ϊʱ����������

�ڶ�ȡ���ݹ����������ٽ���һ������index_col,��ָ����Ϊ��������(�ֶ�),�����֮ǰ��parse_dates����,�Ϳ���ֱ�ӽ�����������ʱ����ֶ�ֱ��ת��Ϊʱ����������

��ʵһ�¿������������������,ʱ������Ӣ������ΪDatetimeIndex��˳����һ��,���ֲ�������ֶε�����Ĭ�ϸ���ֵ������index,�����Ҫ�����������ƽ�����,ʹ�õĴ���Ϊdf.index.name = 'xxx'

4.2 ʱ���������ò���

4.2.1 ֱ������ȡֵ

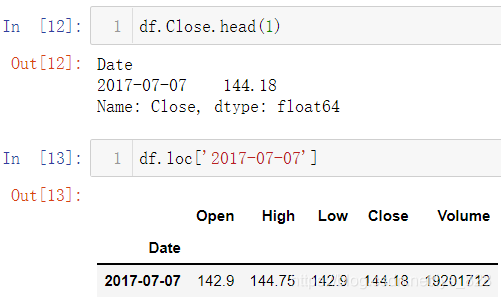

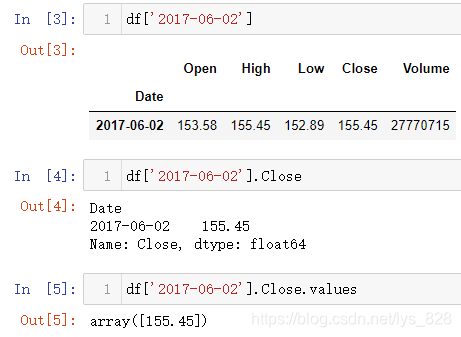

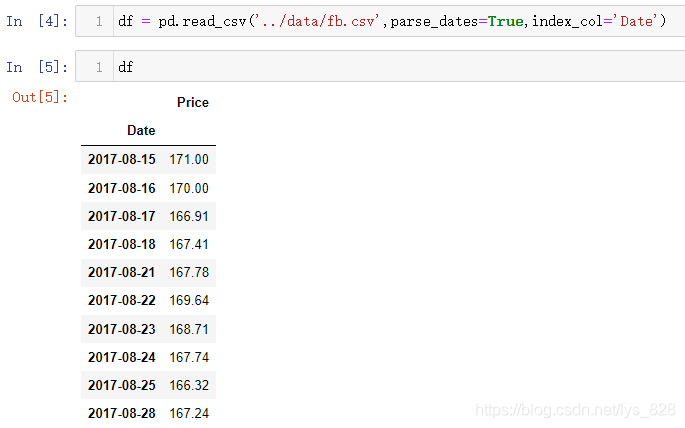

�Ȼع�һ�»�ȡ�л����еIJ���,����

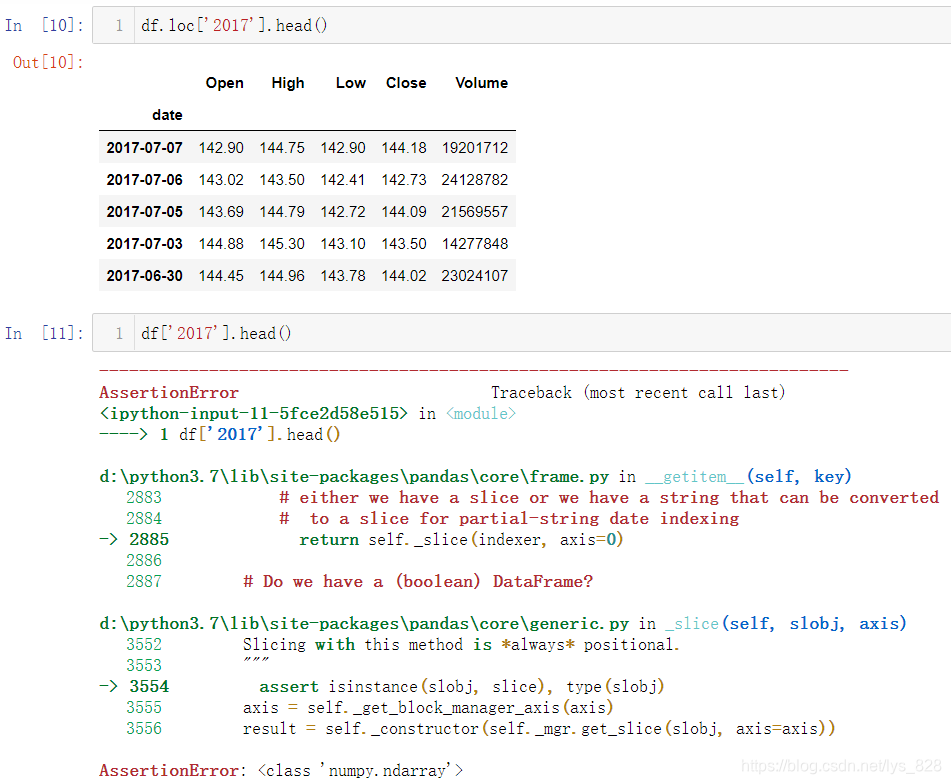

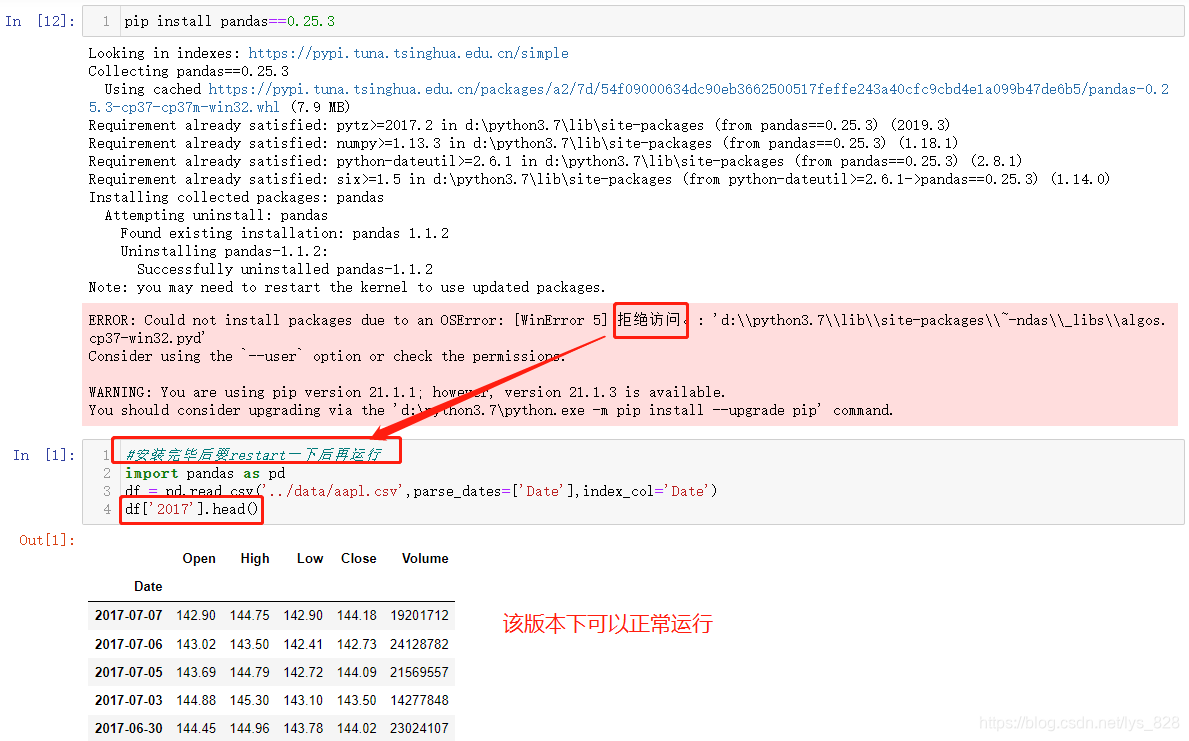

�����ʱ������,�ͻ��кܶ����IJ���,����ѡȡ2017�������,ֱ��ͨ��df.loc['2017'].head()�Ϳ��Բ鿴2017��ǰ5��������,������ǰ�İ汾����Ҫloc����ֱ�ӽ���2017�����ݵ�ɸѡ

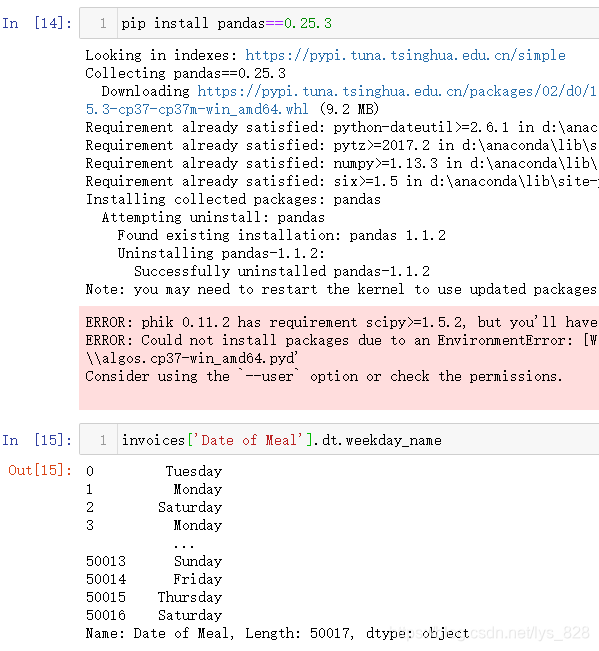

Pandas��0.25.x�汾��ͽ�����1.x�汾,���Ҳ������ʱ��̫��Զ,�൱����һ���汾�ĸ���,��ǰ�汾�ſ�������0.25.3,���¿��Կ���ж��֮ǰʹ�õ�Pandas�汾Ϊ1.1.2������ijָ���汾ģ������ָ��Ϊ:pip install xxx==�汾��(ע��ֱ����notebook��װ��ģ���,һ����Ҫrestartһ��kernel,Ȼ����ִ����ѡ����,ע���������ǰ�����б��,restart�������������´�1��ʼ������)

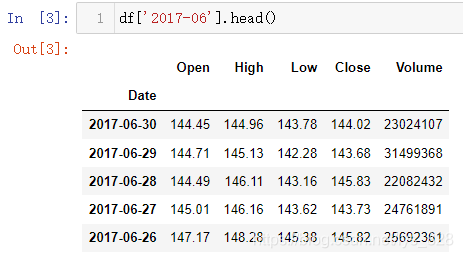

���Ҫ�鿴2017��6�·ݵ�����,ֱ��ͨ��df['2017-06']�Ϳ��Ի�ȡ(Ϊ�˷���չʾ,ѡ�����ǰ��������)

��ȡ�����ijһ���е�����,����2017��6��2�ŵ������ݡ�Ȼ����ڻ�ȡ��������,�����Խ�һ���õ������ijһ�ֶε�����,�൱����ȷ������ȷ����(�ֶ�),�����Ͱѵ�Ԫ��ľ����λ��ȷ�������ˡ�

��Ҫע���������������ȡ��ֻ��һ��Series����,Ҫ��ȡ��Ԫ�������,���Խ���.values�IJ���(����������������Ϊarray����,�ٴ�֤��Pandas�ײ�������numpy)

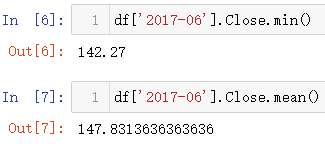

��Ȼ����ֱ�Ӷ��·ݽ��л��ܼ���,�Ϳ���ֱ��ʹ��֮ǰ���ܵ�һЩͳ���������ٸ��ӵĴ�ʱ������ȡ�·����ݺ��ٽ��з��������(��ȡ��Сֵ�;�ֵΪ��,������ͳ��������)

4.2.2 ��Ƭ����

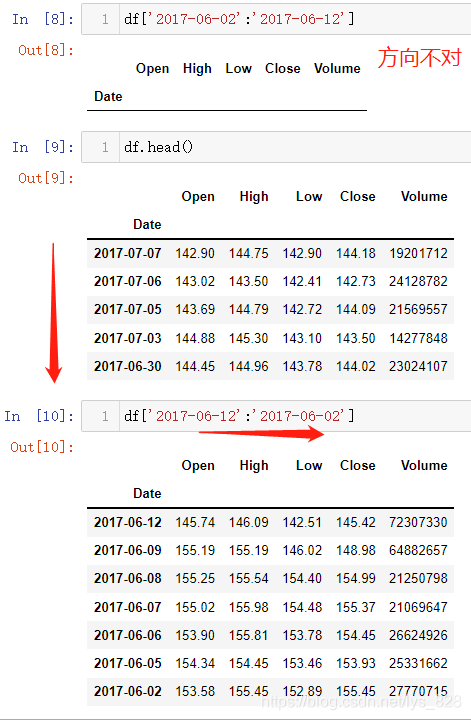

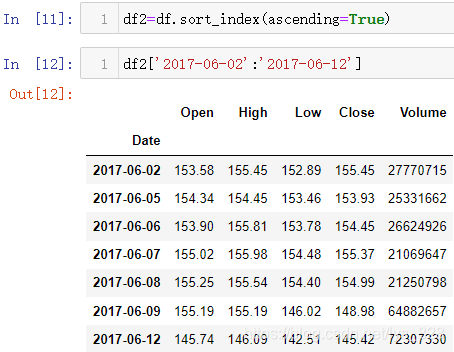

֮ǰҲ�н���df[xxx:xxx]�����ݻ�ȡ,ʱ������Ҳ����ʹ�����ַ�ʽ,����ע��ʱ������˳��,ͨ��������м���,���ָ��������˳����ʱ�������ķ���һ��,��ȡ�Ľ����Ϊ��

��ô��Ȼ�漰�����������,����Ҫ֪��ʱ�������������,����ʹ��sort_index()�Ĺ���(����ǰ���ij�ֶ��������sort_values('�ֶ���')),��Ҫע�����,���������и�ָ������ķ���IJ���Ϊascending,Ĭ��ֵΪFalse��ʾ��������(�Ӵ�С),Ҳ���Ը�����Ҫָ��ΪTrue,��ʾ��������(��С����)

4.2.3 ʱ���ز���

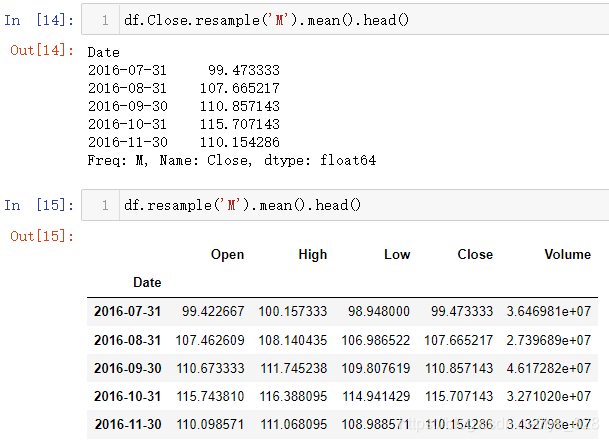

ʱ���ز���respame():��ʱ�����д�һ��Ƶ��ת��Ϊ��һ��Ƶ�ʵĹ���,�һ������ݵĽ�ϵIJ����������ڻ��ÿ���������Ϣʱ��,��Ҫ����ÿ��������ÿ������ۻ���ʱ��,����Ҫʹ��ʱ�������ز�����

��Ҫע��:һ����Ҫѡȡָ�����ֶκ��ٽ���resample(),����ͻ���ȫ���ֶν���,�����м���漰�����ݵ�����,����������������ֵԽ��ʱ��ͺ���������,Ӱ����������ʱ��,�������һ�е���ֵ�ͺܴ�,������ʱ�������Ըо����ӳ�

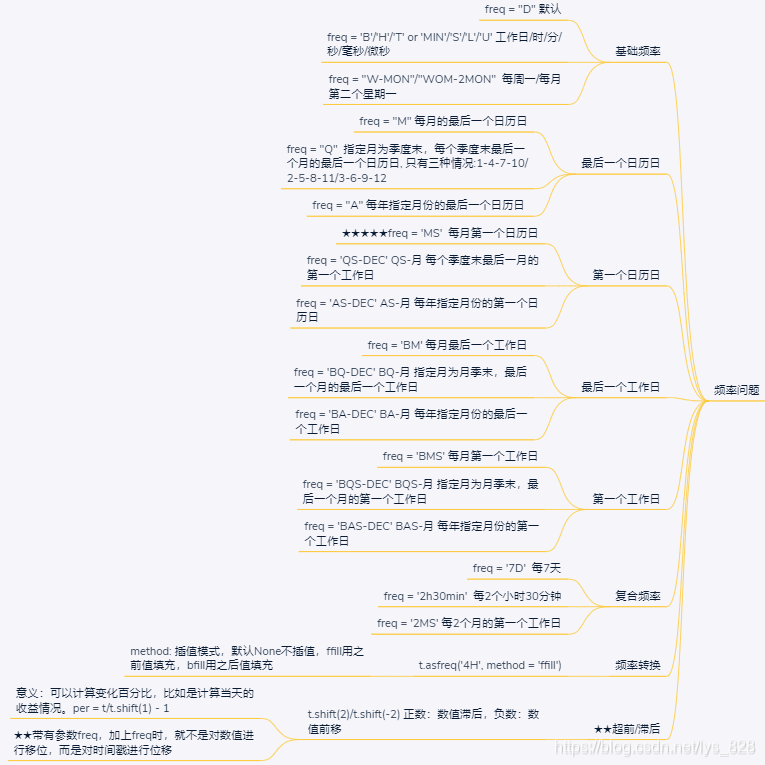

�ز�����ʱ�����ѡȡ���кܶ���,���糣�����ꡢ���ȡ��¡��ա�Сʱ,����һЩ�����ա��ܡ�ÿ�µĵ�һ��/���һ�졢ÿ������һ��������/�����յȵ�

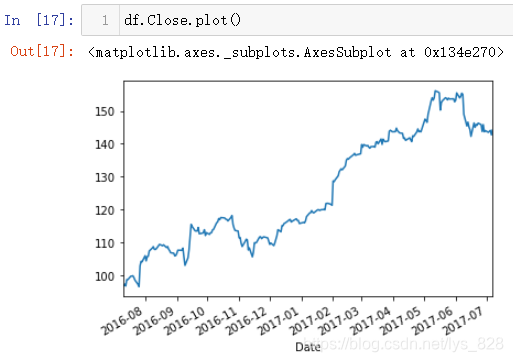

4.2.4 ��ͼ

ʱ�����л���ͼ��dz�����,ֱ��һ�д���㶨������ָ������ڻ�ȡ�ֶεĻ����ϼ���plot(),����Ĭ�Ͼͻ���ʱ������Ϊx��,ѡȡ���ֶ�Ϊy�����ͼ�����

������ʱ���ز���֮������ݽ��л�ͼ,���൱�ڶ�ͼ�����ƽ������,����ȡÿ�����ں�ÿ���µľ�ֵ����������ͼ��,����������(M�ǰ����·�,W�ǰ�������,���Կ���x���ǩ��ʱ�Զ�ת��ΪӢ�ĸ��·ݵ��ʵ���д)

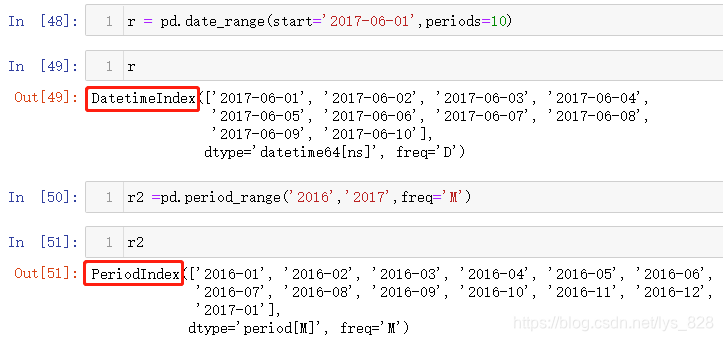

5 ʱ�����ݹ����Ƶ��ת��

5.1 ʱ�����ݹ���

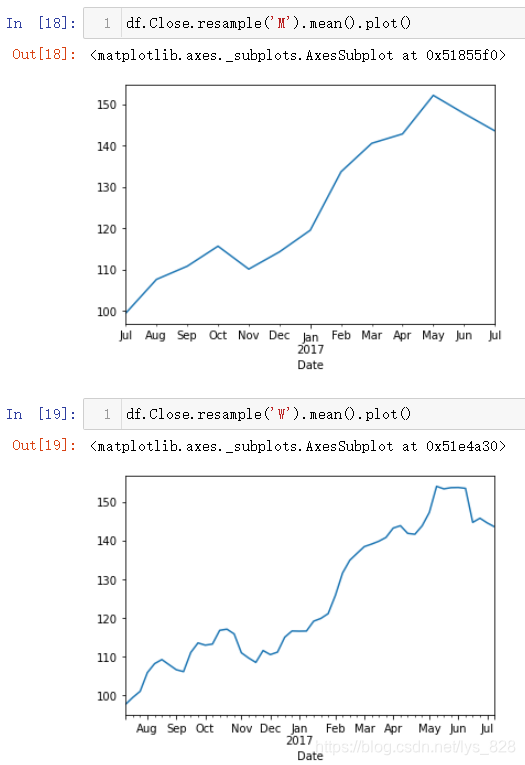

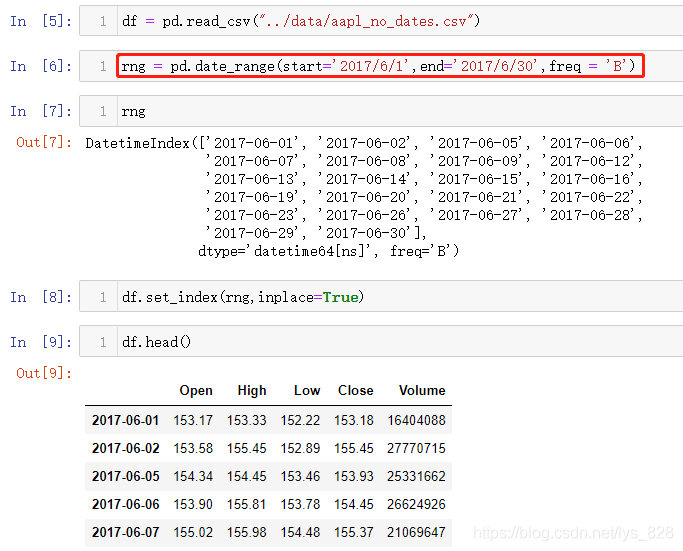

ǰ����ܹ�ʱ���������͵�ת����ʱ���ز���,���ǻ������е����ݻ�����,��ô��ʱ����Ҫ�Լ�����ʱ��������Ϊ����,ʱ��������ι�������������ˮ���ˡ�����ķ�ʽ���Dz���pd.date_range()����

���ȿ�һ��ԭ������ʱ���ֶβ�����Ϊ�����ķ���,һ����Ϊ��������һ����ʱ���ַ������ݷ������б���,Ȼ��ֵ��df�е�һ�����ֶ�;�ڶ������ǽ����ֶε���������ת��Ϊʱ����������;������ָ�����ֶ�Ϊ���������������������

5.1.1 ��һ�ֹ��췽ʽ

�������pd.date_range()����,ֱ��ʡȥ��ת���������͵IJ���,����Ҫ����������Խ��Խ�����ֳ��˷���������,�����˴����ֶ�����,�ر������ֹ�Ʊ����,��ĩ��û������,������ʹ��ѭ��һ��Ҳ��̫����ʵ��,����pd.date_range()һ�д���㶨�����ݵĹ���

��������������,start����ָ��ʱ�俪ʼ������,end������ʾʱ����������,freq��ʾʱ�乹��Ĺ���,�����B�����Ź�����

5.1.2 �ڶ��ֹ��췽ʽ

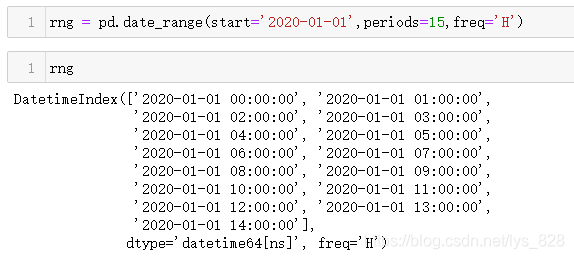

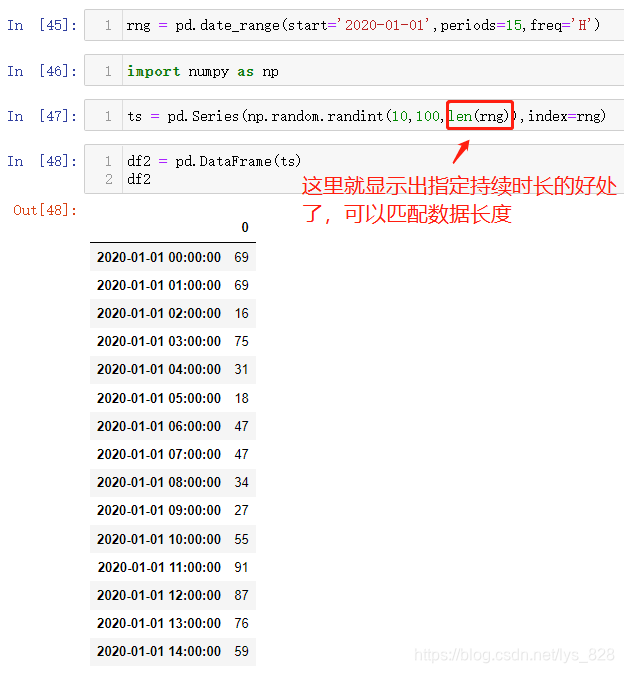

ǰ������������൱����ָ����ʱ��Ŀ��(����ʼ����ֹʱ��)������ʱ��Ĺ���,�Զ����ɵ�ʱ������;��ʱ��Ҳ������������:����ʼʱ��ͳ���ʱ��(û����ֹʱ��)�Լ�ʱ���¼����,���չ���ʱ����������,��ʱ�����end�����ij�periods��������,�����2020��1��1�տ�ʼ,ÿСʱ��¼һ��,һ������15��Сʱ,������������

5.2 ����ʱ����������ȱʧֵ

���ǰ�������DataFrame�����е�ʱ�����������ݽ�����,Ȼ���������������,�������Ҫ���Խ�һ��������Щ�����������ȡ����(ԭ����������������),���ַ�ʽҲ������չ������ʱ�����е������������ֶ�������

5.3 ʱ��Ƶ��ת��

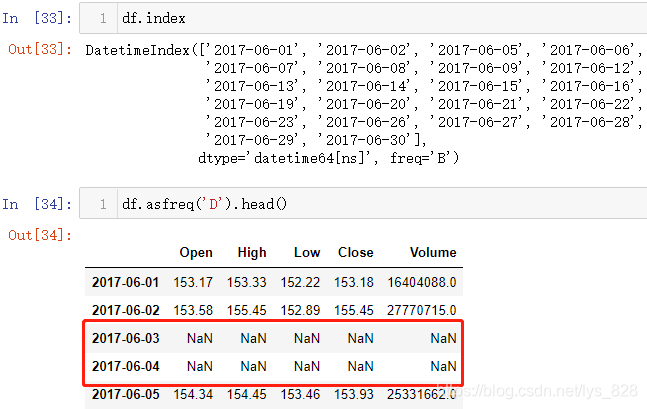

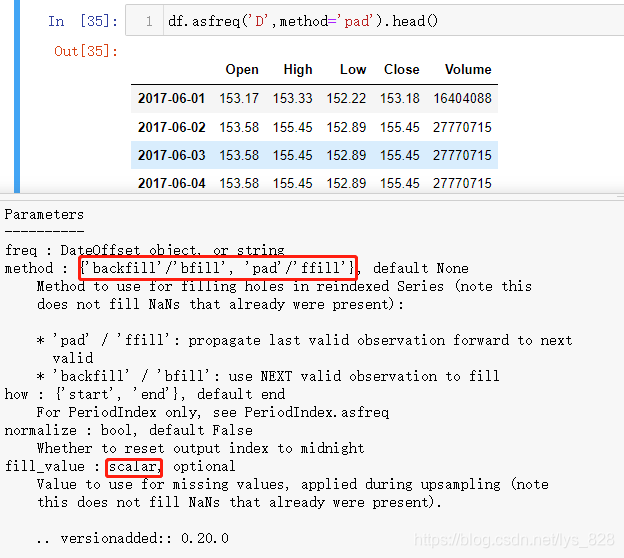

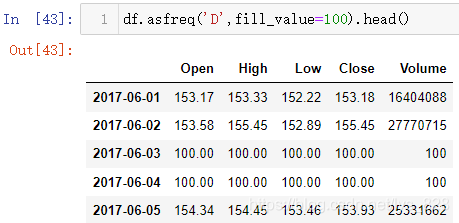

��ȡ���ǹ�Ʊ����,���ڹ�����ʱ�ε�����,û����ĩ����Ϣ,��������IJ�����,������ʹ��asfreq()����,����DΪÿһ��,�������оͻ���ʾ����ĩ��ʱ������,��������û������,Ĭ����ʾ��ֵ

��Ȼ������ȱʧֵ,���ж�Ӧ�Ĵ�������,�����е�method����������������������,��������ѡ��ֵ,�ֱ��Ӧǰ�潲����ȱʧֵ��̬���ķ���,����о�̬���IJ���fill_value,����ָ��һ���������

��̬���

��̬���

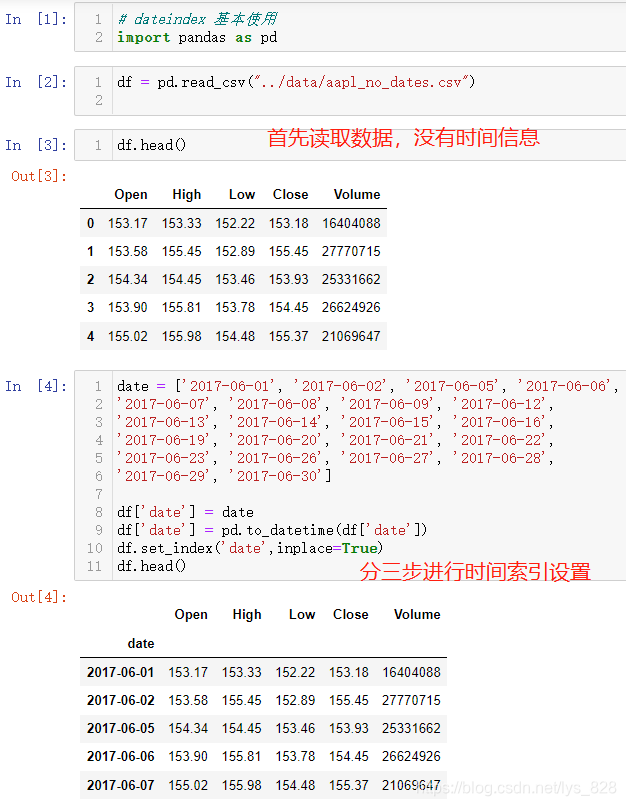

5.4 ����Ӧ��

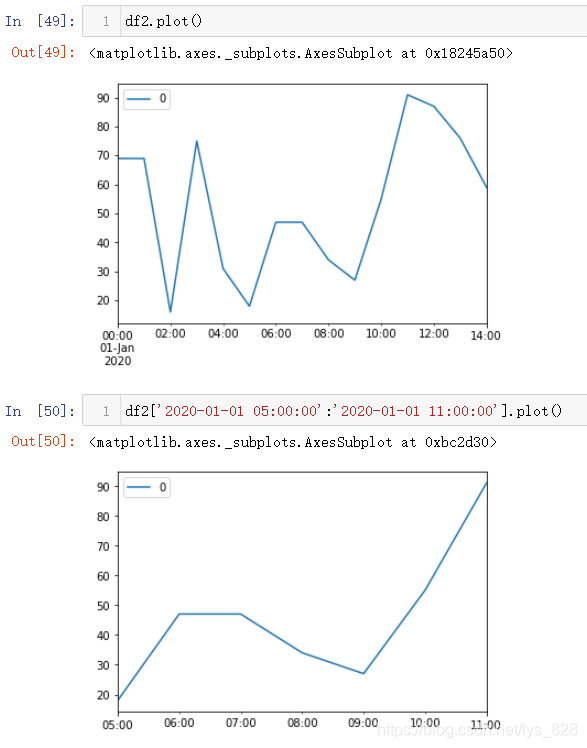

ʹ�� pd.date_range() ����ʱ������,Ȼ���������������һ����ͼ��

����ͼ��ʱ,����ѡ��Ĭ��ȫ�����ݽ��л���,Ҳ����ѡȡ�������ݽ��л���ͼ��

�����:����ʱ��Ƶ������ָ���Ĺ���ܶ�,���Բο���ƪ����:Pandas��ʱ�����д���(3)ʱ���������date_range()������Ƶ��freq�ı任,������һ���������ܽ������ͼ,����Ȥ�Ŀ��������Ķ�

6 �ڼ����빤��������

ͨ�������ʱ�����ݷ���,�����и�ʱ��Ƚ����۾���5��1��,����ڹ�����Ϊ�������Ĺ�����,�������й����Ƿ����Ľڼ���,��Ʊ��Ȼ�ڽڼ��ղ�����,��˾����˽������֮���ϿɵĹ����պͽڼ��յIJ�ͬ������

6.1 �Զ���ڼ���

ֱ�Ӹ���ʹ�õ�ģ�����,ʹ��ʱ�ڴ˻����Ͻ����������ݺ������Ķ�����

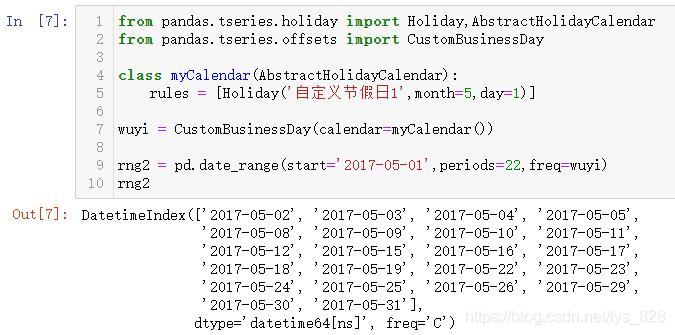

from Pandas.tseries.holiday import Holiday,AbstractHolidayCalendar

from Pandas.tseries.offsets import CustomBusinessDay

#�Զ���ڼ�����,����������rules�б���������Լ���Ҫ���ӵ�ʱ��

class myCalendar(AbstractHolidayCalendar):

rules = [Holiday('�Զ���ڼ���1',month=5,day=1)]

#�����Լ�����������

wuyi = CustomBusinessDay(calendar=myCalendar())

#Ӧ���Լ�����������

rng2 = pd.date_range(start='2017-05-01',periods=22,freq=wuyi)

rng2

����������:(ʹ�õIJ�������ܽ������,���ľ��ǰ��Լ���Ҫ���ӵĽڼ�����Ϣ����rules�б���)

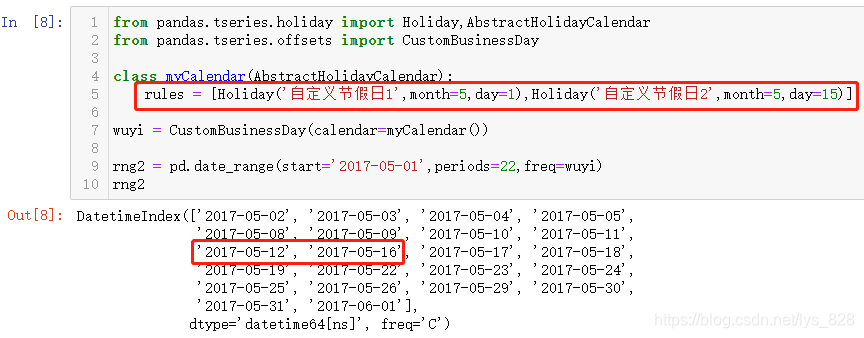

����ָ����������,���������Լ���Ҫ,���ָ��һ������,�����Լ������ն���,Ȼ�����¼������п�һ��,Ϊ�˼�,ֱ�Ӽٶ�����Ϊ5��15(�����������д��ڵ�ʱ��),����������

������Щʱ��Ҫ�о��¹�,���Ϊ�������¹ʺͷǹ������¹�,���зǹ������¹ʾͽ�һ��ϸ�־����˽ڼ����¹ʺ���������ĩ�¹�,�պ��Զ���ڼ��շ�ʽ�ܹ���æ����������

6.2 �Զ��幤����

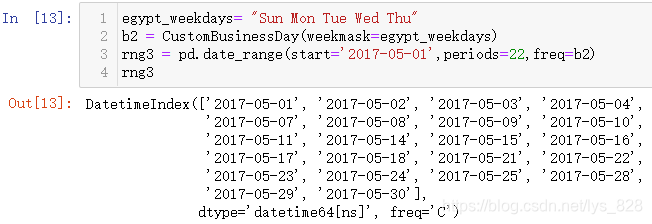

��Щ���ҵĹ����պ�����,����Ϊ��ҵ������,����Ҫ�����ⲿ�����ݡ����簣��������,���Ǵ������쵽������(���������еĹ����Ѿ��ᳫ��������,��Ϣ������),���Ϊ�˽���������,�������Զ������յ�������ģ������

from Pandas.tseries.offsets import CustomBusinessDay

egypt_weekdays= "Sun Mon Tue Wed Thu"

b2 = CustomBusinessDay(weekmask=egypt_weekdays)

rng3 = pd.date_range(start='2017-05-01',periods=22,freq=b2)

rng3

������Ϊ:(ͨ������Ա�ԭ���Ľ��,���Է�����������ȷʵ���������յ�����ʱ��������)

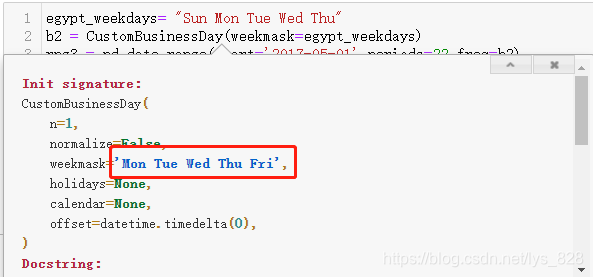

ע������:���ľ�����ָ��weekmask������Ӧ���ַ�������,���ַ�����һ���ַ����Ǵ�����һ�ܹ�����ʼ��ʱ��,���һ�����ǽ���ʱ��,�м����Կո�ָ�,��������ļ�дû�е�,�Աȹٷ�������ʹ���ֲ�,Ĭ���ǰ�����һ��������Ϊ������

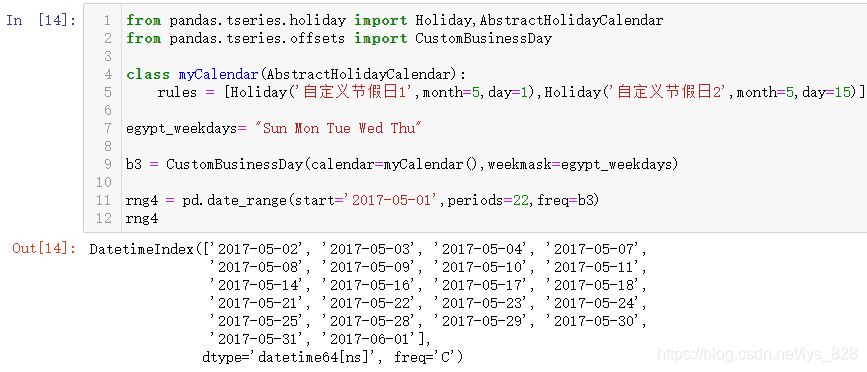

6.3 �ۺ��Զ���ڼ��պ��Զ��幤����

���Ҫ���Զ���ڼ��պ��Զ��幤���ս��,�Ǿͼ���,ֱ�ӽ����ߺϲ��Ϳ�����,ϸ�ĵ��С�����Է������������Ƕ�Ӧͬһ������/���������ͬ�IJ���,����ģ������

from Pandas.tseries.holiday import Holiday,AbstractHolidayCalendar

from Pandas.tseries.offsets import CustomBusinessDay

#�Զ�����Ҫ�Ľڼ���

class myCalendar(AbstractHolidayCalendar):

rules = [Holiday('�Զ���ڼ���1',month=5,day=1),Holiday('�Զ���ڼ���2',month=5,day=15)]

#�Զ��幤������ֹʱ��

egypt_weekdays= "Sun Mon Tue Wed Thu"

#�����Զ���Ĺ����պͽڼ���

b3 = CustomBusinessDay(calendar=myCalendar(),weekmask=egypt_weekdays)

#Ӧ���Զ���Ĺ����պͽڼ���

rng4 = pd.date_range(start='2017-05-01',periods=22,freq=b3)

rng4

����������:(��Ҫ�����һ������Զ���ڼ������ﴫ�����һ�������,�Զ��幤�������ﴫ�����һ���ַ�������)

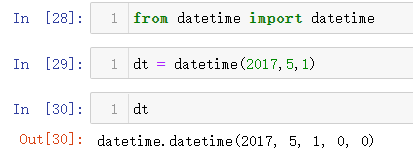

6.4 ��ʵ�Զ���ʱ��

�����Զ����˹����պͽڼ��յ�ʱ�����b3,���Ը���һ����֤���ʱ�����(���߸�ȷ�е�˵Ҫʹ������������ʱ������֮ǰ���к�),��������ָ��һ�������ʱ��Ϊ5��1��(��һ��b3�������Ƿǹ�����)

����������һ���ѵ�������ȷ��������ڶ�Ӧ�ܼ�?ֱ�ӷ������ٶȵ�Ȼ����,��û��ʲô��������ֱ�ӻ�ȡ��,����������ֳ�ʱ���������͵�������,����ֱ�Ӷ������������dir()����,��һ�¸������������Դ���Щ�Ѿ���װ���˷���/����

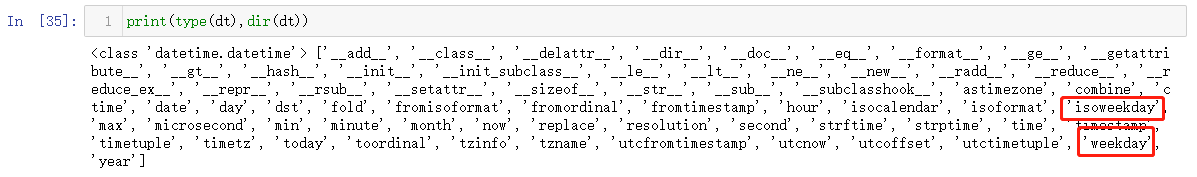

������������������/����������week�й�,�Ϳ���ֱ�Ӳ���һ��,��������һ����ʾ1,һ����ʾΪ0

������������ֱ��ķ�ʽ����ֱ�Ӳ鿴˵���ĵ�,��������,����˵���ĵ���ʱ����Ȼ����,�������ĵ�����(��û�з��־�ϲ������������,���߶���ָ������һMonday,�������������ķ���ֵ������Ϣ����һ��)

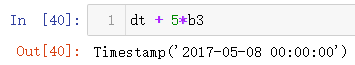

���Կ���ȷ��2017��5��1�Ŷ�Ӧ������һ,��ô���ò��Թ�5�������ն�Ӧ������(����Ľ��Ϊ5��8��,���ö�Ӧ�����Ĺ�����ʱ�����,����5��6�Ŷ�Ӧ��ĩ,2,3,4�Ŷ�Ӧ���ܵ�����������,7,8�Ŷ�Ӧ���ܵ�����������,���������ھͶ�����,������)

7 ʱ���������ݴ���

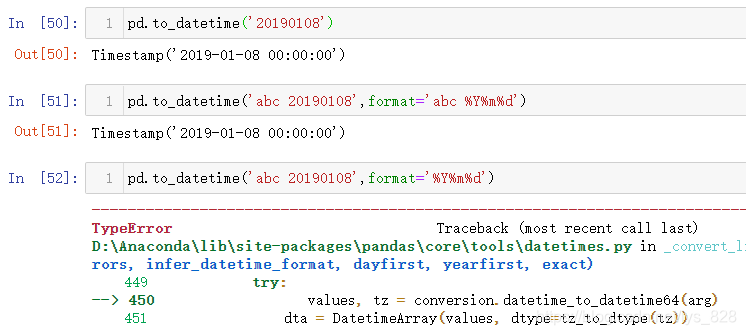

���ַ�����ɵ��б�����ת��Ϊʱ���������ݺ��Ĵ���:pd.to_datetime()

7.1 ����ʱ���ʽ

7.1.1 ʱ���ʽת��

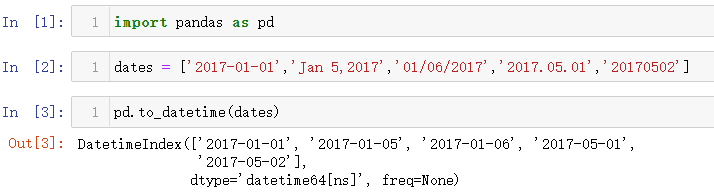

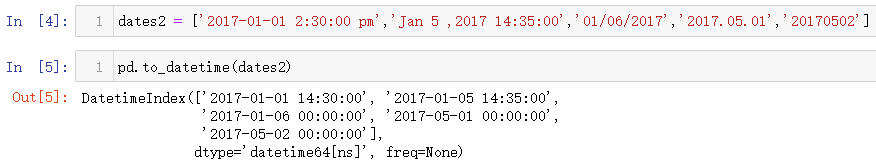

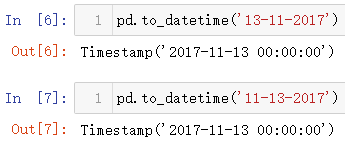

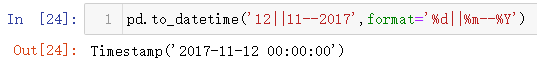

������������ʱ��,��������(�����Ͼ�������������,���������յı�����ʽ,һ���·���ǰ,һ������ǰ�ı�����ʽ)

����ټ���ʱ����,��һ��ת���Ľ��(��Ȼ������������ʱû�м�ʱ����,�������ʱΪ�˱��ָ�ʽһ�¶�ͳһת��Ϊ��ͬ�ĸ�ʽ)

7.1.2 Ĭ��ʱ�䴦����ʽ

������Ե�ʱ�����ݶ��ܡ�������,û�в�������,��Щʱ�����ݿ��ܾͲ�����,����13-11-2017,11-13-2017����������,�������ĸ���ȷ,����ͨ��������һ��(����Ϊ�ڶ���ʱ���ʽ�ǻᱨ��,����������������ʽ������)

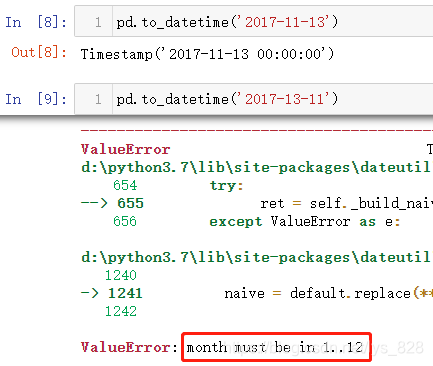

��ô�ٿ�һ��������ʱ���ʽ,2017-11-13��2017-13-11��һ�����ڻ������ȷ,���Ǻ�����һ������������ȷ,��������ʾ�ڶ����Dz����Ͻ����ĸ�ʽҪ��,�������·ݱ�������ָ����Χ��

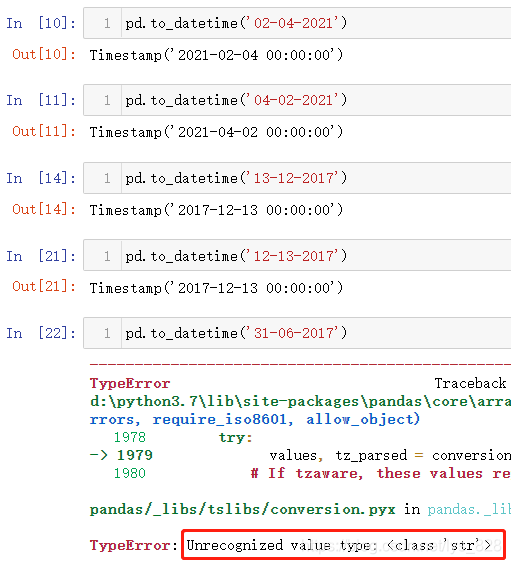

��������ʾ�����Է���,������������ǰ��,��ôPandas����ʱ��Ĺ���ͱ����������յ���ʽ(��Ҳ���������˵���֪),�����������ں���Ļ�,������ʱ�����������������������,����ͳ���һ������,����ĵ�һ��ʾ���н���13���ֵ�dz���12���·ݵ�������,�����Զ��ж�Ϊ����û������,�����02-04-2021��04-02-2021,ϵͳ���������ʲô���Ľ��(����������ʱ���ʽת���IJ���)

�ۺ������ȫ����ʾ�����Եó�һ��Ĭ�Ϲ���:

- (1)��������ǰ,ʱ���ʽֻ��Ϊ��������ʽ

- (2)�������ں�,��Ҫ�ж��·ݺ�����������������ȡֵ�Ĵ�С(�·�1-12֮��,��1-31֮��)

- a)���·ݺ��վ�������ȡֵ��Χ��,�û������ʲôʱ���ʽ,��������ʲô��ʽ

- b)���·ݳ�������ȡֵ��Χ��,��������ȡֵ��Χ��,��ʱ��ͻ����ϸ��,����յ�ȡֵ�����1-12֮��,��ô����Ľ���ͻᷢ���պ���λ�û���,����յ�ȡֵ����12,��ô����ֱ�ӱ���

- c)���ճ�������ȡֵ��Χ��,�����·�ȡֵ����,����ֱ�ӱ���(������Щ������·��յ�ȡֵ����Ҫ����31,ֻ��Ҫ��������������������)

7.2 �Զ���ʱ���ʽ(������Чʱ��)

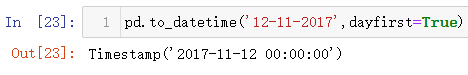

Ϊ��Ӧ���ܽ��(2)�� b)������,����ͨ������dayfirst���Զ���ʱ��ĸ�ʽ,�Ӷ����������Զ�λ��ת���Ĺ���

�������������,������ʹ��ʱ���ʽ����ʽ,��������format,����ָ����ʱ���ʽ����ת��(���ַ�ʽ�����ͺ�ǿ,�����������ʲôʱ���ʽ,ֻҪ�������յ�Ӱ��,�����м��ж�ô���ӵķ���,�����Խ���ʶ��)����ʽ���е��ַ�d����day(��),m����month(��),Y����Year(��),�����ʱ���ַ��ĸ�ʽ�����ſ��Բο�:python��ʱ���ʽ������

��������������Чʱ�����ݴ���,�������е���������ƥ�䡣������ֵ�ʱ���ʽ����(2)�� c)�����ǿ�н�������ת���ͻ�ֱ�ӱ���,���Խ���errors�������з�������,��errors = 'ignore',��ʾ���Դ��������,���errors = 'coerce',��ʾ��Чʱ�����ݻᱻ�滻Ϊ��ֵ(��������ʱ�������ݵĿ�ֵ,NaT:Not a Time)

7.3 ʱ����ʱ���ת��

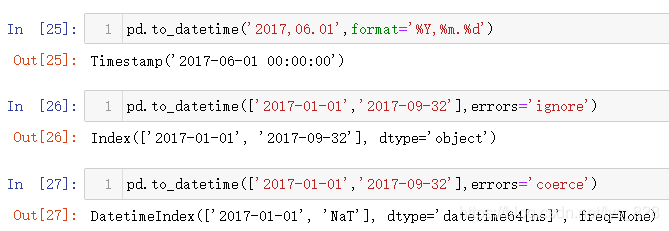

������һ��ʱ���:1970-01-01 00:00:00(�������ʼ����ʱ��),ʱ������Ǹ�ʱ�䵽������һ�̵���������

- ��ȡ��ǰʱ���:

time.time() - ��ȡָ��ʱ���:

t.value - ʱ���תʱ��:

pd.to_datetime()

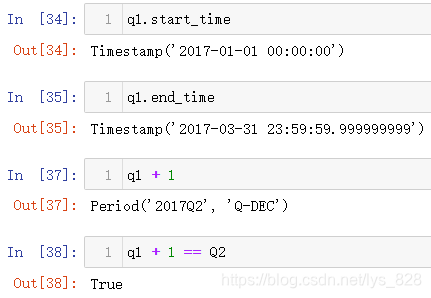

8 Periodʱ�ڲ���

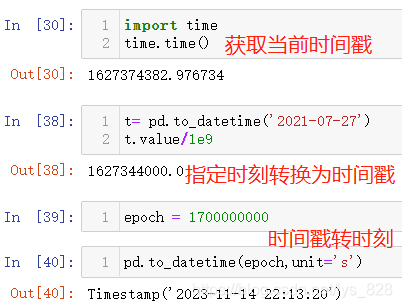

���Ĵ������:pd.Period()

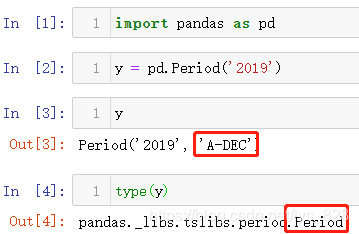

8.1 ������������ʱ��

ǰ�������ʱ����ص�ʱ�䴦����ʽ,��������һ��ʱ��ʱ��IJ�����ʵս���ֱ�����(Y)����(M)����(D)��Сʱ(H)������(Q)������(W)��������

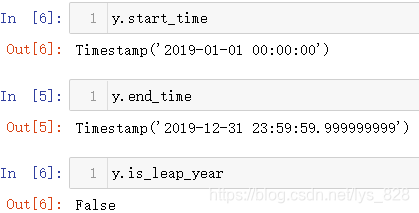

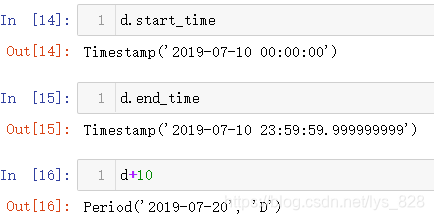

(1)���

�������ʱ���������͵Ĺ���,ֱ�����ʱ�����ݱ���(���������y,֮���m��d�ȱ���)�����ʱ�ڵ�ʱ�仹�ж�Ӧ�����Ƶ��freq�Ĺ���,����Ĭ����A-DEC������ÿ�����һ����(��12��)�����һ��������(���Բο�ǰ�����freqʱ�������)

��ȡ���ʱ�ڿ�ʼ�ͽ�����ʱ��,�Լ��Ƿ�Ϊ������ж�

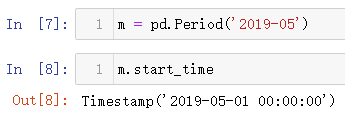

(2) ������

Ҳ��ͨ��pd.Period()����,Ȼ�����������,����ֻ�����·�����

���ſ�һ��ʱ�ڵĿ�ʼ�ͽ���ʱ��,�Լ���ʱ������

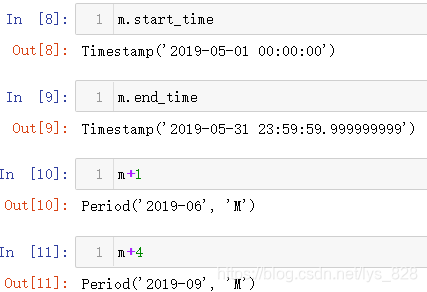

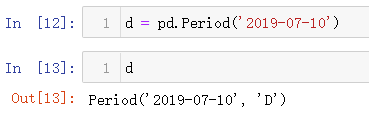

(2)������

��������������

�鿴�����ڵ���ʼ�ͽ���ʱ��,�����м�����

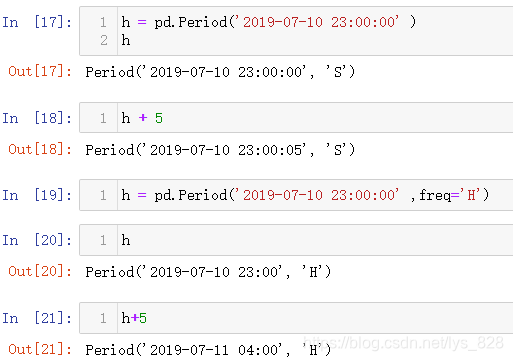

(4)Сʱ����

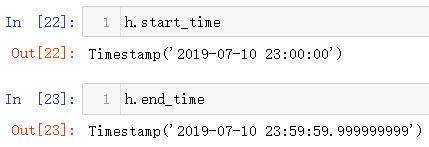

Сʱ���ڹ���,ע���ʱĬ�ϵ�freq��S,Ҳ������,��������������IJ����������������,Ҫ����Сʱ������ʾ,Ӧ��ָ��freq='H',Ȼ���ٽ�������,��������Сʱ����������

���ǿ��Բ鿴ʱ�ڵĿ�ʼʱ��ͽ���ʱ��

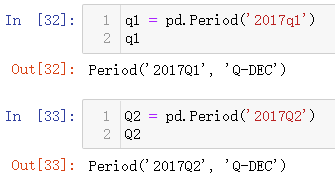

(5)��������

���켾����������,�ر�ע��Q-DEC�Ľ���,������ÿ��ÿ���ȵ����һ���µ�������,���������q�ʹ�������,�����ִ�Сд

��������ʱ�ڵĿ�ʼʱ��ͽ���ʱ��IJ鿴,����������ʵ�����������Ĺ�ϵ

(6)��ʱ��

������ʱ����������,freq='W'������Ƶ��Ϊ��,����Ĺ������Ϊ:'W-SUN'����ÿ�ܵ����һ��(Ĭ��Ҳ��������),ͬ��Ҳ���Խ��м���Ϳ�ʼ�����ʱ��IJ鿴

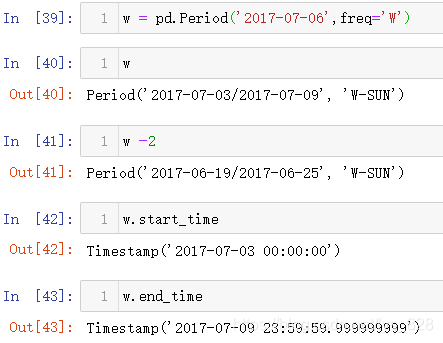

8.2 ʱ��Ƶ��ת��

֮ǰѧ����asfreq()����,�ڴ���ʱ������ʱ��Ҳ���������ó�,���罫�ոյļ�����������ת��Ϊ�·��������ݡ���Ҫ���ĵ��Ǽ������������3����,��ʱ��Ƶ��freqת��Ϊ��,���Ĭ�ϱ��1����,Ĭ��ȡ��Ƶ��freq����ÿ�����ȵ����1����,��������Q1��ʾ��1����,�ü��ȵ����1�¾���3�·�,ͬʱҲ����ͨ��how����������ȡ�����·�ֵ

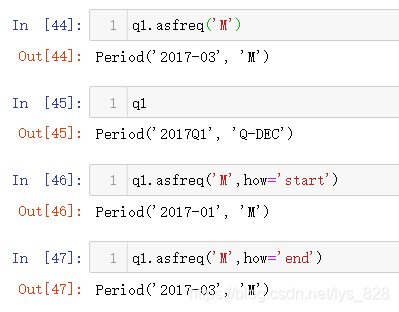

8.4 ʱ��������ʱ����������

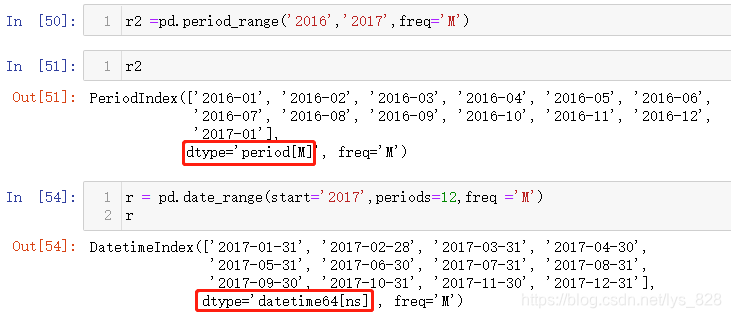

֮ǰѧ����ʱ������DateTimeIndex,�������ʱ������PeriodIndex,ע������������ʾ��ͬ����������

���߶���������һ��ʱ������,���������ͨ���������н�����鿴�����¶�������2016��2017�����������,���������������Ͳ�ͬ��,���嵽ÿһ��Ԫ�ص���������Ҳ��һ��,һ����Period��������һ����datetime64[ns]��������,�����һ���ܴ�IJ��,����M��ΪƵ��freq��ʱ��������������������ǵ��·�,�������ǵ��������,��Ҳ���ֳ�ʱ�ڱ����ķ�Χ�����ϵ�����

��һ�����Բ���Ƶ��freqΪ��Y,�鿴�������ͻ������

8.5 ʱ������ʵս����

8.5.1 ���ɼ������±�

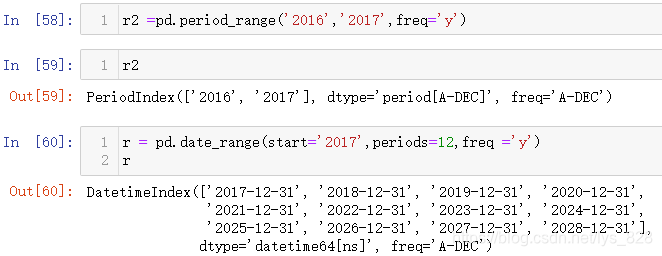

����numpy����������ܺ�����ѧ����ʱ������,ʱ��Ƶ��freq�����·�ȡ�Ϳ����ˡ����ľ����������ݵij��Ⱥ�ʱ�������ij���һ�¶���index����Ϊ������ʱ������

��Ȼ������ʱ��,��ô�Ϳ���ʹ��֮ǰ��ɸѡ���ݵķ�ʽ,����ɸѡ2015��1�µ�2017��1�µ�����

8.5.2 Ӫ������ʵ��

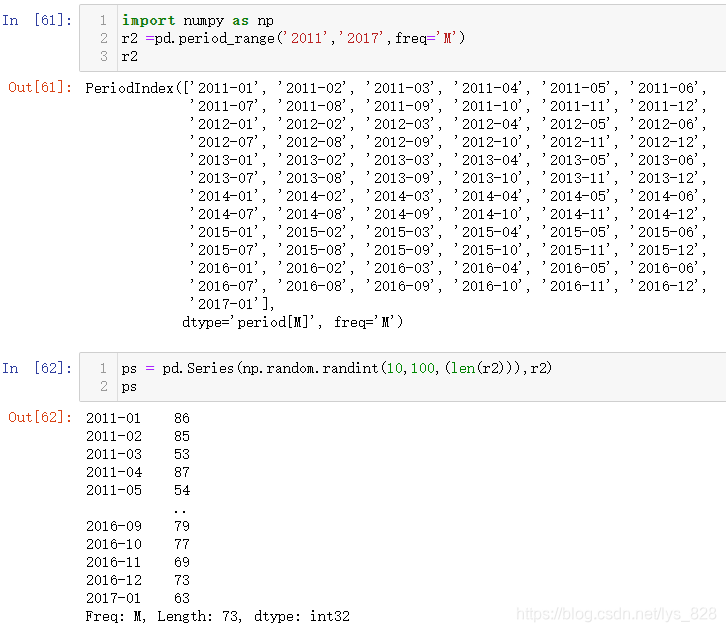

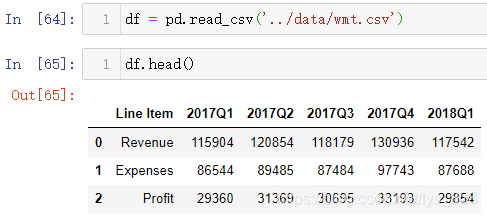

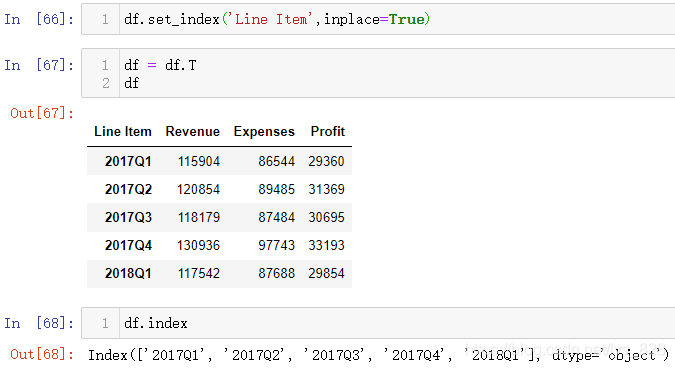

���ȶ�ȡ�ļ��е�����,�ۿ�һ�¶�ȡ�����������Ǽ���Ȼ��,����Ҫ��������ʱ����������,����Ҫ��������ת��Ϊ������,����ת��֮ǰ��Ҫ�ȴ���һ��Line Item�ֶε�����

������Line Item�ֶε�������ʱ��Ϊ����,Ȼ����ת��һ��,����ԭ�����б���ͱ��������,Ҳ��������������в�ȫ��ʱ�����ݵ�����

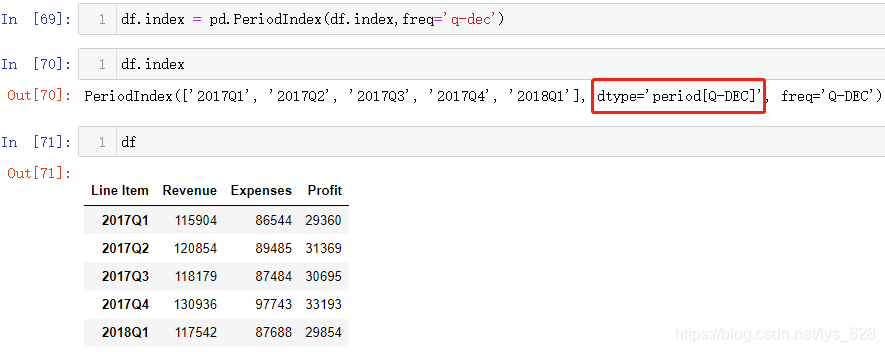

ͨ�����鿴���������,����ֻ����ʽ�Ϸ���ǰ����ܵ�ʱ�����ݵ���ʽ,���DZ����ϻ���object�ַ�����������,�����Ҫ������������ת�������Ĵ���:pd.PeriodIndex()

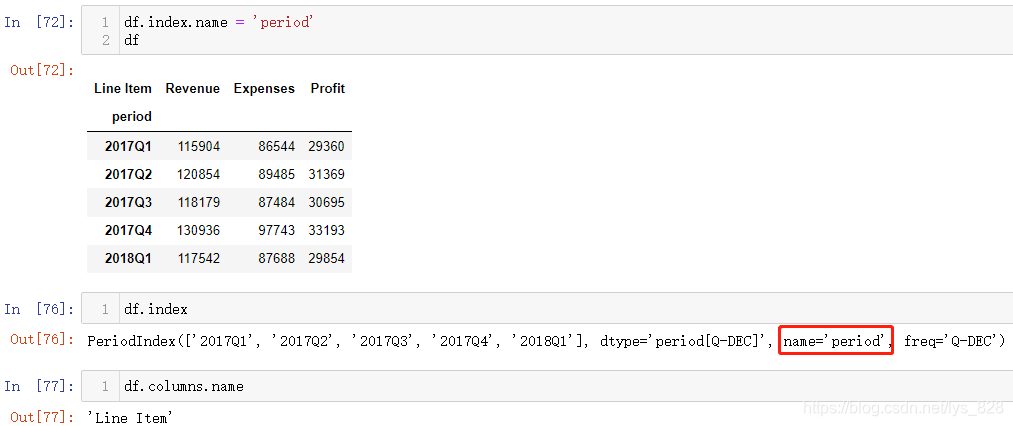

ת����Ϻ��������;���ʱ������,Ȼ������Line Item����ȴ��ʱ�����������Ϸ�,�·���ʱ������������,ʵ���ϲ���,���ǿ��֢��ʾ�б�Ҫ����������������(ע���������������һ����Ϣ,û��name������,������Line Item�������ں����һ�еĸ��ֶ�����,��ֵ����������к������name����),

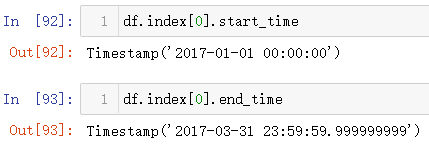

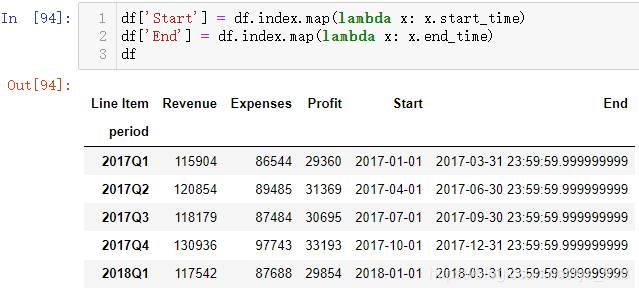

��Ȼ��ʱ������,������ÿһ�����ݶ���Period��������,�Ϳ���ʹ��ǰ�淴��ʹ�õ���ʱ�ڿ�ʼ��ʱ��ͽ�����ʱ��,������е���ʱ�����ݵ���ʼ�ͽ�����ʱ��鿴

��ô������������չ������ʱ�����������и���ô������?���ǵ�ǰ���ص�˵���ֶε�map������ʹ��,ֱ�������lambda�ͻᷢ������˼���Ч��(x���Ǵ�����ʱ�������е�ÿһ��ʱ������)

����Ľ���о������������ֶ�,����End�ֶε�ʱ���ʽ�����������ǵ�Ҫ��,����ǰ������Զ���ʱ���ʽ�ķ�ʽ�Ϳ����������ʽ�Ĺ���,����ȥ��������һ���9�����Ǹ�С����,ֻ�������ȵ��뼴�ɡ�

���ܺ�ǰ����Զ���ʱ���ʽ�������в�һ��,ǰ���õ�pd.to_datetime()�����е�format����,����ʹ�õ���datetime�����������Դ��ĸ�ʽ��ʱ��ĺ���strftime(),���е�f�ʹ���format�ĺ���,����ʱ���ʽ�����ַ���ʽ����һģһ��,�ɴ�����Ӫ������ʵ�ٰ����ͽ������

9 ʱ��ת������

�������ĵĻ�����ʶ:

- (1)������Բ��,���Ҵ��ڲ�ͬ��ʱ����,�й�λ�ڶ�8��

- (2)ʱ���Ϊ����,һ���Ǿ���ʱ��(Ҳ���DZ���ʱ��),һ�������ʱ��(ʱ��ʱ��)

���Ƚ��в������ݼ���,���ڵ�һ�в�����Ҫ������,����ֱ��ѡ������,Ȼ��ʱ���ֶ��Զ���������Ϊ����(���︴ϰǰ�潲���ĸ��ֲ���)

9.1 ʱ��λ��

���Ĵ���:tz_localize()

�������Ϊ��2��,�Ϻ�Ϊ��8��,����Ľ���ͻ���ԭ�е�ʱ�����ݻ����ϼ��϶�Ӧ��ʱ�䶫��Ϊ��,����Ϊ��

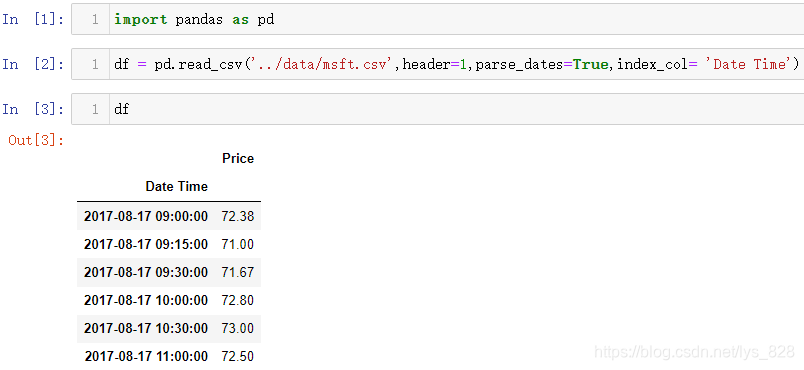

�������ʹ�õĸ����е�ʱ����Ϣ�������´���鿴

from pytz import all_timezones

print (all_timezones)

������Ϊ:(���̫����,��Ϊ�����ϵĹ��Ҷ���200���,����ô��������Ҳ������,ֻ��ȡ��������)

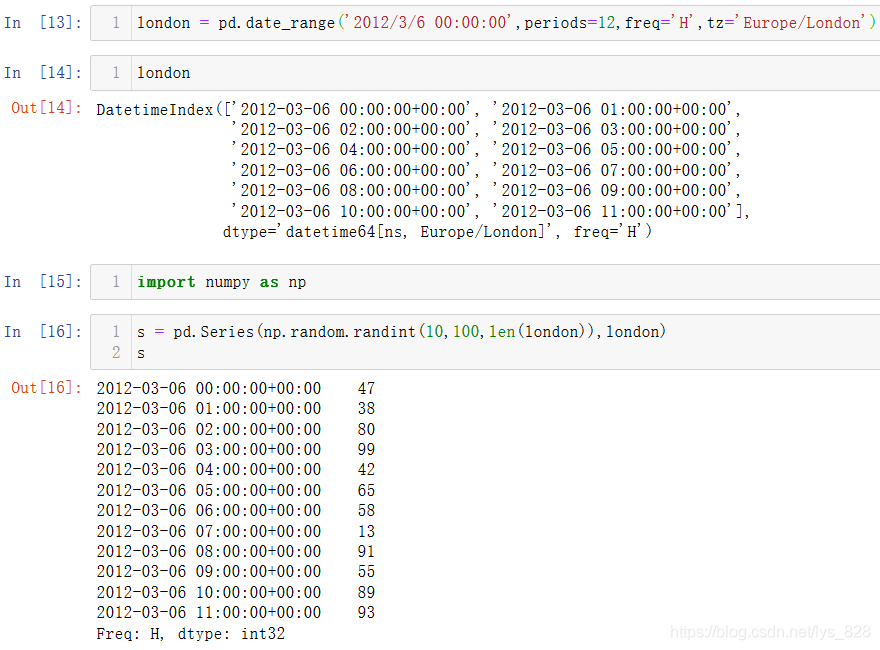

9.2 ���ɴ���ʱ��������

���Ĵ���:pd.date_range(tz='ijʱ��')

����ԭ����date_range()����,�����һЩ����֮ǰ�Ѿ����ܹ�,�����������tz��ʾʱ���IJ���,�ͻ��Զ�����ת��,�������������Ӧ��ʱ�����

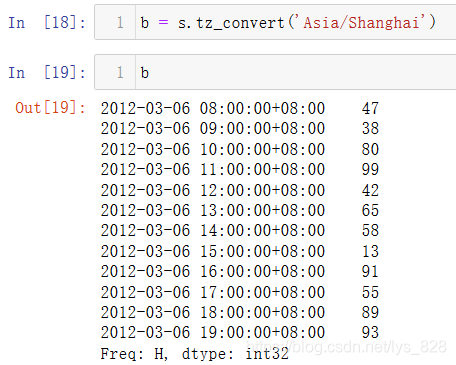

9.3 ʱ��ת��

���Ĵ���:tz_convert()

���ո����ɵ�ʱ������ת��Ϊ�Ϻ���8������,ֱ���������������Ҫת������ʱ�����Ƽ���

9.4 ��ͬʱ��������ݼ���

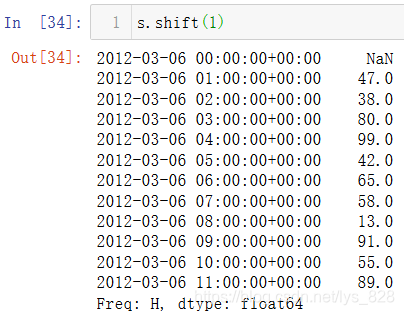

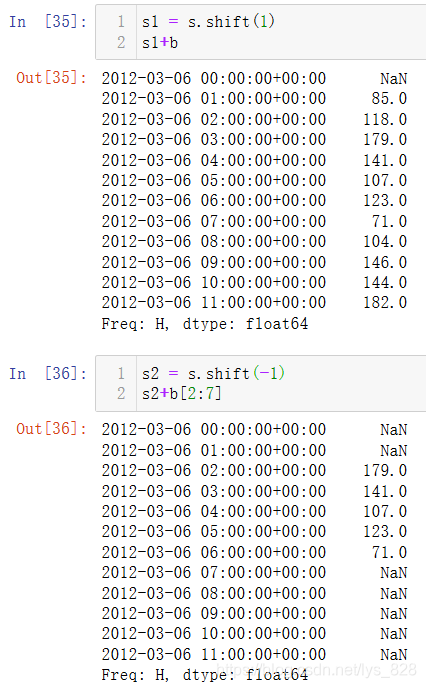

��������ʱ��������ʱ������,�����Dz�ͬ��ʱ��Ҳ�ɽ��м���,���������:���ǰ���ʱ��ʱ��ת��Ϊͬ�ȶ�Ӧ��һ��ʱ����ʱ��(��������ʱ�����Ϻ���������ʱ���Ӧ���)��ʱ�������������㡣����ž����������в鿴,������Ҫ�õ�һ��ʱ��ƽ�Ƶĺ���shift(),��������������д��1,��ʾ��ԭ����ʱ�������ƶ�һ��Сʱ,��һ��������Ȼ�ͱ���ֵ���,���������ݶ��Ƕ���һ�����ݽ������

Ȼ�仯���s�������¸�ֵ,ʹ�ñ仯��Ч,Ȼ���ں�b�������(b���Ƕ�Ӧʱ���ͬ�Ķ�8��),����������

����ֱ�ӻ��㲻̫���,������Excel�е����ʾ��ͼ����������һЩ,��Ҫ����������ĵ�

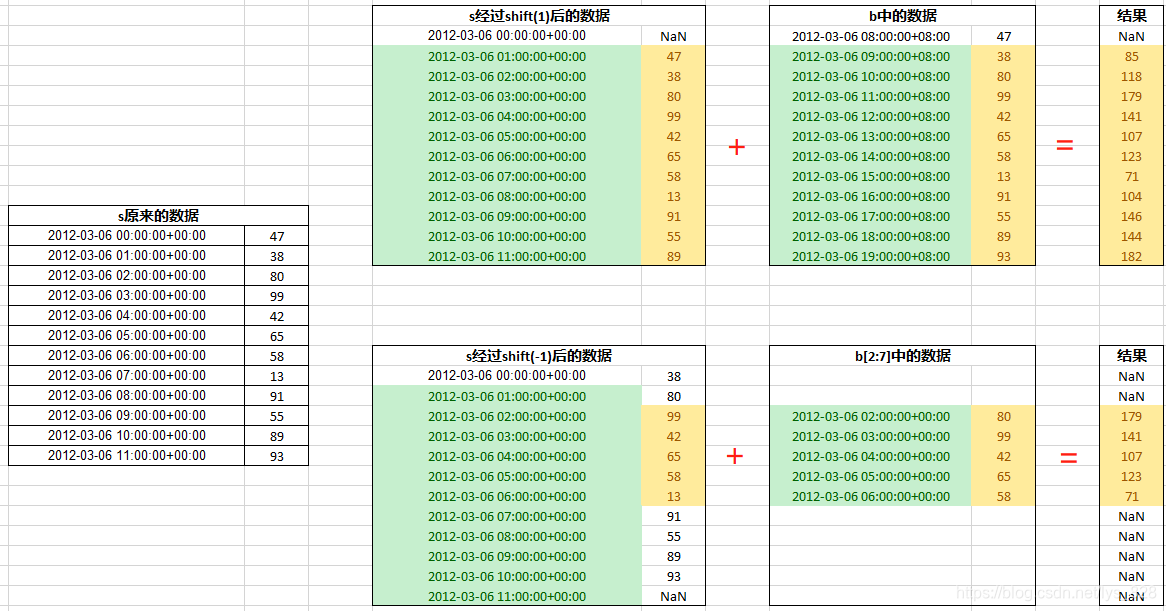

s����shift(1)���һ����ֵΪNaNs����shift(-1)�����һ����ֵΪNaNb���Ǻ�s��ͬʱ����ͬ�Ķ�Ӧʱ��,����ʱ���Զ�ת��Ϊ��ʱ��b[2:7]ȡ���ݺ�����Ѷ�������ʱ���Զ�ת��Ϊ��ʱ����ʱ����м���- �����ݵ������вŽ��м���,��һ������Ϊ��,�����м���

10 ʱ��ƽ��

���Ĵ���:DataFrame.shift()

������Ҫ�IJ���:periods����ָ���ƶ��IJ���,����Ϊ�����Ϊ��(���ϲ�ͬʱ������);axis����ָ���ƶ�����,1Ϊ��,0Ϊ��

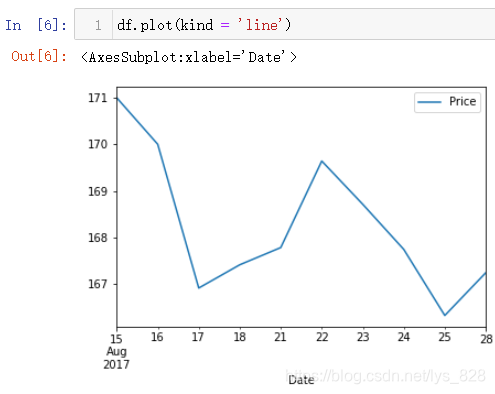

���Ƚ��в������ݶ�ȡ(һ��10��)

��������ʱ���ֶ�,�Ǿ����¶�ȡ���ݲ���ʱ��ָ��Ϊ����(����ϰ��)

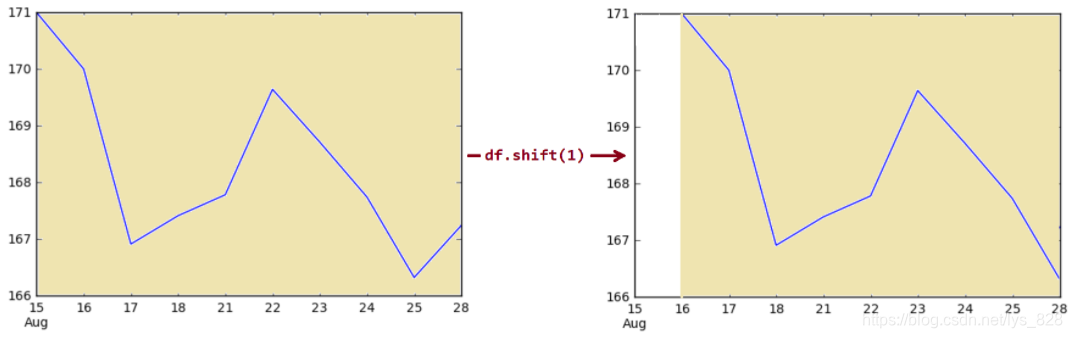

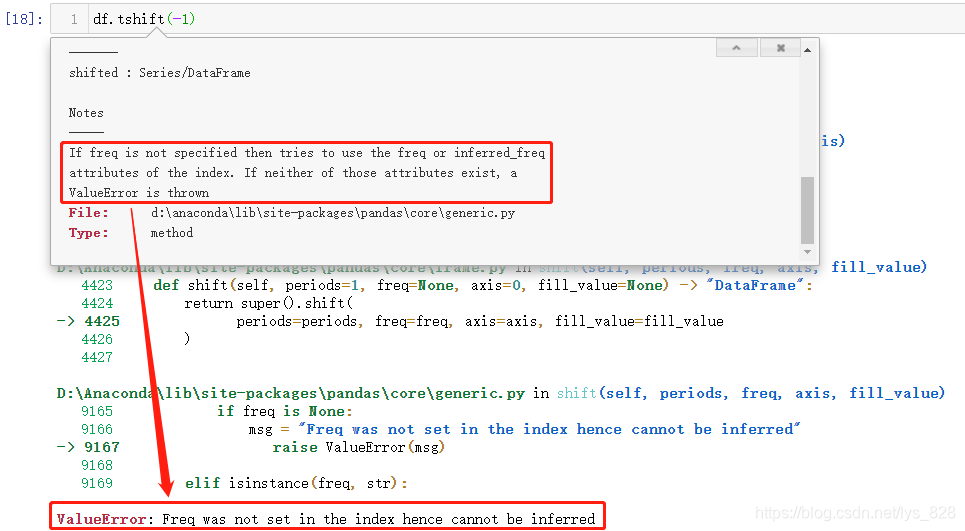

����ͼ�ο�һ�����ݵ����(ע�����Pandas�İ汾����ִ�п��ܻᱨ��,��������һ��)

10.1 shift����ƽ��

ǰ���Ѿ��õ����������,����ͨ��ͼʾ������˵�������shift()���������periodsָ��Ϊ1,ͨ�����ͼ�п��Է������յ�ͼ�������ƶ�һ��ij���,�����IJ��ֺ͵�һ��Ҳ����15�ŵ����ݾͲ���ʾ��(���滹��һ������freq,û��ָ���ͻ����ʱ�����������������ƶ�ȡֵ,���������ʱ������������Ե�ÿ��,��Ȼ�ƶ�1����ָ1��)

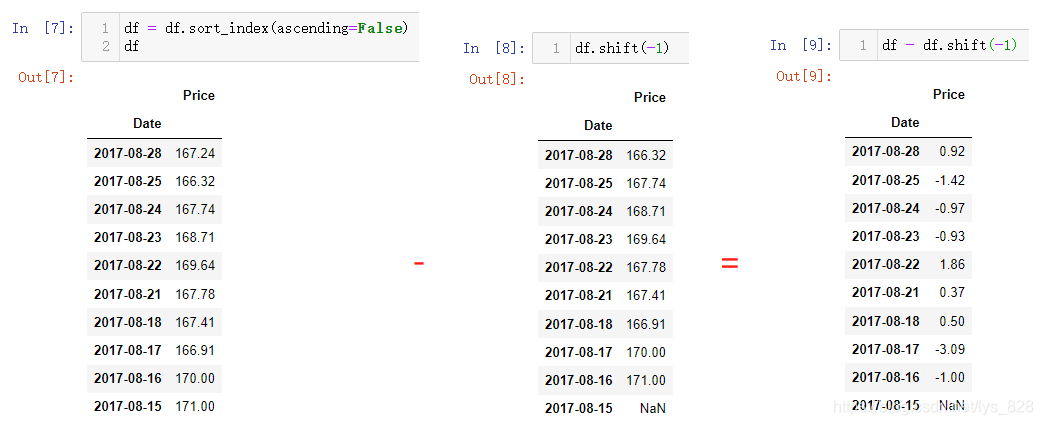

shift()���ܾ���Ӧ��,��һ���ܳ��õ�ʵ��,���Ǽ���۸�ÿ��������ʡ�Ϊ�˷�ֹ������,ͳһ�������²������˵�淶����:

- (1)���ʱ�������ǰ��,����ͨ��

sort_index()�����е�ascending������������, - (2)ʹ��

df.shift(-1)��ʱ���Ӧ����������һ��ʱ������ - (3)ʹ��

df-df.shift(-1)���������������һ��ʱ�ڵ��������� - (4)���Ҫ��һ�����ÿ��������,��һ���õ��Ľ���ٳ���

df.shift(-1)����

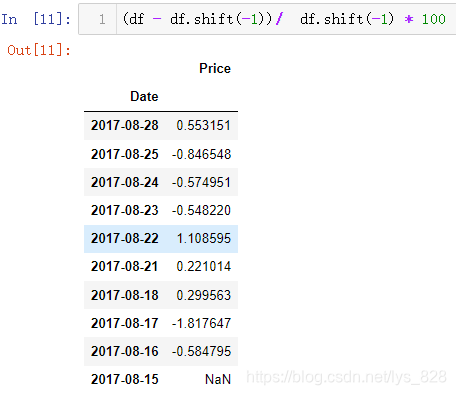

����ÿ������������:(ͬ������ǰ��ѧ����ʱ��Ƶ��ת����ʱ���ز���,�Ϳ����������Ƶ�ÿ��������,ÿ���������ʵȵ�)

10.2 tshiftʱ������ƽ��

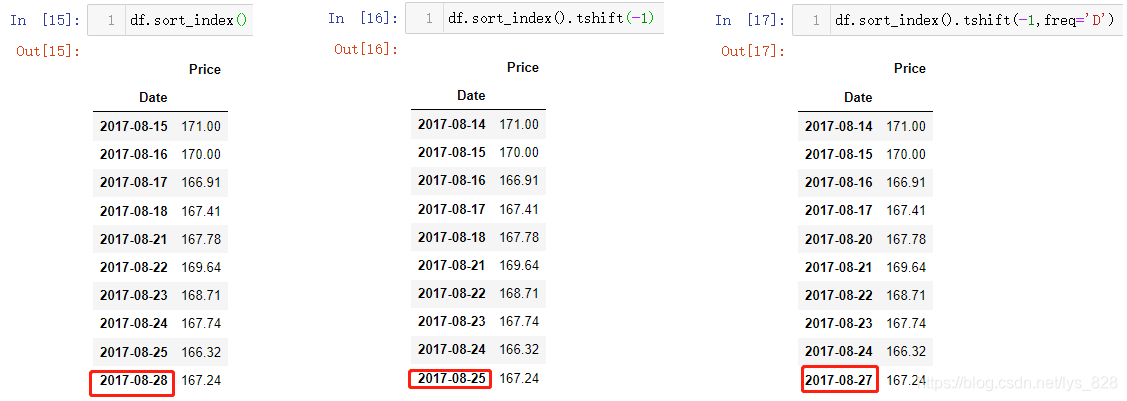

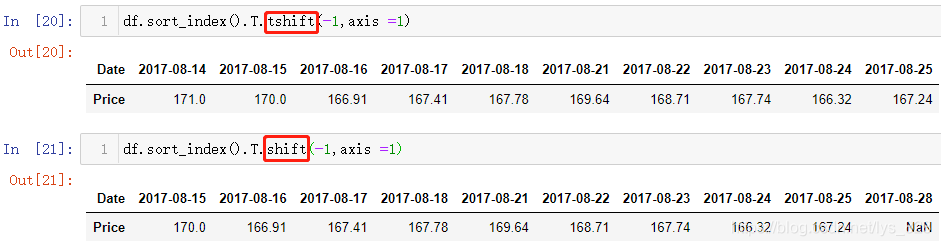

ǰ��shift()������������ʱ��������Ӧ�����ݽ���ƽ��,tshift()�������Ƕ�Ӧ��ʱ������������ƽ��,���������еIJ�������һ�µ�

��������һ������Ҫע��һ��:ָ��freq�Ͳ�ָ��freq����������

- ��ֻ����

periods����ʱ,ϵͳĬ�ϸ���ʱ����������freq,��������ָ��-1,���е�ʱ���������������ƶ�һ����Ԫ��,�������һ����Ԫ��ʹ��ԭ����Ԫ���ǰһ�������� - ���ָ��

freq����,��ô����ʱ����������ԭ�������Ļ�����ȫ����ȥ1��

�Ա����һ�е�ʱ��������ֵ,���������ʱ��Ϊ2017-08-28,��ָ��Ƶ��freq����ʱ,��һ����Ԫ���ʱ�����������Ƶ����˵�Ԫ��,Ȼ��ָ��Ƶ��freqΪD,���е�ʱ������ֵ����1

����������������ɻ�,Ϊɶǰ��ʹ�ý���,�����иij���������?��Ϊtshift()�����ʱ������,�Զ��ƶϳ����Ӧ��freq,���ǽ��н����,�����ƶϲ�����ֱ�ӱ���,����ָ��freq='D'�ŷ������������ӡ�ֱ��ʹ��df.thift(-1)�������

�����:shift()��tshift()�����ж���һ��axis�IJ���,���ǰ�ִ�еķ������,��ô��Ӧʱ�������ķ���Ҳ��Ҫ��,��ԭ����ת�ü���(Ĭ��axis=0,ʱ�����������з�����;axis=1,ʱ��������Ҫ���з�����)

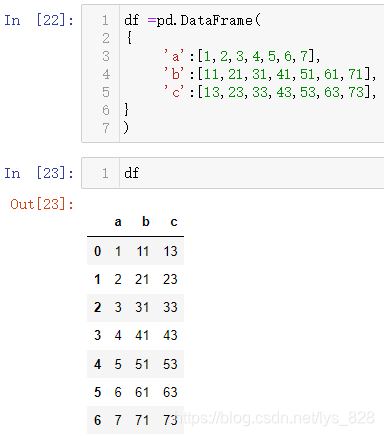

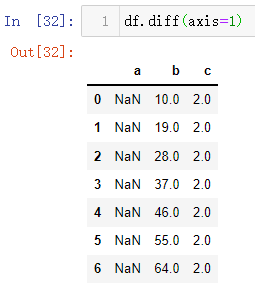

10.3 diff ��ֵ����

�ȴ���һ��ʾ������,��������

df =pd.DataFrame(

{

'a':[1,2,3,4,5,6,7],

'b':[11,21,31,41,51,61,71],

'c':[13,23,33,43,53,63,73],

}

)

��������������:

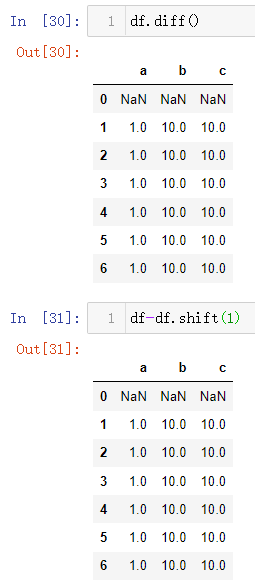

Ȼ��ʹ��diff()�����������յ����������,�������������⺯���Ĺ��ܡ��������е���������ʵ��df-df.shift(1)�IJ���:��һ�е�ֵ��ȥ��һ�е�ֵ

�÷���Ҳ��axis�IJ���,Ĭ�Ͼ���axis=0,������в���,��ָ��axis = 1ʱ���������в���

diff()�����еIJ��������֮ǰ����������,����freq����,��ֻ��periods��axis��������,periods��ʾ����ƽ�Ʒ��Ⱥ����·���,axis��ʾ�����ݼ��㷽��(���ỹ������,���л�����)

11 �����������ͺ���������ת��

11.1 ���õ�7����������

| �������� | ���� |

|---|---|

| object | �ַ������� |

| int64 | 64��� |

| float64 | ������,�����ڱ�ʾ����С������ֵ |

| bool | ��ֵ,ȡֵ��True/False |

| datetime64 | ʱ���ʱ������ |

| timedelta | ��ʾ����ʱ��IJ�ֵ |

| category | �������� |

11.2 ��������ת��

Pandas�г��õ���������ת�����������ַ�ʽ:

- (1)

df.�ֶ���.astype('Ŀ����������')/df.�ֶ���.map('Ŀ����������') - (2)

pd.to_numeric() / pd.to_datetime()/ pd.to_timedelta()

��һ�ֱȽϳ��ö��ڻ�����������֮���ת��,�����ַ���,����,�����,�ڶ�����Ҫ����ʱ��,��������ת���������滹��һ��errors����,����ָ��erros='ignore'�ͻ��Զ�����ת���еĴ���

11.2.1 ����������ʵ��

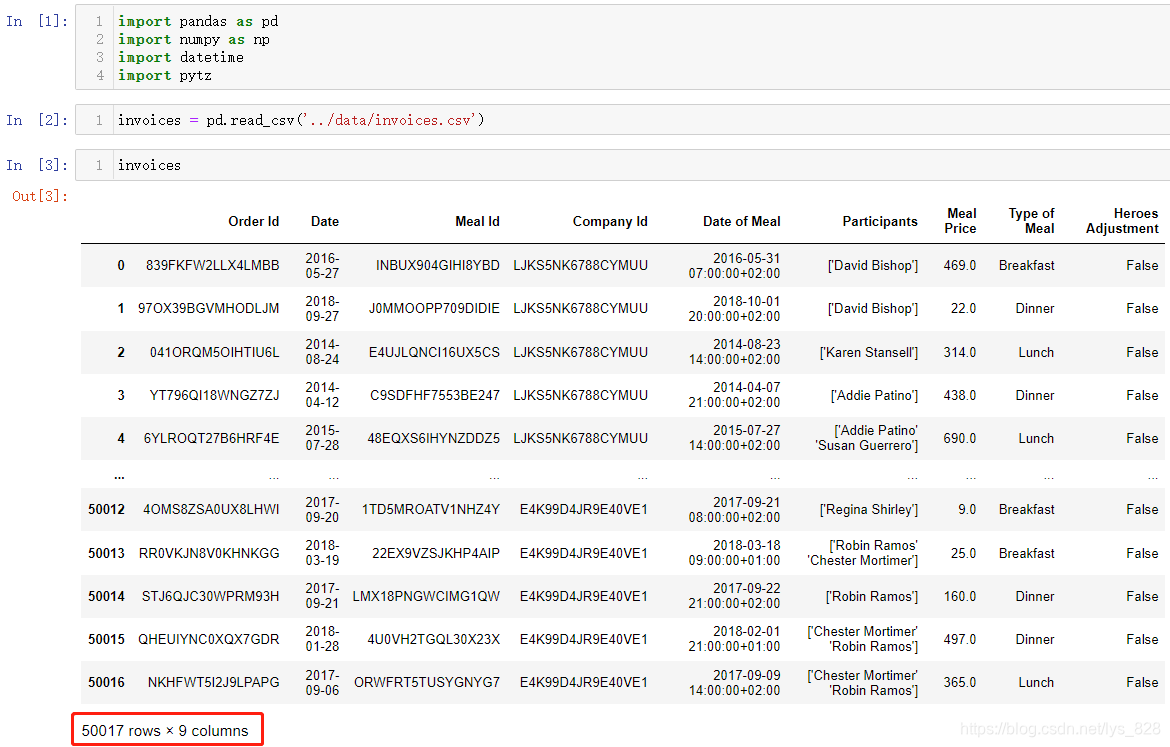

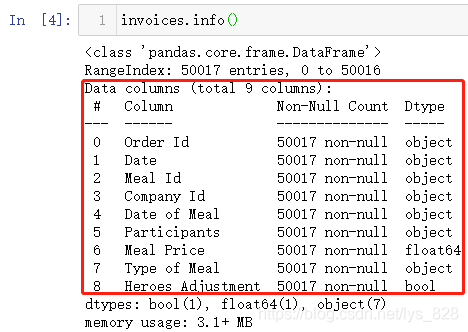

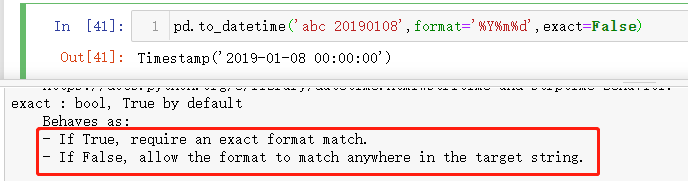

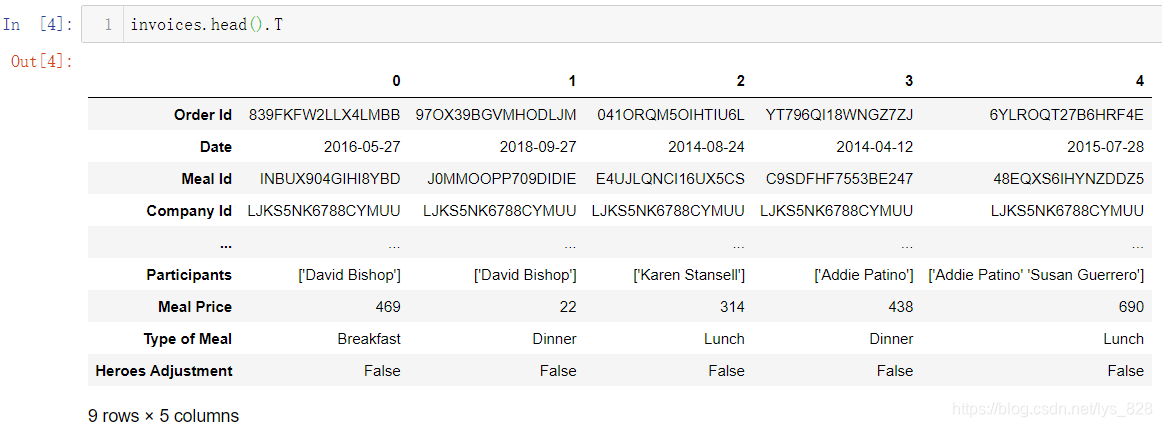

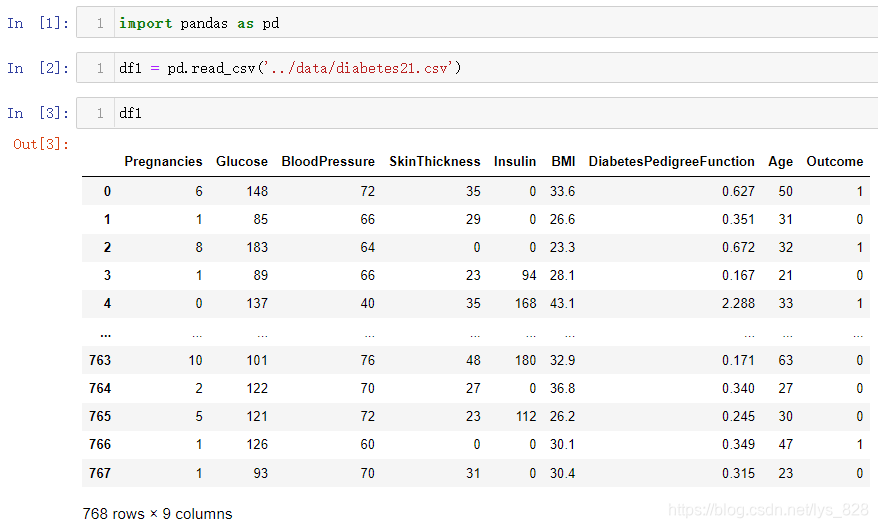

���ȵ�����Ҫʹ�õ�ģ��,������Csv�ļ��Ķ�ȡ,�ܹ���50017������,9���ֶ�

�ڵڶ�����ȱʧֵ�����Ŀ�ʼ�ͽ�������β鿴�ֶε���������,��������ٸ�ϰ�ع�һ��,ʹ��info()������������ݵĻ�������,�����������ֶε���������

�����������зֱ������������������ΪDataFrame,�����������Լ�������ʼ�ͽ����ķ�Χ;����е����ݾ��Ǹ��ֶε����,�������ֶ�����,�ֶ�����,ȱʧֵ�����Ͷ�Ӧ���ֶ���������;��������Ѹ��������ͽ��л���,����ʹ�õ��ڴ��С

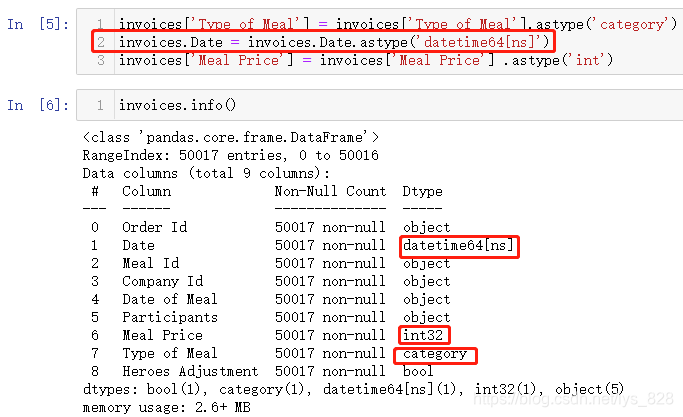

��һ���۲���ֶε��������ͷ��ֺܶ���ֶζ�����Ӧ�ô��ڵ���������,�������ID���ֶ�,����һ�������������(�еĿ�������ĸ�����ֻ���),����date���ֶ�Ҳ������ʱ�����ʱ������,����һ�־��Ǵ���TypeҲӦ�ù�Ϊ�������ݡ�ʹ�õ�һ���������͵�ת����ʽ���������ֶ�

ע��������岽��invoices.Date��ʹ��,��Ϊ����ֶ������м�û�пո�,����ֱ��ʹ��,��������Ͳ���ֱ�������ַ�ʽȥһ���ֶ�,������岽�������µ������ֶ��ж����пո�,����ֻ��ʹ�������ŵķ�ʽ�����ֶ�ѡȡ���ٴε���info()�鿴�������ͷ����Ѿ�����ת�������

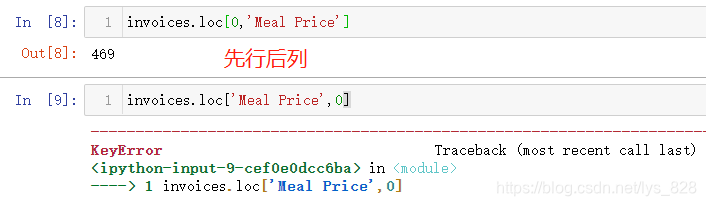

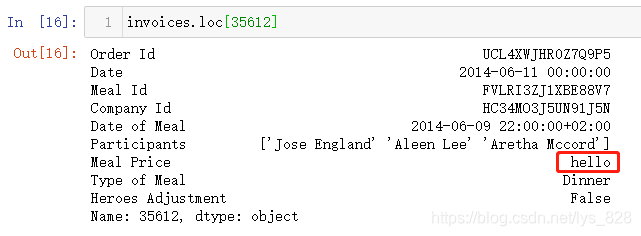

��һ�ַ�ʽ��ϰ��ɺ�,���Գ��Եڶ��ַ�ʽ��ʹ��,���ڶ�����������û��ȱʧֵ,����Ҫ�����ֶ�������һЩ�쳣ֵ���������֤��֮ǰ��λ����ĵ�Ԫ����Ϣ��ͨ��iloc[]����,ͬ��Ҳ����ʹ��loc[]λ�ö�λ�ķ�ʽ,����ע������������д�����ݱ��������к���(���ַ�������ͬ��Ҳ�������к���,����IJ��������,iloc[]Ҫ������ȶ�������,�ٽ�������;loc[]Ҫ������ָ��������,��ȷ�����ֶ�����)

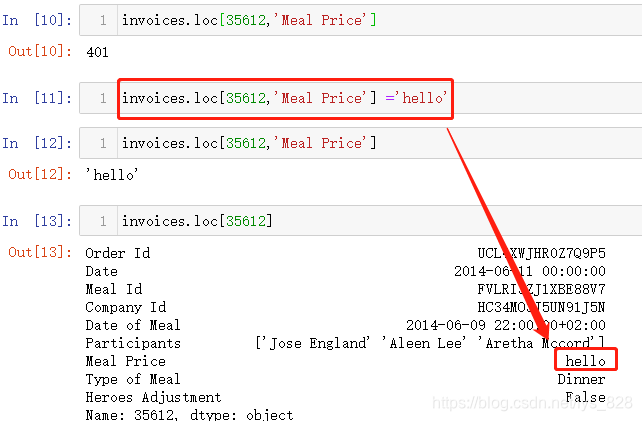

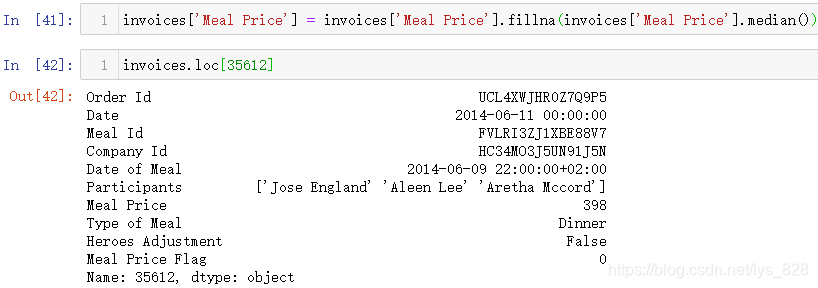

���罫������Ϊ35612,�ֶ�����ΪMeal Price��ֵ��Ϊhello,�������¡�ֻ��Ҫ��λ�������Ԫ����и�ֵ,��iloc[]���궨λ��ֵһ��

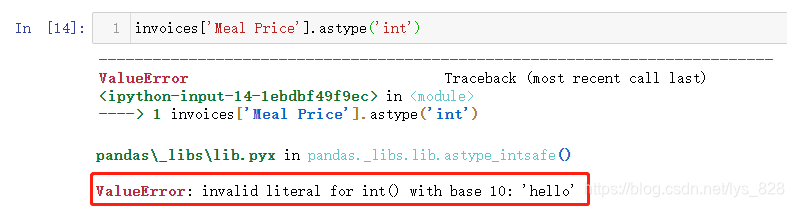

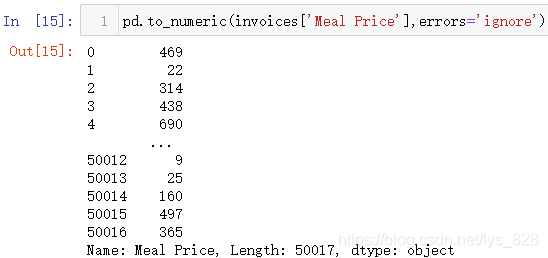

��������������ֶ����ֶ������������쳣��������,ԭ���Ǽ�Ǯ�ֶ�,��ȻΪ��ֵ����,�ո����ӵ�helloΪ�ַ���,�õ�һ�ַ�ʽ��ȡ�������,���ջ��������ܽ��������ݸ���ʾ����(��������dz����һ�ν���������ʾ������,���������ݴ�������,�ֶ����滹���쳣����,����ű�������ֱ�����е���������ת��һ��)

��Ȼ��һ�ַ�ʽû�а취��,�ͳ���һ�µڶ��ַ���,������û�б���,��������������ֶε��������ͻ�����ʾΪobject

Ȼ��鿴һ�¸ո��Ǹ�λ�õ�����״̬,������֤������û�з����仯,����Ĵ�������������������ȥ��

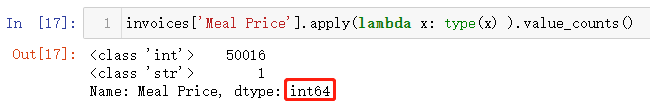

ʵ�������������ݲ����������Ǹող���һ������ֱ��֪���쳣�������͵Ķ��ٺ;����λ��,���Ҫ���������ת��������,�ͱ������Щ�쳣���ݶ�������Ȼ����и��������Ƚ���쳣��������������,ģ���������

#������������дҪ���ҵ��ֶ�����

invoices['Meal Price'].apply(lambda x: type(x) ).value_counts()

������Ϊ:(���ջ���ֶ��и����������ͽ��м���,�����մӴ�С����,���������int64��ָ��������������Series����������,����ָԭ�е��ֶ���������,��Ҫ���)

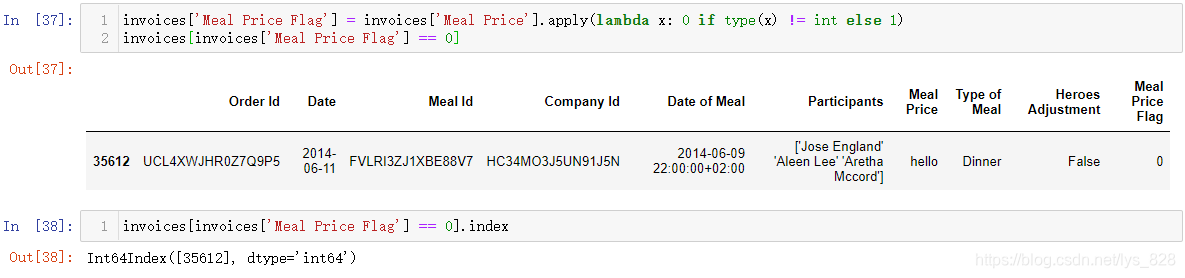

�����һ�������,�����ֽ���ڶ�������,�ҳ��쳣���ݶ�Ӧ��λ��,ģ���������

invoices['Meal Price Flag'] = invoices['Meal Price'].apply(lambda x: 0 if type(x) != int else 1)

invoices[invoices['Meal Price Flag'] == 0]

invoices[invoices['Meal Price Flag'] == 0].index

������Ϊ:(������̷�Ϊ����,���Ⱦ��Ƕ����ݽ��б��,�������Լ�Ҫ���������ͱ��Ϊ1,���ǵľͱ��Ϊ0��Ϊ�˱����ƻ�ԭ����,����һ������ֶ�,Ȼ����ݸ��ֶ�����ȡֵ�õ����Ϊ0�����ݻ����������ڵ�index���������,ʣ�¾���Ҫ�Լ��ֶ�һ�����Ѵ������ݾ�����)

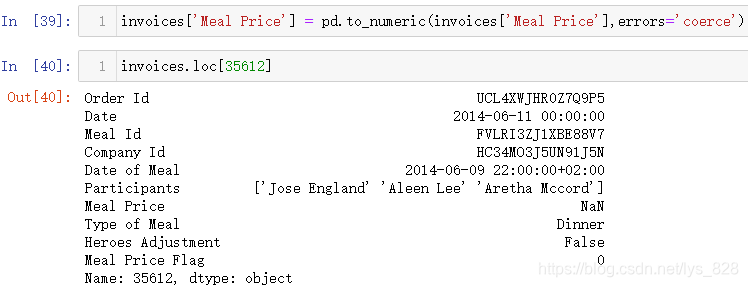

���������Щ�쳣�������͵����ݲ���Ҫ���д���,������ͼ���,֮ǰ����ʱ�ڲ���ʱ��Ҳ��errors�������,��Ӧȡֵ����Ϊerrors='coerce',���������ֵҲ���õڶ��ַ�ʽ�Ĵ���,��ʾ���쳣��������ֱ�����Ϊ��ֵ

��ֵ��Ӱ����������ֵ������,���ǻ�Ӱ����ֵ����Ľ��,����������Ϻ�һ��Ҫ��ij��ͳ��������ȱʧֵ�����,��Ϊ��ֵ,��ֵ��,�������������ֵ���

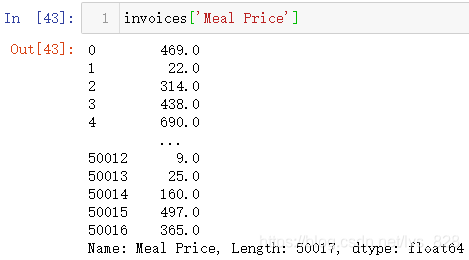

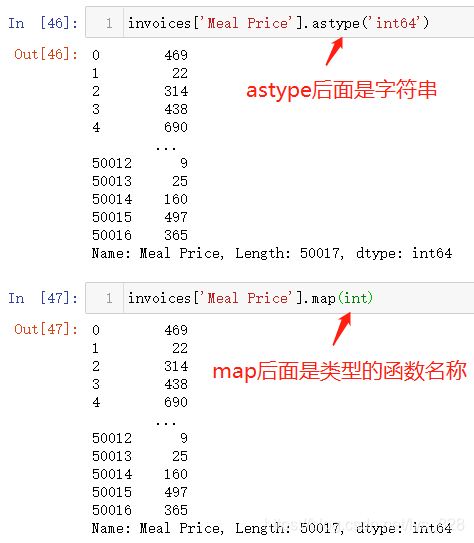

�����Ϻ�,�ٿ�һ������ֶε���������,�Զ������float64����ֵ����

��Ȼ������ֵ��,����ʱ����ʹ�õ�һ�ַ�ʽ������û��������,ע������������ʹ���ϵIJ��

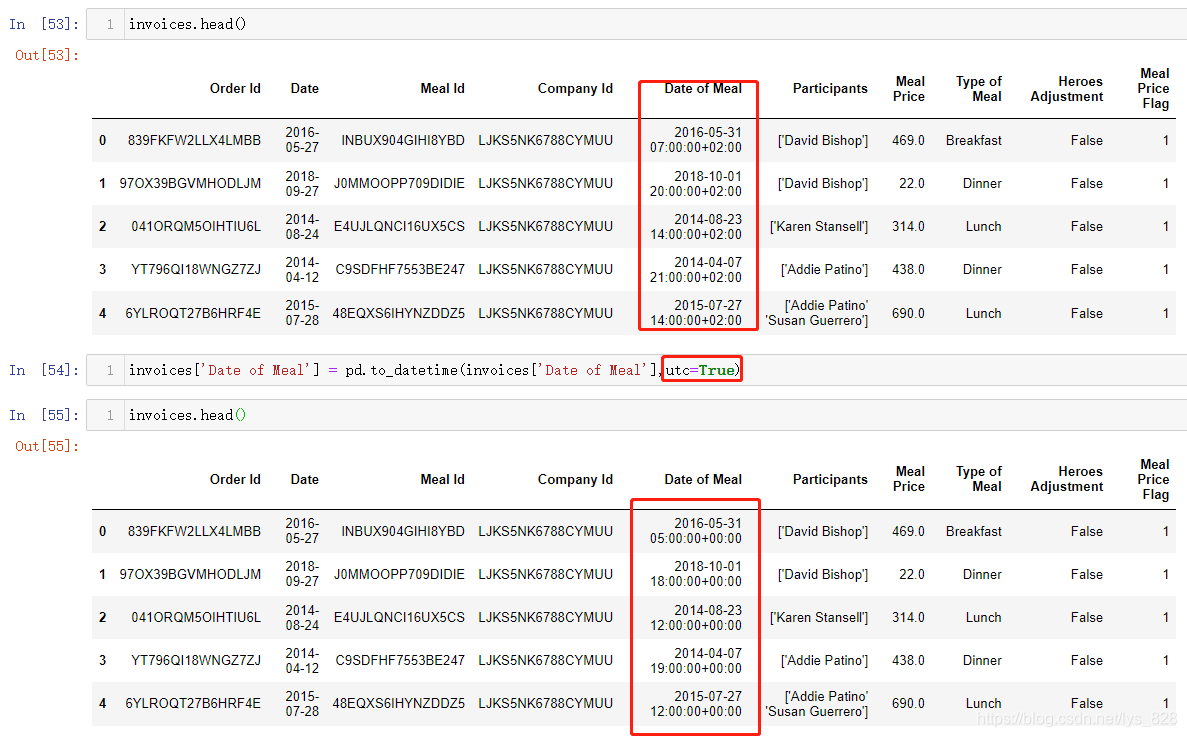

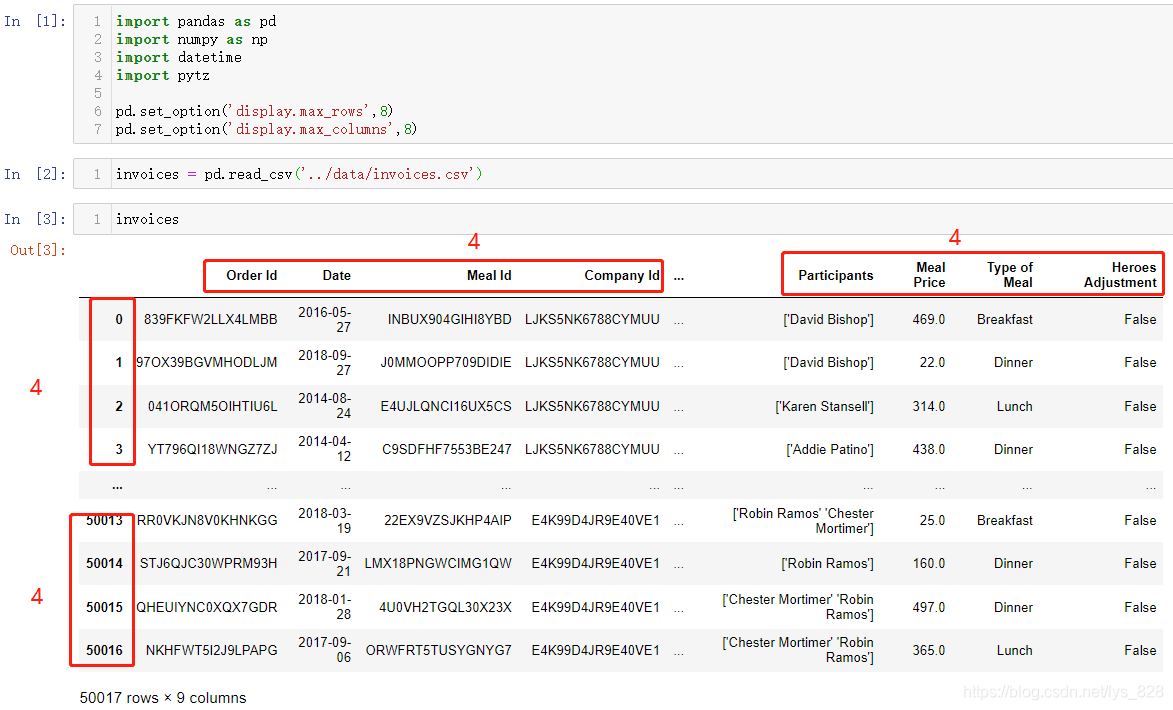

��������л���һ��������ֶξ���Date of Meal,���ʱ����ʱ��ʱ��,ת��Ϊ��ʱ��,������ԭ��ʱ��Ļ����ϼ�ȥ��Сʱ�Ϳ�����,���Dz����Լ�����,���������и�utc����,ָ��ΪTrue����

���˲���������ʵ���г�����������ת���ĺ��IJ��־�ȫ�����������

11.2.2 ʱ����������ת��

����Ͳ���һЩ���ؼ���ʱ����������ת��,����֮ǰ���Զ���ʱ���ʽ����format�Ĺ����Ѿ���ǿ����,���ǻ�����һ������,format��Ҫ��������ַ�������ĸ�ʽ��ȫƥ��,��һ���ֶ��л���ֺܶ�����,��������ȡ��ʱ�����������������,��˾Ͳ�����һ���̶��ĸ�ʽ,�����������ʱ���ʽת���Ĺ���

Ҫ��������������Ҫ��ƥ��Ķ�λ��ֻ������Ҫ��ʱ���ʽ�Ϳ���,��Χ���������ݾ�ֱ�Ӻ��Ե�,�е���������ƥ���еķ��顣ʵ�ֵľ��巽ʽ�ǽ���exact����,�趨exact=False��ʾģ��ƥ��,ֻҪ�о��е�����

12 ���ݷ���ת����

Pandas �е�ת����(accessor)���ܺ�ǿ��,��������Ϊһ�����Խӿ�,ͨ������ȡ����ķ���,���õ�ת����������:

.cat:���ڷ�������.str:�����ַ�������.dt:����ʱ��

12.1 ָ����ʾ������������

�����Բ���������Ϊ��,��ȡ����,��ʾָ�����к�����,����ڶ�������ָ��ΪNone���DZ�ʾ��ʾȫ��������

#��ʾ������

pd.set_option('display.max_columns', None)

#��ʾ������

pd.set_option('display.max_rows', None)

֮ǰ��ȡ������,Ҫô��ȫ������,�����м�����ݻᱻ����,Ҫô����ָ��head()�鿴ǰ5�е�����,�ر�����Щʱ���ֶι���ʱ����Զ�����,��Ҫ�˽������ʾָ��������������,��������(�ڶ�����������ָ����ʾ�ij���)

12.2 ʱ��ת����

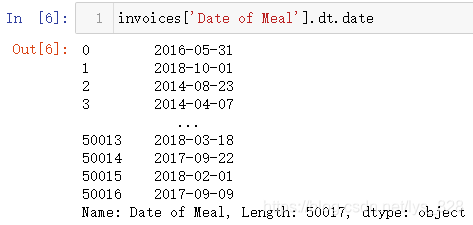

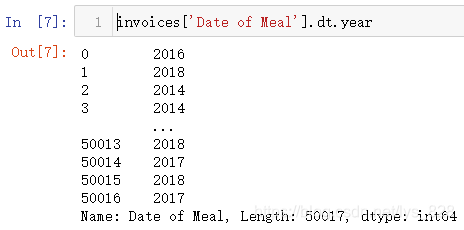

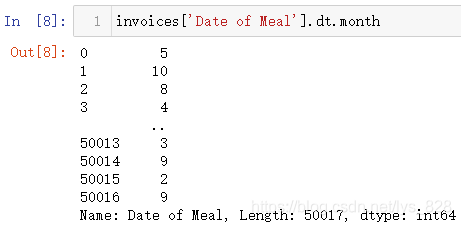

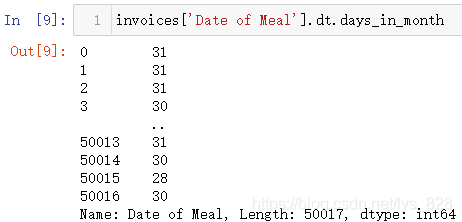

ʹ�õ�ǰ���Ǹ��ֶε���������Ϊʱ�����ʱ������,���罫Date of Meal�ֶ�ת��Ϊʱ����������

Ȼ����IJ�����Ҫ������,ֱ��ʹ��.dt��ʽ�Ϳ��Ի�úܶ�ʵ�õĹ���,����:

(1)��ȡ������Ϣ

(2)��ȡ����Ϣ

(3)��ȡ����Ϣ

(4)��ȡʱ���Ӧ���µ�����

(5)��ȡ������Ϣ

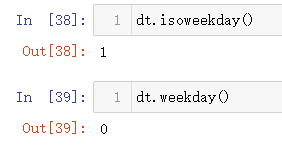

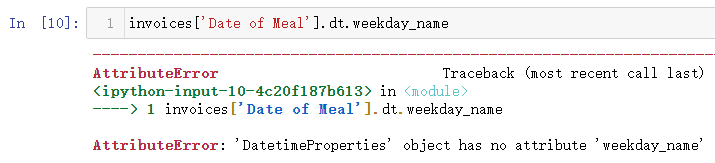

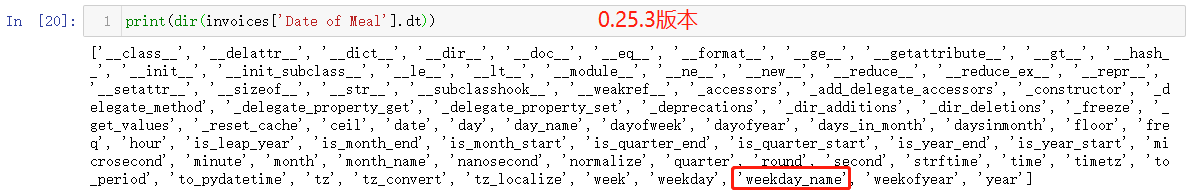

�����Ҫע��,�ϰ汾����weekday_name�������,�����µİ汾�лᱨ��,���ǰ��װ����0.25.3�汾��Pandas�����ǿ�����������

ֱ���������cell��������װָ���汾��Pandas,Ȼ���������������ʾ����

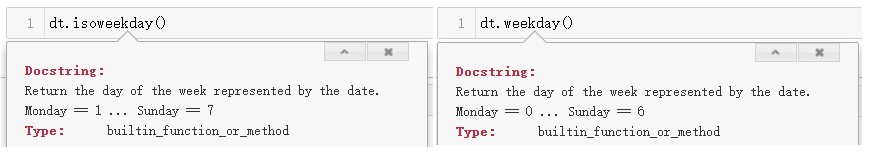

1.x�汾�в鿴����Ϣ,6.4���ֺ�ʵ�Զ���ʱ���Ѿ����ܹ���,����weekday()��isoweekday(),���ն��Ƿ������ڵ���Ϣֻ�Ƿ��ص����ִ��������ڲ�ͬ,����Ͳ�����

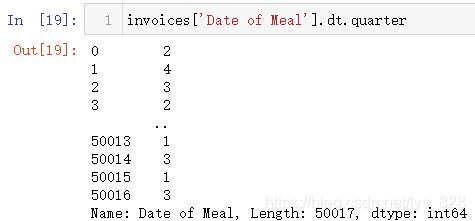

(6)��ȡ������Ϣ

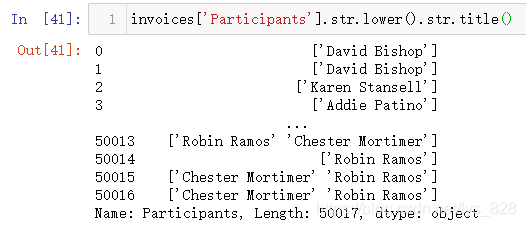

.dtʱ��ӿ��еĺ��������Ժܶ�,���Ը���dir(DataFrame['�ֶ���'].dt)���в鿴,�������0.25.3�汾�����,�����1.x�汾��������ݻ�������ͬ

12.3 ���ת����

ǰ��Ҫ���ֶ���������Ϊ�ַ���,��������������������,�����Ա𡢽���ˮƽ�ȡ���Ӧ�ڲ��Ե������о��dzԷ������������硢�С����������

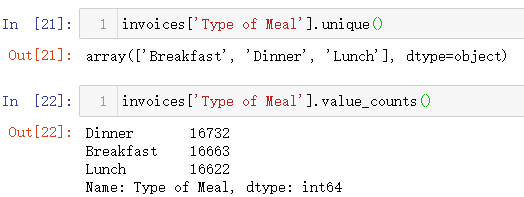

unique()������������ֶ������ݵ�Ψһֵ,value_counts()��������ͳ����ЩΨһֵ���ֵĴ���

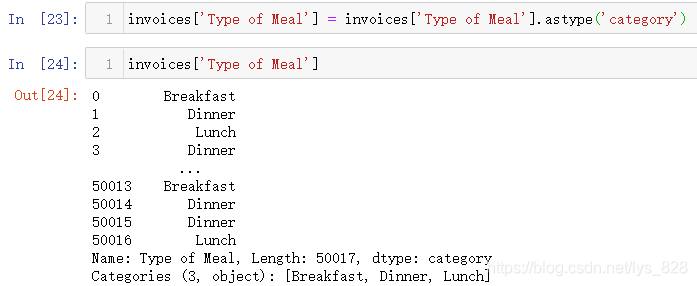

������ת��Ϊ�������

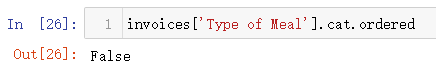

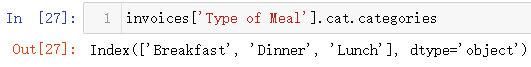

��ת���������Ҫ���ڱ���������,���õķ����������������ʱ��ת��������,����鿴��������Ƿ�����(������ݷ�Ϊ�������������,����ı���С�����б���������;����ͱ����С�Ů��)

Ҳ���Բ鿴������������ܹ�����Щ���,�����ʵ�ͺ�ǰ���unique()������������

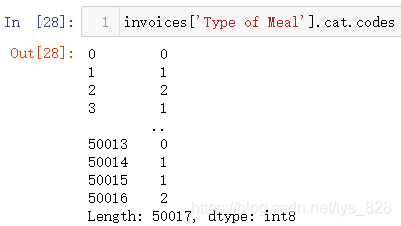

������һ���Զ�����Ĺ���,��������codes����,��һһ��Ӧ�������

����в��������ķ���,����ͨ��dir(DataFrame['�ֶ���'].cat)���в鿴

12.4 �ַ���ת����

Ҳ����Ҫ�ֶ���������Ϊ�ַ�����������,Ȼ��Ҫ�����ݷ���������,���Ժܶ�,���Ǻ����ҵ�����

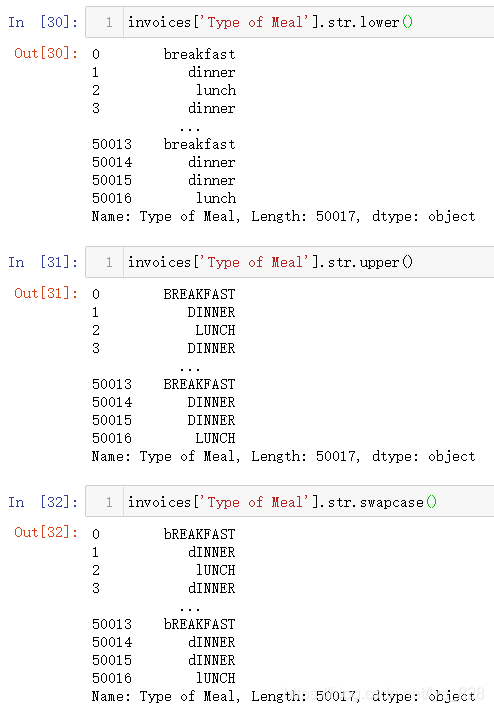

(1)�ı��Сд����Сдת��

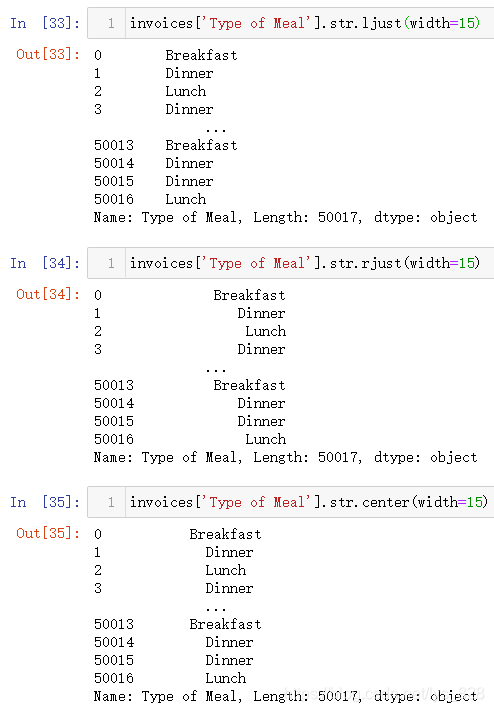

(2)�������Ҿ��ж���

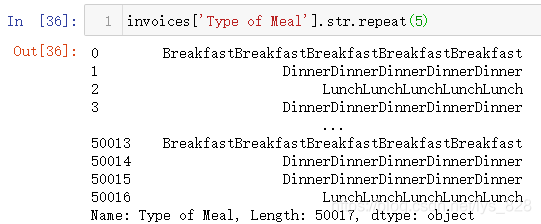

(3)�ظ��ַ�

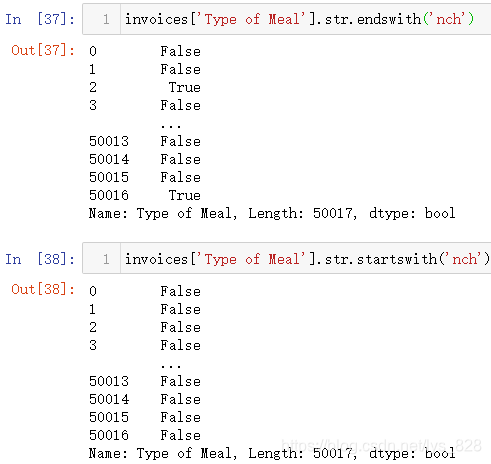

(4)�ж��ַ�����ʼ�ͽ����ַ�

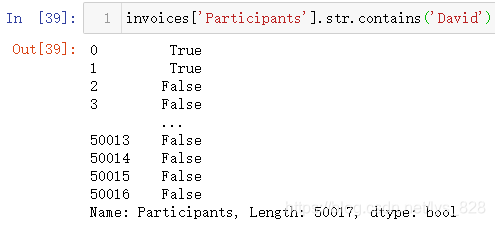

(5)�ж��ַ������Ƿ����ijһ�ַ�

(6)�ж��ַ�������

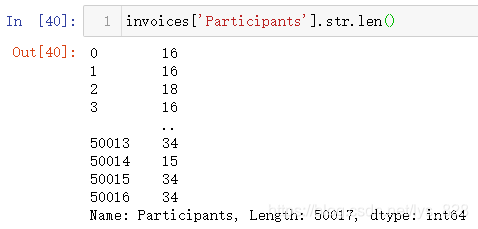

(7)����ĸ��д

�������Ҫ�����ó�����һ��,��ʱ�ʿ�����Ϊƴд��С��ͳһ,������ͼʱ��Ϊ�˱����ͼ����,Ӧ�þ����Ѹ�ʽ��Ϊһ��,������������ĸ��д�������IJ������Ƚ����е���ĸСд֮���ٽ�������ĸ��д,�����Ͳ��������(���Զ���������)

����������һЩ�ַ����IJ���,������python�����ַ������͵IJ���,���ﶼ������,���廹����Щ���������Կ���ͨ��dir(DataFrame['�ֶ���'].str)��ȡ,���˹���ת�����Ĺ��ܾͽ��������

13 DataFrame�ϲ�����

13.1 concat����

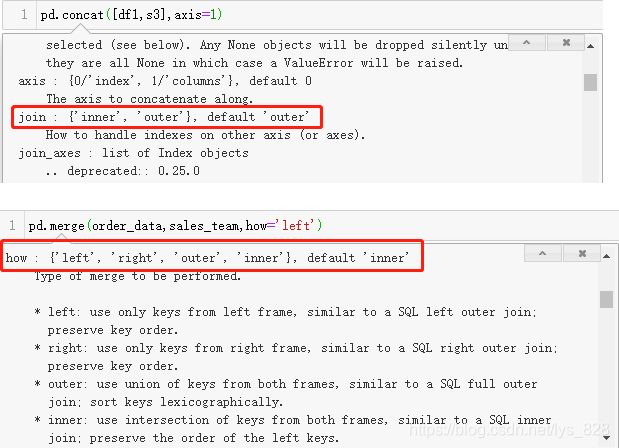

����ʹ�ò���:pd.concat(objs, axis=0, join=��outer��, join_axes=None, ignore_index=False, keys=None, levels=None, names=None, verify_integrity=False, copy=True)

��һ������obj����Ԥ�ϲ��Ķ���,һ�����б�����,�����˶�����ϲ�������,ʣ�µļ������ò�����������ν���

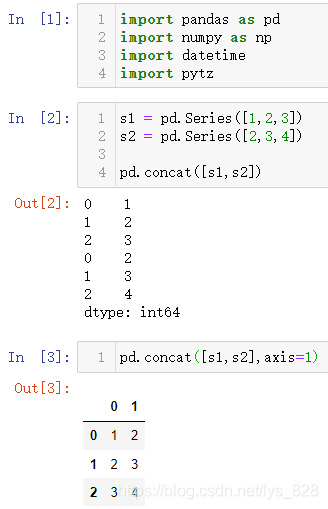

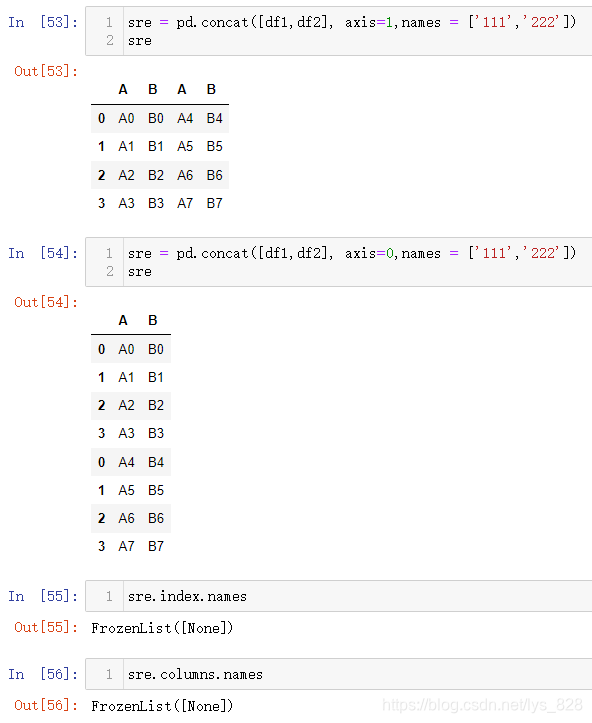

13.1.1 �ݺ�������

���IJ���axis,Ĭ�ϸ�ֵΪ0,��ʾ��������,�����ֵΪ1,��ʾ��������,����ʾ������

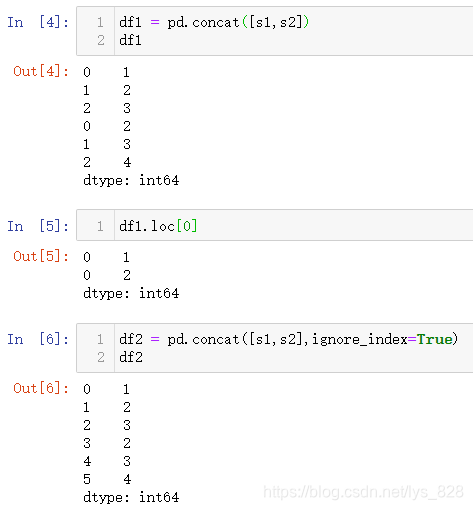

13.1.2 ��������

�����������ӻ���һ���������ԭ��������Ҳ��Ĭ�ϵ����ϲ��������,�������loc[0],�ͻ�����������,Ϊ�˱�֤�����Ψһ��,����Ҫʹ�õ�ignore_index�������,Ĭ����ΪFalse,Ҫ�������������ָ��ignore_index=True,��������

13.1.3 ���ӷ�ʽ

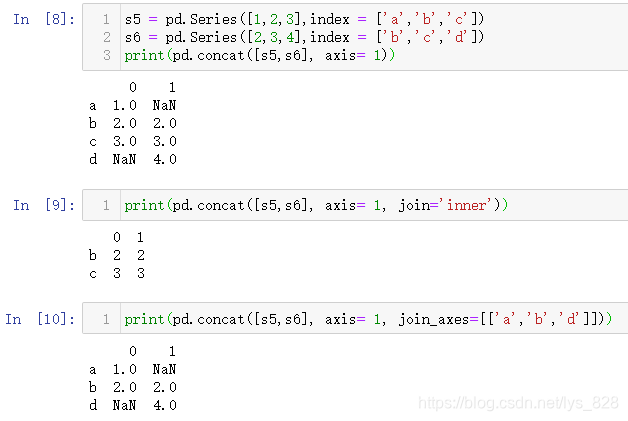

���IJ���:join��join_axes

joinĬ�ϸ�ֵ����Ϊouter,�����൱��ȫ����,ֻ��һ���е����ݶ����оٳ���,��һ��û�еĻ��Կ�ֵ��ʾ,���8������������join='inner',��ʾ����Ҫ�ϲ�������ȡ����,����ͬ���������ݲŻᱣ������,�ο���9����������join_axes��������������,����������Զ���ָ�����ӵķ�ʽ,����ͻᰴ����ָ�����������ݽ��кϲ�,����10��

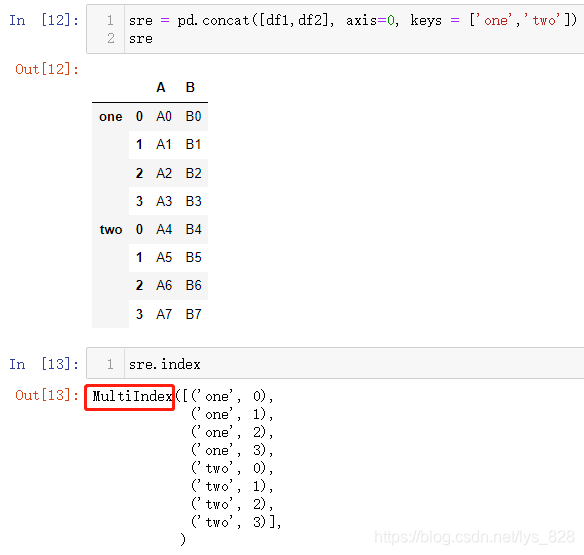

13.1.4 ����������ǩ

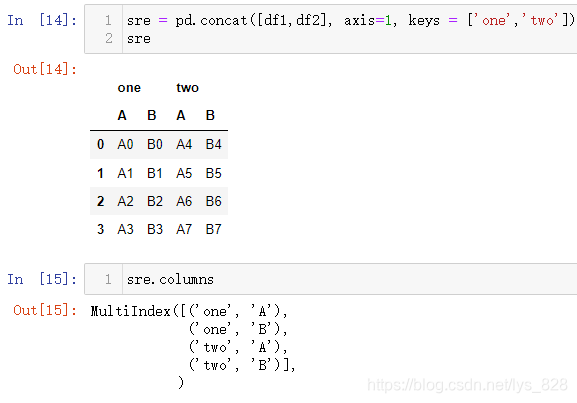

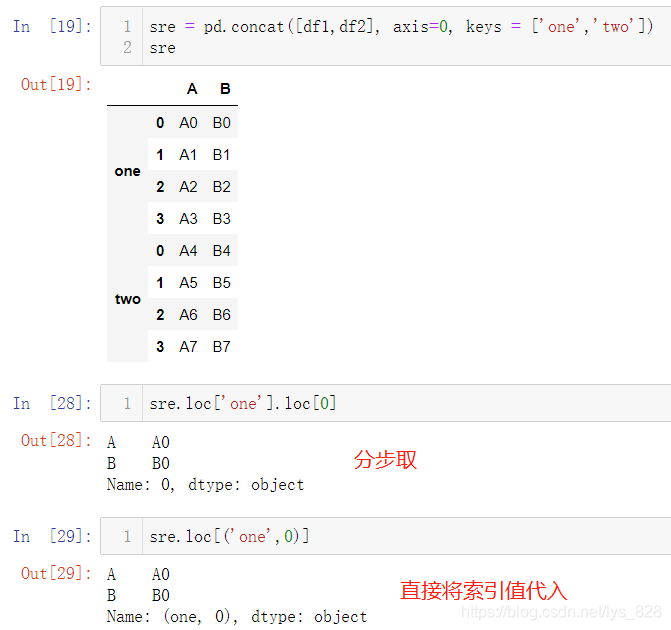

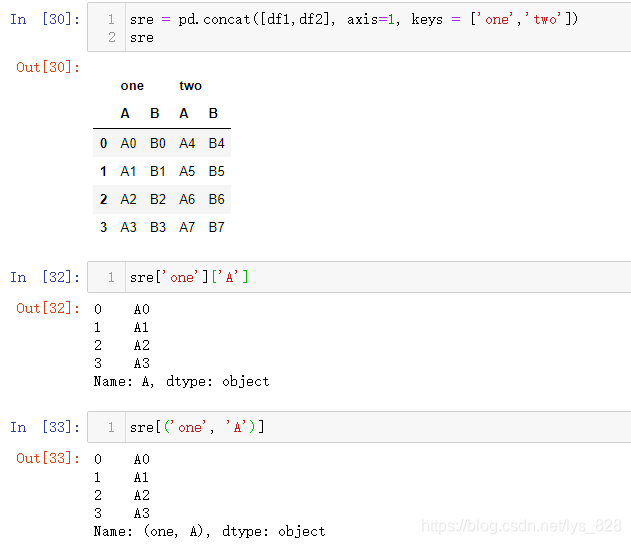

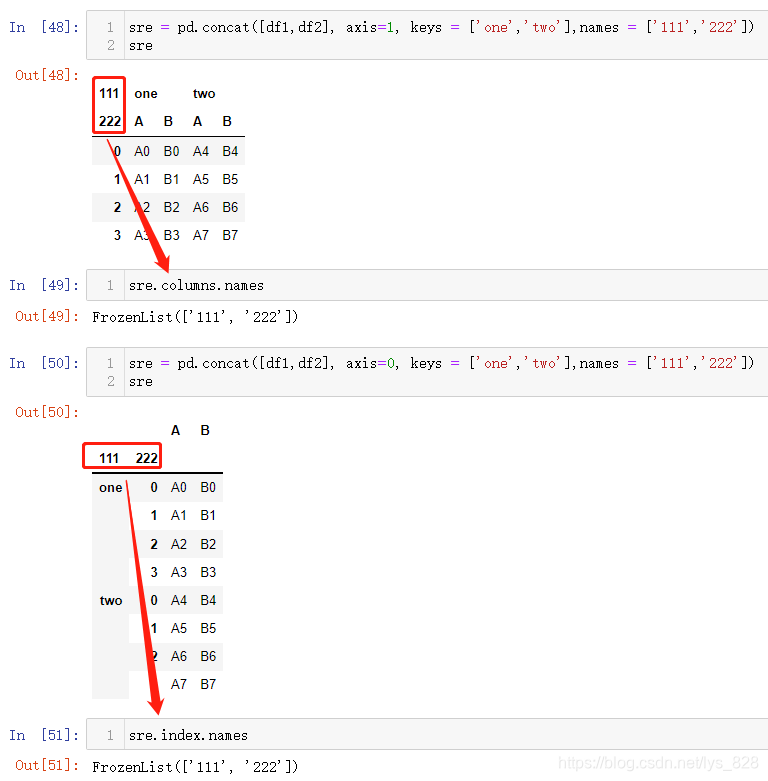

�ٽ��кϲ����ݺ�,��ʱ��Ҫ֪���ϲ������������ԭ����һ������,�൱��Ҫ��ԭ��������ǰ���һ�л���һ�ж����ݽ��з�����,�������漰���˶���������ǩ,����keys�������,�ò���Ĭ��ΪNone�������axisʹ�û��в�ͬ��Ч��,���axis=0,����ָ�������������;���axis=1,����ָ������ֶ�����

������������,��������ʾ����DF

df1 = pd.DataFrame({'A': ['A0', 'A1', 'A2', 'A3'],

'B': ['B0', 'B1', 'B2', 'B3']})

df2 = pd.DataFrame({'A': ['A4', 'A5', 'A6', 'A7'],

'B': ['B4', 'B5', 'B6', 'B7']})

���������axis=0,�������,�������(���ֱ�ӻ�ȡ�ϲ����DF������,�����������������Ѿ�����˶������)

�����趨axis=1,���Խ�����(����DF��ԭ�����ֶ�Ҳ��ɶ������)

����֪ʶ��:��������µ�����ȡֵ(�ֲ�ȡ����ֱ������ȡֵ)

����,ȡ������

��ȡ������(ע��ֲ�ȡ��ֱ�Ӱ�������ֵȡ����ȡ���Ľ��������ݵ������Dz�ͬ��,Ҳ�����·���Name�ͬ)

13.1.5 �����������

���IJ���names,��Ҫ�����keysʹ��,���û�ж������,����ָ��names����û��Ч����ʾ,���о���names���ݵ��б�Ԫ������Ӧ�úͶ�������IJ���һ��

�������ָ��names����,�������(�����ɵ�DF��û���κ�Ч��)

���˹���concat������ʹ�ó��ò����Ľ��ܾ������,ʣ�µļ��������������Ȥ������������һ��

13.2 merge����

����ʹ�ò���:pd.merge( left, right, how='inner', on=None, left_on=None, right_on=None,left_index=False,right_index=False,sort=False, suffixes=('_x', '_y'),copy=True,indicator=False,validate=None)

left����������DF,right������DFҲ������Series��������,how������ʾĬ�ϵ����ӷ�ʽ��ȡ����,��Щ����ǰ�涼���ܹ�,����������ʣ�µļ������IJ���������Ҫע�����merge�����ϲ���ֻ�ܺ���,����ʵ������

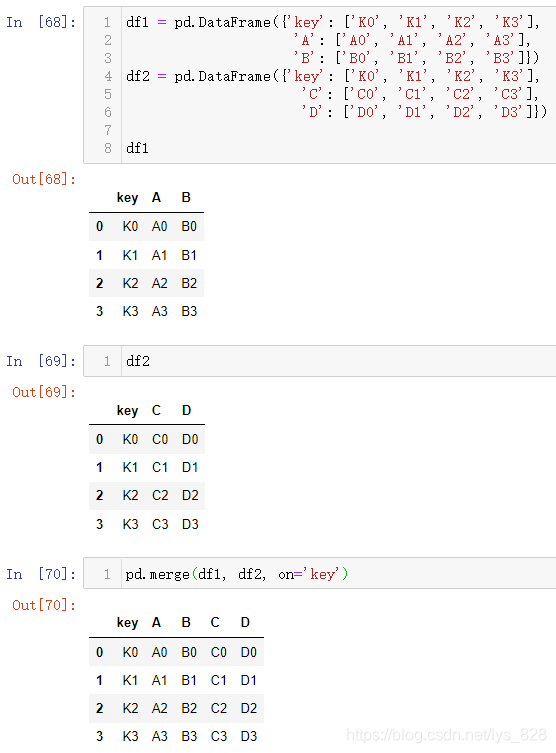

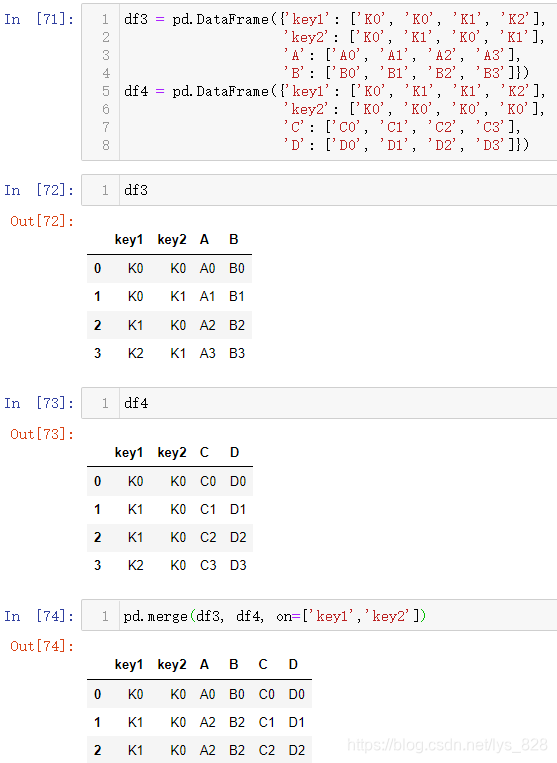

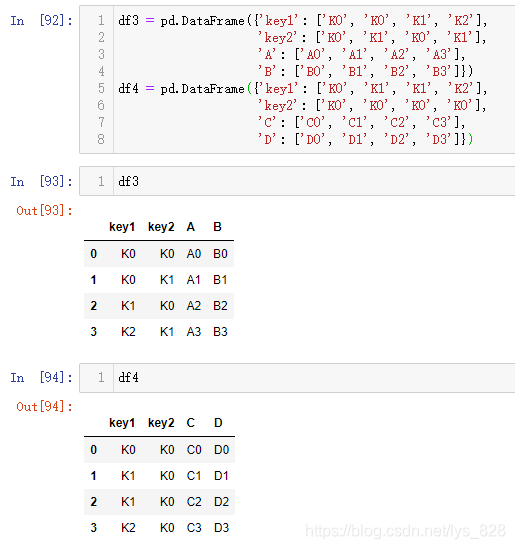

13.2.1 �й����ֶ�

���IJ���on=��ij�ֶΡ�,ʹ�ú�ᰴ��ָ�����ֶν��кϲ�,��������

on����ָ��һ���ֶ���,������ͨ���б�ָ������ֶ�,�Ѻϲ����ݵ��ֶη����б��м���

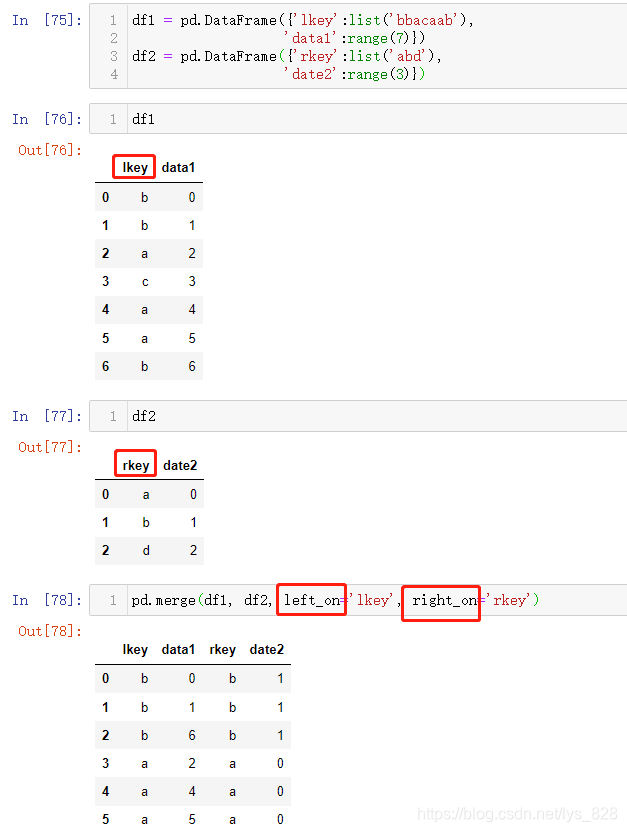

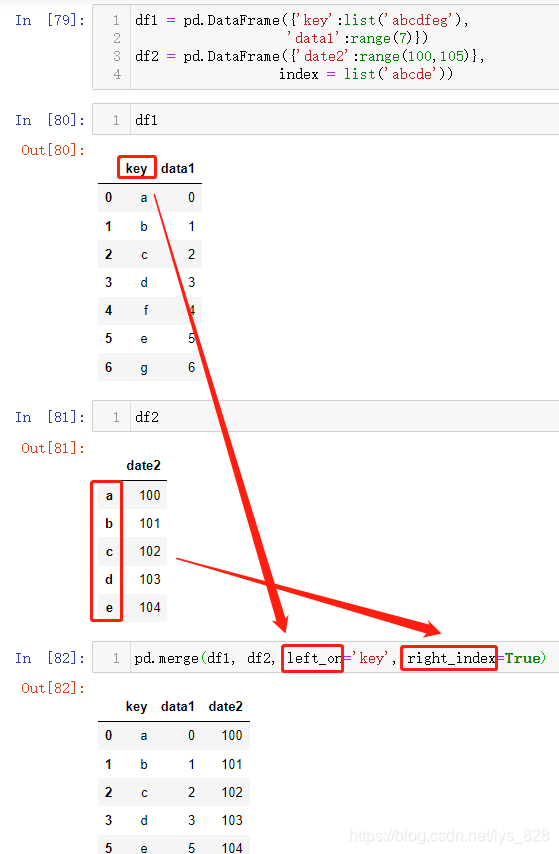

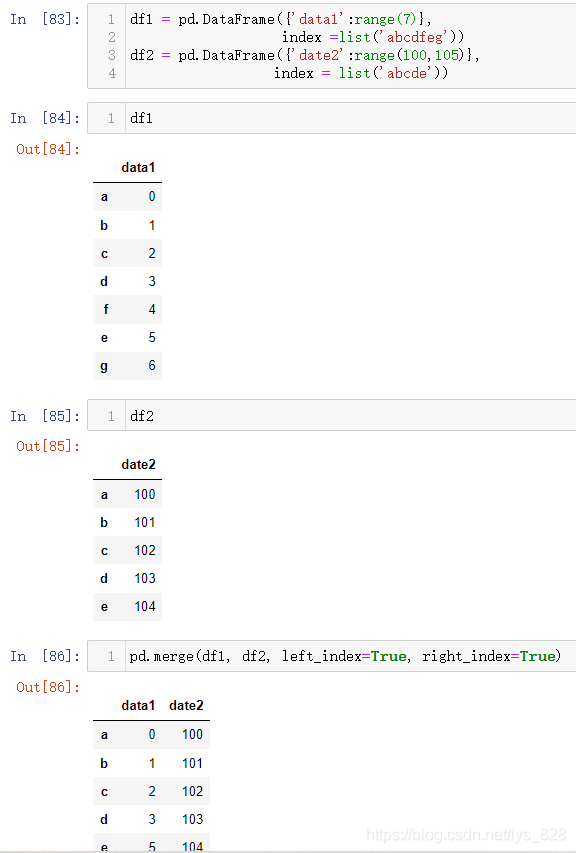

13.2.2 �����ֶ�

��û��һ�����ֶ�ʱ��,on������ʧЧ��,��Ҫʹ�õ�left_on, right_on, left_index, right_index�ĸ�����,����˼��,��_on��β������������ֶ�,_index�����������

(1)�������ֶν��кϲ�

(2)һ��Ϊ�ֶ�,һ��Ϊ����

���������ִ���left_index + right_on����left_on + right_index,����ֻ����һ��,��һ��ʹ��Ҳ������

(3)�������������кϲ�

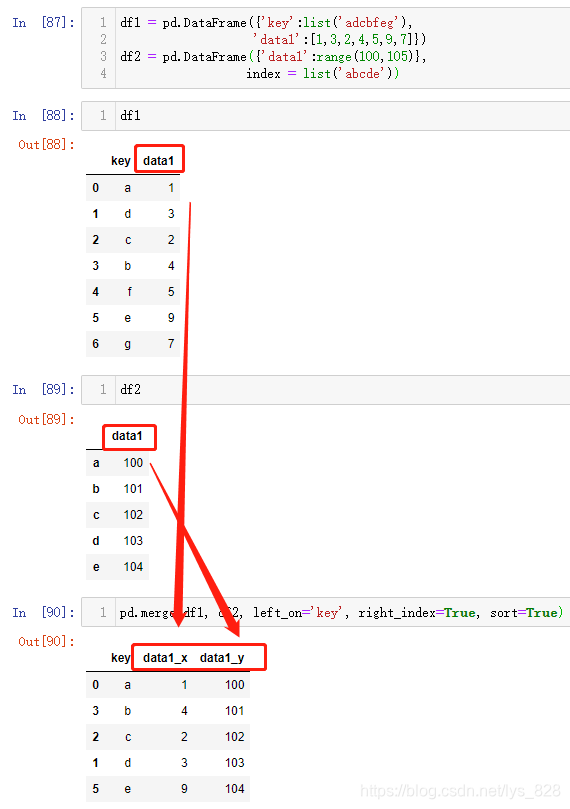

13.2.3 �ظ��ֶ�

���ϲ�ʱ�����������ظ��ֶ�,ϵͳ��Ĭ����_x,_y��Ϊ������������Ӧ���ظ��ֶ�,Ҳ����ʹ��suffixes�����Զ���,����ʹ��_base��_join��Ϊ����������

����ʹ��suffixes����,_x��������Ϊԭ���������е��ֶ�,����df1,_y������Ϊ���ϲ����е��ֶ�,����df2��˳�����һ��sort����,��ʾ�����Ľ����������

Ҳ�����Զ������,��������

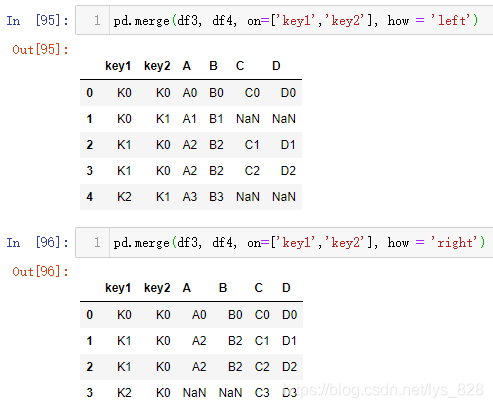

12.2.4 ���ӷ�ʽ

merge���������how������ǰ���concat������join�������ӷ�ʽ��������,�������ߵ�ʹ���ֲ���жԱȡ�����join����ֻ֧��ȡ������ȡ����,Ҳ����inner��outer,how���������������ַ�ʽ,��������ߵ�DFΪ�������ұߵ�DFΪ

����inner��outer���������Ͳ��ٽ��о���,��һ��left��right��ʹ��Ч��,������������

�Ա�һ������Ϊ��������Ϊ���������IJ�𡣵�ָ��how='left'ʱ,����df3�����ݻ�ȫ������,df4������ָ�����ֶλ����������кϲ�,û��ƥ��ĵط����ÿ�ֵ�������,ͬ��Ҳ������how='right'�����,��ʱ�Ҳ�df4�ᱣ��ȫ������

���˳��õ�һЩ����ʹ�þ��������,ʣ�µ�������������Ĭ�ϼ���,�ճ�ʹ���л����ϲ��ý�������,����Ȥ�Ļ����Ե���ʹ���ֲ��˽�һ��

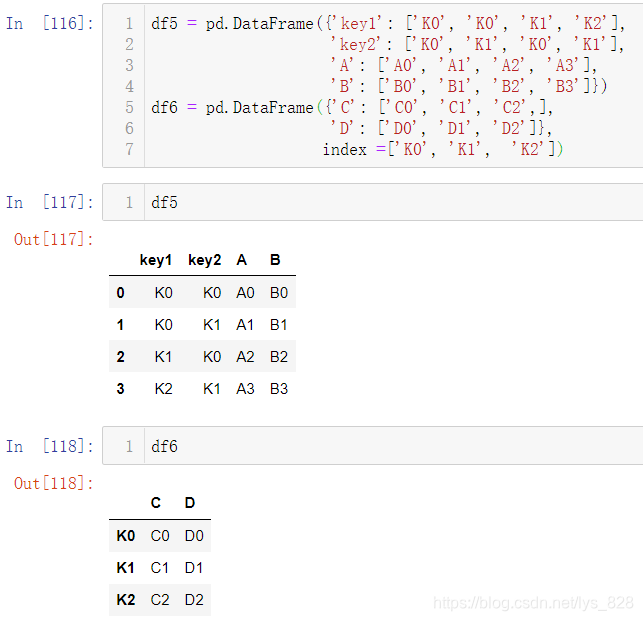

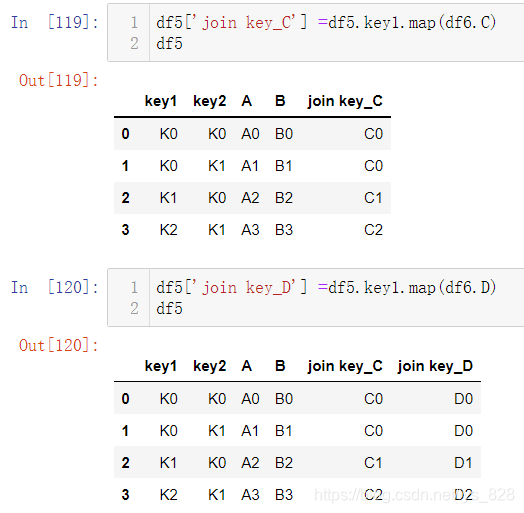

13.3 ʹ��map�������кϲ�

��һ�μ����ֶε�map()������,����Ҫʵ�ֵľ������ݵĺϲ�����ʵԭ��Ҳ��֮ǰ��һ��,���ǰ���һ�е����ݽ���ӳ��,ͬ�ȵ��������ӵ��µ�һ��

������������

���罫����df5�е�key1�ֶν�df6�е�C�к�D�е����ϲ��������ԭ���ͺ�֮ǰʹ��map���������ֵ䱾������һ�µ�,ֻ�����ֵ��������,����ͨ����ȡDF�е�һ������Series���������������

13.4 ������

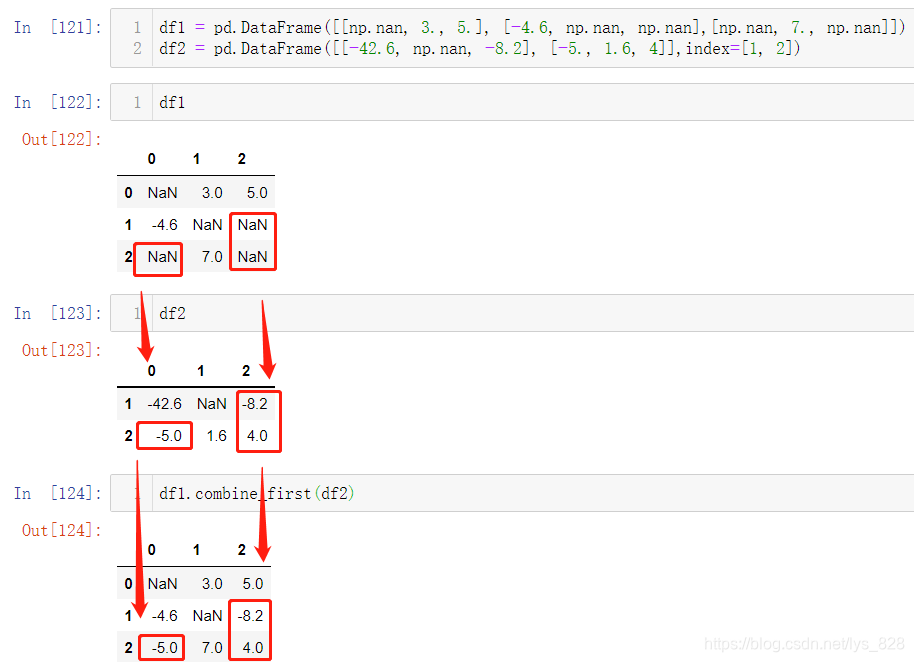

��Ҫ������������:df1.combine_first(df2) ��df1.update(df2)

13.4.1 ֻ�ȱʧֵ

df1.combine_first(df2) ����ָ���df1�����еĿ�ֵ����,ʹ��df2���ݽ����,��ȱʧֵ���ֲ����ı䡣ע�ⲻ�ǰ�����״λ�ý������,�����ϸ���������ֶ����߽�ϡ�����������,���df1����ȱʧֵ�ĵط�(������ĵط�),df2��������(�����),�֮��ԭ�հĵط��ͻᱻ���(�����),�����ǿհĵط�����

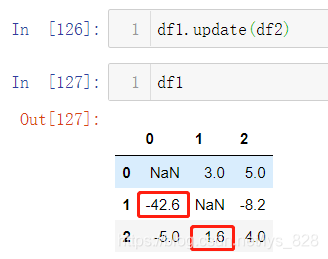

13.4.2 ȫ������

ʹ�������df1��df2����,�õ�df1.update(df2)����,����ʵ�־��ǰ�df1ͬ����ͬ�ֶε�������df2�������滻������ԭ��df1��(1,0)λ�õ�����Ϊ-4.6,ֱ�ӱ�����Ϊ-42.6,(2,1)λ�õ�����ԭ����7.0,������Ϊ1.6,ͬʱ���һ�е�����ȱʧֵҲ������Ϊdf2�е�����

ע�������ַ�������������ܵ�������,����һ������df1.combine_first(df2)������ı�df1��ֵ,��Ҫ���¸�ֵΪdf1,�Ż���df1,��df1.update(df2)ִ�к�df1�е������Ѿ������ı���,���ԶԱ�python�������������е��б����ַ�������ʹ�õ������������,�б�ֱ��ʹ�÷������Ӧ�ı������ݾͷ����仯,�ַ�������Ҫ���¸�ֵ

14 ��������

��������������������

14.1 DFת��

���ǽ�ԭ��DF���к��н��жԻ�,�൱��ԭ�еĽṹת����90�ȡ����罫���������ǰ5�н���ת��,�������(ǰ���ڽ���ʱ��������ʱ���Ѿ�ʹ�ù�ת�õķ���,����͵�����ϰ)

14.2 �����ݱ䳤����

���Ĵ���:melt()����

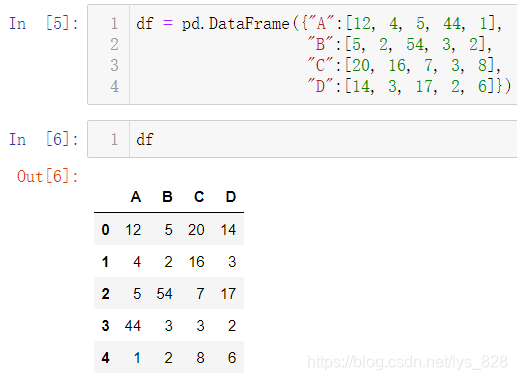

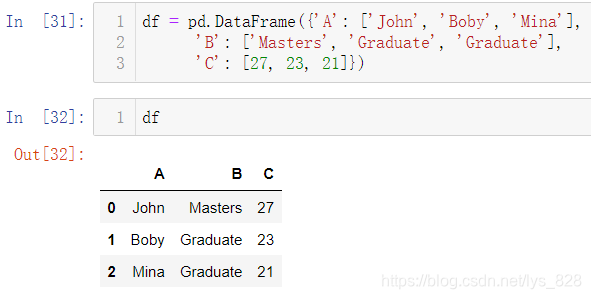

�ȸ���һ���IJ������ݰ�������

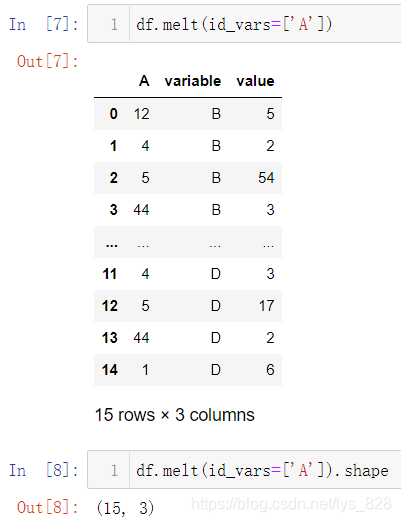

ʹ��melt()������������ת��,���籣��A�ֶ�,�������ֶ���Ϊ���ݡ���������ԭ����B,C,D�ֶζ�����variable�ֶ��µ�����,Ȼ���ӦֵҲ��һһ��Ӧ����value�ֶ���,�Ӷ�ʵ�ֿ����ݵ������ݵ�ת��

�б��л��������������,���籣��A,B,C�ֶ�,����D�ֶ���ת��

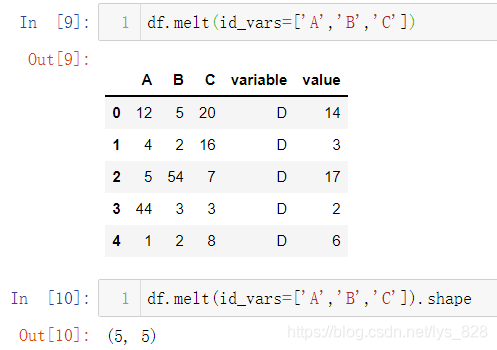

����ָ�������ֶ���,������ָ��������ת���ֶ�,����ֻ����A�ֶ�,��D�ֶν���ת��

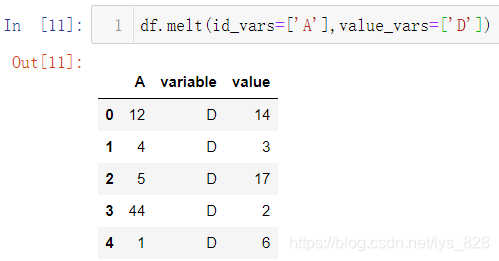

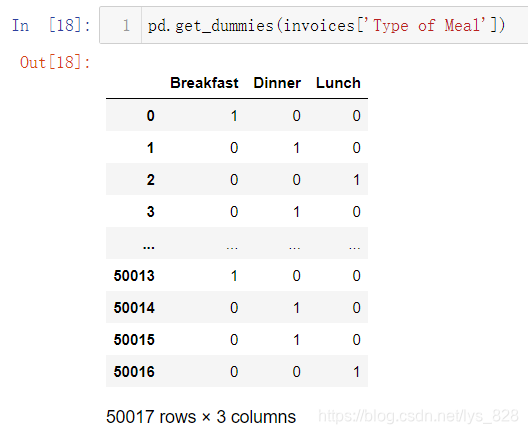

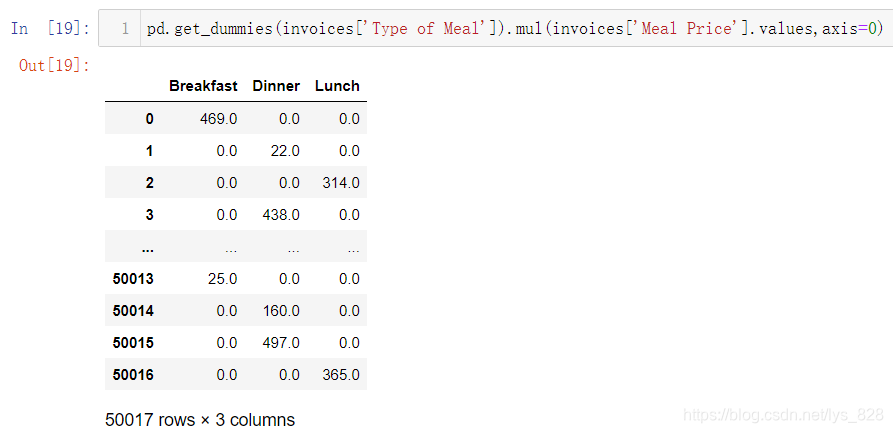

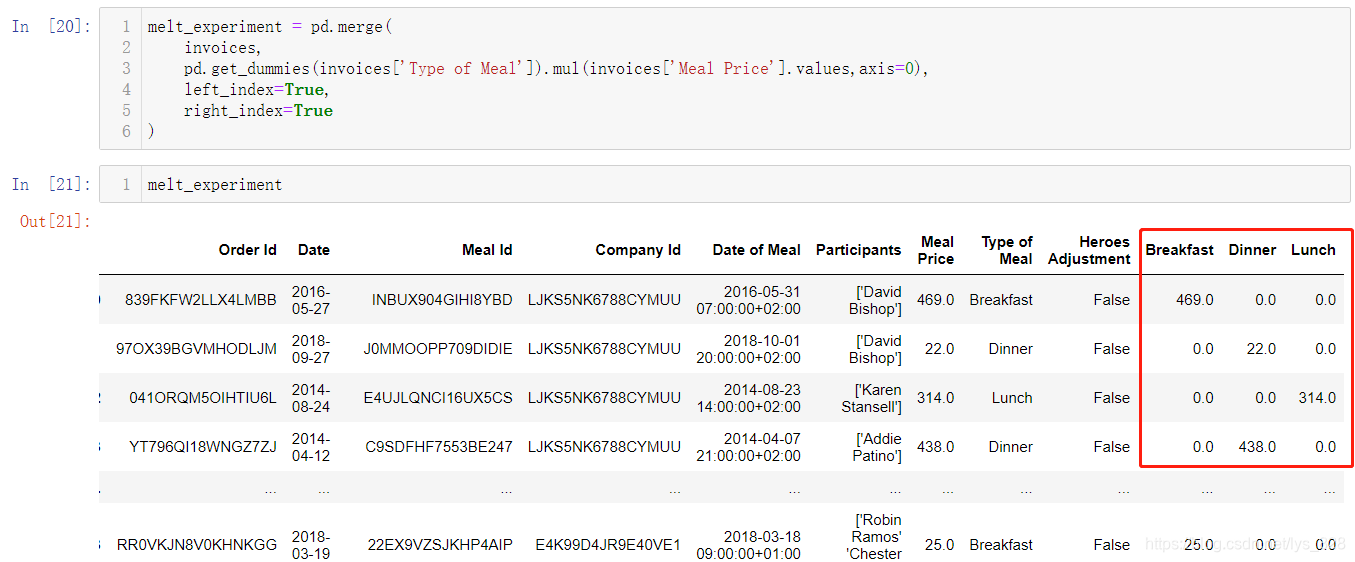

���˷���Ӧ���ڲ���������,������ѷ�Ʊ��Ϣ��Ӧ�������ͺͼ۸���Ϣ,������Ҫ�������������������ͷֱ���Ϊ�����ֶ�,Ȼ��۸��������ֶν�ϡ���һ���ֶεĶ���������ת��Ϊ����ֶ���Ҫʹ�õ�get_dummies()����

���Ž�������˷�,����Ǯ�ֶ����������ֶν��

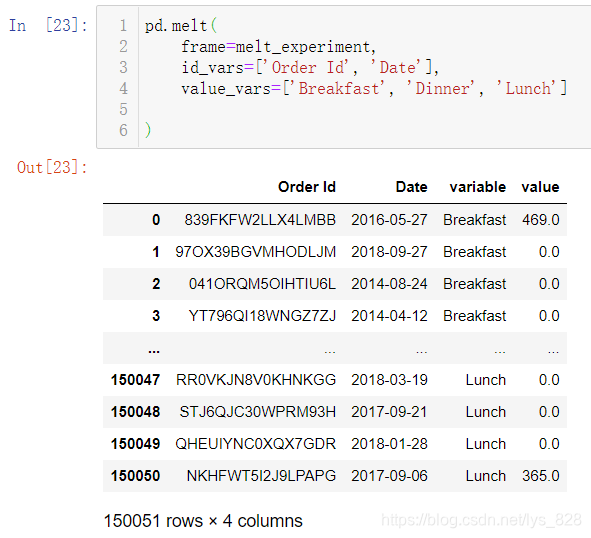

���Ͼ���Ŀ����ʽ��,��һ����������melt�������вٵ�,ֻ������Ʊ��ʱ����Ϣ�ֶ�,�������ͼ��۸���Ϣ��Ϊvariable��value�ֶ�,������������

(1)��ԭ������������Ľ�����кϲ�

(2)ָ���������ֶκ�ת�����ֶ�

14.3 �����ݱ������

���Ĵ���pd.poivot()��pd.pivot_table()

�Ƚ���һ����ʾ��,������������

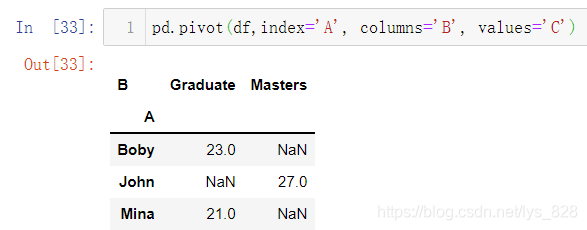

Ȼ�����pivot()����,ָ����ز�����Ӧ��ֵ,���罫A��Ϊ����,B��Ϊ�ֶ�����,C��Ϊֵ

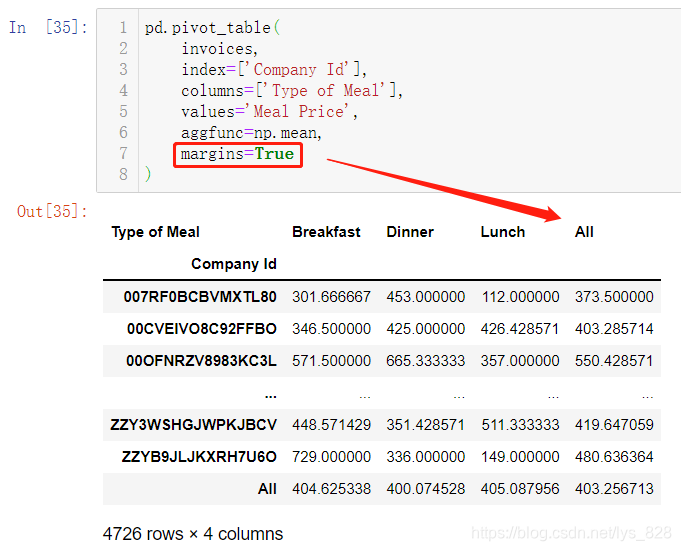

Ҫ�����һ��,�����趨value�ļ��㷽ʽ,����ȱʧֵ������ʽ,����ʹ��pd.pivot_table(),ֱ��Ӧ���ڲ�������������,���簴�չ�˾��Ϊ����,����������Ϊ�ֶ�,��Ǯ��Ϊֵ,����ķ�ʽ����ƽ��ֵ����

aggfunc��������ָ������ķ�ʽ,��Ϊÿ����˾�Է���ֹһ��,�����������ݾͰ��ճԷ��ľ�ֵ����ͳ��,Ȼ�������margins�����������º����ҵ�ALL��Ӧ������,�ֱ���к������ݽ���ͳ��,Ҳ�ǰ��վ�ֵ���С����˾Ϳ���֪��ÿ����˾���������͵�ƽ���۸�,�Ѿ�һ��Է���ƽ���۸�,���о������й�˾�������͵�ƽ���۸��һ��Ļ�ʳ����ˮƽ

14.4 ���ݷ������

���Ĵ���:groupby().agg({'�ֶ���':[����]})

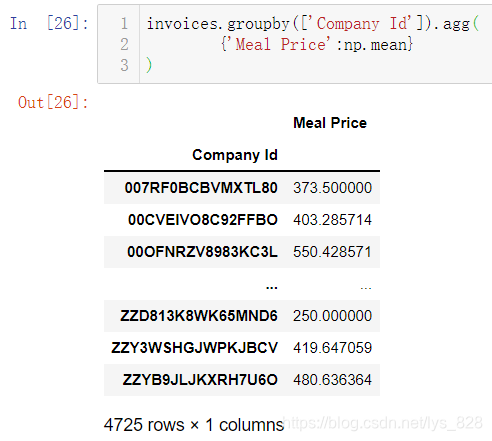

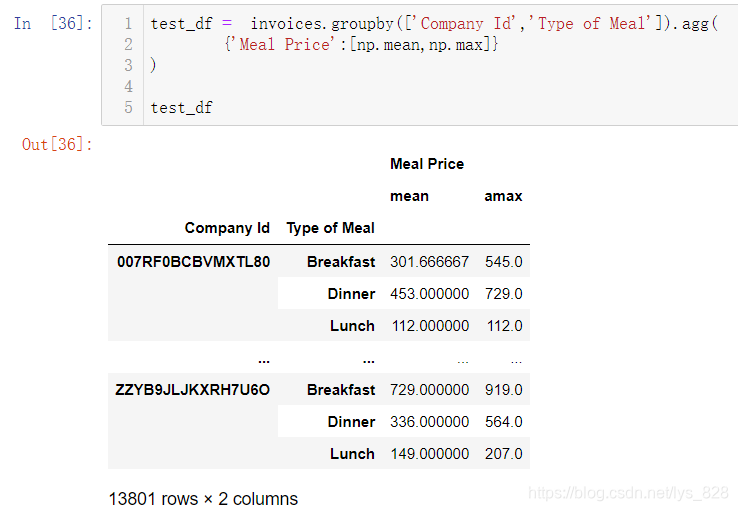

ֱ��Ӧ���ڲ�������������,���簴�չ�˾���л���ͳ��,���ÿ����˾�������͵ļ۸�ƽ��ֵ

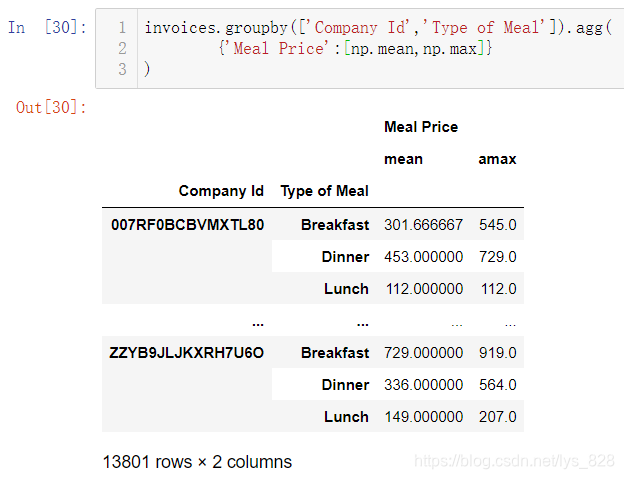

����ǰ��ն��ֶν��л����,�б������������������,�һ��ܺ�����б���Ĭ�ϵ�˳����Ϊ�������,���簴�չ�˾�Ͳ���ʱ��������,�������ֵ�����ֵ��

14.5 ����������������

���Ĵ���:unstack()/stack()

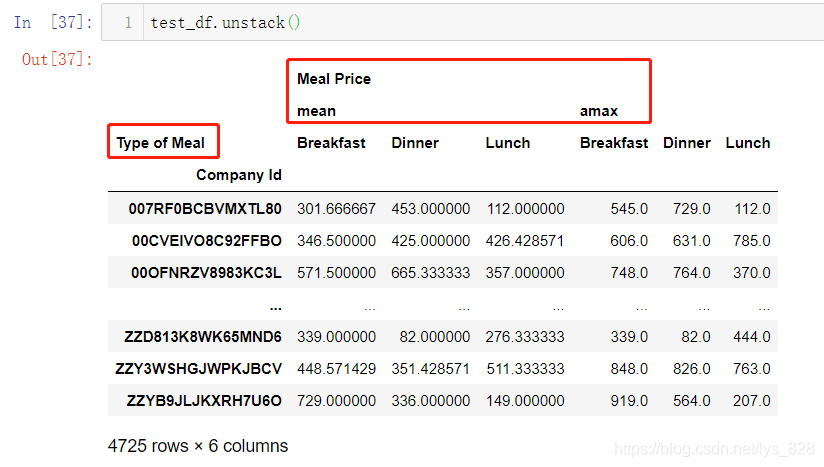

ǰ�����groupby()�������ʱ��,����б�ָ������ֶ���Ϊ����,�ͻ�������������������������������¸�ֵ��Ϊ������������

ʹ�÷�ʽҲ������,ֱ��test_df.unstack(),�������ͻ�Ѷ����������,��������������˫������,unstack()֮��ͱ���˵�������

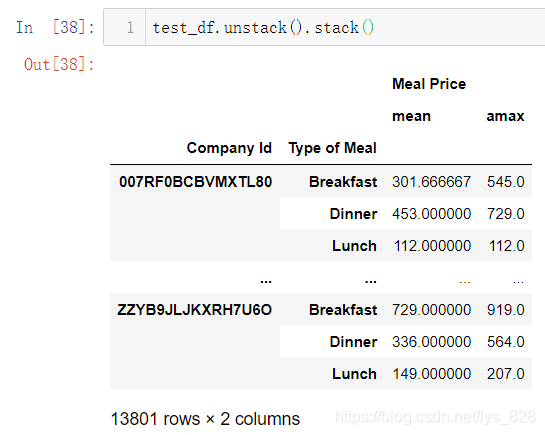

�����Ҫ���±��˫�������ͺܼ�,ֱ��stack()�Ϳ���

15 Pandas��SQL����

����֮ǰ���ܵ�Csv��Excel��������,���ݿ�Ҳ�ǿ�������Pandasֱ�Ӳ�����������Դ��

Pandas.read_sql ���������ݿ���ִ��ָ����SQL����ѯ���ָ�������ű����в�ѯ,��DataFrame �����ͷ��ز�ѯ���,�����ڸ����ݿ���н�������ʱ����Ҫ��һ��,�ȶ�ȡ����,������DataFrame���㴦����

���ڿ�����Щ��û�нӴ������ݿ�,����ʹ����н��н���,�ȶ�ȡ���ص�����,һ��������챨��ijɼ�,��ȡ����

15.1 ���

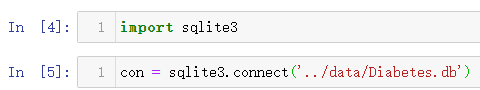

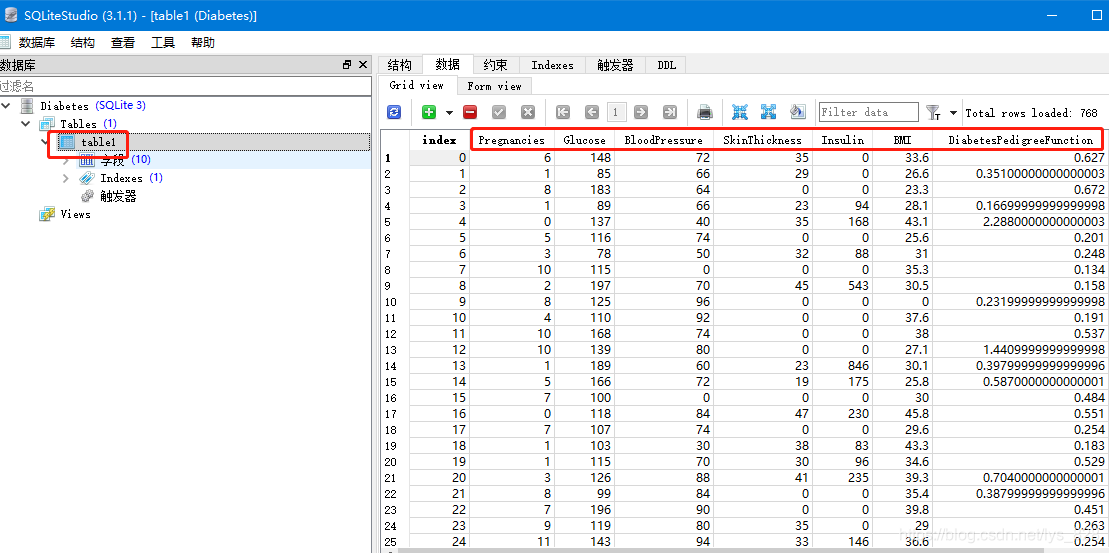

��������,���ž����ô��봴��һ�����ݿ��ļ�,��df1�е����ݴ�Ž�ȥ���ʼ�Ƚ���һ������С�͵����ݿ�,����sqlite,��python��Ҳ�����õ����ݿ�ģ��,ֱ�ӵ���,ͨ������Ĵ������ֱ�Ӵ���һ�����ݿ��ļ������Ĵ���:sqlite3.connect()

����������:(ִ�в���5��,��ʱ����ָ��·���»�����������ݿ��ļ�,�����Ĵ�С�����ļ�ֻ��0kb,��û�д����κ�����)

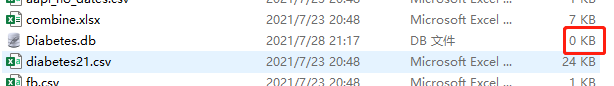

���žͰ�df1�е����ݴ��뵽���ݿ��ļ��С����Ĵ���:df1.to_sql(name='table1',con=con,if_exists='append')����name��ָ�����ݿ��б�������,con�������������ϸոմ������Ǹ����ݿ��ļ�,if_exists='append'��ʾ���������������,�����ӵķ�ʽ������д�뵽���ݿ��ļ���

15.2 ������

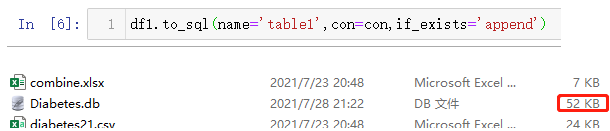

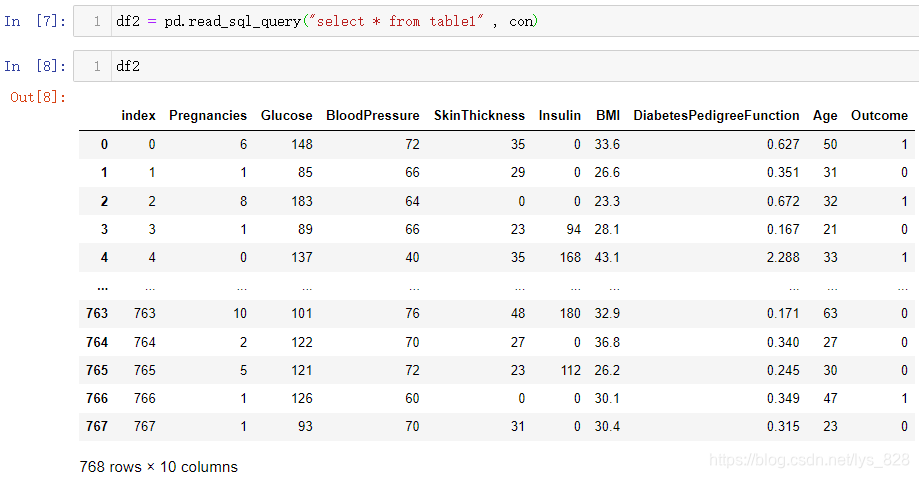

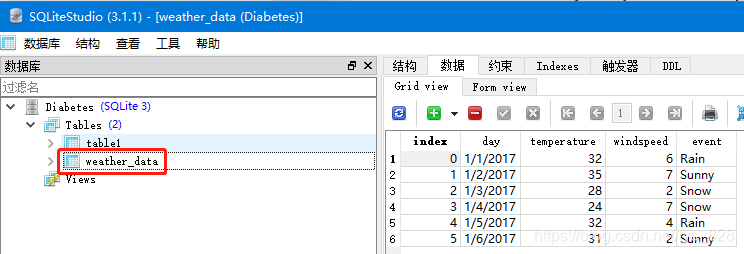

�鿴���ݿ��ļ���Ϣ����ͨ������sqlite����,Ҳ����ʹ�ô�����в�ѯ,��˵���д����ѯ,���Ĵ���:df2 = pd.read_sql_query("select * from table1" , con)

���ʹ���������в鿴,�����õ������ܶ�,�����õ���SQLiteStudio,������ļ���,˫��table1��,Ȼ���ٵ�����Ϸ������ݡ��˵����Ϳ��Բ鿴������������

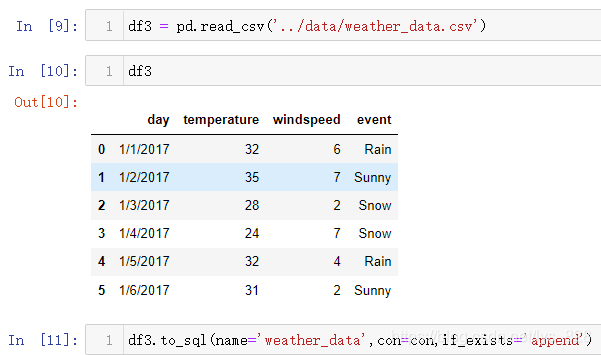

15.3 ���Ӷ��������

����������һ��֮ǰ���ļ���ŵ����ݿ��п�һ��,�����������ݡ�ע������û���½����ݿ��ļ�,����ֱ��ѡ��ĸոյ�con

ͨ��������һ���Ƿ�������ӽ�ȥ������һ��������(��ʵ����,���ݿ���൱�ڶ��csv�ļ��IJֿ�,���Լ��϶���ļ���һ��,���Ҵ����ʱ��Ҳ��������)

����ʹ��Pandas���ܽ��ܼ�Ӧ�õ�ȫ�����ݾ����������,�������??�c(�㨌��)��?