1、初识网络爬虫

1.1 网络爬虫概述

网络爬虫(又被称作网络蜘蛛、网络机器人),可以按照指定的规则(网络爬虫算法)自动浏览或抓取网络中的信息。

1.2 网络爬虫的分类

- 通用网络爬虫

- 聚焦网络爬虫

- 增量网络爬虫

- 深层网络爬虫

1.3网络爬虫的基本原理

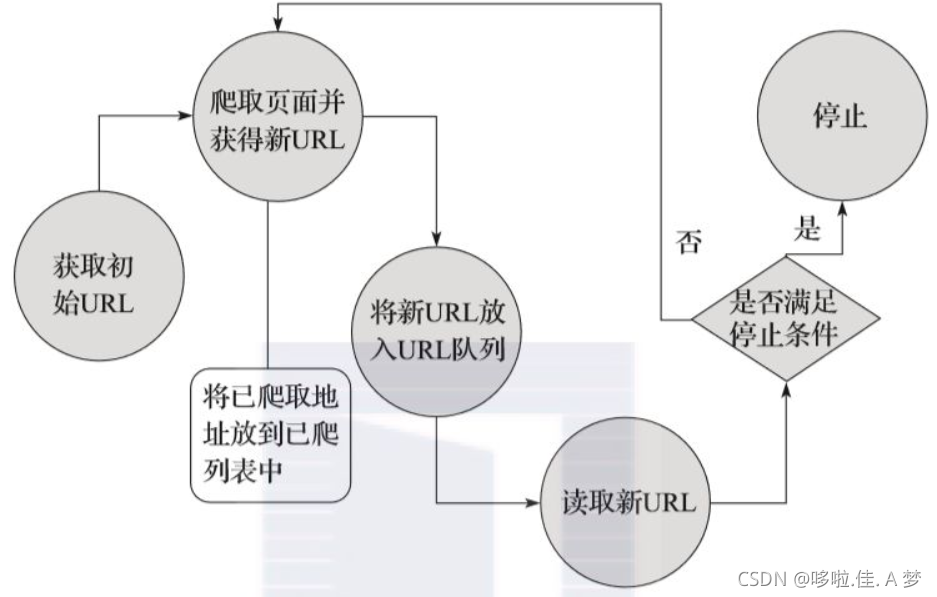

一个通用的网络爬虫基本工作流程如图所示。

2、网络爬虫的常用技术

URL地址与下载网页,这两项是网络爬虫必备而又关键的功能,说起这两个功能必然是离不开HTTP的,在Python中实现HTTP网络请求常见的三种方式:urllib、urllib3和requests,个人比较喜欢用requests,下面简单介绍下吧!

2.1 Python的网络请求之requests模板

requests是python中实现HTTP请求的一种方式,requests是第三方模块,该模块在实现HTTP请求时要比urllib模块简化很多,操作更加人性化,在使用requests模块时需要通过执行 pip install requests 代码进行该模块的安装。

以get请求方法为例,打印多种请求信息的示例代码如下所示。

import requests #导入模板

res = requests.get('http://www.baidu.com')

print(res.status_code) #打印状态码

print(res.url) #打印请求URL

print(res.headers) #打印头部信息

print(res.cookies) #打印cookie信息

print(res.text) #以文本形式打印网页源码

print(res.content) #以字节流形式打印网页源码

2.2 请求headers处理

有时在请求一个网页内容时发现无论通过GET或者是POST以及其他请求方式都会出现403错误。这种现象多数为服务器拒绝了您的访问,那是因为这些网页为了防止恶意采集信息所使用的反爬虫设置。此时可以通过模拟浏览器的头部信息来进行访问,这样就能解决以上的反扒设置的问题。

import requests

url = 'https://www.baidu.com/' #创建需要爬取网页的网址

#创建头部信息

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/92.0.4515.159 Safari/537.36'}

res = requests.get(url, headers = headers)

print(res.text)

2.3 HTML解析之Xpath

解析HTML可以使用beautifulsoup(简单),xpath、正则表达式(比较难)等,个人比较喜欢用xpath,运行效率较高且难度适中。关于xpath可以参考专业文档xpath教程 ~

3、小结

哈哈我写的这部分都是很基础的知识,第一次写有点草率且不成熟,以后会继续努力学习哒~争取下次能把脑海里一闪而过的奇思妙想沉淀在blogs里面。

实践出真知!