��װ

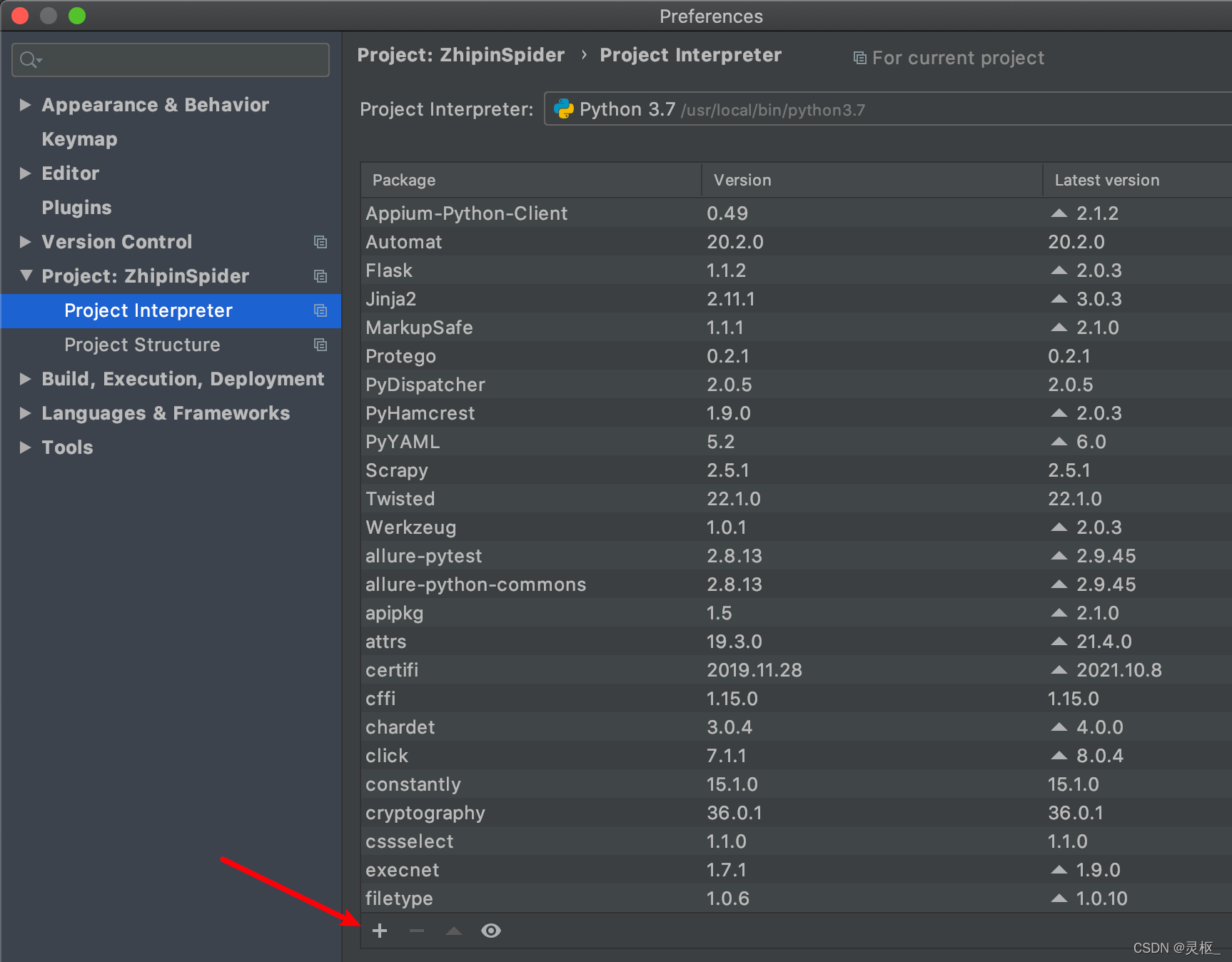

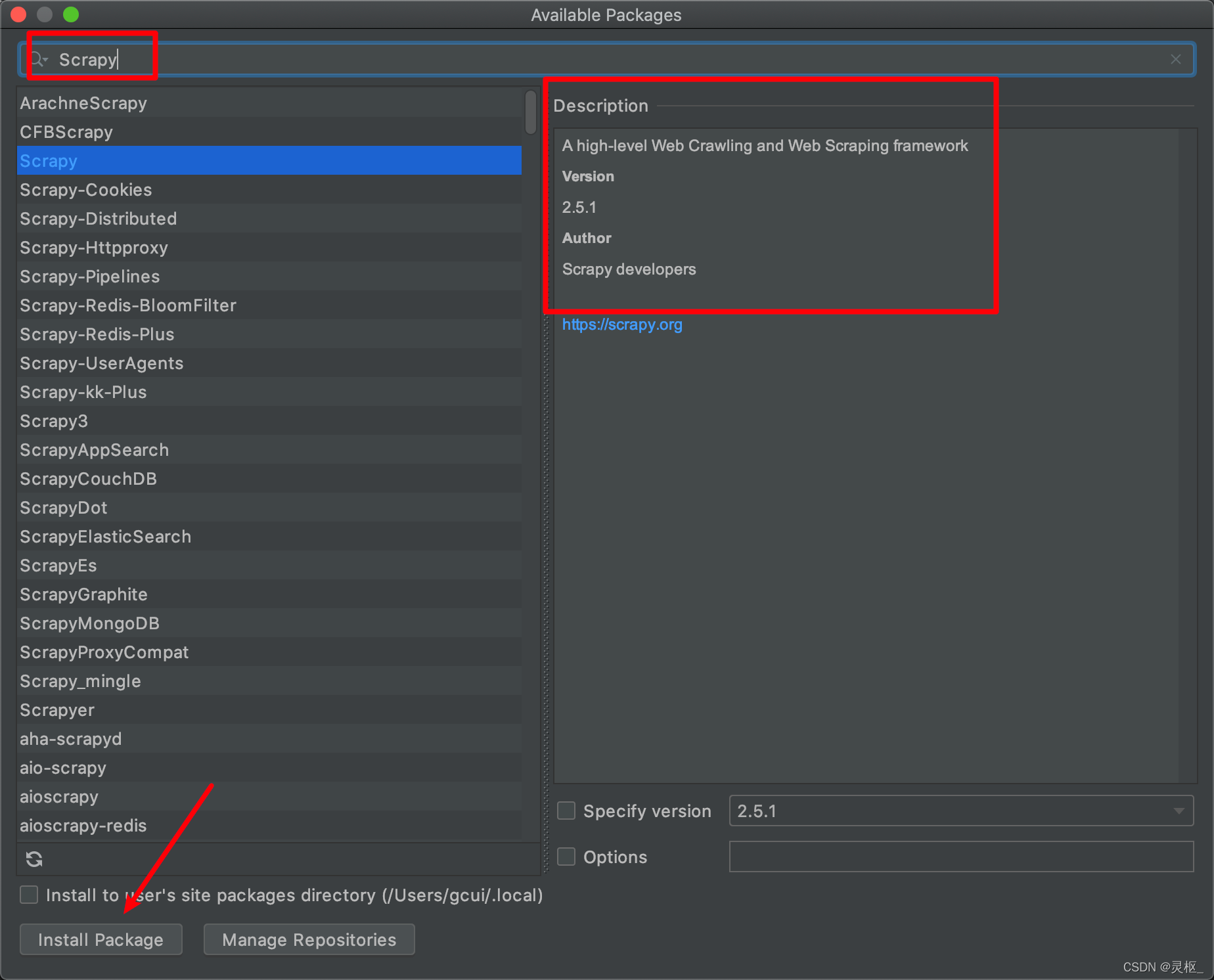

ʹ��PyCharm��װ,���뵽PyCharm -> Preferences -> Project Interpreter,����Ӻ�

��ѯ�����롮Scrapy��,�����Install Package��

ʹ��shell���Թ���

- ʹ��Scrapy�ṩ��shell���Թ�����ץȡ��ҳ��Ϣ, ����ȡ�ҵIJ���Ϊ��,����

MAC-53796:PycharmProjects gcui$ scrapy shell https://blog.csdn.net/galen2016

...

...

...

[s] Available Scrapy objects:

[s] scrapy scrapy module (contains scrapy.Request, scrapy.Selector, etc)

[s] crawler <scrapy.crawler.Crawler object at 0x10672f050>

[s] item {}

[s] request <GET https://blog.csdn.net/galen2016>

[s] response <200 https://blog.csdn.net/galen2016>

[s] settings <scrapy.settings.Settings object at 0x106817090>

[s] spider <DefaultSpider 'default' at 0x106bab490>

[s] Useful shortcuts:

[s] fetch(url[, redirect=True]) Fetch URL and update local objects (by default, redirects are followed)

[s] fetch(req) Fetch a scrapy.Request and update local objects

[s] shelp() Shell help (print this help)

[s] view(response) View response in a browser

>>>

���Կ�������200,˵��ץȡ��ҳ��Ϣ�ɹ��ˡ�

ע��,�������403,��������ҳ�����ˡ������桯,������Scrapyαװ������������,���ڷ�������ʱ����User-Agentͷ,��User-Agent��ֵ����Ϊ��������������User-Agent��������������Ŀ�����ģʽ�в鵽User-Agent��

����,����ʹ������������Scrapyαװ��Chrome�����������shell����

scrapy shell -s USER_AGENT='Mozilla/5.0' https://blog.csdn.net/galen2016

- ��Scrapy��shell����̨����response��xpath()��������ȡXpathƥ��Ľڵ�,���ȡ���͵ı���:

>>> response.xpath('//article//h4/text()').extract()

['PyCharm�ϴ�������Ŀ��GitLab - MacOS��', '��Docker��Docker����Web UI�Զ���Demo', '[Mac] selenium��Chrome�����', 'Python-���õ��������ʽ', 'Docker - Dockerfileָ��', '��Docker��docker���������ܽ�', 'Postman/Newman+Docker+Jenkins/Pipeline ���ӿ��Զ�������', 'Docker����Postman/Newman', 'Docker -ɾ������(image)', '��Pytest��fixtureʹ��request����,���parametrize', '��Pytest��ʹ��Allure���Ա���', '����ϵͳDNS �ܽ�', 'Python - ���ڡ�ʱ�����������', 'Python -��־ģ��ʹ��', '��̬��������Э��DHCP', '2019���ܽ� - �ջ�ܶ�', 'MacBook �����ļ����ļ���·��', '��Appium��Android Toast����', '��Appium��ʹ��uiautomator��λԪ��', 'xpath�����ڡ���������д��']

>>>

����Scrapy��Ŀ

- ѡ��һ��Ŀ¼,������������:scrapy startproject xxxx,���һ����������Ŀ��,����

MAC-53796:PycharmProjects gcui$ scrapy startproject BlogSpider

New Scrapy project 'BlogSpider', using template directory '/usr/local/lib/python3.7/site-packages/scrapy/templates/project', created in:

/Users/gcui/PycharmProjects/BlogSpider

You can start your first spider with:

cd BlogSpider

scrapy genspider example example.com

MAC-53796:PycharmProjects gcui$

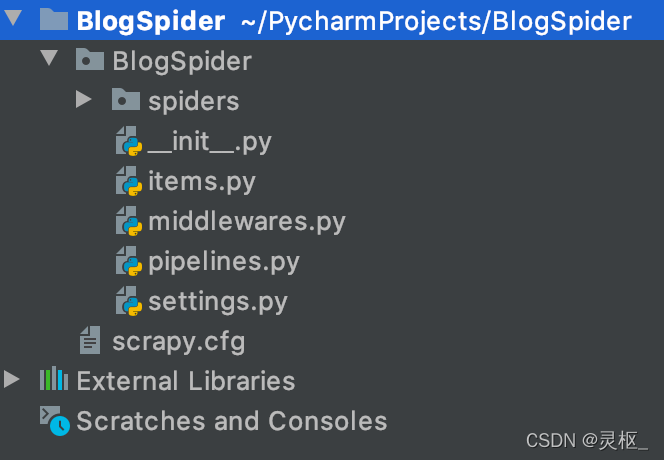

- ��PyCharm����Ŀ,���Կ�����Ŀ��Ŀ¼����:

scrapy.cfg: ��Ŀ���������ļ�,ͨ��������

BlogSpider/items.py: ���ڶ�����Ŀ�õ���Item��,Ҳ����һ�����ݴ������,��Ҫ�ɿ�����������

BlogSpider/pipelines.py: ��Ŀ�Ĺܵ��ļ�,��������ȡ������Ϣ,��Ҫ�ɿ���������д

BlogSpider/setting.py: ��Ŀ�������ļ�

BlogSpider/spiders: �ڸ�Ŀ¼�´����Ŀ�����֩��C����ץȡ��Ŀ����Ȥ����Ϣ��

Scrapy��������

- ����Item��,���屻��ȡ���������,������ͱ��⡢����ʱ�䡢�Ķ�����,��item.py�ж���,����:

import scrapy

class BlogspiderItem(scrapy.Item):

# ���ͱ���

title = scrapy.Field()

# ����ʱ��

publish_date = scrapy.Field()

# �Ķ���

read_count = scrapy.Field()

- ��дSpider��,����Spider���ļ�����spidersĿ¼��,Ȼ����XPath��CSS����ȡHTMLҳ���и���Ȥ����Ϣ��

Scrap�ṩ��scrapy genspider����,����ֱ������Spider�ࡣ�Ƚ��뵽BlogSpiderĿ¼��,Ȼ������:

MAC-53796:BlogSpider gcui$ scrapy genspider galen__blogs 'blog.csdn.net/'

Created spider 'galen__blogs' using template 'basic' in module:

BlogSpider.spiders.galen__blogs

MAC-53796:BlogSpider gcui$

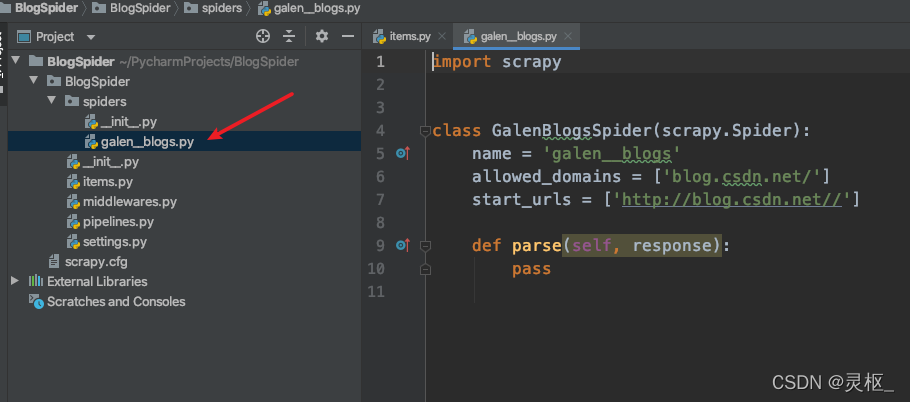

����������BlogSpider/spidersĿ¼��������galen_blogs.py, ����ͼ:

��дSpider��,��Ҫ�ǽ�Ҫ��ȡ�ĸ�ҳ��URL����start_url�б���,Ȼ����parse������ͨ��XPath��CSS��ȡ����Ȥ����Ϣ,����:

import scrapy

from BlogSpider.items import BlogspiderItem

class GalenBlogsSpider(scrapy.Spider):

# �����Spider������

name = 'galen__blogs'

# �����Spider������ȡ������

allowed_domains = ['blog.csdn.net/']

# �����Spider��ȡ����ҳ�б�

start_urls = ['https://blog.csdn.net/galen2016']

# �÷���������ȡresponse����������Ϣ

# response ������������start_urls�е�ÿ��URL���صõ�����Ӧ

def parse(self, response):

# ����ҳ���е����� //article[@class="blog-list-box"] �ڵ�

for article in response.xpath('//article[@class="blog-list-box"]'):

item = BlogspiderItem()

item['title'] = article.xpath('.//h4/text()').extract_first()

item['publish_date'] = article.xpath('.//div[@class="view-time-box"]/text()').extract_first()

item['read_count'] = article.xpath('.//span[@class="view-num"]/text()').extract_first()

yield item

���һ�д���ʹ��yield��佫item���ظ�Scrapy����,Ȼ��Scrapy���潫��Щitem�ռ�����������Ŀ��Pipeline��

3. ��дpipelines.py�ļ�,Ŀǰֻ�Ǽ��ڿ���̨��ӡitem����,û��ʹ�����ݿ⡣����:

class BlogspiderPipeline:

def process_item(self, item, spider):

print('���ͱ���:', item['title'])

print('����ʱ��:', item['publish_date'])

print('�Ķ���:', item['read_count'])

Scrapy������Զ���Spider���������item�������process_item(self, item, spider)����,��˸÷���ֻ�账��������item���ɡ�

4. ��settings.py�ļ�,��������ȡ��ע��

ITEM_PIPELINES = {

'BlogSpider.pipelines.BlogspiderPipeline': 300,

}

- ����Spider,�����н��뵽��Ŀ��Ŀ¼��,������������:

MAC-53796:BlogSpider gcui$ scrapy crawl galen__blogs

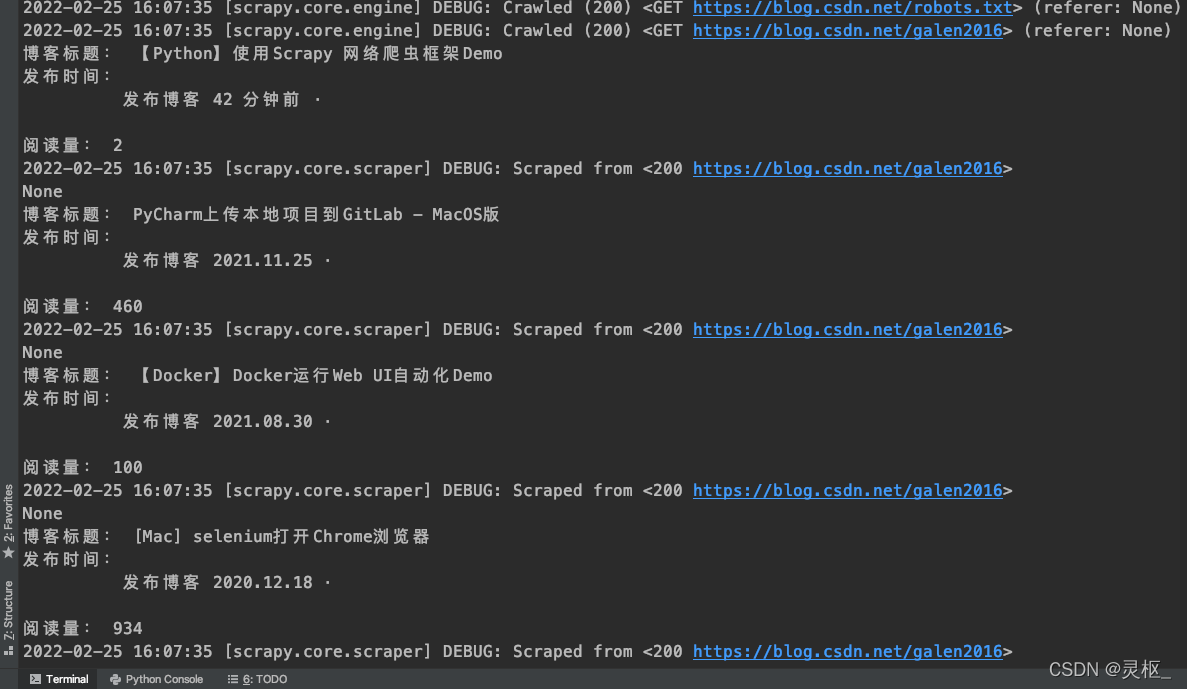

���һ������ galen_blogs����ǰ�涨���Spider���ơ�������������֮��,���Ի�ȡ���½��: