DataWhale――《深入浅出Pytorch》1

一、Pytorch的introduction

PyTorch是由Facebook人工智能研究小组开发的一种基于Lua编写的Torch库的Python实现的深度学习库,目前被广泛应用于学术界和工业界,而随着Caffe2项目并入Pytorch, Pytorch开始影响到TensorFlow在深度学习应用框架领域的地位。总的来说,PyTorch是当前难得的简洁优雅且高效快速的框架。因此本课程我们选择了PyTorch来进行开源学习。

二、Pytorch与Tensorflow的对比

- 更加简洁

- 上手快

- 良好的文档和社区支持

- 更好的调试代码

PyTorch是一个动态的框架,而TensorFlow是一个静态的框架。使用TensorFlow时,必须先搭建好网络的结构,然后使用预先留出的几个占位符作为样本输入和label输入,这就像是通过开了几个洞的木板进行交互,中途无法对计算的流程进行更改。

TensorFlow必须运行会话才能得到运行的结果,而且网络必须努力构造以确保每个张量具有正确的维度

三、Pytorch安装教程

- 1、检查自己的电脑是否具有可支持深度学习的显卡(NVIDIA)

- 2、查看自己的电脑是否完成了CUDA与CUDNN安装成功

以笔者的电脑为例子

从图中的系统信息可以看出其支持的CUDA的版本是11.1,因此需要前往英伟达官网,下载好对应的CUDAToolkit以及通过一些操作,能够登录到英伟达的官网,去下载关于CUDA的CUDNN的工具,在下载的时候,最好选择local而不要选择net的

最终安装成功的样子是这样的

- 3、安装pytorch

如果使用者的电脑没有GPU的话,可以在命令行下直接输入命令

pip install pytorch -i https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/main

如果使用者的电脑有GPU的话,可以通过pip的命令或者通过pytorch的wheel文件进行下载

这里有一点要注意的,比如说需要下载torchvision的时候,需要先下载后torchvision,并成功安装后,才能安装pytorch的gpu版本,不然的话会出现安装完pytorch的gpu版本,在安装torchvision的时候,就会出现自动覆盖掉pytorch的gpu版本的"sao操作"

这里笔者提供了几个比较有用的网站

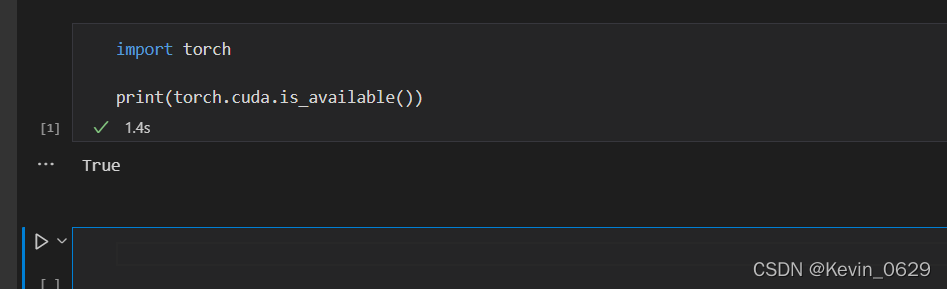

4、检查安装成功

这里以显示GPU版本的Pytorch作为介绍

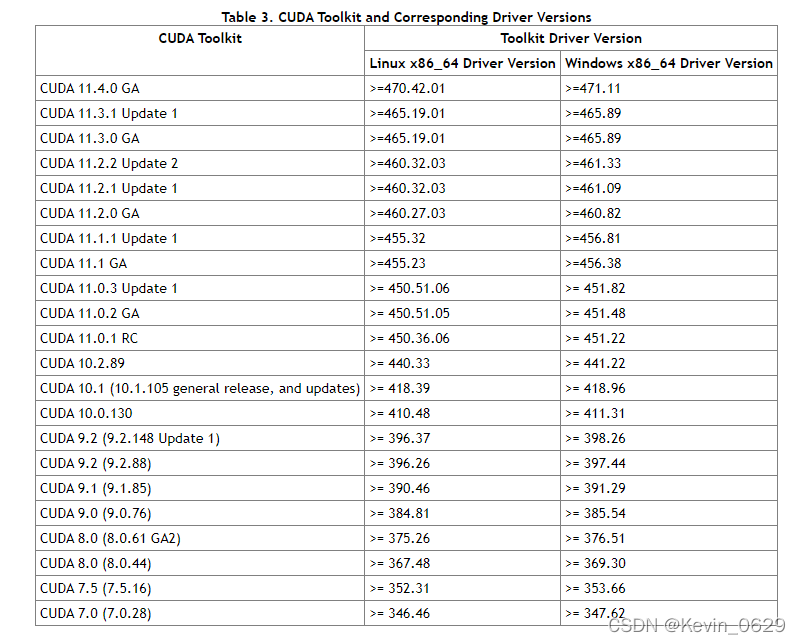

这里给出关于pytorch和cuda直接对应的适配表

四、Pytorch基础知识

x = torch.ones(2, 2, requires_grad=True)

首先通过内置的数据集或者外源数据集,若把数据集从内部产生,则无需要重写dataloader的函数,相反是自定义的数据集则需要重写部分的dataloader的函数,这里笔者通过一个时装Mnist识别分类

五、PyTorch模型定义的方式

- 模型构造类 (nn.Module)

各个部分的初始化(init);数据流向定义(forward)

- Sequential

class MySequential(nn.Module):

from collections import OrderedDict

def __init__(self, *args):

super(MySequential, self).__init__()

if len(args) == 1 and isinstance(args[0], OrderedDict): # 如果传入的是一个OrderedDict

for key, module in args[0].items():

self.add_module(key, module) # add_module方法会将module添加进self._modules(一个OrderedDict)

else: # 传入的是一些Module

for idx, module in enumerate(args):

self.add_module(str(idx), module)

def forward(self, input):

# self._modules返回一个 OrderedDict,保证会按照成员添加时的顺序遍历成

for module in self._modules.values():

input = module(input)

return input

import torch.nn as nn

net = nn.Sequential(

nn.Linear(784, 256),

nn.ReLU(),

nn.Linear(256, 10),

)

print(net)

- ModuleList

- ModuleDict

六、模型使用模块式定义

这里以U-net的开源仓库作为介绍

七、修改模型

八、模型保存

九、总结

因为笔者之前安装过挺多的关于深度学习的框架,再加上现在比较流行的包括google在内的tensorflow以及facebook的pytorch,再加上笔者在之前安装学习的时候,也遇到不少的问题,加上这次进行组队学习,对于笔者来说也是一次机会,可以让我对自己之前学过的东西进行总结