分别使用numpy和pytorch实现FNN例题

- 1. 过程推导 - 了解BP原理

- 2.数值计算 - 手动计算,掌握细节

- 3.代码实现 - numpy手推 + pytorch自动

- 3.1 对比【numpy】和【pytorch】程序,总结并陈述。

- 3.2 激活函数Sigmoid用PyTorch自带函数torch.sigmoid(),观察、总结并陈述。

- 3.3 激活函数Sigmoid改变为Relu,观察、总结并陈述。

- 3.4 损失函数MSE用PyTorch自带函数 t.nn.MSELoss()替代,观察、总结并陈述。

- 3.5 损失函数MSE改变为交叉熵,观察、总结并陈述。

- 3.6 改变步长,训练次数,观察、总结并陈述。

- 3.7 权值w1-w8初始值换为随机数,对比“指定权值”的结果,观察、总结并陈述。

- 3.8 权值w1-w8初始值换为0,观察、总结并陈述。

- 3.9 全面总结反向传播原理和编码实现,认真写心得体会。

1. 过程推导 - 了解BP原理

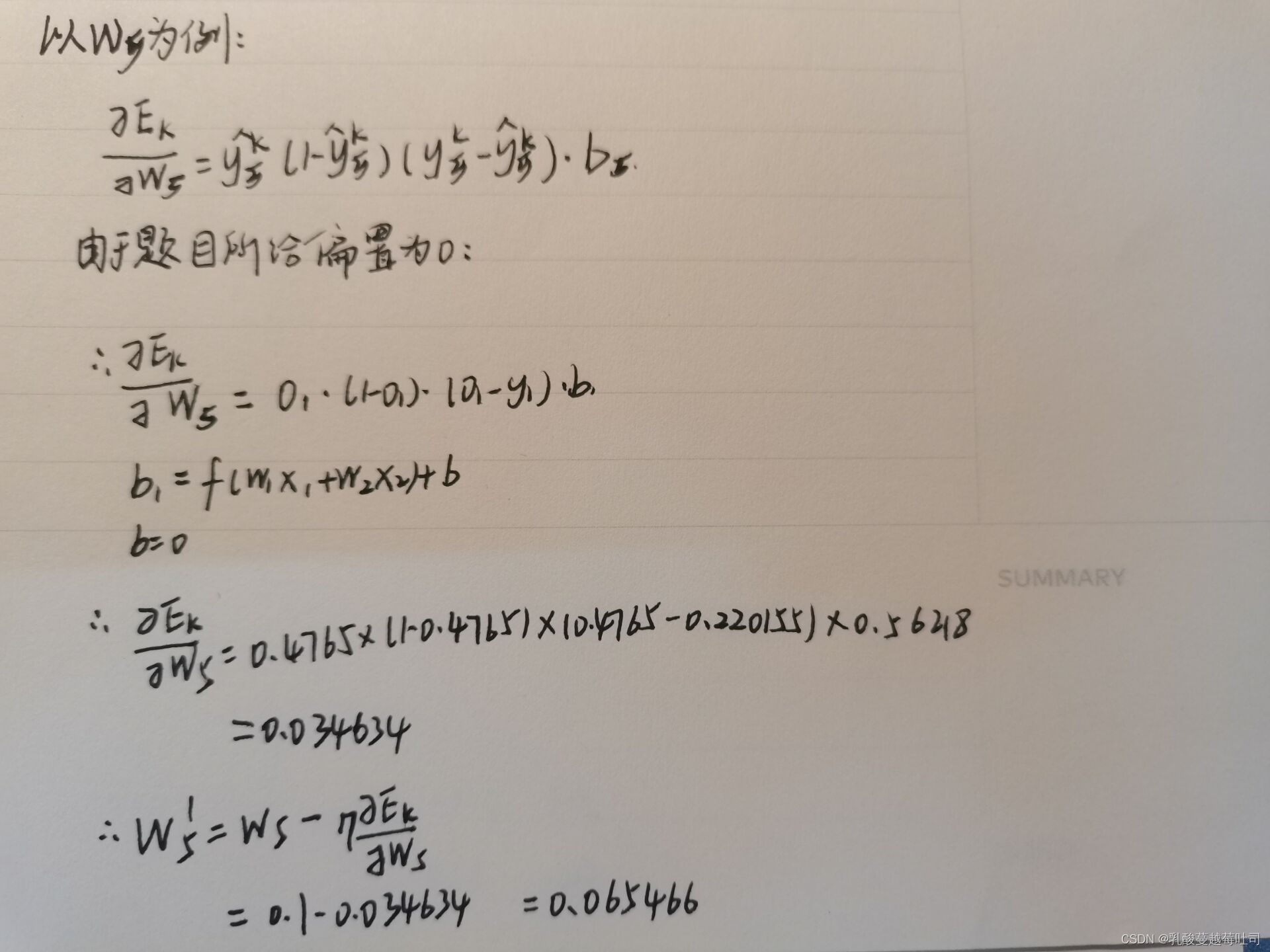

2.数值计算 - 手动计算,掌握细节

3.代码实现 - numpy手推 + pytorch自动

3.1 对比【numpy】和【pytorch】程序,总结并陈述。

numpy程序:

import numpy as np

w1, w2, w3, w4, w5, w6, w7, w8 = 0.2, -0.4, 0.5, 0.6, 0.1, -0.5, -0.3, 0.8

x1, x2 = 0.5, 0.3

y1, y2 = 0.23, -0.07

print("输入值 x0, x1:", x1, x2)

print("输出值 y0, y1:", y1, y2)

def sigmoid(z):

a = 1 / (1 + np.exp(-z))

return a

def forward_propagate(x1, x2, y1, y2, w1, w2, w3, w4, w5, w6, w7, w8):

in_h1 = w1 * x1 + w3 * x2

out_h1 = sigmoid(in_h1)

in_h2 = w2 * x1 + w4 * x2

out_h2 = sigmoid(in_h2)

in_o1 = w5 * out_h1 + w7 * out_h2

out_o1 = sigmoid(in_o1)

in_o2 = w6 * out_h1 + w8 * out_h2

out_o2 = sigmoid(in_o2)

print("正向计算,隐藏层h1 ,h2:", end="")

print(round(out_h1, 5), round(out_h2, 5))

print("正向计算,预测值o1 ,o2:", end="")

print(round(out_o1, 5), round(out_o2, 5))

error = (1 / 2) * (out_o1 - y1) ** 2 + (1 / 2) * (out_o2 - y2) ** 2

print("损失函数(均方误差):",round(error, 5))

return out_o1, out_o2, out_h1, out_h2

def back_propagate(out_o1, out_o2, out_h1, out_h2):

# 反向传播

d_o1 = out_o1 - y1

d_o2 = out_o2 - y2

d_w5 = d_o1 * out_o1 * (1 - out_o1) * out_h1

d_w7 = d_o1 * out_o1 * (1 - out_o1) * out_h2

d_w6 = d_o2 * out_o2 * (1 - out_o2) * out_h1

d_w8 = d_o2 * out_o2 * (1 - out_o2) * out_h2

d_w1 = (d_o1 * out_h1 * (1 - out_h1) * w5 + d_o2 * out_o2 * (1 - out_o2) * w6) * out_h1 * (1 - out_h1) * x1

d_w3 = (d_o1 * out_h1 * (1 - out_h1) * w5 + d_o2 * out_o2 * (1 - out_o2) * w6) * out_h1 * (1 - out_h1) * x2

d_w2 = (d_o1 * out_h1 * (1 - out_h1) * w7 + d_o2 * out_o2 * (1 - out_o2) * w8) * out_h2 * (1 - out_h2) * x1

d_w4 = (d_o1 * out_h1 * (1 - out_h1) * w7 + d_o2 * out_o2 * (1 - out_o2) * w8) * out_h2 * (1 - out_h2) * x2

print("w的梯度:",round(d_w1, 2), round(d_w2, 2), round(d_w3, 2), round(d_w4, 2), round(d_w5, 2), round(d_w6, 2),

round(d_w7, 2), round(d_w8, 2))

return d_w1, d_w2, d_w3, d_w4, d_w5, d_w6, d_w7, d_w8

def update_w(w1, w2, w3, w4, w5, w6, w7, w8):

# 步长

step = 1

w1 = w1 - step * d_w1

w2 = w2 - step * d_w2

w3 = w3 - step * d_w3

w4 = w4 - step * d_w4

w5 = w5 - step * d_w5

w6 = w6 - step * d_w6

w7 = w7 - step * d_w7

w8 = w8 - step * d_w8

return w1, w2, w3, w4, w5, w6, w7, w8

if __name__ == "__main__":

print("权值w0-w7:",round(w1, 2), round(w2, 2), round(w3, 2), round(w4, 2), round(w5, 2), round(w6, 2), round(w7, 2),

round(w8, 2))

for i in range(5):

print("=====第" + str(i+1) + "轮=====")

out_o1, out_o2, out_h1, out_h2 = forward_propagate(x1, x2, y1, y2, w1, w2, w3, w4, w5, w6, w7, w8)

d_w1, d_w2, d_w3, d_w4, d_w5, d_w6, d_w7, d_w8 = back_propagate(out_o1, out_o2, out_h1, out_h2)

w1, w2, w3, w4, w5, w6, w7, w8 = update_w(w1, w2, w3, w4, w5, w6, w7, w8)

print("更新后的权值w:",round(w1, 2), round(w2, 2), round(w3, 2), round(w4, 2), round(w5, 2), round(w6, 2), round(w7, 2),

round(w8, 2))

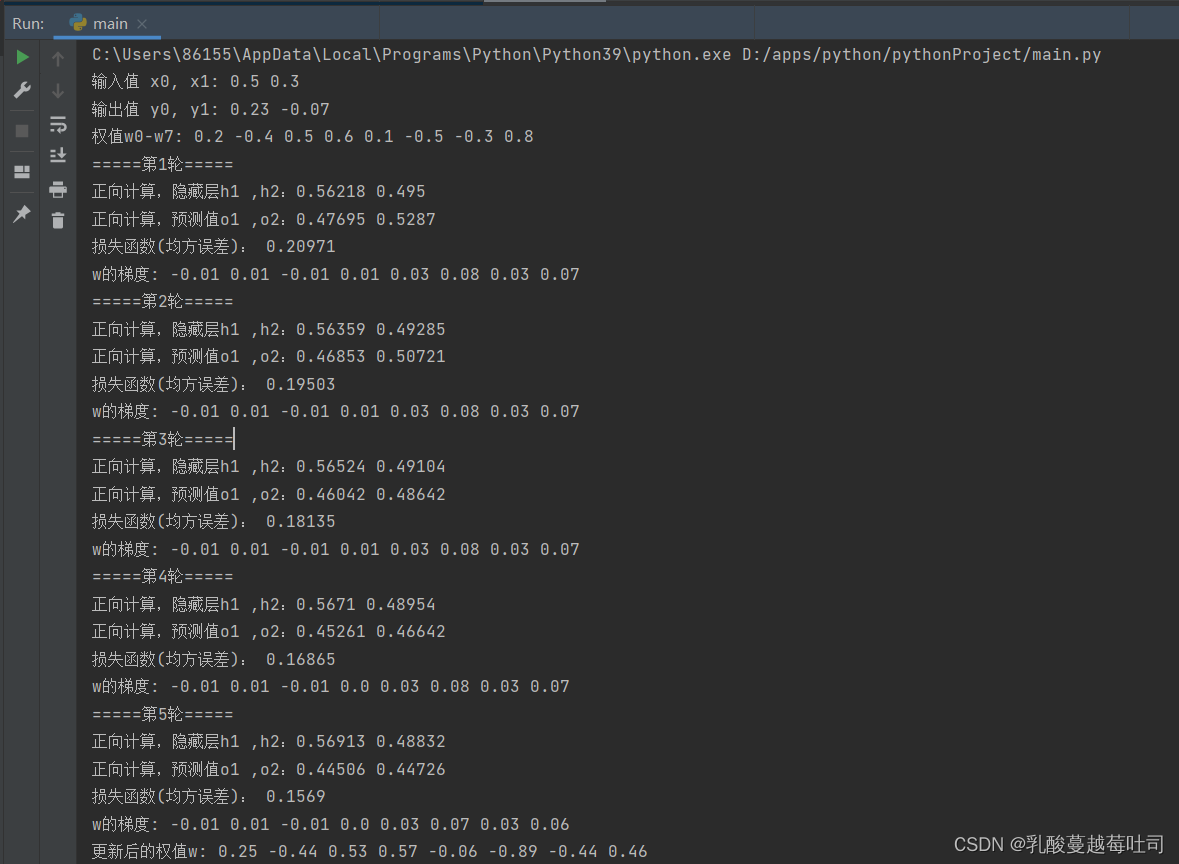

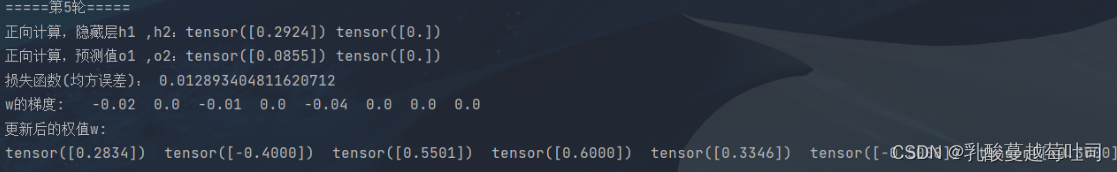

结果:

python程序:

import torch

x = [0.5, 0.3] # x0, x1 = 0.5, 0.3

y = [0.23, -0.07] # y0, y1 = 0.23, -0.07

print("输入值 x0, x1:", x[0], x[1])

print("输出值 y0, y1:", y[0], y[1])

w = [torch.Tensor([0.2]), torch.Tensor([-0.4]), torch.Tensor([0.5]), torch.Tensor(

[0.6]), torch.Tensor([0.1]), torch.Tensor([-0.5]), torch.Tensor([-0.3]), torch.Tensor([0.8])] # 权重初始值

for i in range(0, 8):

w[i].requires_grad = True

print("权值w0-w7:")

for i in range(0, 8):

print(w[i].data, end=" ")

def forward_propagate(x): # 计算图

in_h1 = w[0] * x[0] + w[2] * x[1]

out_h1 = torch.sigmoid(in_h1)

in_h2 = w[1] * x[0] + w[3] * x[1]

out_h2 = torch.sigmoid(in_h2)

in_o1 = w[4] * out_h1 + w[6] * out_h2

out_o1 = torch.sigmoid(in_o1)

in_o2 = w[5] * out_h1 + w[7] * out_h2

out_o2 = torch.sigmoid(in_o2)

print("正向计算,隐藏层h1 ,h2:", end="")

print(out_h1.data, out_h2.data)

print("正向计算,预测值o1 ,o2:", end="")

print(out_o1.data, out_o2.data)

return out_o1, out_o2

def loss(x, y): # 损失函数

y_pre = forward_propagate(x) # 前向传播

loss_mse = (1 / 2) * (y_pre[0] - y[0]) ** 2 + (1 / 2) * (y_pre[1] - y[1]) ** 2 # 考虑 : t.nn.MSELoss()

print("损失函数(均方误差):", loss_mse.item())

return loss_mse

if __name__ == "__main__":

for k in range(5):

print("\n=====第" + str(k+1) + "轮=====")

l = loss(x, y) # 前向传播,求 Loss,构建计算图

l.backward() # 反向传播,求出计算图中所有梯度存入w中. 自动求梯度,不需要人工编程实现。

print("w的梯度: ", end=" ")

for i in range(0, 8):

print(round(w[i].grad.item(), 2), end=" ") # 查看梯度

step = 1 # 步长

for i in range(0, 8):

w[i].data = w[i].data - step * w[i].grad.data # 更新权值

w[i].grad.data.zero_() # 注意:将w中所有梯度清零

print("\n更新后的权值w:")

for i in range(0, 8):

print(w[i].data, end=" ")

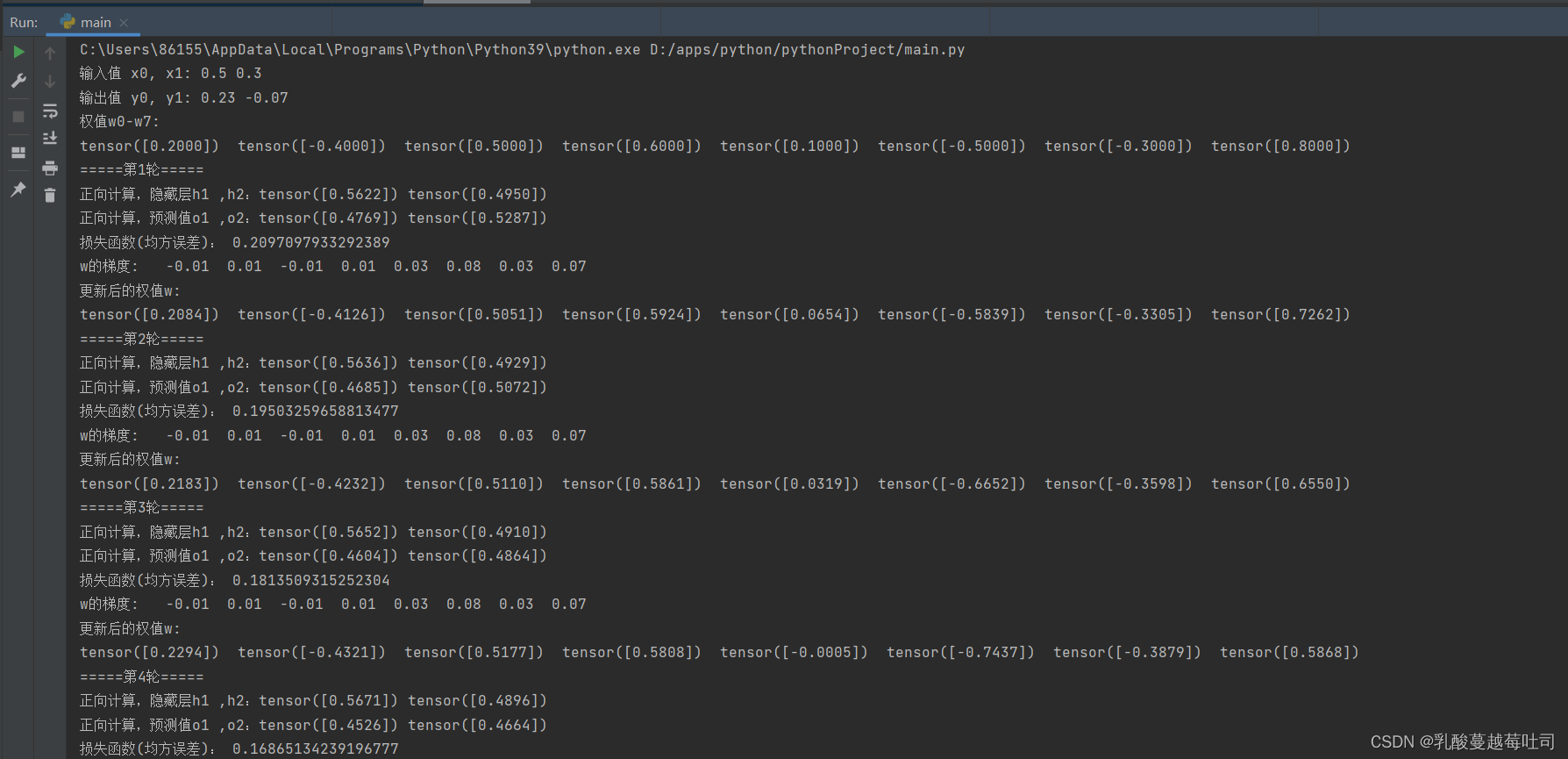

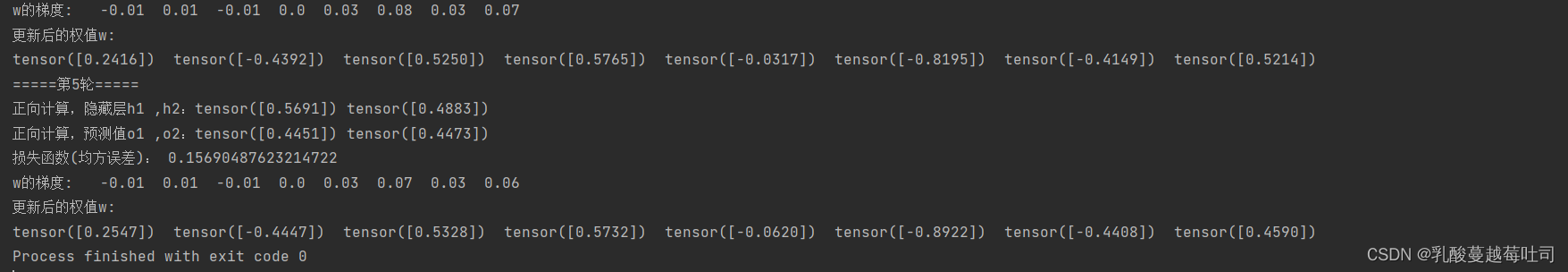

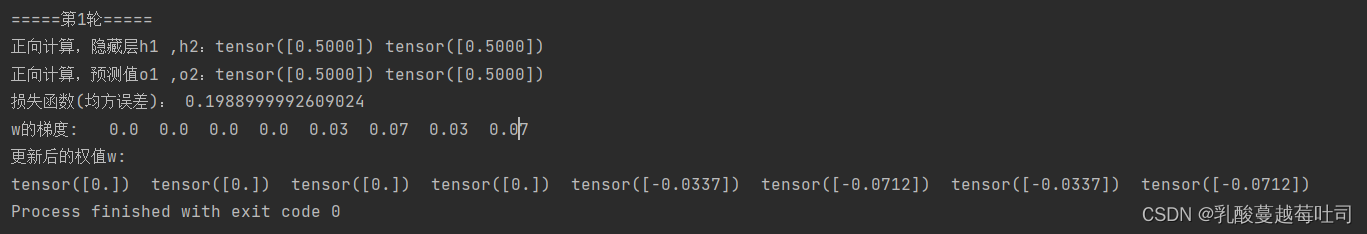

结果:

总结:在pytorch中有已经定义好的神经网络训练函数,torch库中可以调用backward()直接得到与函数相关的参数的梯度,进而进行梯度下降计算。不仅代码写的简单,也保证了正确性。

通过观察结果发现都十分相近,因此可认为两种方法的求解效果基本相同,可认为两种方法的求解效果基本相同。

3.2 激活函数Sigmoid用PyTorch自带函数torch.sigmoid(),观察、总结并陈述。

sigmoid函数表达式 f ( x ) = 1 1 + e ? x f(x)=\frac{1}{1+e^{-x}} f(x)=1+e?x1?

Sigmoid函数的导数是其本身的函数,即f′(x)=f(x)[1?f(x)],因此Sigmoid函数在反向传播的求导中起到了重要作用。

def forward_propagate(x1, x2):

in_h1 = w1 * x1 + w3 * x2

out_h1 = torch.sigmoid(in_h1)

in_h2 = w2 * x1 + w4 * x2

out_h2 = torch.sigmoid(in_h2)

in_o1 = w5 * out_h1 + w7 * out_h2

out_o1 = torch.sigmoid(in_o1)

in_o2 = w6 * out_h1 + w8 * out_h2

out_o2 = torch.sigmoid(in_o2)

print("正向计算:o1 ,o2")

print(out_o1.data, out_o2.data)

return out_o1, out_o2

没有较为明显的差距。

3.3 激活函数Sigmoid改变为Relu,观察、总结并陈述。

Relu函数的数学形式是:

f ( x ) = { x ? x > 0 0 ? x < = 0 f(x)=\begin{cases} x & \text{ } x>0 \\ 0 & \text{ } x<=0 \end{cases} f(x)={x0??x>0?x<=0?

Relu函数其实就是分段的线性函数,作用是把所有的负值都变为0,而正值保持不变。

def Relu(z):

if z<=0:

b = 0

return b

def forward_propagate(x1, x2):

in_h1 = w1 * x1 + w3 * x2

out_h1 = Relu(in_h1)

in_h2 = w2 * x1 + w4 * x2

out_h2 = Relu(in_h2)

in_o1 = w5 * out_h1 + w7 * out_h2

out_o1 = Relu(in_o1)

in_o2 = w6 * out_h1 + w8 * out_h2

out_o2 = Relu(in_o2)

print("正向计算:o1 ,o2")

print(out_o1.data, out_o2.data)

return out_o1, out_o2

Relu激活函数收敛速度要优于使用sigmoid激活函数。

3.4 损失函数MSE用PyTorch自带函数 t.nn.MSELoss()替代,观察、总结并陈述。

def loss_fuction(x1, x2, y1, y2): # 损失函数

y1_pred, y2_pred = forward_propagate(x1, x2) # 前向传播

# loss = (1 / 2) * (y1_pred - y1) ** 2 + (1 / 2) * (y2_pred - y2) ** 2 # 考虑 : t.nn.MSELoss()

loss_func = torch.nn.MSELoss() # 创建损失函数

y_pred = torch.cat((y1_pred, y2_pred), dim=0) # 将y1_pred, y2_pred合并成一个向量

y = torch.cat((y1, y2), dim=0) # 将y1, y2合并成一个向量

loss = loss_func(y_pred, y) # 计算损失

print("损失函数(均方误差):", loss.item())

return loss

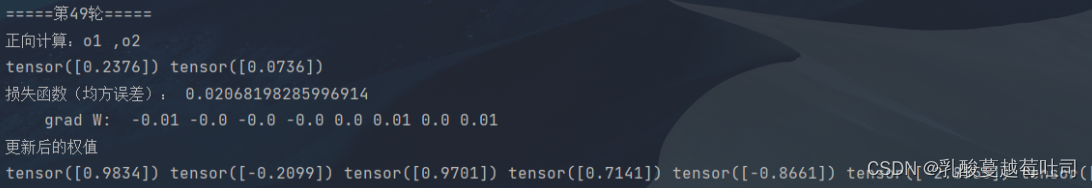

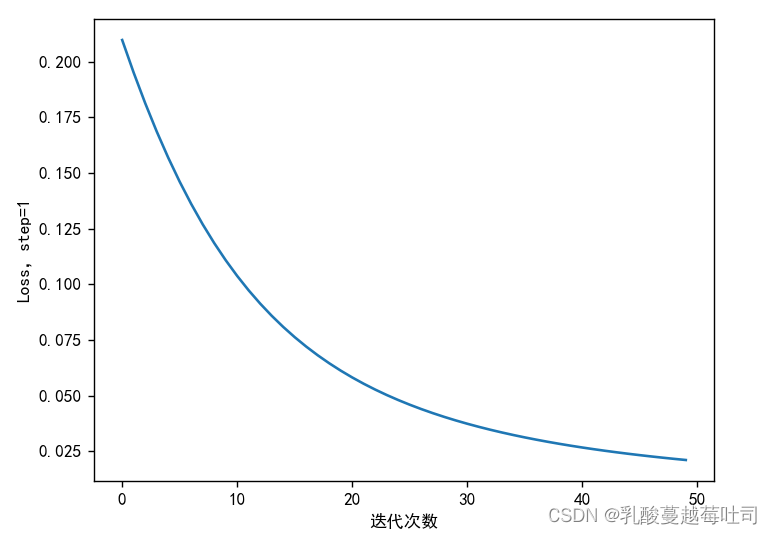

训练次数为50:

MSELoss是均方误差,是预测值与真实值之差的平方和的平均值。结果基本相同。

3.5 损失函数MSE改变为交叉熵,观察、总结并陈述。

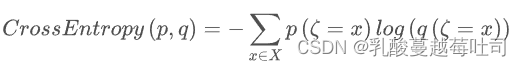

衡量两个分布之间的相似性。X代表样本集合,p(x)表示真实,q(x)表示预测:

信息熵在这里就是一个常量。由于KL散度的值表示真实概率分布与预测概率分布之间的差异,值越小表示预测的结果越好,所以需要最小化KL散度,而交叉熵等于KL散度加上一个常量(信息熵),且公式相比KL散度更加容易计算,所以在机器学习中常常使用交叉熵损失函数来计算loss。

def loss_fuction(x1, x2, y1, y2):

y1_pred, y2_pred = forward_propagate(x1, x2)

loss_func = torch.nn.CrossEntropyLoss() # 创建交叉熵损失函数

y_pred = torch.stack([y1_pred, y2_pred], dim=1)

y = torch.stack([y1, y2], dim=1)

loss = loss_func(y_pred, y) # 计算

print("损失函数(交叉熵损失):", loss.item())

return loss

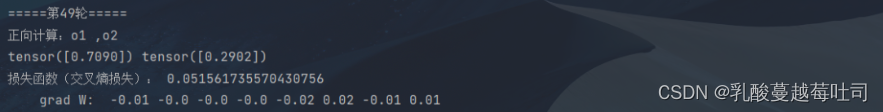

训练次数为49:

改为交叉熵之后损失函数出现负数。

3.6 改变步长,训练次数,观察、总结并陈述。

步长为1,训练次数为5:

步长为10,训次数为5:

训练次数一定的情况下,步长从1到10,均方误差下降越快,收敛越快。

步长为10,训练次数为20:

步长为10,训练次数为50:

步长一定的情况下,随着训练次数从10到50,均方误差下降速度也在逐渐降低,收敛速度也就下降了。

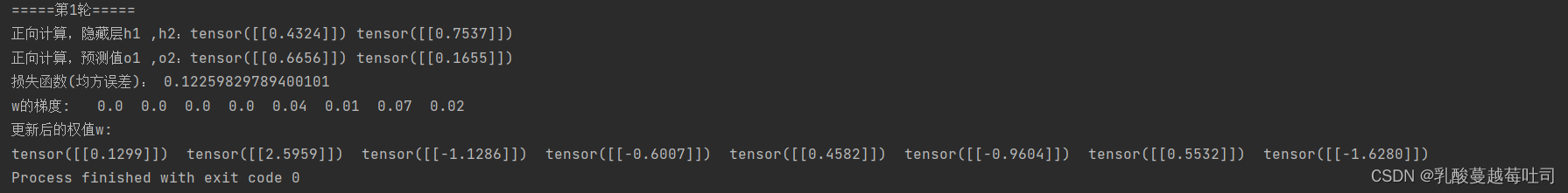

3.7 权值w1-w8初始值换为随机数,对比“指定权值”的结果,观察、总结并陈述。

初始化权重:

w = [torch.randn(1, 1), torch.randn(1, 1), torch.randn(1, 1), torch.randn(1, 1), torch.randn(1, 1), torch.randn(1, 1), torch.randn(1, 1), torch.randn(1, 1) ]

# 权重初始值

训练1轮:

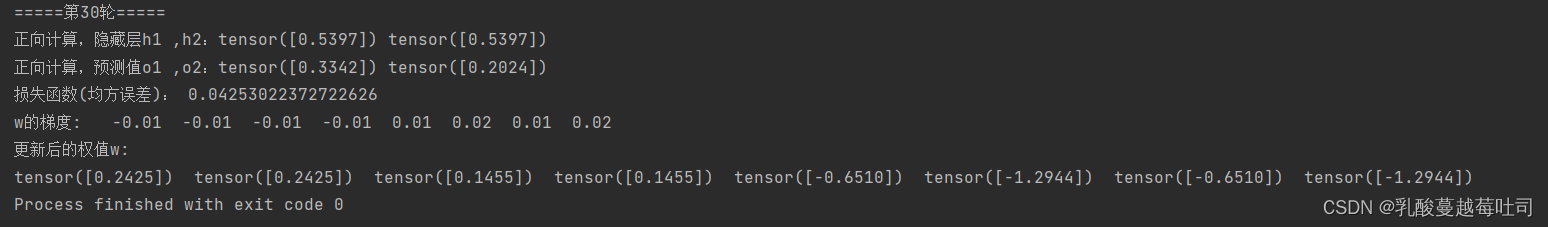

训练30轮:

训练50轮:

权重的初始化不会影响收敛的结果,均方误差的下降速度与指定权值时相比有所降低,收敛速度小于指定权值。

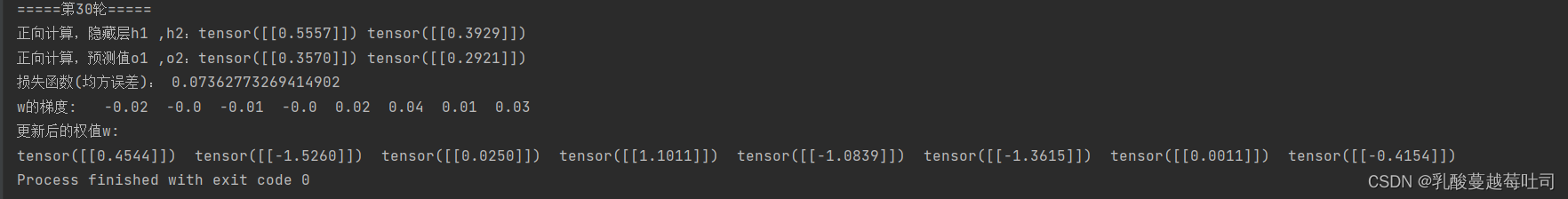

3.8 权值w1-w8初始值换为0,观察、总结并陈述。

训练1轮:

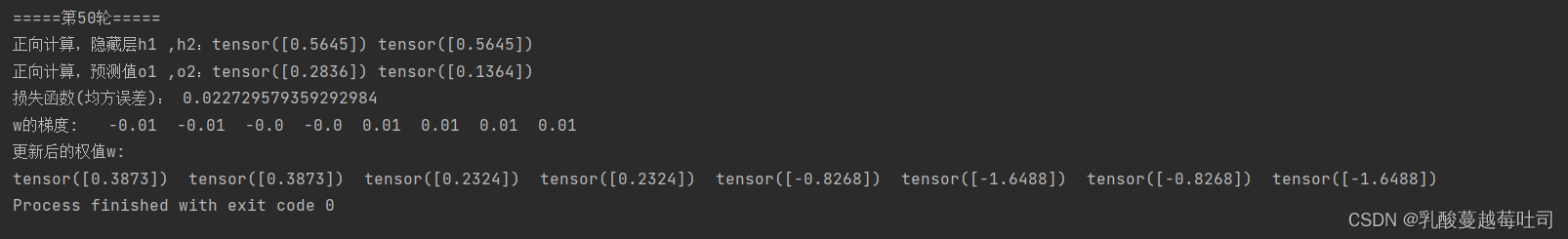

训练30轮:

训练50轮:

权重初始值只影响收敛速度,并不会影响收敛结果。

3.9 全面总结反向传播原理和编码实现,认真写心得体会。

首先再次拾起来了反向传播的计算流程,自己手推一遍真的想起来了以前的回忆!通过修改代码中激活函数、损失函数、步长、训练次数、权重的值,运行观察了一下对收敛速度、结果的影响。大部分就是影响了一下收敛的速度,但它们的结果都大致相同。