写在前面

是看b站一位up(我是土堆)的视频学的,感觉很ok(土堆超棒的好吗!)

这里是up的主页传送门orz

还有就是大部分都可以用说明文档查到;

以及,“//补代码”的部分都是课程中的代码,挺简单的就没有放上来,需要的话可以在原视频评论区找到(别忘了给原视频三连23333)

配置与安装Pytorch

之前装过了就不写在这了,anaconda真好用.jpg

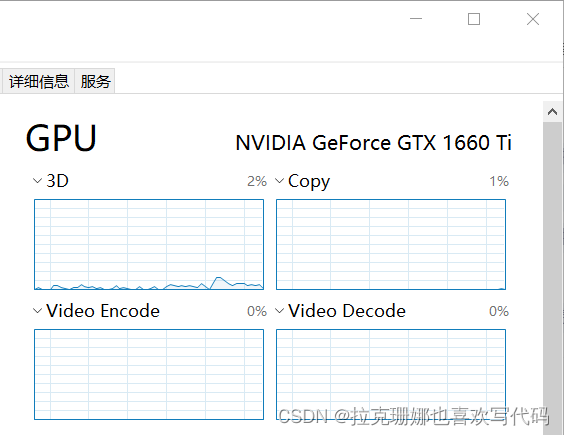

显卡:驱动 + CUDA工具包

检查驱动:任务管理器 -> 性能 -> GPU

能显示型号说明驱动是ok的

创建环境

和“把大象装进冰箱”一样需要三步:

①进入anaconda prompt

②conda create -n pytorch python=3.6

ps:这里的“pytorch”是我们取的环境名,“=3.6”是需要的版本号

③conda activate pytorch(进入环境)

进入环境后可以输入一些命令进行进一步查看:

pip list 看看我们有哪些包

torch.cuda.is_available() 返回true说明pytorch可以使用GPU

python学习中的两大法宝函数

dir() 能让我们知道工具箱以及工具箱中的分隔区有什么东西

help() 能让我们知道每个工具的使用方法

python文件、python控制台与Jupyter对比

如果说“代码是以块为一个整体运行”的话:

①python文件的块时所有行的代码

优:通用,传播方便,适用于大型项目

缺:需要从头运行

②python控制台以每一行为块运行

优:显示每个变量的属性

缺:不利于代码阅读和修改

③Jupyter以任意行为块运行

优:利于代码阅读及修改

缺:环境需要配置

加载数据

Dataset:为提供一种方式去获取数据及其label

①如何获取每一个数据及其label?

②总共有多少数据?

Dataloader:为后面的网络提供不同的数据形式

//补代码

Tensorboard的使用

tensorboard --logdir=logs --port=6007

logdir=事件文件所在文件夹名

port=指定端口号(避免和其他人的端口一样)

但有个小问题,改图像函数关系但没改图像名,会出现奇怪的事情

解决方案:

①杀掉进程重新开始(或者把事件文件夹删掉)

②官方建议:子文件夹,也就是创建新的SummaryWriter(“新文件夹”)

SummaryWriter

//补代码

add_image

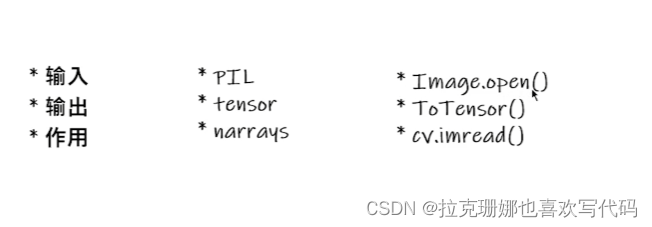

问题:参数类型和Image.open()读的PIL类型不同咋办?

解决方案:

①利用OpenCV读取图片,获得numpy型图片数据

②利用numpy.array(),对PIL图片进行转换(还要注意shape,如:CHW,etc)

即:从PIL到numpy,需要在add_image()中指定shape中每一个数字/维表示的含义

//补代码

常见Transforms

python中__call__的用法:

内置函数可以直接通过“对象(参数)”调用;

自己写的方法需要用“对象.方法(参数)”调用;

ToTensor的使用:

//补代码

Normalize的使用:

//补代码

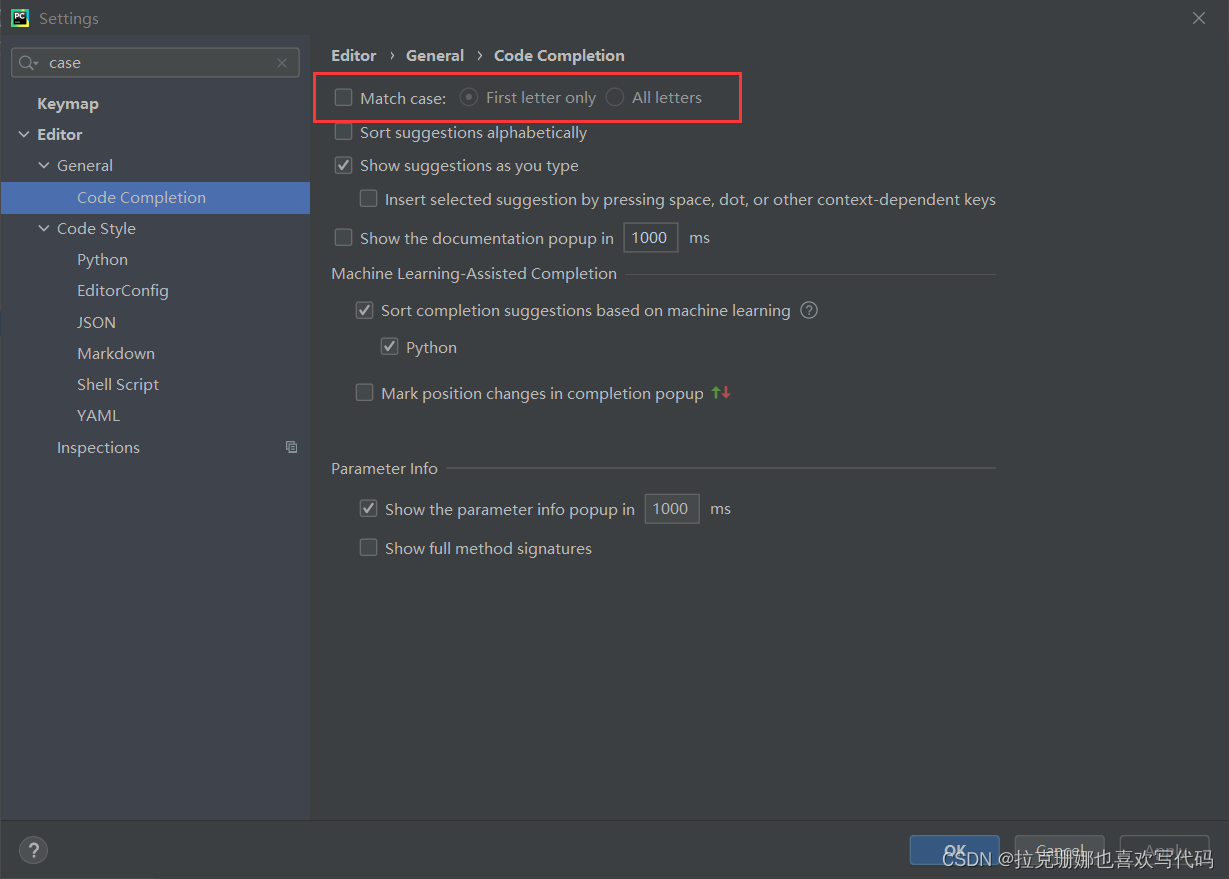

PyCharm使用小技巧设置:忽略大小写进行提示匹配

一般情况下,需要输入R,才能提示出Resize

我们想设置,即便输入的是r,也能提示出Resize

也就是忽略了大小写进行匹配提示

Resize()的使用:

//补代码

Compose()的使用:

Compose()中的参数需要是一个列表

python中,列表的表现形式为[数据1,数据2,…]

在Compose中,数据需要是transforms类型

所以得到,Compose([transform参数1,transform参数2, …])

注意:Compose后面参数的输入和前面参数的输出要同一类型,不然报错

//补代码

RandomCrop()的使用:

//补代码

总结:

①关注输入和输出类型

②多看官方文档

③关注方法需要什么参数

torchvision中的数据集使用

官网上有一个模块torchvision,里面有好多,可以用,还能帮咱下载

//补代码

DataLoader的使用

//补代码

神经网络的搭建

torch.nn超好用.jpg

//补代码

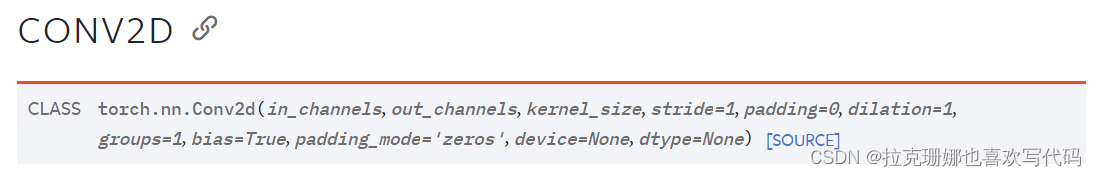

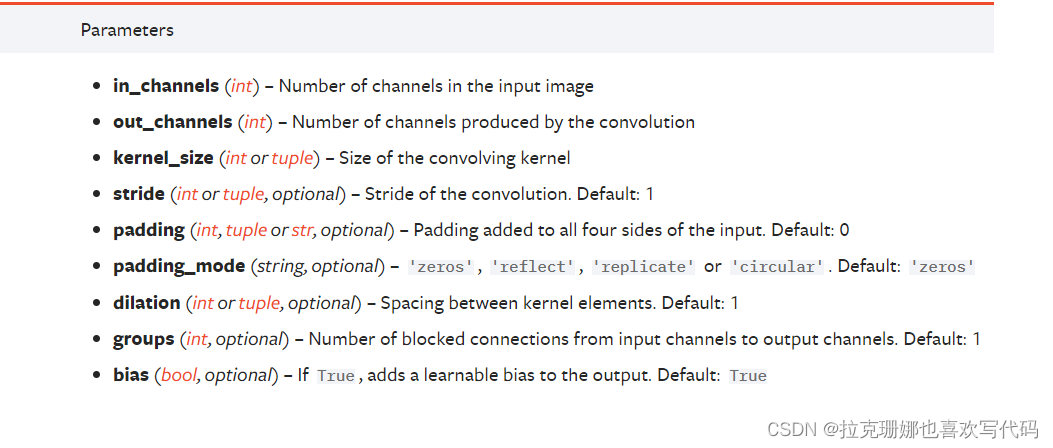

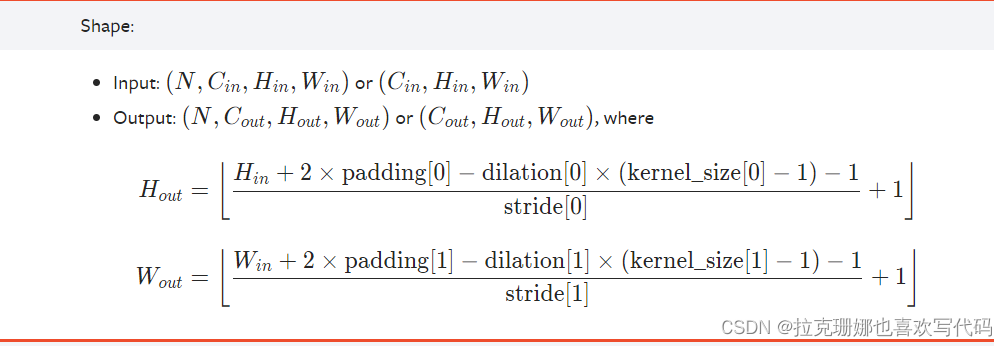

卷积层

常用这个:

参数:

看论文的时候可以根据这个公式对图像尺寸进行一个导的推:

//补代码

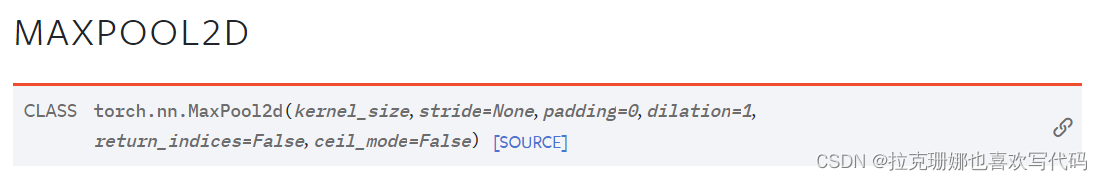

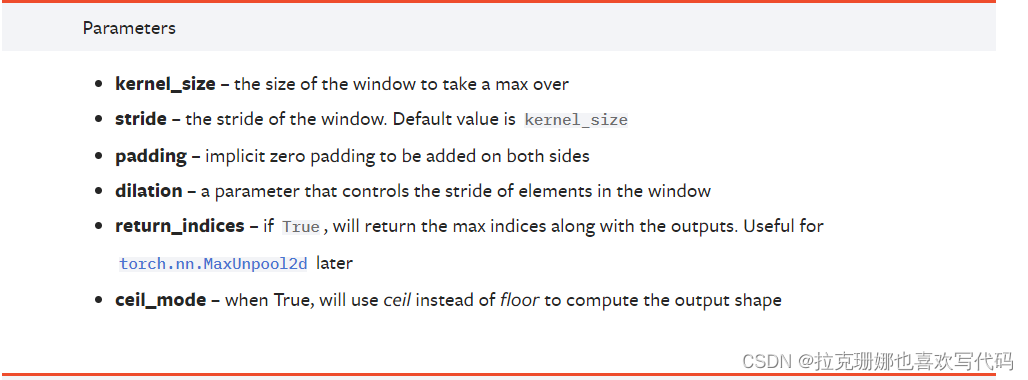

最大池化的作用

热知识:最大池化也被称为下采样,相反的(MaxUnpool)就是上采样.

常用这个:

参数:

ceil_mode == true,保留边缘不足情况时的池化结果;反之不保留。

//补代码

最大池化的作用:

保留输入图像特征,并使数据量减小

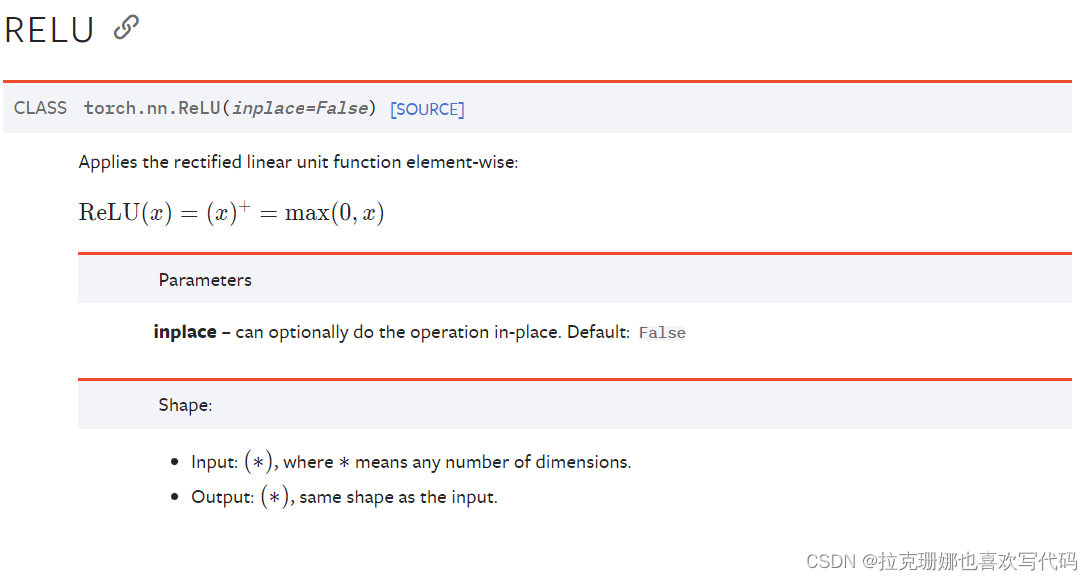

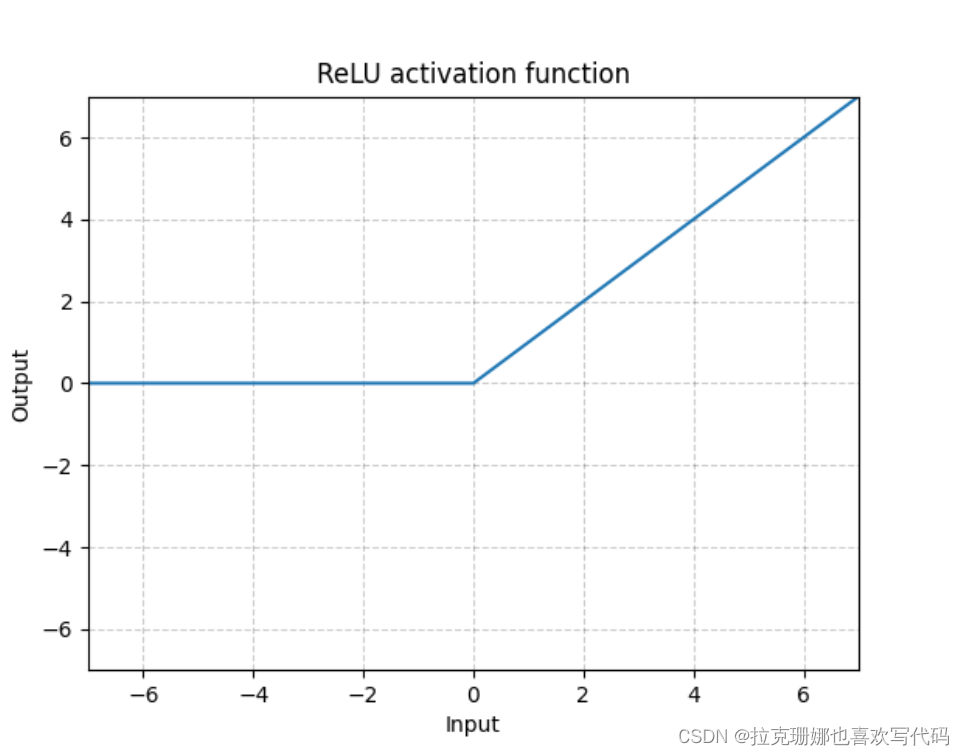

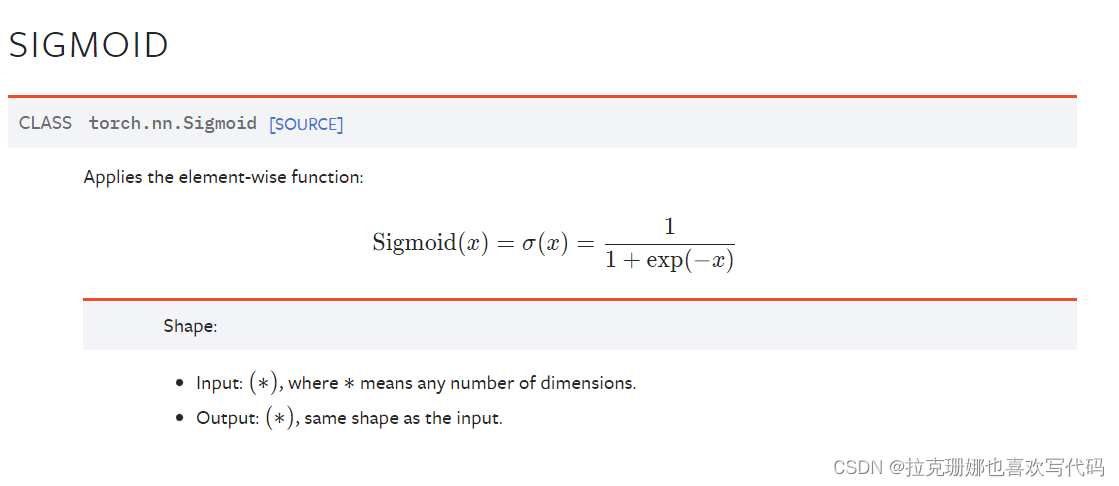

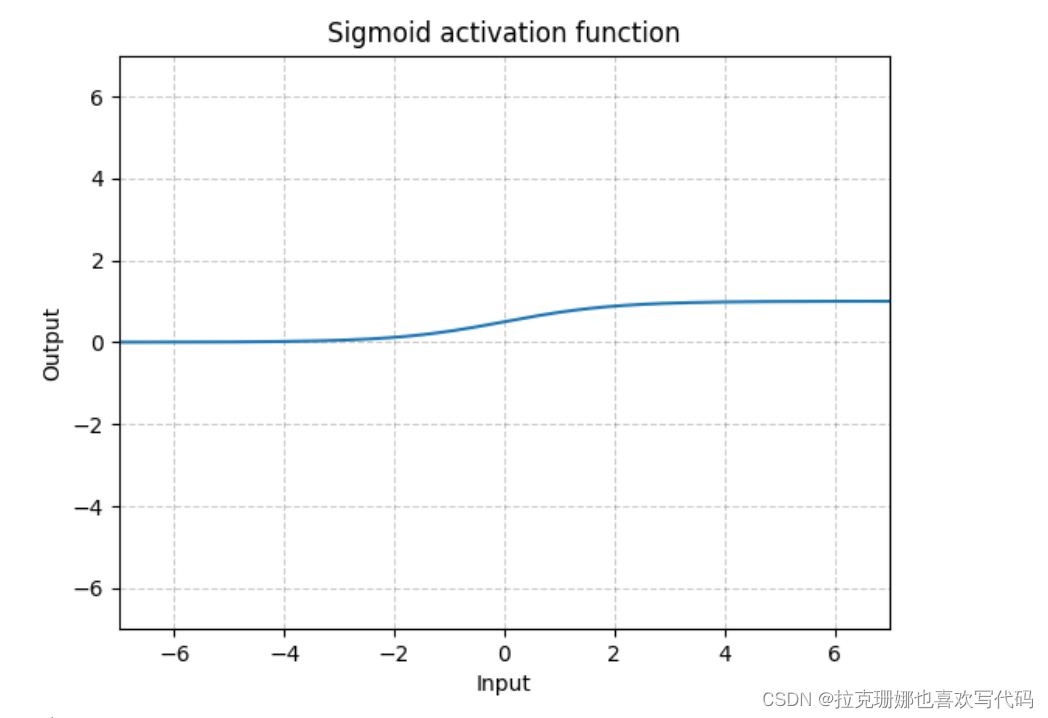

非线性激活

常用的激活函数:

ReLU的图像:

sigmoid图像:

inplace == true,覆盖输入;反之不覆盖

//补代码

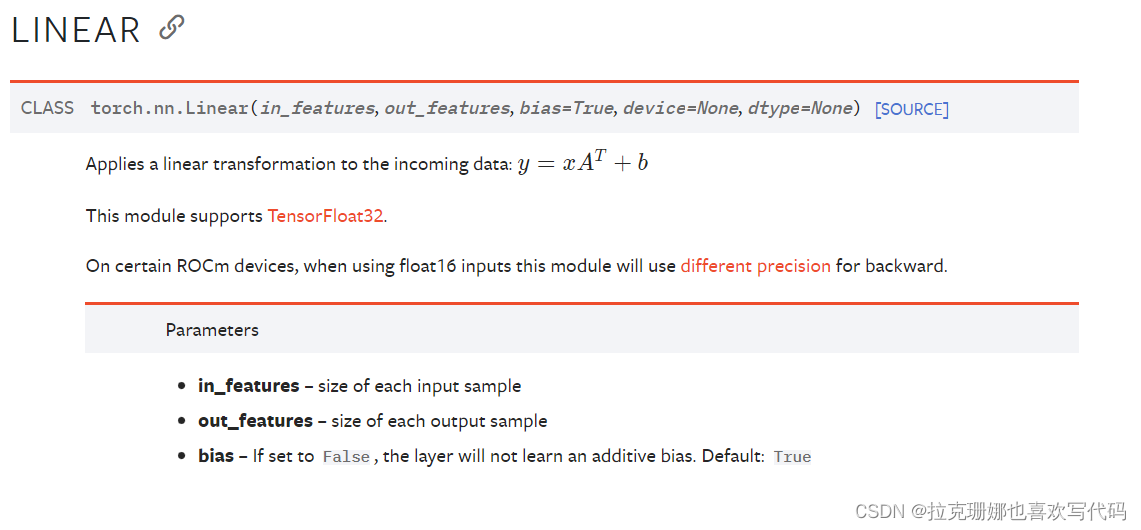

线性层及其它层介绍

正则化层:加速网络训练(看看就行也不咋用)

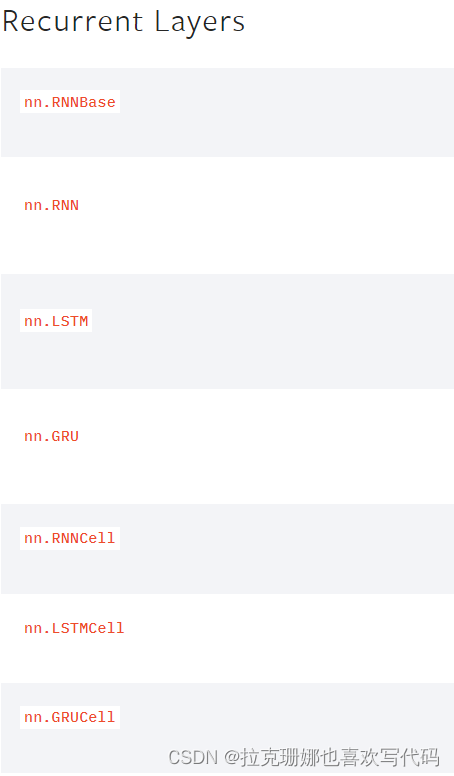

Recurrent Layers:用啥拿啥(特定使用)

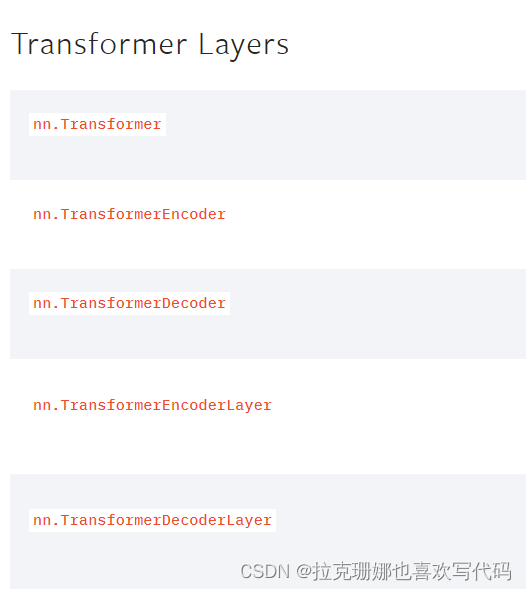

Transform Layers:也是用啥拿啥(特定使用)

Linear Layers:(常用)

//补代码

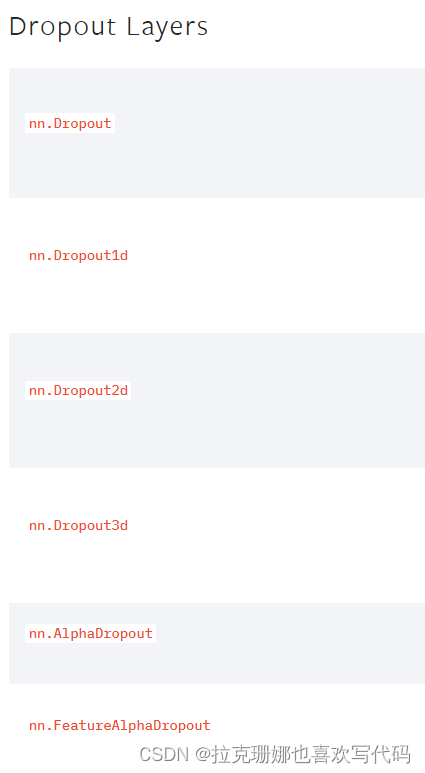

Dropout Layers:避免过拟合

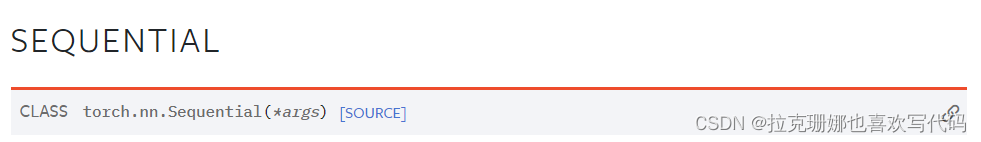

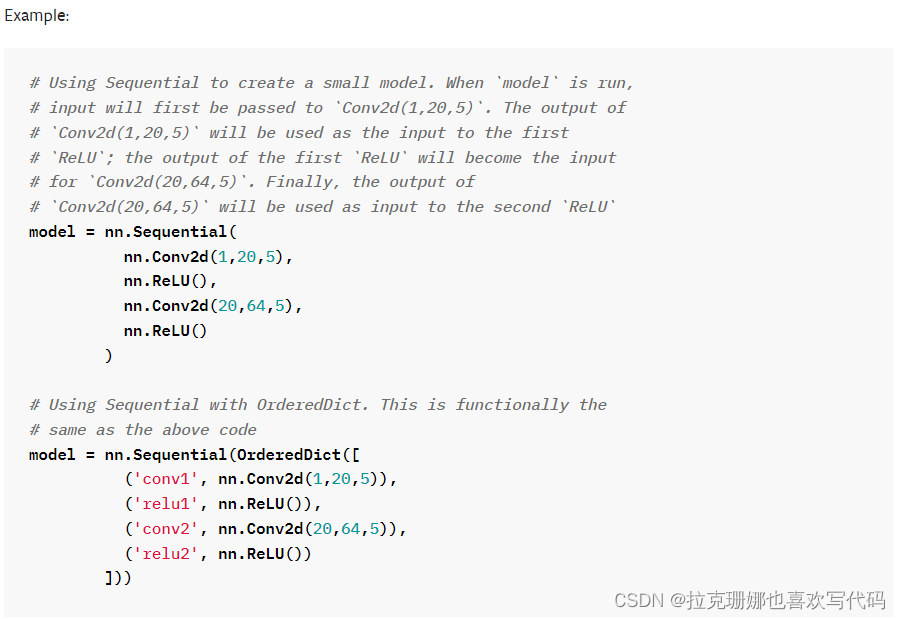

Sequential的使用

搭建小实战

//补代码

损失函数与反向传播

Loss Function:

①计算实际输出和目标之间的差距

②为我们更新输出提供一定的依据(反向传播)

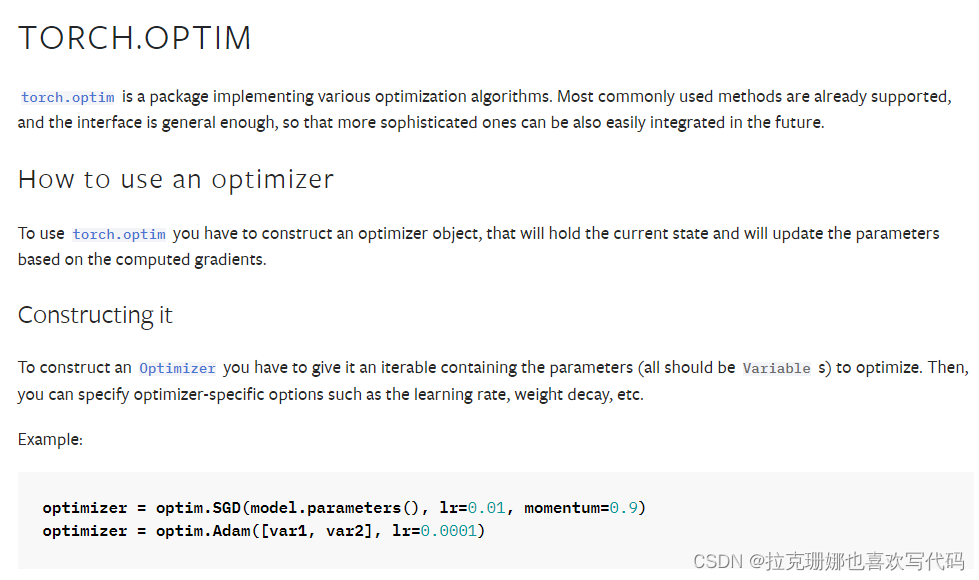

优化器

//补代码

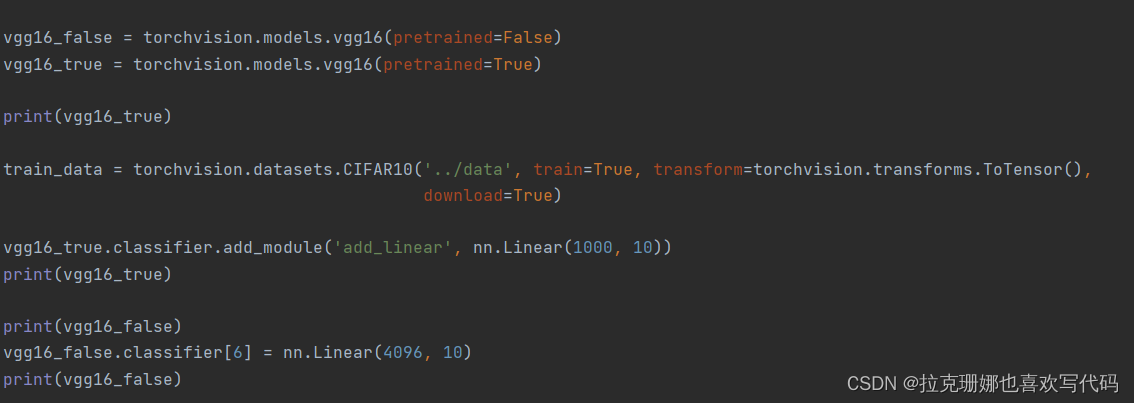

现有网络模型的使用及修改

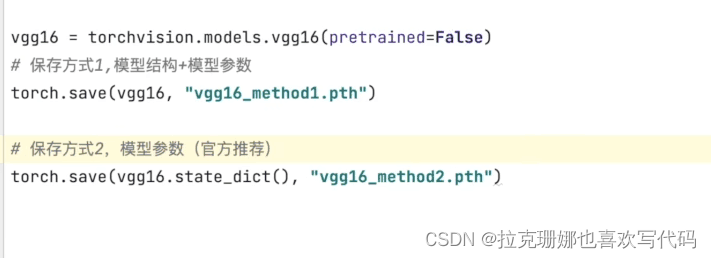

模型的保存与加载

使用GPU(两种方式)

直接粘贴了土堆的代码,看一下就懂了嘿

方法一:

# -*- coding: utf-8 -*-

# 作者:小土堆

# 公众号:土堆碎念

import torch

import torchvision

from torch.utils.tensorboard import SummaryWriter

# from model import *

# 准备数据集

from torch import nn

from torch.utils.data import DataLoader

train_data = torchvision.datasets.CIFAR10(root="../data", train=True, transform=torchvision.transforms.ToTensor(),

download=True)

test_data = torchvision.datasets.CIFAR10(root="../data", train=False, transform=torchvision.transforms.ToTensor(),

download=True)

# length 长度

train_data_size = len(train_data)

test_data_size = len(test_data)

# 如果train_data_size=10, 训练数据集的长度为:10

print("训练数据集的长度为:{}".format(train_data_size))

print("测试数据集的长度为:{}".format(test_data_size))

# 利用 DataLoader 来加载数据集

train_dataloader = DataLoader(train_data, batch_size=64)

test_dataloader = DataLoader(test_data, batch_size=64)

# 创建网络模型

class Tudui(nn.Module):

def __init__(self):

super(Tudui, self).__init__()

self.model = nn.Sequential(

nn.Conv2d(3, 32, 5, 1, 2),

nn.MaxPool2d(2),

nn.Conv2d(32, 32, 5, 1, 2),

nn.MaxPool2d(2),

nn.Conv2d(32, 64, 5, 1, 2),

nn.MaxPool2d(2),

nn.Flatten(),

nn.Linear(64*4*4, 64),

nn.Linear(64, 10)

)

def forward(self, x):

x = self.model(x)

return x

tudui = Tudui()

if torch.cuda.is_available():

tudui = tudui.cuda()

# 损失函数

loss_fn = nn.CrossEntropyLoss()

if torch.cuda.is_available():

loss_fn = loss_fn.cuda()

# 优化器

# learning_rate = 0.01

# 1e-2=1 x (10)^(-2) = 1 /100 = 0.01

learning_rate = 1e-2

optimizer = torch.optim.SGD(tudui.parameters(), lr=learning_rate)

# 设置训练网络的一些参数

# 记录训练的次数

total_train_step = 0

# 记录测试的次数

total_test_step = 0

# 训练的轮数

epoch = 10

# 添加tensorboard

writer = SummaryWriter("../logs_train")

for i in range(epoch):

print("-------第 {} 轮训练开始-------".format(i+1))

# 训练步骤开始

tudui.train()

for data in train_dataloader:

imgs, targets = data

if torch.cuda.is_available():

imgs = imgs.cuda()

targets = targets.cuda()

outputs = tudui(imgs)

loss = loss_fn(outputs, targets)

# 优化器优化模型

optimizer.zero_grad()

loss.backward()

optimizer.step()

total_train_step = total_train_step + 1

if total_train_step % 100 == 0:

print("训练次数:{}, Loss: {}".format(total_train_step, loss.item()))

writer.add_scalar("train_loss", loss.item(), total_train_step)

# 测试步骤开始

tudui.eval()

total_test_loss = 0

total_accuracy = 0

with torch.no_grad():

for data in test_dataloader:

imgs, targets = data

if torch.cuda.is_available():

imgs = imgs.cuda()

targets = targets.cuda()

outputs = tudui(imgs)

loss = loss_fn(outputs, targets)

total_test_loss = total_test_loss + loss.item()

accuracy = (outputs.argmax(1) == targets).sum()

total_accuracy = total_accuracy + accuracy

print("整体测试集上的Loss: {}".format(total_test_loss))

print("整体测试集上的正确率: {}".format(total_accuracy/test_data_size))

writer.add_scalar("test_loss", total_test_loss, total_test_step)

writer.add_scalar("test_accuracy", total_accuracy/test_data_size, total_test_step)

total_test_step = total_test_step + 1

torch.save(tudui, "tudui_{}.pth".format(i))

print("模型已保存")

writer.close()

方法二:

# -*- coding: utf-8 -*-

# 作者:小土堆

# 公众号:土堆碎念

import torch

import torchvision

from torch.utils.tensorboard import SummaryWriter

# from model import *

# 准备数据集

from torch import nn

from torch.utils.data import DataLoader

# 定义训练的设备

device = torch.device("cuda")

train_data = torchvision.datasets.CIFAR10(root="../data", train=True, transform=torchvision.transforms.ToTensor(),

download=True)

test_data = torchvision.datasets.CIFAR10(root="../data", train=False, transform=torchvision.transforms.ToTensor(),

download=True)

# length 长度

train_data_size = len(train_data)

test_data_size = len(test_data)

# 如果train_data_size=10, 训练数据集的长度为:10

print("训练数据集的长度为:{}".format(train_data_size))

print("测试数据集的长度为:{}".format(test_data_size))

# 利用 DataLoader 来加载数据集

train_dataloader = DataLoader(train_data, batch_size=64)

test_dataloader = DataLoader(test_data, batch_size=64)

# 创建网络模型

class Tudui(nn.Module):

def __init__(self):

super(Tudui, self).__init__()

self.model = nn.Sequential(

nn.Conv2d(3, 32, 5, 1, 2),

nn.MaxPool2d(2),

nn.Conv2d(32, 32, 5, 1, 2),

nn.MaxPool2d(2),

nn.Conv2d(32, 64, 5, 1, 2),

nn.MaxPool2d(2),

nn.Flatten(),

nn.Linear(64*4*4, 64),

nn.Linear(64, 10)

)

def forward(self, x):

x = self.model(x)

return x

tudui = Tudui()

tudui = tudui.to(device)

# 损失函数

loss_fn = nn.CrossEntropyLoss()

loss_fn = loss_fn.to(device)

# 优化器

# learning_rate = 0.01

# 1e-2=1 x (10)^(-2) = 1 /100 = 0.01

learning_rate = 1e-2

optimizer = torch.optim.SGD(tudui.parameters(), lr=learning_rate)

# 设置训练网络的一些参数

# 记录训练的次数

total_train_step = 0

# 记录测试的次数

total_test_step = 0

# 训练的轮数

epoch = 10

# 添加tensorboard

writer = SummaryWriter("../logs_train")

for i in range(epoch):

print("-------第 {} 轮训练开始-------".format(i+1))

# 训练步骤开始

tudui.train()

for data in train_dataloader:

imgs, targets = data

imgs = imgs.to(device)

targets = targets.to(device)

outputs = tudui(imgs)

loss = loss_fn(outputs, targets)

# 优化器优化模型

optimizer.zero_grad()

loss.backward()

optimizer.step()

total_train_step = total_train_step + 1

if total_train_step % 100 == 0:

print("训练次数:{}, Loss: {}".format(total_train_step, loss.item()))

writer.add_scalar("train_loss", loss.item(), total_train_step)

# 测试步骤开始

tudui.eval()

total_test_loss = 0

total_accuracy = 0

with torch.no_grad():

for data in test_dataloader:

imgs, targets = data

imgs = imgs.to(device)

targets = targets.to(device)

outputs = tudui(imgs)

loss = loss_fn(outputs, targets)

total_test_loss = total_test_loss + loss.item()

accuracy = (outputs.argmax(1) == targets).sum()

total_accuracy = total_accuracy + accuracy

print("整体测试集上的Loss: {}".format(total_test_loss))

print("整体测试集上的正确率: {}".format(total_accuracy/test_data_size))

writer.add_scalar("test_loss", total_test_loss, total_test_step)

writer.add_scalar("test_accuracy", total_accuracy/test_data_size, total_test_step)

total_test_step = total_test_step + 1

torch.save(tudui, "tudui_{}.pth".format(i))

print("模型已保存")

writer.close()