ЛњЦїбЇЯАжЎЪЕЯжЯпадЛиЙщ

1.НщЩмЪ§ОнМЏ

БОЮФжаЮвЪЙгУЕФЪЧЮїЙЯЪ§ОнМЏ3.0a

дкФУЕНЪ§ОнМЏКѓ,дЄДІРэЪЧ:

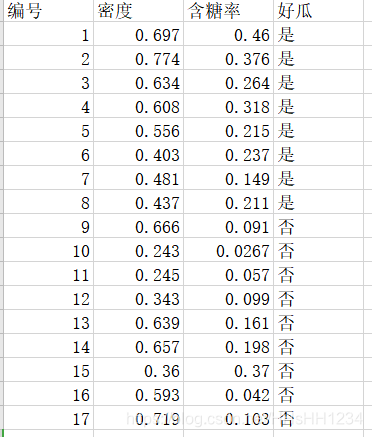

етИіЪ§ОнМЏЕФИёЪНЪЧgbkИёЪНЕФ,ЫљвдЯШЪжЖЏНЋИУЪ§ОнМЏИФЮЊutf-8,етбљдкКѓУцЕФДІРэжаВЛШнвзБЈДэЁЃЗЂЯждкЕкЫФСаКУЙЯетвЛСаШЋВПЪЧККзж,ККзжжЛЪЧЮвУЧЕФгябд,МЦЫуЛњПДВЛЖЎ,ЫљвдЮвУЧашвЊНЋЦфзЊЛЏЮЊМЦЫуЛњПДЕФЖЎЕФ,ЪЧБфЮЊ1,ЗёБфЮЊ0ЁЃ

1.ЖСШЁЪ§ОнМАЪ§ОндЄДІРэ

ЪзЯШНЋЪєадОиеѓКЭБъМЧОиеѓЗжПЊДцДЂ,ЭЌЪБдкЪєадОиеѓзюКѓдіМгвЛСаШЋЮЊ1ЕФЪ§,ВЂНЋЦфЗХШыlabelРяУцДцДЂЁЃ

#ЖСШыЮїЙЯЪ§ОнМЏВЂЧвдЄДІРэ

def loadDatatest(filename):

datatest = []

labletest = []

with open(filename,'r',encoding = 'utf-8')as csv_file:

csv_reader = csv.reader(csv_file)

header = next(csv_reader)

for row in csv_reader:

if row[3] == 'ЪЧ':

labletest.append(1)

elif row[3] =='Зё':

labletest.append(0)

row[3] = 1

datatest.append(row)

data=[[float(x) for x in row]for row in dataset]

return datatest,labletest

ЪзЯШЖЈвхdatatestКЭlabletestРДДцДЂЪ§Он,НЋlabletestжаЮЊЪЧЕФМг1,ЮЊЗёЕФМг0,жЎКѓНЋИУСаШЋВПЬцЛЛЮЊ1.

2.ЖдЪ§МИТЪКЏЪ§ЈCsigmoidКЏЪ§

#ЖдЪ§МИТЪКЏЪ§ sigmoid()

def sigmoid(z):

return 1.0 / (1+np.exp(-z))

дкетРяЮЊЪВУДЪЙгУsigmoidКЏЪ§ЖјВЛЪЧНздОКЏЪ§,двђЪЧНздОКЏЪ§ВЛСЌај,ВЛФмжБНгЪЙгУ,ЫљвдЯЃЭћеввЛИіНќЫЦЕЅЮЛНздОКЏЪ§ЕФЁАЬцДњКЏЪ§ЁБ,ВЂЯЃЭћЫћЕЅЕїПЩЮЂ,ЫљвдВЩгУСЫsigmoidКЏЪ§ЁЃ

3.ЕќДњЧѓwКЏЪ§ЁЊЁЊtrain

ЦфжаnЮЊВНГЄ,зюжеЮвУЧЕУЕНЕФwЪЧвЛИіЪ§зщ,УПвЛИідЊЫиБэЪОЕФЪЧИУЪєадЧАУцЕФЯЕЪ§w,ЮЊСЫПижЦЕќДњДЮЪ§,ЮвУЧНЋЁБзМШЗТЪИпгк90%ЁАзїЮЊжежЙЕФЬѕМў;

#training

def train(datatest,labletest):

data=np.mat(dataset).astype(float)#НЋЪ§ОнМЏжаЕФЪ§ОнЖСШЁГіРДаЮГЩОиеѓаЮЪН

label=np.mat(labelset).transpose()#ЭЌЩЯ

w = np.ones((len(dataset[0]),1))#np.ones()ДДНЈвЛИіmааnСаЕФЖрЮЌЪ§зщ

#ВНГЄ = 0.0001

n = 0.0001

# УПДЮЕќДњМЦЫувЛДЮе§ШЗТЪ(дкВтЪдМЏЩЯЕФе§ШЗТЪ)

# ДяЕН0.90ЕФе§ШЗТЪ,ЭЃжЙЕќДњ

rightrate = 0.0#е§ШЗТЪ

while rightrate<0.90 :

c=sigmoid(np.dot(data,w))

b=c-label

change = np.dot(np.transpose(data),b)

w=w-change*n

#дЄВт,ИќаТзМШЗТЪ

rightrate = test(dataset,labelset,w)

return w

4.МЦЫузМШЗТЪКЏЪ§ЁЊЁЊtest

ХаЖЯyЪЧЗёДѓгкЛђаЁгк0.5,ЕУЕНдЄВтжЕ;ВЂгыЪЕМЪБъМЧжЕЪЧЗёЯрЕШ,ШєЯрЕШдђХаЖЯе§ШЗЕФИіЪ§+1,зюжеЗЕЛизМШЗТЪЁЃ

#test

def test(dataset,labelset,w):

data=np.mat(dataset).astype(float)

y=sigmoid(np.dot(data,w))

b,c=np.shape(y)#ЙІФмЪЧВщПДОиеѓЛђепЪ§зщЕФЮЌЪ§ЁЃ

rightcount=0

for i in range(b):

flag=-1

if y[i,0]>0.5:

flag=1

elif y[i,0]<0.5:

flag=0

if labelset[i] == flag:

rightcount+=1

rightrate=rightcount/len(dataset)

return rightrate

5.жїКЏЪ§

dataset=[]

labelset=[]

filename =r'C:\Users\dahula\Desktop\watermelon_3a.csv'

dataset,labelset=loadDatatest(filename)

w=train(dataset,labelset)

print("ШєЪЙЕУзМШЗТЪДѓгк90%,дђДЫЪБЕФwЮЊ:\n",w)

print("е§ШЗТЪ:%f"%(test(dataset,labelset,w)*100)+"%")