yolo v1

yolo v1��ģ��ѵ�����̡�

- ����Ҫ����ǩ�ı任,��Ϊyolo v1���ɵ� embedding �� b a t c h ? s i z e �� S �� S �� 30 batch-size \times S \times S \times 30 batch?size��S��S��30��ά��,��������Ҫ��ÿ��ͼ��ı�ǩҲת������ͬ�� S �� S �� 30 S \times S \times 30 S��S��30��ά�ȡ���ǩת���ľ�����������:

def encoder(self, boxes, labels): //�����boxes��voc2007.txt�е�bounding box

"""

boxes (tensor) [[x1,y1,x2,y2],[]]

labels (tensor) [...]

return 14x14x30 //����� S = 14 B = 2

"""

grid_num = 14

target = torch.zeros((grid_num, grid_num, 30)) //ÿ��ͼƬ��Ҫ����voc2007.txt�еı�ǩ�����[S, S, 30]������

cell_size = 1./grid_num # ��һ����ÿ������Ĵ�С

wh = boxes[:, 2:] - boxes[:, :2] # ����ÿ��bounding box�Ŀ���

cxcy = (boxes[:, 2:] + boxes[:, :2]) / 2 # ����ÿ��bounding box�����ĵ�

for i in range(cxcy.size()[0]): # ���obj����[n, n]

cxcy_sample = cxcy[i] # �� i ��obj��bounding box �Ĺ�һ�����ĵ�

ij = (cxcy_sample/cell_size).ceil()-1 # �ҵ���obj��bounding box�����ĵ�����,Ҳ���ǿ��������Ǹ�����

target[int(ij[1]), int(ij[0]), 4] = 1 # ��target��box��Ϊ1

target[int(ij[1]), int(ij[0]), 9] = 1 # ��target��box��Ϊ1

target[int(ij[1]), int(ij[0]), int(labels[i])+9] = 1 # ��target��class��Ϊ1

xy = ij*cell_size # ƥ�䵽��������Ͻ��������

delta_xy = (cxcy_sample - xy)/cell_size

target[int(ij[1]), int(ij[0]), 2:4] = wh[i] # ÿ��bounding box�Ĺ�һ������

target[int(ij[1]), int(ij[0]), :2] = delta_xy # ������ĵ��ƫ����

target[int(ij[1]), int(ij[0]), 7:9] = wh[i]

target[int(ij[1]), int(ij[0]), 5:7] = delta_xy

return target

��ǩת���Ĺ��̾��ǽ�ͼƬ�����һ��[S,S,30]ά������,Ҳ���ǽ�

S

��

S

S \times S

S��S��patchÿ����encodeΪ30ά������,������patch �д���object,��patch��30ά�������ĵ� 5 ��, �� 10 ��λ��(�������Ŷ�,������ obj ��λ��)�� 1,���⽫ 20 ��������Ӧ���λ���� 1,ע��ǰ 4 ��λ���Ǿ���ת�����,(x, y, w, h --> x y ����������ĵ��ƫ����,w h�C>���� ÿ��bounding box�Ĺ�һ������),��Ϊ��obj�Ŀ���Ψһ��,���Ե�1-4 ���� 5-8��λ�õ�������ͬ��

2. yolo ��ѵ������:�Ƚ�����ͼƬ�ֳ�

S

��

S

S \times S

S��S ��patch,Ȼ��ÿ�� patch ����Ԥ������ bounding box,��� ͼƬ�ֳ���

14

��

14

14 \times 14

14��14��patch,��ô�ͽ���

14

��

14

��

2

14 \times 14 \times 2

14��14��2��bounding box,Ȼ��ͨ������ IoU��ѡ�����õ��Ǹ� bounding box��Ϊ���յ�bounding box��

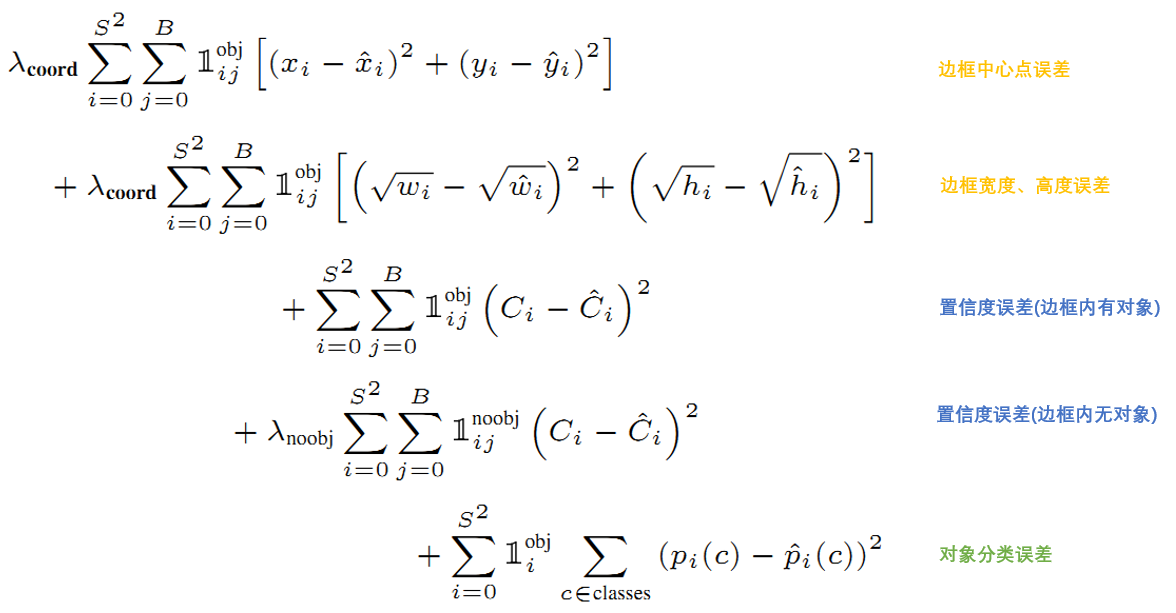

- ��ʧ�ļ���

yolo v1����ʧ���� 5 �����֡�

- IoU�ļ���

ע��:��ѵ��������û���õ� NMS

ģ�͵�Ԥ�����(ָԤ��ͼƬ)

������̺�ѵ�����̲�ͬ���Dz����� NMS ���������� Ԥ�ⴰ�ڡ�

NMS����ԭ��

yolo v1��ע���

1��ÿ������ֻԤ��һ�����(Ҳ��һ�����ı߽��),�������ֻȡ���Ŷ������Ǹ��߽����͵�����������ͬ����(����ͬ������IJ�ͬʵ��)����������ͬһ��������,�����©�졣

2��yolo������ĺܽ�������,���к�С��Ⱥ����Ч������,������Ϊһ��������ֻԤ����������,����ֻ����һ�ࡣ

3��λ�þ��Բ�,�ٻ��ʵ͡�������ʧ����������,��λ�����Ӱ����Ч������Ҫԭ�������Ǵ�С����Ĵ�����,���д���ǿ

4���Բ���ͼ����,ͬһ��������ֵ��µIJ������ij����Ⱥ��������ʱ����������ƫ��