����Ŀ¼

- 1.1 ������Ӿ�

- 1.2 ��Ե���ʾ��

- 1.3 ����ı�Ե�������

- 1.4 padding

- 1.5 �������� strided convolution

- 1.6 ������

- 1.7 ����������

- 1.8 ��������ʾ��

- 1.9 �ػ���

- 1.10 ����������ʾ��

- 1.11 Ϊʲôʹ�þ���?

- 2.1 ΪʲôҪ����ʵ���о�?

- 2.2 ��������

- 2.3 �����

- 2.4 �в�����Ϊʲô����?

- 2.5 �����е������Լ�1x1����

- 2.6 �ȸ�inception������

- 2.7 inception����

- 2.8 ʹ�ÿ�Դ��ʵ�ַ���

- 2.9 Ǩ��ѧϰ

- 2.10 ��������

- 2.11 ������Ӿ���״

- 3.1 Ŀ�궨λobject localization

- 3.2 ��������landmark detection

- 3.3 Ŀ����object detection

- 3.4 �����Ļ�������ʵ��

- 3.5 Bounding BoxԤ��

- 3.6 ������intersection over union(IOU)

- 3.7 �Ǽ���ֵ����Non-max suppression

- 3.8 Ancher Boxes

- 3.9 YOLO�㷨

- 3.10 ��ѡ����region proposal

- 4.1 ʲô������ʶ��?

- 4.2 One-Shotѧϰ

- 4.3 Siamese����

- 4.4 Triplet��ʧ(��Ԫ��)

- 4.5 �沿��֤�Ͷ�����

- 4.6 ʲô�����ת��?

- 4.7 ʲô����Ⱦ�������?

- 4.8 ���ۺ���_bilibili

- 4.9 ���ݴ��ۺ���

- 4.10 �����ۺ���

- 4.11 һά����ά�ƹ�

1.1 ������Ӿ�

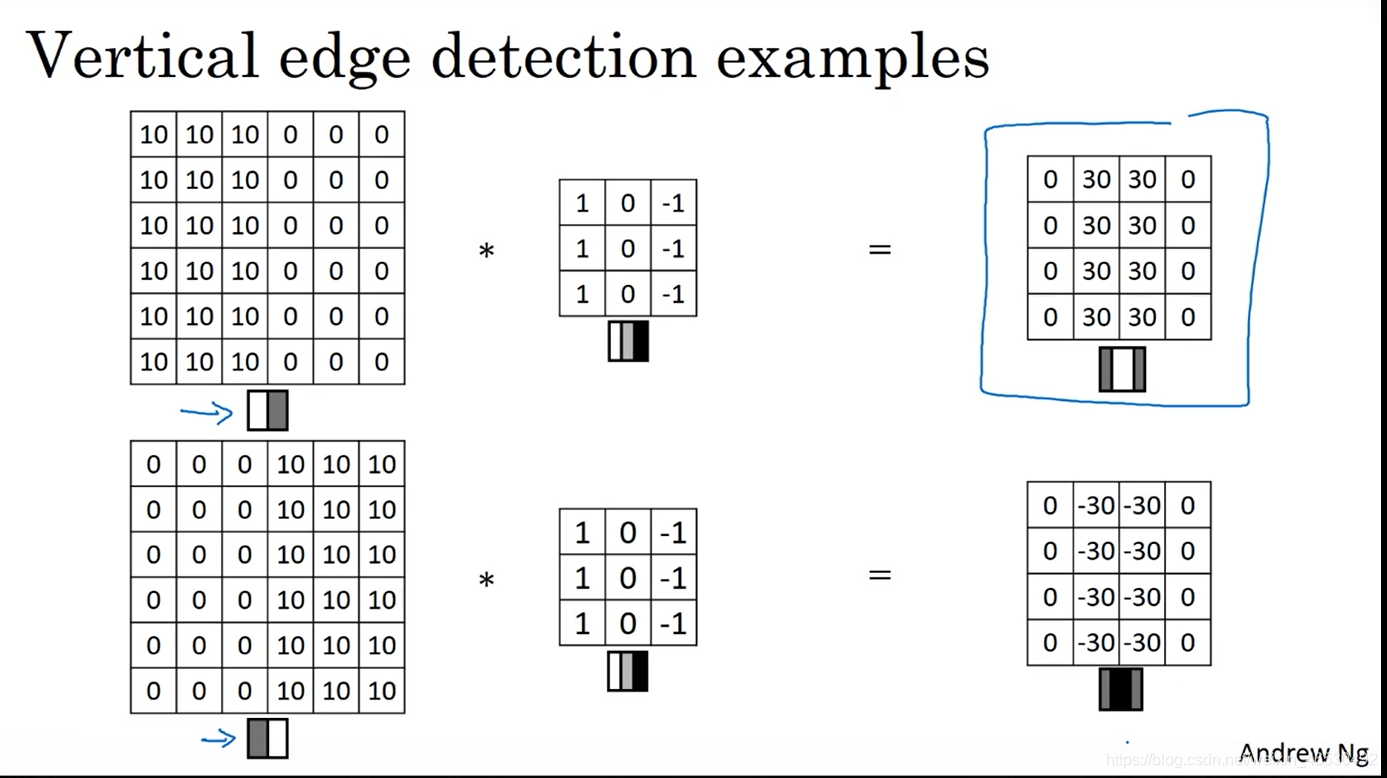

1.2 ��Ե���ʾ��

�����ij˷�(��ӦԪ�����,��ͬ�ھ���˷�)fliter������

[

3

0

1

2

7

4

1

5

8

9

3

1

2

7

2

5

1

3

0

1

3

1

7

8

4

2

1

6

2

8

2

4

5

2

3

9

]

?

[

1

0

?

1

1

0

?

1

1

0

?

1

]

=

[

?

5

?

4

0

8

?

10

?

2

2

3

0

01

?

4

?

7

?

3

?

2

?

3

?

16

]

\left[\begin{array}{cc}3&0&1&2&7&4\\1&5&8&9&3&1\\2&7&2&5&1&3\\0&1&3&1&7&8\\4&2&1&6&2&8\\2&4&5&2&3&9\end{array}\right]*\left[\begin{array}{cc}1&0&-1\\1&0&-1\\1&0&-1\end{array}\right] =\left[\begin{array}{cc}-5&-4&0&8\\-10&-2&2&3\\0&01&-4&-7\\-3&-2&-3&-16\end{array}\right]

?????????312042?057124?182315?295162?731723?413889??????????????111?000??1?1?1????=??????5?100?3??4?201?2?02?4?3?83?7?16??????

1.3 ����ı�Ե�������

[

1

0

?

1

1

0

?

1

1

0

?

1

]

[

1

1

1

0

0

0

?

1

?

1

?

1

]

v

e

r

t

i

c

a

l

h

o

r

i

z

o

n

t

a

l

[

1

0

?

1

2

0

?

2

1

0

?

1

]

[

3

0

?

3

10

0

?

10

3

0

?

3

]

s

o

b

e

r

f

i

l

t

e

r

s

c

h

a

r

r

f

i

l

t

e

r

\left[\begin{array}{cc}1&0&-1\\1&0&-1\\1&0&-1\end{array}\right]\quad \left[\begin{array}{cc}1&1&1\\0&0&0\\-1&-1&-1\end{array}\right] \\ vertical \quad \quad \quad horizontal\\ \left[\begin{array}{cc}1&0&-1\\2&0&-2\\1&0&-1\end{array}\right] \quad \quad \left[\begin{array}{cc}3&0&-3\\10&0&-10\\3&0&-3\end{array}\right] \\ sober \quad filter \quad \quad scharr\quad filter

???111?000??1?1?1???????10?1?10?1?10?1????verticalhorizontal???121?000??1?2?1???????3103?000??3?10?3????soberfilterscharrfilter

���н�filter���������óɲ���,ͨ����������ѧϰ��

1.4 padding

֮ǰ�ľ��������ή��ͼƬ��ά��,���ܻ�ʹͼƬά��Խ��Խ��,ͬʱ��Ե������ֻ������������һ�Ρ�

ϰ������0�����,ά�ȱ��(n+2p-f+1)*(n+2p-f+1)

valid convolutions:no padding

same convolutions: padding so that output size is the same as the input size.

(

n

+

2

p

?

f

+

1

)

��

(

n

+

2

p

?

f

+

1

)

i

f

n

+

2

p

?

f

+

1

=

n

p

=

f

?

1

2

(n+2p-f+1)\times(n+2p-f+1)\\ if \quad n+2p-f+1 = n\\ p = \frac{f-1}{2}

(n+2p?f+1)��(n+2p?f+1)ifn+2p?f+1=np=2f?1?

����fһ��Ϊ����,��ʱ�����ܱ�֤p������,��������ľ�����(kernel)������,����ָ����������λ�á�

1.5 �������� strided convolution

n �� n i m a g e f �� f f i l t e r p a d d i n g p s t r i d e s �� n + 2 p ? f s + 1 �� �� �� n + 2 p ? f s + 1 �� n\times n\quad image \quad \quad f\times f \quad filter\\ padding\quad p \quad \quad \quad stride\quad s\\ \llcorner\frac{n+2p-f}{s}+1\lrcorner \times \llcorner\frac{n+2p-f}{s}+1\lrcorner n��nimagef��ffilterpaddingpstrides��sn+2p?f?+1������sn+2p?f?+1��

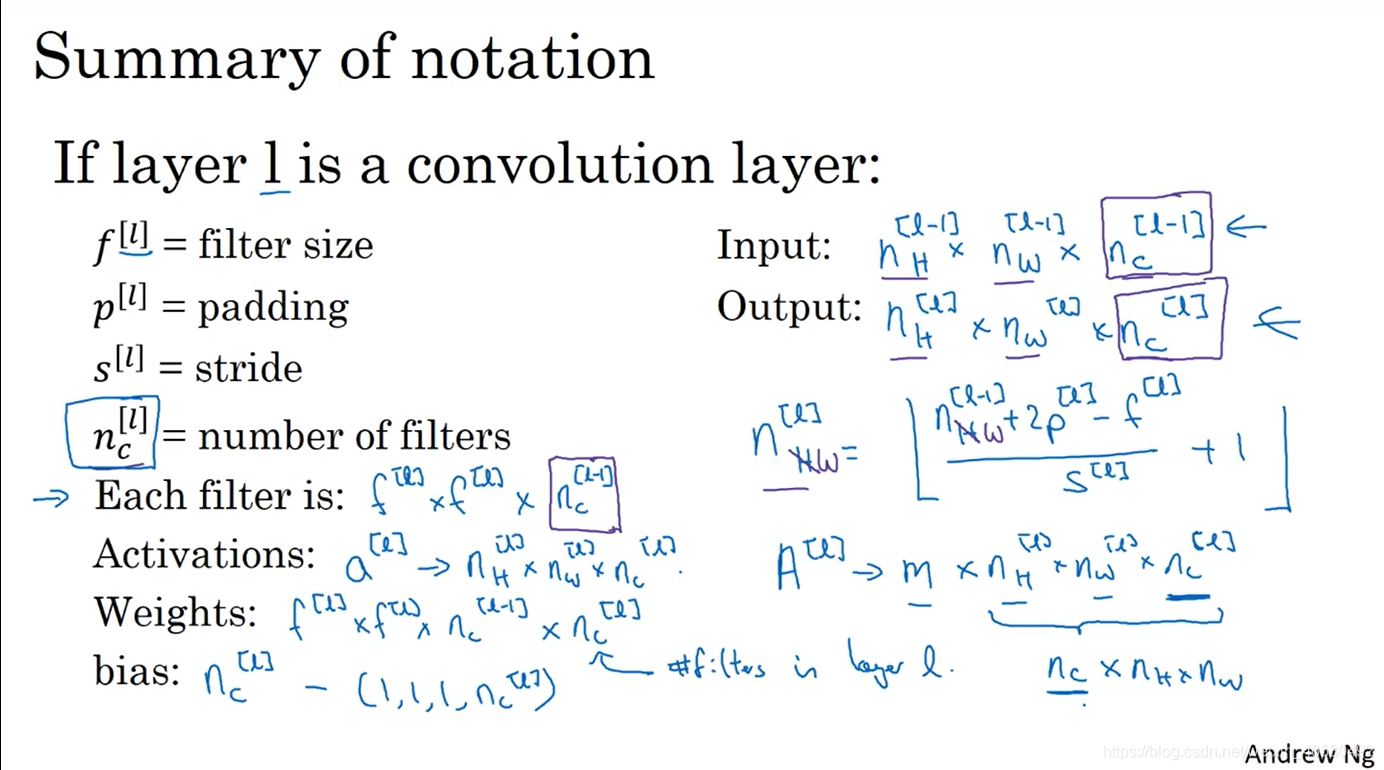

1.6 ������

ͨ���������������(������)�IJ�ͬͨ������ֵ,������ȡ��ͬ���������

s

u

m

m

a

r

y

:

(

n

��

n

��

n

c

)

?

(

f

��

f

��

n

c

)

��

(

n

?

f

+

1

)

��

(

n

?

f

+

1

)

��

n

c

��

summary:(n\times n\times n_c)*(f\times f \times n_c)\rightarrow(n-f+1)\times(n-f+1)\times n_c'

summary:(n��n��nc?)?(f��f��nc?)��(n?f+1)��(n?f+1)��nc��?

1.7 ����������

����������:�������ϡ�����Ӧ�õ���СͼƬ��,������������

![[����ͼƬת��ʧ��,Դվ�����з���������,���齫ͼƬ��������ֱ���ϴ�(img-DmWLpa4O-1627111410677)(../AppData/Roaming/Typora/typora-user-images/image-20210719161338274.png)]](https://img-blog.csdnimg.cn/a26c275f1bb240d585872f9703f70d49.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3dlaXhpbl80NjUzMDQ5Mg==,size_16,color_FFFFFF,t_70)

if you have 10 filters that are 3x3x3 in one layer of a neural network, how many parameters does that layers have?

(3x3x3+1) x 10 = 280

1.8 ��������ʾ��

��������������ȡ��,������Խ��,��ȡ����ϢԽ�ࡣ

Types of layers in a convolutional network?

- Convolution (CONV)

- Pooling (POOL)

- Fully connected (FC)

1.9 �ػ���

�ػ���:����ģ�͵Ĵ�С,������ٶ�,ͬʱ�������ȡ������³���ԡ�

Ŀǰ��˵,���ػ���ƽ���ػ�������,��Ҳ������,������Ⱥ���������硣

summary of pooling

hyperparameters:

f: filter size

s: stride

Max(f=2,s=2) or average(f=3,s=2) pooling

1.10 ����������ʾ��

���Ų���������,�߶ȺͿ��ȶ����С,��ͨ�����������ӡ�

![[����ͼƬת��ʧ��,Դվ�����з���������,���齫ͼƬ��������ֱ���ϴ�(img-bH8R1efm-1627111410679)(../AppData/Roaming/Typora/typora-user-images/image-20210719172447466.png)]](https://img-blog.csdnimg.cn/ea59ecefa7ae403abb01a6ef8e14c2c4.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3dlaXhpbl80NjUzMDQ5Mg==,size_16,color_FFFFFF,t_70)

![[����ͼƬת��ʧ��,Դվ�����з���������,���齫ͼƬ��������ֱ���ϴ�(img-iTGNIhO3-1627111410681)(../AppData/Roaming/Typora/typora-user-images/image-20210719172527871.png)]](https://img-blog.csdnimg.cn/60dc2496a47b4407a8fd866670894ef3.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3dlaXhpbl80NjUzMDQ5Mg==,size_16,color_FFFFFF,t_70)

1.11 Ϊʲôʹ�þ���?

������������������ַ�ʽ���ٲ���,�Ա��������ø�С��ѵ����ѵ����,�Ӷ�Ԥ��������ϡ�

Ϊʲôʹ�þ���:����������ϡ������

![[����ͼƬת��ʧ��,Դվ�����з���������,���齫ͼƬ��������ֱ���ϴ�(img-v0i7VMQf-1627111410682)(../AppData/Roaming/Typora/typora-user-images/image-20210719194630040.png)]](https://img-blog.csdnimg.cn/76b599ce326f458a97e08f380725a959.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3dlaXhpbl80NjUzMDQ5Mg==,size_16,color_FFFFFF,t_70)

2.1 ΪʲôҪ����ʵ���о�?

classic networks:LeNet-5��AlexNet��VGG

ResNet��Inception.

2.2 ��������

![#### [����ͼƬת��ʧ��,Դվ�����з���������,���齫ͼƬ��������ֱ���ϴ�(img-xyayRYpX-1627111410683)(../AppData/Roaming/Typora/typora-user-images/image-20210720133948106.png)]](https://img-blog.csdnimg.cn/5338eac45617471d93133abcc4e93774.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3dlaXhpbl80NjUzMDQ5Mg==,size_16,color_FFFFFF,t_70)

![[����ͼƬת��ʧ��,Դվ�����з���������,���齫ͼƬ��������ֱ���ϴ�(img-HOzrWTeu-1627111410684)(../AppData/Roaming/Typora/typora-user-images/image-20210720134111562.png)]](https://img-blog.csdnimg.cn/77c4fe2e11a849dbaf4cbc348d2967cb.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3dlaXhpbl80NjUzMDQ5Mg==,size_16,color_FFFFFF,t_70)

![[����ͼƬת��ʧ��,Դվ�����з���������,���齫ͼƬ��������ֱ���ϴ�(img-TgbTeiZw-1627111410684)(../AppData/Roaming/Typora/typora-user-images/image-20210720134157993.png)]](https://img-blog.csdnimg.cn/772d1445239e4854a182800cd5f19df6.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3dlaXhpbl80NjUzMDQ5Mg==,size_16,color_FFFFFF,t_70)

2.3 �����

skip connect(Զ������): a [ l ] a^{[l]} a[l]����һ���ü���,�Ӷ�����Ϣ���ݵ�������ĸ���㡣

residual network �ܹ��ﵽ����ĸ����,���ַ�ʽȷʵ�����ڽ���ݶ���ʧ���ݶȱ�ը���⡣��������ѵ�����������ͬʱ,���ܱ�֤���õ����ܡ�

2.4 �в�����Ϊʲô����?

�������Խ��,����ѵ������ѵ�������Ч�ʻ���������,��Ҳ����ʱ�����Dz�ϣ�����������ԭ��

�в��������õ���Ҫԭ������Щ�в��ѧϰ��Ⱥ���������,�����������ܲ����ܵ�Ӱ��,�ܶ�ʱ�������������Ч��,����˵���ٲ��ή��Ч�ʡ�

a

[

l

+

2

]

=

g

(

z

[

l

+

2

]

+

a

[

l

]

)

=

g

(

w

[

l

+

2

]

a

[

l

+

1

]

+

b

[

l

+

2

]

+

a

[

l

]

)

��

��

w

[

l

+

2

]

��

b

[

l

+

2

]

��

Ϊ

0

,

��

��

=

g

(

a

[

l

]

)

=

a

[

l

]

(

R

e

L

U

��

��

)

a^{[l+2]} = g(z^{[l+2]}+a^{[l]})\\ = g(w^{[l+2]}a^{[l+1]}+b^{[l+2]}+a^{[l]})\\ ����w^{[l+2]}��b^{[l+2]}��Ϊ0,����\\ = g(a^{[l]}) = a^{[l]} (ReLU����)

a[l+2]=g(z[l+2]+a[l])=g(w[l+2]a[l+1]+b[l+2]+a[l])����w[l+2]��b[l+2]��Ϊ0,����=g(a[l])=a[l](ReLU����)

2.5 �����е������Լ�1x1����

1x1���������ڱ�֤�߶ȿ��Ȳ���������ѹ���ŵ����������ټ��㡣

2.6 �ȸ�inception������

![[����ͼƬת��ʧ��,Դվ�����з���������,���齫ͼƬ��������ֱ���ϴ�(img-9ZKf5Mj7-1627111410685)(../AppData/Roaming/Typora/typora-user-images/image-20210722103918503.png)]](https://img-blog.csdnimg.cn/6ded2356fe23420f9acfeb1b3f7823e1.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3dlaXhpbl80NjUzMDQ5Mg==,size_16,color_FFFFFF,t_70)

![[����ͼƬת��ʧ��,Դվ�����з���������,���齫ͼƬ��������ֱ���ϴ�(img-gDXG68BL-1627111410686)(../AppData/Roaming/Typora/typora-user-images/image-20210722104019550.png)]](https://img-blog.csdnimg.cn/6ad2285d2a20400690b3225e433cc5b4.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3dlaXhpbl80NjUzMDQ5Mg==,size_16,color_FFFFFF,t_70)

2.7 inception����

![[����ͼƬת��ʧ��,Դվ�����з���������,���齫ͼƬ��������ֱ���ϴ�(img-rMVcHgZA-1627111410686)(../AppData/Roaming/Typora/typora-user-images/image-20210722104057652.png)]](https://img-blog.csdnimg.cn/1f87aa8c4bbf4835ba0cc166880b2cfc.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3dlaXhpbl80NjUzMDQ5Mg==,size_16,color_FFFFFF,t_70)

2.8 ʹ�ÿ�Դ��ʵ�ַ���

2.9 Ǩ��ѧϰ

����ǰ�����еIJ�,ֻ��softmax��Ķ�����Ӧ�Լ���ʵ�֡�

2.10 ��������

mirroring����Գơ�random cropping�������rotation��shearing��local warping

color shifting(rgbͨ��)

2.11 ������Ӿ���״

3.1 Ŀ�궨λobject localization

Need to output b x , b y , b h , b w b_x,b_y,b_h,b_w bx?,by?,bh?,bw?,class label (1,-4)

y = [ p c , b x , b y , b h , b w , c 1 , c 2 , c 3 ] y = [p_c,b_x,b_y,b_h,b_w,c_1,c_2,c_3] y=[pc?,bx?,by?,bh?,bw?,c1?,c2?,c3?]

L ( y ^ , y ) = �� i = 1 8 ( y i ^ ? y i ) 2 L(\hat{y},y) = \sum_{i=1}^8 (\hat{y_i}-y_i)^2 L(y^?,y)=��i=18?(yi?^??yi?)2

3.2 ��������landmark detection

C o n v N e t �� [ f a c e , l 1 x , l 1 y , l 2 x , l 2 y , �� �� , l 64 x , l 64 y ] ConvNet\rightarrow[face,l_{1x},l_{1y},l_{2x},l_{2y},����,l_{64x},l_{64y}] ConvNet��[face,l1x?,l1y?,l2x?,l2y?,����,l64x?,l64y?] 129

3.3 Ŀ����object detection

3.4 �����Ļ�������ʵ��

convolution implementation of sliding windows

3.5 Bounding BoxԤ��

YOLO:you only look once

YOLO�����ٶȷdz���,���Դﵽʵʱʶ��,

3.6 ������intersection over union(IOU)

Evaluating object localization �����Ⱥ���

���������߿��벢��֮��

��correct�� if IoU > 0.5

3.7 �Ǽ���ֵ����Non-max suppression

![[����ͼƬת��ʧ��,Դվ�����з���������,���齫ͼƬ��������ֱ���ϴ�(img-wDJdjEj5-1627111410687)(../AppData/Roaming/Typora/typora-user-images/image-20210721161124816.png)]](https://img-blog.csdnimg.cn/a2ba480448444d329219a458b0492a2e.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3dlaXhpbl80NjUzMDQ5Mg==,size_16,color_FFFFFF,t_70)

3.8 Ancher Boxes

ancher boxes:Ϊ�˴����������������ͬһ������������,����ʹ���ѵ�������������(�ܸߺ��ݵ����˺ͺܳ��ܵ͵ij���)

y

=

[

p

c

,

b

x

,

b

y

,

b

h

,

b

w

,

c

1

,

c

2

,

c

3

?

,

p

c

,

b

x

,

b

y

,

b

h

,

b

w

,

c

1

,

c

2

,

c

3

?

]

a

n

c

h

o

r

b

o

x

1

a

n

c

h

o

r

b

o

x

2

y = [\underbrace {p_c,b_x,b_y,b_h,b_w,c_1,c_2,c_3},\underbrace {p_c,b_x,b_y,b_h,b_w,c_1,c_2,c_3}]\\ anchor\quad box 1\quad \quad \quad \quad \quad anchor\quad box 2

y=[

pc?,bx?,by?,bh?,bw?,c1?,c2?,c3??,

pc?,bx?,by?,bh?,bw?,c1?,c2?,c3??]anchorbox1anchorbox2

3.9 YOLO�㷨

![[����ͼƬת��ʧ��,Դվ�����з���������,���齫ͼƬ��������ֱ���ϴ�(img-VRS738sq-1627111410688)(../AppData/Roaming/Typora/typora-user-images/image-20210722081011589.png)]](https://img-blog.csdnimg.cn/a05abfc77276468e998503a99a2a6b62.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3dlaXhpbl80NjUzMDQ5Mg==,size_16,color_FFFFFF,t_70)

3.10 ��ѡ����region proposal

R-CNN:������ľ���������

���ȵõ���ѡ����,Ȼ���ٷ���,�����ٶȽ�����

4.1 ʲô������ʶ��?

face verification������֤

- input image,name/ID

- output whether the input image is that of the claimed person.

face recognition����ʶ��

- has a database of K persons

- get an input image

- output ID if the image is any of the K persons (or ��not recognized��)

4.2 One-Shotѧϰ

d(img1,img2) = degree of difference between images

if d(img1,img2) �� �� \leq \tau ����

4.3 Siamese����

![[����ͼƬת��ʧ��,Դվ�����з���������,���齫ͼƬ��������ֱ���ϴ�(img-enSMfoew-1627111410688)(../AppData/Roaming/Typora/typora-user-images/image-20210722084032996.png)]](https://img-blog.csdnimg.cn/f873ab93a1474f20adacd58ac7d77227.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3dlaXhpbl80NjUzMDQ5Mg==,size_16,color_FFFFFF,t_70)

4.4 Triplet��ʧ(��Ԫ��)

Anchor��Positive��Negative

�O

�O

f

(

A

)

?

f

(

P

)

�O

�O

2

+

��

��

�O

�O

f

(

A

)

?

f

(

N

)

�O

�O

2

�O

�O

f

(

A

)

?

f

(

P

)

�O

�O

2

?

�O

�O

f

(

A

)

?

f

(

N

)

�O

�O

2

+

��

��

0

��

:

m

a

r

g

i

n

(

��

��

)

l

o

s

s

f

u

n

c

t

i

o

n

:

L

(

A

,

P

,

N

)

=

m

a

x

(

�O

�O

f

(

A

)

?

f

(

P

)

�O

�O

2

?

�O

�O

f

(

A

)

?

f

(

N

)

�O

�O

2

+

��

,

0

)

J

=

��

i

=

1

m

L

(

A

(

i

)

,

P

(

i

)

,

N

(

i

)

)

||f(A)-f(P)||^2 + \alpha \leq ||f(A) - f(N)||^2\\ ||f(A)-f(P)||^2 - ||f(A) - f(N)||^2+ \alpha \leq 0\\ \alpha : margin(���)\\ loss \quad function: L(A,P,N) = max(||f(A)-f(P)||^2 - ||f(A) - f(N)||^2+ \alpha ,0)\\ J = \sum_{i=1}^m L(A^{(i)},P^{(i)},N^{(i)})

�O�Of(A)?f(P)�O�O2+�����O�Of(A)?f(N)�O�O2�O�Of(A)?f(P)�O�O2?�O�Of(A)?f(N)�O�O2+����0��:margin(����)lossfunction:L(A,P,N)=max(�O�Of(A)?f(P)�O�O2?�O�Of(A)?f(N)�O�O2+��,0)J=i=1��m?L(A(i),P(i),N(i))

4.5 �沿��֤�Ͷ�����

��������֤����һ���ලѧϰ,����һ���ɶ�ͼƬ��ѵ����(����������һ��),Ŀ���ǩ��1��ʾ����ͼƬ��ͬһ����

4.6 ʲô�����ת��?

4.7 ʲô����Ⱦ�������?

4.8 ���ۺ���_bilibili

J ( G ) = �� J c o n t e n t ( C , G ) + �� J s t y l e ( S , G ) J(G) = \alpha J_{content}(C,G) + \beta J_{style}(S,G) J(G)=��Jcontent?(C,G)+��Jstyle?(S,G)

4.9 ���ݴ��ۺ���

![[����ͼƬת��ʧ��,Դվ�����з���������,���齫ͼƬ��������ֱ���ϴ�(img-M6nPLVlj-1627111410689)(../AppData/Roaming/Typora/typora-user-images/image-20210722091849087.png)]](https://img-blog.csdnimg.cn/f74bfae53bcb4db9a457d0b45ad7d500.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3dlaXhpbl80NjUzMDQ5Mg==,size_16,color_FFFFFF,t_70)

4.10 �����ۺ���

L e t a i , j , k [ l ] = a c t i v a t i o n a t ( i , j , k ) . G [ l ] i s n c [ l ] �� n c [ l ] G k k �� [ l ] ( S ) = �� i = 1 n H [ l ] �� j = 1 n W [ l ] a i j k [ l ] ( S ) a i j k �� [ l ] ( S ) G k k �� [ l ] ( G ) = �� i = 1 n H [ l ] �� j = 1 n W [ l ] a i j k [ l ] ( G ) a i j k �� [ l ] ( G ) J s t y l e [ l ] ( S , G ) = 1 2 n H [ l ] n W [ l n C [ l ] �O �O G k k �� [ l ] ( S ) ? G k k �� [ l ] ( G ) �O �O F 2 = 1 2 n H [ l ] n W [ l n C [ l ] �� k �� k �� ( G k k �� [ l ] ( S ) ? G k k �� [ l ] ( G ) ) 2 Let \quad a^{[l]}_{i,j,k} = activation\quad at(i,j,k). G^{[l]} is n^{[l]}_c\times n^{[l]}_c\\ G^{[l](S)}_{kk'} = \sum_{i=1}^{n_H^{[l]}}\sum_{j=1}^{n_W^{[l]}} a^{[l](S)}_{ijk}a^{[l](S)}_{ijk'}\\ G^{[l](G)}_{kk'} = \sum_{i=1}^{n_H^{[l]}}\sum_{j=1}^{n_W^{[l]}} a^{[l](G)}_{ijk}a^{[l](G)}_{ijk'}\\ J^{[l]}_{style}(S,G) = \frac{1}{2n^{[l]}_Hn^{[l}_Wn^{[l]}_C}||G^{[l](S)}_{kk'}-G^{[l](G)}_{kk'}||^2_F\\ = \frac{1}{2n^{[l]}_Hn^{[l}_Wn^{[l]}_C}\sum_k\sum_{k'}(G^{[l](S)}_{kk'}-G^{[l](G)}_{kk'})^2 Letai,j,k[l]?=activationat(i,j,k).G[l]isnc[l]?��nc[l]?Gkk��[l](S)?=i=1��nH[l]??j=1��nW[l]??aijk[l](S)?aijk��[l](S)?Gkk��[l](G)?=i=1��nH[l]??j=1��nW[l]??aijk[l](G)?aijk��[l](G)?Jstyle[l]?(S,G)=2nH[l]?nW[l?nC[l]?1?�O�OGkk��[l](S)??Gkk��[l](G)?�O�OF2?=2nH[l]?nW[l?nC[l]?1?k��?k����?(Gkk��[l](S)??Gkk��[l](G)?)2