Pytorch Note34 ѧϰ��˥��

����Ŀ¼

ȫ���ʼǵĻ�����: Pytorch Note ��������

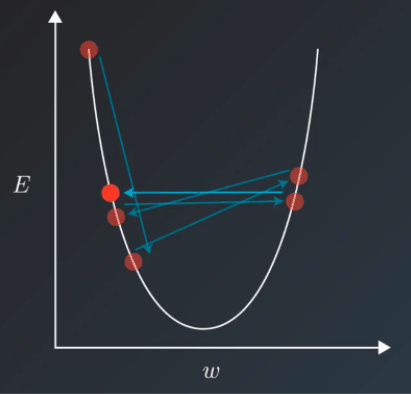

���ڻ���һ���ݶȽ����Ż��ķ�������,��ʼ��ʱ����µķ����DZȽϴ��,Ҳ����˵��ʼ��ѧϰ�ʿ������ô�һ��,���ǵ�ѵ������ loss �½���һ���̶�֮��,,ʹ�����̫���ѧϰ�ʾͻᵼ�� loss һֱ������,����

��֮ǰ,���ǻ�ѡ���һ����Ż��㷨,����������ʲô�Ż��㷨���п��ܻ������������,�����ѧϰ�ʵ��ĺ�С,���Ż���ʱ���ֻ�ܴ�,���ʱ�����Ҫ��ѧϰ�ʽ���˥���Ѵﵽ loss �ij���½�,������ѧϰ��˥���İ취�ܹ�������ì��,ѧϰ��˥����������ѵ���Ľ��в��ϵļ�Сѧϰ�ʡ�

�� pytorch ��ѧϰ��˥���dz�����,ʹ�� torch.optim.lr_scheduler,�������Ϣ����ֱ�Ӳ鿴�ٷ��ĵ�

һ����˵,pytorch������ѧϰ�ʵ���(˥��)����:

- ʹ�ÿ⺯�����е���

- �ֶ�����

ʹ�ÿ⺯������ѧϰ��

PyTorchѧϰ�ʵ�������ͨ��torch.optim.lr_scheduler�ӿ�ʵ�֡�PyTorch�ṩ��ѧϰ�ʵ������Է�Ϊ������,�ֱ���

- �������:�ȼ������(Step),�������ѧϰ��(MultiStep),ָ��˥������(Exponential)�������˻�CosineAnnealing��

- ����Ӧ����:����Ӧ����ѧϰ�� ReduceLROnPlateau��

- �Զ������:�Զ������ѧϰ�� LambdaLR��

scheduler.step()

��ÿ��epoch��ѵ����,ʹ��scheduler.step()������ѧϰ�ʸ���,�˷���������optimizer.step()����ģ�Ͳ���,��һ��epoch��Ӧһ��scheduler.step()��

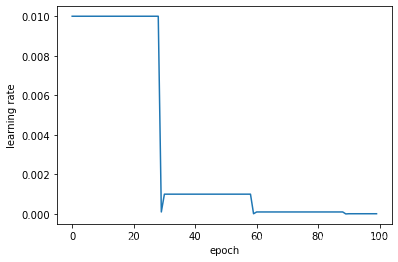

�ȼ������ѧϰ�� StepLR

�ȼ������ѧϰ��,��������Ϊ gamma ��,�������Ϊ step_size�������λ��step,һ����˵,stepͨ����ָepoch,������iteration

����˵,����ÿѵ��step_size��epoch,ѧϰ�ʵ���Ϊlr=lr*gamma��

torch.optim.lr_scheduler.StepLR(optimizer, step_size, gamma=0.1, last_epoch=-1)

����:

-

optimizer: ������ѵ����ʹ�õ��Ż���,��optimizer=torch.optim.SGD(��)

-

step_size(int): ѧϰ���½������,��λ��epoch,������iteration��������Ϊ30,�����30��60��90����stepʱ,��ѧϰ�ʵ���Ϊlr*gamm

-

gamma(float): ѧϰ�ʵ�������,Ĭ��Ϊ0.1,���½�10��

-

last_epoch(int): ��һ��epoch��,�����������ָʾѧϰ���Ƿ���Ҫ��������ʵ�������һ��epoch��index,�����ѵ���˺ܶ��epoch���ж���,����ѵ��,���ֵ�͵��ڼ��ص�ģ�͵�epoch��Ĭ��Ϊ-1��ʾ��ͷ��ʼѵ��,����epoch=1��ʼ��

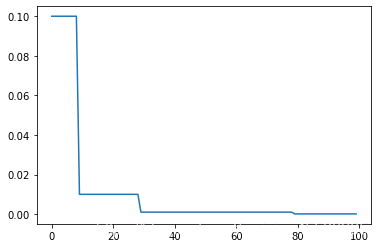

�������ѧϰ�� MultiStepLR

��StepLR����,�������ǵ������ǵ��ڵ�epoch���Լ�����,����һ���ǵȲ�����,����[30, 60, 90,��]

��������ʺϺ��ڵ���ʹ��,�۲� loss ����,Ϊÿ��ʵ�鶨��ѧϰ�ʵ���ʱ����

torch.optim.lr_sheduler.MultiStepLR(optimizer, milestones, gamma=0.1, last_epoch=-1)

����:

-

optimizer: ������ѵ����ʹ�õ��Ż���,��optimizer=torch.optim.SGD(��)

-

milestone(list): һ���б�����,��ʾ���ѧϰ����Ҫ������epochֵ,��milestones=[10, 30, 80],��˵���ڵ�10,��30,��80��epoch���иı�

-

gamma(float): ѧϰ�ʵ�������,Ĭ��Ϊ0.1,���½�10��

-

last_epoch(int): ��һ��epoch��,�����������ָʾѧϰ���Ƿ���Ҫ��������ʵ�������һ��epoch��index,�����ѵ���˺ܶ��epoch���ж���,����ѵ��,���ֵ�͵��ڼ��ص�ģ�͵�epoch��Ĭ��Ϊ-1��ʾ��ͷ��ʼѵ��,����epoch=1��ʼ��

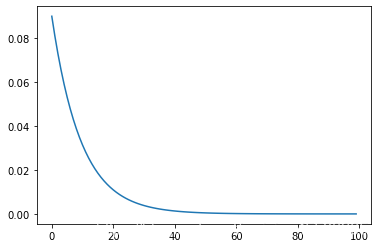

ָ��˥������ѧϰ�� ExponentialLR

ѧϰ�ʳ�ָ����˥��,ÿѵ��һ��epoch, l r = l r �� g a m m a e p o c h lr=lr \times gamma^{epoch} lr=lr��gammaepoch

torch.optim.lr_sheduler.ExponentialLR(optimizer, gamma, last_epoch)

����:

-

optimizer: ������ѵ����ʹ�õ��Ż���,��optimizer=torch.optim.SGD(��)

-

gamma(float):ѧϰ�ʵ��������ĵ���,ָ��Ϊepoch,��ʼֵ��lr, ����Ϊ g a m m a e p o c h gamma^{epoch} gammaepoch

-

last_epoch(int): ��һ��epoch��,�����������ָʾѧϰ���Ƿ���Ҫ��������ʵ�������һ��epoch��index,�����ѵ���˺ܶ��epoch���ж���,����ѵ��,���ֵ�͵��ڼ��ص�ģ�͵�epoch��Ĭ��Ϊ-1��ʾ��ͷ��ʼѵ��,����epoch=1��ʼ��

�����˻�������ѧϰ�� CosineAnnealingLR

�����Һ���Ϊ����,����ÿ���������ֵʱ��������ѧϰ�ʡ��Գ�ʼѧϰ��Ϊ���ѧϰ��,�� 2?Tmax Ϊ����,��һ�����������½�,��������

torch.optim.lr_sheduler.CosineAnnealingLR(optimizer, T_max, eta_min=0, last_epoch=-1)

����:

- T_max(int):ѧϰ���½�����Сֵʱ��epoch��,����epoch=T_maxʱ,ѧϰ���½������Һ�����Сֵ,��epoch>T_maxʱ,ѧϰ�ʽ�����

- eta_min(float): ѧϰ�ʵ�������Сֵ,����һ��������,ѧϰ����С���½��� eta_min,Ĭ��ֵΪ 0��

����ָ�����ѧϰ�� ReduceLROnPlateau

��ijָ��(loss��accuracy)���������epoch�ж�û�б仯(�½������߳���������ֵ)ʱ,����ѧϰ�ʡ�

�統��֤����loss�����½�ʱ,����ѧϰ��;����֤����accuracy��������ʱ,����ѧϰ�ʡ�

torch.optim.lr_sheduler.ReduceLROnPlateau(optimizer, mode='min', factor=0.1, patience=10,

verbose=False, threshold=0.0001, threshold_mode='rel', cooldown=0, min_lr=0, eps=1e-08)

����:

- mode(str): ģʽѡ��,��min��max����ģʽ,min��ʾ��ָ�겻�ٽ���(����loss),max��ʾ��ָ�겻������(����accuracy)

- factor(float): ѧϰ�ʵ�������,ͬǰ���gamma,�����ָ��ﵽҪ��ʱ,lr=lr��factor��

- patience(int): ���ܸ�ָ����ٸ�epoch���仯,��������ʱ,����ѧϰ�ʡ�

- verbose(bool): �Ƿ��ӡѧϰ����Ϣ,print( ��Epoch {:5d} reducing learning rate of group {} to {:.4e}.��.format(epoch, i, new_lr), Ĭ��ΪFalse, ������ӡ����Ϣ��

- threshold_mode (str): ѡ���ж�ָ���Ƿ�����ŵ�ģʽ,������ģʽ:rel �� abs.

��threshold_mode == rel, ���� mode == maxʱ,dynamic_threshold = best * (1 + threshold);

��threshold_mode == rel, ���� mode == minʱ,dynamic_threshold = best * (1 - threshold);

��threshold_mode == abs, ���� mode == maxʱ,dynamic_threshold = best + threshold;

��threshold_mode == abs, ���� mode == minʱ,dynamic_threshold = best - threshold; - threshold(float): ���threshold_modeʹ�á�

- cooldown(int): ����ȴʱ�䡱,������ѧϰ��֮��,��ѧϰ�ʵ��������侲һ��,��ģ����ѵ��һ��ʱ��,���������ģʽ��

- min_lr(float or list): ѧϰ������,��Ϊfloat,����list,���ж��������ʱ,����list�������á�

- eps(float): ѧϰ��˥������Сֵ,��ѧϰ�ʵ��仯ֵС��epsʱ,����ѧϰ�ʡ�

�Զ������ѧϰ�� LambdaLR

Ϊ��ͬ�������趨��ͬѧϰ�ʵ������ԡ���������Ϊ,

l

r

=

b

a

s

e

_

l

r

?

l

a

m

b

d

a

(

s

e

l

f

.

l

a

s

t

_

e

p

o

c

h

)

lr=base\_lr?lambda(self.last\_epoch)

lr=base_lr?lambda(self.last_epoch)

fine-tune ��ʮ������,���Dz�����Ϊ��ͬ�IJ��趨��ͬ��ѧϰ��,������Ϊ���趨��ͬ��ѧϰ�ʵ������ԡ�

torch.optim.lr_scheduler.LambdaLR(optimizer, lr_lambda, last_epoch=-1)

����:

- lr_lambda(function or list): �Զ������ѧϰ�ʵ��������ĺ���,ͨ��ʱepoch�ĺ���,���ж��������ʱ,��Ϊlist.

- last_epoch (int) �C ��һ�� epoch ��,�����������ָʾѧϰ���Ƿ���Ҫ��������last_epoch �����趨�ļ��ʱ,�ͻ��ѧϰ�ʽ��е�������Ϊ-1 ʱ,ѧϰ������Ϊ��ʼֵ��

�ֶ�����ѧϰ��

�ֶ�����ѧϰ��,ͨ�����Զ������º���:

def adjust_learning_rate(optimizer, epoch):

"""Sets the learning rate to the initial LR decayed by 10 every 30 epochs"""

lr = args.lr * (0.1 ** (epoch // 30))

for param_group in optimizer.param_groups:

param_group['lr'] = lr

def adjust_learning_rate(epoch, lr):

if epoch <= 81: # 32k iterations

return lr

elif epoch <= 122: # 48k iterations

return lr/10

else:

return lr/100

�ú���ͨ����ÿ��epoch��,���������е�lr������ѧϰ���ֶ�����,�÷�����:

for epoch in range(epochs):

lr = adjust_learning_rate(optimizer, epoch) # ����ѧϰ��

optimizer = optim.SGD(net.parameters(), lr=lr, momentum=0.9, weight_decay=5e-4)

......

optimizer.step() # �����µ�ѧϰ�ʽ��в�������

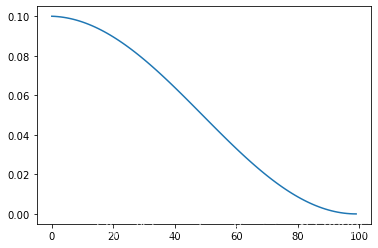

��:����������ѧϰ�ʱ仯ͼ�ij���:

import torch

import torch.optim as optim

from torch.optim import lr_scheduler

from torchvision.models import AlexNet

import matplotlib.pyplot as plt

model = AlexNet(num_classes=2)

optimizer = optim.SGD(params=model.parameters(), lr=0.1)

# �ȼ������ѧϰ��,ÿѵ��step_size��epoch,lr*gamma

# scheduler = lr_scheduler.StepLR(optimizer, step_size=30, gamma=0.1)

# ��������ѧϰ��,ÿѵ����milestones�е�epoch,lr*gamma

# scheduler = lr_scheduler.MultiStepLR(optimizer, milestones=[10, 30, 80], gamma=0.1)

# ָ��ѧϰ��˥��,lr*gamma**epoch

# scheduler = lr_scheduler.ExponentialLR(optimizer, gamma=0.9)

# �����˻�ѧϰ��˥��,T_max��ʾ�������,lr�ij�ʼֵ��Ϊ���Һ���0���ļ���ֵ��ʼ�½�,

# ��epoch=T_maxʱlr������Сֵ,��pi/2��,Ȼ������������,lr����

# scheduler = lr_scheduler.CosineAnnealingLR(optimizer, T_max=100, eta_min=0)

plt.figure()

x = list(range(100))

y = []

for epoch in range(100):

scheduler.step()

y.append(scheduler.get_lr()[0])

plt.plot(x, y)

plt.show()

�õ�ѧϰ��

optimizerͨ��param_group������������.param_group�б����˲����鼰���Ӧ��ѧϰ��,�����ȵ�.�������ǿ���ͨ������param_group[��lr��]��ֵ�����Ķ�Ӧ�������ѧϰ�ʡ�

aijust_learning_rate() ��������ͨ��forѭ������ȡ��ÿһ��param_group,Ȼ�������еļ� ��lr�� ��ֵ,��֮Ϊ�ֶ�����ѧϰ��

�����������һ���ֵ�,�����кܶ�����,����ѧϰ��,Ȩ��˥���ȵ�,���ǿ��Է�������

print('learning rate: {}'.format(optimizer.param_groups[0]['lr']))

print('weight decay: {}'.format(optimizer.param_groups[0]['weight_decay']))

learning rate: 0.01

weight decay: 0.0001

�����Ҫÿ�ε�����ʵʱ��ӡѧϰ��,��������ÿ��step����֪�����µ�����ѧϰ��,Ҳ����ʹ��

scheduler.get_lr()

������һ��ѧϰ���б�,�ɲ������еIJ�ͬѧϰ�����,��ͨ���б��������õ���ͬ�������е�ѧϰ�ʡ�