引言

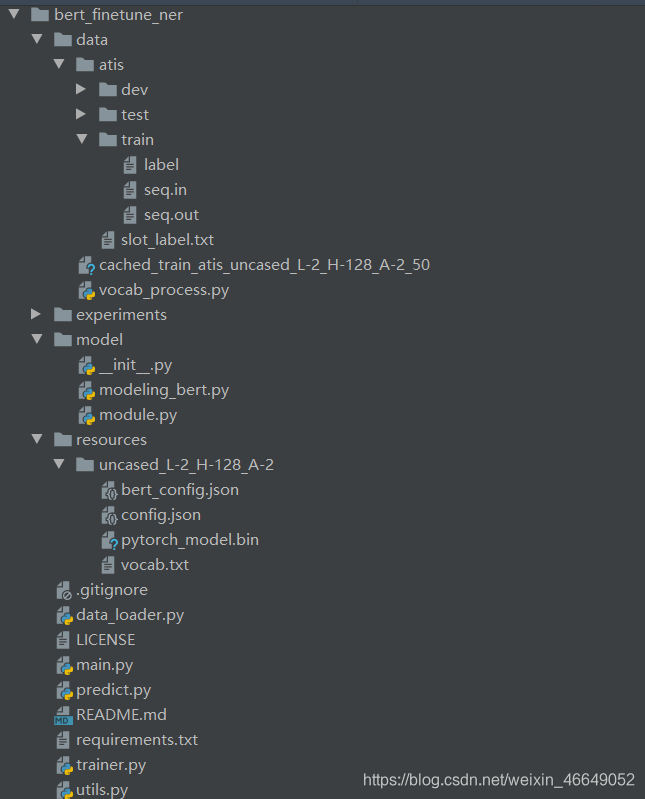

??这一节学习BERT模型如何在ner任务上进行微调。项目代码框架如下:

争取做到每一行代码每一行注释!!!

一、项目环境配置

- python>=3.6

- torch==1.6.0

- transformers==3.0.2

- seqeval==0.0.12

- pytorch-crf==0.7.2

二、数据集介绍

| Train | Dev | Test | Slot (NER) Labels | |

|---|---|---|---|---|

| ATIS | 4,478 | 500 | 893 | 120 |

- 标签数量基于 Train 数据集

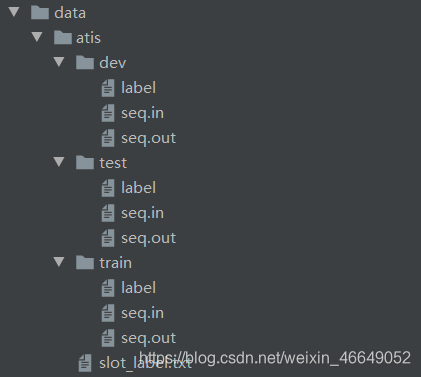

??我们这一节使用atis数据,数据集由训练集、验证集、测试集组成

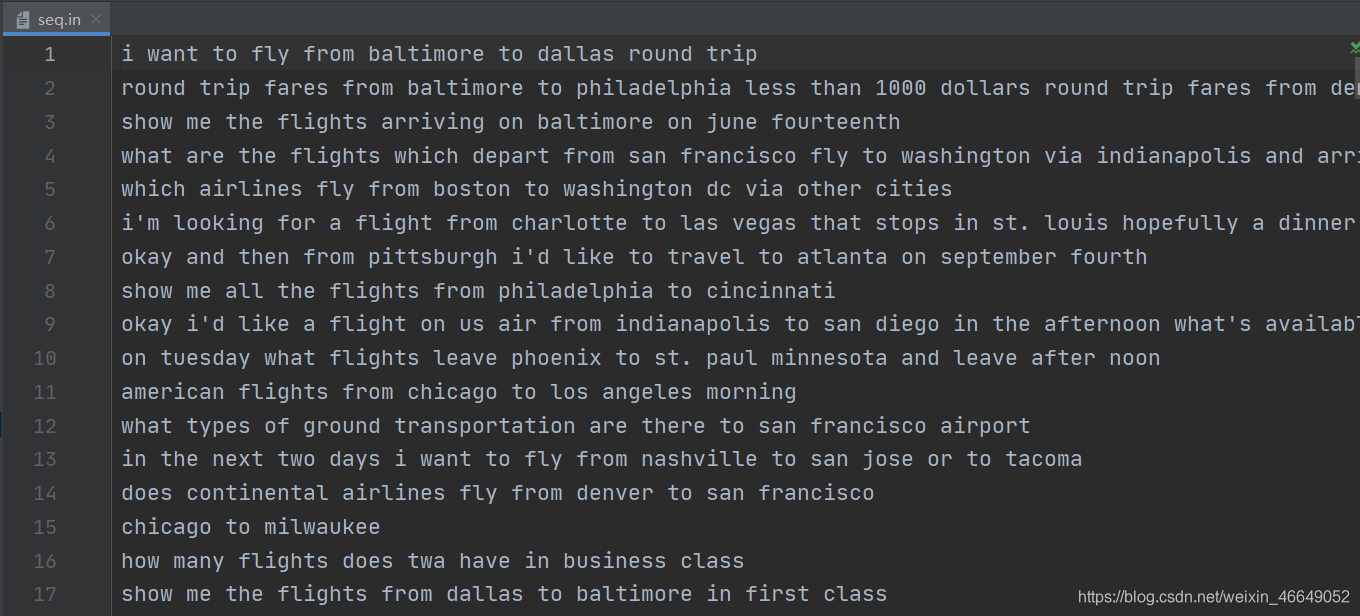

seq.in文件:每一行是一个文本

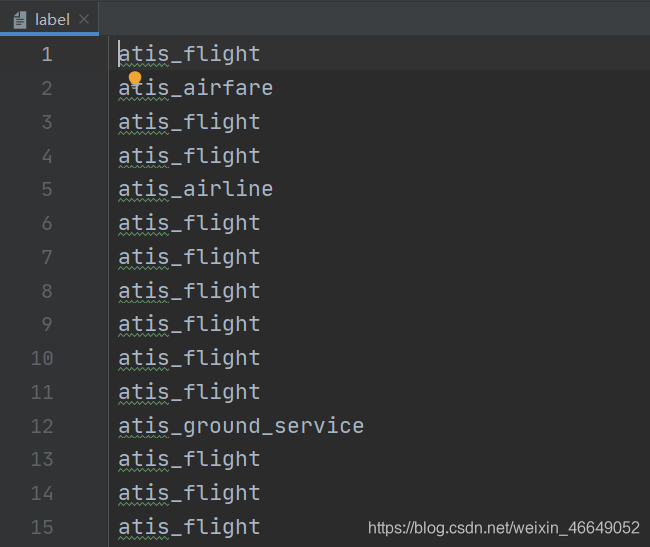

label文件:每一行一个意图标签

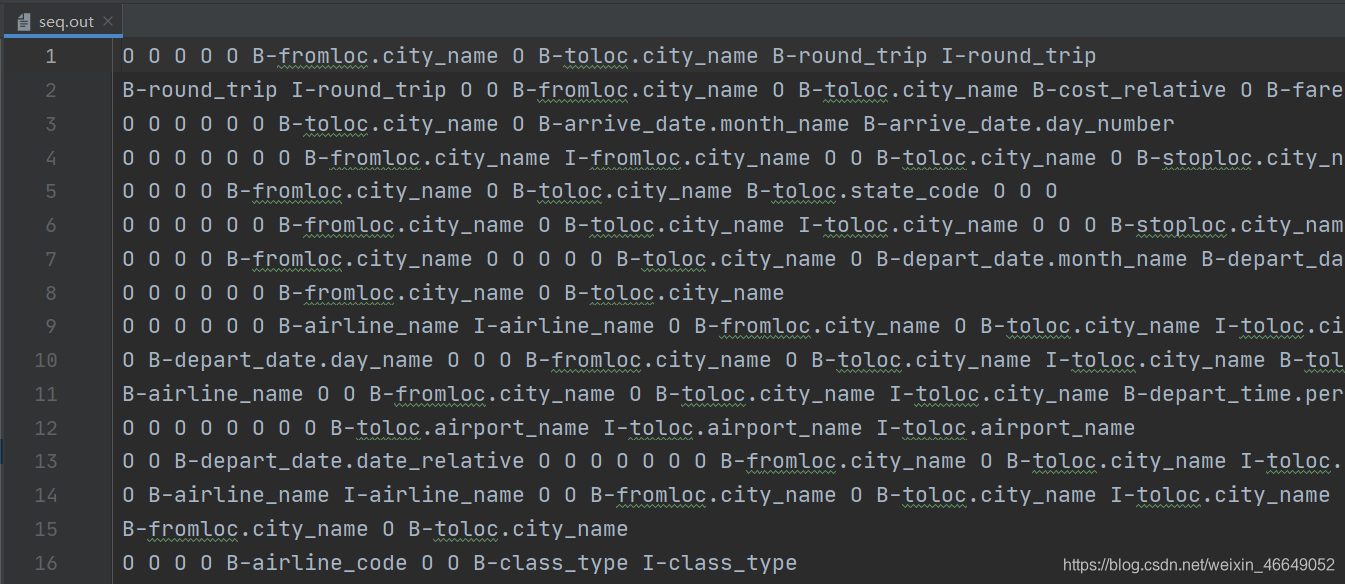

seq.out文件:在对话研究领域来讲,是slot_label。我们在这里当成序列的标签或者命名实体标签,我们会使用数据集中的序列标注的标签训练基于bert的ner模型。

slot_label.txt文件:这个文件是由vocab_process.py文件生成的命名实体标签统计文件,一共122个,基于训练数据集标签文件的120个,再加上两个额外标签"PAD"、“UNK”。

三、代码介绍

data_loader.py文件:这个文件的功能是将文本文件转化成InputExample类数据,并将输入样本转化为bert能够读取的InputFeatures类数据,最后保存至cache文件中,方便下次快速加载。utils.py文件:封装了很多实用程序,方便统一调用trainer.py文件:定义了任务的训练与评估以及保存模型与加载模型main.py文件:用于模型的训练与评估predict.py文件:用于模型的预测

四、测试结果

1.代码运行流程

??在命令行中输入

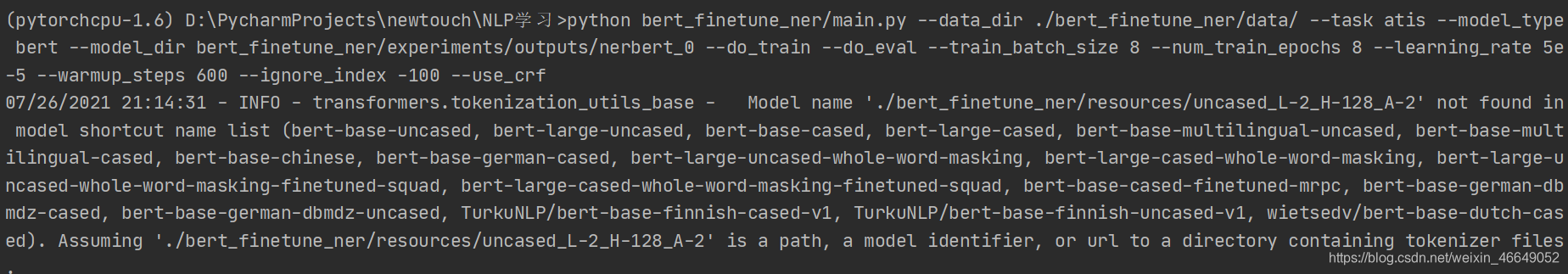

python bert_finetune_ner/main.py --data_dir ./bert_finetune_ner/data/ --task atis --model_type bert --model_dir bert_finetune_ner/experiments/outputs/nerbert_0 --do_train --do_eval --train_batch_size 8 --num_train_epochs 8 --learning_rate 5e-5 --warmup_steps 600 --ignore_index -100

如果还想使用crf,就输入

python bert_finetune_ner/main.py --data_dir ./bert_finetune_ner/data/ --task atis --model_type bert --model_dir bert_finetune_ner/experiments/outputs/nerbert_0 --do_train --do_eval --train_batch_size 8 --num_train_epochs 8 --learning_rate 5e-5 --warmup_steps 600 --ignore_index -100 --use_crf

我的示范如下:

2.运行结果

-

默认版本

python bert_finetune_ner/main.py --data_dir ./bert_finetune_ner/data/ --task atis --model_type bert --model_dir bert_finetune_ner/experiments/outputs/nerbert_0 --do_train --do_eval --train_batch_size 8 --num_train_epochs 8 --learning_rate 5e-5 --warmup_steps 600 --ignore_index -100测试结果

sementic_frame_acc = 0.6103023516237402 slot_f1 = 0.8044086773967809如果使用crf

python bert_finetune_ner/main.py --data_dir ./bert_finetune_ner/data/ --task atis --model_type bert --model_dir bert_finetune_ner/experiments/outputs/nerbert_1 --do_train --do_eval --train_batch_size 8 --num_train_epochs 8 --use_crf --learning_rate 5e-5 --warmup_steps 600 --ignore_index -100测试结果

sementic_frame_acc = 0.6226203807390818 slot_f1 = 0.8127837932238909 -

trick版本

如果给线性层设置更高的学习率python bert_finetune_ner/main.py --data_dir ./bert_finetune_ner/data/ --task atis --model_type bert --model_dir bert_finetune_ner/experiments/outputs/nerbert_3 --do_train --do_eval --train_batch_size 8 --num_train_epochs 8 --learning_rate 5e-5 --linear_learning_rate 5e-4 --warmup_steps 600 --ignore_index -100则测试结果为

sementic_frame_acc = 0.8073908174692049 slot_f1 = 0.9181532004197271如果给crf设置更高的学习率

python bert_finetune_ner/main.py --data_dir ./bert_finetune_ner/data/ --task atis --model_type bert --model_dir bert_finetune_ner/experiments/outputs/nerbert_1 --do_train --do_eval --train_batch_size 8 --num_train_epochs 8 --use_crf --crf_learning_rate 5e-3 --learning_rate 5e-5 --linear_learning_rate 5e-4 --warmup_steps 600 --ignore_index -100则测试结果为:

sementic_frame_acc = 0.8365061590145577 slot_f1 = 0.9351427564328516如果给crf层设置超高的学习率

python bert_finetune_ner/main.py --data_dir ./bert_finetune_ner/data/ --task atis --model_type bert --model_dir bert_finetune_ner/experiments/outputs/nerbert_2 --do_train --do_eval --train_batch_size 8 --num_train_epochs 8 --use_crf --crf_learning_rate 1e-1 --learning_rate 5e-5 --linear_learning_rate 5e-5 --warmup_steps 600 --ignore_index -100则测试结果为:

sementic_frame_acc = 0.7077267637178052 slot_f1 = 0.8759744861800142

3.预测

??预测部分代码在predict.py文件中,运行这个文件,需要在命令行输入

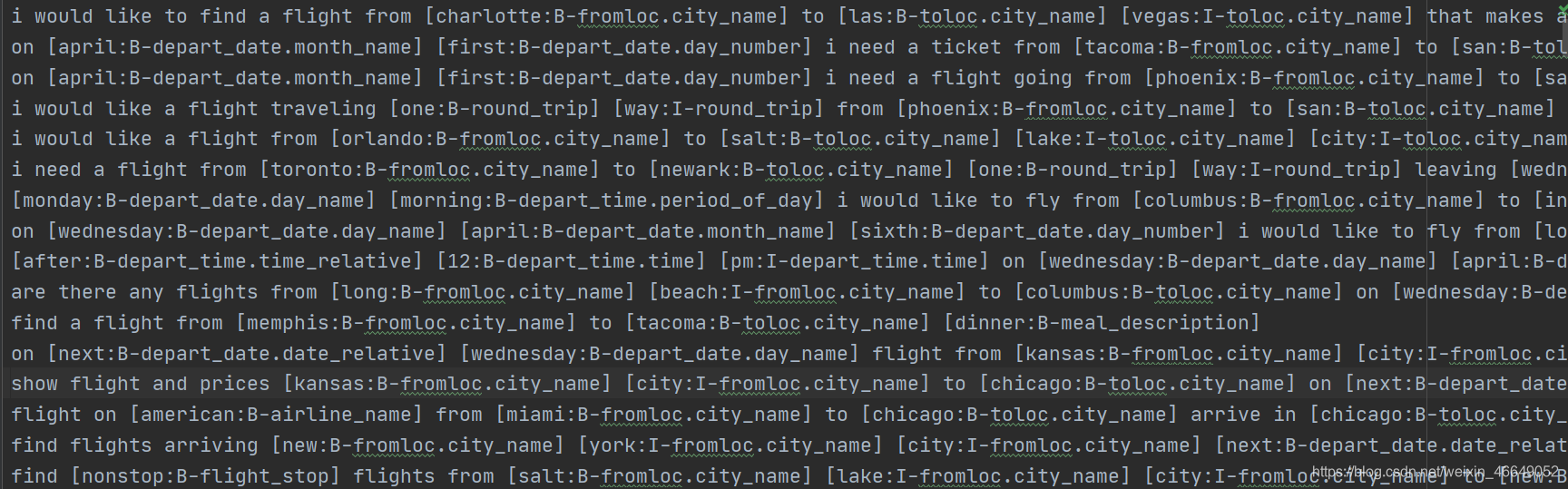

python bert_finetune_ner/predict.py --input_file bert_finetune_ner/data/atis/test/seq.in --output_file bert_finetune_ner/experiments/outputs/nerbert_0/atis_test_predicted.txt --model_dir bert_finetune_ner/experiments/outputs/nerbert_0

输出结果保存在atis_test_predicted.txt文件中,形式如下:

如果对您有帮助,麻烦点赞关注,这真的对我很重要!!!如果需要互关,请评论或者私信!