�����Ĭ����-����CSDN����Ŀ¼

cs224w(ͼ����ѧϰ)2021�����γ�ѧϰ�ʼǼ���

����Ŀ¼

���ڿ�slides ���ص�ַ

ͬ��һƪ����:

YouTube ��Ƶ�ۿ���ַ1 ��Ƶ�ۿ���ַ2 ��Ƶ�ۿ���ַ3

������Ҫ����:

�������Ƚ�����ͼ��motif / subgraph�ĸ���,�Լ���motif significance�Ķ���(������ͼ�е�subgraphҪ��null model��/�ٳ����ٲ�������,�Լ��������null model)��

������������������ģ���µ�subgraph matching����(ͬʱҲ��subgraph�ı�ʾ����)��

����������ҵ�ͼ�г���Ƶ�ʽϸߵ�motif / subgraph��

1. Identifying and Counting Motifs in Networks

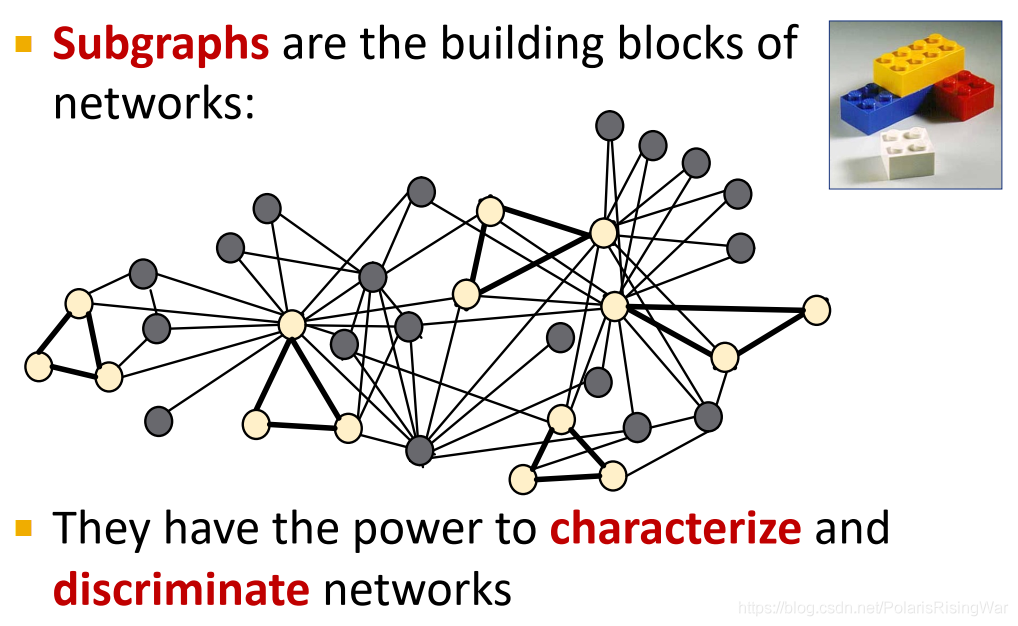

- subgraph

subgraph���������ɲ���,������ʶ������ֲ�ͬ������(����˵�Dz�ͬ�����������в�ͬ������subgraph)��

ʹ�ô�ͳ��discrete type matching1 �������ۺܴ�,���Ļ����ʹ����������subgraph matching����ķ�����

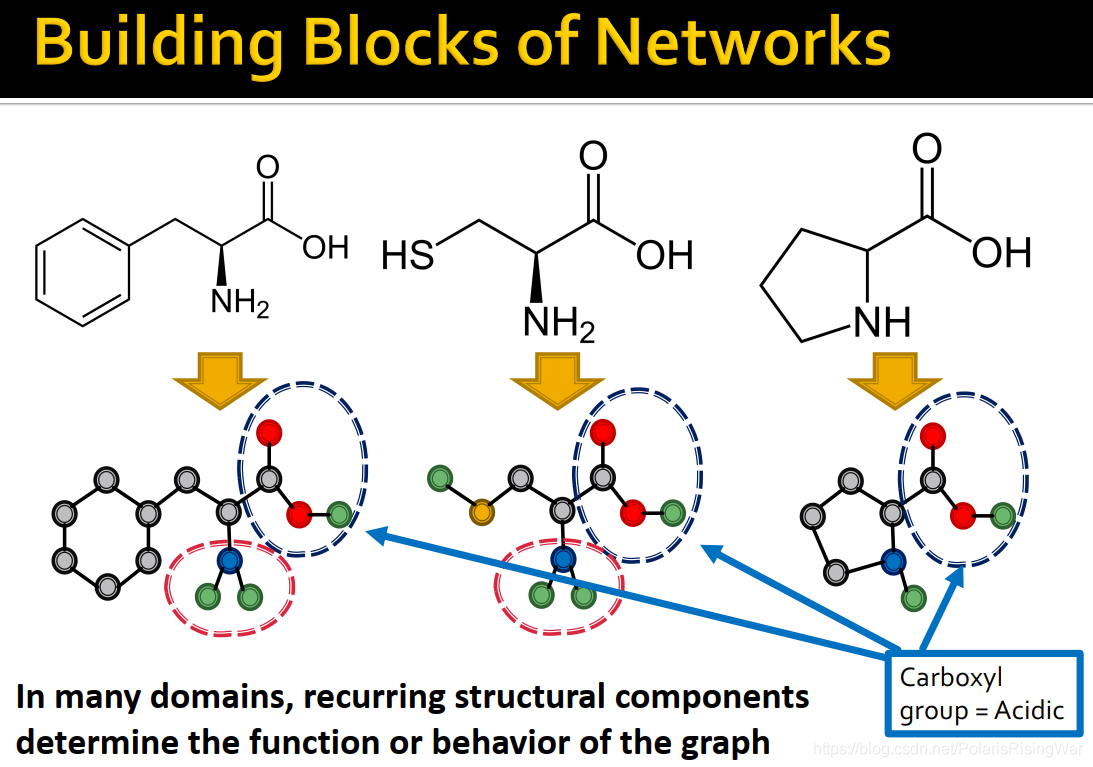

- ����ͼ����ʽΪ��:�����Ȼ�(subgraph)�ķ���(graph)������(group)

2. Subgraph and Motifs

2.1 Defining Subgraphs and Motifs

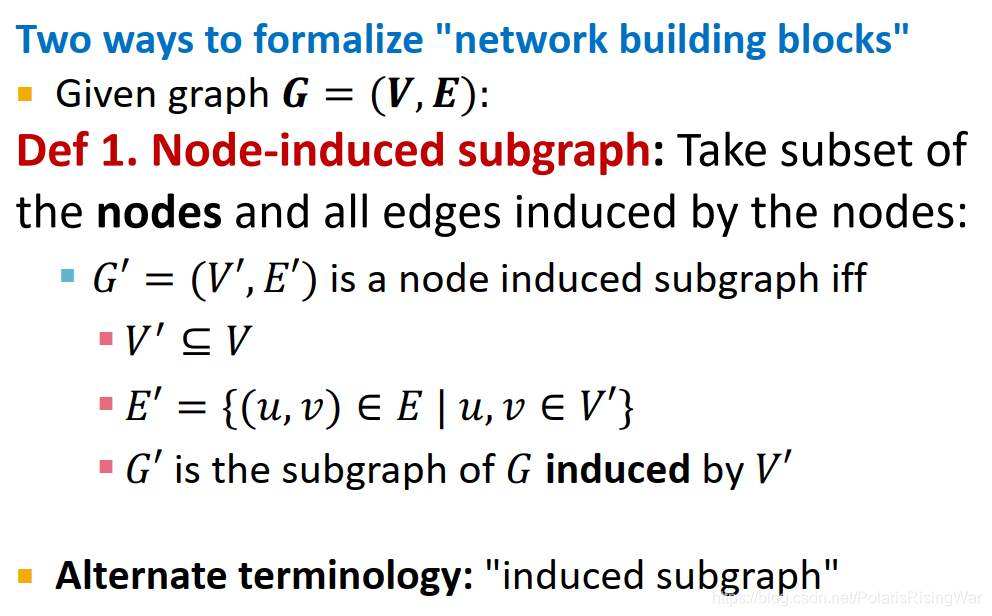

- subgraph����

����ͼ G = ( V , E ) \mathbf{G}=(\mathbf{V},\mathbf{E}) G=(V,E) �����ֶ�����subgraph�ķ�ʽ:- node-induced subgraph / induced subgraph:���ö���

ͼ�е�һ���ڵ��Ӽ�+ԭͼ�������ڵ㶼�ڸýڵ��Ӽ��ڵı�(��edges induced by the nodes)

G �� = ( V �� , E �� ) G'=(V',E') G��=(V��,E��) �� node induced subgraph,���ҽ���:

V �� ? V V'\subseteq V V��?V

E �� = { ( u , v ) �� E ? �O ? u , v �� V �� } E'=\{(u,v)\in E\ |\ u,v\in V'\} E��={(u,v)��E?�O?u,v��V��} ʱ

G �� G' G�� is the subgraph of G induced by V �� V' V��

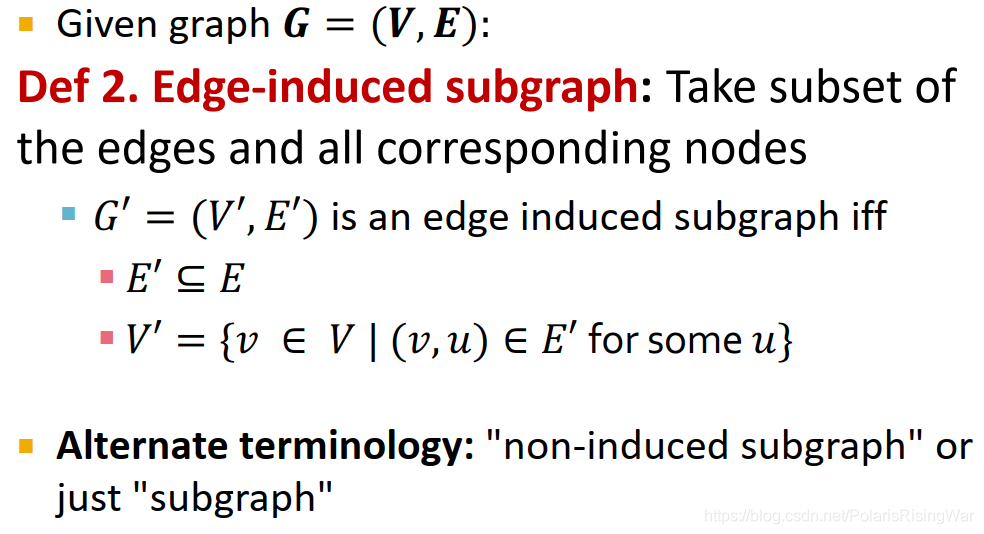

- edge-induced subgraph / non-induced subgraph / subgraph

ͼ�е�һ�����Ӽ�+���Ӽ��Ķ�Ӧ�ڵ�

G �� = ( V �� , E �� ) G'=(V',E') G��=(V��,E��) �� edge induced subgraph,���ҽ���:

E �� ? E E'\subseteq E E��?E

V �� = { v �� V ? �O ? ( v , u ) �� E �� ?for?some? u } V'=\{v\in V\ |\ (v,u)\in E'\ \text{for some}\ u\} V��={v��V?�O?(v,u)��E��?for?some?u} ʱ(��û����,��˼Ӧ���ǰ�����Щ�ߵ�ȫ���ڵ㡣����˵ѡ�˱�֮��ڵ���Ȼ��ȷ����,������non-induced���ο�2)

- ����ʹ�����ֶ���ȡ������������

���ڻ�ѧ�����г�ʹ��node-induced����(������),��֪ʶͼ���г���edge-induced����(���ǹ��ĵ��Ǵ�������ϵ�ı�)��

- node-induced subgraph / induced subgraph:���ö���

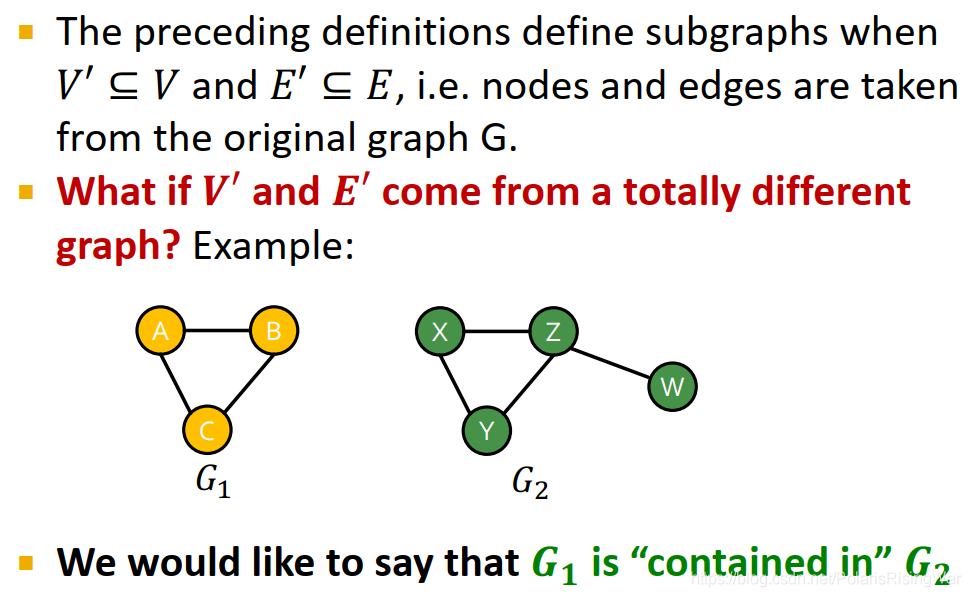

- ǰ�Ķ�subgraph�Ķ��嶼��Ҫ

V

��

?

V

V'\subseteq V

V��?V ��

E

��

?

E

E'\subseteq E

E��?E,��

V

��

V'

V�� ��

E

��

E'

E�� ������ԭͼ������ڵ�ͱ߳��Բ�ͬ��ͼ�����ж�Ӧ��ϵ,����ͼ��ʾ,���dz��������Ϊ

G

1

\mathbf{G}_1

G1? is contained in

G

2

\mathbf{G}_2

G2?

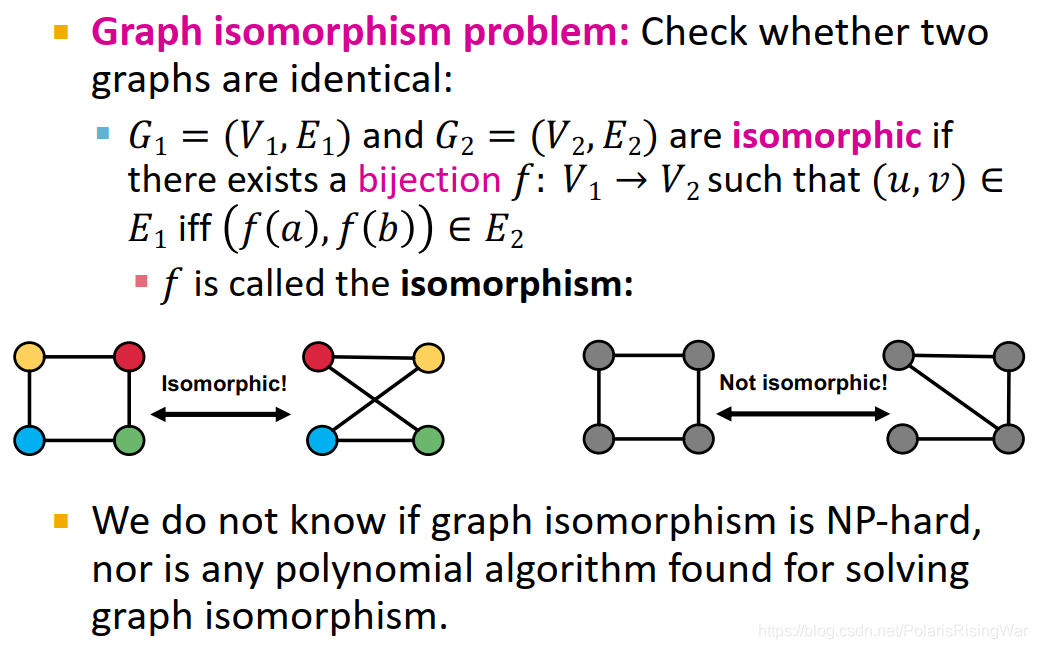

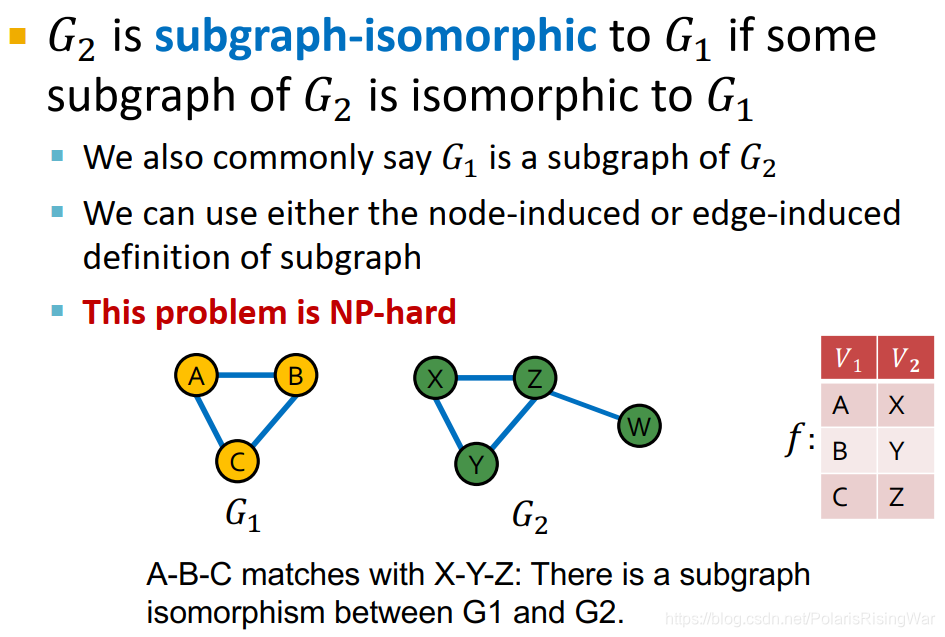

- graph isomorphismͼͬ��

��� G 1 G_1 G1? �� G 2 G_2 G2? ����˫���ϵ f : V 1 �� V 2 f:V_1\rightarrow V_2 f:V1?��V2?,ʹ�õ��ҽ��� ( f ( u ) , f ( v ) ) �� E 2 \big(f(u),f(v)\big)\in E_2 (f(u),f(v))��E2? ʱ, ( u , v ) �� E 1 (u,v)\in E_1 (u,v)��E1?(�� G 1 G_1 G1? �еĽڵ���һһӳ�䵽 G 2 G_2 G2? �еĽڵ�,ʹ�ڵ�֮���Ӧ�ı߹�ϵҲ��ͬʱӳ�䵽��һ��ͼ����Ӧ�Ľڵ�֮��)�����dz�����ͼͬ����

ͼ��ab��uvд���ˡ�

����ͼ��ͼ��ʾ(�ڵ���ɫ��ʾӳ���ϵ)��

��Ϊ�ڵ�û�й̶�˳��,�������Dz�֪���ڵ�֮������ôӳ���,����������Ҫ�������п��ܡ�

����ͼ�Ƿ�ͬ���������Ƿ�NP-hardδ֪,������û�����polynomial algorithm��

- subgraph isomorphism��ͼͬ��

��� G 2 G_2 G2? ����ͼ�� G 1 G_1 G1? ͬ��,���dz� G 2 G_2 G2? is subgraph-isomorphic to G 1 G_1 G1?��

���ǿ���ʹ��node-induced��edge-induced subgraph���塣

��һ������NP-hrad�ġ�

�ڵ�֮���ӳ�䲻��Ψһ�� - subgraph����

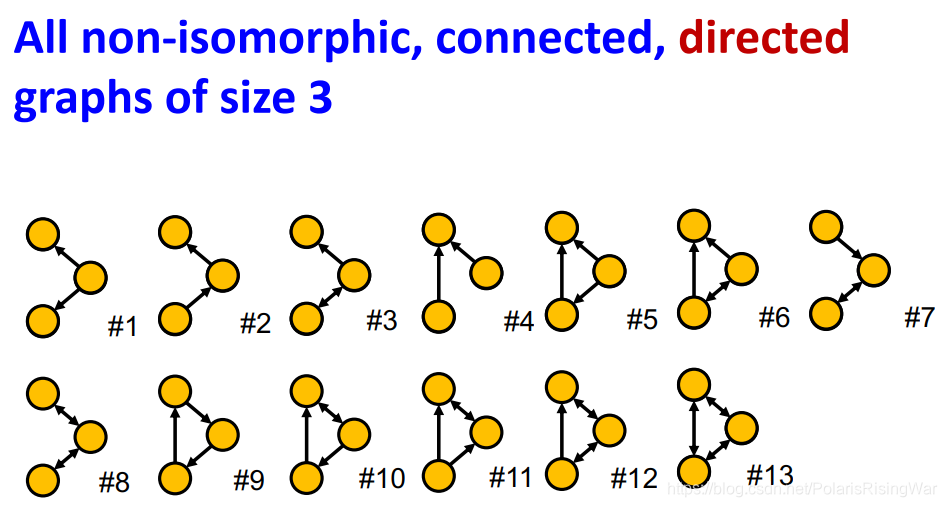

- ���з�ͬ���ġ�connected�������4���ڵ��ͼ:

- ���з�ͬ���ġ�connected�������3���ڵ��ͼ:

һ�����Ҳ��4-5���ڵ���

- ���з�ͬ���ġ�connected�������4���ڵ��ͼ:

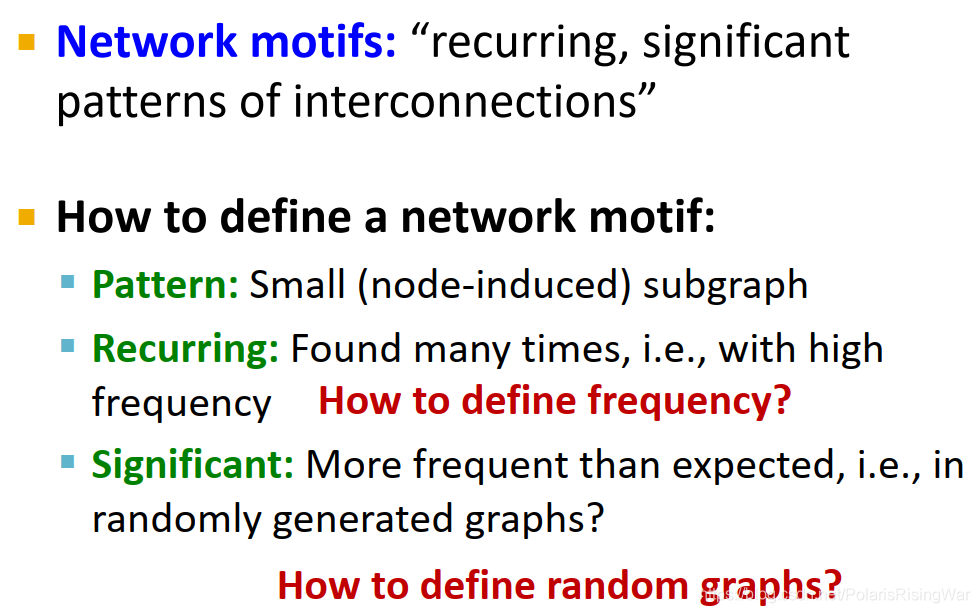

- network motifs

����:recurring, significant patterns of interconnections- pattern:��node-induced subgraph

- recurring:���ֺܶ��,������Ƶ�ʸ�(���½�������ζ���Ƶ��)

- signifant:��Ԥ��(����������ɵ�ͼ��)���ֵ�Ƶ�ʸ�(���½�������ζ������ͼ)

- motif����:

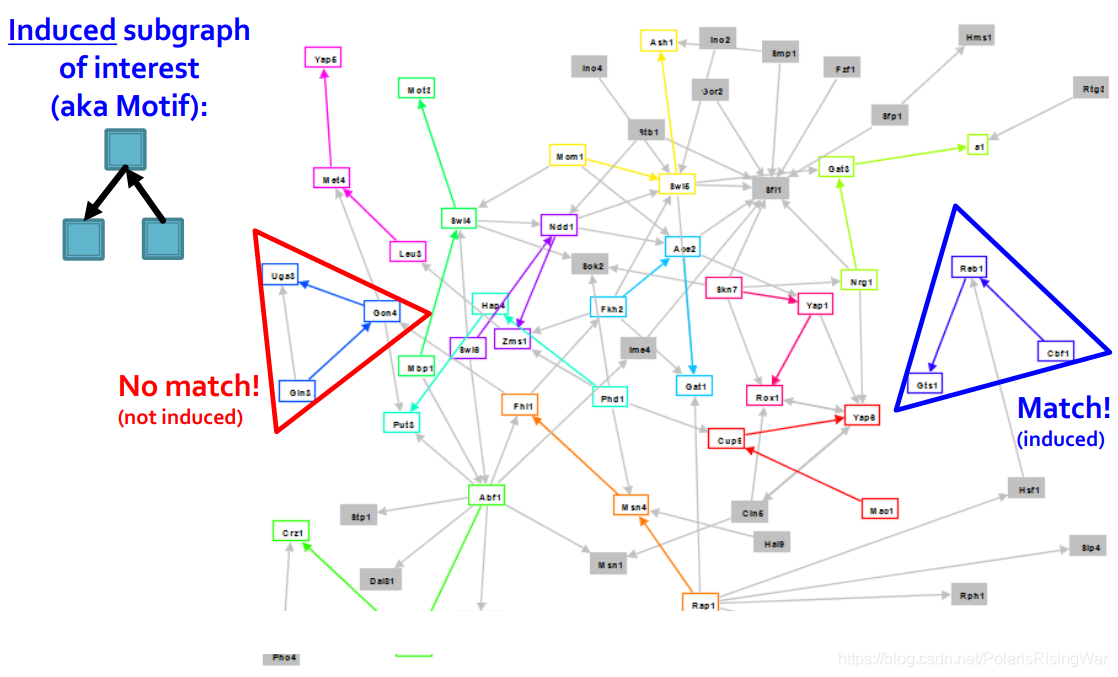

��ͼ��ʾ:���ϽǾ�������������Ȥ��induced subgraph(motif)���������ڵ�induced subgraph����Ҫ��,�������ڲ���induced subgraph������Ҫ��

��ͼ��ʾ:���ϽǾ�������������Ȥ��induced subgraph(motif)���������ڵ�induced subgraph����Ҫ��,�������ڲ���induced subgraph������Ҫ�� - motif������:

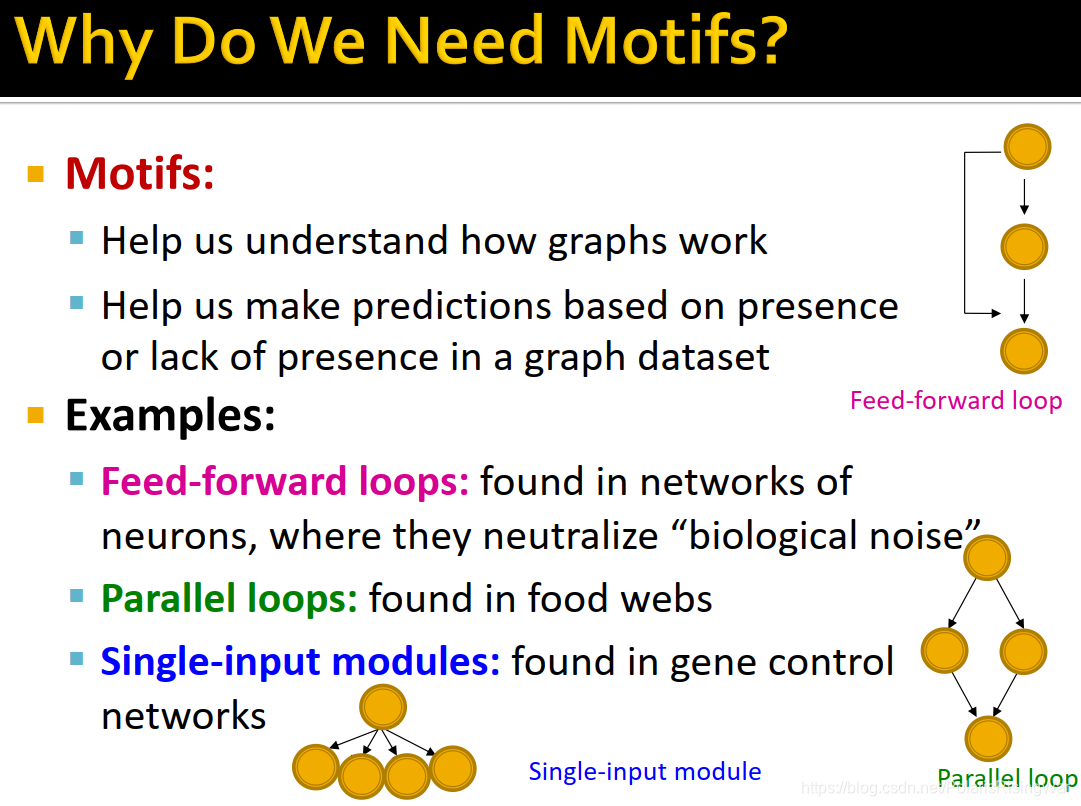

?1. ���������˽�ͼ�Ĺ������ơ�

?2. �������ǻ���ͼ���ݼ���ij��subgraph�ij��ֺ�û�г���������Ԥ��3��

����:- feed-forward loops:��Ԫ�����������к�biological noise

- parallel loops:ʳ������(������������ͬһ������Ϊʳ����ͬһ�������������)

- single-input modules:�����������4 ��

- feed-forward loops:��Ԫ�����������к�biological noise

- subgraph frequency

- ͼ�����subgraph frequency����

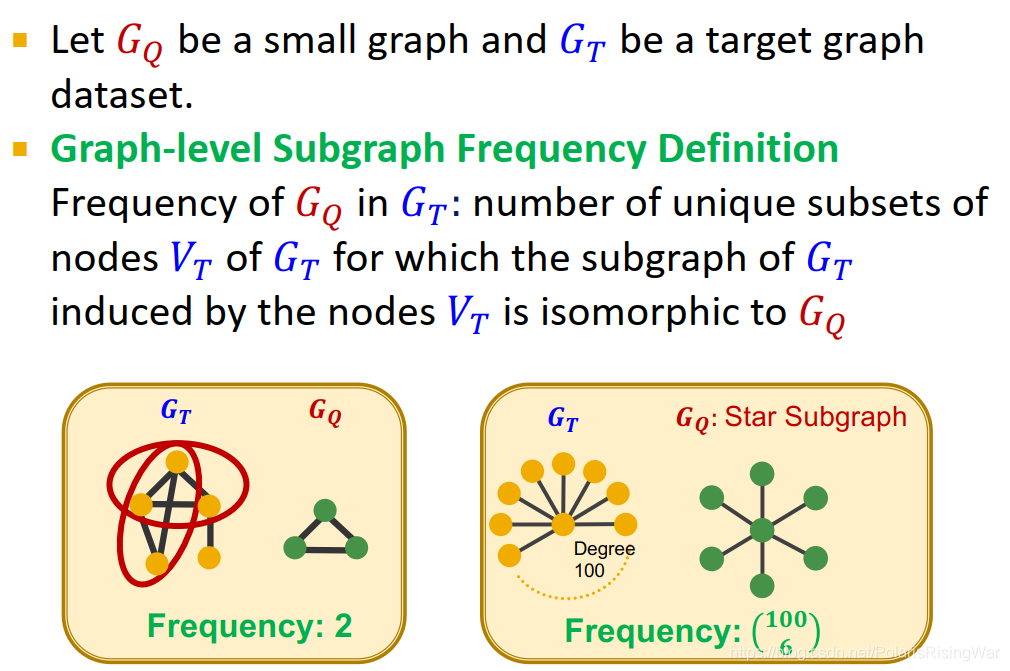

�� G Q G_Q GQ? ��һ��Сͼ, G T G_T GT? ��Ŀ��ͼ���ݼ���

G Q G_Q GQ? �� G T G_T GT? �е�Ƶ��: G T G_T GT? ��ͬ�Ľڵ��Ӽ� V T V_T VT? ����Ŀ( V T V_T VT? induce�� G T G_T GT? ��subgraph�� G Q G_Q GQ? ͬ��)

������ͼ��frequencyΪ2(��Ȧ�е����ֽڵ��Ӽ�),��ͼ�е�frequencyΪ C 100 6 C_{100}^6 C1006?(ͼ�е��������д�����Բο�5)

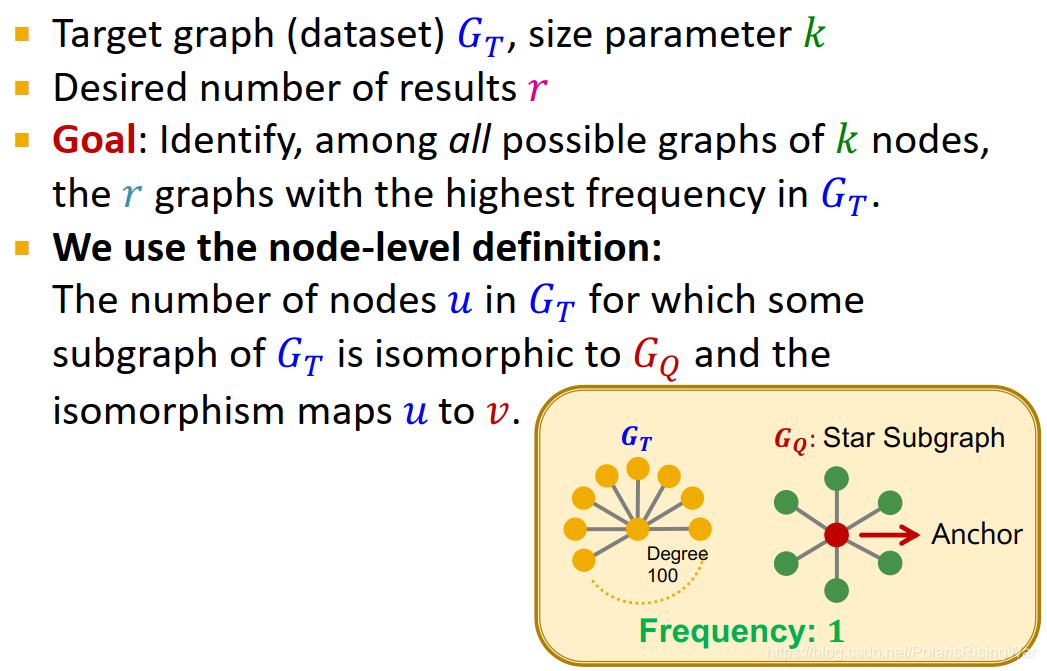

- �ڵ㼶���subgraph frequency����

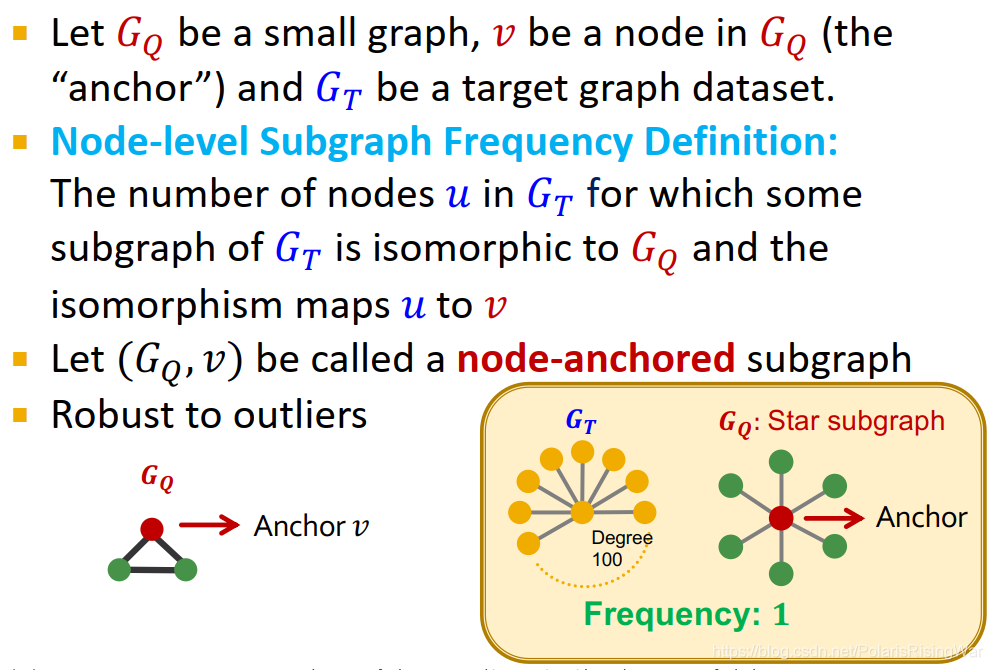

�� G Q G_Q GQ? ��һ��Сͼ, v v v ����һ���ڵ�(anchor), G T G_T GT? ��Ŀ��ͼ���ݼ���

G Q G_Q GQ? �� G T G_T GT? �е�Ƶ��: G T G_T GT? �нڵ� u u u ����Ŀ( G T G_T GT? ��subgraph�� G Q G_Q GQ? ͬ��,��ͬ��ӳ�� u u u �� v v v ��)

( G Q , v ) (G_Q,v) (GQ?,v) ��node-anchored subgraph

���ֶ�����쳣ֵ�Ƚ�³��������ͼ����,star subgraph�����Ľڵ�Ϊanchor,���� G T G_T GT? �е�frequency����1;��������Χ�ڵ���Ϊanchor,����frequency����100

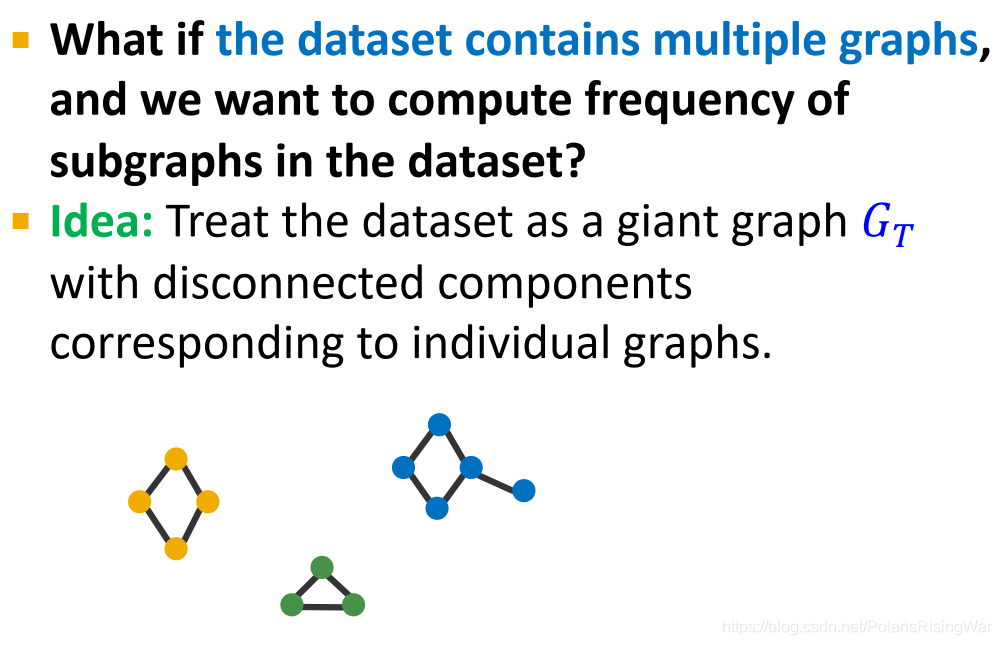

- ������ݼ��а������ͼ,���ǿɽ�����Ϊһ������ͼ

G

T

G_T

GT?(����disconnected components,����ɲ��ֶ�Ӧ����ͼ)

- ͼ�����subgraph frequency����

2.2 Determining Motif Significance

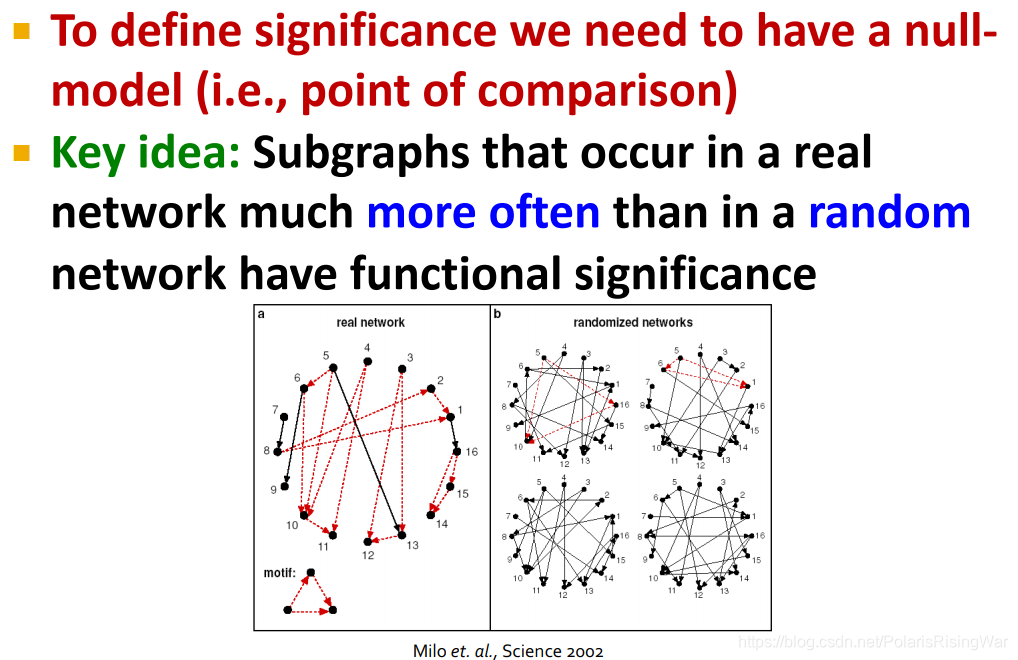

- ����������Ҫ����null-model

����˼��:����ʵ�����б�����������г��ָ�Ƶ����subgraph��functional significance

ͼ������(��ͼ����):Zweig K A . Milo et al. (2002): Network Motifs: Simple Building Blocks of Complex Networks[M]. 2019. - �������ͼ:Erd?s�CR��nyi (ER) random graphs

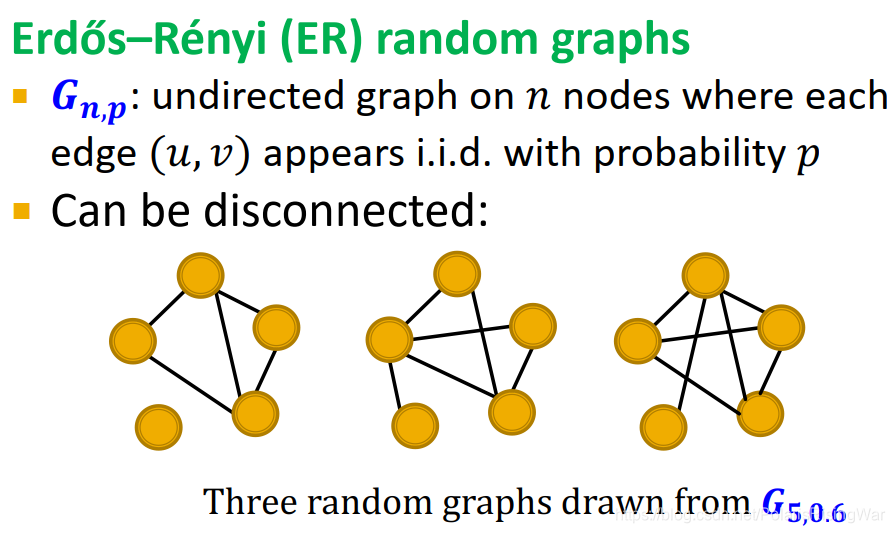

G n , p G_{n,p} Gn,p?: n n n ���ڵ������ͼ,ÿ���� ( u , v ) (u,v) (u,v) ��Ƶ�� p p p ����ͬ�ֲ����֡�

������disconnected:

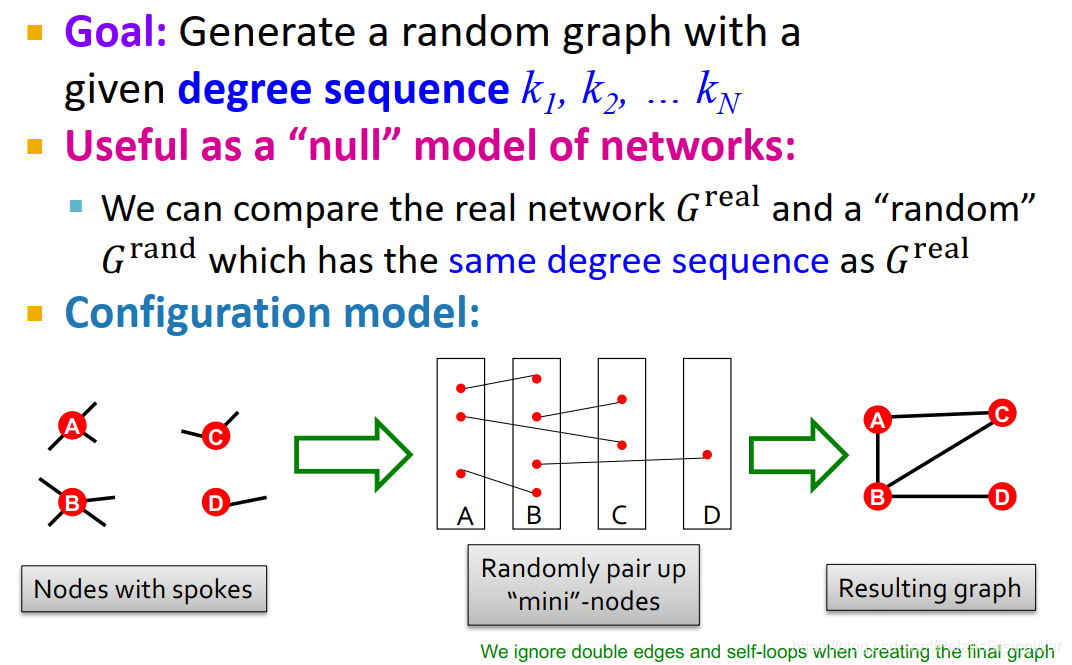

- ��ģ��:configuration model

Ŀ��:���ո����������� k 1 , k 2 , . . . ? k N k_1,k_2,...\ k_N k1?,k2?,...?kN? �������ͼ��

��Ϊ�����null model������,���Խ���ʵͼ�����������ͬ�������е����ͼ���ȡ�

configuration model������ͼ��ʾ:�Խڵ��ϵı߽����������,�õ����յĽ��ͼ(��������ر�(multiple edges)6���Ի������,�����亱��,���Կ���ֱ�Ӻ��ԡ���ͼ��A-B�ڵ�֮�������double edge,�������Ľ��ͼ�оͺ�����,����Ϊһ����������)

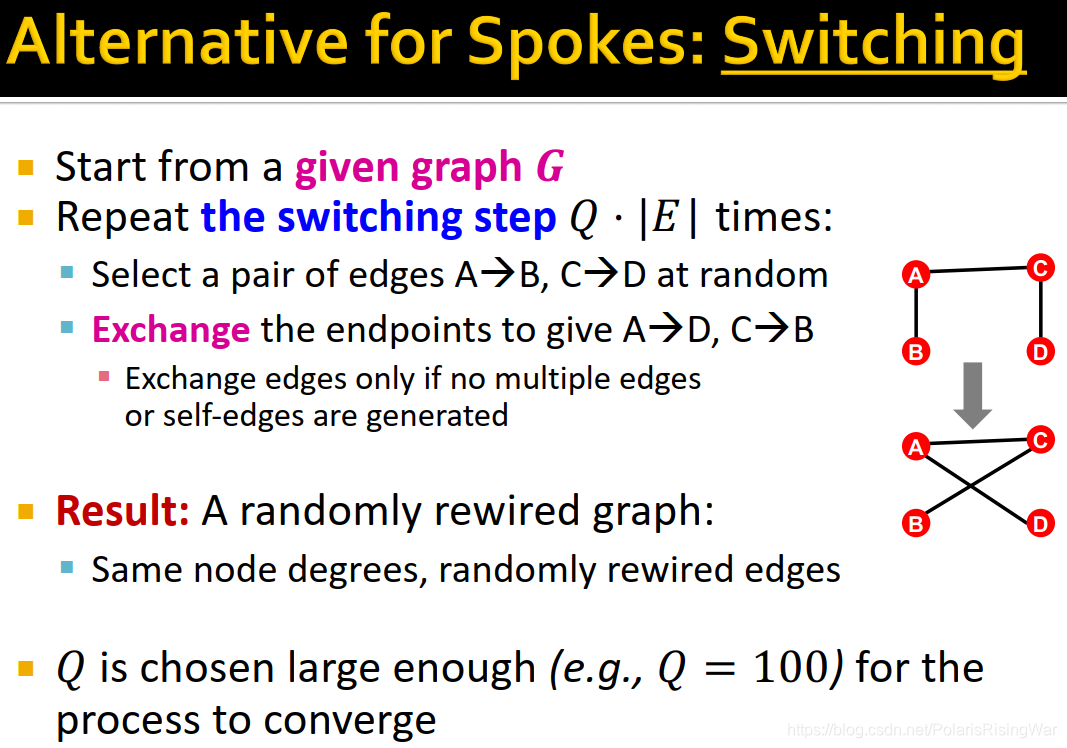

- ��������ͼ���ֽڵ����������,������ʹ��switching����:

�Ը���ͼ G G G,�ظ�switching���� Q ? �O E �O Q\cdot|E| Q?�OE�O ��:

?1. ���ѡȡһ�Ա�A��B,C��D

?2. �����˵�7 ʹA��D,C��B(�������ر��Ի�������ʱ���н�������)

�õ�randomly rewired graph(��ԭͼ�Ľڵ������ͬ)

Q Q Q ���㹻��(��100)��ʹ�����������8

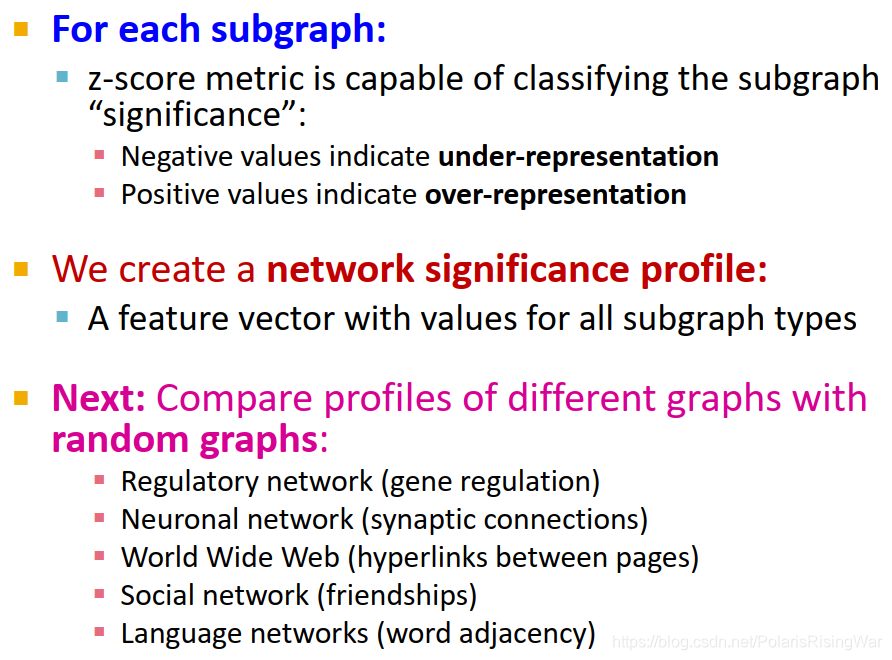

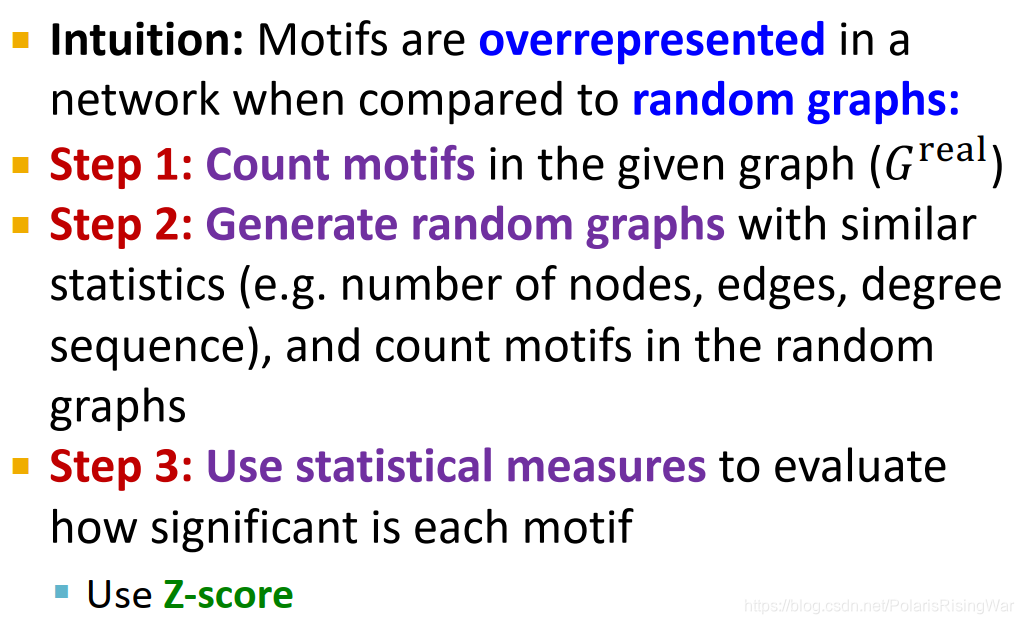

- motif significance overview

����motif����ʵ�������Ƿ�������ͼ��overrepresent�IJ���:- step1:����ʵͼ����motif�ĸ���

- step2:�����������ʵͼ����ͬͳ����(��ڵ������������������е�)�����ͼ,����Щ���ͼ����motif�ĸ���

- step3:ʹ��ͳ��ָ�����ÿһmotif�Ƿ�����

��Z-score

- Z-score for statistical significance

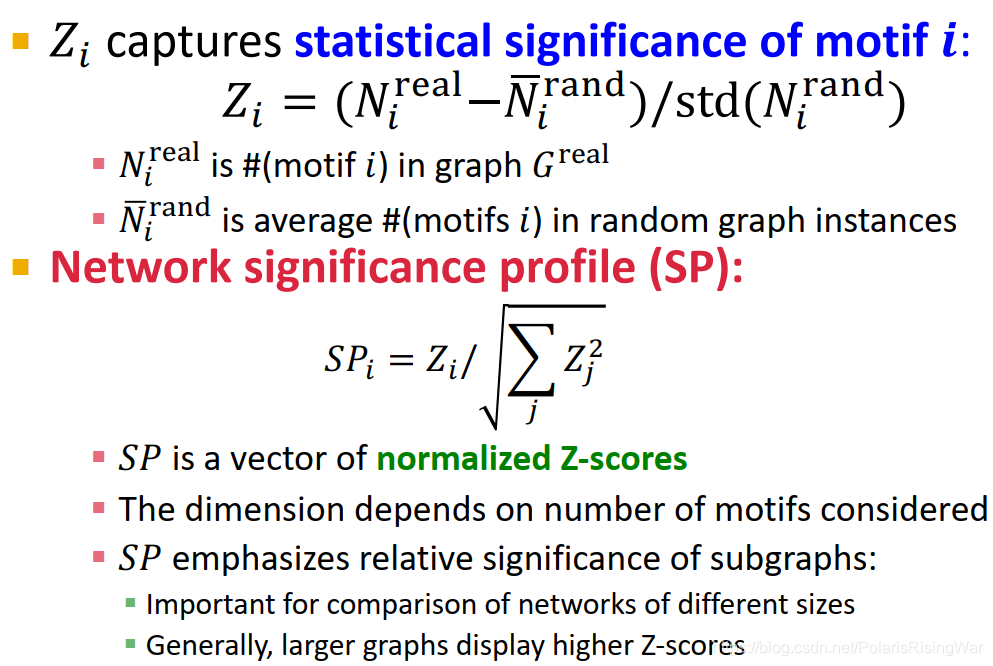

Z i Z_i Zi? ����motif i i i ��statistical significance:

Z i = ( N i r e a l ? N �� i r a n d ) / std ( N i r a n d ) Z_i=(N_i^{real}-\overline{N}_i^{rand})/\text{std}(N_i^{rand}) Zi?=(Nireal??Nirand?)/std(Nirand?)

���� N i r e a l N_i^{real} Nireal? ����ʵͼ��motif i i i �ĸ���, N �� i r a n d \overline{N}_i^{rand} Nirand? �����ͼʵ����motif i i i ��ƽ��������

0����˵��ʵͼ�����ͼ��motif���ֵ�һ���ࡣ����ֵ����29 ʱ���������ض�����������١�

network significance profile (SP):

S P i = Z i / �� j Z j 2 SP_i=Z_i/\sqrt{\sum_jZ_j^2} SPi?=Zi?/j��?Zj2??

S P SP SP �ǹ�һ����Z-score����,��ά��ȡ�������ǿ��ǵ�motif��������

S P SP SP ǿ��subgraph�������Ҫ��:�ڱȽϲ�ͬ��С������ʱ����Ҫ,��Ϊһ����˵,��ͼ����ָ��ߵ�Z-score9��

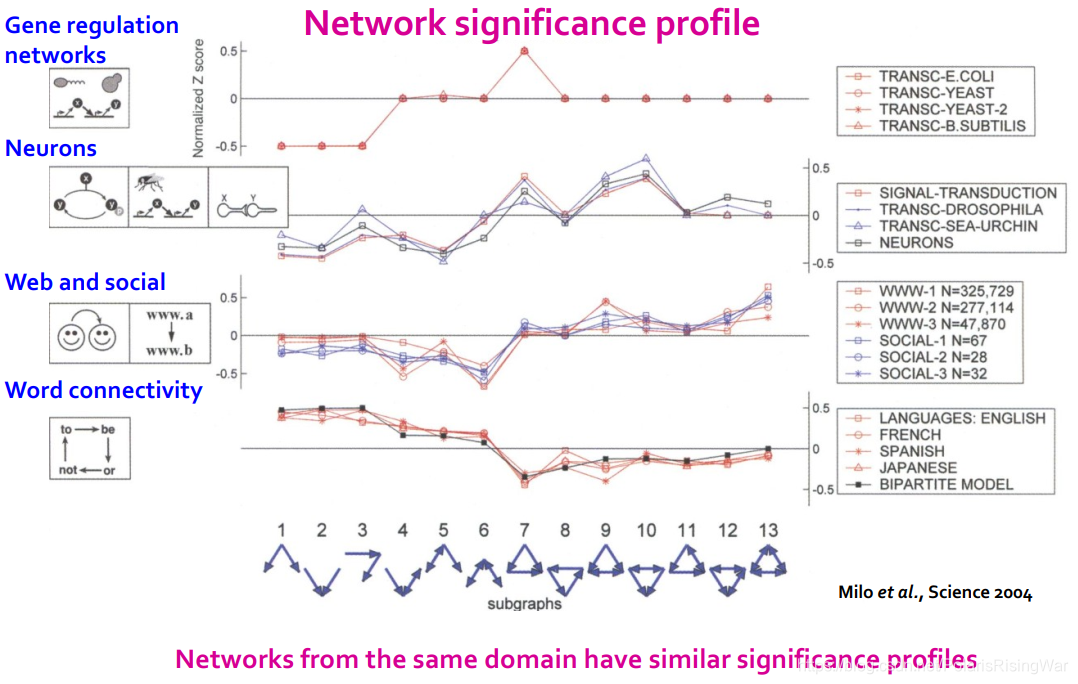

- significance profile

��ÿ��subgraph,Z-scoreָ������ڷ���subgraph significance:������ζ��under-representation,������ζ��over-representation��

network significance profile�Ǿ�������subgraph��С�ϵ�ֵ��feature vector��

�������Ϳ��ԱȽ����ͼ�Ͳ�ͬͼ�ϵ�profile�ˡ�

��ͬ�������: - significance profileʾ��:

��������������������Ƶ�SP������ͨ��motif frequency���ж����繦�ܡ����罻�����е�subgraph6�١�����subgraph13��,��Ϊһ���˺���ͬʱ�����˱��ֽ��ܺ��ѹ�ϵ���������˲�������ʶ,ÿ�ܻ�Ҫ������2�ο��ȡ��Ͼ����������ʶ�Ժ�Ϳ���һ�ܳ���ֻԼ1�ο����ˡ�

��������������������Ƶ�SP������ͨ��motif frequency���ж����繦�ܡ����罻�����е�subgraph6�١�����subgraph13��,��Ϊһ���˺���ͬʱ�����˱��ֽ��ܺ��ѹ�ϵ���������˲�������ʶ,ÿ�ܻ�Ҫ������2�ο��ȡ��Ͼ����������ʶ�Ժ�Ϳ���һ�ܳ���ֻԼ1�ο����ˡ� - ���motif�ܽ�:

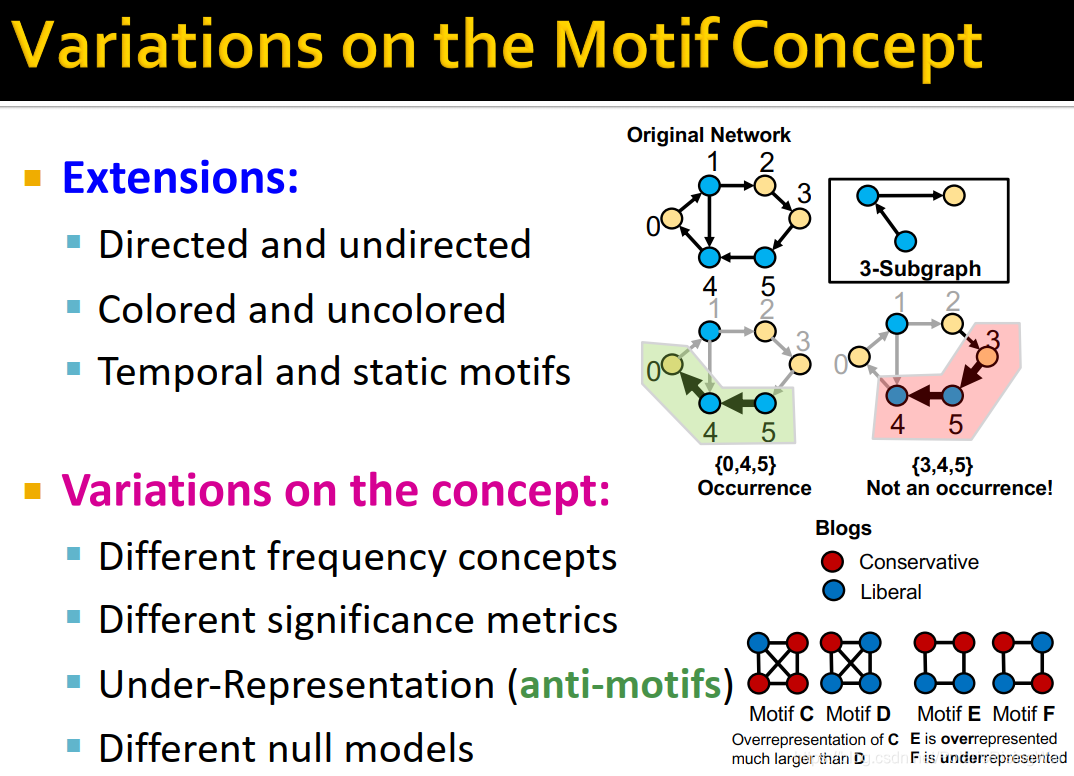

- motif����ı���:

����:����/����,colored/uncolored(Ӧ��ָ���ǽڵ�����,����ͼ�����Ͻ�045��motif���֡�345����motif���ֵ����),��̬/static motif

�����ϵı���:��ͬ��frequency�����ͬ��significanceָ�ꡢunder-representation (anti-motifs)(����ͼ�����½���ʾ)����ͬ��null models

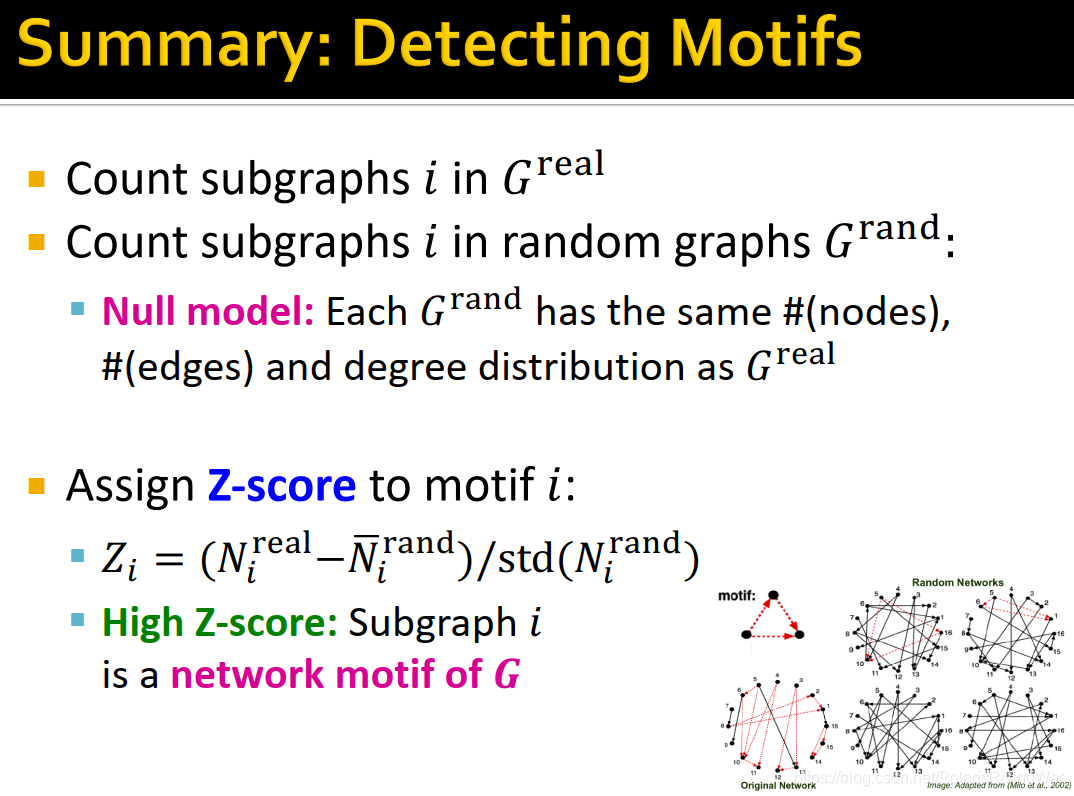

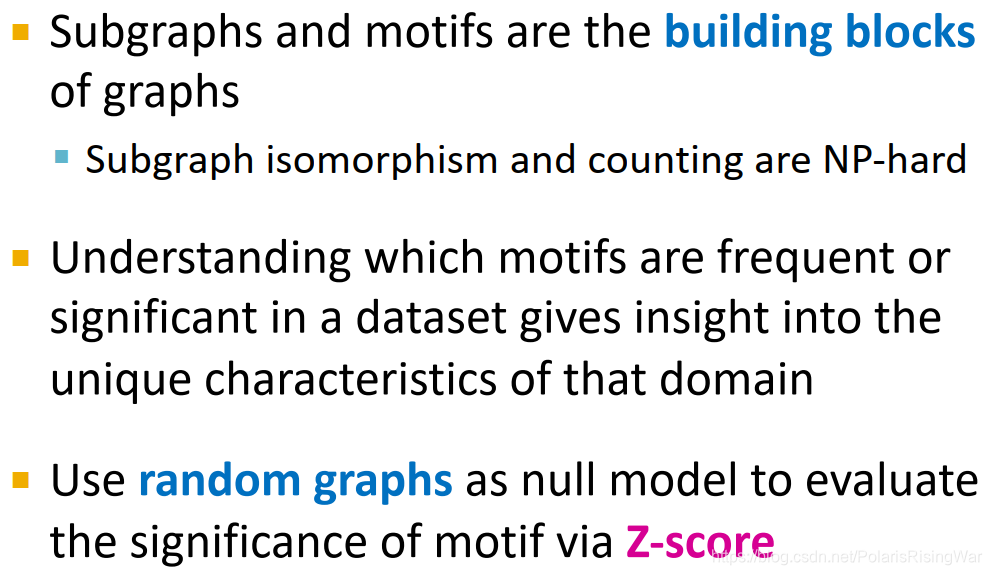

- motif�ܽ�:

subgraph��motif��ͼ����ɲ���,��ͼͬ���ͼ���������NP-hrad��

�������ݼ���motif��Ƶ������������,����ʹ�����˽������Ķ���������

ʹ�����ͼ��Ϊnull model��ͨ��Z-score����motif�������ԡ�

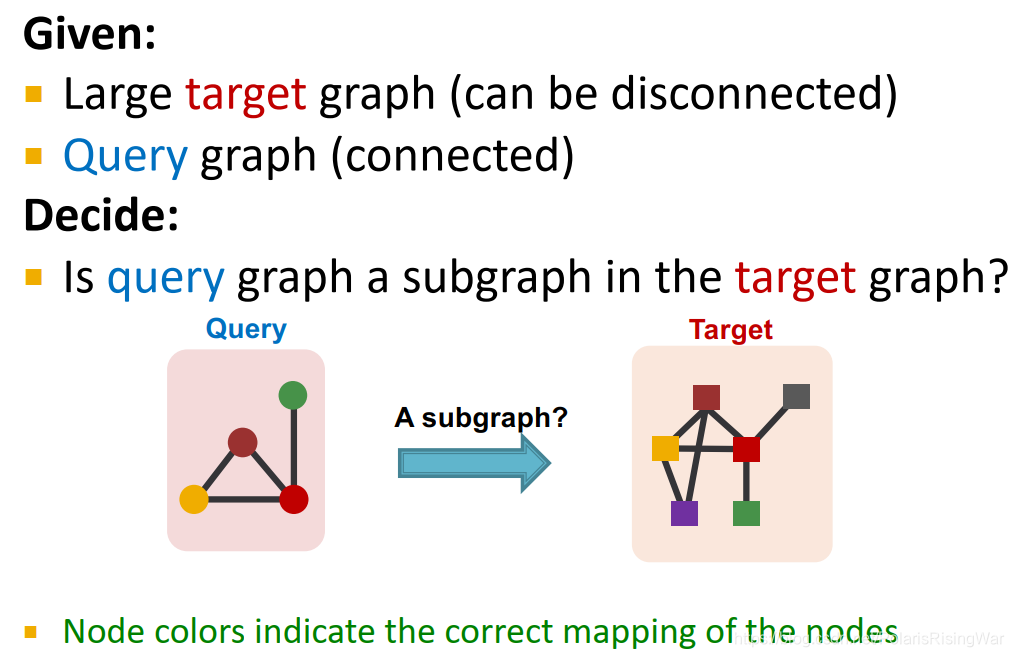

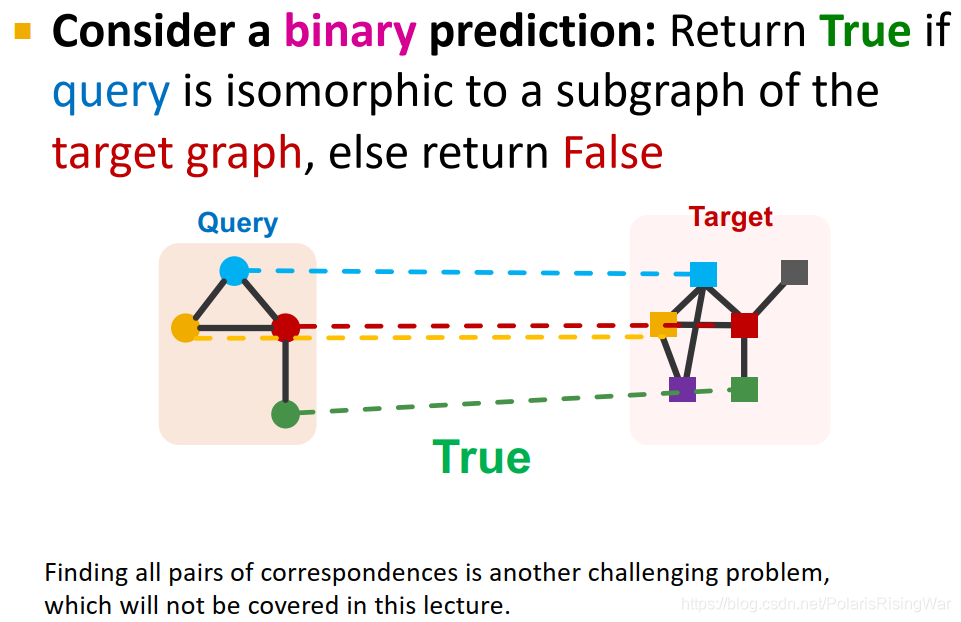

3. Neural Subgraph Matching / Representations

-

subgraph matching11

�������target graph(������disconnected),query graph(connected)

����:query graph�Ƿ���target graph�е���ͼ?

ʾ������ͼ(�ڵ���ɫ��ʾӳ���ϵ):

-

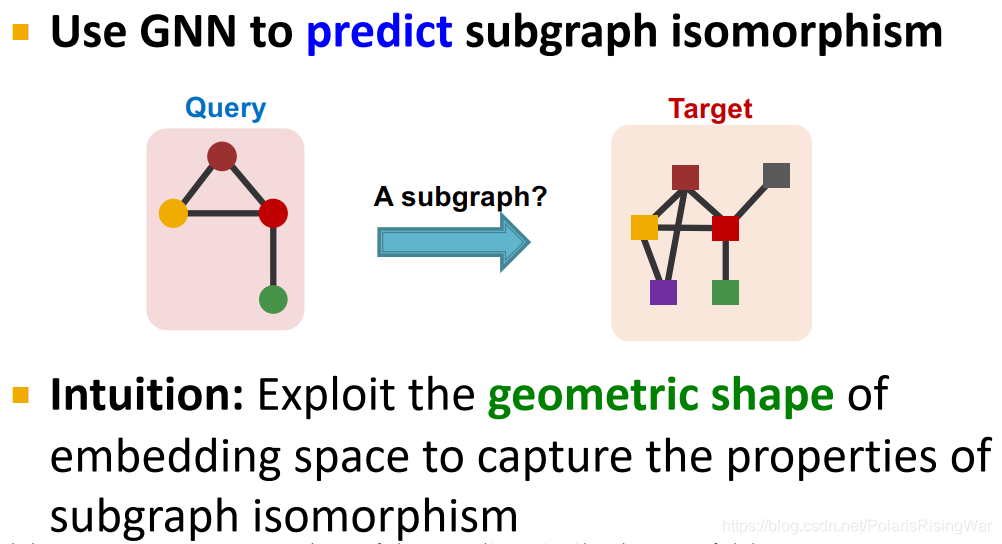

�ڱ��γ������Dz���combinatorial matching������,��������������Ԥ������,ʹ�û���ѧϰ�����������һ���⡣

ֱ��:����Ƕ����ļ�����״��������ͼͬ��������12

-

task setup

��ԪԤ������:����query�Ƿ���target graph��ͼͬ��

(ע������������ֻ��ע��Ԥ����������վ���,���Dz��ǡ�������Ľڵ�֮�����һһ��Ӧ�Ĺ�ϵ���γ��в���)

-

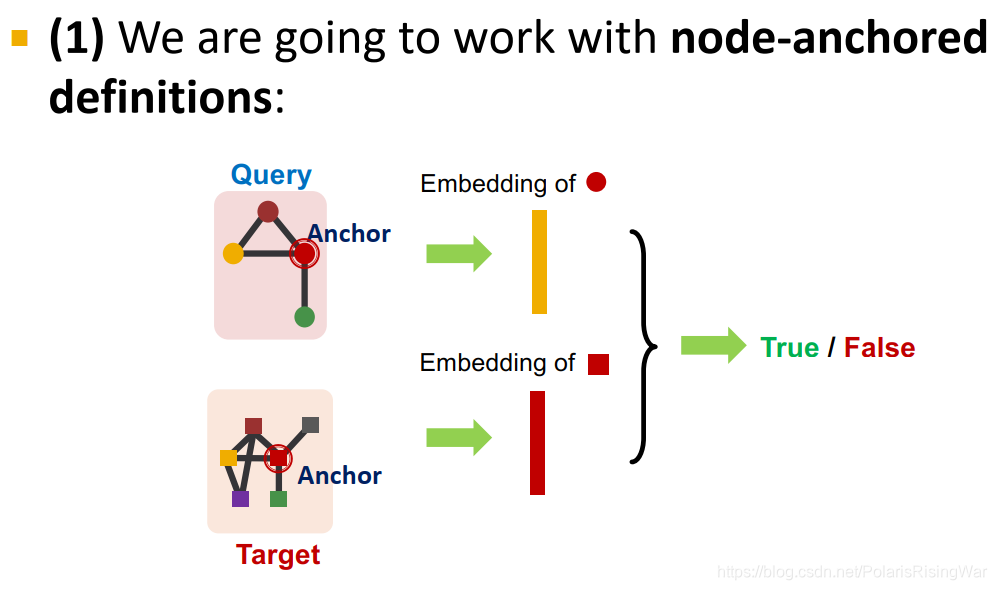

overview of the approach

����������ͼ��ʾ:��target graph��ɺܶ�neighborhoods,Ƕ��neighborhoods��query,��ÿ��neighborhood��query��ƥ��,�ж����Ƿ���ͼͬ��:

-

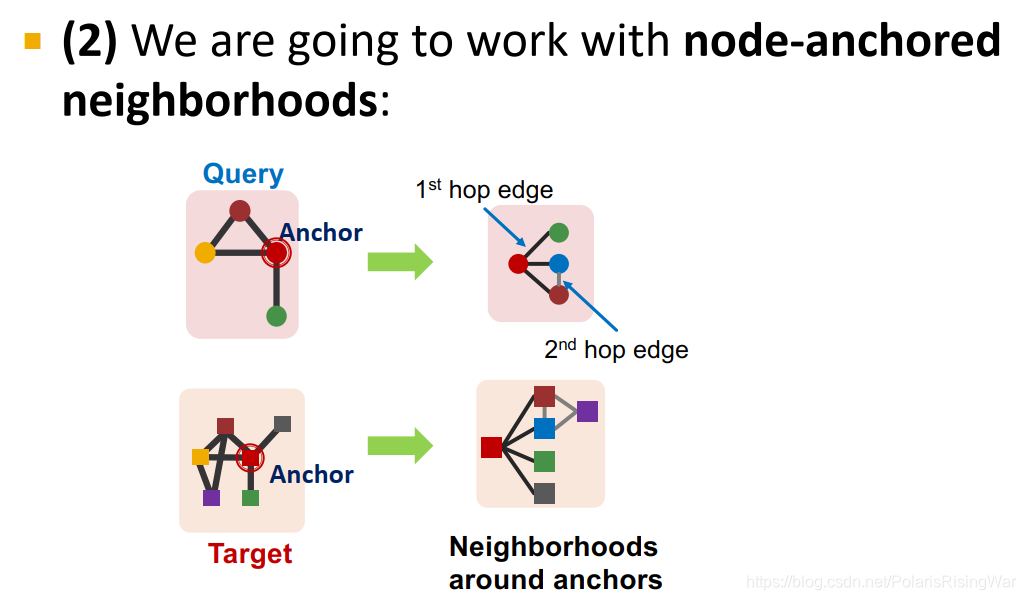

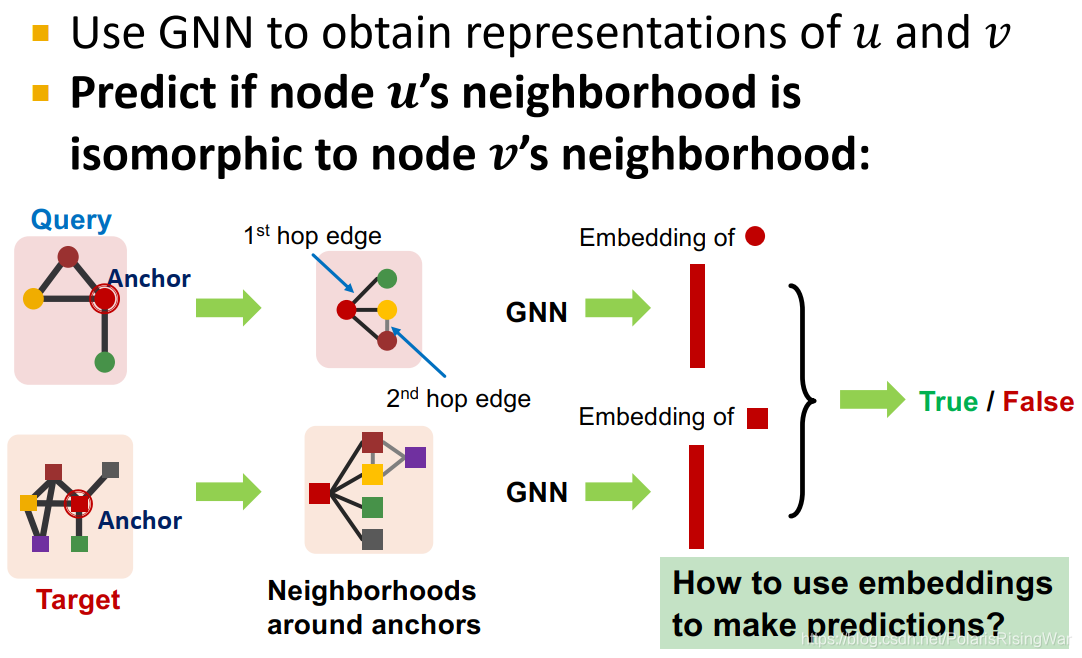

neural architecture for subgraphs

- ���ǽ�ʹ��node-anchored����,��anchor��Ƕ�����ж��Ƿ�ͬ��

- ʹ��node-anchored neighborhoods:

��ͼ��Ӧ���ǰ���ͼ�Ļ�ɫ�㻭����ɫ��

��GNN����anchor���ھӵõ���Ƕ��,Ԥ�� u u u ���ھ��Ƿ��� v v v ���ھ�ͬ��(ͼ��Ӧ�������˶����ھӵ���˼):

- ���ǽ�ʹ��node-anchored����,��anchor��Ƕ�����ж��Ƿ�ͬ��

-

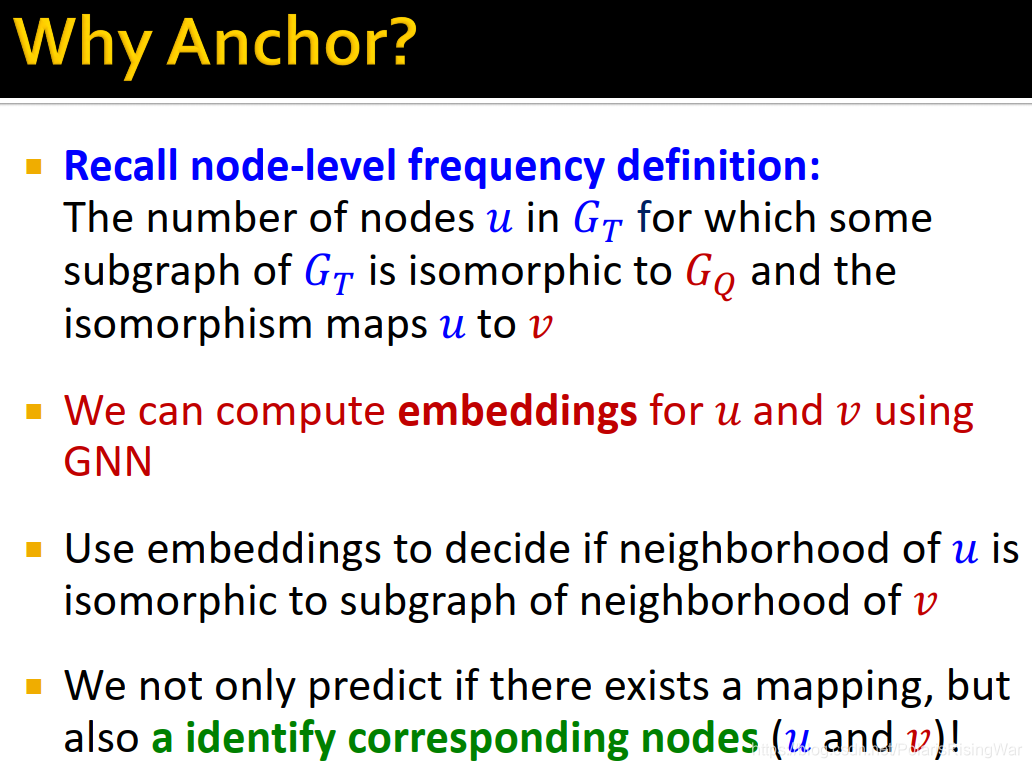

ΪʲôҪʹ��anchor��?

����node-level frequency definition��������Ϊ���ǿ�����GNN����� u u u �� v v v ��Ӧ��Ƕ��,�Ӷ����Ե�֪ u u u ���ھ��Ƿ��� v v v ���ھ�ͬ��,�����Ϳ���Ԥ���Ƿ����anchor��ӳ���ϵ��ʶ�����Ӧ���ض��ڵ㡣

-

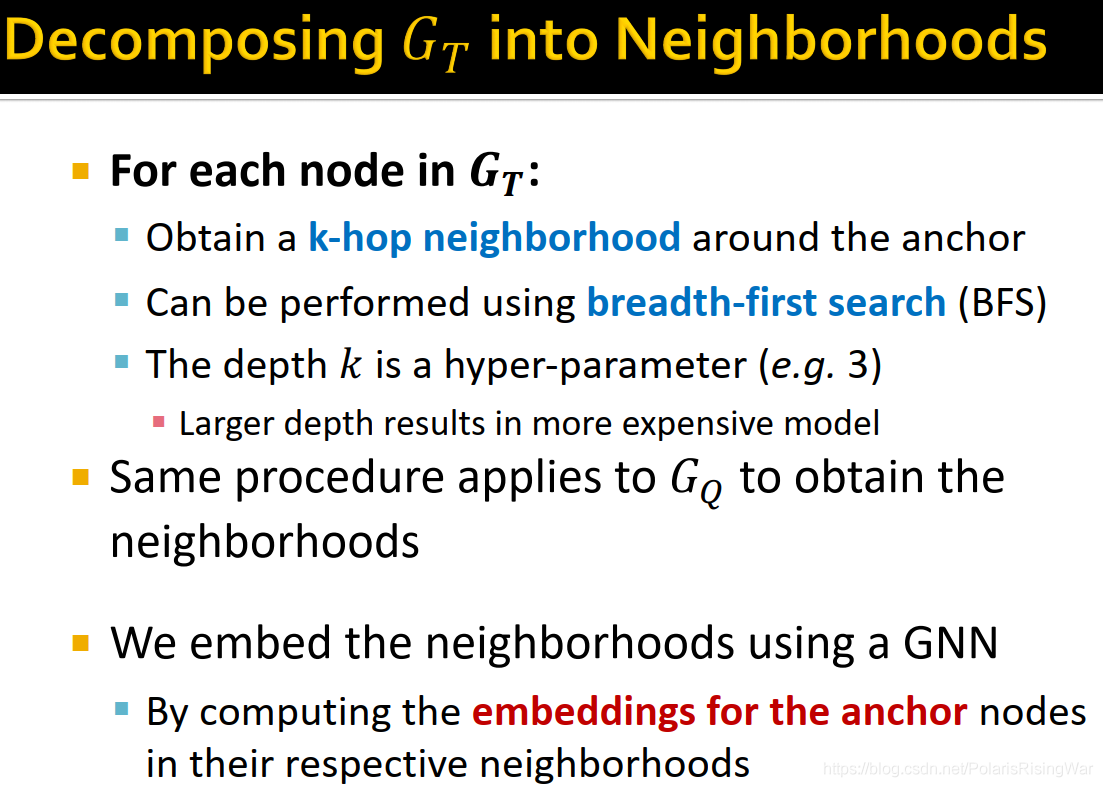

�� G T G_T GT? �ֽ�Ϊneighborhoods:

�� G T G_T GT? �е�ÿ���ڵ�(anchor),��ȡ��k���ھ�(����ͨ��BFS��ȡ)��k��һ������,kԽ��,ģ�ʹ���Խ�ߡ�

ͬ���Ĺ���ҲӦ���� G Q G_Q GQ?,ͬ���õ�neighborhoods��

����ͨ��GNN�õ�anchor node����neighborhood��embedding,Ҳ���ǵõ�����Щneighborhoods��Ƕ�롣

-

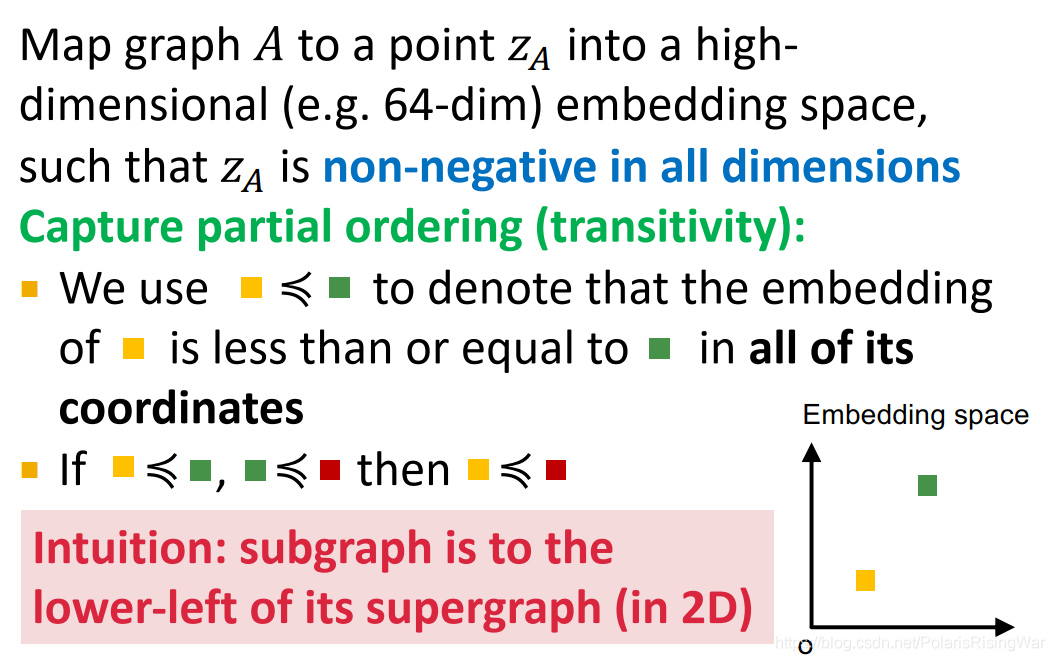

order embeddings space

��ͼ A A A ӳ�䵽��ά(��64ά)Ƕ����ĵ� z A z_A zA?,ʹ z A z_A zA? ����ά��Ԫ�ض��Ǹ���

���Բ���partial ordering(��ϵ�ɴ���)(�����ͼ):

��֮������Ƕ���άԪ��ȫ��С�ڵ��ڵĹ�ϵ����ʾsubgraph9 -

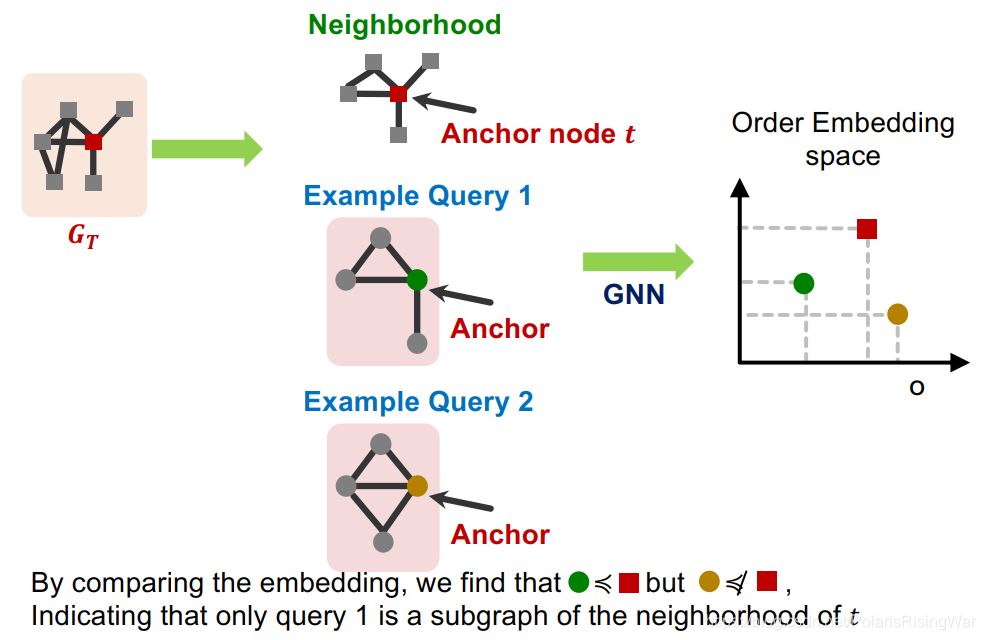

subgraph order embedding space

��ͼ:��order embedding space��ȫ��ά��С��target graph��anchorǶ��ľ�����subgraph��anchorǶ��(�ڶ�άǶ������,������target graph�����½�)

-

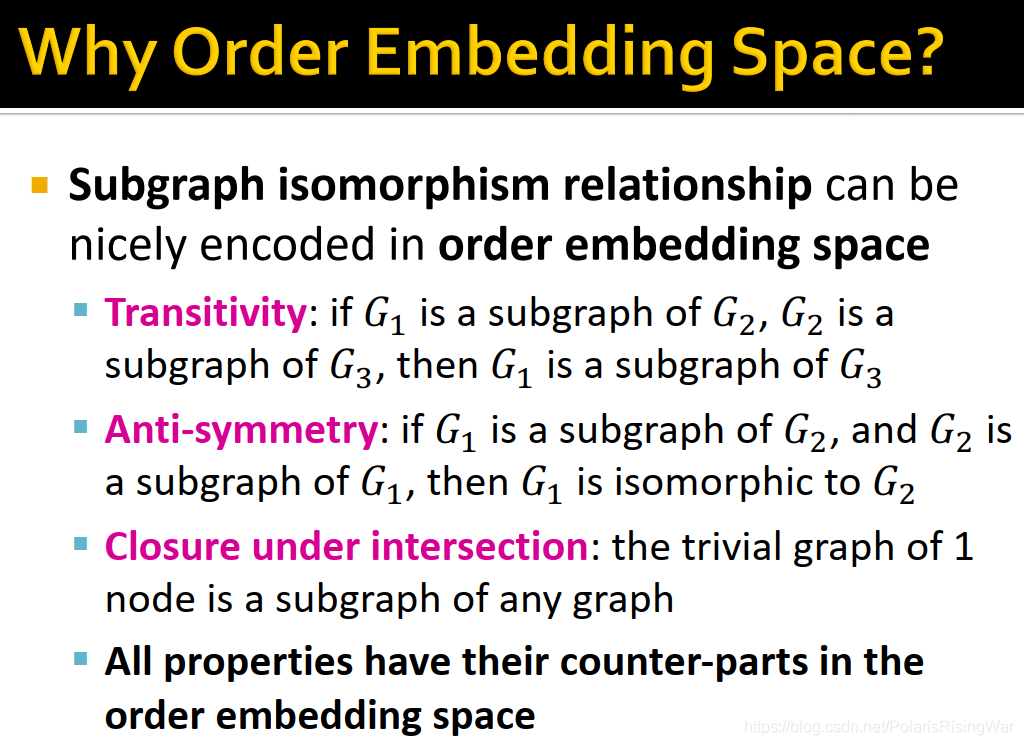

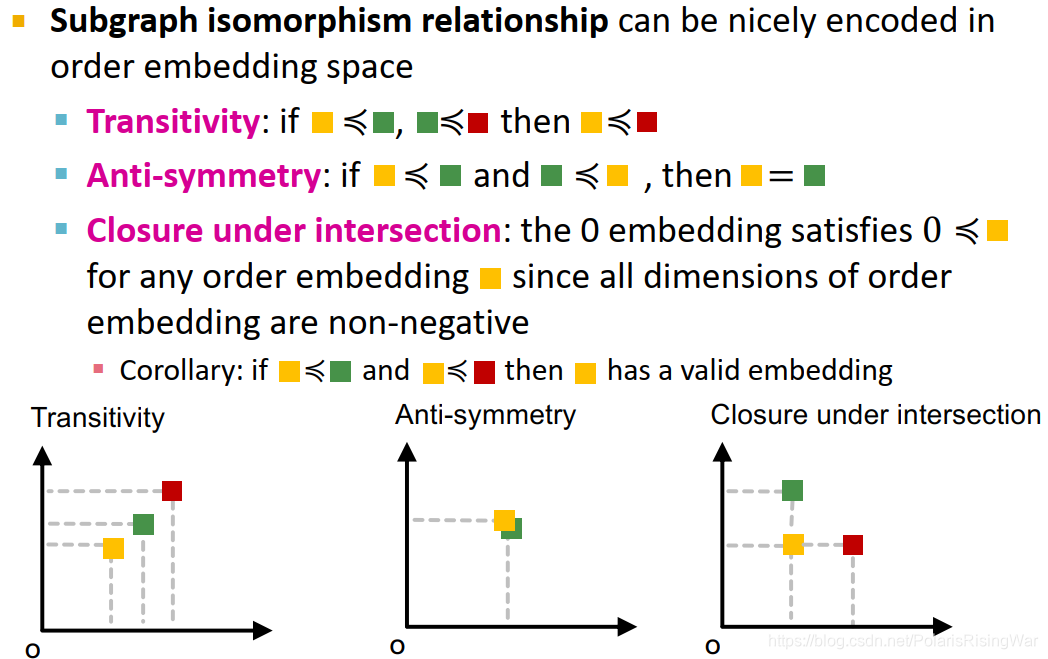

ΪʲôҪʹ��order embedding space?

��Ϊsubgraph isomorphism relationship���Ժܺõ���order embedding space�б���,Ҳ����˵order embedding�������������ʾͼ����subgraph�Ĺ�ϵ:

transitivity:

?ͼ��:��� G 1 G_1 G1? �� G 2 G_2 G2? ��subgraph, G 2 G_2 G2? �� G 3 G_3 G3? ��subgraph,�� G 1 G_1 G1? �� G 3 G_3 G3? ��subgraph

?Ƕ����:(��ͼ)

anti-symmetry:

?ͼ��:��� G 1 G_1 G1? �� G 2 G_2 G2? ��subgraph, G 2 G_2 G2? �� G 1 G_1 G1? ��subgraph,�� G 1 G_1 G1? �� G 2 G_2 G2? ͬ����

?Ƕ����:(��ͼ)

closure under intersection:

?ͼ��:1���ڵ��ͼ������ͼ��subgraph

?Ƕ����:(��ͼ)

Corollary����(��Ȼ�Ľ��(�����);)13

���valid embedding��ɶ�����Ҿ�û���� -

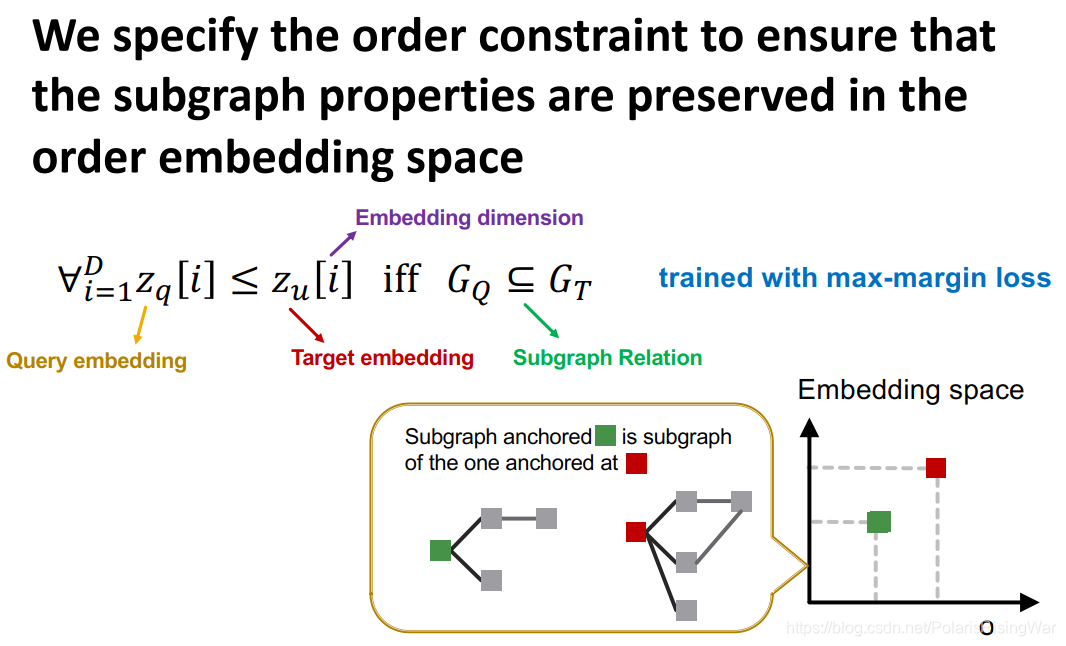

order constraint

������GNN��Ƕ��neighborhoods��������order embedding�ṹ,���������Ҫѧϰһ�ֿ���ѧϰ��ӳsubgraph��ϵ��order embedding����ʧ������

���ǻ���order constraint�����ʧ������order constraint�涨������Ŀɷ�ӳsubgraph��ϵ��order embedding����:

? i = 1 D z q [ i ] �� z u [ i ] ?iff? G Q ? G T \forall_{i=1}^Dz_q[i]\leq z_u[i]\ \text{iff}\ G_Q\subseteq G_T ?i=1D?zq?[i]��zu?[i]?iff?GQ??GT?

���� z q z_q zq? ��query embedding, z u z_u zu? ��target embedding, i i i ��embedding dimension(DӦ����Ƕ��ά��), ? \subseteq ? ��subgraph��ϵ��

order constraint��max-margin loss14 ��ѵ����

-

��ʧ����

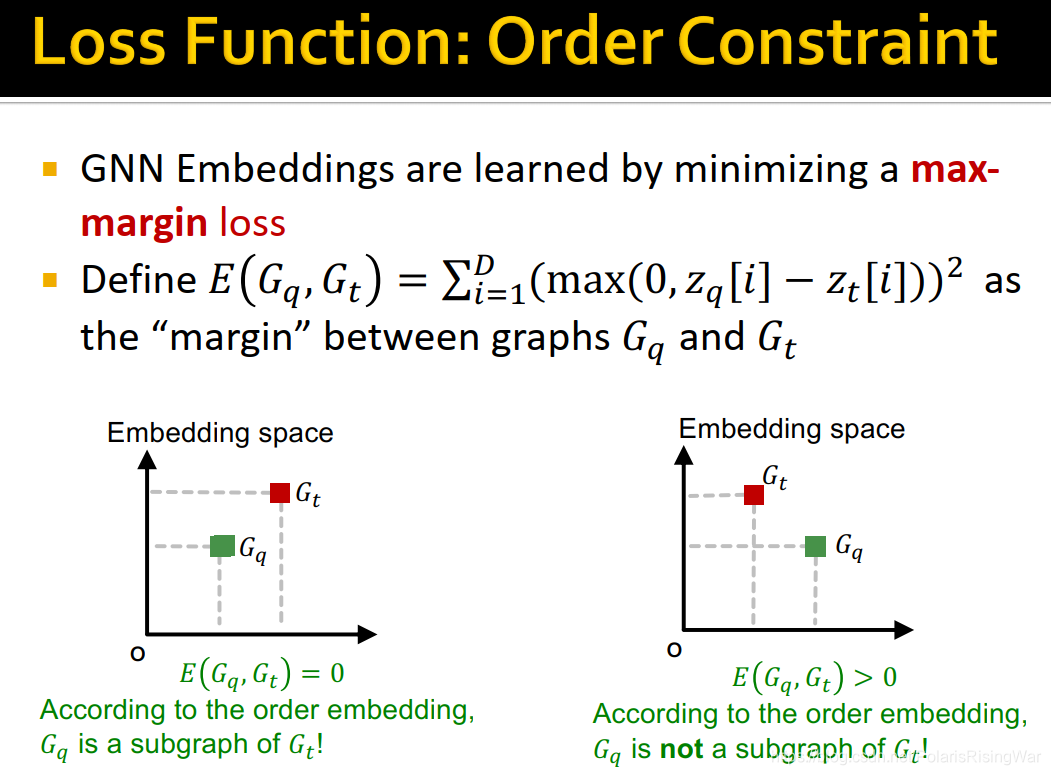

GNNǶ��ͨ����С��max-margin lossѧ�á�

���� E ( G q , G t ) = �� i = 1 D ( max ? ( 0 , z q [ i ] ? z t [ i ] ) ) 2 E(G_q,G_t)=\sum_{i=1}^D\big(\max(0,z_q[i]-z_t[i])\big)^2 E(Gq?,Gt?)=��i=1D?(max(0,zq?[i]?zt?[i]))2 Ϊͼ G q G_q Gq? �� G t G_t Gt? ֮���margin(penalty��violation)��

��margin=0ʱ z q [ i ] ? < ? z t [ i ] z_q[i]\ <\ z_t[i] zq?[i]?<?zt?[i] �����,�� G q G_q Gq? �� G t G_t Gt? ��subgraph;��margin>0ʱ G q G_q Gq? ���� G t G_t Gt? ��subgraph��

-

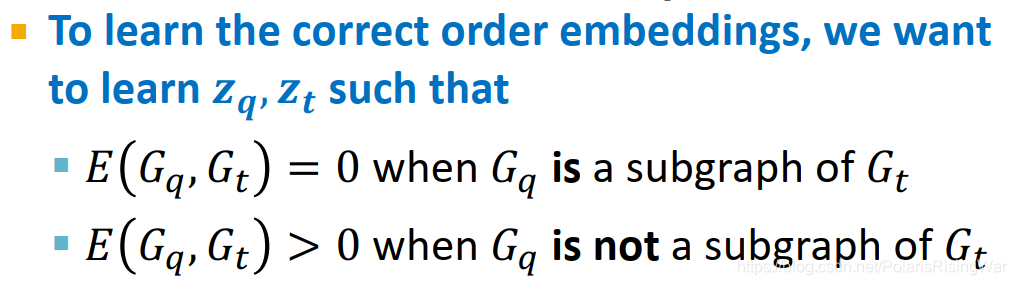

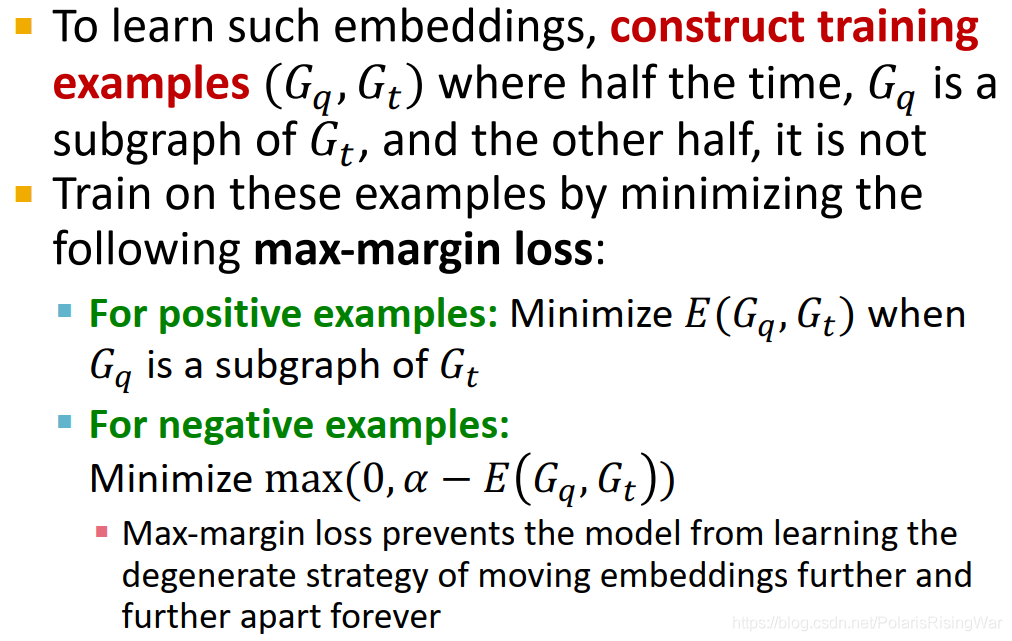

training neural subgraph matching

Ϊ��ѧϰ����Ƕ��,��ҪԼ��ѵ�������� ( G q , G t ) (G_q,G_t) (Gq?,Gt?) ��һ�� G q G_q Gq? �� G t G_t Gt? ��subgraph,��һ�벻�ǡ�

��������:���� E ( G q , G t ) E(G_q,G_t) E(Gq?,Gt?)

�Ը�����:��С�� max ? ( 0 , �� ? E ( G q , G t ) ) \max\big(0,\alpha-E(G_q,G_t)\big) max(0,��?E(Gq?,Gt?))

max-margin lossʹ�������� z q [ i ] ? < ? z t [ i ] z_q[i]\ <\ z_t[i] zq?[i]?<?zt?[i],ʹȫʽΪ0;�������е� E ( G q , G t ) E(G_q,G_t) E(Gq?,Gt?) ���� �� \alpha ��(ʹ �� ? E ( G q , G t ) \alpha-E(G_q,G_t) ��?E(Gq?,Gt?) С��0,ʹȫʽΪ0)��������ǿ�������,ʹǶ������֮�䲻��Ҫ����Զ(slides��˵����degenerate strategy,��Ҳû�鵽�����Ǹ�ɶ����)

-

training example construction

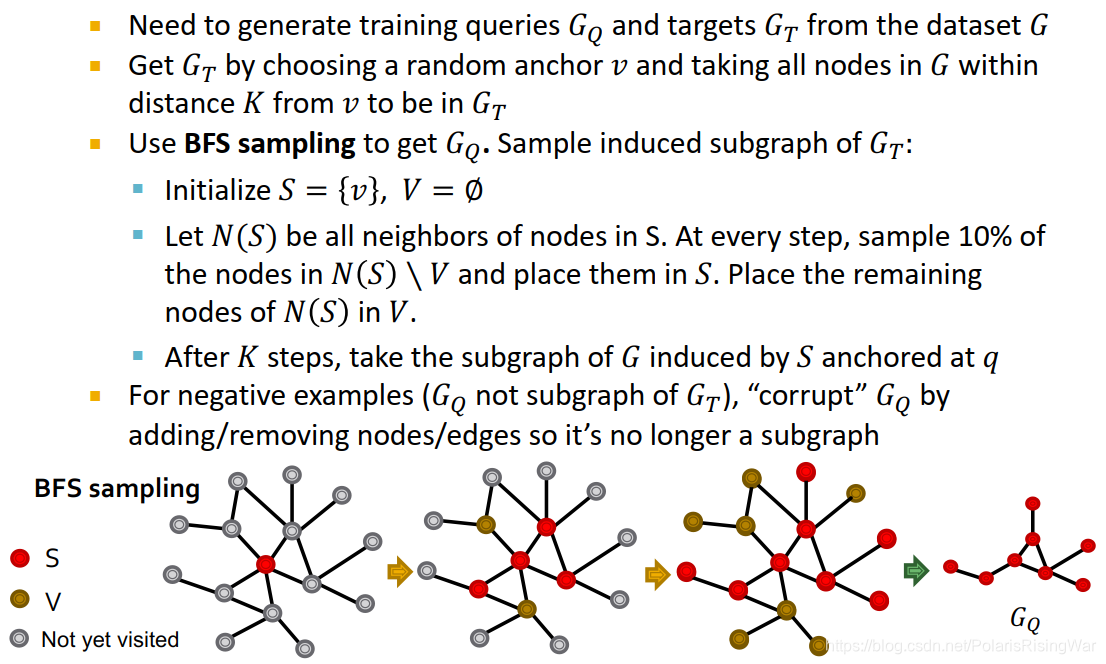

������Ҫ�����ݼ� G G G ������ѵ������:query G Q G_Q GQ? ��target G T G_T GT?

�õ� G T G_T GT?:���ѡȡanchor v v v,��ȡ��ȫ�� K K K ���ھӡ�

�õ� G Q G_Q GQ?:��BFS����,�� G T G_T GT? �г���induced subgraph:

?step1:��ʼ�� S = { v } , V = ? S=\{v\},V=\varnothing S={v},V=?

?step2:ʹ N ( S ) N(S) N(S) Ϊ S S S �нڵ�������ھӡ�ÿһ������10%�� N ( S ) \ V N(S)\backslash V N(S)\V �еĽڵ���� S S S ��,��������ڵ���� V V V �С�

?step3: K K K ����,��ȡ G G G �� induced by S S S anchored at q q q ��subgraph

�Ը�����( G Q G_Q GQ? ���� G T G_T GT? ��subgraph):corrupt G Q G_Q GQ?:����/�ƶ��ڵ�/��ʹ��������һ��subgraph

-

ѵ��ϸ��

- ������Ҫ����������training examples?

ÿ�ε���,���Ƕ���Ҫ�����µ�target-query�ԡ�

�������ĺô���ÿ��ģ�Ͷ��ῴ����ͬ��subgraph����,�������ֽ������������(�Ͼ���ָ�����Ŀ���subgraph�ɹ�����) - BFS����Ӧ�ö���?

����һ����Ҫƽ������ʱ��ͱ��ֽ���ij�����,һ������Ϊ3-5,Ҳ��Ҫȡ�������ݼ��Ĵ�С��

- ������Ҫ����������training examples?

-

����ͼ��Ԥ��һ��ͼ�Ƿ�����һ��ͼ��subgraph

��֪:query graph G q G_q Gq? anchored at node q q q, target graph G t G_t Gt? anchored at node t t t

Ŀ��:���query�Ƿ���target��node-anchored subgraph

����:��� E ( G q , G t ) < ? E(G_q,G_t)<\epsilon E(Gq?,Gt?)<?,Ԥ��Ϊ��;��֮Ԥ��Ϊ��( ? \epsilon ? �dz�����)

Ϊ�˼��� G Q G_Q GQ? �Ƿ��� G T G_T GT? subgraph isomorphism,������ q �� G Q , t �� G T q\in G_Q,t\in G_T q��GQ?,t��GT? �ظ��������̡��˴��� G q G_q Gq? �� q �� G Q q\in G_Q q��GQ? ������neighborhood��

-

neural subgraph matching�ܽ�

neural subgraph matchingʹ�û��ڻ���ѧϰ�ķ���ѧϰNP-hard��subgraph isomorphism����:

?1. ��query��targetͼ��Ƕ��order embedding space

?2. ����ЩǶ���������� E ( G q , G t ) E(G_q,G_t) E(Gq?,Gt?) ���ж�query�Ƿ���target��subgraph

��order embedding spaceǶ��ͼʹsubgraph isomorphism���Ը�Ч��ʾ����ͼǶ������λ�ý��м��顣

4. Mining / Finding Frequent Motifs / Subgraphs

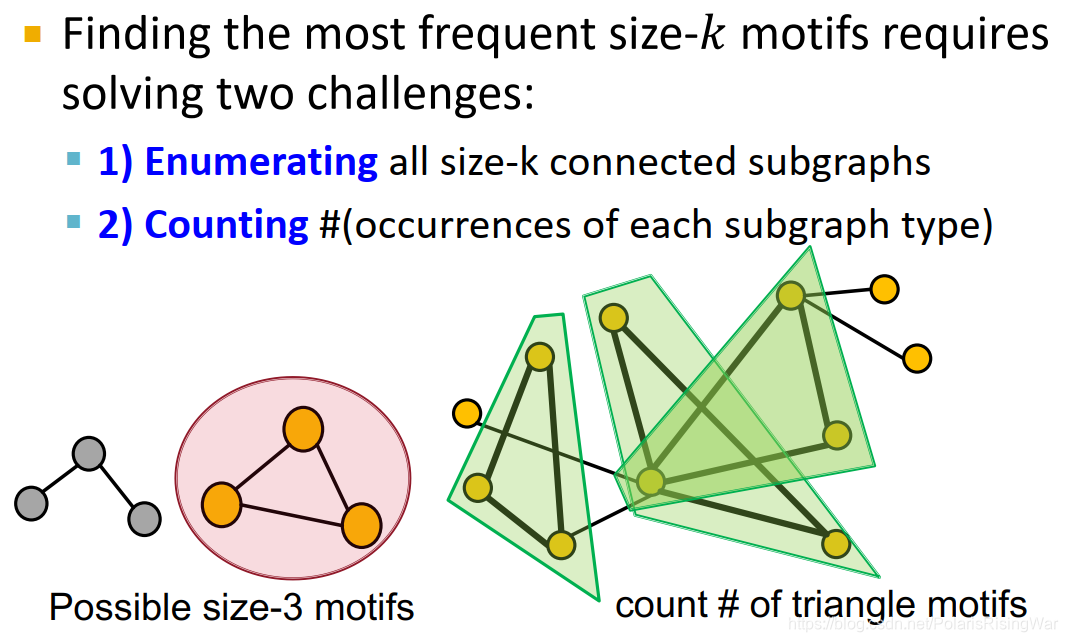

- finding frequent subgraphs

����Ƶ���Ĵ�СΪk��motif��Ҫ���������ս:- �������д�СΪk��connected subgraph

- ��ÿһ��subgraph�ij��ִ���

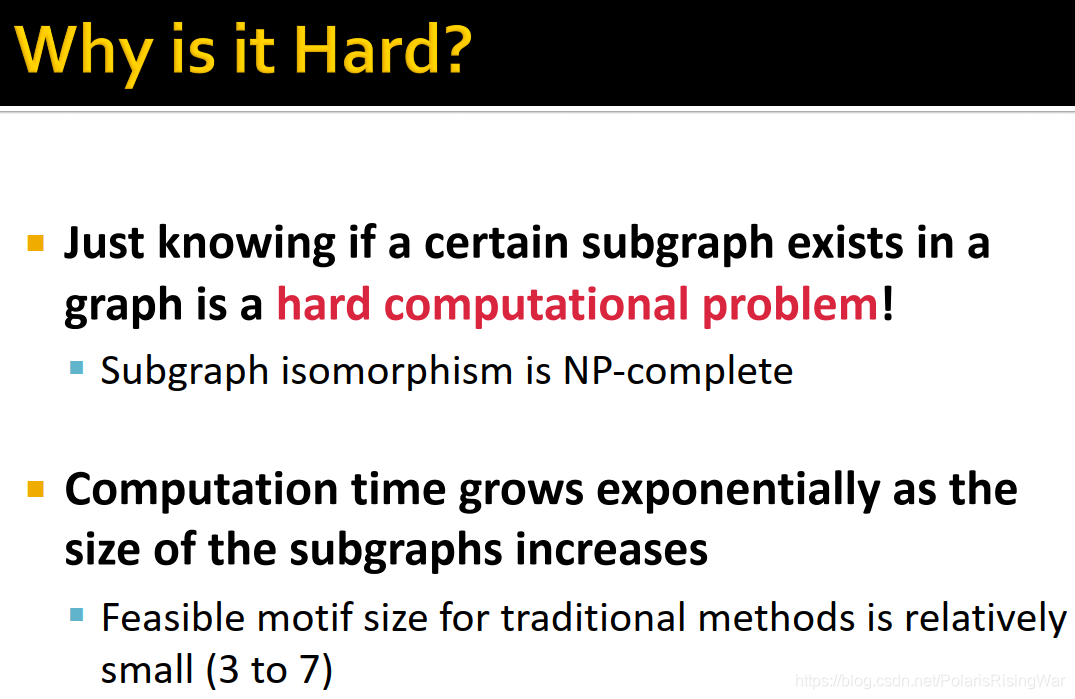

- ����������ڽ�ȷ��һ���ض�subgraph�Ƿ������ͼ�о����Ǽ�����ۺܸߵ�����(subgraph isomorphism��NP-complete),������ʱ��subgraphָ��������(��˴�ͳ�������е�motif�ߴ綼��Խ�С,��3-7)��

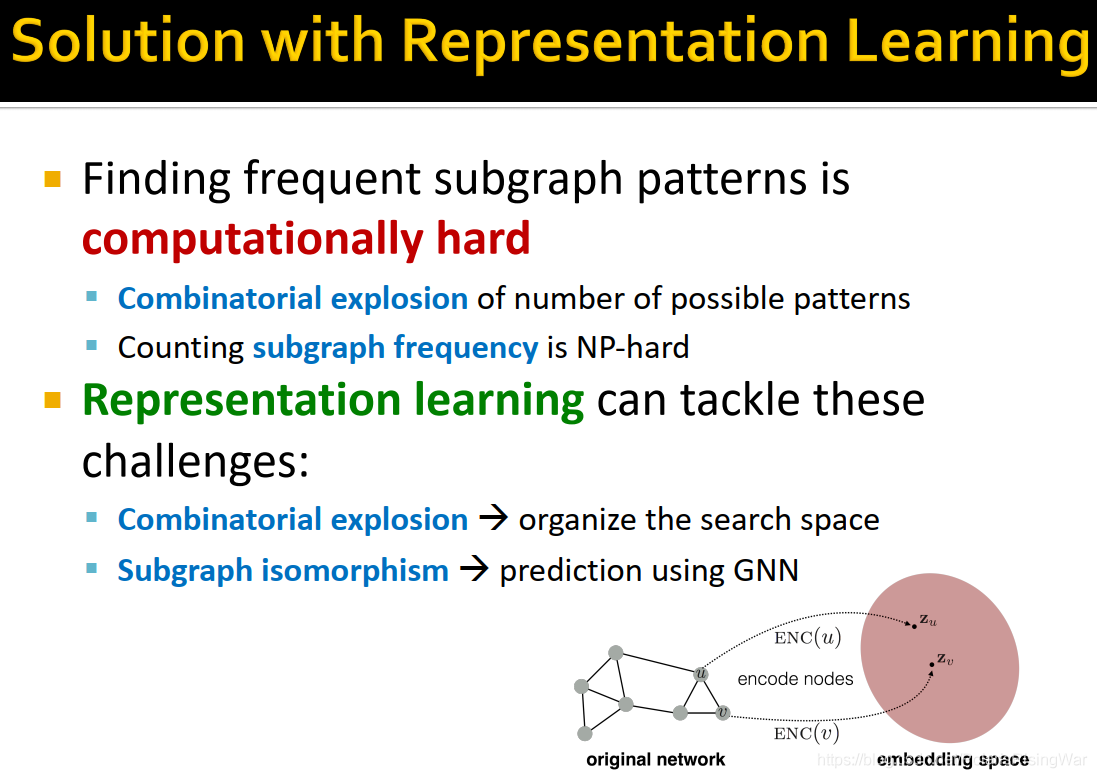

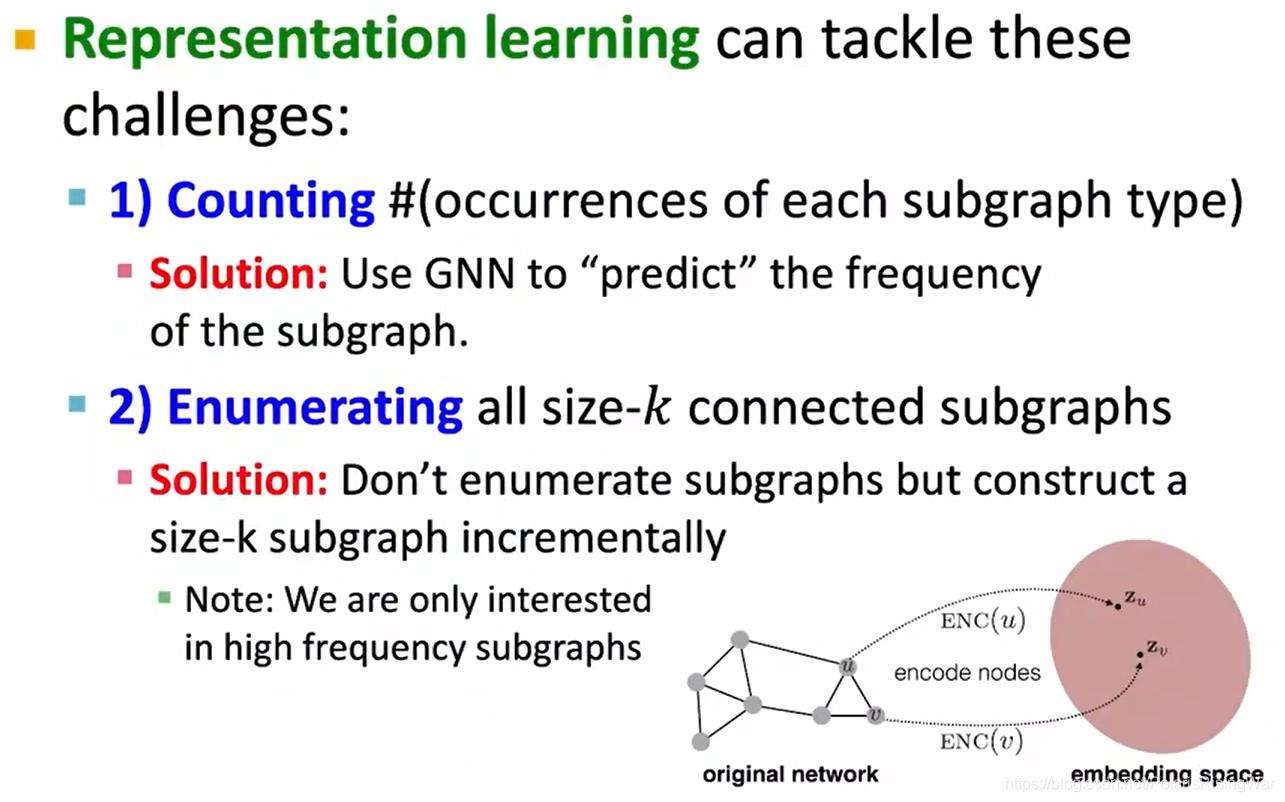

����˵��������ָ���������������λ�����(�ض���С�ж���motif(��ϱ�ըcombinatorial explosion15)+�ҳ�ÿ��motif��frequency(subgraph isomorphism and subgraph counting))

- ʹ�ñ�ʾѧϰ�ķ������������

��ʾѧϰͨ��search space(ÿ������һ���ڵ�,�ۻ���size k��subgraph��,��������ġ�ע�����ǽ����ĸ�Ƶsubgraph)�����ϱ�ը����,ͨ��GNNԤ����subgraph isomorphism����(���DZ��µ�������������֪ʶ)��

- problem setup: frequent motif mining

����target graph(���ݼ�) G T G_T GT?,subgraph��С���� k k k

���������� r r r

Ŀ��:�����д�СΪ k k k ���ڵ��ͼ��,ʶ��� r r r ���� G T G_T GT? �г���Ƶ����ߵ�ͼ��

����ʹ��node-level subgraph���塣

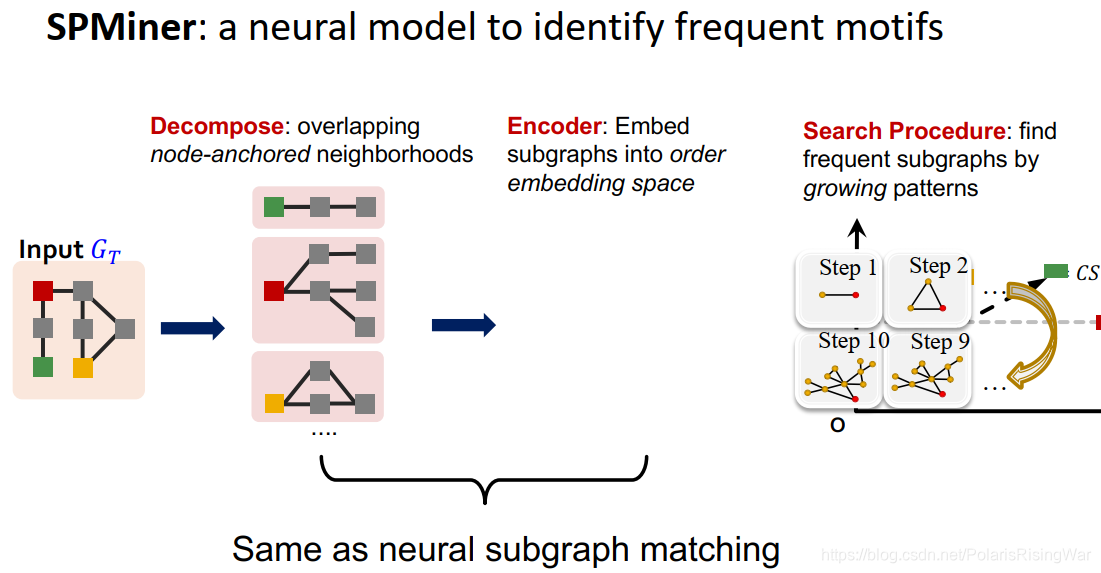

- SPMiner overview

SPMiner:ʶ���Ƶmotifs��������ģ��

����:������ͼ G T G_T GT? decomposeΪ�ظ���node-anchored neighborhoods,��subgraphǶ�뵽order embedding space(����������neural subgraph matching��һ����);Ȼ�����search procedure,�����Dz��������п��ܵ�subgraph,��ֱ�Ӵ�2���ڵ��ͼ��ʼ������һ������ڵ�����subgraph,��������ͬʱ������֤Ƶ�ʸߡ�

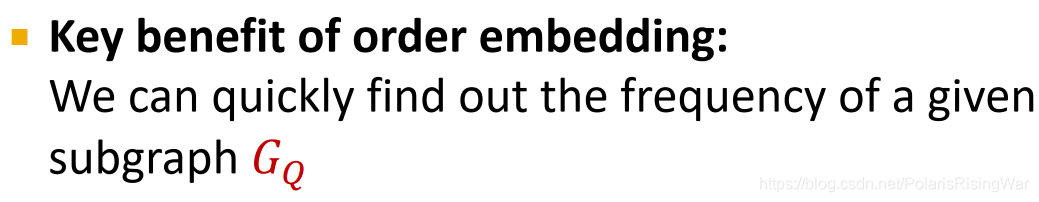

- SPMiner:����˼��

order embedding�ĺ�������:����Ѹ���ҵ��ض�subgraph G Q G_Q GQ? ��Ƶ��

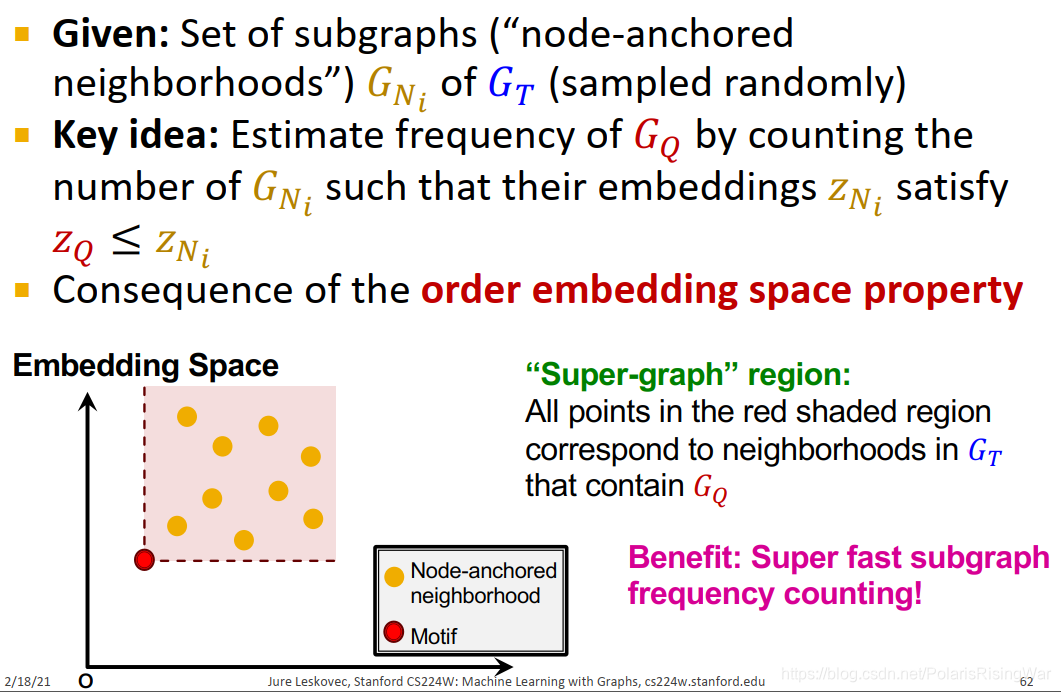

- motifƵ�ʹ���

��֪:һϵ�� G T G_T GT? ��subgraph(node-anchored neighborhoods) G N i G_{N_i} GNi?? (ͨ����������õ�)��

����˼��:���� G Q G_Q GQ? ��Ƶ��:ͨ��������Ҫ��� G N i G_{N_i} GNi?? �ĸ���( z Q �� z N i z_Q\leq z_{N_i} zQ?��zNi??)

������order embedding space�����Եõ��Ľ���:����ͼ��ʾ,��ɫ�ڵ�(motif)���Ͻǵĺ�ɫ���������super-graph region,��ɫ�ڵ����������ڸ�����Ľڵ�( G T G_T GT? ��neighborhoods)��subgraph��

�����ĺô�������ÿ졣

- SPMiner search procedure

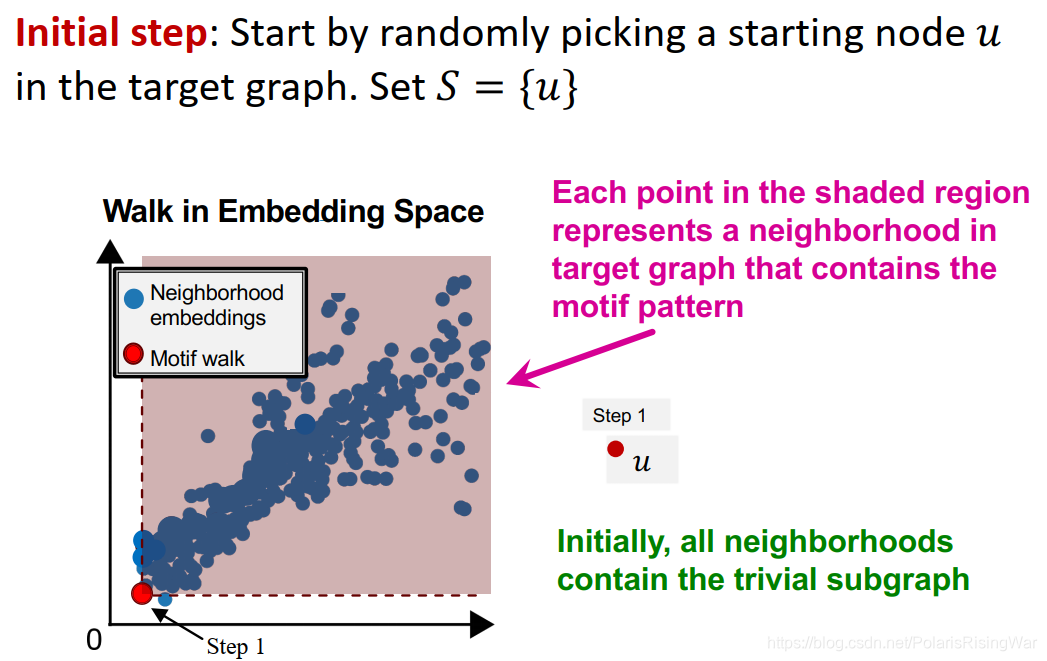

- ��ʼ:��һ����target graph�����ѡ������

u

u

u ��ʼ:��

S

=

{

u

}

S=\{u\}

S={u}

����neighborhoods����һ��������Ϸ�����,�����������subgraph��

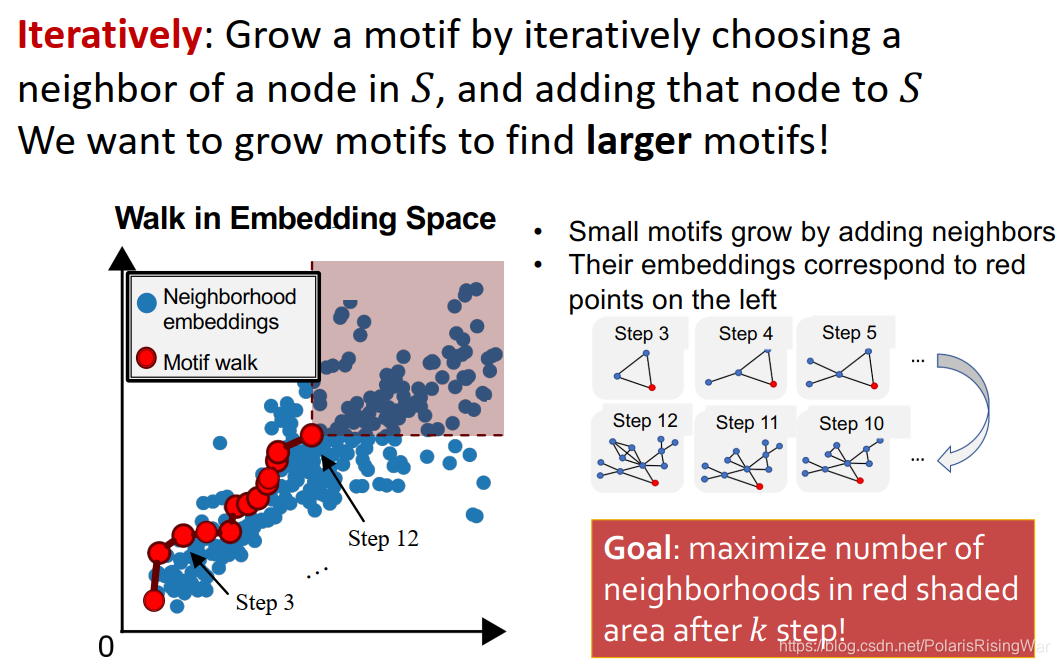

- ����:ÿ��ѡһ��

S

S

S �нڵ���ھ�,�ӵ�

S

S

S ��,���������motif�ijߴ硣

Ŀ��:�� k k k �������ɫ��Ӱ�����е�neighborhoods��Ŀ��

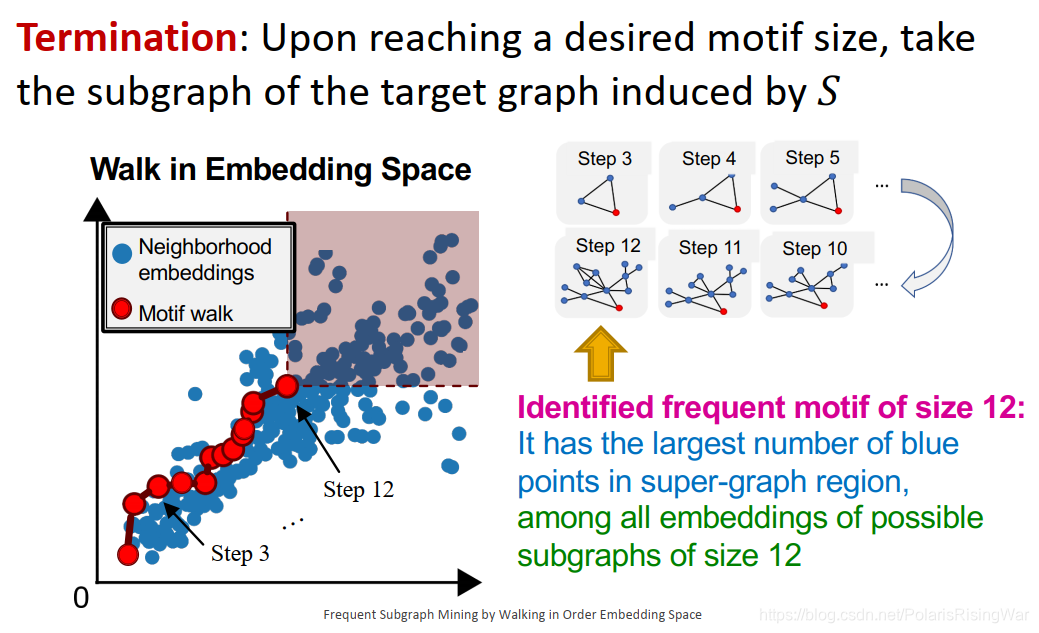

- ֹͣ:�ﵽԤ��motif�ߴ��,ѡȡthe subgraph of the target graph induced by

S

S

S

�����ҵ���motif����Ԥ�ڳߴ籸ѡsubgraphǶ���������target graph neighborhoods(����)�ں�ɫ�����subgraph��

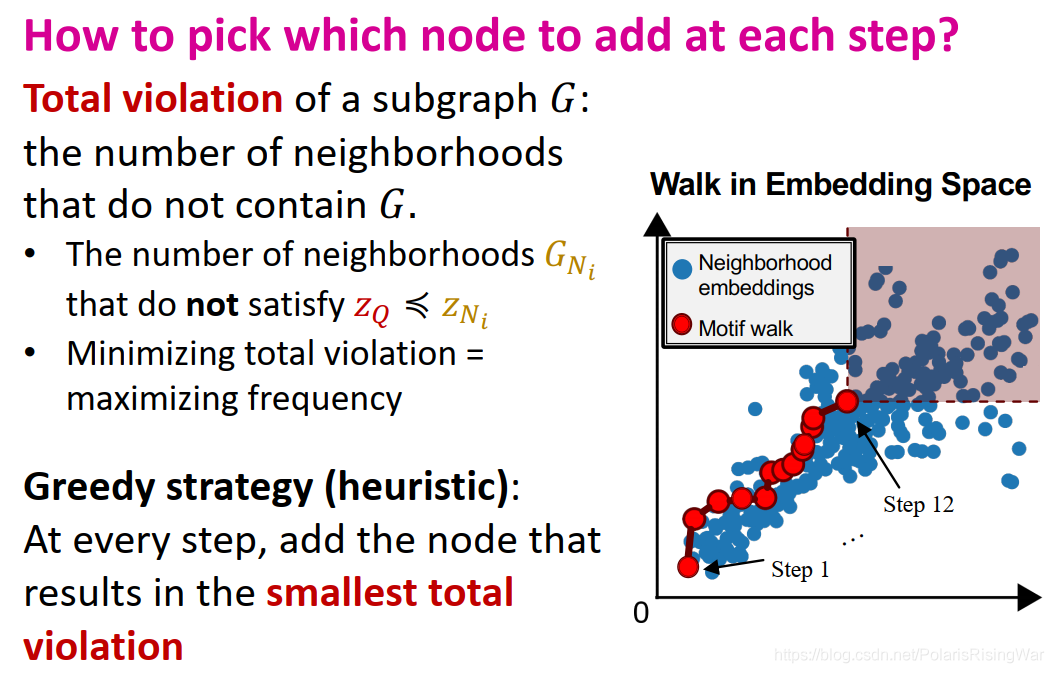

- ÿһ�����ѡȡ�ڵ�?

����subgraph G G G ��total violation:������ G G G ��neighborhoods�������������� z Q ? z N i z_Q\preccurlyeq z_{N_i} zQ??zNi?? ��neighborhoods G N i G_{N_i} GNi?? ������

��С��total violation�������Ƶ�ʡ�

���Dz���̰���㷨,ÿһ����ѡ��ʱ��ǰtotal violation��С�Ľڵ㡣

- ��ʼ:��һ����target graph�����ѡ������

u

u

u ��ʼ:��

S

=

{

u

}

S=\{u\}

S={u}

- ʵ����

- Сmotif

ground truth:ͨ�����۸߰���BF�����㷨(�����ƽ�)�ҵ�10������Ƶ����ߵ�motif��

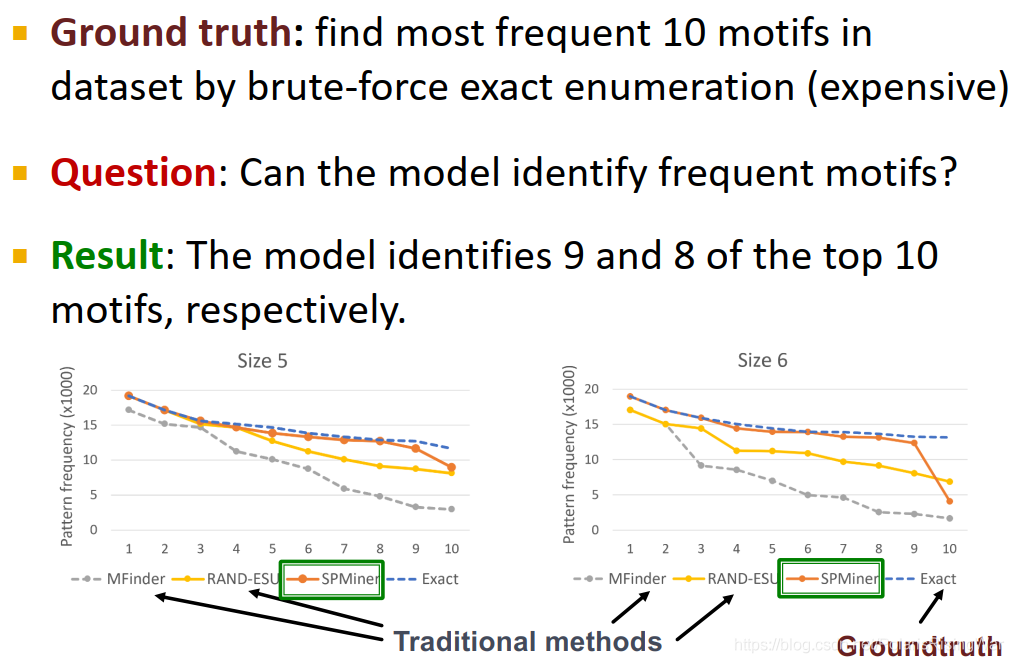

�ڴ�СΪ5-6��motif��,SPMiner����ʶ���top 10��ǰ9/8��,ʶ�����Ƶ�ʽӽ���ʵֵ:

- ��motif

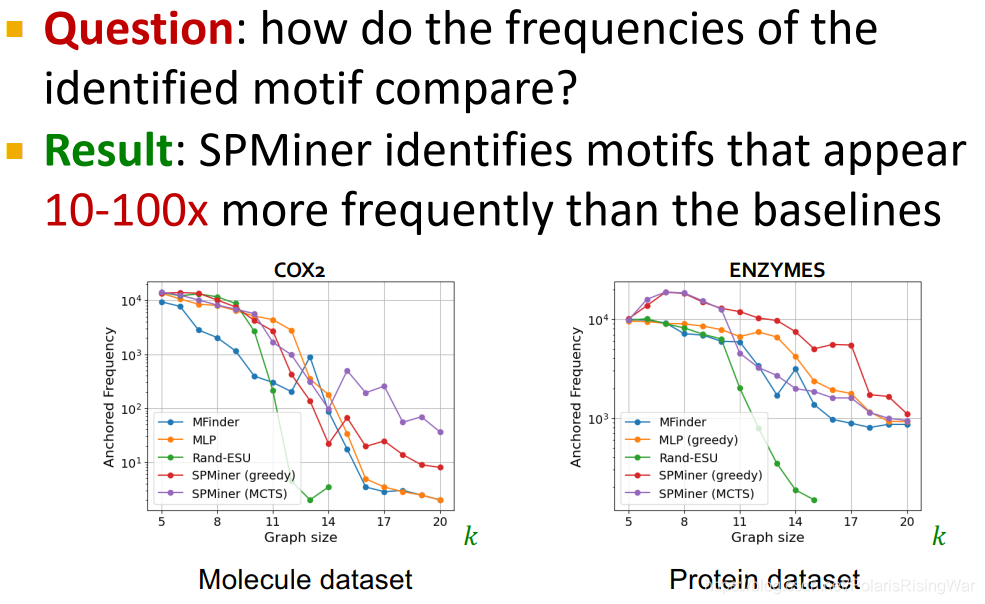

SPMiner��baseline��ʶ��10-100����

- Сmotif

- �ܽ�

- subgraph��motif�ǿ����������˽�ͼ�ṹ����Ҫ����,��������������ڵ��ͼ��������

- ���½���һ��Ԥ��subgraph isomorphism��ϵ�������緽����

- order embeddings�����Կ����ڱ���subgraph��ϵ��

- order embedding space�ϵ�neural embedding-guided search����������һ�ֱȴ�ͳ������ʶ�������motifƵ�ʵĻ���ѧϰģ�͡�

��ֱ���ðٶȲ�����ؼ���û�鵽,ֻ�鵽˵��ɢ��ѧ����matching problem(�ο���ƪ����:��ɢ��ѧ�ʼ�6(Matching problems) - ֪�� ),���Ǹо��������������ûʲô��ϵ?

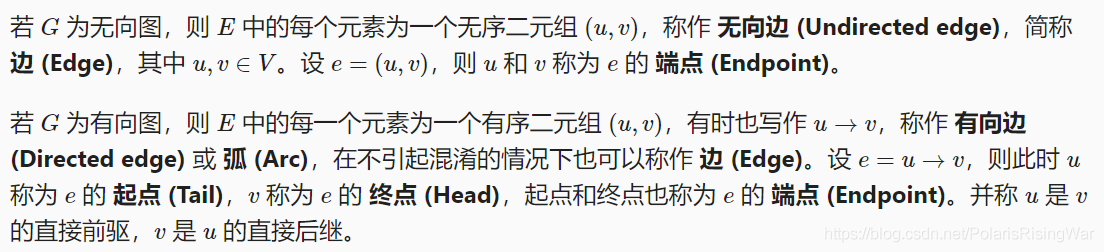

�����Ҿ���ԭ��ָ��Ӧ���Ǵ�ͳ��subgraph matching����11��������Щ��ͳ��subgraph matching������û�������˽�,�Ҿ���ֱ��ѧ�ı��¿γ̡� ??Edge-induced subgraph | Article about edge-induced subgraph by The Free Dictionary ˵edge-induced subgraph�еĽڵ���ȫ��������г��ֹ�����һ�ε�ԭͼ�ڵ㡣

Edge-Induced Subgraph �C from Wolfram MathWorld: An edge-induced subgraph is a subset of the edges of a graph G together with any vertices that are their endpoints7.

��ͼ�ĸ���_yyywww666��ר��-CSDN����

networkx.classes.function.edge_subgraph �� NetworkX 2.5 documentation

dgl.edge_subgraph �� DGL 0.6.1 documentation ??��ͼ��ԭ�䡭����,��֪����û�����Ⲣ������ȷ��

�����Ҿ����������С���ⲻ��Ҫ�ɡ�

presenceһ�ʲ�֪���ڴ˴�����רҵ����������������ڡ� ??�ɲο� ����������� (Gene Regulatory Network) 01 - Bracer - ����

��Ϊ�����ҵ�רҵ����,������û��ϸ���� ?? ??��֮ǰд�ıʼ�:cs224w(ͼ����ѧϰ)2021�����γ�ѧϰ�ʼ�2: Traditional Methods for ML on Graphs_�����Ĭ����IJ���-CSDN���� �н�ע4 ??

��ʱ������ʼǵ�ʱ������Ӣ��ά��,����������ʱ������,�����ҾͰ��ҵ�ʱ�õIJο������г���,��������ֻ�ܿ���֮ǰ�ʼ���,��û����ȥԭ��ҳ��һ������֤ʵ��:

�� һ�Խڵ�֮�����˶���� ��Դ:https://zh.wikipedia.org/wiki/%E9%87%8D%E8%BE%B9

�� https://en.wikipedia.org/wiki/Dual_graph ??һ���ߵ�endpoint�������Ӧ�������˵㡣���������������������˵㡣

���OI Wiki��

ԭ��: ͼԴ:ͼ����ظ��� - OI Wiki ?? ??

ͼԴ:ͼ����ظ��� - OI Wiki ?? ??������������Ȼ��������Ҳ�Ǻ����� ??

�������ͦ���ӵ�,��Ҳû��ϸ����

���ӷ���Ҳ������,���ʲο�:Networks based on words ??����֮ǰ�鵽�Ķ�subgraph matching����Ķ���:����target graph��query graph,ȷ��query graph�Ƿ���target graph����ͼ,����ȷ����λ�á��ο�16)

�����ɲο����弰��Դ:

Subgraph matching problem is identifying a target subgraph in a graph. ���� Subgraph Matching Using Graph Neural Network ?? ??�Ҳ�û��������ֱ��,Ҳû������仰ɶ��˼�� ??

���Բο�:���ֶ���(Theorem)������(Lemma)������(Corollary)�ȸ���_cloudeagle_bupt��ר��-CSDN����_corollary ??

���Ǹо�max margin���������ҵ��Ķ������������̫һ������������ߵĻ��Ͱ��տγ��н������ɡ�

���������˽�ø�����ʹ�õ�����Ҳ�ų���,���ʲο�:��ʧ����:Hinge Loss(max margin) - �˼�һö - ���� ??��ʵ��û������ϱ�ը�������ɶ��˼��������������������size���,subgraph���,����¡�������ϱ�ը����ʱ�����ɶ��˼,�Ҿ�û�㶮��

����stack overflow�Ͽ���������һ������:Examples for combinatorial explosion in Java? - Stack Overflow ����Java�ȱ�������������ϱ�ը,������ܿ��ö�,�͡�����Ҳ�dz���Ա,��Ҳ�ǽ����˰�,����ô�ܲ���interface������!

�������subgraph����ʲô��ϵ? ??ԭ��:Subgraph matching is the problem of determining the presence and location (s) of a given query graph in a large target graph. ���� [2007.03092] Neural Subgraph Matching ??