����Ŀ¼

����������Pytorchѧϰ��Ƶ����,��Ƶ����: �������-AI��PyTorchѧ�������!

1.PyTorch����

2017��1��,��Facebook�˹������о�Ժ(FAIR)����Torch�Ƴ���PyTorch������һ������Python�Ŀ��������,�ṩ����������:1������ǿ���GPU���ٵ���������(��NumPy)��2�������Զ���ϵͳ����������硣

2.����������

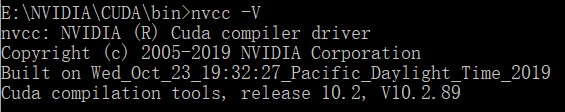

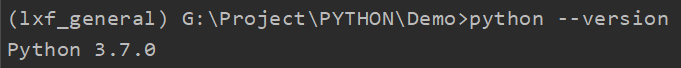

cmd�鿴CUDA�汾��Ϣ: nvcc -V

cmd�鿴python�汾��Ϣ:python --version

python�鿴torch��cuda��Ϣ:

import torch

print(torch.__version__) # 1.9.0+cu102

print('gpu:', torch.cuda.is_available()) # gpu: True

3.numpy.genfromtxt()

file_name = "data.csv"

"""

10.3,6.6

...

"""

# ���ı��ļ���������,����ָ������ȱʧֵ

points = numpy.genfromtxt(file_name, delimiter=",")

for i in range(len(points)):

x = points[i, 0]

y = points[i, 1]

4.������������

4.1 All is about Tensor

| python | PyTorch |

|---|---|

| Int | IntTensor of size() |

| float | FloatTensor of size() |

| Int array | IntTensor of size[d1,d2,��] |

| Float array | FloatTensor of size[d1,d2��] |

| string | �C |

4.2 How to denote string

- One-hot:[0, 1, 0, 0,��]

- Embedding:Word2vec,glove

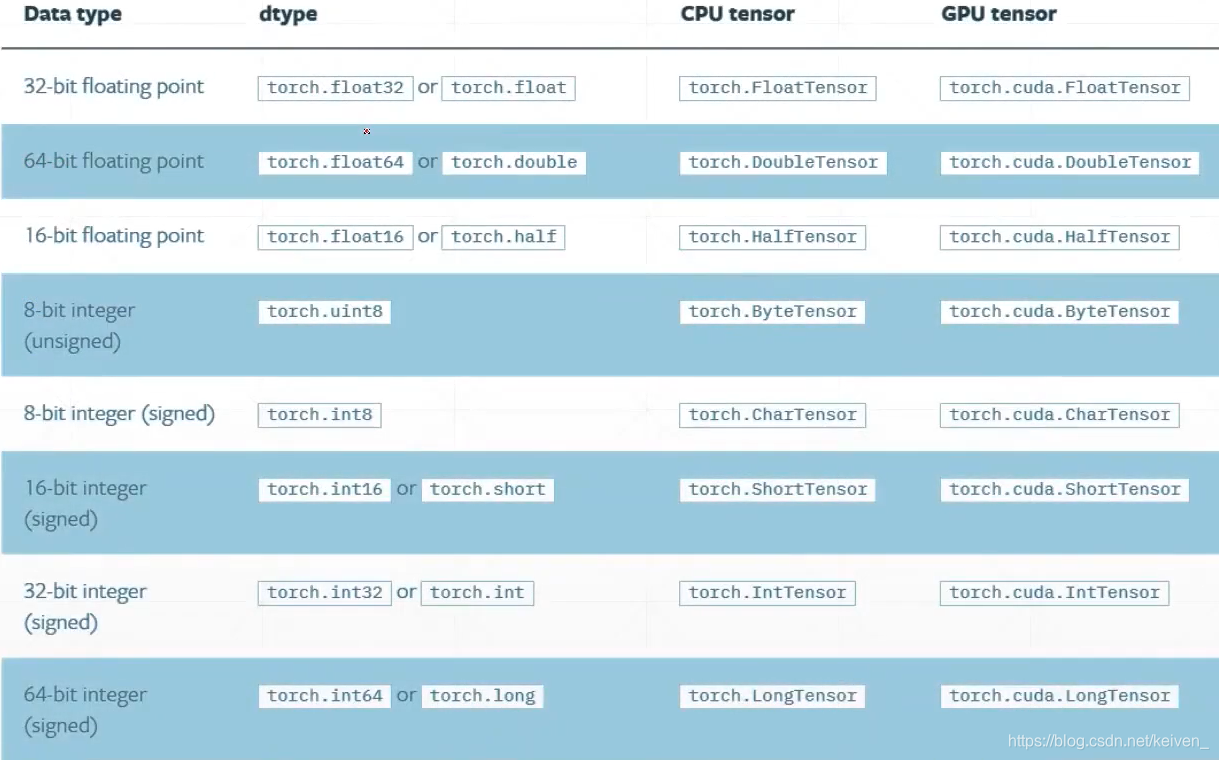

4.3 Data type

4.4 Type check

a = torch.randn(2, 3)

print(a) # tensor([[ 0.3765, 0.6532, -0.8246],

# [ 1.3567, -0.3963, 0.1719]])

print(a.type()) # torch.FloatTensor

print(type(a)) # <class 'torch.Tensor'>

print(isinstance(a, torch.FloatTensor)) # True

# ����λ�ö��������͵�Ӱ��

print(isinstance(a, torch.cuda.FloatTensor)) # False

a = a.cuda()

print(isinstance(a, torch.cuda.FloatTensor)) # True

4.5 Dimension / rank

- Dimension 0 :Loss

- Dimension 1 :Bias��Linear Input

- Dimension 2 :Linear Input batch

- Dimension 3 :RNN Input Batch

- Dimension 4 :CNN[b, c, h, w]

4.6 Mixed

a = torch.rand(2, 3, 4, 5)

print(a.size()) # torch.Size([2, 3, 4, 5])

print(a.shape) # torch.Size([2, 3, 4, 5])

print(len(a.shape)) # 4

print(a.dim()) # ��:4

print(a.numel()) # ��������ݴ�С:120

5.����Tensor

5.1 Import from numpy

a = np.ones(2)

print(a) # [1. 1.]

print(torch.from_numpy(a)) # tensor([1., 1.], dtype=torch.float64)

5.2 Import from List

a = torch.tensor([2, 3.2])

print(a) # tensor([2.0000, 3.2000])

torch.Tensor()�������ݵ�����

torch.tensor()�����ֳɵ�����

5.3 uninitialized

��ʼ�������ݿ��ܻ�dz�����߷dz�С,������ʹ��

- torch.empty()

- torch.FloatTensor(d1, d2, d3)

- torch.IntTensor(d1, d2, d3)

5.4 set default type

print(torch.tensor([1.2, 3]).type()) # torch.FloatTensor

torch.set_default_tensor_type(torch.DoubleTensor)

print(torch.tensor([1.2, 3]).type()) # torch.DoubleTensor

5.5 rand / rand_like, randint, randn

�Ƽ�ʹ����������ʼ��

a = torch.rand(2, 1)

print(a) # tensor([[0.1746],

# [0.6831]])

print(torch.rand_like(a)) # tensor([[0.5452],

# [0.4782]])

print(torch.randint(1, 5, [2, 1])) # tensor([[3],

# ������Сֵ�����ֵ,����ҿ� # [4]])

torch.randn() ��������������̬�ֲ�(0, 1)

torch.normal(mean=torch.full([10], 0), std=torch.arrange(1, 0, -0.1)) �Զ�����̬�ֲ���ֵ�ͱ���

5.6 full

print(torch.full([], 7)) # ����:tensor(7)

print(torch.full([1], 7)) # ����:tensor([7])

5.7 arrange / range

print(torch.arange(0, 10, 2)) # tensor([0, 2, 4, 6, 8])

print(torch.range(0, 10, 2)) # ������ʹ��,tensor([ 0., 2., 4., 6., 8., 10.])

5.8 linspace / logspace

print(torch.linspace(0, 10, steps=3)) # �Ȳ����Ϊsteps��:tensor([ 0., 5., 10.])

print(torch.logspace(0, -1, steps=5)) # ��������Ϊsteps��:tensor([1.0000, 0.5623, 0.3162, 0.1778, 0.1000])

5.9 Ones / zeros / eye

print(torch.ones(1, 2)) # ȫ1����:tensor([[1., 1.]])

print(torch.zeros(1, 2)) # ȫ0����:tensor([[0., 0.]])

print(torch.eye(2)) # �����:tensor([[1., 0.],

# [0., 1.]])

5.10 randperm

a = torch.rand(4, 3)

print(a)

idx = torch.randperm(3) # �����������

print(idx)

print(a[[1, 0, 2]])

"""

tensor([[0.1708, 0.2821, 0.8163],

[0.8898, 0.6628, 0.2350],

[0.3743, 0.4281, 0.5309],

[0.4996, 0.7259, 0.5485]])

tensor([1, 0, 2])

tensor([[0.8898, 0.6628, 0.2350],

[0.1708, 0.2821, 0.8163],

[0.3743, 0.4281, 0.5309]])

"""

6.��������Ƭ

��������Ƭ�ķ�ʽͬpython list[start:end:steps]

- Indexing

- select first / last N

- select by steps

- select by specific index

6.1 ��

����ȫ��ȡֵ

a = torch.rand(4, 3, 28, 28)

print(a[0, 1].shape) # torch.Size([28, 28])

print(a[0, 0, 2, 4]) # tensor(0.9485)

print(a.index_select(2, torch.arange(8)).shape) # torch.Size([4, 3, 8, 28])

print(a[:,:1,...].shape) #torch.Size([4, 1, 28, 28])

6.2 select by mask

x = torch.randn(3, 4)

print(x)

mask = x.ge(0.5) # Ԫ�ش���0.5��

print(mask)

print(torch.masked_select(x, mask))

"""

tensor([[-1.8692, 0.9687, -0.4978, 0.7836],

[-2.5662, 0.0487, 0.3978, -0.3676],

[-1.5896, -0.1129, -1.9687, 0.5585]])

tensor([[False, True, False, True],

[False, False, False, False],

[False, False, False, True]])

tensor([0.9687, 0.7836, 0.5585])

"""

6.3 select by flatten index

reshapeΪһά��ȡ����

src = torch.tensor([[4, 3, 5],

[6, 7, 8]])

print(torch.take(src, torch.tensor([0, 2, 5]))) # tensor([4, 5, 8])

7.ά�ȱ任

7.1 View / reshape

view��sizeǰ�����һ��,view��sizeҪ��ʵ������,�������������Ⱦ

a = torch.rand(4, 1, 28, 28)

print(a.view(4, 28*28).shape) # torch.Size([4, 784])

print(a.unsqueeze(4).shape) # torch.Size([4, 1, 28, 28, 1])

7.2 Sequeeze / unsqueeze

unsqueeze����һ��ά��,����ı����ݱ���

squeeze�������ļ�ѹά��Ϊ1��ѹ��,����Ϊ1��ԭ������ά�Ȳ���

b = torch.tensor([1, 2])

print(b.unsqueeze(-1)) # tensor([[1],

# [2]])

print(b.unsqueeze(0)) # tensor([[1, 2]])

c = torch.rand(1, 31, 1, 1)

print(c.shape) # torch.Size([1, 31, 1, 1])

print(c.squeeze().shape) # torch.Size([31])

print(c.squeeze(0).shape) # torch.Size([31, 1, 1])

print(c.squeeze(1).shape) # torch.Size([1, 31, 1, 1])

7.3 Expand / repeat

- Expand(broadcasting)

- repeat(memory copied)

a = torch.rand(1,32,1,1)

print(a.shape) # torch.Size([1, 32, 1, 1])

print(a.expand(4,32,14,14).shape) # torch.Size([4, 32, 14, 14])

print(a.repeat(4,32,1,1).shape) # torch.Size([4, 1024, 1, 1])

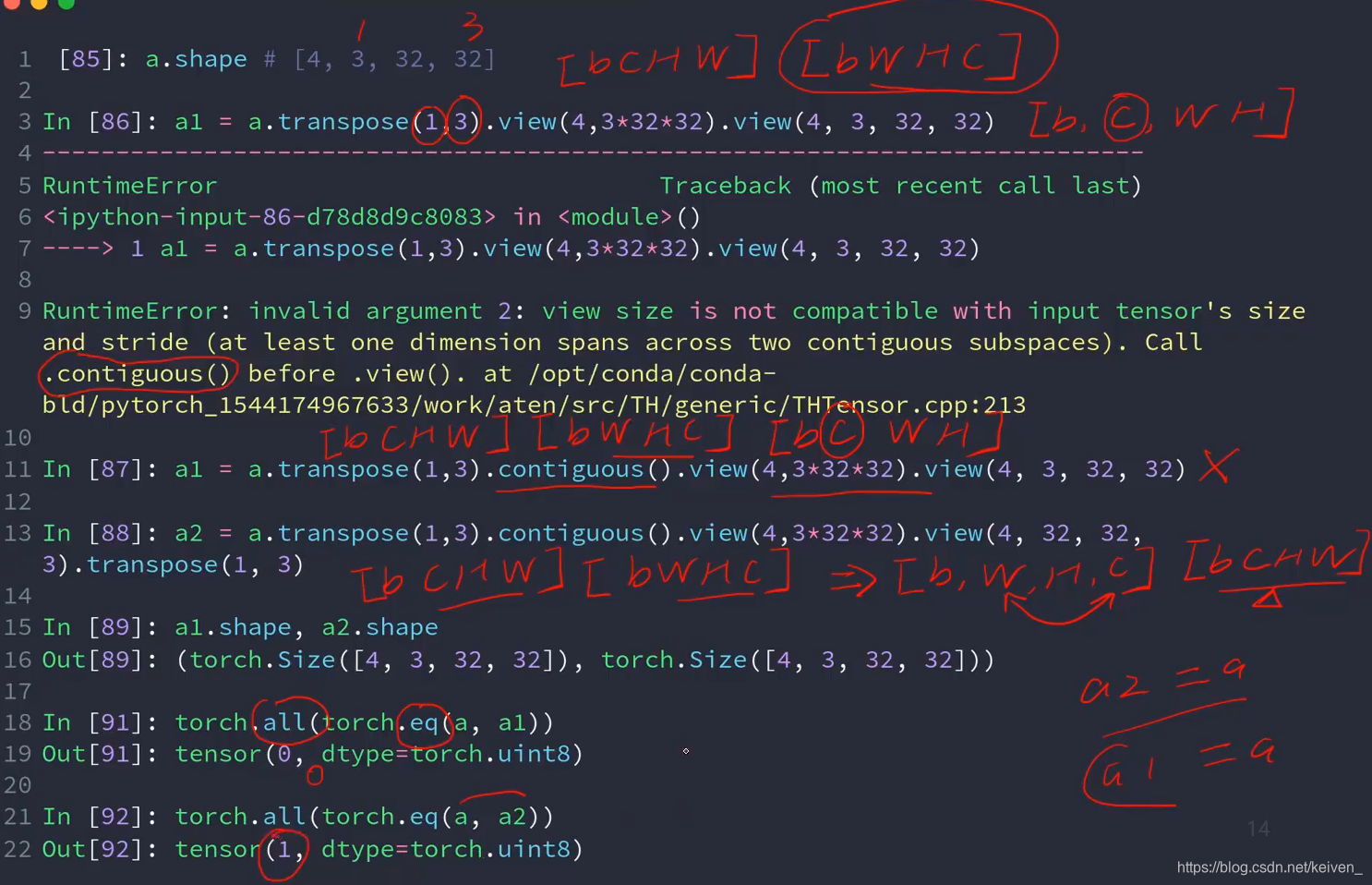

7.4 Transpose / t / permute

t()ֻ��ת�ö�ά����,����

a = torch.rand(2,3)

print(a.t().shape) # torch.Size([3, 2])

b = torch.rand(4,3,28,28)

print(b.transpose(1,3).transpose(1,2).shape) # torch.Size([4, 28, 28, 3])

print(b.permute(0,2,3,1).shape) # torch.Size([4, 28, 28, 3])