Unsupervised Learning - Linear Methods

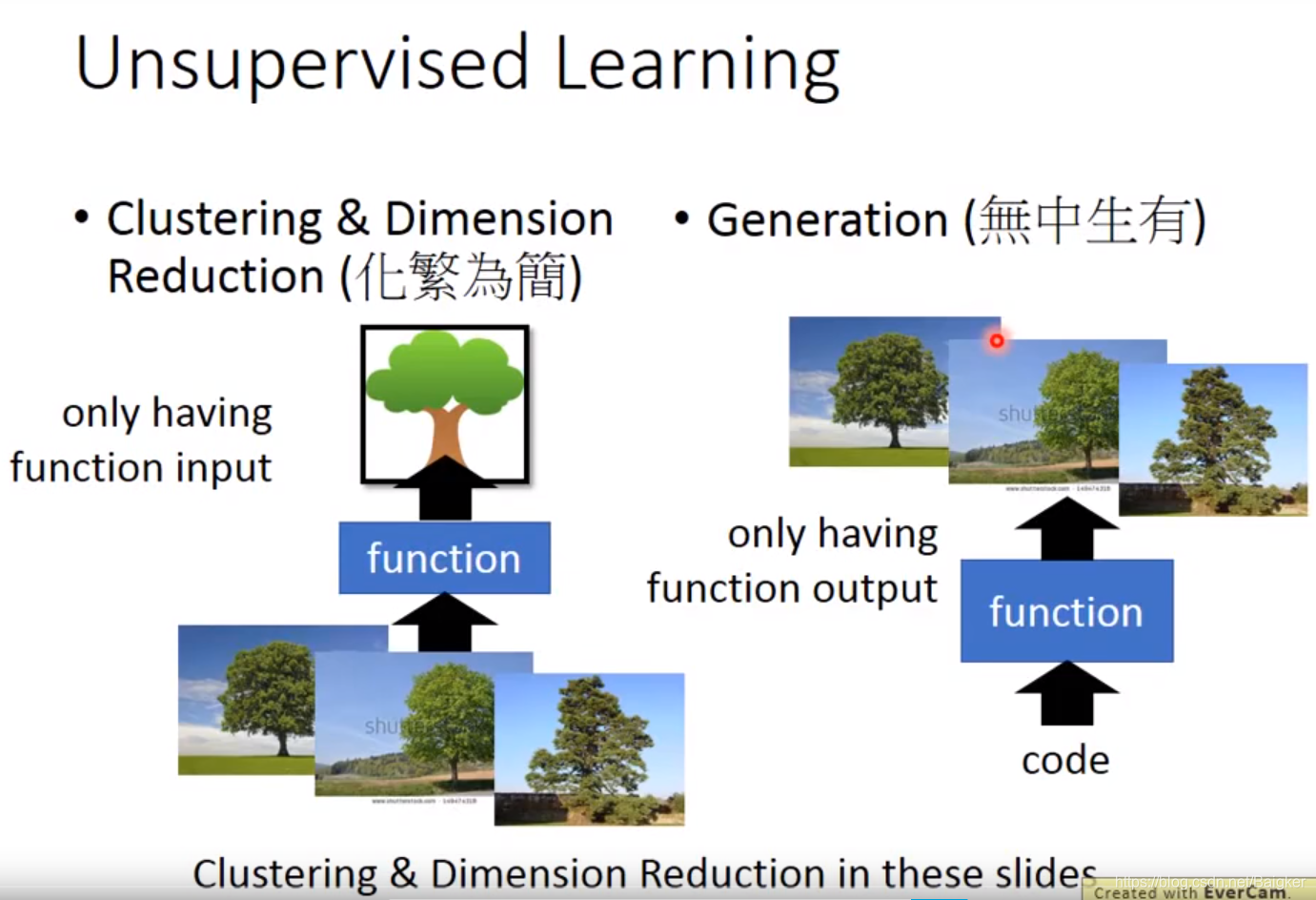

�ලѧϰ���Է�Ϊ����:

- ����Ϊ��(���� Clustering,��ά Dimension Reduction):������ָ�������,���һ���������

- ��������(Generation):�����Ӧ�Ĵ���,������ָ�������

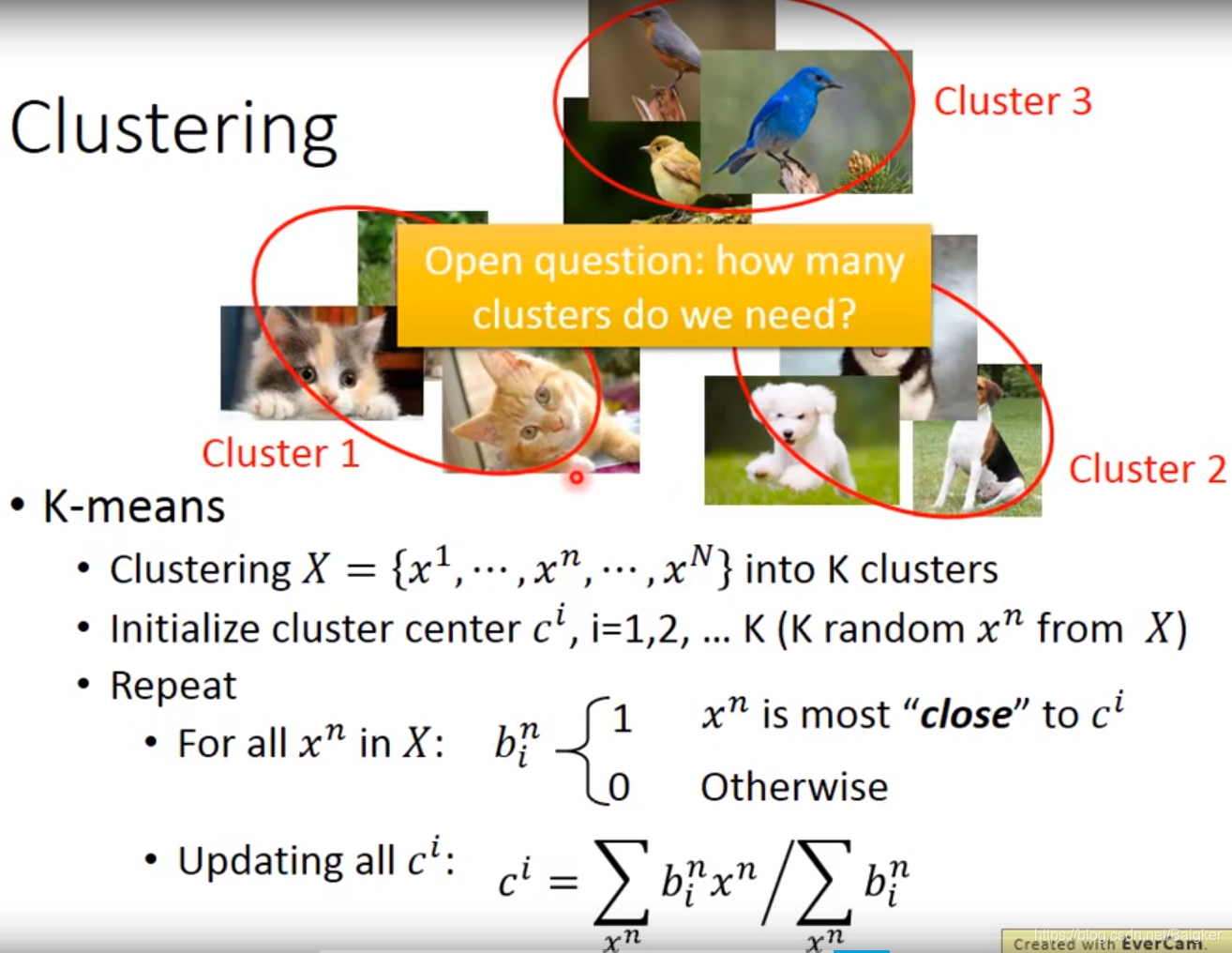

Clustering(����)

���ǰѸ����ޱ�ǩ�����ݽ��з��ࡣ�ֶ�����cluster 1��cluster 2��cluster 3�ı�ǩ,���������̾��ǻ���Ϊ��Ĺ��̡�

��ô,�ֳɼ�����?��һ��K-means�ķ���:

ע:������Ǵ�ԭ�ȵ�data set��ȡcenter�ij�ʼֵ,���ܻᵼ�²���clusterû��������

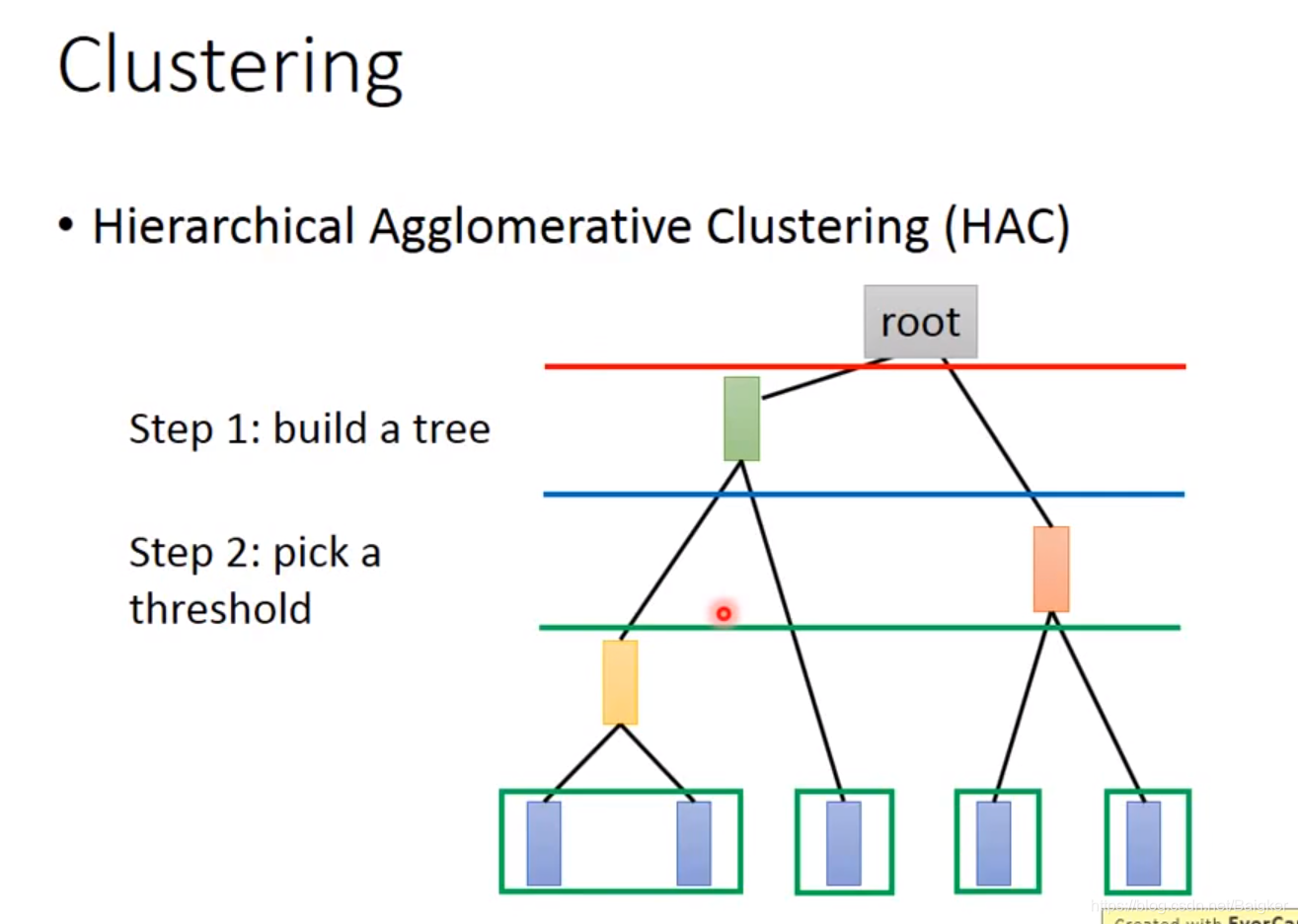

����һ��HAC�ķ���:

- ÿ��ѡ���������ƶ���ߵĵ�,�ϳ�һ���㡣ֱ���ϳ�һ��root��

- ѡȡ��ֵ(threshold),������˵�����ڹ���õ�tree�Ϻ�����һ��,������Ҷ�������ͬһ��cluster

HAC��K-means��������������ξ���cluster������,��K-means��,K��ֵ��Ҫ��ֱ�Ӿ�����;����HAC��,�㲢����Ҫֱ�Ӿ����ֶ���cluster,����ȥ������һ�������������

Dimension Reduction

����,����ķ�����һ����������:�ܶණ��������ֱ��˵������һ��,������ͬʱ���ж��������ԡ�

����:һ���˿��Ի�������,��˲����ܰ�������Ϊ��xx�����ߡ���

���,����Ӧ����һ����������ʾһ�����塣

��ͽ�Distributed Representation��

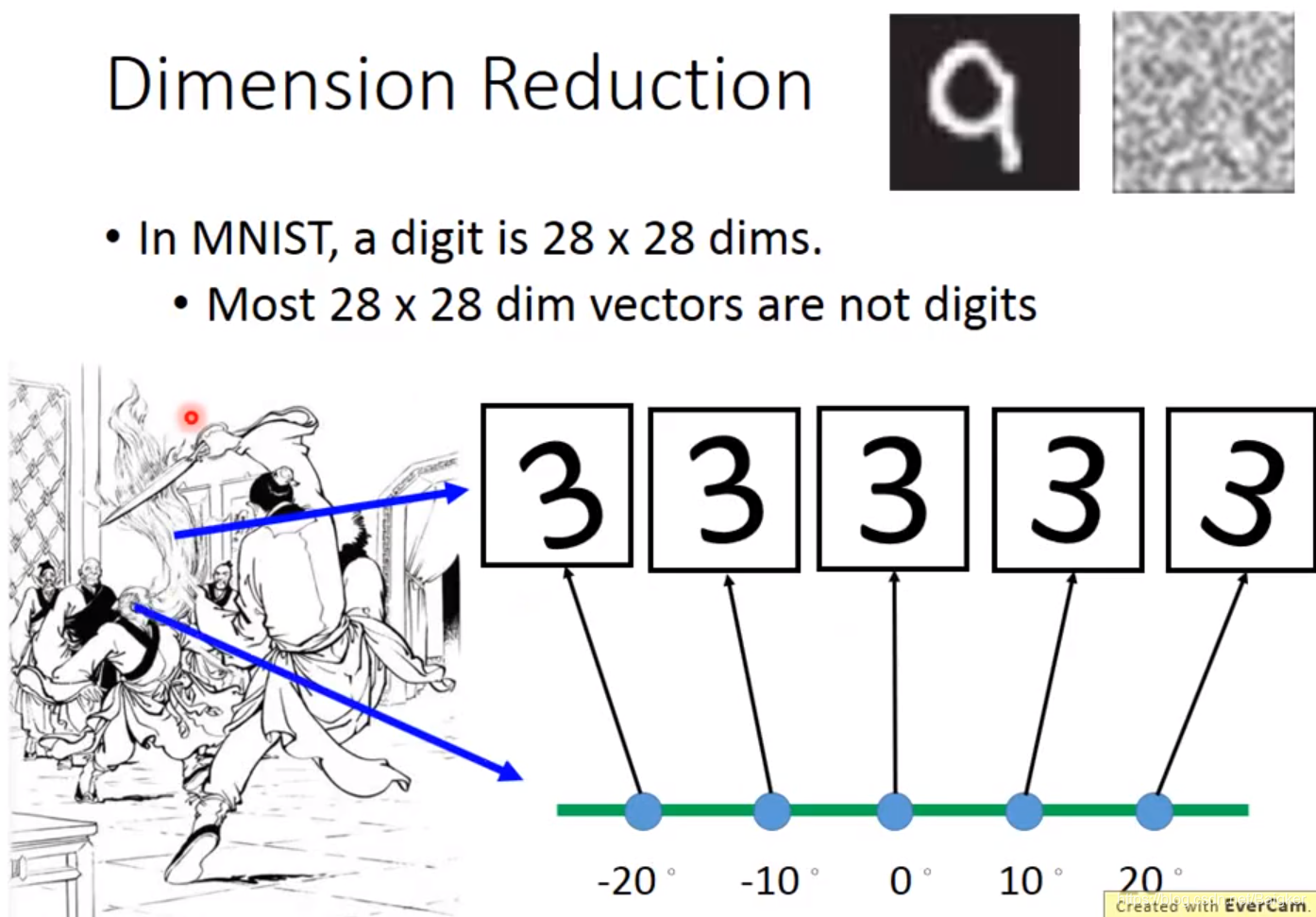

���ԭ�ȵ�object��high dimension��,����image,��������������������������,�Ϳ���ʹ֮�Ӹ�ά�ռ�ת��Ϊ��ά�ռ�,�������ν����ά(Dimension Reduction)

��������,�е�ͼƬʵ����ֻ��Ҫ���ٵ�ά�Ⱦ��ܱ�ʾ��:

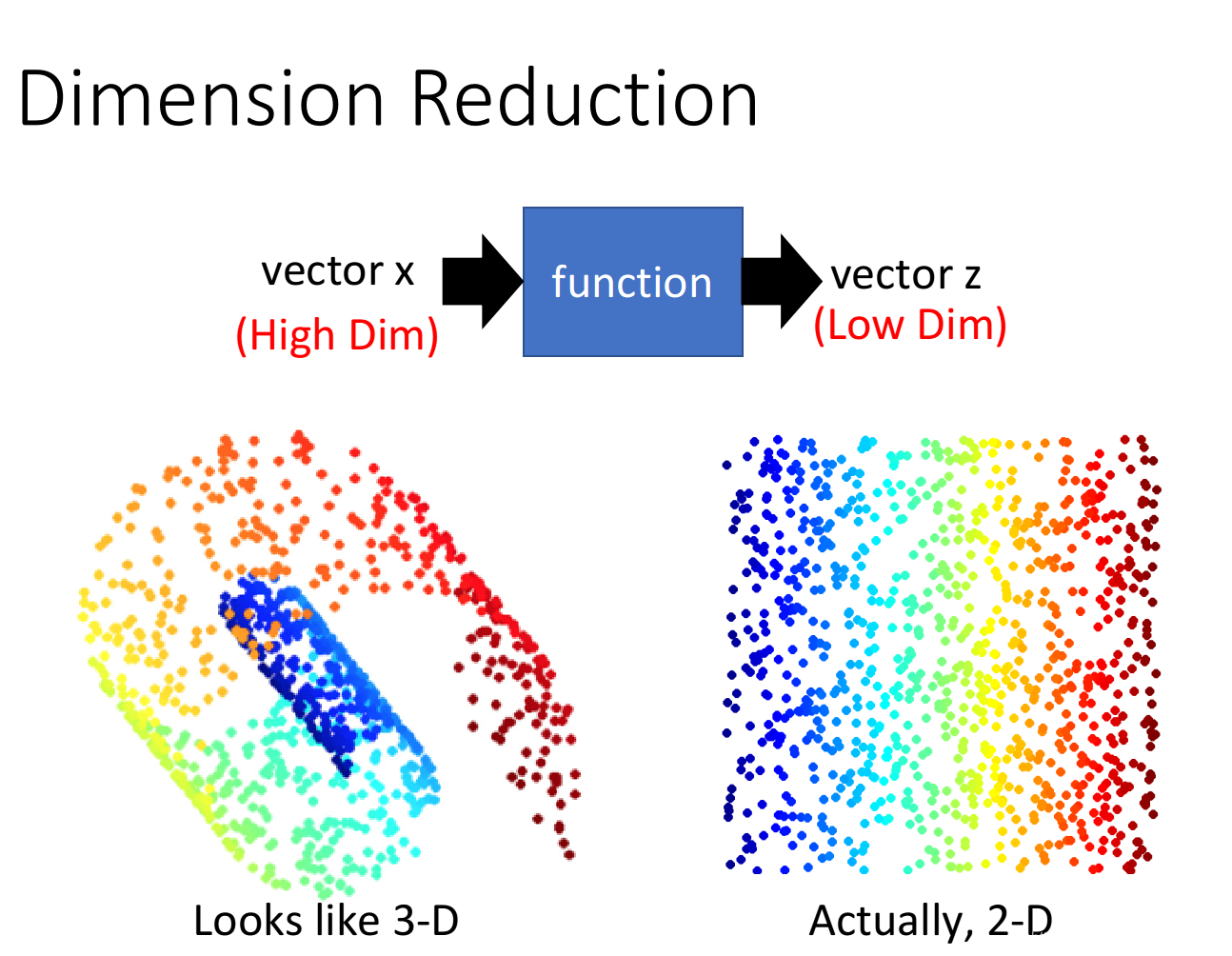

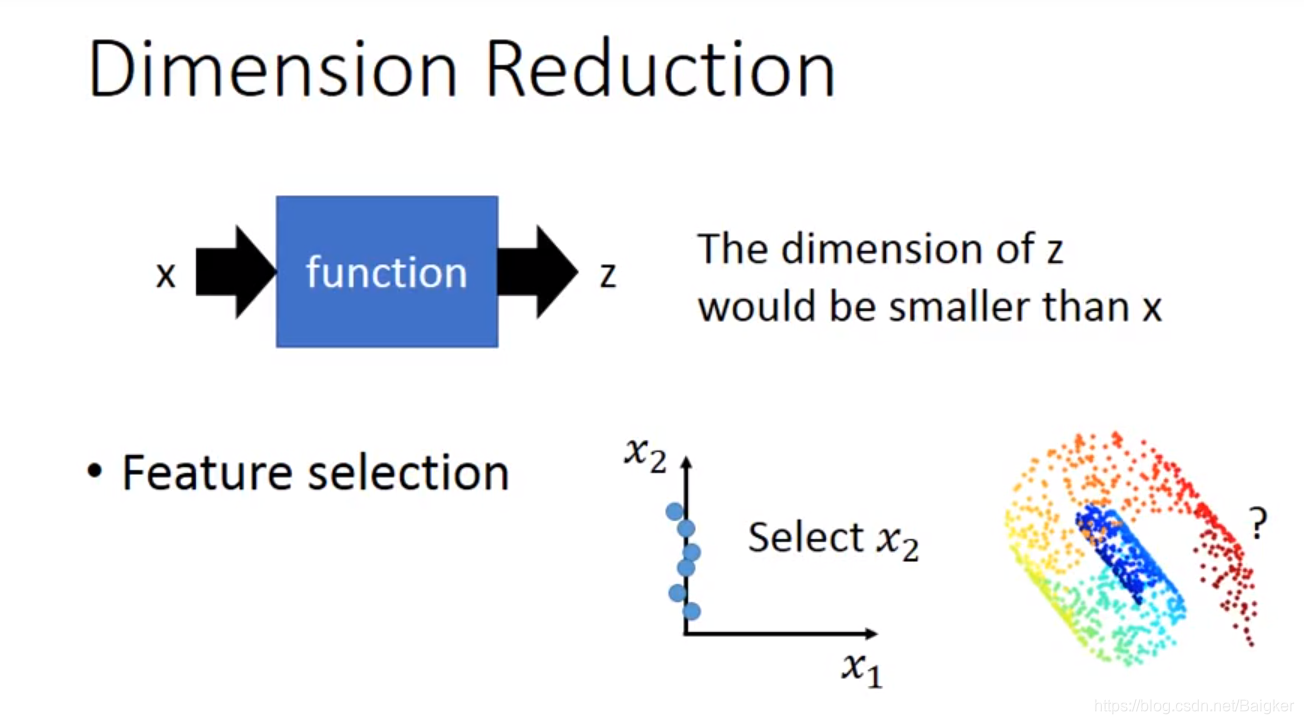

��Dimension Reduction��,����Ҫ��һ��function,���function��input��ԭʼ��x,output�Ǿ�����ά֮���z

��ķ�����Feature Selection,��ֱ�Ӵ�ԭ�е�dimension���õ�һЩֱ���ϾͶԽ��û��Ӱ���dimension,�������˽�ά,������ͼ�д�

x

1

,

x

2

x_1,x_2

x1?,x2?����ά����ֱ���õ�

x

1

x_1

x1?;�������������������,��Ϊ�ܶ�������κ�һ��dimension��ʵ�����ܱ��õ�,������ͼ�е���������

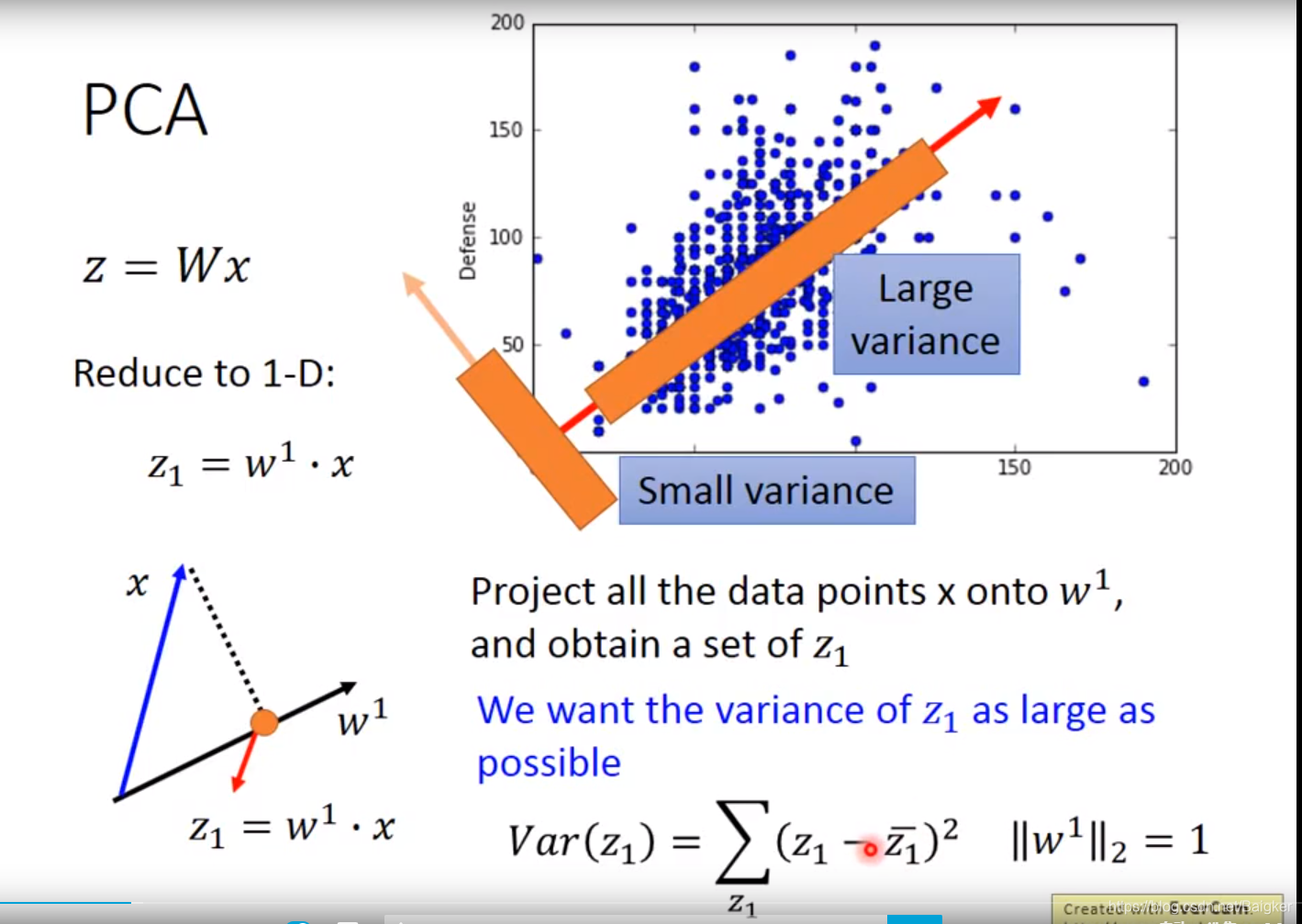

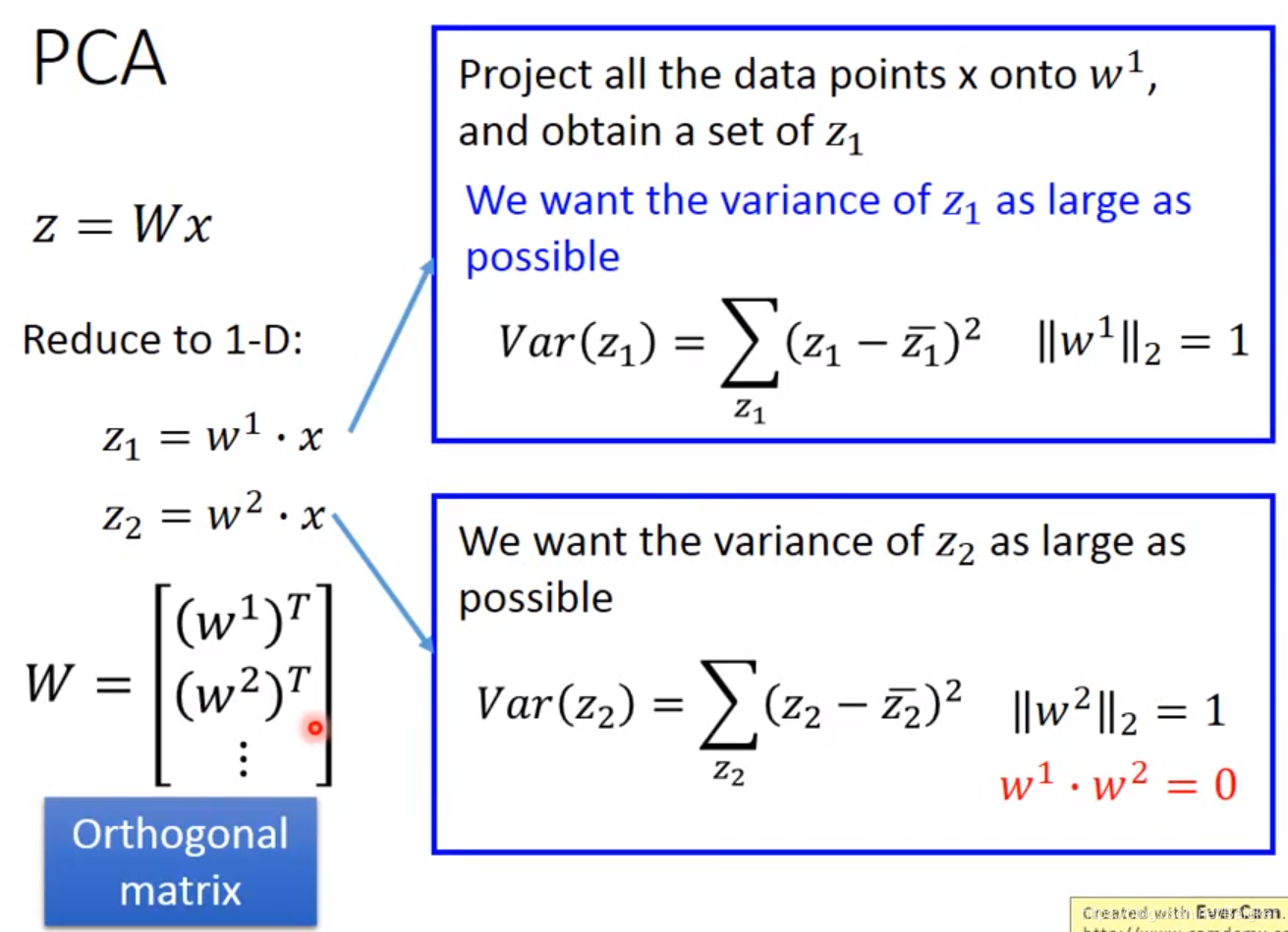

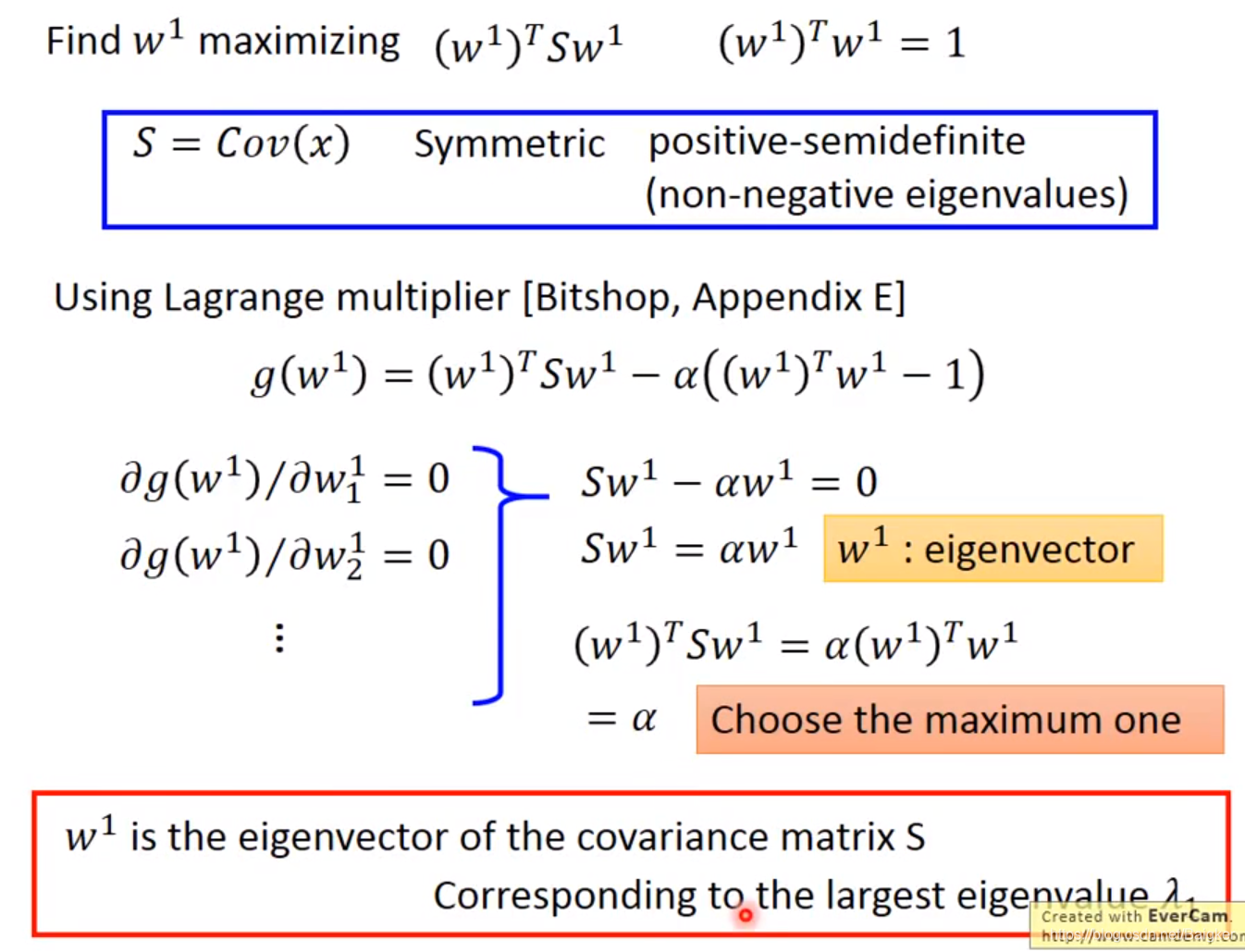

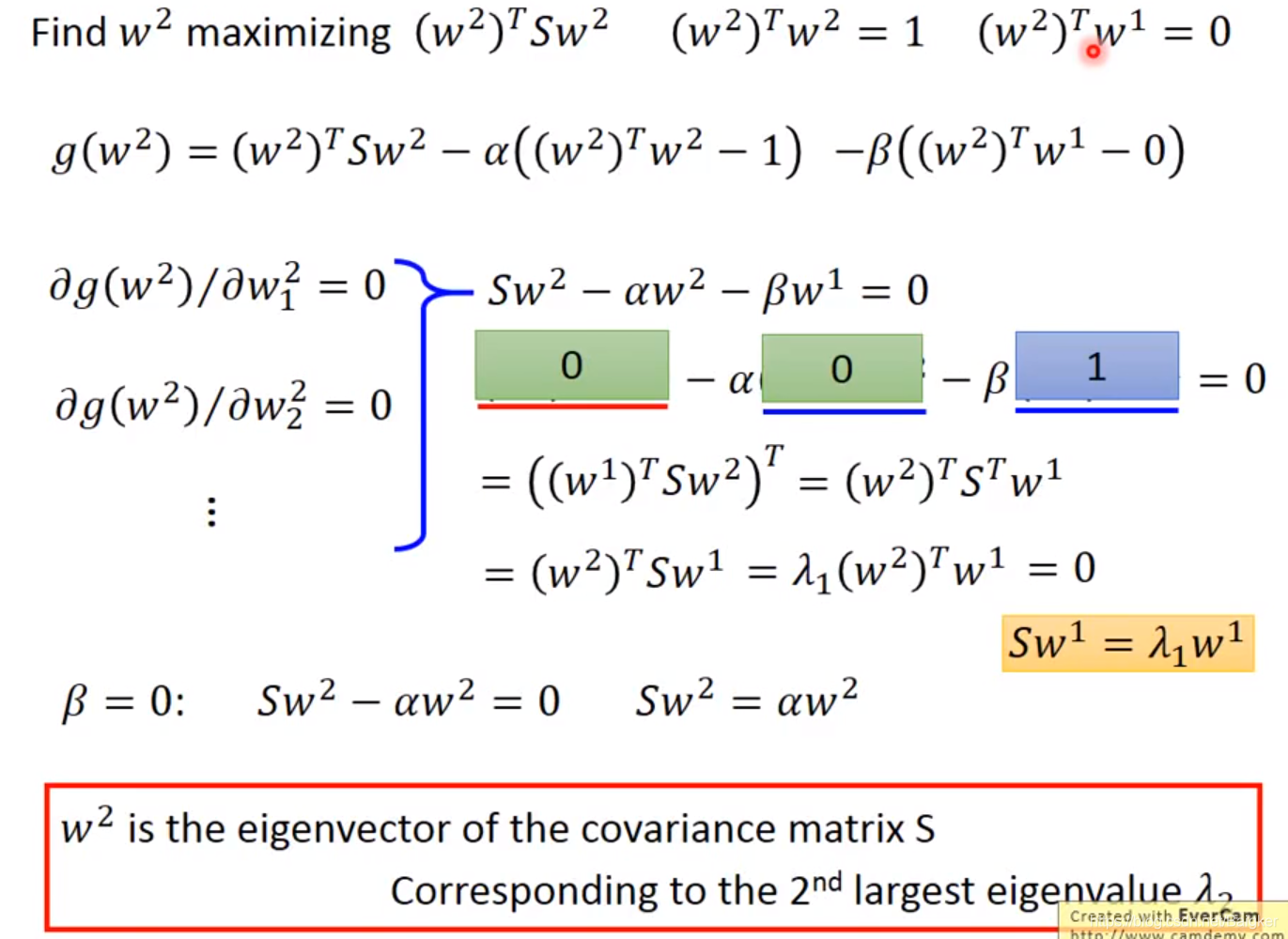

PCA

��һ�ַ�������PCA��

��ѧ�Ƶ�

PCA��Ϊ,����ֻҪ�ҵ�һ��

W

W

W,��

z

=

W

x

z=Wx

z=Wx��ά���ɡ�������ͼ��:

x

x

x�DZ����εĹ������ͷ�����,����Ҫ��һ��

W

W

W,��������ε�ս����

z

z

z������,��Щ

z

z

z�ķֲ�Խ��ɢԽ��(��:

v

a

r

i

a

n

c

e

variance

varianceҪ��)��

�����DZ��1ά�����,���nά�����Ҳ��һ���ġ�ֻҪ������

w

w

w,�˴˻�������,����ƴ����һ��Ϳ����ˡ�

��ô,������

w

w

w��?��ѧ��ʽ���¡�

���Կ���,��ѧ���Ǻܳ��ġ������ڿ���ֱ�ӵ��ú���,��ʵû��ô�鷳��

PCA����ȥ**�����(decorrelation)**�����á�

PCA�����ò�ͬdimension֮���covariance��Ϊ0,����ͬnew feature֮����û��correlation��,�������ĺô���,����feature֮�����ϵ�Ӷ�����model����IJ�������

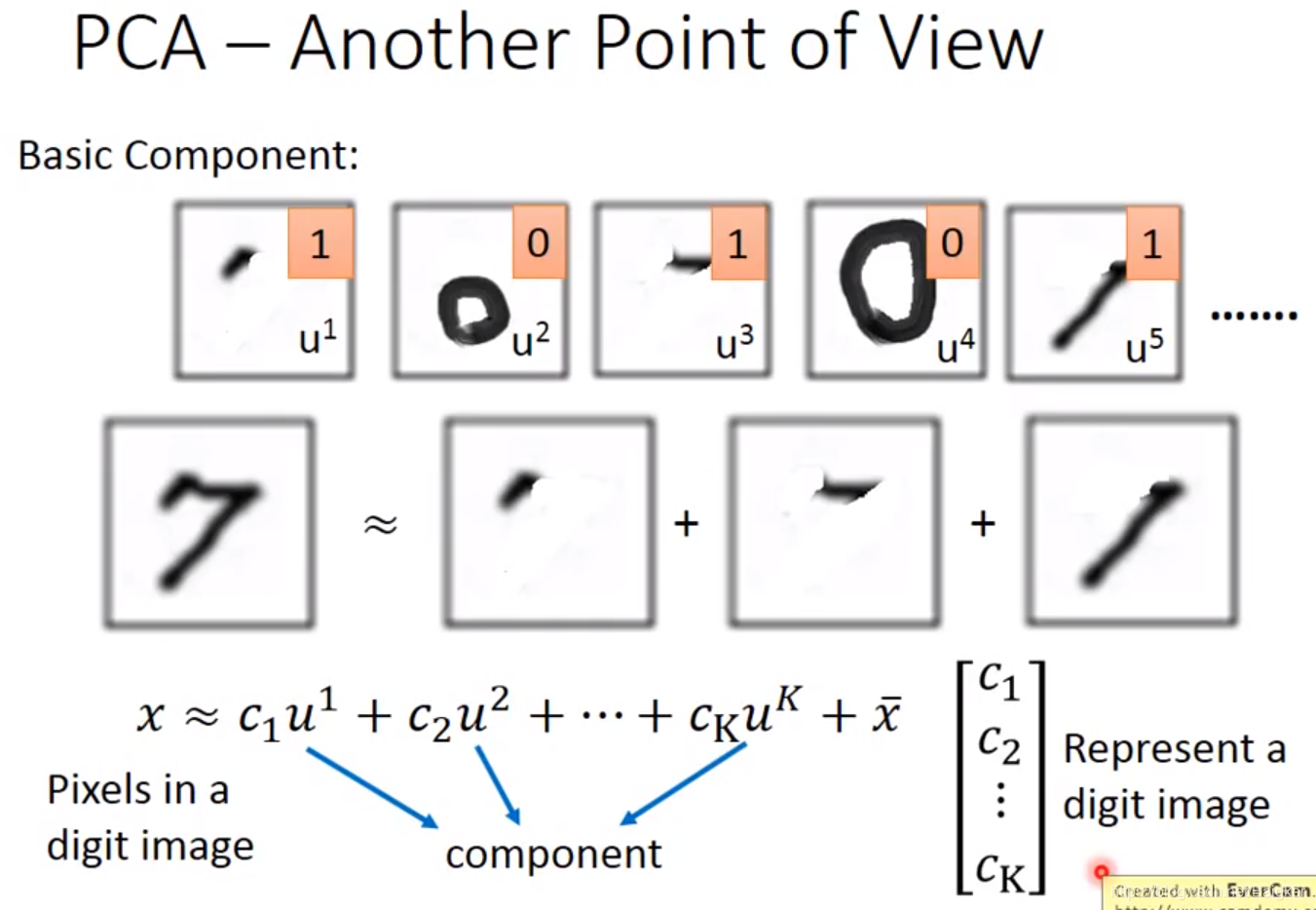

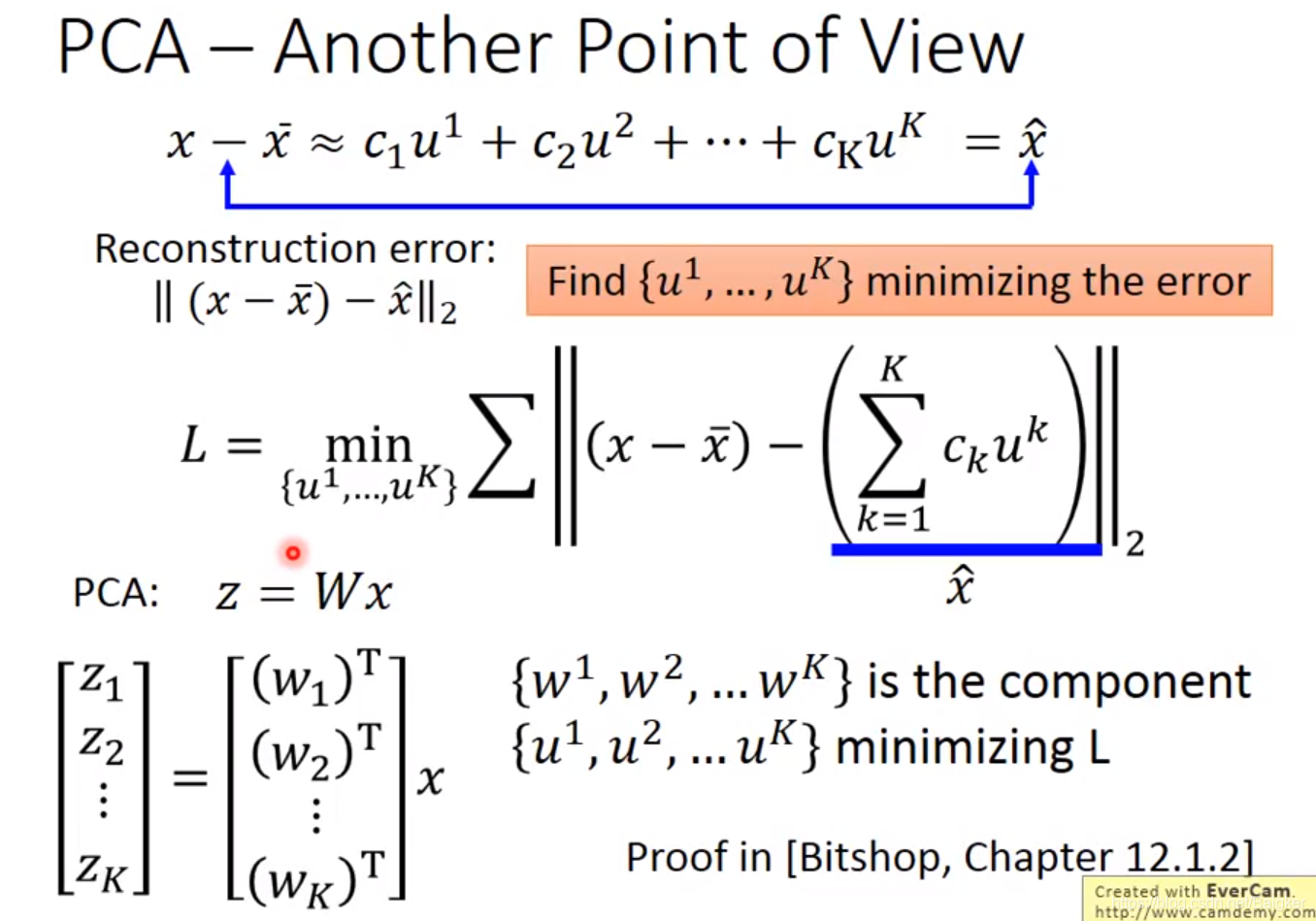

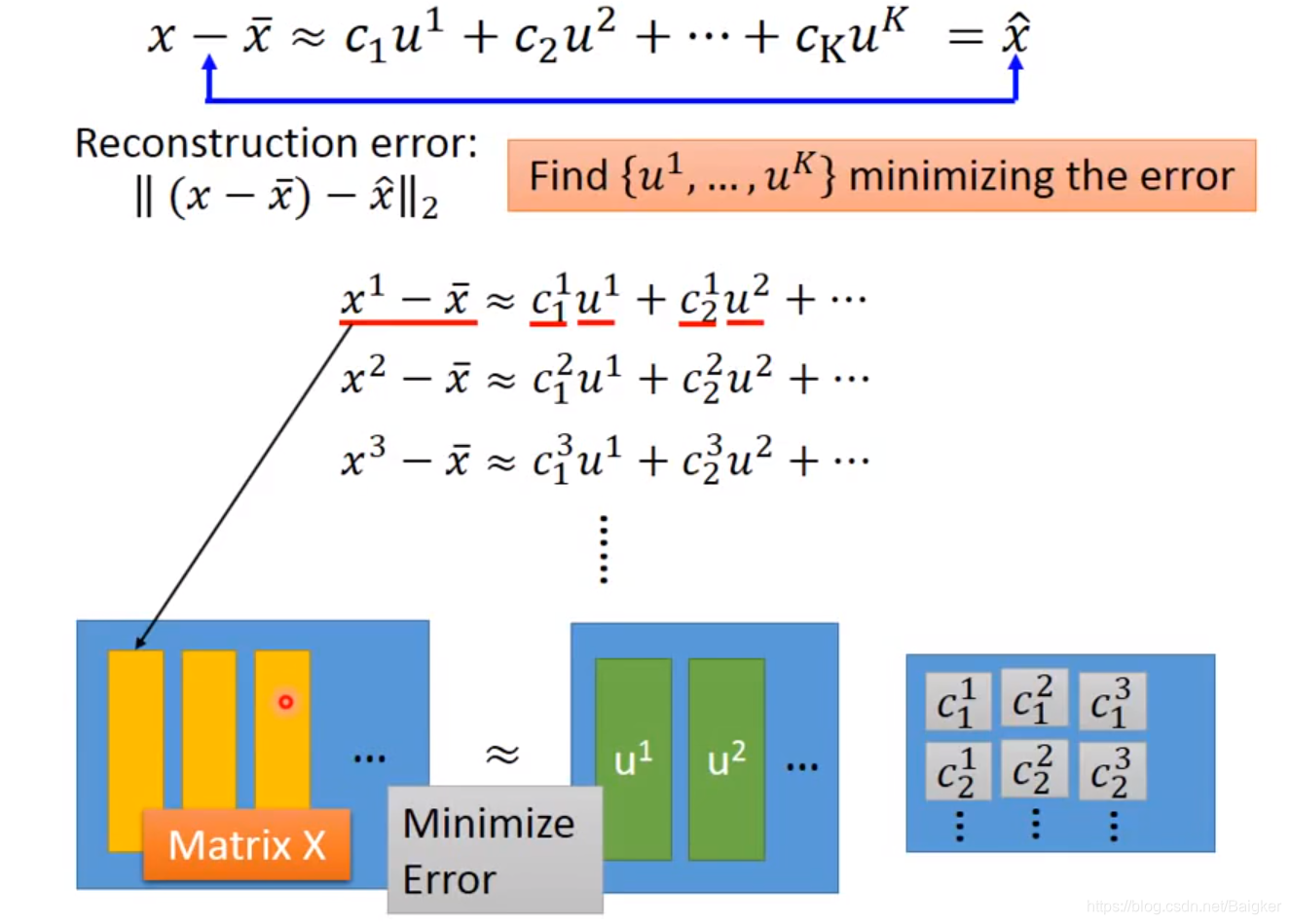

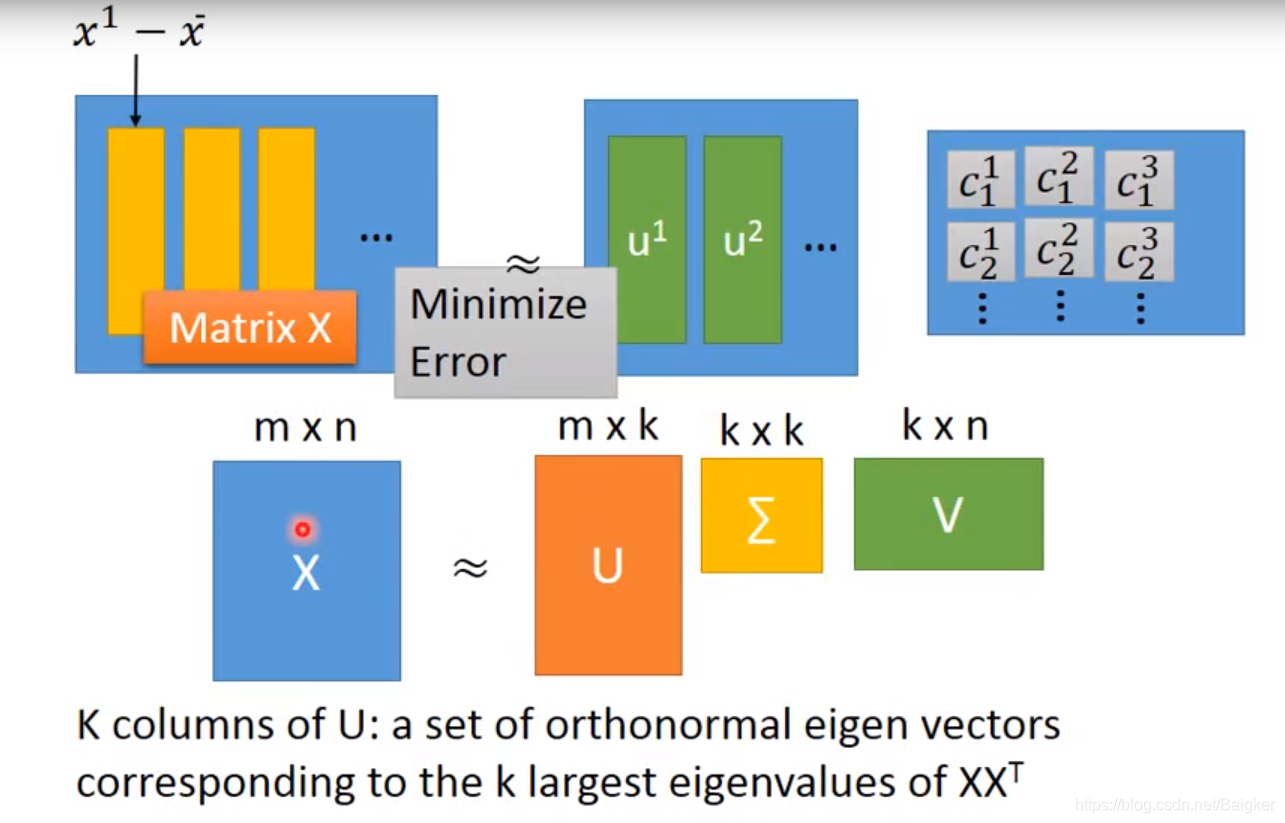

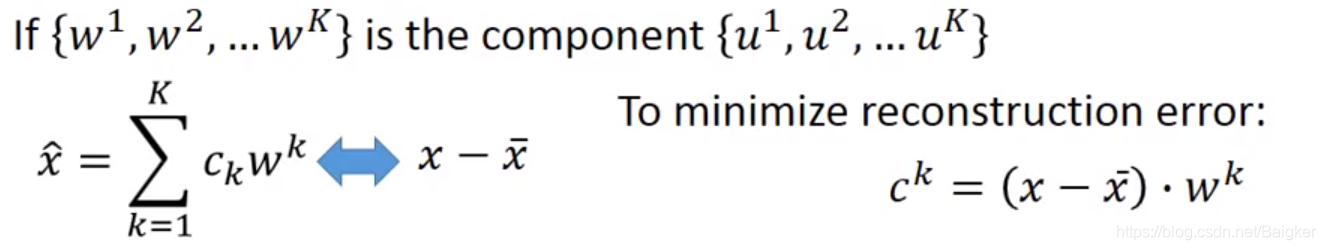

��һ���Ƕȿ�PCA

����д����ʶ��Ϊ��:

���ǿ���һ�����ֿ��ɶ���ʻ������,��������ġ�7����

�Թ�ʽ�Ľ���:

x

x

x��һ��ͼ����������,

c

c

c��Ȩ��,

u

u

u��ʾ�ʻ�,

x

��

\bar x

x��������ͼƬ��ƽ��ֵ��

��

��

c

i

u

i

=

x

^

\sum{c_iu^i}=\hat x

��ci?ui=x^������Ȼ,����ϣ��

x

?

x

��

x-\bar x

x?x����KaTeX parse error: Expected 'EOF', got '}' at position 7: \hat x}?Խ�ӽ�Խ��,����С��

�O

�O

(

x

?

x

��

)

?

x

^

�O

�O

||(x-\bar x)-\hat x||

�O�O(x?x��)?x^�O�O��

���ǵ������ж���ͼƬ,�����

x

x

x,�Ϳ���д�����µ�Loss function����ôĿ��������

u

1

,

u

2

,

.

.

.

,

u

K

u^1,u^2,...,u^K

u1,u2,...,uK��

��Ȥ����,

u

1

,

u

2

,

.

.

.

,

u

K

u^1,u^2,...,u^K

u1,u2,...,uK����֮ǰPCA�����

w

1

,

w

2

,

.

.

.

,

w

K

w^1,w^2,...,w^K

w1,w2,...,wK��

�������

W

W

W֮��,�Ϳ�����Ȩֵ

C

C

C�ˡ�

PCA��ȱ��

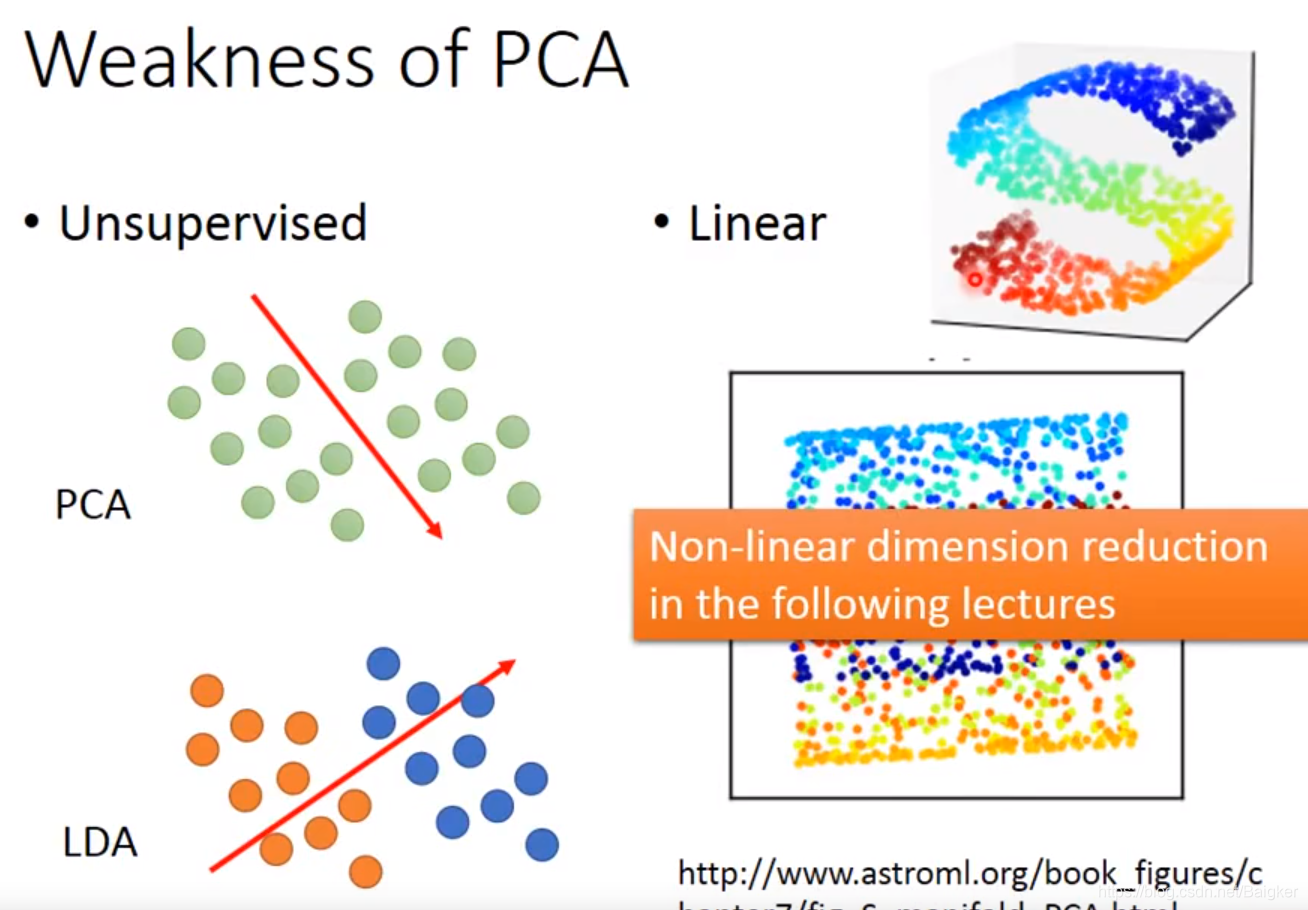

- ����Unsupervised�ġ�PCA�ܿ�������һ������,��������class�ĵ㱻������һ���������:ʹ������labeled data��LDA����,������supervised�ġ�

- ����Linear�ġ�PCAֻ�ܰѷֲ����,��������ֱ�����������ηֲ�ʱЧ���ܲ��á��������:ʹ��non-linear transformation��

PCA������

������

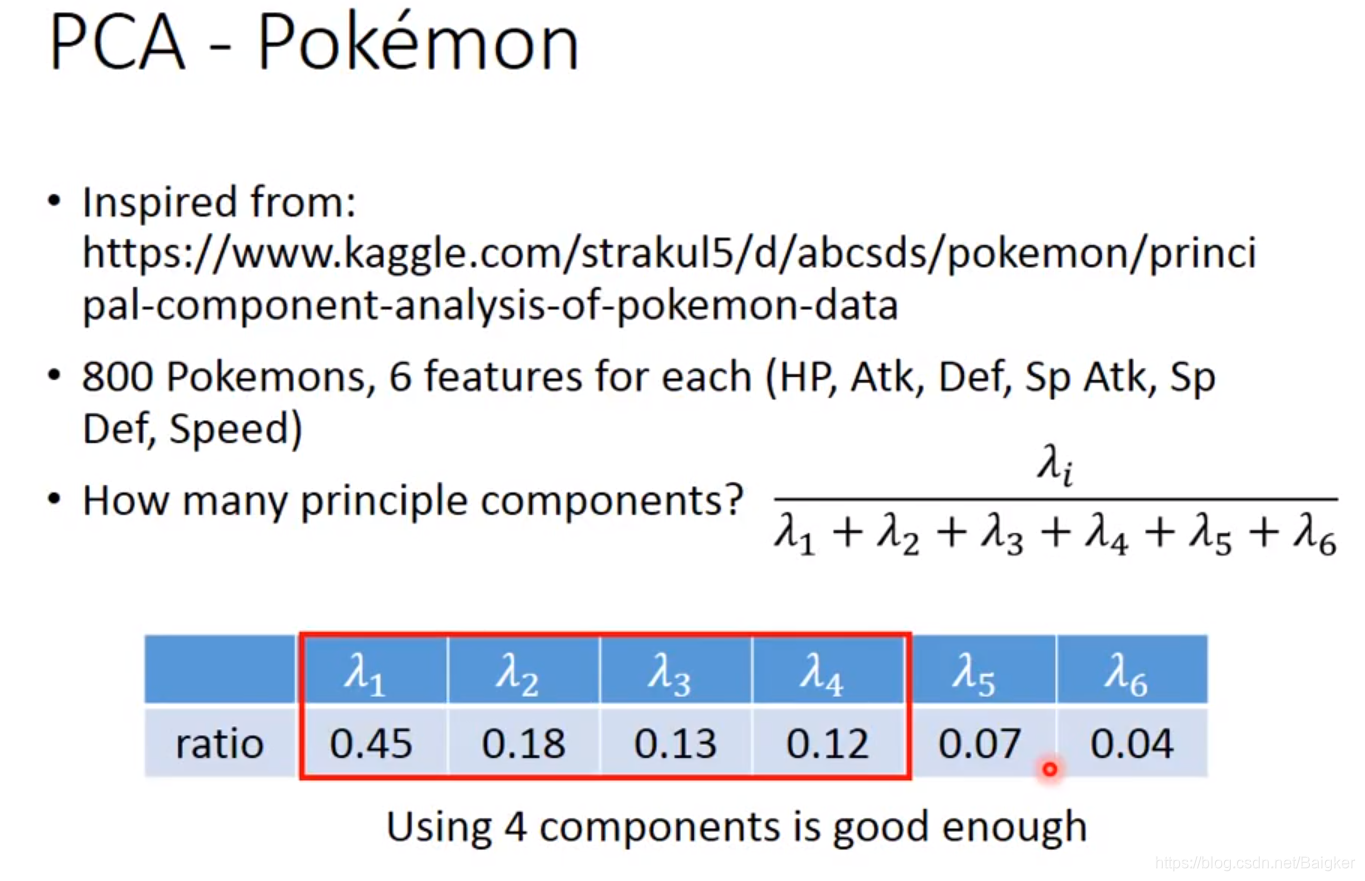

ÿ��������������ά�ȼ�vector={HP, Atk, Def, Sp Atk, Sp Def, Speed},���ǵ�Ȼ������PCA�����������Ρ�

������һ������:���ǿ������ҳ�6�����������Ͷ�Ӧ������ֵ

��

i

\lambda_i

��i?,����

��

i

\lambda_i

��i?��ʾ��i��ͶӰά�ȵ�variance�ж��(���ڵ�i��ά�ȵ�ͶӰ�ϵ�ļ��г̶��ж��),Ȼ�����ǾͿ��Լ����ÿ��

��

i

\lambda_i

��i?�ı����������Ƚ�С�����������б����εĹ���,�����ǵķ�����������,����������������ͼ�е�5��6��

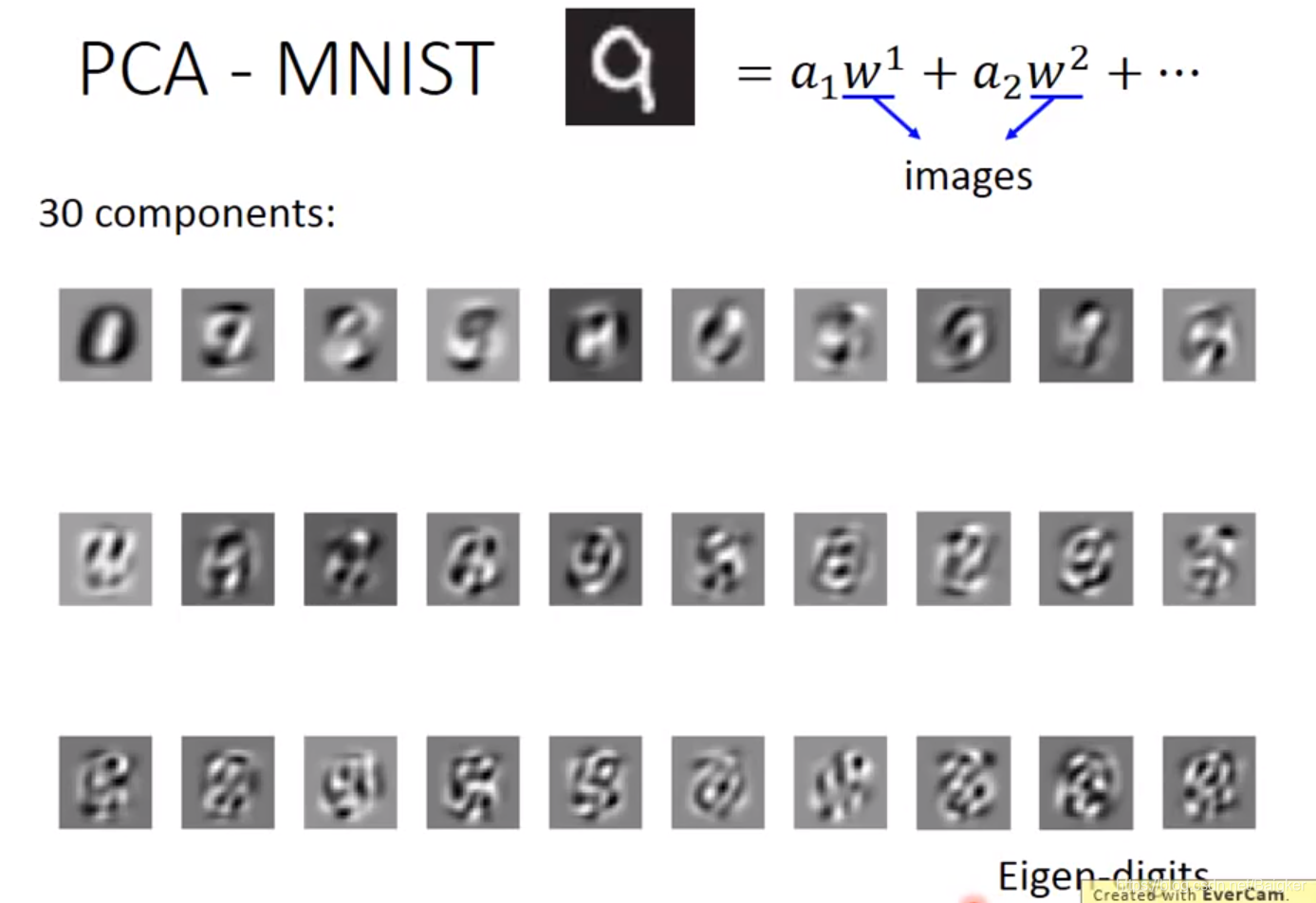

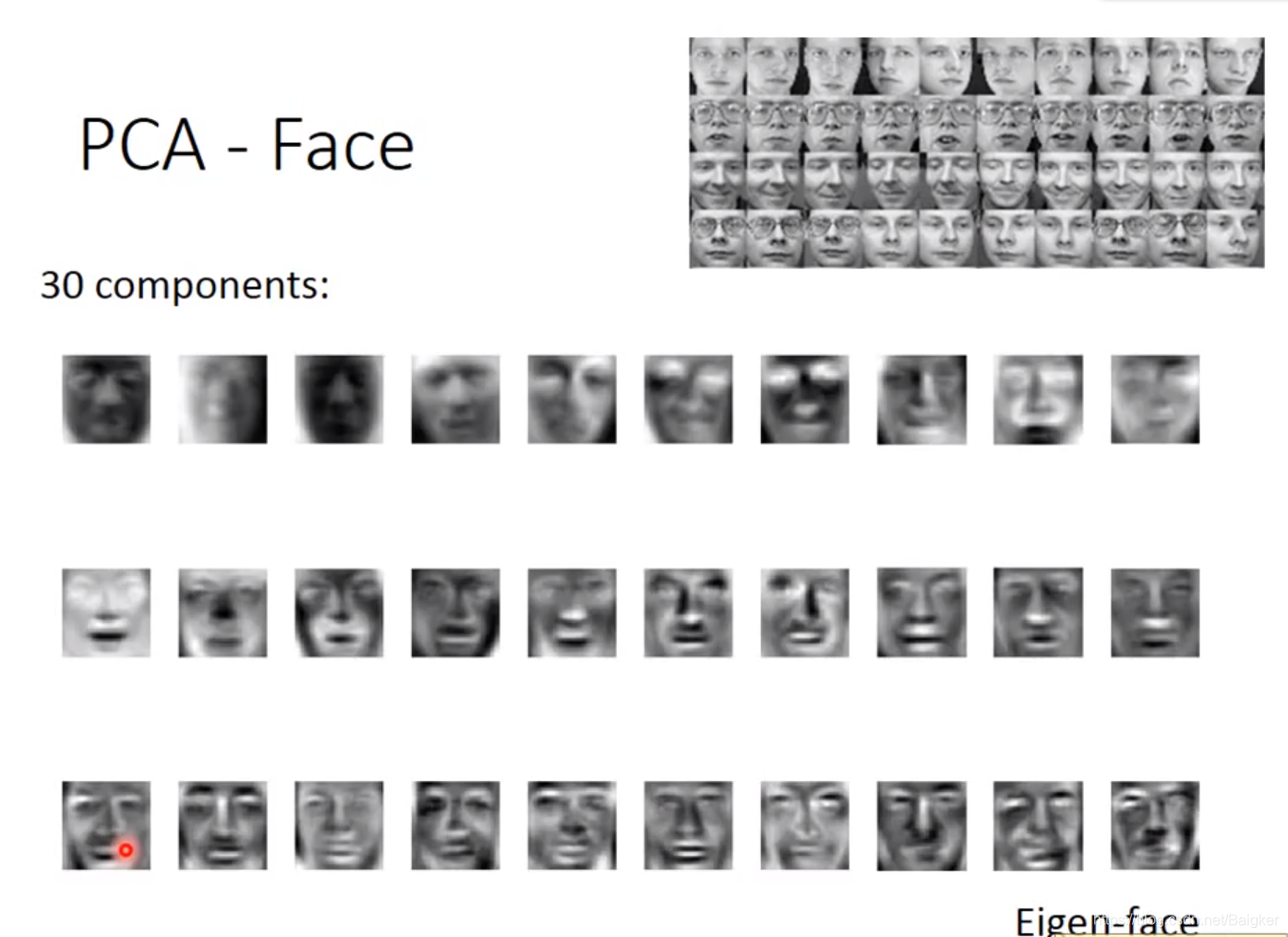

��д����ʶ��

���Կ���,ÿ��component�е���ʻ�,�Ƚϼ�;�е�������;���е�����������,�ܸ��ӡ�

���ƺ������ǵij���(�����ֲ�ֳɱʻ�)��Щ������

����ʶ��

��������ʶ��,��������������:��������component����һ�����������!

�ص���ʽ����,���ѷ���ԭ��:

a

a

a����Ϊ��������ʹ�����PCA��һ�����ø���component���ӳ�

x

x

x,���п�����������ͨ���ӼӼ����϶����Ի�û��������Ԫ�ء�

����Ȼ�������ǵij��ԡ�

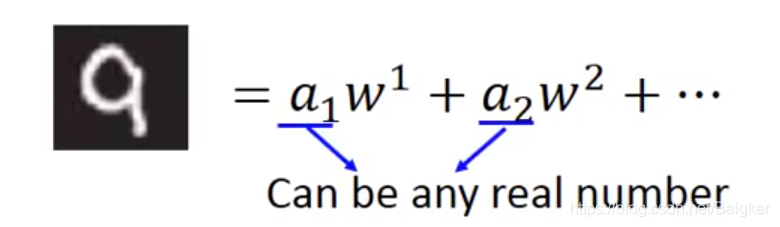

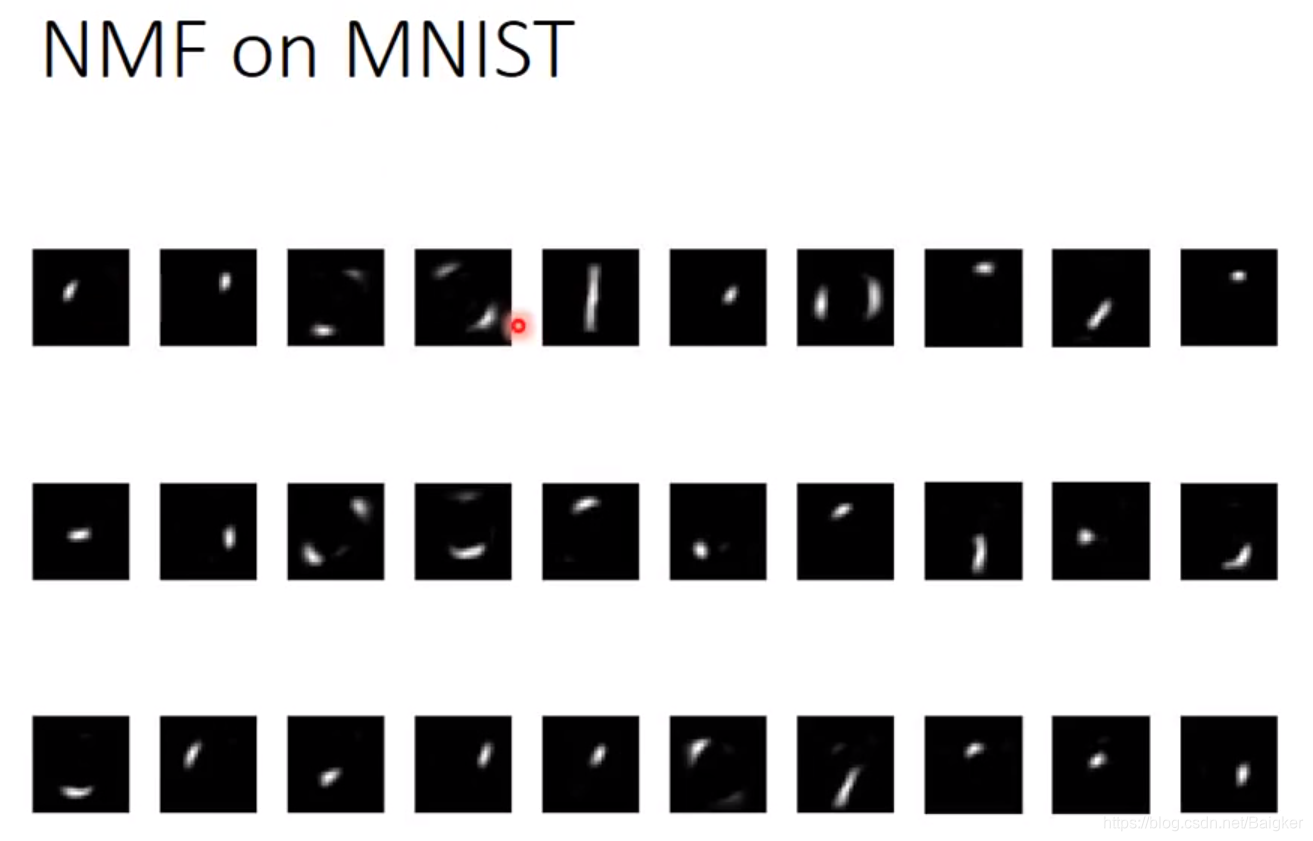

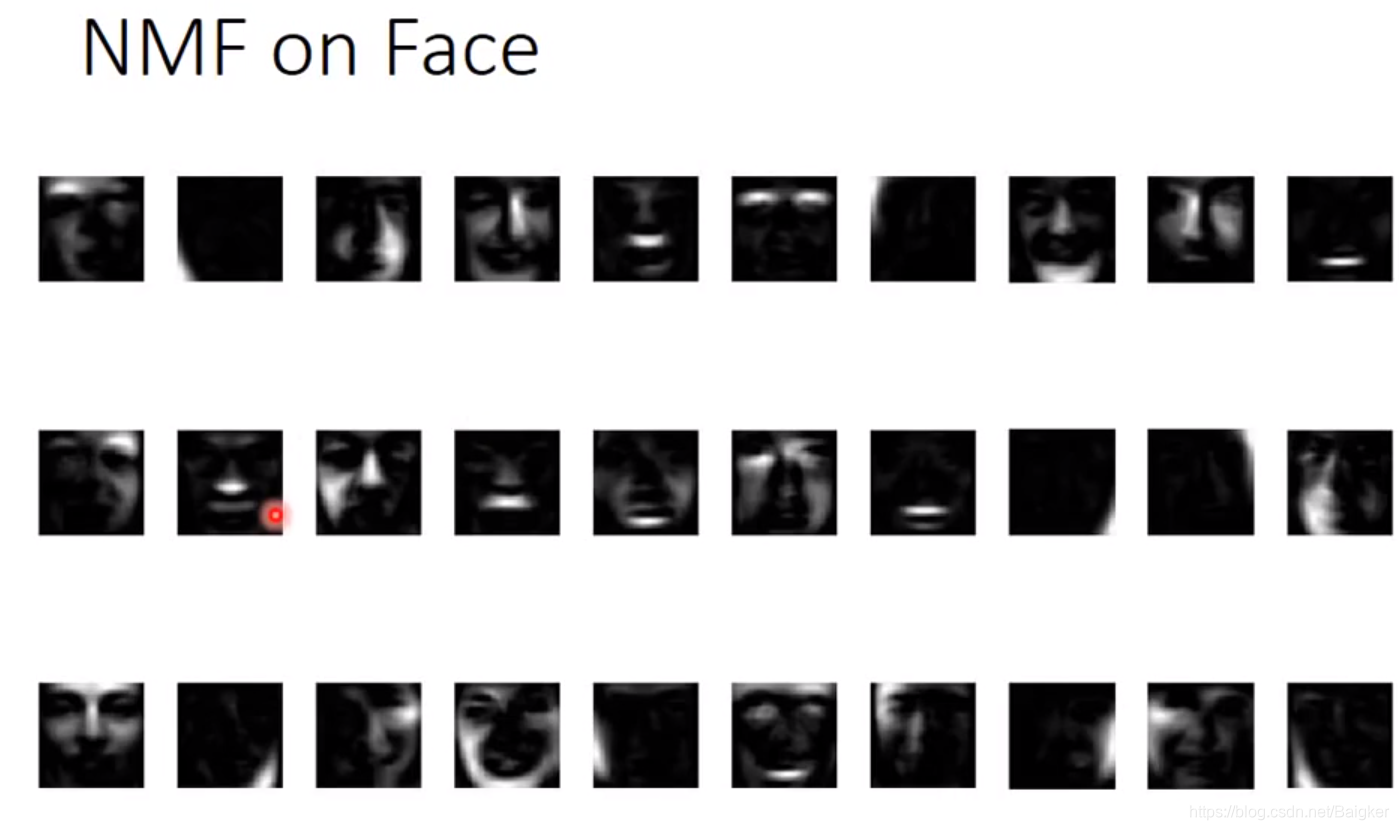

�������:NMF��

NMF�Ļ���������,ǿ��ʹ������������ļ�Ȩֵ������������,Ҳ����˵����ͼ������������ӵõ���

���ֱּ��ķ���Ч���Ǻܺõ�:

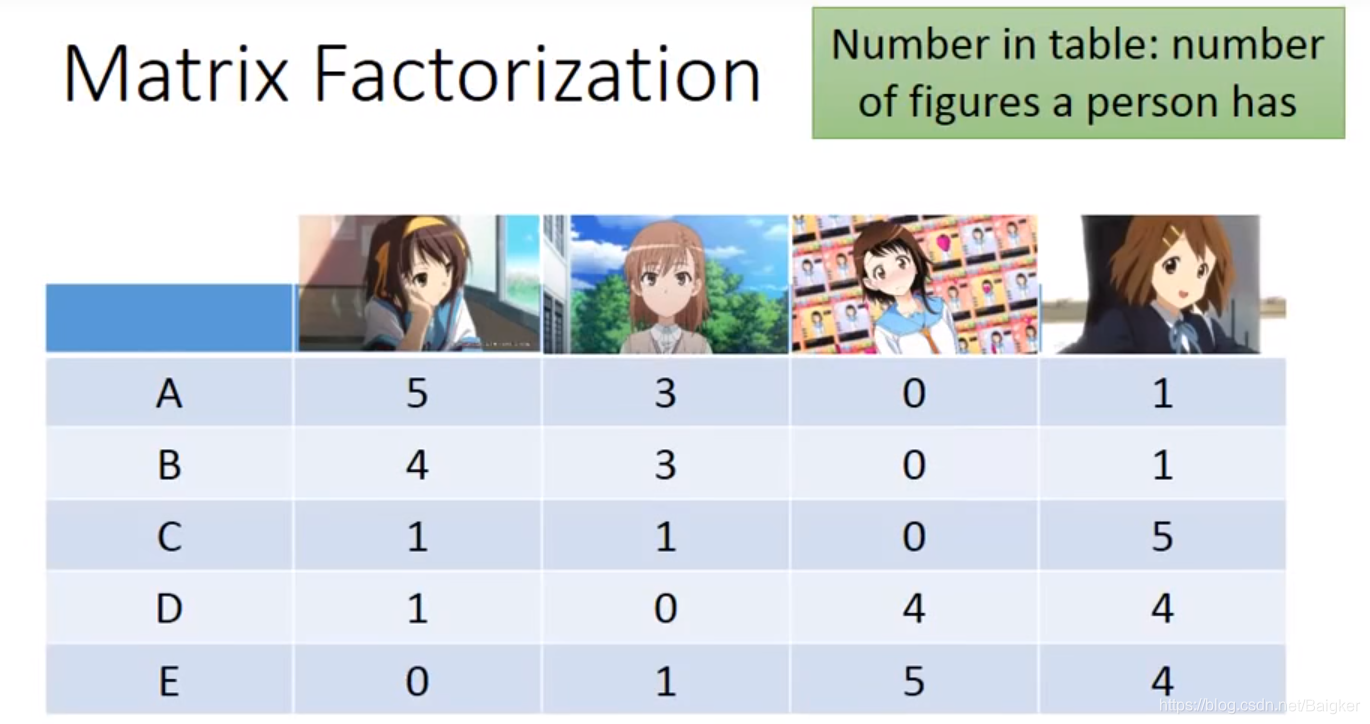

Matrix Factorization

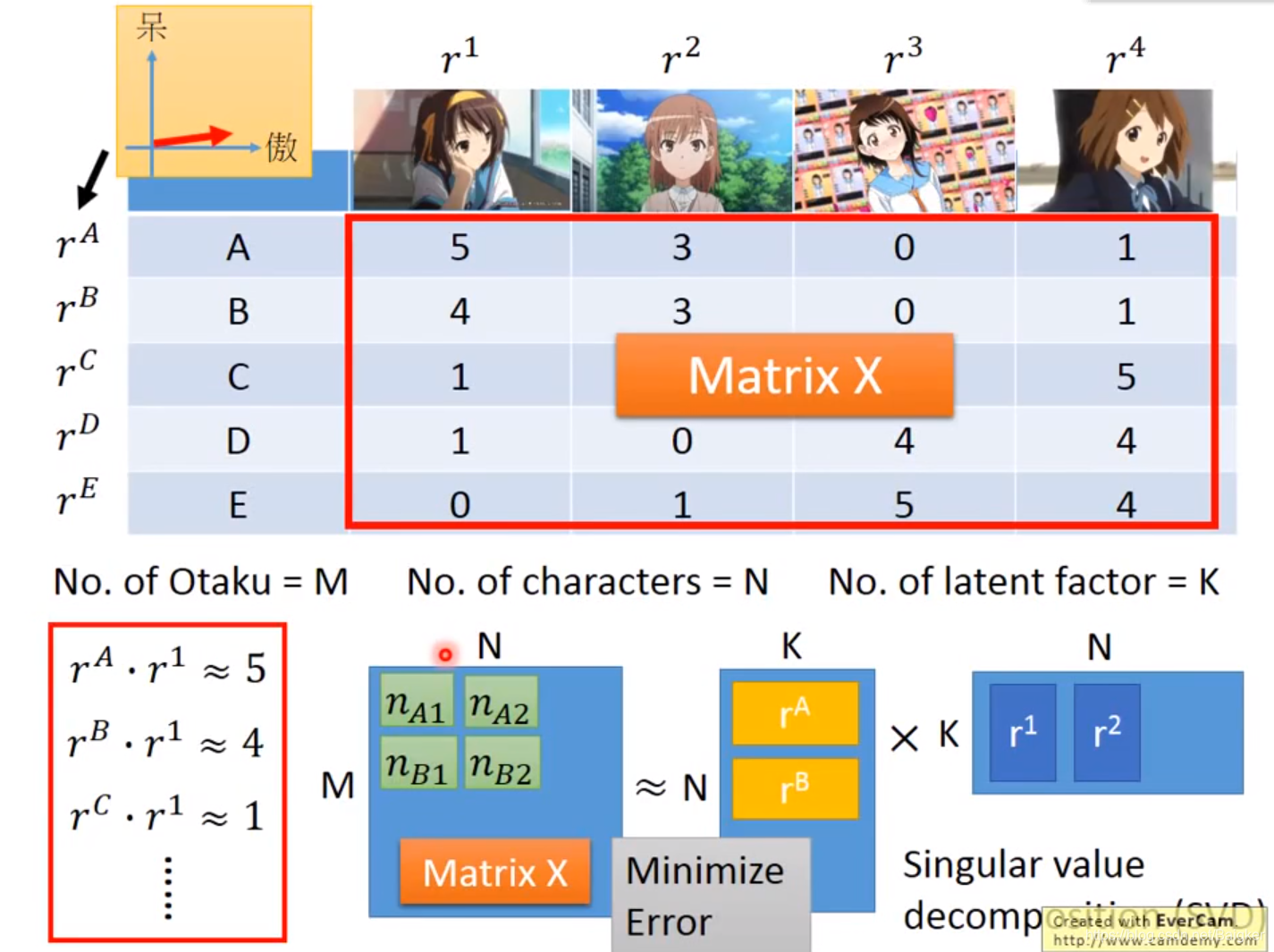

����������:

������ABCDE���˵ı���ӵ�����(����):

��˵:û����Ե�ʵİ�,Ҳû����Ե�ʵĺޡ�һ������ʲô������Ȼ����������ԭ��,��������Ҫ̽�������е�ԭ��

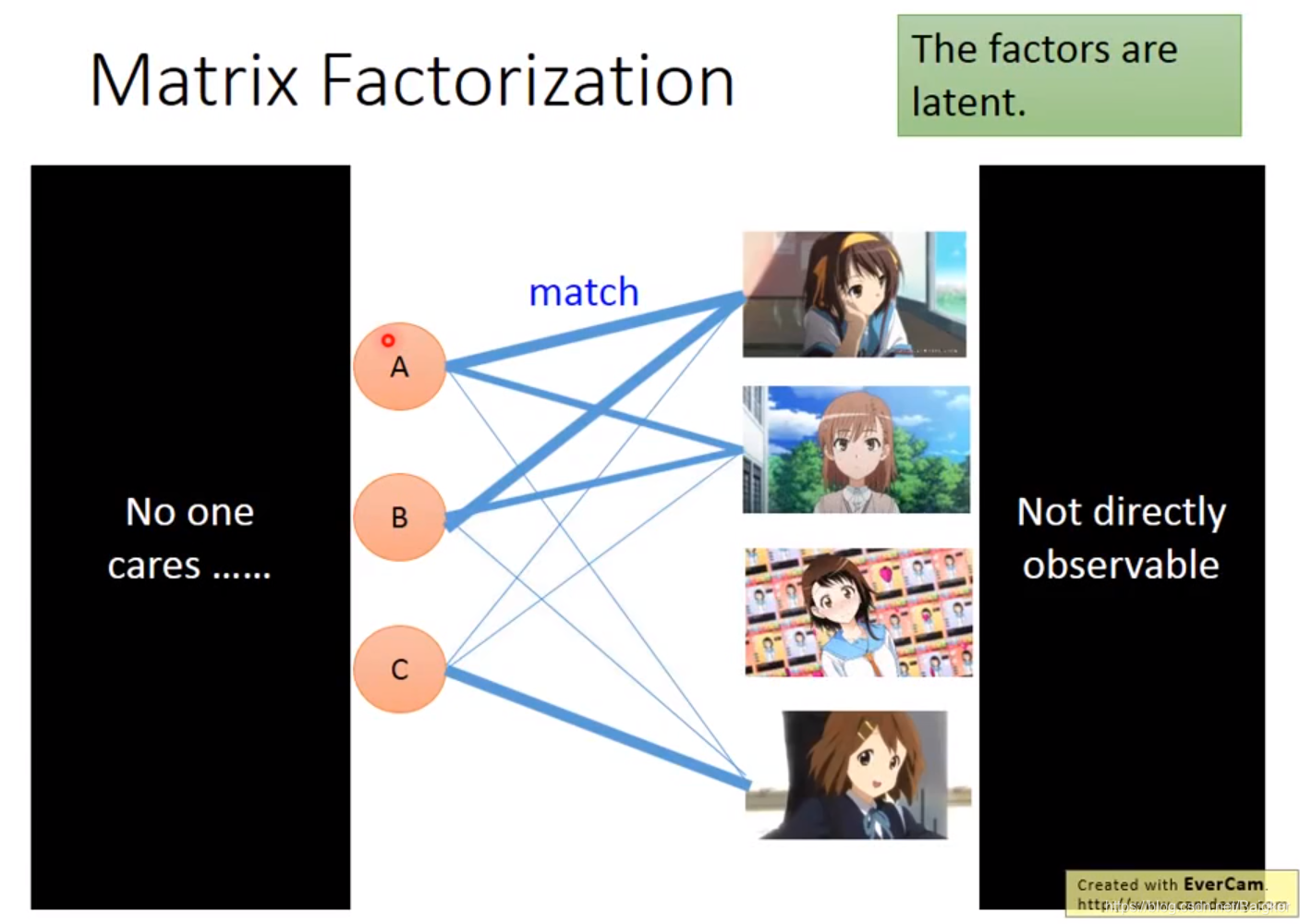

����֮ǰReduction���뷨,������һ�²²�:

ÿ����ɫ��һЩ����,��̶ȿ�����һ����������ʾ(�����������Ȼ��);ÿ���˶���Щ�����в�ͬ��ϲ��,ϲ�ó̶�Ҳ������һ����������ʾ��

��һ���˺�һ����������ʱ,���������ĵ�����DZ�����Ӧ�����֡�

��������,��Щ�������Ƕ���֪�������������SVD�������

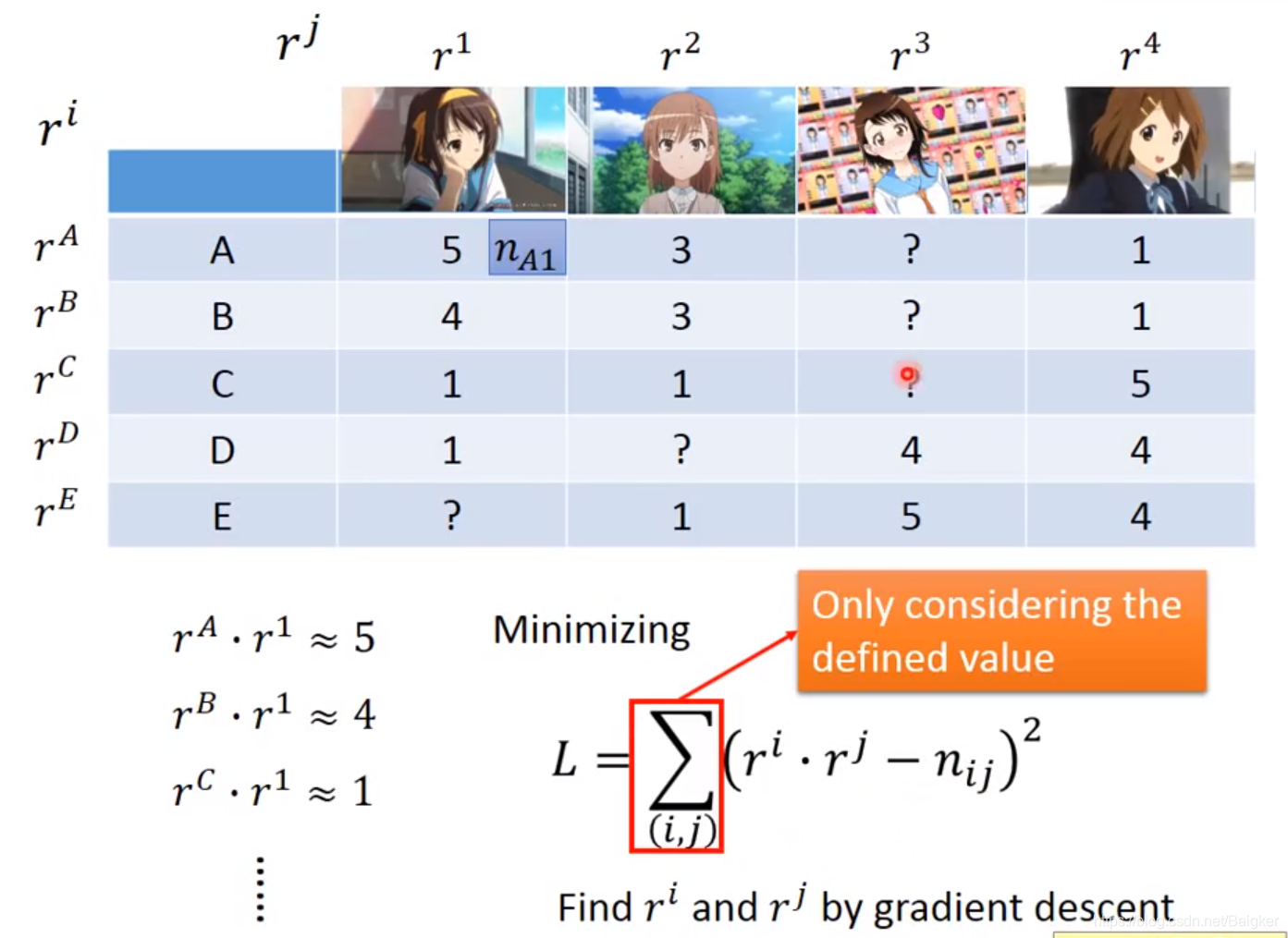

����ʱ��,��������Щ����ʱȱʧ�ġ������Ͳ�����SVD�ˡ�

���ʱ���Ҫ����ʹ��Gradient Descent�������

�Loss Function:

L

=

��

(

i

,

j

)

(

r

i

?

r

j

?

n

i

j

)

2

L=\sum\limits_{(i,j)}(r^i\cdot r^j-n_{ij})^2

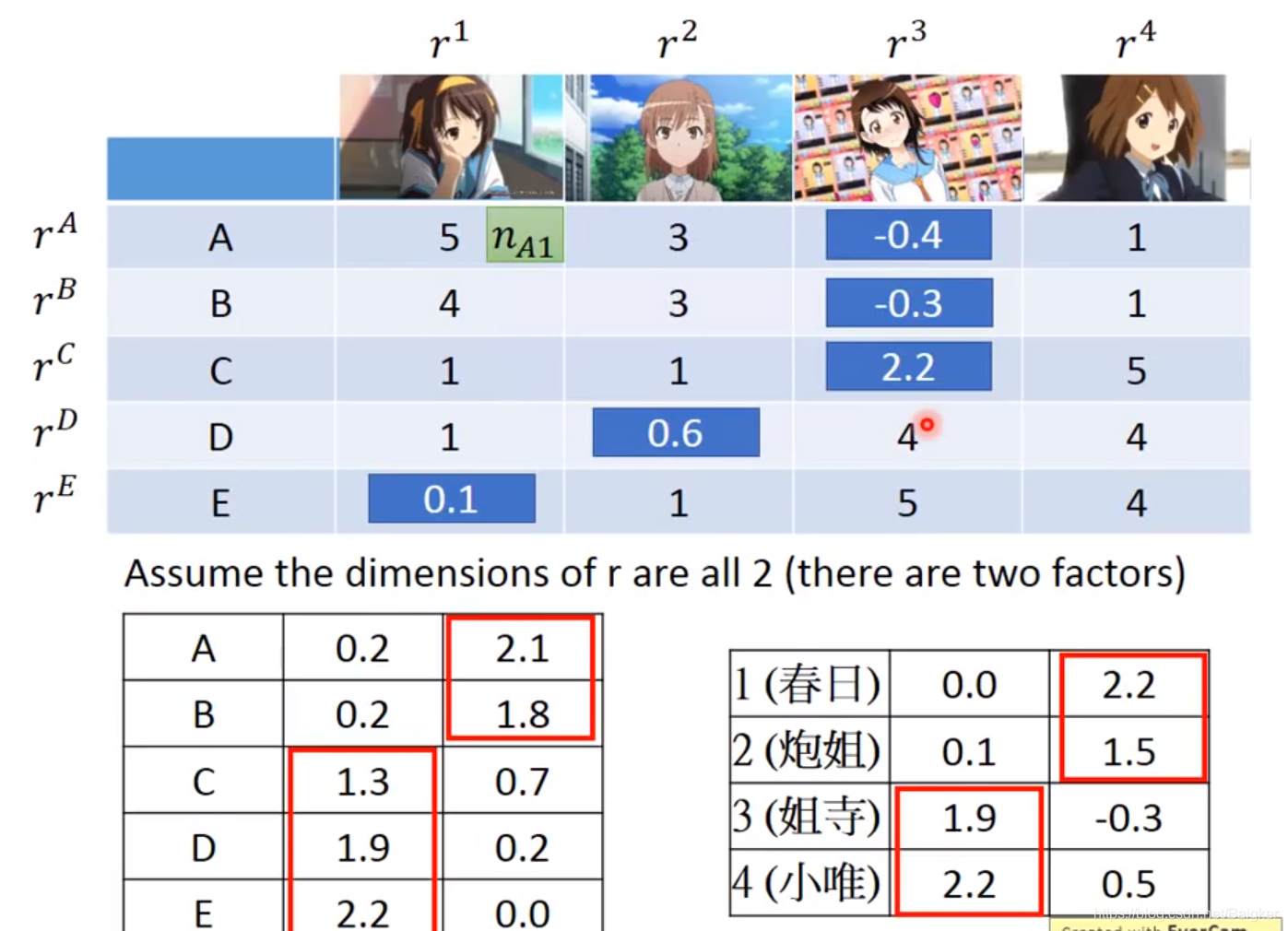

L=(i,j)��?(ri?rj?nij?)2��Ϳ���ֱ��Train�ˡ�

���Կ���,���ϲ��:ÿ����ɫ�����Ժ�ÿ���˵�ϲ�ö�֪����!

���,��Ҳ���Ƽ�ϵͳ�ij��÷�����

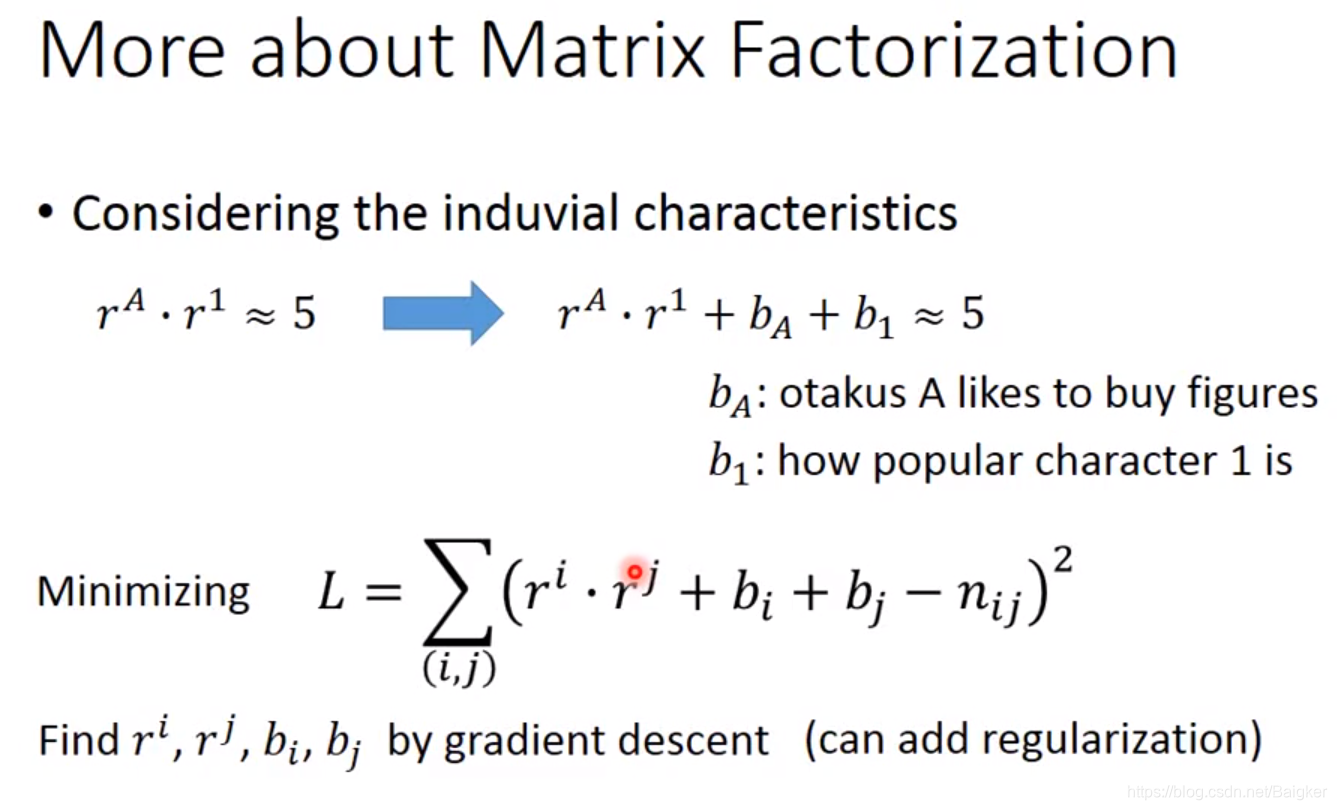

ʵ���ϳ����˺Ͷ�����ɫ������֮��,���ܻ������������زٿع���������һ��ֵ,������ǿ��Խ�ʽ�Ӹ���ȷ�ظ�дΪ:

r

A

?

r

1

+

b

A

+

b

1

��

5

r^A\cdot r^1+b_A+b_1��5

rA?r1+bA?+b1?��5 ����

b

A

b_A

bA?��ʾA����˱����ж�ϲ������,

b

1

b_1

b1?���ʾ���������ɫ�����ж�������Ҫ����,��Щ�����Ǹ�����vector�ص�,��ʱloss function����дΪ:

L

=

��

(

i

,

j

)

(

r

i

?

r

j

+

b

i

+

b

j

?

n

i

j

)

2

L=\sum\limits_{(i,j)}(r^i\cdot r^j+b_i+b_j-n_{ij})^2

L=(i,j)��?(ri?rj+bi?+bj??nij?)2 ��Ȼ��Ҳ���Լ���һЩregularizationȥ�Խ����Լ����