PyTorch学习笔记(4)–DataLoader的使用

????本博文是PyTorch的学习笔记,第4次内容记录,主要介绍DataLoader的基本使用。

1.Dataset和DataLoader的区别

????torch.utils.data.Dataset是代表这一数据的抽象类(也就是基类)。我们可以通过继承和重写这个抽象类实现自己的数据类,只需要定义__len__和__getitem__这个两个函数。

????DataLoader是Pytorch中用来处理模型输入数据的一个工具类。组合了数据集(dataset) + 采样器(sampler),并在数据集上提供单线程或多线程(num_workers )的可迭代对象。在DataLoader中有多个参数,这些参数中重要的几个参数的含义说明如下:

1. epoch:所有的训练样本输入到模型中称为一个epoch;

2. iteration:一批样本输入到模型中,成为一个Iteration;

3. batchszie:批大小,决定一个epoch有多少个Iteration;

4. 迭代次数(iteration)=样本总数(epoch)/批尺寸(batchszie)

5. dataset (Dataset) – 决定数据从哪读取或者从何读取;

6. batch_size (python:int, optional) – 批尺寸(每次训练样本个数,默认为1)

7. shuffle (bool, optional) –每一个 epoch是否为乱序 (default: False);

8. num_workers (python:int, optional) – 是否多进程读取数据(默认为0);

9. drop_last (bool, optional) – 当样本数不能被batchsize整除时,最后一批数据是否舍弃(default: False)

10. pin_memory(bool, optional) - 如果为True会将数据放置到GPU上去(默认为false)

????详情可以参照这个博客:Dataset和Dataloader的理解。

????由于tensorvision中自带了很多数据集,对于练手和神经网络的训练都十分有利,因此需要用Dataset和DataLoader来帮助我们学习。

2.DataLoader的使用

2.1DataLoader的基础使用

????通过查看PyTorch官网 中关于DataLoader类的介绍,所以这里以CIFAR10数据集的使用为例子,简单介绍DataLoader的使用。

????(1)查看数据集CIFAR10中第1张图片的基本信息,代码如下:

# coding :UTF-8

# 文件功能: 代码实现dataloader类的基本功能

# 开发人员: dpp

# 开发时间: 2021/8/13 12:10 上午

# 文件名称: dataloader_test.py.py

# 开发工具: PyCharm

import torchvision

from torch.utils.data import DataLoader

from torch.utils.tensorboard import SummaryWriter

# 准备的测试数据集 数据放在了CIFAR10文件夹下

test_data = torchvision.datasets.CIFAR10("./CIFAR10", train=False, transform=torchvision.transforms.ToTensor())

test_loader = DataLoader(dataset=test_data, batch_size=4, shuffle=True, num_workers=0, drop_last=False)

# 测试数据集中第一张图片及target

img, target = test_data[0]

print(img.shape)

print(target)

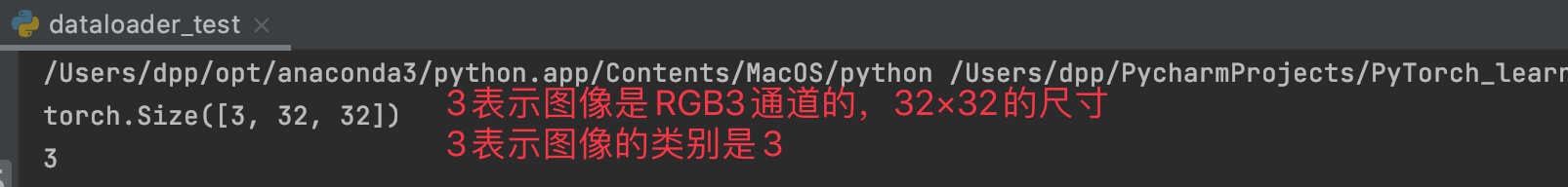

????上述代码输出结果如下,展示的是读取到的CIFAR10中第一张照片的形状信息和类别target信息。

????(2)batch_size=4对数据读取的作用,表示一次性读取数据集中的4张图片,并且集合在一起进行返回,代码如下:

# coding :UTF-8

# 文件功能: 代码实现dataloader类的基本功能

# 开发人员: dpp

# 开发时间: 2021/8/13 12:10 上午

# 文件名称: dataloader_test.py.py

# 开发工具: PyCharm

import torchvision

from torch.utils.data import DataLoader

from torch.utils.tensorboard import SummaryWriter

# 准备的测试数据集 数据放在了CIFAR10文件夹下

test_data = torchvision.datasets.CIFAR10("./CIFAR10", train=False, transform=torchvision.transforms.ToTensor())

test_loader = DataLoader(dataset=test_data, batch_size=4, shuffle=True, num_workers=0, drop_last=False)

# 测试数据集中第一张图片及target

img, target = test_data[0]

print(img.shape)

print(target)

# 在定义test_loader时,设置了batch_size=4,表示一次性从数据集中取出4个数据

for data in test_loader:

imgs, targets = data

print(imgs.shape)

print(targets)

????上述代码输出结果如下,展示的是batch_size=4时返回的结果。

????(3)将epoch设置为2时,对数据集进行两次完整的遍历加载,同时设置batch_size=4,代码如下:

# coding :UTF-8

# 文件功能: 代码实现dataloader类的基本功能

# 开发人员: dpp

# 开发时间: 2021/8/13 12:10 上午

# 文件名称: dataloader_test.py.py

# 开发工具: PyCharm

import torchvision

from torch.utils.data import DataLoader

from torch.utils.tensorboard import SummaryWriter

# 准备的测试数据集 数据放在了CIFAR10文件夹下

test_data = torchvision.datasets.CIFAR10("./CIFAR10", train=False, transform=torchvision.transforms.ToTensor())

test_loader = DataLoader(dataset=test_data, batch_size=4, shuffle=True, num_workers=0, drop_last=False)

# 在定义test_loader时,设置了batch_size=4,表示一次性从数据集中取出4个数据

writer = SummaryWriter("logs")

for epoch in range(2):

step = 0

for data in test_loader:

imgs, targets = data

writer.add_images("Epoch: {}".format(epoch), imgs, step)

step = step + 1

writer.close()

????此时借助Tensorboard,对代码效果进行展示,得到如下的结果:

????从Tensorboard中的运行结果可知,设置参数batch_size=4时,每次取了4张照片,并获得4个targets标签。将DataLoader()函数用图示如下:

????(4)shuffle=True对数据读取的作用,每个epoch读完数据之后,在下次读取数据时是否会将数据打乱顺序,如果设置shuffle=True,那么在下一次epoch时,会将数据打乱顺序,然后再进行下一次读取,从而两次epoch读到的数据顺序是不同的;如果设置shuffle=False,那么在下一次数据读取时,不会打乱数据的顺序,从而两次读取到的数据顺序是相同的。

3.学习小结

????在本文中总结了DataLoader的使用方法,并通过读取CIFAR10中的数据,借助Tensorboard的展示各种参数的功能,能为后续神经网络的训练奠定基础,同时也能更好的理解pytorch。