����transformers����Ȼ���Դ���(NLP)����

Ŀ¼

1 Seq2Seq

�����ġ�Sequence to Sequence Learning

with Neural Networks��2014����Learning Phrase Representations using RNN Encoder�CDecoder

for Statistical Machine Translation��2014��

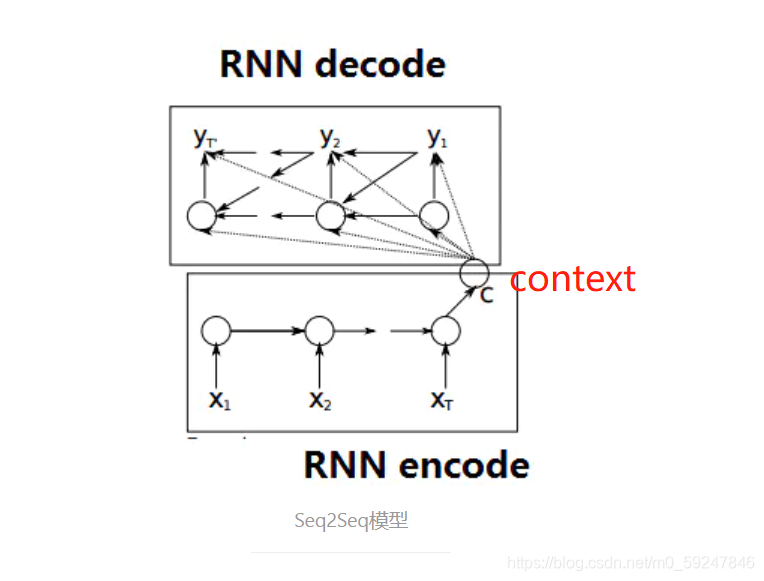

���ο���Seq2Seqģ����

- seq2seq����encoder-decoder�ṹ��һ��

- ����˼�������������RNN,һ��RNN��Ϊencoder,��һ��RNN��Ϊdecoder

- �������к�������г��ȿ��Բ�ͬ

2 attention

�����ġ�Neural Machine Translation by Jointly Learning to Align and Translate��2014����Effective Approaches to Attention-based Neural Machine Translation��2015��

���ο���Attention��Transformer��һ�Ŀ���attention

-

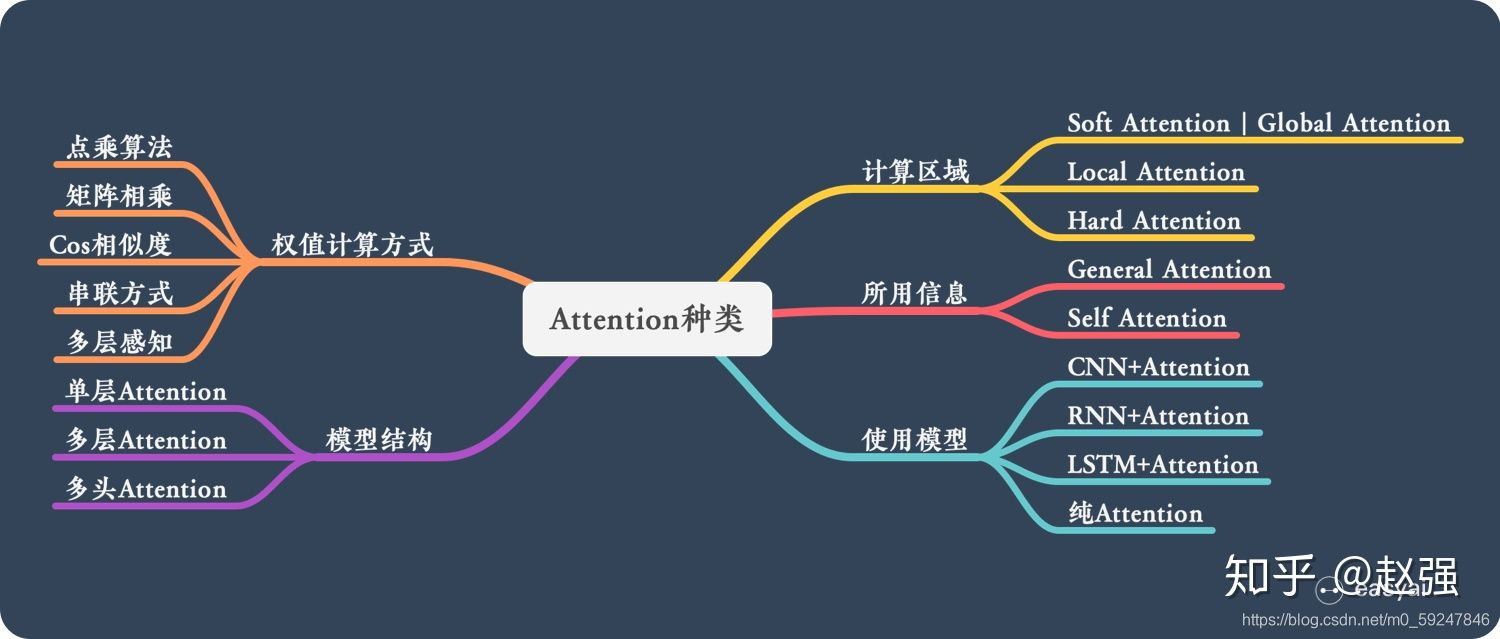

attention˼��:���ֵ�,���ݲ�õĸ�key��query������Լ���value�ļ�Ȩ��

-

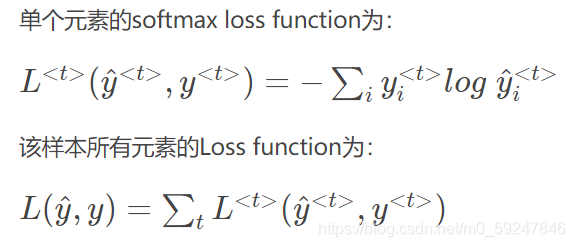

��Ϊ���ܸ���Խ,�����ᵽ��seq2seqһ�㶼ָ������attention���Ƶ�ģ��

-

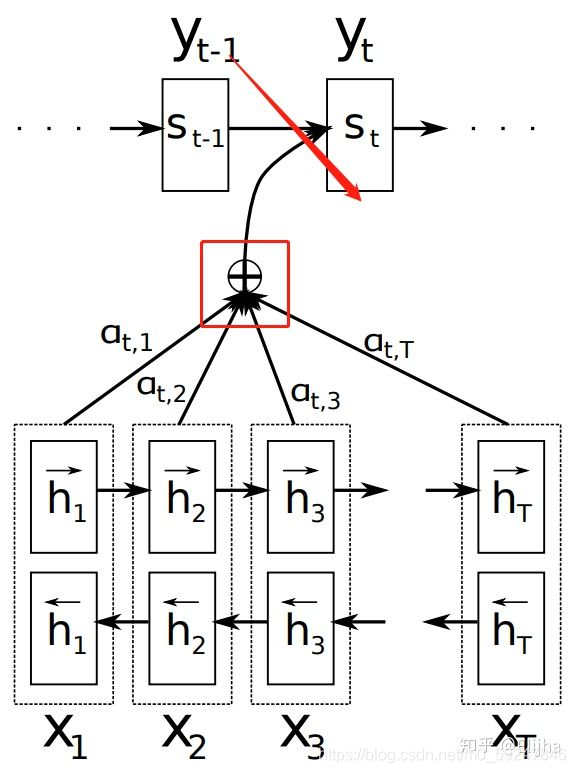

˫��RNN��encoder

-

h h h ����encoder�����ز�(����������Ϊvalue), s s s ����decoder�����ز�

-

�����attention,����������(context)

- c t = �� i = 1 T �� t i h i c_t=\sum_{i=1}^{T}\alpha_{ti}h_i ct?=��i=1T?��ti?hi?,�� t t t ��decoder,�� i i i ��encoder���ز�,�Ը�encoder������м�Ȩ���,Ȩ��Խ����context��ռ�Ⱦ�Խ��,decoderʱ��Խ������(attention˼��)

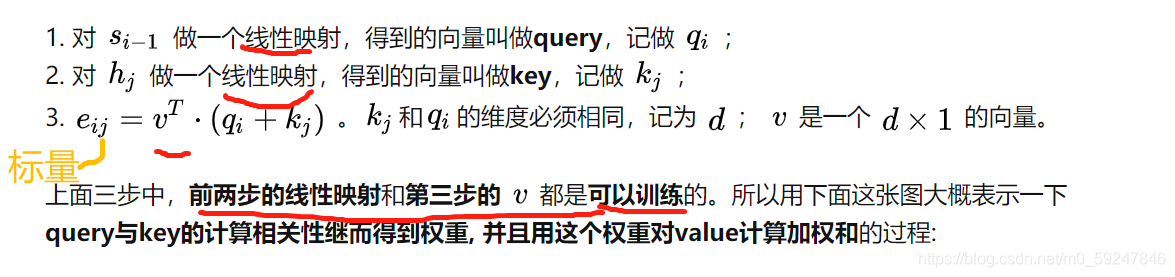

- �� t i = e x p ( e t i ) �� i = 1 T e x p ( e t i ) \alpha_{ti}=\frac{exp(e_{ti})}{\sum_{i=1}^Texp(e_{ti})} ��ti?=��i=1T?exp(eti?)exp(eti?)?,����alignment,���� e t i = a ( s t ? 1 , h i ) e_{ti}=a(s_{t-1},h_i) eti?=a(st?1?,hi?),���Լ�����һʱ�̵���� s t ? 1 s_{t-1} st?1? ������encoder�������س̶�,����softmax��һ��

-

a

(

?

)

a(\cdot)

a(?) ������س̶�,һ������attention�ļ��㷽������:query��key

- ����attention����ͨ��query��keyֱ�������˷��õ�����;local sensitive attention,˼�������� �� t i \alpha_{ti} ��ti? ֮��Ĺ�ϵ����Խϴ�,���Ϊ�˲����ֹ�ϵ��alignment���о���

- ����query:�ϸ�decoder������ s t ? 1 s_{t-1} st?1?����ǰdecoder������ s t s_{t} st?�� s t ? 1 s_{t-1} st?1? �� y t ? 1 y_{t-1} yt?1? concat������,��������������

-

�ܽ�:seq2seq�е�attention,���Ǽ���һ��encoder��������ļ�Ȩ��,�����Ϊcontext(��Ȩ����query��key����س̶�,�ٹ�һ��)

3 transformer

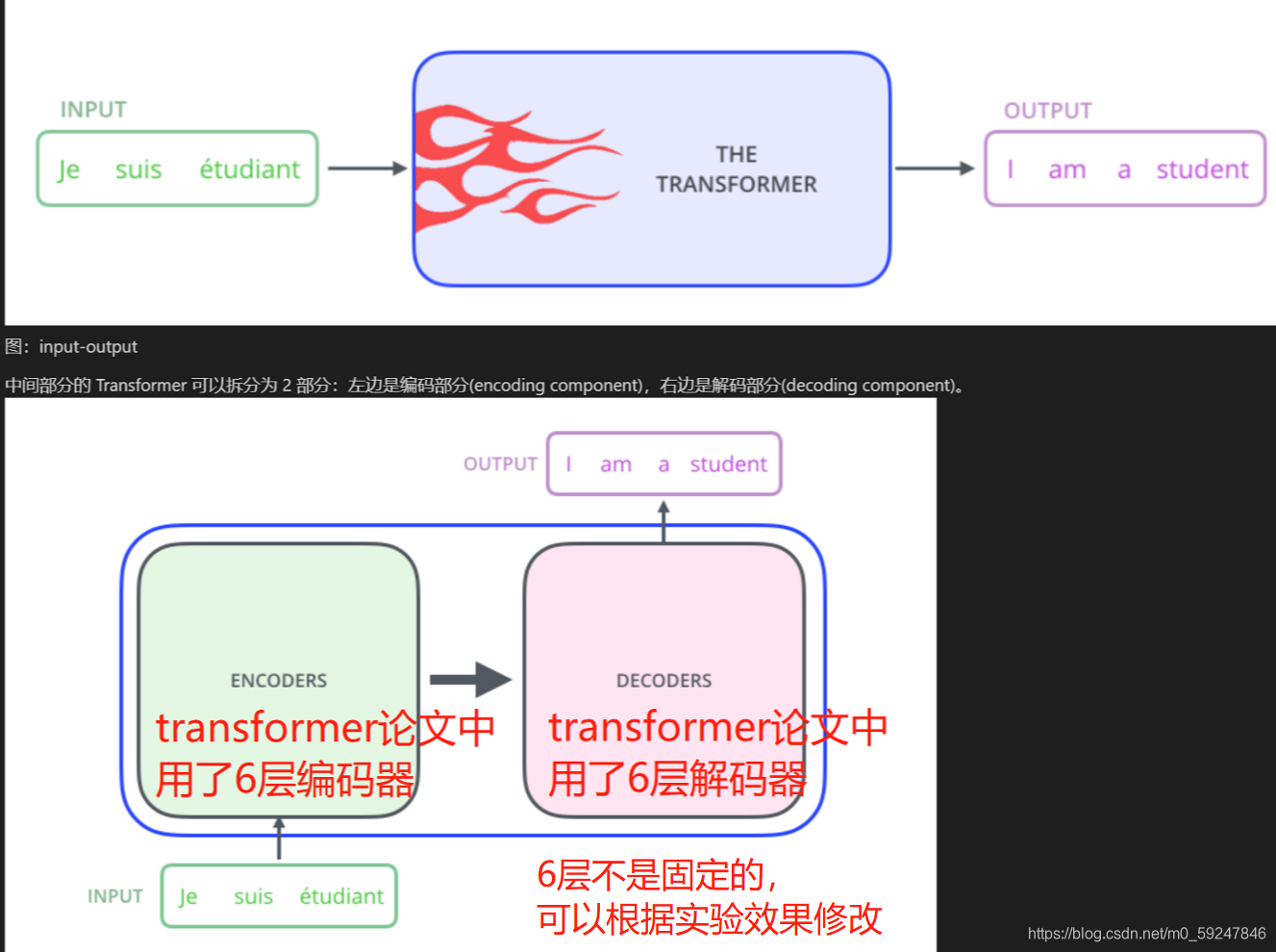

Transformer����һ���������seq2seq,Ҳ����һ��encoder��һ��decoder��ɵ�;����encoder��decoder������RNN,���ǻ����˶��attention

3.1������

3.2 ���������/������

- ���������:self-attention + ǰ��������(FFNN)

- ���������:self-attention + encoder-decoder attention + FFNN

- encoder-decoder attention:������seq2seq�е�attention,���������۽���������ӵĸ�����

- self-attention:key=query=value,��ԭ���е�ÿ���ʿ��Ը��þ����е����дʽ���Attention����,�൱��Ѱ��ԭ���ڲ��Ĺ�ϵ

3.3 self-attention

- ��ͷע��������

- ��ͷע��������