һ��ѵ�������������Ծ������

�������:

M

S

E

=

1

N

��

i

=

1

N

(

y

i

?

f

^

(

x

i

)

)

2

MSE = \frac{1}{N}\sum\limits_{i=1}^{N}(y_i -\hat{ f}(x_i))^2

MSE=N1?i=1��N?(yi??f^?(xi?))2,����

f

^

(

x

i

)

\hat{ f}(x_i)

f^?(xi?)������

x

i

x_i

xi?Ӧ�ý�����ģ��

f

^

\hat{f}

f^?Ԥ��Ľ����

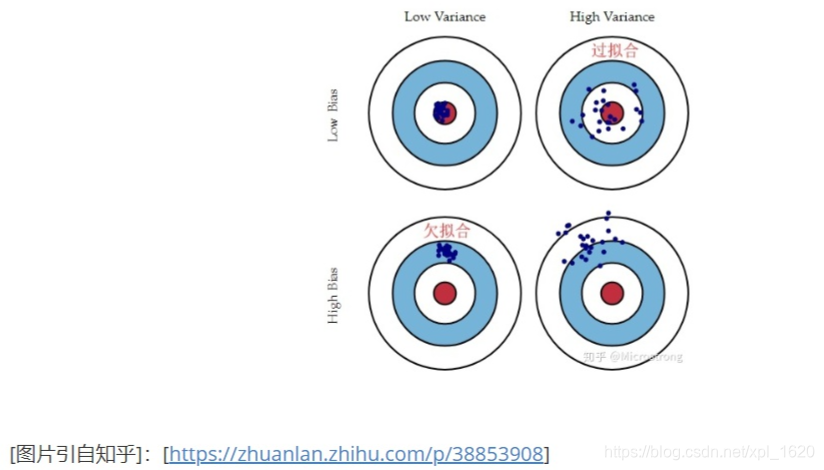

ѵ�������������Ĺ�ϵ: ѵ���������Ͻ���,���Ծ������һ����Ƚ��ͺ����ߡ�һ��ģ�͵�ѵ�����������Сʱ,���ܱ�֤���Ծ������ͬʱҲ��С��(������ͼ�ƫ���뷽���Ȩ��)��

�ص�: ѵ�����������С,������ʹ�ò��Ծ��������С!

����ƫ���뷽���Ȩ��

ƫ����ָ: Ϊ��ѡ��һ����ģ��ȥ������ʵ�������������ƫ�������ѧϰ�㷨������Ԥ������ʵ�����ƫ��̶�,���̻���ѧϰ�㷨���������������

����: ��������ͬһ��ģ���ڲ�ͬ���ݼ��ϵ��ȶ��ԡ�

�����������һ���Ƚ��ͺ�����,˵��������������������������ڻ���ġ�����֤��:

E

(

y

0

?

f

^

(

x

0

)

)

2

=

Var

?

(

f

^

(

x

0

)

)

+

[

Bias

?

(

f

^

(

x

0

)

)

]

2

+

Var

?

(

��

)

E\left(y_{0}-\hat{f}\left(x_{0}\right)\right)^{2}=\operatorname{Var}\left(\hat{f}\left(x_{0}\right)\right)+\left[\operatorname{Bias}\left(\hat{f}\left(x_{0}\right)\right)\right]^{2}+\operatorname{Var}(\varepsilon)

E(y0??f^?(x0?))2=Var(f^?(x0?))+[Bias(f^?(x0?))]2+Var(��)

Ҳ����˵,���ǵIJ��Ծ�����������ֵ���Էֽ�Ϊ f ^ ( x 0 ) \hat{f}(x_0) f^?(x0?)�ķ�� f ^ ( x 0 ) \hat{f}(x_0) f^?(x0?)��ƫ��ƽ��������� ? \epsilon ?�ķ�� Var ? ( �� ) \operatorname{Var}(\varepsilon) Var(��)Ϊ��ģ������Ѷ�,����������ǵ�����ȷ���������ı��,Ҳ��������Լ��

ƫ���뷽��Ĺ�ϵ:

һ�����,����ģ�͵ĸ��Ӷ�,�����ģ�͵�ƫ��,���ǻ�����ģ�͵ķ���,����Ҫ�ҵ�һ������Cƫ���Ȩ��,ʹ�ò��Ծ��������С,�����Ҫ�Բ��Ծ��������й��ơ�

��������������

ΪʲôҪ���в��Ծ���������?

������֪,����Ҫѡ����Dz��������С��ģ�͡���Ϊѵ�������Сʱ,���Ծ����������������,�Һ��Ѻ��Ѷ�ʵ�ʵIJ��������о�ȷ�ļ���,����Ҫ�Բ��Ծ��������й��ơ����Ծ��������Ƶ����ַ���:ֱ�ӹ��ơ���ӹ�����

3.1��ӹ���-ѵ���������:

������֪,ģ��Խ����,ѵ�����ԽС,��������ȼ����������,�����ȹ���һ�������϶��ģ��ʹ������,��ʱѵ������С���������ܴ�,����ʱ���Ǽ���������������ijͷ������,�����ǵ�ѵ����������������������Ӷ�����ʱ,�ͷ�����Ϊ�������������Ӷ�����,������ѵ����������������������Ӷ�����ֹ�ؼ�С(ͨ������ƫ��,�����ͷ���)���������ѧ������:

C

p

=

1

N

(

R

S

S

+

2

d

��

^

2

)

C_p = \frac{1}{N}(RSS + 2d\hat{\sigma}^2)

Cp?=N1?(RSS+2d��^2),

����dΪģ����������,

R

S

S

=

��

i

=

1

N

(

y

i

?

f

^

(

x

i

)

)

2

RSS = \sum\limits_{i=1}^{N}(y_i-\hat{f}(x_i))^2

RSS=i=1��N?(yi??f^?(xi?))2,

R

S

S

RSS

RSSΪ�в�ƽ���͡�

��

^

2

\hat{\sigma}^2

��^2Ϊģ��Ԥ�����ķ���Ĺ���ֵ,���в�ķ��

AIC�����Ϣ����:

A

I

C

=

1

d

��

^

2

(

R

S

S

+

2

d

��

^

2

)

AIC = \frac{1}{d\hat{\sigma}^2}(RSS + 2d\hat{\sigma}^2)

AIC=d��^21?(RSS+2d��^2)

BIC��Ҷ˹��Ϣ����:

B

I

C

=

1

n

(

R

S

S

+

l

o

g

(

n

)

d

��

^

2

)

BIC = \frac{1}{n}(RSS + log(n)d\hat{\sigma}^2)

BIC=n1?(RSS+log(n)d��^2)

���ͨ��ѵ�������Ʋ������?

�����������ӻ�ʹ��ѵ������,ͨ���������������гͷ�,����ѵ����������������������Ӷ�����ֹ�ؼ�С ,�Ӷ�ȷ������������Խϵ͵�λ�á�

3.2ֱ�ӹ���-������֤

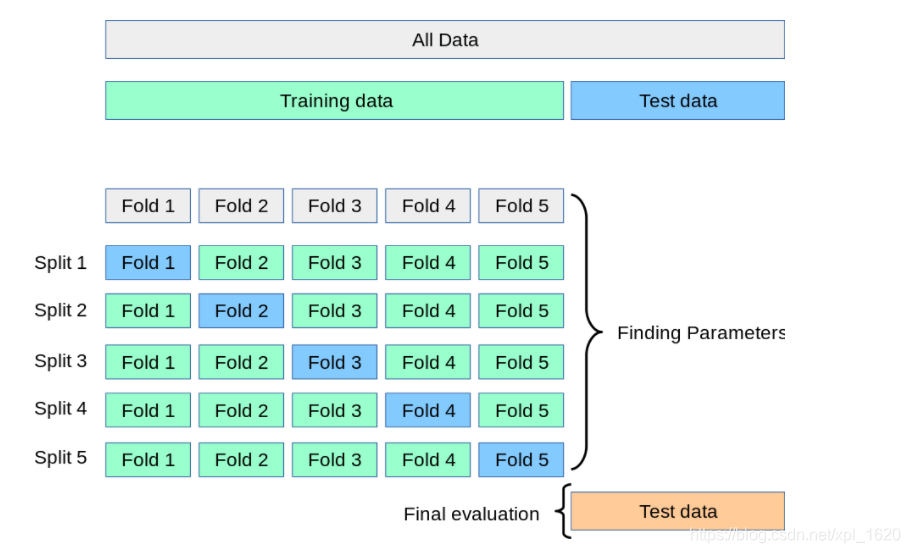

K�۽�����֤:

������֤�ǶԲ�������ֱ�ӹ��ơ�������֤��ѵ�������������������:�ܹ�������������һ��ֱ�ӹ�����������ֻ����K�۽�����֤:���ǰ�ѵ�������ֳ�K�ȷ�,Ȼ����K-1������������ѵ����,ʣ�µ�һ��������Ϊ��֤��ȥ������K-1���������õ���ģ�͵ľ���,��������ظ�K��ȡƽ��ֵ�õ���������һ������

C

V

(

K

)

=

1

K

��

i

=

1

K

M

S

E

i

CV_{(K)} = \frac{1}{K}\sum\limits_{i=1}^{K}MSE_i

CV(K)?=K1?i=1��K?MSEi?��

KFord����ԭ���Ĺ�������ͼ����:

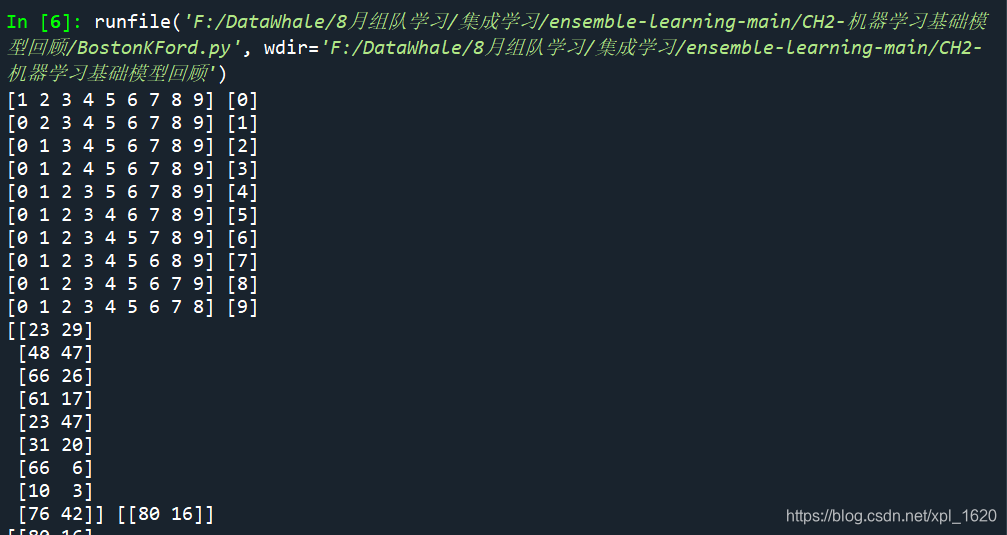

KFord����ʾ������:

import numpy as np

from sklearn.model_selection import KFold

X = np.random.randint(1,100,20).reshape((10,2)) #������

#K�۽�����֤

'''

����ʹ��:

classsklearn.model_selection.KFold(n_splits=5,*,shuffle=False,random_state=None)

n_splits:��ʾҪ�ָ�K���Ӽ�,Ĭ��Ϊ5

shuffle:�Ƿ�Ҫ��������,Ĭ��false

random_state:���״̬,��Ҫ��shuffle���ʹ��

'''

kf = KFold(n_splits=10) #��ѵ�����ֳ�10��

for train_index,valid_index in kf.split(X):

print(train_index,valid_index) #���10�ۻ������ݼ���ѵ����������

for train_index,valid_index in kf.split(X):

print(X[train_index],X[valid_index]) #���10�ۻ�������ֵ

�ġ�������ȡ

�ڲ�������ܹ��������Ĺ��Ƴ����Ժ�,����������ѡ���Ŀ�����:��p��������ѡ��m������,ʹ�ö�Ӧ��ģ�͵IJ������Ĺ�����С����Ӧ�ķ�����:

4.1 �����Ӽ�ѡ��:

(i) �Dz����κ�������ģ��Ϊ M 0 M_0 M0?,������� M 0 M_0 M0?�IJ�����

(ii) �� M 0 M_0 M0?����������һ������,����p��ģ�͵�RSS,ѡ��RSS��С��ģ�ͼ��� M 1 M_1 M1?,�������ģ�� M 1 M_1 M1?�IJ�����

(iii) �����ӱ���,����p*p-1��ģ�͵�RSS,��ѡ��RSS��С��ģ�ͼ��� M 2 M_2 M2?,�������ģ�� M 2 M_2 M2?�IJ�����

(iv) �ظ����Ϲ���֪����ϵ�ģ����p������Ϊֹ,��ѡ��p+1��ģ�� { M 0 , M 1 , . . . , M p } \{M_0,M_1,...,M_p \} {M0?,M1?,...,Mp?}�в��������С��ģ����Ϊ����ģ�͡�

4.2 ��ǰ��ѡ��:

�����Ӽ�ѡ����Ȼ��ԭ���Ϻ�ֱ��,����������������ά��p������,�Ӽ�������Ϊ 2 p 2^p 2p,����Ч�ʷdz���������Ҫ�ļ����ڴ�Ҳ�ܸ�,�ڴ����ݵı�������Ȼ�����á����,������Ҫ�������Ӽ�ѡ�������Ч�����,���ʹ����ǰ��ѡ���㷨�Ĺ�������:

(i) �Dz����κ�������ģ��Ϊ M 0 M_0 M0?,������� M 0 M_0 M0?�IJ�����

(ii) �� M 0 M_0 M0?����������һ������,����p��ģ�͵�RSS,ѡ��RSS��С��ģ�ͼ��� M 1 M_1 M1?,�������ģ�� M 1 M_1 M1?�IJ�����(iii) ����С��RSSģ���¼�������һ������,ѡ��RSS��С��ģ�ͼ��� M 2 M_2 M2?,�������ģ�� M 2 M_2 M2?�IJ�����

(iv) �Դ�����,�ظ����Ϲ���֪����ϵ�ģ����p������Ϊֹ,��ѡ��p+1��ģ�� { M 0 , M 1 , . . . , M p } \{M_0,M_1,...,M_p \} {M0?,M1?,...,Mp?}�в��������С��ģ����Ϊ����ģ�͡�

����:

import pandas as pd

from sklearn import datasets #�������Իع���Ҫ��ģ��Ϳ�

from statsmodels.formula.api import ols #����ols(��С���˷�)ģ��,��Ҫ�������Իع�IJ�������

boston = datasets.load_boston() #����boston���ݼ�

X = boston.data

y = boston.target

features = boston.feature_names

boston_data = pd.DataFrame(X,columns=features)

boston_data["Price"] = y

#������ǰ�ع麯��

def forward_select(data,target):

variate=set(data.columns) #���ֶ���ת�����ֵ�����

variate.remove(target) #ȥ����������ֶ���

selected=[]

current_score,best_new_score=float('inf'),float('inf') #Ŀǰ�ķ�������÷�����ʼֵ��Ϊ�����(��ΪAICԽСԽ��)

#ѭ��ɸѡ����

while variate:

aic_with_variate=[]

for candidate in variate: #��������Ա���

formula="{}~{}".format(target,"+".join(selected+[candidate])) #���Ա�������������

aic=ols(formula=formula,data=data).fit().aic #����olsѵ��ģ�͵ó�aicֵ

aic_with_variate.append((aic,candidate)) #����ÿһ�ε�aicֵ�Ž����б�

aic_with_variate.sort(reverse=True) #��������aicֵ

best_new_score,best_candidate=aic_with_variate.pop() #��õ�aicֵ����ɾ���б������һ��ֵ,�Լ���õ��Ա��������б����һ���Ա���

if current_score>best_new_score: #���Ŀǰ��aicֵ������õ�aicֵ

variate.remove(best_candidate) #�Ƴ��ӽ����ı�����,���ڶ���ѭ��ʱ,�����Ǵ��Ա�����

selected.append(best_candidate) #�����Ա�����Ϊ�ӽ�ģ���е��Ա���

current_score=best_new_score #���µķ���������õķ���

print("aic is {},continuing!".format(current_score)) #�����С��aicֵ

else:

print("for selection over!")

break

formula="{}~{}".format(target,"+".join(selected)) #���յ�ģ��ʽ��

print("final formula is {}".format(formula))

model=ols(formula=formula,data=data).fit()

return(model)

forward_select(data=boston_data,target="Price")

lm=ols("Price~LSTAT+RM+PTRATIO+DIS+NOX+CHAS+B+ZN+CRIM+RAD+TAX",data=boston_data).fit()

lm.summary()

OLS���Իع�������������:

Dep.Variable : ʹ�õ������ֵ

Model:ʹ�õ�ģ��

method: ʹ�õķ���

Date:ʱ��

No.Observations:�������ݸ���

Df Residuals:�в�����ɶ�

DF Model:ģ�͵����ɶ�

R-squared:R��ֵ

Adj.R-squared:�������R��

F-statistic :Fͳ����

Prob(F-statistic):Fͳ������pֵ

Log-Likelihood:��Ȼ��

AIC BIC:����ģ�������ȵ�ָ��,ԽСԽ��

const:�ؾ��� P>|t| :t�����pֵ,���pֵС��0.05 ��ô���Ǿ���Ϊ������������

�ο�:Python ����AIC������ǰ�ع���б���ɸѡ(��)

4.3ѹ������(����)

���˸ո����۵�ֱ�Ӷ�������������ѡ������,���ǻ����ԶԻع��ϵ������Լ�����ӷ��ļ��ɶ�p��������ģ�ͽ������,��������ģ�ͷ���,����Ҳ�����ģ�͵����Ч����������˵,���ǽ��ع�ϵ������ķ���ѹ��,��Ҳ����Ϊʲô��ѹ�����Ƶ�ԭ���ˡ�

- ��ع�(L2��������):

�����Իع���,���ǵ���ʧ����Ϊ

J

(

w

)

=

��

i

=

1

N

(

y

i

?

w

0

?

��

j

=

1

p

w

j

x

i

j

)

2

J(w) = \sum\limits_{i=1}^{N}(y_i-w_0-\sum\limits_{j=1}^{p}w_jx_{ij})^2

J(w)=i=1��N?(yi??w0??j=1��p?wj?xij?)2,���������Իع����ʧ�����Ļ��������Ӷ�ϵ����Լ�����߳ͷ�,��:

J

(

w

)

=

��

i

=

1

N

(

y

i

?

w

0

?

��

j

=

1

p

w

j

x

i

j

)

2

+

��

��

j

=

1

p

w

j

2

,

????

��

��

,

��

��

0

w

^

=

(

X

T

X

+

��

I

)

?

1

X

T

Y

J(w) = \sum\limits_{i=1}^{N}(y_i-w_0-\sum\limits_{j=1}^{p}w_jx_{ij})^2 + \lambda\sum\limits_{j=1}^{p}w_j^2,\;\;����,\lambda \ge 0\\ \hat{w} = (X^TX + \lambda I)^{-1}X^TY

J(w)=i=1��N?(yi??w0??j=1��p?wj?xij?)2+��j=1��p?wj2?,����,����0w^=(XTX+��I)?1XTY

���ڲ���

��

\lambda

���Ĵ�С��Ӱ��ѹ�����ƵĹؼ�,

��

\lambda

��Խ��,�ͷ�������Խ��,ϵ����Խ������0,��֮,ѡ����ʵ�

��

\lambda

����ģ�;�����˵ʮ����Ҫ����ع�ͨ���������Իع����ƫ�Խ��ͷ���,�п���ʹ��ģ������IJ�������С,���ģ�͵ķ���������

import pandas as pd

from sklearn import datasets #�������Իع���Ҫ��ģ��Ϳ�

from sklearn import linear_model

boston = datasets.load_boston() #����boston���ݼ�

X = boston.data

y = boston.target

features = boston.feature_names

boston_data = pd.DataFrame(X,columns=features)

boston_data["Price"] = y

'''

sklearn.linear_model.ridge_regression(X, y, alpha, *, sample_weight=None,

solver='auto', max_iter=None, tol=0.001,

verbose=0, random_state=None, return_n_iter=False,

return_intercept=False, check_input=True)

- ����:

alpha:�ϴ��ֵ��ʾ��ǿ������������

sample_weight:����Ȩ��,Ĭ���ޡ�

solver:��ⷽ��,{��auto��, ��svd��, ��cholesky��, ��lsqr��, ��sparse_cg��, ��sag��, ��saga��}, Ĭ��=��auto����

�� svd��ʹ��X������ֵ�ֽ�������Ridgeϵ����'cholesky'ʹ�ñ���scipy.linalg.solve����ͨ��dot(XT,X)��Cholesky�ֽ��÷����ʽ�Ľ⡣

'sparse_cg'ʹ��scipy.sparse.linalg.cg�еĹ����ݶ��������

��Ϊһ�ֵ����㷨,���ڴ��ģ����(��������tol��max_iter),��������ȡ� Cholesky�������ʡ�

lsqr��ʹ��ר�õ�������С��������scipy.sparse.linalg.lsqr����������,����ʹ�õ������̡�

�� sag��ʹ�����ƽ���ݶ��½�,�� saga��ʹ����Ľ�����ƫ�汾SAGA�����ַ�����ʹ�õ�������,���ҵ�n_samples��n_features���ܴ�ʱ,ͨ����������������졣

��ע��,ֻ���ڱ���������ͬ��Ҫ���ϲ���ȷ���� sag���͡� saga������������������ʹ��sklearn.preprocessing�е������������ݽ���Ԥ������

�������������֧���ܼ���ϡ�����ݡ�����,��fit_interceptΪTrueʱ,��'sag'��'sparse_cg'֧��ϡ�����롣

'''

reg_rid = linear_model.Ridge(alpha=.5)

reg_rid.fit(X,y)

print(reg_rid.score(X,y)) #0.739957023371629

- Lasso�ع�(L1��������):

��ع��һ�����������ص���:��ģ�͵�ϵ������ķ���ѹ��,������ع��ϵ��ֻ���ظ�����0��������0,���仰˵,������������ѡ���ܷ�ʹ��ѹ�����Ƶ�˼�����������������Ӽ�ѡ��������ȡ����Ҫ��������?���ǿ϶���!����ֻ��Ҫ����ع���Ż�������СС�ĵ���������,����ʹ��ϵ��������L1�����滻��ع��е�L2����:

J

(

w

)

=

��

i

=

1

N

(

y

i

?

w

0

?

��

j

=

1

p

w

j

x

i

j

)

2

+

��

��

j

=

1

p

�O

w

j

�O

,

????

��

��

,

��

��

0

J(w) = \sum\limits_{i=1}^{N}(y_i-w_0-\sum\limits_{j=1}^{p}w_jx_{ij})^2 + \lambda\sum\limits_{j=1}^{p}|w_j|,\;\;����,\lambda \ge 0

J(w)=i=1��N?(yi??w0??j=1��p?wj?xij?)2+��j=1��p?�Owj?�O,����,����0

'''

class sklearn.linear_model.Lasso(alpha=1.0, *, fit_intercept=True, normalize=False, precompute=False, copy_X=True, max_iter=1000, tol=0.0001, warm_start=False, positive=False, random_state=None, selection='cyclic')

- ����:

alpha:����ǿ��,1.0��������С���ˡ�

fit_intercept:�Ƿ����ģ�ͽؾࡣĬ��true��

normalize:�Ƿ����,Ĭ��false��

positive:�Ƿ�ǿ��ϵ��Ϊ��,Ĭ��false��

'''

reg_lasso = linear_model.Lasso(alpha = 0.5) #lasso�ع�(L1����)

reg_lasso.fit(X,y)

print(reg_lasso.score(X,y)) #0.7140164719858566

�塢��ά

��ĿǰΪֹ,���������۵ķ����Է���Ŀ��������ַ�ʽ:һ����ʹ��ԭʼ�������Ӽ�,��һ���ǽ�����ϵ��ѹ�����㡣������Щ�������ǻ���ԭʼ����

x

1

,

.

.

.

,

x

p

x_1,...,x_p

x1?,...,xp?�õ���,��������̽��һ���µķ���:��ԭʼ�������ռ�ͶӰ��һ����ά�Ŀռ�ʵ�ֱ�������������,��:����ά��ƽ��ͶӰ��һά�ռ䡣

���ɷַ���(PCA):

���ɷַ�����˼��:ͨ�����ͶӰ���� ��ԭʼ�ռ�����ع�,������������ع�Ϊ��,������ij�������ϵĵ�(ͶӰ)�ķ�������ڽ�����һ���Ƶ�֮ǰ,�����Ȱ�������ֵ������Э��������ƹ���������ʽ:

PCA�������������ʵ��

- [ ע]:�����Լ������ݼ�����ʵ��һ��

����ģ�ͳ���������

- [ע]:���������㷨,ʱ������,������������