我的遗憾

先说一下我的一个小遗憾,没有去诺坎普看梅西踢一场球,送给梅老板一句话,莫愁天下无知己,天下谁人不识君。

模型的遗憾

从模型的学习方式可以把模型分为两种,在线学习和批量学习

- 批量学习:一次全部学完,用一些性能指标来评价,好就是好坏就是坏,它不懂什么叫遗憾,我也就不谈它了

- 在线学习:人如其名,我在线上一直学,一直学,不断成长,试图成为一个完美的模型,可哪里有完美的模型呢,这就产生了遗憾

遗憾的定义

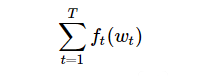

在线学习的目的是为了成为一个完美的模型,无线的最小化累计的损失,当一个模型迭代了T轮以后,累计的损失就是,

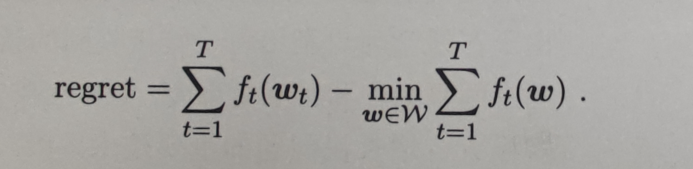

遗憾就是累计的损失和理性算法的最小损失的差值,公式如下:

在线学习的目的就是在T趋向于∞(无穷)时,regret/T 趋近于 0.

谈一下在线学习

- 优点是什么呢? 可以成长的总是有一天会变成更好的,对于数据持续增长的场景,在线学习这种利用当前到来的训练样本更新模型,是可以显著降低时间和空间的复杂度的,实时性更强

- 挑战是什么呢? 当新到来一个数据实例时,要求在线学习方法能够自动地侦测当前要鉴别的流数据是原来数据中存在的还是新生成的,并进行分类给出相应的权值,当分类出错时,产生一个罚值,分类器要根据数据实例的真正的类别标签以及权值,罚值等对分类器参数进行相应地调整,以此更好地预测新的数据。

说一下在线学习的分类

根据接受反馈分类

- 完全信息式在线学习:就是说全信息的在线学习,就想赛马一样,你可以看到其他所有的马,和你马一起跑,你可以看到全部的损失函数,此种类型就可以用梯度下降,信息熵的方式进行优化

- 赌博式在线学习,你知道你赌的东西,只知道你自己的损失,不可偷看到别人的情况,学习器是只能观测到所选的决策结果,不知道其他人的情况

根据学习器类型分类

1、线性学习

2、核学习算法

此处不多谈了,大家感兴趣可以去自己了解一下,在预警监测,自然语言,图片处理等方面的使用率是非常高的

总计

关于在线学习,可以深入的部分是非常多的,我才疏学浅,只能谈论翩翩一叶,为大家开一头,有兴趣的可以继续深入研究凸凹优化问题 动态遗憾 自适应遗憾等方面,看看书学学习谢谢文章,希望未来遗憾可以趋近于0.