目录

TDN: 用于有效动作识别的时差网络

Abstract

时间建模对于视频中的动作识别仍然具有挑战性。 为了缓解这个问题,本文提出了一种新的视频架构,称为时间差分网络 (TDN),重点是捕获多尺度时间信息以进行有效的动作识别。我们 TDN 的核心是通过明确利用时间差异算子来设计一个有效的时间模块 (TDM),并系统地评估其对短期和长期运动建模的影响。 为了完全捕获整个视频的时间信息,我们的TDN建立了一个两级差异建模范式。 具体来说,对于局部运动建模,连续帧上的时间差异用于为2D CNN提供更精细的运动模式,而对于全局运动建模,跨段的时间差异被结合,以捕获用于运动特征激发(motion feature excitation)的长程结构( long-range structure )。 TDN提供了一个简单而有原则的时间建模框架,并且可以以很小的额外计算代价,用现有的CNN进行实例化。 我们的 TDN 在Something-Something V1 和V2 数据集上呈现了前沿水平,并且与Kinetics-400 数据集上的最佳性能相当。此外,我们进行了深入的消融实验,并绘制了 TDN 的可视化结果,希望能对时差建模提供有见地的分析。

1.Introduction

深度神经网络在视频中的动作识别方面取得了巨大进步 [14, 29, 38, 31, 6, 26, 37]。 时间建模对于捕获视频中的运动信息以进行动作识别至关重要,这通常通过当前深度学习方法中的两种机制来实现。 一种常用的方法是使用双流网络 [29],其中一个流在 RGB 帧上提取外观信息(appearance information),另一流是利用光流作为输入来捕获运动信息。事实证明,这种方法对于提高动作识别准确度是有效的,但是光流计算需要大量的计算消耗。 另一种替代方法是使用 3D 卷积 [12, 31] 或时间卷积 [33, 41, 25] 从 RGB 帧中隐式学习运动特征。 然而,3D 卷积通常在时间维度上缺乏特定的考虑,并且也可能带来更高的计算成本。 因此,设计一个具有高运动建模能力和低计算消耗的有效时间模块仍然是视频识别的一个具有挑战性的问题。

本文旨在通过引入基于时间差异的模块(TDM)来提出一种新的时间建模机制。 时间导数(差异)与光流高度相关 [11],并且通过使用 RGB 差异作为近似运动表示 [38, 43] 在动作识别中显示出有效性。 然而,这些方法只是将 RGB 差异视为另一种视频模态,并训练不同的网络与 RGB 网络融合。 相反,我们的目标是提出一个统一的框架来联合捕获外观和运动信息,通过将时间差异的思想概括为用于端到端网络设计的有原则且有效的时间模块。

此外,我们认为短期和长期时间信息对于动作识别都至关重要,因为它们能够捕捉动作实例独特的和互补的属性。 因此,在我们提出的时间建模机制中,我们提出了一个独特的基于整体和稀疏采样策略的两级时间建模框架 [38],称为时间差异网络 (TDN)。 具体来说,在 TDN 中,我们考虑了两种有效形式的 TDM,用于不同尺度的运动建模。 对于局部运动建模,我们提出了一个轻量级和低分辨率的差分模块,通过横向连接(lateral connections)为单个 RGB 提供运动模式(motion patterns),而对于远程(long-range)运动建模,我们提出了一个多尺度和双向差分模块来捕捉运动激励的跨段变化(cross-segment variations for motion excitation)。 这两个 TDM 被系统地研究为用于短期和长期时间结构提取的模块化构建块。

我们的 TDN 提供了一个简单而通用的视频级运动建模框架,并且可以使用现有的 CNN 进行实例化,而只需少量的额外计算成本。 为了证明 TDN 的有效性,我们使用 ResNets 实现它并在两个数据集上进行实验:Kinetics 和Something-Something。 评估结果表明,在使用类似主干的设置下,我们的 TDN 能够在运动相关的Something-Something数据集和场景相关的Kinetics数据集上产生新的最先进的性能。 如图 1 所示,在Something-Something V1 的数据集上,我们的最佳结果明显优于之前的方法。 我们还进行了详细的消融研究,以证明时间差异操作的重要性,并研究特定 TDM 设计的效果。 总而言之,我们的主要贡献在于以下三个方面:

? 我们概括了 RGB 差异的思想,以设计一个有效的时间差异模块 (TDM) 用于视频中的运动建模,并通过系统地呈现有效和详细的模块设计来提供 3D 卷积的替代方案。

? 我们的 TDN 提出了一个视频级运动建模框架,其中包含提出的时间差异模块,重点是捕获用于视频识别的短期和长期时间结构。

? 我们的TDN 在使用相同主干的设置下,在Kinetics 和Something-Something 数据集上获得了最新的最先进性能。 我们还对 TDM 进行了深入的消融研究,以提供对我们的时间差异建模的一些见解。

2. Related work

Short-term temporal modeling.(短期时间建模。) 动作识别在过去几年引起了很多研究的关注。 这些方法可以分为两种类型:(1)双流 CNN [29] 或其变体 [7]:它使用 RGB 和光流两个输入,分别对视频中的外观和运动信息进行建模,再进行后期融合; (2) 3D-CNNs [31, 12]:它提出了 3D 卷积和池化来直接从视频中学习时空特征。几种变体试图通过将 3D 卷积分解为 2D 卷积和 1D 时间卷积来降低 3D 卷积的计算成本,例如 R(2+1)D [33]、S3D [41]、P3D [25] 和 CT- Net[16]。 沿着这条研究路线,一些工作专注于设计更强大的时间模块并将它们插入到 2D CNN 中以进行有效的动作识别,例如 TSM [19]、TIN [28]、TEINet [20]、TANet [21] 和 TEA [18]。 此外,一些方法试图利用双流网络的思想来设计多分支架构来捕获外观和运动或上下文信息,使用精心设计的时间模块或以不同 FPS 采样的两个 RGB 输入,包括Non-local Net [39]、ARTNet [36]、STM [13]、SlowFast [6] 和 CorrelationNet [35]。 最近的一些工作[5](X3D)尝试了网络架构搜索来进行视频识别。 这些工作是基于剪辑的架构(clip-based architecture ),通过从整个视频的一小部分(例如 64 帧)中学习来进行短期运动建模。

Long-term temporal modeling.(长期时间建模。) 短期基于剪辑的网络无法捕获远程时间结构。一些方法通过使用 RNN [24, 3] 或长时间卷积 [34] 堆叠更多帧,或使用稀疏采样和聚合策略 [38, 44, 42, 9, 18]来克服这一限制。 在这些方法中,时间段网络 (temporal segment network ,TSN) [38] 被证明是一种有效的远程( long-range)建模框架,并在多个基准测试中使用 2D CNN 获得了最先进的性能。 然而,带有 2D CNN 的 TSN 仅在最后阶段进行时间融合,未能捕捉到更精细的时间结构。 StNet [9] 提出了一个局部和全局模块来对时间信息进行分层建模。 V4D [42] 通过提出一个有原则(principled )的 4D 卷积算子来聚合来自不同阶段的远程( long-range)信息,从而扩展了 TSN 框架。

Temporal difference representation. (时间差异表示。) 时间差异操作(Temporal difference operations)出现在之前的几项运动提取(motion extraction)工作中,例如 RGB 差异 [38, 43, 23] 和特征差异 [20, 13, 18]。 RGB 差异被证明是替代光流作为运动表示的有效形式(modality) [38, 43, 23]。 然而,他们只是用另一种视频模式对 RGB 进行了不同的处理( they only treated RGB differently with another video modality),并训练了一个单独的网络来与 RGB 流融合。 TEINet [20]、TEA [18] 和 STM [13] 的工作采用了差异操作(difference operation)进行网络设计。 然而,这两种方法只是简单地使用了一个简单的差分算子进行单级运动提取(single-level motion extraction),并且比 3D 卷积受到的研究关注较少。

与现有方法不同,我们提出的时间差异网络(TDN)是一种视频级架构,可以捕获短期和长期信息以进行端到端动作识别。 我们的主要贡献是引入时间差异模块 (TDM) 来显式计算运动信息,并将其有效地利用到我们的两级运动建模范式中。 我们希望改进和推广这些基于时间差异的建模替代方案,这种方案在两个具有较小 FLOP 的基准上的表现普遍优于 3D 卷积。

3. Temporal Difference Networks

在本节中,我们将详细描述我们的时间差分网络 (TDN)。 首先,我们概述了 TDN 框架,该框架由短期和长期时间差异模块 (TDM) 组成。 然后,我们对这两个模块进行技术描述。 最后,我们提供了使用 ResNet 主干实例化 TDN 的实现细节。

3.1. Overview

如图 2 所示,我们提出的时间差异网络 (TDN) 是一个视频级框架,用于使用整个视频信息学习动作模型。由于 GPU 内存的限制,遵循 TSN 框架 [38],我们为每个视频提出了一种稀疏和整体的采样策略。 我们的主要贡献是在网络设计中利用时间差异算子来显示地捕获短期和长期运动信息。 效率是我们在时间差异模块 (TDM) 设计中的核心考虑因素,我们研究了两种特定形式来分别完成局部窗口中的运动补充( motion supplement)和跨不同段的运动增强(motion enhancement)任务。 这两个模块通过残差连接( residual connection)并入主网络。

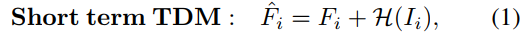

具体地,每个视频V被划分为T个相等时长且不重叠的片段。 我们从每个片段中随机抽取一帧,总共得到 T 帧I= [I1; ・ ・ ・ ; IT ],其中 I 的形状为 [T,C,H,W]。这些帧被分别输入 2D CNN 以提取逐帧特征 F = [F1; ・ ・ ・ ; FT ],其中 F 表示隐藏层中的特征表示,其维度为 [T; C’; H’; W’]。 短期 TDM 旨在为这些早期层( early layers )的逐帧表示 F提供局部运动信息,以提高其表示能力:

其中 F^i 表示经过 TDM 增强后的特征表示,H 表示我们的短期 TDM,它从Ii 周围的相邻帧中提取局部运动。 长期 TDM 旨在利用跨段时间结构来增强帧级特征表示:

其中 G 代表我们的长期 TDM,在当前的实现中,我们只考虑相邻的段级信息,以便在每个长期(long-term) TDM 中进行长期(long-range)时间建模。 通过堆叠多个长期 TDM,我们能够捕获较长尺度的时间结构。 详细信息将在接下来的小节中描述。

3.2. Short-term TDM

我们认为局部时间窗口中的相邻帧是非常相似的,直接堆叠多个帧用于后续处理是低效的。 另一方面,从每个窗口采样单个帧能够提取外观信息,但无法捕获局部运动信息。 因此,我们的短期 TDM 选择提供具有时间差异的单个 RGB 帧,以产生有效的视频表示,显式编码外观和运动信息。

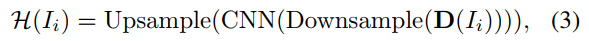

具体来说,我们的短期 TDM运行在网络的早期层,以提取低级的特征,并通过融合时间差异信息使单帧 RGB 能够感知局部运动。 如图3所示,对于每个采样帧Ii,我们在以Ii为中心的局部窗口中提取几个时间RGB差异(temporal RGB difference),然后沿通道维度D(Ii)=[D?2, D-1, D1,D2]来堆叠它们。 基于这种表示,我们提出了一种有效的 TDM 形式:

其中 D 代表 Ii 附近的 RGB 差异,CNN 是不同阶段的具体网络。 为了保持效率,我们设计了一个轻量级的 CNN 模块来对堆叠的 RGB 差异 D(Ii) 进行操作。 它通常遵循低分辨率处理策略:(1)使用平均池化将 RGB 差异下采样一半,(2)使用 2D CNN 提取运动特征,(3)上采样运动特征以匹配 RGB 特征。 这种设计来自我们的观察,即 RGB 差异在大多数区域表现出非常小的值,并且仅在运动显着区域包含高响应。 因此,对于这个稀疏信号使用低分辨率架构就足够了,而不会损失太多精度。

将短期 TDM 的信息与单个 RGB 帧融合,使原始帧级表示能包含运动模式信息,能够更好地描述局部时间窗口。 我们通过横向连接实现这种融合。 我们将短期 TDM 和帧级表示的融合连接附加到每个早期阶段(即我们实验中的阶段 1-2)。 在实践中,我们还将残差连接与其他融合策略进行了比较,如消融研究中所示。

3.3. Long-term TDM

配备短??期 TDM 的逐帧表示对于捕获局部段(窗口)内的时空信息非常有效。 然而,这种表示在时间感受野方面受到限制,因此无法探索学习动作模型的长期(long-range)时间结构。 因此,我们的长期 TDM 尝试使用跨段信息,通过新颖的双向和多尺度时间差异模块来增强原始表示。

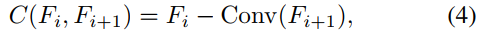

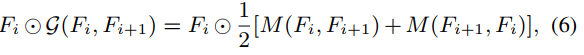

除了效率之外,远程帧之间空间位置的缺失对齐(the missing-alignment of spatial location between long-range frames)是另一个问题。 因此,我们设计了一种多尺度架构,以在差异计算之前平滑大感受野中的差异。 如图 3 所示,我们首先将特征维度以比率 r 压缩,并进行卷积以提高效率,并计算相邻段之间对齐的时间差异:

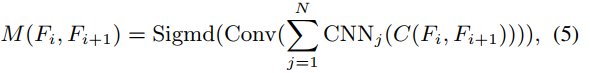

其中 C(Fi; Fi+1) 表示段 Fi的对齐时间差异,Conv 是用于空间平滑的通道卷积(channel-wise convolution ),从而缓解了缺失对齐问题。 然后,对齐的时间差异通过多尺度模块进行远程(long-range)运动信息提取:

其中不同空间尺度的CNNj旨在从不同的感受野中提取运动信息,实际中N=3。 对于缺失对齐问题,它们的融合可能更加稳健。 在实现上,它涉及三个分支:(1)短连接,(2)一个3×3卷积,(3)一个平均池化,一个3×3卷积和一个双线性上采样。 最后,我们利用双向跨段时间差异来增强帧级特征,如下所示:

其中⊙是逐元素乘法(哈达玛积,即{v1,v2,v3}T⊙{w1,w2,w3}T= {v1w1,v2w2,v3w3}T)。 我们还通过残差连接将原始帧级表示和增强后的表示结合,如等式 (2)。与短期 TDM 略有不同,我们使用差异表示作为注意力图(attention map)来增强帧级特征,which is partially based on the observation that注意力建模对后阶段的CNN 更有效。 我们还在消融实验中将这种实现与其他形式进行了比较。

3.4. Exemplar(范例): TDN-ResNet

如上所述,我们的 TDN 框架基于 TSN [38] 的稀疏采样,它对均匀分布在整个视频上的一系列帧进行操作。 我们的 TDN 提出了一种两级运动建模机制,它的重点在于以局部到全局的方式捕获时间信息。 特别是,如图 2 所示,我们在早期阶段插入短期 TDM (S-TDM) 以进行更精细和低级别的运动提取,并在后期插入长期 TDM (LTDM) 以进行更粗略和高级的时间结构建模。

我们使用 ResNet 主干 [10] 实例化我们的 TDN。遵循 V4D [42] 中的实践,ResNet 的前两个阶段是使用 S-TDMs 在每个段内提取短期时间信息,而 ResNet 的后三个阶段配备 L-TDMs 用于捕获 跨段的远程(long-range)时间结构。 对于局部运动建模,我们在第 1 阶段和第 2 阶段的 S-TDM 和主网络之间添加了残差连接。对于长期运动建模,我们在第 3-5 阶段的每个残差块中添加了 L-TDM 和时间卷积。在实践中,最终的 TDN-ResNet 仅将原始 2D TSN-ResNet 的 FLOP 增加了约 9%。

4. Experiments

在本节中,我们展示了 TDN 框架的实验结果。 首先,我们描述评估数据集和实现细节。 然后,我们对 TDN 的设计进行消融研究。 接下来,我们将我们的 TDN 与最先进的方法进行比较。 最后,我们展示了一些可视化结果以进一步分析我们的 TDN。

4.1. Datasets and implementation details

Video datasets.(视频数据集。 )我们在两个视频数据集上评估我们的 TDN,它们关注用于识别的动作实例的不同方面。 Kinetics-400 [15] 是一个大规模的 YouTube 视频数据集,拥有大约 30 万个修剪过的视频,涵盖 400 个类别。 Kinetics 数据集包含日常生活中的活动,某些类别与交互对象或场景上下文高度相关。 我们在训练数据(大约 24 万个视频)上训练我们的 TDN,并报告在验证数据桑(大约 2 万个视频)的性能。 Some-Something [8] 是一个由众包创建的大规模数据集。 通过对不同的对象执行相同的动作来收集视频,以此期望动作识别将重点放在运动属性上,而不是对象或场景上下文上。 第一个版本包含约 100k 个视频over 174 类,而第二个版本包含更多视频,包含训练集中约 169k 个视频和验证集中 25k 个视频。 我们报告了在Something-Something V1和V2验证集上的性能。

Training and testing. (训练和测试。) 在实验中,我们使用 ResNet50 和 ResNet101 来实现我们的 TDN 框架,并从每个视频中采样 T = 8 或 T = 16 帧。 按照通常做法[6, 39],在训练期间,每个视频帧都被调整为短边在[256,320](have shorter side in [256,320] )和 一个224 × 224 的随机裁剪。 我们在 ImageNet 数据集 [2] 上预训练我们的 TDN。 批大小为 128,初始学习率为 0.02。 总训练epoch在 Kinetics 数据集上设置为 100,在Something-Something 数据集上设置为 60。 当在验证集上性能饱和时,学习率将被除以 10 倍。 为了测试,将每个视频的较短边调整为 256。我们实施两种测试方案:1-clip 和 center-crop,即仅将一个来自单张clip的224 × 224 的中心裁剪(center crop)用于评估; 10- clip和 3-crop,即 3 个 256 × 256 的crop和 10 个clip用于测试。 第一个测试方案是高效的,而第二个是通过更密集的预测方案来提高准确性。

4.2. Ablation studies

我们在Something-Something V1 数据集上进行了消融实验。 对于这些评估,我们使用了 “1 clip and center crop”的测试方案,并报告 Top1 精度。 我们还与其他时间建模模块进行了比较以证明 TDM 的有效性

Study on the effect of difference operation.(差分运算的效果研究)。 我们通过探索 TDM 中时间差异操作的有效性来开始我们的研究。 我们通过简单地删除 S-TDM 中的时间差异操作并用 取平均值替换L-TDM 中的时间差异操作来实现相当可比的基线(fairly comparable baselines)。 表 1a 显示了具有时间差异或不具有时间差异的各种设置的结果。 可以看出,简单的叠加和取平均值来融合时间信息会降低约10%的识别准确率。 我们分析这些没有差异操作的时间融合策略会使网络过度拟合静态信息,无法捕捉视频中的时间变化。 在 S-TDM 和 L-TDM 中添加时间差异有助于提高精度,它们的组合可获得最佳性能。

Study on short-term TDM.(短期TDM研究。)我们比较了不同形式的短期 TDM (S-TDM)。 我们为所有后期阶段添加长期 TDM (LTDM),并在早期阶段设置不同的S-TDM。 如表 1b 所示,我们首先比较了在 S-TDM 中将差异表示与 RGB 特征相结合的不同融合策略:(1)attention with elementwise multiplication(逐元素相乘的注意力机制),(2) addition with attention,(3)only addition(加法)。 我们可以看到,我们的 S-TDM 加上简单的加法产生了最好的性能,而其他基于注意力的融合可能会破坏预先训练的特征对应(feature correspondence)。 此外,我们尝试使用 RGB 差异表示来学习通道注意力权重,就像 TEINet [21] 一样,其性能也比我们提出的 S-TDM 差(47.3% vs. 52.3%)。 在剩下的研究中,我们默认使用 S-TDM 的加法形式。

Study on long-term TDM.(长期TDM研究。) 我们在早期阶段采用短期 TDM,并比较放置在后期阶段的不同形式的长期 TDM (L-TDM) 。 结果报告在表1c中。 对于 L-TDM 设计,我们首先与两个基线架构进行比较:(1)等式 2中没有attention modeling,并且直接将差异表示加到帧级特征中; (2) 像 TEA [18]一样的channel attention modeling。 据观察,我们提出的spatiotemporal attention form of L-TDM优于without attention(52.3% 对 44.1%),也优于channel attention(52.3% 对 50.9%)。 然后,我们研究了多尺度架构在差异特征提取中的有效性,它能够将性能从 49.7% 提高到 52.3%,这证实了其大感受野对差异特征提取的有效性。 最后,我们比较了双向差分和单向差分的性能,发现双向差分有助于提高 2.3% 的性能。

Study on the location of S-TDM and L-TDM .(S-TDM和L-TDM定位的研究。) 我们对哪个阶段使用短期 TDM (S-TDM) 或长期 TDM (L-TDM) 进行了消融实验。 结果如表1d所示。 从这些结果中,我们看到在主网络中添加更多的 S-TDM 会略微增加网络计算成本,因为它具有用于时间差异表示的特征提取。 在阶段1-2使用S-TDM和在阶段3-5使用L-TDM的设置获得了最好的识别准确度并且计算成本也合理。

Short-term vs. long-term modeling.(短期vs长期建模。) 我们进行了对比实验,分别探究 S-TDM 和 L-TDM 的有效性。 结果总结在表1e中。 我们首先报告了没有 S-TDM 或 L-TDM 的基线性能,即在后期仅使用一维时间卷积进行时间建模,其准确率为 46.6%。 然后我们分别将 S-TDM 和 L-TDM 添加到基线中,它们获得了 51.5% 和 49.9% 的性能。 S-TDM 优于 L-TDM 的性能可能归因于局部运动信息对于动作识别至关重要的事实。 最后,结合 S-TDM 和 L-TDM 可以将性能提升到 52.3%,这意味着两个模块的互补性。

Comparison with other temporal modules.(与其他时间模块的比较。) 最后,我们将我们提出的 TDM 与其他时间建模方法进行比较,结果如表 1f 所示。 我们将 TDM 与三个时间模块进行比较:时间卷积 [33]、TSM [19] 和 TEINet [20]。 首先,这些方法都使用 ResNet50 作为主干,8 帧作为输入。在这种设置下,他们的 FLOP 与我们的 TDN接近。 我们发现我们的 TDN 的性能比这些具有相似 FLOP 的基线要好得多,证明了显式时间差异操作的有效性。然后,为了公平比较,我们还实现了与我们的帧数相同的其他时间模块(即 40 帧,用 ++ 表示),并且我们观察到,简单地输入更多帧不会对提高识别精度有太大贡献。 我们分析这些时间模块仍然缺乏足够的建模能力来很好地捕捉细粒度(fine-grained)的运动信息,因此更多的帧会使它们更严重地过度拟合外观(appearance)。 另一方面,由于时间差分操作,我们的 TDM 能够更多地关注运动信息,因此更多的帧能提高识别精度。

4.3. Comparison with the state of the art

在Something-Somthing V1数据集上对8帧TDN进行消融研究后,我们直接将其最佳设置转移到Something-Something V2和Kinetics400的数据集上。 在本小节中,我们在这些基准测试集上将我们的 TDN 与最先进的方法进行比较。 正如预期的那样,采样更多帧可以进一步提高准确性,但也会增加 FLOP。 我们报告了 8 帧 TDN 和 16 帧 TDN 的性能。 为了公平比较,我们简单地列出了仅使用 RGB,且没有在额外的视频数据集上进行预训练的方法的性能。

结果总结在表 2 和表 3 中。为了与以前的方法进行公平比较,我们在Something-Something 数据集上使用1 clip and center crop 测试方案,在Kinetics400 数据集上使用10 clips and 3 crops 进行测试。 我们首先与通过后期融合进行远程时间建模的2D CNN 的基线方法进行比较,例如 TSN [38] 和 TRN [44],并看到我们的 TDN 在两个数据集上都显着优于这些基线方法。 然后,我们将 TDN 与所有阶段都具有时间模块的2D CNN方法进行比较,例如 S3D [41]、R(2+1)D [33]、TSM [19]、TEINet [20]、TANet [21]、TAM [4] 和 GSM [30],我们的 TDN 在两个数据集上始终优于它们,证明了 TDM 在动作识别的时间建模中的有效性。 在此之后,我们与最近的基于 3D CNNs 的方法进行比较,例如 I3D [1]、Non-local I3D [39] 和 SlowFast [6],我们的 TDN 仍然可以获得比这些方法稍好的性能,且有相对较小的计算成本。 最后,我们比较了最近的视频识别网络,例如 SmallBigNet [17]、V4D [42]、CorrelationNet [35] 和 X3D [5]。 我们的最佳结果在Something-Something V1 上明显优于前面的方法,并且与之前在Kinetics 数据集上的最佳性能相当。 在 Kinetics 数据集上的最佳性能是 SlowFast 和 Non-local Net 的组合,它在 Top1 精度方面略好于我们,但 Top5 精度较低,FLOPs 较高。

4.4. Visualization of activation maps

我们使用 GradCAM [45, 27]将类激活图可视化(class activation maps),结果如图 4 所示。在这个可视化中,我们将 8 帧作为输入,只在中心帧中绘制激活图。 这些可视化结果表明,只有时间卷积的基线无法专注于运动显着区域,而我们的 TDN 能够定位更多与动作相关的区域,这要归功于我们提出的用于短期和长期时间建模的 TDM。 例如,我们的 TDN 更关注与交互对象的手部运动,而时间卷积可能只关注背景。 更多可视化示例和分析可以在补充材料中找到。

5. Conclusion

在本文中,我们提出了一个新的视频级框架,称为 TDN,用于从整个视频中学习动作模型。 TDN 的核心贡献是将时间差分算子推广为具有特定设计的高效通用时间模块 (TDM),用于捕获视频中的短期和长期时间信息。 我们提出了两种用于实施 TDM 的定制形式( customized forms),并系统地评估它们对时间建模的影响。 正如在 Kinetics-400 和 Something-Something 数据集上所证明的那样,我们的 TDN 能够产生优于以前使用类似主干的最先进方法的性能。

此外,我们对 TDM 进行了深入的消融研究,以研究时间差异操作的影响,并证明与具有更多帧的标准 3D 卷积相比,提取细粒度(fine-grained)时间信息更有效。 希望我们的分析提供了更多关于时间差异操作的见解,希望 TDM 能够替代3D卷积用于视频中的时间建模。

致谢。 这项工作得到了国家科学基金(62076119、61921006)、江苏省创新人才创业计划、新型软件技术与产业化协同创新中心的支持。