�����㷨

Ŀ��ֵ:���- sklearnת������Ԥ����

- KNN�㷨

- ģ��ѡ�������

- ���ر�Ҷ˹�㷨

- ������

- ���ɭ��

����Ŀ¼

sklearnת������Ԥ����

ת���� transfrom

- ʵ���� (ʵ��������һ��ת������(Transfermer))

- ����fit_transfrom(�����ĵ����������Ƶ����,����ͬʱ����)

������ estimator

- ���ڷ���Ĺ������U

- sklearn.neighbors k-�����㷨

- sklearn.naive_bayes ��Ҷ˹

- sklearn.linear_model.LogisticRegression���ع�

- sklearn.tree�����������ɭ��

- ���ڻع�Ĺ�����:

- sklearn.linear_model.LinearRegression���Իظ�

- sklearn.linear_model.Ridge��ع�

- �����ලѧϰ�Ĺ�����

- sklearn.cluster.KMeans ����

��������������

- ʵ����һ��estimator

- estimator.fit(x_train,y_train) ����

�����������,ģ������ - ģ������

1��ֱ�ӶԱ���ʵֵ��Ԥ��ֵ

y_predict = estimator.predict(x_test)

y_test == y_predict

2������ȷ��

accuracy = estimator.score(x_test,y_test)

KNN�㷨(K-�����㷨)

����˼��:��������ھ����ж�������

���һ�������������ռ��е�k��������(�������ռ������ڽ�)�������еĴ��������ijһ�����,�������Ҳ����������

k = 1 :�����ܵ��쳣ֵ��Ӱ��

k ���� :�����ܵ�����������Ӱ��

k ��С :�����ܵ��쳣���Ӱ��

����:Ԥ���β������

- ��ȡ����

- ���ݼ�����

- ��������----����

- KNNԤ��������

- ģ������

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from sklearn.preprocessing import StandardScaler

from sklearn.neighbors import KNeighborsClassifier

def knn_iris():

'''

��knn�㷨���β�����з���

:return:

'''

#1.��ȡ����

iris = load_iris()

#2.�������ݼ�

x_train,x_test,y_train,y_test = train_test_split(iris.data,iris.target,random_state=6)

#3.��������:����

transfer = StandardScaler()

x_train = transfer.fit_transform(x_train)

x_test = transfer.transform(x_test)

#4.KNN�㷨Ԥ����

estimator = KNeighborsClassifier(n_neighbors=3)#����kֵ

estimator.fit(x_train,y_train)

#5.ģ������

#����һ:ֱ�ӱȶ���ʵֵ��Ԥ��ֵ

y_predict = estimator.predict(x_test)

print("y_predict\n",y_predict)

print("ֱ�ӱȶ���ʵֵ��Ԥ��ֵ:\n",y_test==y_predict)

#������:����ȷ��

score = estimator.score(x_test,y_test)

print("ȷ��Ϊ:\n",score)

return None

if __name__ == "__main__":

# ��knn�㷨���β�����з���

knn_iris()

�ܽ�

- �ŵ�:

- ��,��������,����ʵ��,����ѵ��

- ȱ��:

- ����ָ��kzhi3,kֵѡ���Dz��ܱ�֤���ྫȷ��

- �����㷨,����������ʱ�ļ�������,�ڴ濪����

ģ��ѡ�������

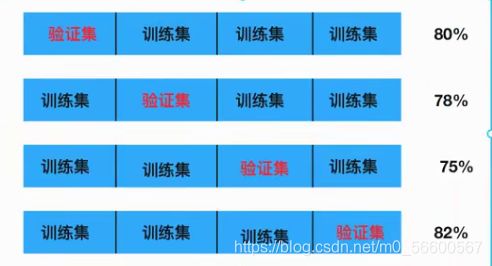

������֤:

���õ���ѵ������,��Ϊѵ������֤��������ͼΪ��:�����ݷֳ�4��,����һ����Ϊ��֤����Ȼ��4��(��)�IJ���,ÿ�ζ�������ͬ����֤�������õ�4��ģ�͵Ľ��,ȡƽ��ֵ��Ϊ���ս�����ֳ�4�۽�����֤��

������-��������

sklearn.model_selection.GridSearchCV(estimator, param_grid=None,cv=None)

estimator:����������

param_grid:����������

cv:ָ��������֤

�������:

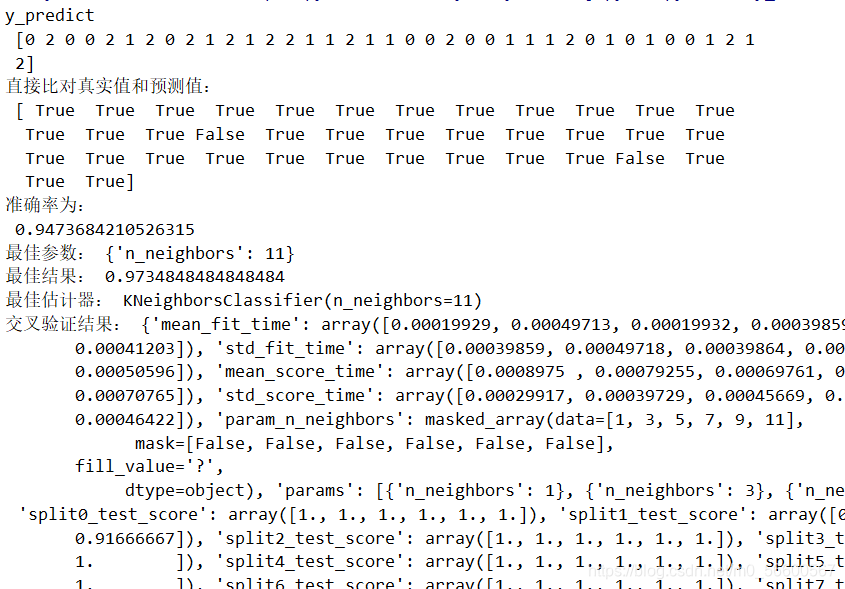

��Ѳ���: best_params_

��ѽ��: best_score_

��ѹ�����: best_estimator_

������֤���:cv_results_

����:�β������kֵ����

from sklearn.datasets import load_iris

from sklearn.model_selection import GridSearchCV

from sklearn.model_selection import train_test_split

from sklearn.neighbors import KNeighborsClassifier

from sklearn.preprocessing import StandardScaler

def knn_iris_gscv():

'''

��knn�㷨���β�����з���,�������������ͽ�����֤

:return:

'''

# 1.��ȡ����

iris = load_iris()

# 2.�������ݼ�

x_train, x_test, y_train, y_test = train_test_split(iris.data, iris.target, random_state=6)

# 3.��������:����

transfer = StandardScaler()

x_train = transfer.fit_transform(x_train)

x_test = transfer.transform(x_test)

# 4.KNN�㷨Ԥ����

estimator = KNeighborsClassifier()

# ****�������������뽻����֤

# ������

param_dict = {"n_neighbors": [1, 3, 5, 7, 9, 11]}

estimator = GridSearchCV(estimator, param_grid=param_dict, cv=10)

estimator.fit(x_train, y_train)

# 5.ģ������

# ����һ:ֱ�ӱȶ���ʵֵ��Ԥ��ֵ

y_predict = estimator.predict(x_test)

print("y_predict\n", y_predict)

print("ֱ�ӱȶ���ʵֵ��Ԥ��ֵ:\n", y_test == y_predict)

# ������:����ȷ��

score = estimator.score(x_test, y_test)

print("ȷ��Ϊ:\n", score)

# ****�鿴���

print("��Ѳ���:", estimator.best_params_)

print("��ѽ��:", estimator.best_score_)

print("��ѹ�����:", estimator.best_estimator_)

print("������֤���:", estimator.cv_results_)

return None

if __name__ == "__main__":

# ��knn�㷨���β�����з���,�������������ͽ�����֤

knn_iris_gscv()

����:Ԥ��Facebookǩ��λ��

import pandas as pd

from sklearn.model_selection import train_test_split, GridSearchCV

#1.��ȡ����

from sklearn.neighbors import KNeighborsClassifier

from sklearn.preprocessing import StandardScaler

data = pd.read_csv("train.csv")

#2.���ݴ���

# a.��С��Χ

data.query('x < 2.5 & x > 2 & y < 1.5 & y > 1')

# b.����ʱ������

time_values = pd.to_datetime(data['time'],unit='s')

date = pd.DatetimeIndex(time_values)

data['day'] = date.day

data['weekday'] = date.weekday

data['hour'] = date.hour

# print(data)

# c.���˵�ǩ�������ٵĵص�

place_count = data.groupby('place_id').count()['row_id']

place_count[place_count > 3]

data_final = data[data['place_id'].isin(place_count[place_count > 3].index.values)]

#ɸѡ����ֵ��Ŀ��ֵ

x = data_final[['x','y','accuracy','day','weekday','hour']]

y = data_final['place_id']

# print(x)

#3.���ݼ�����

x_train,x_test,y_train,y_test = train_test_split(x,y)

# 4.��������:����

transfer = StandardScaler()

x_train = transfer.fit_transform(x_train)

x_test = transfer.transform(x_test)

# 5.KNN�㷨Ԥ����

estimator = KNeighborsClassifier(n_neighbors=3)

# ****�������������뽻����֤

# ������

param_dict = {"n_neighbors": [3, 5, 7, 9]}

estimator = GridSearchCV(estimator, param_grid=param_dict, cv=3)

estimator.fit(x_train, y_train)

estimator.fit(x_train, y_train)

# 6.ģ������

# ����һ:ֱ�ӱȶ���ʵֵ��Ԥ��ֵ

y_predict = estimator.predict(x_test)

print("y_predict\n", y_predict)

print("ֱ�ӱȶ���ʵֵ��Ԥ��ֵ:\n", y_test == y_predict)

# ������:����ȷ��

score = estimator.score(x_test, y_test)

print("ȷ��Ϊ:\n", score)

# ****�鿴���

print("��Ѳ���:", estimator.best_params_)

print("��ѽ��:", estimator.best_score_)

print("��ѹ�����:", estimator.best_estimator_)

print("������֤���:", estimator.cv_results_)

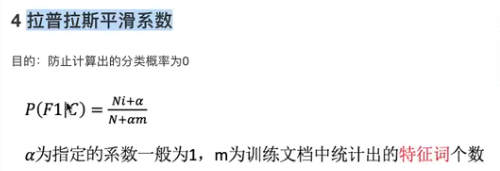

���ر�Ҷ˹�㷨

���ر�Ҷ˹ = ����(����:����������֮�����������)+��Ҷ˹

����:20�����ŷ���

from sklearn.datasets import fetch_20newsgroups

from sklearn.feature_extraction.text import TfidfVectorizer

from sklearn.model_selection import train_test_split

from sklearn.naive_bayes import MultinomialNB

def nb_news():

'''

�����ر�Ҷ˹�����Ž��з���

:return:

'''

# 1.��ȡ����

news = fetch_20newsgroups(subset='all')

# 2.�������ݼ�

x_train,x_test,y_train,y_test = train_test_split(news.data,news.target)

# 3.��������:�ı�������ȡ

transfer = TfidfVectorizer()

x_train = transfer.fit_transform(x_train)

x_test = transfer.transform(x_test)

# 4.���ر�Ҷ˹�㷨Ԥ��������

estimator = MultinomialNB()

estimator.fit(x_train,y_train)

# 5.ģ������

# ����һ:ֱ�ӱȶ���ʵֵ��Ԥ��ֵ

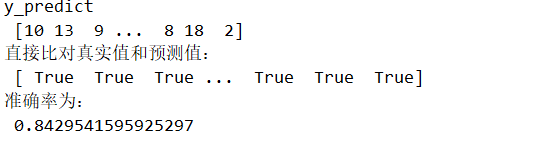

y_predict = estimator.predict(x_test)

print("y_predict\n", y_predict)

print("ֱ�ӱȶ���ʵֵ��Ԥ��ֵ:\n", y_test == y_predict)

# ������:����ȷ��

score = estimator.score(x_test, y_test)

print("ȷ��Ϊ:\n", score)

return None

if __name__ == "__main__":

nb_news()

�ܽ�:

�ŵ�:

��ȱʧ���ݲ�̫����,�㷨Ҳ�Ƚϼ�,�������ı�����

����ȷ�ȸ��ٶȿ�

ȱ��:

����ʹ�����������Զ����Եļ���,����������������й���ʱ��Ч������

������

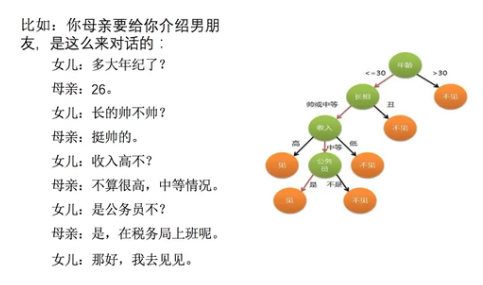

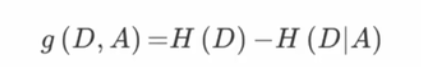

˼��:��θ�Ч���о���

��������:�������Ⱥ�˳��

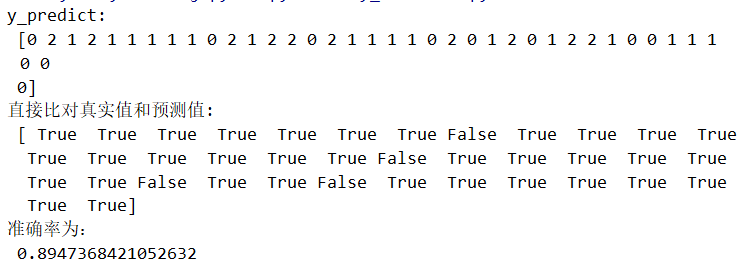

��Ϣ�ۻ���:

1. ��Ϣ:

��ũ:������������ԵĶ���

С�� ���ҽ���18�ꡱ������Ϣ������

С�� "С������19�ꡱ����������Ϣ

2. ��Ϣ�ĺ���:��Ϣ��

3. ��Ϣ����:(�������Ļ�������)

���������ӻ�

sklearn.tree.export_graphviz()

tree.excport_graphwviz(estimator,out_file='tree.dot",feature_namesm[""]

����:�þ��������β�����з���

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from sklearn.tree import DecisionTreeClassifier, export_graphviz

def decision_iris():

"""

�þ��������β�����з���

:return:

"""

# 1)��ȡ���ݼ�

iris = load_iris()

# 2)�������ݼ�

x_train, x_test, y_train, y_test = train_test_split(iris.data, iris.target, random_state=22)

# 3)������Ԥ����

estimator = DecisionTreeClassifier(criterion="entropy")

estimator.fit(x_train, y_train)

# 4)ģ������

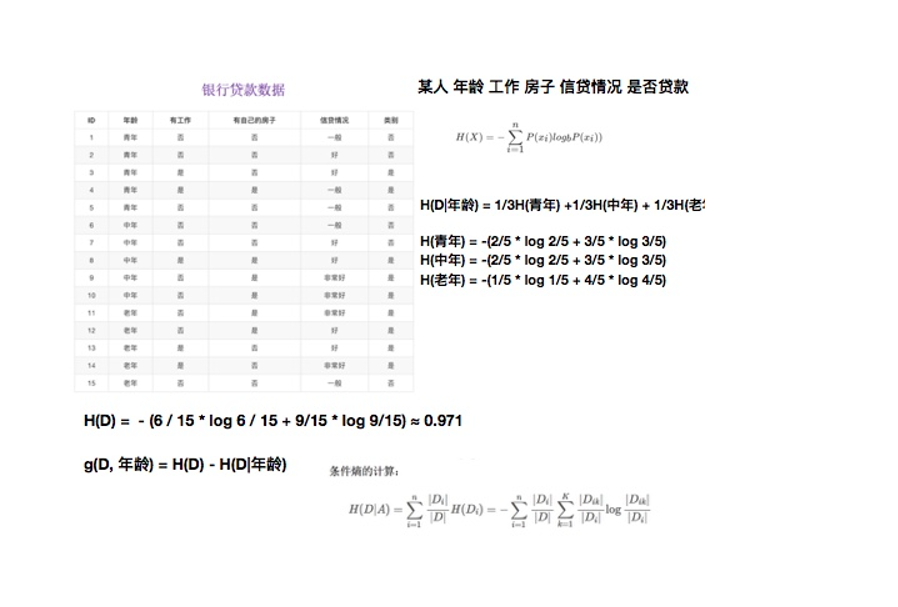

# ����1:ֱ�ӱȶ���ʵֵ��Ԥ��ֵ

y_predict = estimator.predict(x_test)

print("y_predict:\n", y_predict)

print("ֱ�ӱȶ���ʵֵ��Ԥ��ֵ:\n", y_test == y_predict)

# ����2:����ȷ��

score = estimator.score(x_test, y_test)

print("ȷ��Ϊ:\n", score)

# ���ӻ�������

export_graphviz(estimator, out_file="iris_tree.dot", feature_names=iris.feature_names)

return None

if __name__ == "__main__":

decision_iris()

�ܽ�:

�ܽ�:

- �ŵ�:

������ͽ���,��ľ���ӻ��� - ȱ��:

���ײ��������

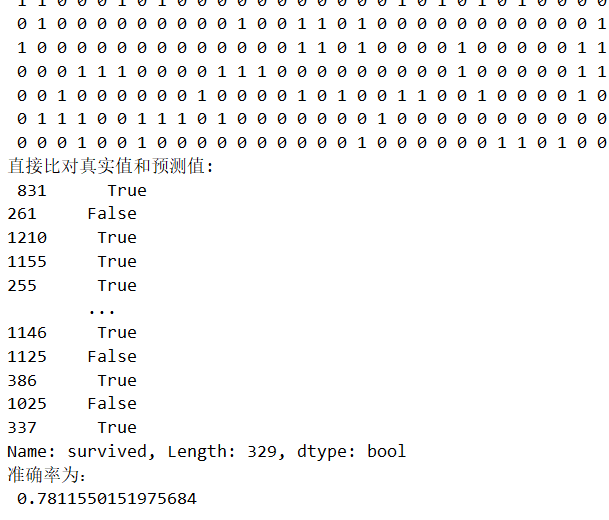

����:̩̹��˺ų˿�����Ԥ��

import pandas as pd

from sklearn.feature_extraction import DictVectorizer

from sklearn.model_selection import train_test_split

from sklearn.tree import DecisionTreeClassifier,export_graphviz

#1.��ȡ����

from sklearn.tree import DecisionTreeClassifier, export_graphviz

titanic = pd.read_csv("titanic.csv")

#ɸѡ����ֵ��Ŀ��ֵ

x = titanic[['pclass','age','sex']]

y = titanic['survived']

# print(x.head())

# print(y.head())

#2.���ݴ���

#a.ȱʧ���ݴ���:

x['age'].fillna(x['age'].mean(),inplace=True)

#b.ת�����ֵ�

x = x.to_dict(orient='recorda')

#3.���ݼ�����

x_train,x_test,y_train,y_test = train_test_split(x,y,random_state=22)

#�ֵ�������ȡ

transfer = DictVectorizer()

x_train = transfer.fit_transform(x_train)

x_test = transfer.transform(x_test)

#4.������Ԥ����

estimator = DecisionTreeClassifier(criterion="entropy")

estimator.fit(x_train, y_train)

# 5.ģ������

# ����1:ֱ�ӱȶ���ʵֵ��Ԥ��ֵ

y_predict = estimator.predict(x_test)

print("y_predict:\n", y_predict)

print("ֱ�ӱȶ���ʵֵ��Ԥ��ֵ:\n", y_test == y_predict)

# ����2:����ȷ��

score = estimator.score(x_test, y_test)

print("ȷ��Ϊ:\n", score)

# ���ӻ�������

export_graphviz(estimator, out_file="titanic_tree.dot", feature_names=transfer.get_feature_names())

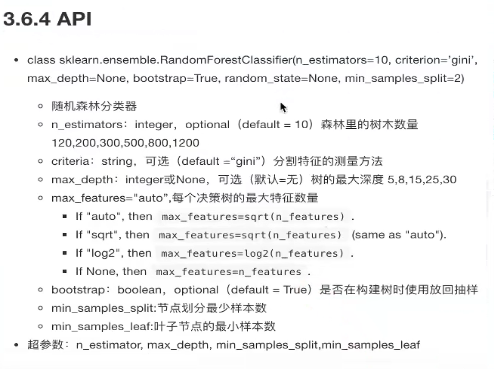

���ɭ��

����ѧϰ����:

����ѧϰͨ����������ģ����ϵ��������һԤ�����⡣���Ĺ���ԭ�������ɶ��������/ģ��,���Զ�����ѧϰ������Ԥ�⡣��ЩԤ������ϳ����Ԥ��,��������κ�һ�������������Ԥ�⡣

���ɭ��:

���:ѵ�������+����ֵ���

ɭ��:��������������ķ���Ⱥ

����:

import pandas as pd

from sklearn.feature_extraction import DictVectorizer

from sklearn.model_selection import train_test_split

from sklearn.ensemble import RandomForestClassifier

from sklearn.model_selection import GridSearchCV

#1.��ȡ����

from sklearn.tree import DecisionTreeClassifier, export_graphviz

titanic = pd.read_csv("titanic.csv")

#ɸѡ����ֵ��Ŀ��ֵ

x = titanic[['pclass','age','sex']]

y = titanic['survived']

# print(x.head())

# print(y.head())

#2.���ݴ���

#a.ȱʧ���ݴ���:

x['age'].fillna(x['age'].mean(),inplace=True)

#b.ת�����ֵ�

x = x.to_dict(orient='recorda')

#3.���ݼ�����

x_train,x_test,y_train,y_test = train_test_split(x,y,random_state=22)

#�ֵ�������ȡ

transfer = DictVectorizer()

x_train = transfer.fit_transform(x_train)

x_test = transfer.transform(x_test)

#4.������Ԥ����

estimator = DecisionTreeClassifier(criterion="entropy")

estimator.fit(x_train, y_train)

# 5.ģ������

# ����1:ֱ�ӱȶ���ʵֵ��Ԥ��ֵ

y_predict = estimator.predict(x_test)

print("y_predict:\n", y_predict)

print("ֱ�ӱȶ���ʵֵ��Ԥ��ֵ:\n", y_test == y_predict)

# ����2:����ȷ��

score = estimator.score(x_test, y_test)

print("ȷ��Ϊ:\n", score)

# ���ӻ�������

export_graphviz(estimator, out_file="titanic_tree.dot", feature_names=transfer.get_feature_names())

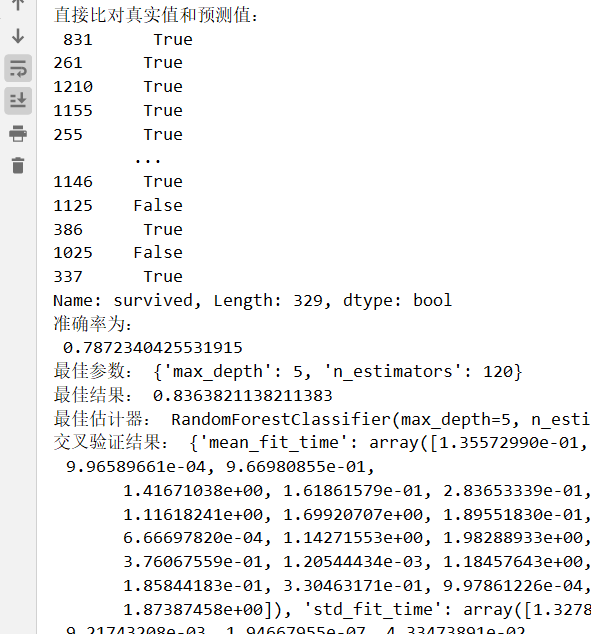

estimator = RandomForestClassifier()

# ****�������������뽻����֤

# ������

param_dict = {"n_estimators": [120,200,300.500,800,1200],

'max_depth':[5,8,15,25,30]}

estimator = GridSearchCV(estimator, param_grid=param_dict, cv=3)

estimator.fit(x_train, y_train)

estimator.fit(x_train, y_train)

# 6.ģ������

# ����һ:ֱ�ӱȶ���ʵֵ��Ԥ��ֵ

y_predict = estimator.predict(x_test)

print("y_predict\n", y_predict)

print("ֱ�ӱȶ���ʵֵ��Ԥ��ֵ:\n", y_test == y_predict)

# ������:����ȷ��

score = estimator.score(x_test, y_test)

print("ȷ��Ϊ:\n", score)

# ****�鿴���

print("��Ѳ���:", estimator.best_params_)

print("��ѽ��:", estimator.best_score_)

print("��ѹ�����:", estimator.best_estimator_)

print("������֤���:", estimator.cv_results_)

�ܽ�:

�ڵ�ǰ�����㷨��,���м��õ�ȷ��

�ܹ���Ч�������ڴ����ݼ���,�������и�ά��������������,���Ҳ���Ҫ��ά

�ܹ��������������ڷ��������ϵ���Ҫ��