1. 💢ЮЪЬтУшЪі

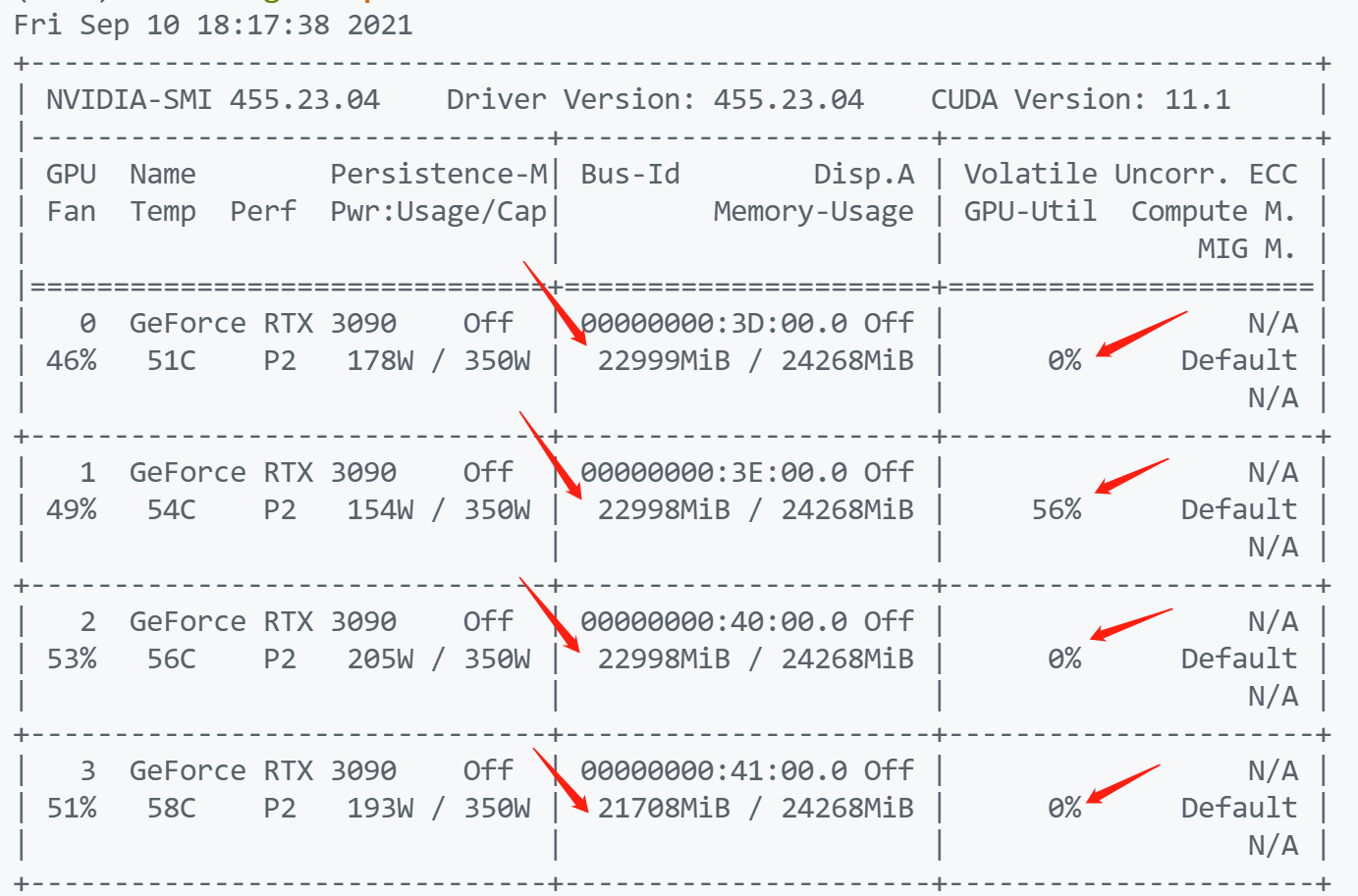

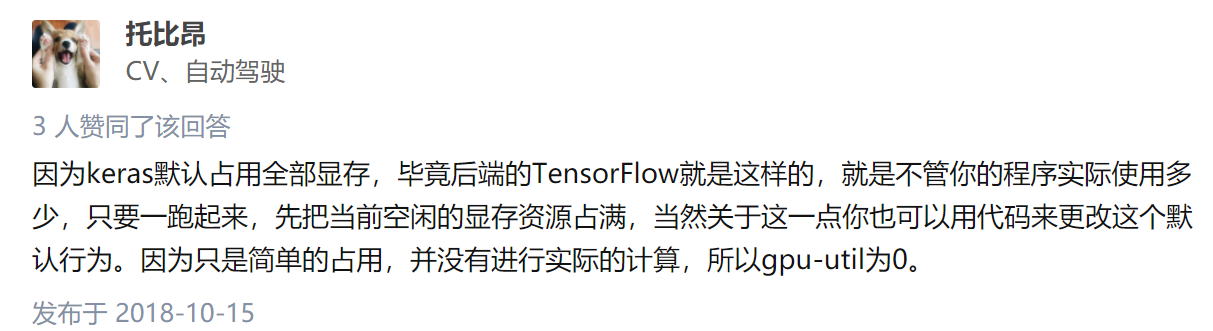

дЫааГЬађЕФЪБКђЬсабЯдДцВЛЙЛ,ВщПДСЫвЛЯТnvidia-smi,ШЗЪЕЯдДцеМТњСЫ,ЕЋЪЧGPU-Util,gpuРћгУТЪгаШ§ИіЖМЪЧ0,жЛгавЛИіЪЧ56%

ЫбЫїКѓЗЂЯжетИіЯжЯѓЕФдвђЛЙБШНЯЦеБщ,ЕЋЪЧЫЦКѕУЛгаМИИіПЩвдКмКУНтОіетИіЮЪЬт,

ВЮПМ:

- НХБОжЎМвЕФЮФеТ:Pytorch GPUФкДцеМгУКмИп,ЕЋЪЧРћгУТЪКмЕЭШчКЮНтОі,

- зЊдиздCSDNВЉПЭ:Pytorch GPUФкДцеМгУКмИп,ЕЋЪЧРћгУТЪКмЕЭ,

- ?змНсздCSDNВЉПЭ:ЩюЖШбЇЯАPyTorch,TensorFlowжаGPUРћгУТЪНЯЕЭ,CPUРћгУТЪКмЕЭ,ЧвФЃаЭбЕСЗЫйЖШКмТ§ЕФЮЪЬтзмНсгыЗжЮі етЦЊЕФЕудоСПЦРТлЪ§зюЖр,вдетИіЮЊжївЊЁЃПДСЫвЛЯТ,ШЗЪЕКмУїЮњ,вВОйСЫР§згЁЃ

2. 🥗двђЗжЮі

2.1 GPUФкДцеМгУТЪ(memory usage)

- GPUФкДцЕФеМгУТЪЭљЭљЪЧгЩФЃаЭДѓаЁКЭbatchsizeОіЖЈЕФ,ШчЙћЗЂЯжGPUеМгУТЪКмаЁ,БШШч40%,70%ЕШЕШЁЃШчЙћДЫЪБЭјТчНсЙЙвбОЙЬЖЈ,дђжЛашвЊИФБфbatch sizeЕФДѓаЁ,ОЭПЩвдОЁСПРћгУЭъећИіGPUЕФФкДцЁЃ

- ЖдGPUФкДцеМгУТЪгАЯьзюДѓЕФЛЙЪЧФЃаЭДѓаЁ,АќРЈЭјТчЕФПэЖШ,ЩюЖШ,ВЮЪ§СП,жаМфУПвЛВуЕФЛКДц,ЖМЛсдкФкДцжаПЊБйПеМфРДНјааБЃДц,ФЃаЭБОЩэЛсеМгУКмДѓвЛВПЗжФкДцЁЃ

- ЦфДЮЪЧbatch sizeЕФДѓаЁ,вВЛсеМгУгАЯьФкДцеМгУТЪЁЃbatch sizeЩшжУЮЊ128,гыЩшжУЮЊ256ЯрБШ,ФкДцеМгУТЪЪЧНгНќгк2БЖЙиЯЕЁЃЕБФуbatch sizeЩшжУЮЊ128,еМгУТЪЮЊ40%ЕФЛА,ЩшжУЮЊ256ЪБ,ДЫЪБФЃаЭЕФеМгУТЪдМЕШгк80%,ЦЋВюВЛДѓЁЃЫљвддкФЃаЭНсЙЙЙЬЖЈЕФЧщПіЯТ,ОЁСПНЋbatch sizeЩшжУДѓ,ГфЗжРћгУGPUЕФФкДцЁЃ

- GPUЛсКмПьЕФЫуЭъФуИјНјШЅЕФЪ§Он,жївЊЦПОБдкCPUЕФЪ§ОнЭЬЭТСПЩЯУцЁЃ

2.2 GPUФкДцРћгУТЪ(volatile GPU-Util)

volatile memory взЪЇадДцДЂЦї

- ЕБУЛгаЩшжУКУCPUЕФЯпГЬЪ§ЪБ,етИіВЮЪ§ЪЧдкЗДИДЕФЬјЖЏЕФ,0%,20%,70%,95%,0%ЁЃетбљЭЃЯЂ1-2 УыШЛКѓгжжиИДЦ№РДЁЃ

- ЦфЪЕЪЧGPUдкЕШД§Ъ§ОнДгCPUДЋЪфЙ§РД,ЕБЪ§ОнДгзмЯпДЋЪфЕНGPUжЎКѓ,GPUж№НЅМЦЫуЦ№РД,РћгУТЪЛсЭЛШЛЩ§Ип,ЕЋЪЧGPUЕФЫуСІКмЧПДѓ,0.5УыОЭЛљБОФмДІРэЭъЪ§Он,ЫљвдРћгУТЪНгЯТРДгжЛсНЕЯТШЅ,ЕШД§ЯТвЛИіbatchЕФДЋШыЁЃ

- ЫљвдGPUРћгУТЪЦПОБдкФкДцДјПэКЭФкДцНщжЪЩЯвдМАCPUЕФадФмЩЯУцЁЃ

- ЬсИпGPUРћгУТЪЕФЗНЪН:

- гВМўЩЯ(зюКУ):ИќЛЛКУЕФЫФДњЛђепИќЧПДѓЕФФкДцЬѕ,ХфКЯИќКУЕФCPUЁЃ

- ШэМўЩЯ(вдpytorchЮЊР§):

- PyTorchПђМмЕФЪ§ОнМгди

DataloaderРржаАќКЌСЫвЛаЉгХЛЏ,АќРЈnum_workers(ЯпГЬЪ§)вдМАpin_memory,ПЩвдЬсЩ§ЫйЖШЁЃНтОіЪ§ОнДЋЪфЕФДјПэЦПОБКЭGPUЕФдЫЫуаЇТЪЕЭЕФЮЪЬтЁЃ - дкTensorFlowЯТвВРрЫЦЕФЩшжУЁЃ

ЯъЯИРДЫЕ

- ЪзЯШвЊНЋnum_workers(ЯпГЬЪ§)ЩшжУКЯРэ,4,8,16ЪЧМИИіГЃбЁЕФМИИіВЮЪ§ЁЃ

ВтЪдЗЂЯжНЋnum_workersЩшжУЕФЗЧГЃДѓ,Р§Шч,24,32,ЕШ,ЦфаЇТЪвВВЛвЛЖЈЛсБфИп,вђЮЊФЃаЭашвЊНЋЪ§ОнЦНОљЗжХфЕНМИИізгЯпГЬШЅНјаадЄДІРэ,ЗжЗЂЕШЪ§ОнВйзї,ЩшИпСЫЗДЖјгАЯьаЇТЪЁЃ

ЕБШЛ,ЯпГЬЪ§ЩшжУЮЊ1,ЪЧЕЅИіCPUРДНјааЪ§ОнЕФдЄДІРэКЭДЋЪфИјGPU,аЇТЪвВЛсЕЭЁЃ- ЦфДЮ,ЕБЗўЮёЦїЛђепЕчФдЕФФкДцНЯДѓ,адФмНЯКУЕФЪБКђ,ПЩвдДђПЊpin_memory,ОЭЪЁЕєСЫНЋЪ§ОнДгCPUДЋШыЕНЛКДцRAMРя,дйИјДЋЪфЕНGPUЩЯ;ЮЊTrue,ЛсжБНггГЩфЕНGPUЕФЯрЙиФкДцПщЩЯ,ЪЁЕєСЫвЛЕуЪ§ОнДЋЪфЪБМфЁЃ

2.3 torch.utils.data.dataloader

ЙйЗНЮФЕЕ:torch.utils.data.dataloader

ШЗЪЕгаСНИіживЊЕФВЮЪ§:

num_workers (int, optional): how many subprocesses to use for data

loading. ``0`` means that the data will be loaded in the main process.

(default: ``0``)

collate_fn (callable, optional): merges a list of samples to form a

mini-batch of Tensor(s). Used when using batched loading from a

map-style dataset.

pin_memory (bool, optional): If ``True``, the data loader will copy Tensors

into CUDA pinned memory before returning them. If your data elements

are a custom type, or your :attr:`collate_fn` returns a batch that is a custom type,

see the example below.

ЪЙгУетИіВЮЪ§,ПЩвдНЋtensorПНБДЕНcudaЕФpinned memory,

Йигкpinned memory,ПЩвдВЮПМЮФеТ:ВЉПЭдА6.1 CUDA: pinned memoryЙЬЖЈДцДЂ,ЪЧвЛжжМгЫйЪ§ОнДгcpuЕНgpuДЋЪфЫйЖШЕФЗНЪНЁЃ

- ЪЙгУpytorchЪБ,бЕСЗМЏЪ§ОнЬЋЖрДяЕНЩЯЧЇЭђеХ,DataloaderМгдиКмТ§дѕУДАь? - ШЫУёвеЪѕМвЕФЛиД№ - жЊКѕ

- pytorchФкДцаЙТЖ-dataloader

2.4 ЦфЫћЯрЙиФкШн

https://www.zhihu.com/question/298616211

3. 🍔КУЕФЪЕМљОбщ

дкЕїЪдЙ§ГЬ,

- УќСю:

topЪЕЪБВщПДCPUЕФНјГЬРћгУТЪ,етИіВЮЪ§ЖдгІФуЕФnum_workersЕФЩшжУ; - УќСю:

watch -n 0.5 nvidia-smiУП0.5УыЫЂаТВЂЯдЪОЯдПЈЩшжУЁЃЪЕЪБВщПДФуЕФGPUЕФЪЙгУЧщПі,етЪЧGPUЕФЩшжУЯрЙиЁЃ - етСНИіХфКЯКУЁЃАќРЈbatch_sizeЕФЩшжУЁЃ

ЪЙгУСЫwatch -n 0.5 nvidia-smiетИіУќСюжЎКѓ,ВХШЗЪЕПЩвдПДЕН,ЦфЪЕGPUЪЧдкдЫааЕФ,жЛЪЧБфЛЏКмПьЁЃвЛжБдкБфЖЏЁЃ