多层感知机

Part1:《动手学深度学习》之线性神经网络

Part2:《动手学深度学习》之多层感知机

Kaggle 加州2020年房价预测竞赛

首先:调试的是李沐老师给出的代码,最终实现效果不理想。提交kaggle,对数均方误差0.16多,排名3000靠外。

其次,查看相关博客,找了几篇博客,跑通了kaggle比赛:房价预测,对比李沐老师的给出代码,主要就是三部分不同。

- 数据预处理部分的不同

- 网络架构添加了一层

- 对数均方误差的实现,将小于1的值设成1,使的取对数时数值更稳定。

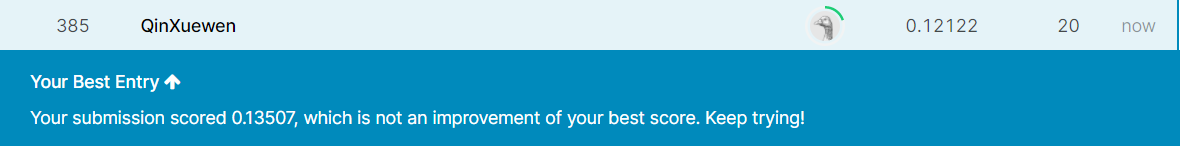

进行简单调整,对数均方误差降到了0.12122,排名385。

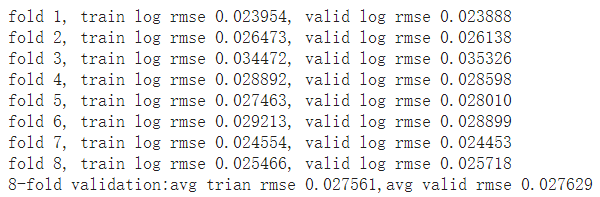

最后,因为数据预处理比较重要,就又查看相关资料,有篇博客中讲的挺详细的,然后迁移到代码中,在测试集合验证集中效果很好,但是提交kaggle,效果差的离谱。

总结:

- 我感觉本次实战最重要的一点就是,数据的预处理部分,数据处理好了,性能提高很多。

- 其次就是网络架构,单层的线性回归效果不会很理想,但是再加一层,加个激活函数,效果就会好很多。由于时间原因,没有测试其他的网络结构。

- 超参数的调整,佛系操作,看运气。

- 通过本次简单的实战,将前面所学到的相关知识进行一次汇总,不仅仅局限于理论知识的学习,将所学付诸实践,看到了简单的成果,然而也体现了自己代码能力太弱,只能做一个调参侠。。。。。。最终结果好容易过拟合。。。

总结

问题:

- 信息论知识,熵,交叉熵等理解不清楚。

- Xavier初始化,没看懂。

- 环境和分布偏移,没看懂。

为了进一步理解数学公式,还需进一步加强概率论的学习。其次,通过本周学习,理论+实践才能真正的锻炼自己能力,强化理论,付诸实践。