1.����ģ��

����ģ��(parametric models)��Dz���ģ��(Nonparametric models)����Ҫ��������:�������ݷֲ��ļ��費ͬ��

����ģ�Ͷ������ݷֲ�(data distribution)���м����,���Dz���ģ�Ͷ������ݷֲ��Ǽ������ɵ�(distribution free)�����,��ν����ģ����Dz���ģ���еIJ���,��ָ���ݷֲ��IJ�����

�����IJ���ģ�Ͱ���:

���ع�

���Իع�

����,���ع����Ǽ���һ���������ݷ��ϲ�Ŭ���ֲ�,�����Իع����Ǽ�����Ӧ�����Ƿ�����̬�ֲ��ġ�

��������Ľ���,��������������ģ���������ŵ�:

1.������,���н�ǿ�Ŀɽ�����,ʵ���Ϲ����г��õ����ع����Ҫ��һ���ŵ���ǿɽ�����ǿ��

2.ѵ���ٶȿ졣��Ϊ�����Ѿ����������ݷֲ��IJ���,��˲���ѧϰ��ѵ�����̶���ȽϿ졣

3.��Ҫ��������С:ֻ��Ҫ�Ƚ��ٵ��������ܶ�����������ñȽϺá�

2.�Dz���ģ��

�����ģ�����,��Ȼ�Dz���ģ�;��Ƕ����ݷֲ��IJ����������衣

�����dz��õ���ģ��,naive bayes, svm��,���ǷDz���ģ�͡�

��Ϊ�Dz���ģ�Ͳ���Ŀ�꺯��������,�������С,����ģ�͵ı���������Ƚ�ǿ����������ģ����ʽ�ľ����ԱȽ�С,���Զ������и����õ�����ԡ���ͬ��ȱ��Ҳ�Ƚ�����,������Ҫ�����������,����ѵ���ٶ���,ͬʱ�бȽϸߵĿ��ܷ���overfitting��

3.����ģ�����б�ģ��

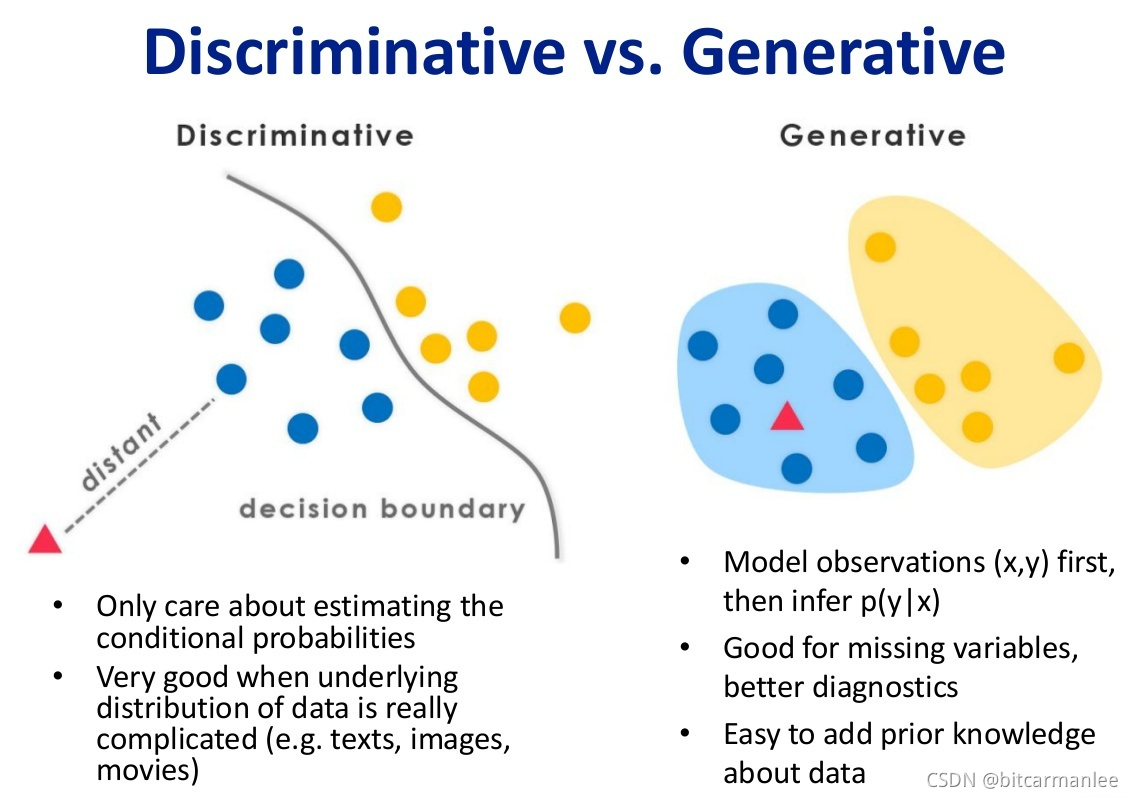

���ڹ۲����X��Ŀ�����Y,�б�ģ���Ǹ����۲����Xֻ��Y���������ʷֲ�,��P(Y|X=x);������ģ���ǻ�ȡX��Y�����ϸ��ʷֲ�P(X, Y)��

ͼƬ��������

�����б�ģ����˵,����P(Y|X)���������dz�����LR,SVM���㷨,�����б�ģ�͡�������Xȷ���Ժ�,���Y�Ϳ���ȷ����

������ģ�͵ĵ���������Naive Bayes����Ҷ˹��ʽ�Ļ����Ƶ����̾��������ϸ��ʹ�ʽ����:

p

(

x

,

y

)

=

p

(

x

)

?

p

(

y

�O

x

)

=

p

(

y

)

?

p

(

x

�O

y

)

p(x, y) = p(x) \cdot p(y|x) = p(y) \cdot p(x|y)

p(x,y)=p(x)?p(y�Ox)=p(y)?p(x�Oy)

���������ñ�Ҷ˹���з���,����ĵ���ʵ����������ϸ���p(x,y)��ȥ���ƺ������p(y|x)��

���������ɷ�ģ��HMMҲ�dz���������ģ�͡�