��������ǿ��ѧϰ��һƪ��Deep Q-learning

Q-learning �㷨

ǿ��ѧϰ����һ���������ɷ����Ϊ���ⱳ��,�����⽨ģΪ(

S

,

A

,

P

,

r

,

��

S,A,P,r,\gamma

S,A,P,r,��) ��ʽ,����

S

S

SΪ״̬�ռ�,

A

A

AΪ�����ռ�,

P

P

PΪ״̬ת�ƺ���,

r

r

rΪ���溯����agentͨ����ij��״̬ѡ��ij�������뻷�����н���,ʹ�û���������̬�ݱ�,agent���Ի�ȡ��Ӧ�����档ǿ��ѧϰ�����Ŀ������ҵ�һ�����ŵĶ�������

��

\pi

��,ʹ��agent�õ��������������

һ�ֺ���Ȼ���뷨����,�����ض���һ��״̬,�Ҹ���ÿһ������һ��ֵȥ��ʾ�ö����ļ�ֵ,��ô��״̬���ݵĹ�����,����ÿһ�ε�״̬�϶�ѡ���ֵ���Ķ���,��ô�����������ݹ���������õ���������ͻ����,��������value-base��ѧ��,��ѧ���Լ�ֵ����Ϊ�ؼ���,��Q��������ʾ״̬-������ֵ,��

Q

��

(

s

,

a

)

Q_\pi(s,a)

Q��?(s,a)��ʾ����

��

\pi

����״̬sʱ����a�ļ�ֵ��

��Ϊǿ��ѧϰ��Ŀ����������溯��,���������ɷ������һ����̬���ݹ���,��Ƶ�ʱ�������,������������ʽ������Ϊ���溯���ı�ʾ������������ʱ�䲽��Ϊ��,һ�ֱ�ʾ��ʽ��ƽ�����潱������,��

R

��

=

E

[

r

1

+

r

2

+

?

+

r

T

T

�O

��

]

R_\pi=E[\frac{r_1+r_2+\cdots+r_T}{T}|\pi]

R��?=E[Tr1?+r2?+?+rT??�O��],��һ���Ǵ����ۿ����ӵĽ�������,��

R

��

=

E

[

r

1

+

��

r

2

+

��

2

r

3

+

?

+

��

T

?

1

r

T

�O

��

]

R_\pi=E[r_1+\gamma r_2 + \gamma ^{2}r_3+\cdots+\gamma^{T-1}r_T|\pi]

R��?=E[r1?+��r2?+��2r3?+?+��T?1rT?�O��],�����ۿ����ӵĴ�������������,һ��Ϊ�˸��ӿ��ص�ǰ����,����δ���������Ҫ��,����Ϊ�˵�T���������ʱ,���溯�������������������ɷ���ƶ�̬����,���ȫ������ȼ������ÿһ��ʱ�̺������,���Զ�����ֵ��������Ϊ

Q

��

(

s

t

,

a

t

)

=

E

[

r

t

+

1

+

��

r

t

+

2

+

?

+

��

T

?

t

?

1

r

T

�O

��

]

Q_\pi(s_t,a_t)=E[r_{t+1}+\gamma r_{t+2}+\cdots+\gamma ^{T-t-1}r_{T}|\pi]

Q��?(st?,at?)=E[rt+1?+��rt+2?+?+��T?t?1rT?�O��]��

Q-learning��һ��model-free�ķ���,��̬�����ķ���ʹ��

Q

t

Q_t

Qt?��������

Q

?

Q^*

Q?,������ʽΪ

Q

t

+

1

(

s

t

,

a

t

)

=

Q

t

(

s

t

,

a

t

)

+

��

(

r

t

+

1

+

��

Q

t

(

s

t

+

1

,

a

t

+

1

)

?

Q

t

(

s

t

,

a

t

)

)

Q_{t+1}(s_t,a_t) = Q_t(s_t,a_t)+\alpha(r_{t+1}+\gamma Q_t(s_{t+1},a_{t+1})-Q_t(s_t,a_t))

Qt+1?(st?,at?)=Qt?(st?,at?)+��(rt+1?+��Qt?(st+1?,at+1?)?Qt?(st?,at?))

����

��

\alpha

��Ϊѧϰ�ʡ�

Q-learning�㷨���������ѱ�֤��������t�IJ�������,����

Q

t

(

s

t

,

a

t

)

Q_t(s_t,a_t)

Qt?(st?,at?)������������״̬-������ֵ����

Q

?

(

s

t

,

a

t

)

Q^*(s_t,a_t)

Q?(st?,at?)������

Q

?

(

s

t

,

a

t

)

=

m

a

x

��

Q

��

(

s

t

,

a

t

)

Q^*(s_t,a_t)=max_\pi Q_\pi(s_t,a_t)

Q?(st?,at?)=max��?Q��?(st?,at?)���㱴��������:

Q

?

(

s

t

,

a

t

)

=

E

[

r

t

+

1

+

��

Q

?

(

s

t

+

1

,

a

t

+

1

)

]

Q^*(s_t,a_t)=E[r_{t+1}+\sigma Q^*(s_{t+1},a_{t+1})]

Q?(st?,at?)=E[rt+1?+��Q?(st+1?,at+1?)]

Q

?

Q^*

Q?��Ӧ�����Ų��Լ�Ϊ

��

?

\pi^*

��?��

ͨ��ʹ��Q-learning�㷨�ķ����ǽ���һ��Q����,��״̬Ϊ������,�Զ���Ϊ������Q���������洢״̬-������ֵ,ÿһ�ε�����Ա����ڵ����ݽ��и���,Q-learning�㷨�ľ����Ա��ɴ˲���,��״̬�ռ�Ͷ����ռ�����Ӵ�ʱ,������ռ�ݵ��ڴ���ܴ�,���ұ���������Ҫ����ĸ��Ӷ�,���ÿһ��״̬�Ķ������ϲ�ͬ,��ô������Ҳ��洢�ܶ���Чֵ,����ڴ���˷ѡ����Q-learning�㷨��ܺõĽ��������⡣

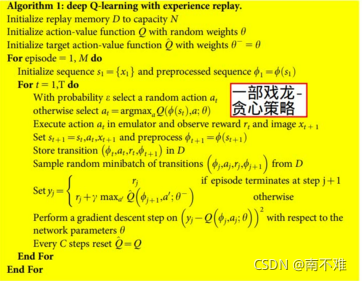

Deep Q-learning�㷨

Deep Q-learning�㷨�����������״̬-������ֵ����,����ʵ�ֶ˶Զ˵�ѵ����

Deep Q-learnig��ӵ����������ṹ,һ��������ѵ����Ԥ������

Q

(

s

,

a

;

��

)

Q(s,a;\theta)

Q(s,a;��),һ�������������ʵֵ��Ŀ������

Q

(

s

,

a

;

��

^

)

Q(s,a;\hat{\theta})

Q(s,a;��^),����

L

(

��

)

=

E

[

(

r

t

+

1

+

��

Q

(

s

t

+

1

,

a

t

+

1

;

��

^

)

?

Q

(

s

t

,

a

t

)

)

2

]

L(\theta)=E[(r_{t+1}+\sigma Q(s_{t+1},a_{t+1};\hat{\theta}) - Q(s_t,a_t))^2]

L(��)=E[(rt+1?+��Q(st+1?,at+1?;��^)?Q(st?,at?))2]��Ϊ�Ż�������������з�������ѵ������ͼΪDQN����Ĵ���ṹ:

Deep Q-learning�������������µ�:

һ replay buffer����ʹ��һ��buffer�洢agent�뻷���Ľ�������,��ѵ��ʱ,�����buffer�в���,�������ŵ���:1.������������������� 2.���Ա�������֮���ǿ�����,��Ϊ���ѧϰ��ѵ��Ҫ���������Ƕ���ͬ�ֲ���,��ǿ��ѧϰ����������ǿ�ҵ�ʱ����,���Խ��������ݷ���buffer�н��д��Ҳ���,���Զ����������Ч��ѵ��

�� target network ����˵��DQN����������ܹ�:Ԥ�������Ŀ������,��Ϊ���ѧϰ��ѵ��Ҫ��label�ǹ̶������,������DQN��Ҫ��Ŀ������IJ��������ٶ�����Ԥ������,ͨ����ʮ��epoch�Ÿ���һ��target network,�����Ż�ʹ�������ѵ�������ȶ���