论文名称:Effective gene expression prediction from sequence by integrating long-range interactions

论文地址:https://www.aminer.cn/pub/615d7dd35244ab9dcb92df24?f=cs

DeepMind 的研究者表示,「我们相信 AI 可以帮助我们深入理解这些复杂的领域,加速科学进步,并未人类健康带来潜在收益。」

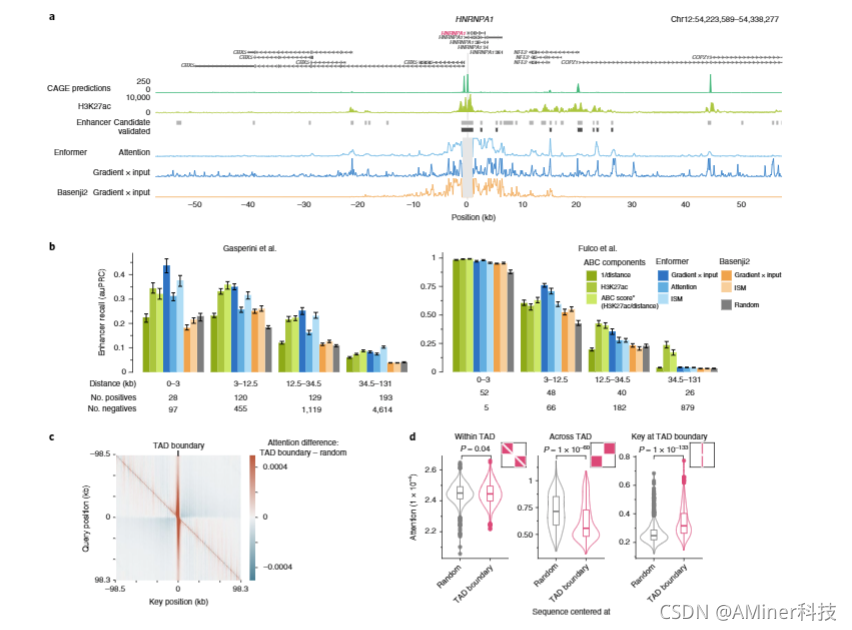

以往关于基因表达的研究通常使用卷积神经网络作为基本构建块,但这些网络在建模远端增强子(enhancer)对基因表达的影响方面存在局限。增强子是 DNA 上一小段可与蛋白质结合的区域,与蛋白质结合之后,基因的转录作用将会加强。增强子可能位于基因上游,也可能位于下游,且不一定接近所要作用的基因,这是因为染色质的缠绕结构,使序列上相隔很远的位置也有机会相互接触。因此,要想精确研究增强子对基因表达的影响,模型需要「阅读」尽可能长的 DNA 序列。

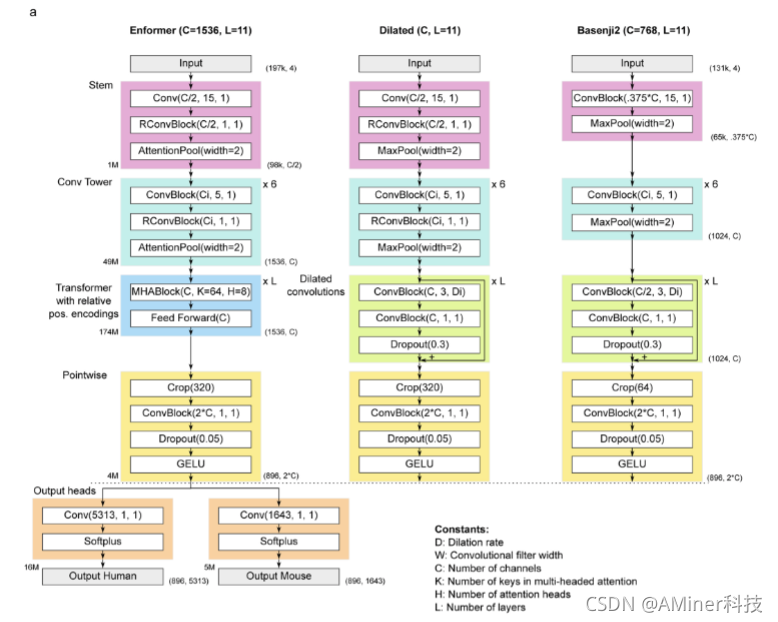

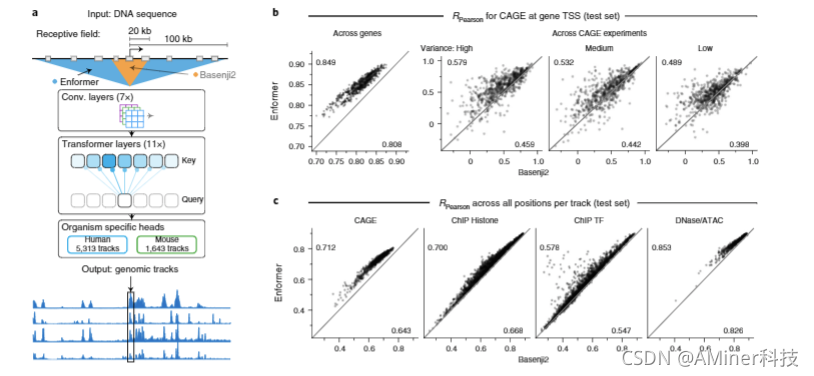

DeepMind 表示,他们最初的探索依赖于 Calico 的 Basenji2 模型,它可以从相对较长的 DNA 序列(40, 000 个碱基对)中预测调控活性,但这个长度还是不够。

基于这些认识,研究者意识到,要想捕获长序列,必须在基本架构层面进行改变。

于是,他们开发了一个基于 Transformer 的新模型――Enformer,以利用自注意力机制处理更大范围的 DNA 上下文。和擅长阅读长文本的 Transformer 类似,改造后的 Enformer 能够「阅读」很长的 DNA 序列,可处理的序列长度达到之前的 5 倍(200, 000 个碱基对)。有了这样一个模型,研究者就能从更长的 DNA 序列上建模增强子对基因表达的影响。

AMiner,让AI帮你理解科学!https://www.aminer.cn