摘要

在点云领域,有监督的方法需要大量人工标注,这非常昂贵且耗时,因此催生了无监督域自适应(UDA)。UDA在源域使用标记数据训练模型,同时使模型在目标域上具有良好的泛化能力。现有研究表明,使用源域和目标域数据的自监督学习有助于提高训练模型的适应性,但它们都依赖于手工设计的自监督任务。在本文中,我们提出了一个可学习的自监督任务,并将其集成到基于自监督的点云UDA体系结构中。具体地说,我们提出了一种可学习的非线性变换,该变换在保留原始语义信息的情况下,对点云的一部分进行变换以生成丰富而复杂的点云,并且所提出的自监督任务是从变换后的点云重构原始点云。在UDA体系结构中,网络之间共享一个编码器,用于自监督任务和点云分类或分割的主要任务,因此可以对编码器进行训练,以提取适用于源数据和目标数据的特征。在PointDA-10和PointSegDA数据集上的实验表明,该方法在点云UDA的分类和分割任务上都取得了最新的性能。

1. Introduction

由于深度相机和雷达技术的发展,我们可以获得越来越多的3D点云数据。然而这些点都是无标记的点,手动标记通常要耗费大量时间和金钱,因此无监督学习利用有标记的源域,可以在无标记的目标域上同样保持模型的性能,使得模型具备良好的泛化能力,减轻对于数据标注的依赖。

因为源域和目标域之间不可避免地存在分布差异,仅在源域中训练的模型通常在目标域中无法很好地工作。2D领域的域自适应方法一般通过全局匹配源域和目标域的特征分布来实现。然而,在3D点云处理领域,从不同域获得的特征分布差异很大,针对2D图像设计的DA方法(如MCD和DANN)无法直接迁移到点云。近年来,通过学习域不变特征来研究点云UDA已经出现了许多研究。如PointDAN所述,点云的局部特征比全局特征更具可转移性,因此作者建议使用自适应节点来对齐源域和目标域之间的局部特征。然而,在点云域适配基准PointDA-10上的实验结果并不令人满意。相比之下,利用自监督任务来帮助捕获高度可转移的特征表示,在PointDA-10上实现了更高的分类精度,从而证明了在点云UDA中集成自监督任务的有效性。

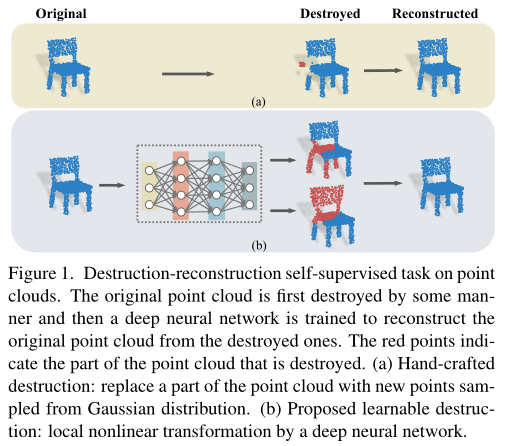

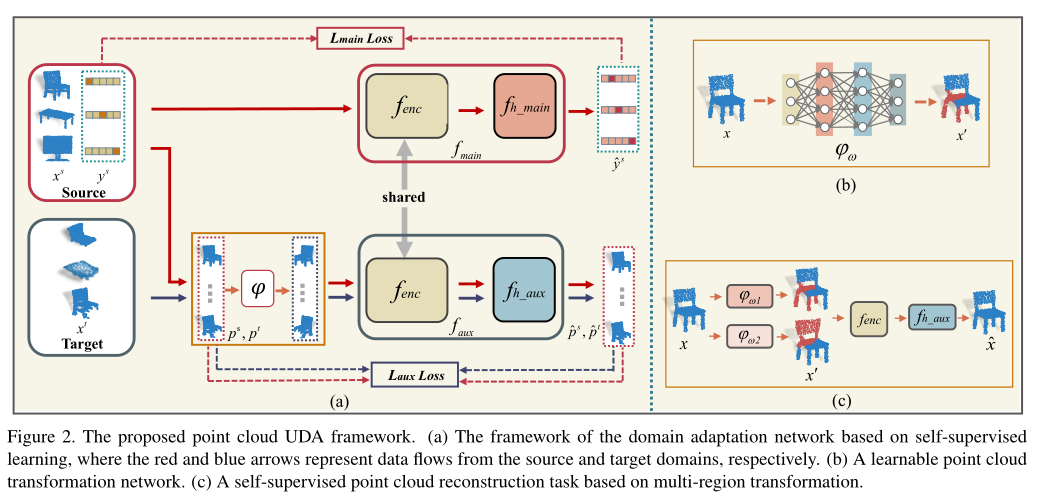

在本文中,我们提出了一种新的可学习自监督任务,并将其集成到基于自监督的点云UDA体系结构中以提高性能。UDA体系结构包含用于主监督任务的主网络和用于辅助自监督任务的辅助网络。这两个网络共享一个编码器,但有不同的头分别执行这两项任务。源域中的标记数据用于训练主网络,源域和目标域中的数据一起用于训练辅助网络,其中自动生成用于训练的伪标签。因此,训练编码器从源域和目标域的数据中提取特征,以便有效地将其传输到目标域。在这种体系结构中,编码器传输到目标域的效果在很大程度上取决于自监督任务。因此,我们在点云上提出了一个可学习的非线性变换,并使用它设计了一个破坏-重建自监督任务,如图1所示。破坏-重建是设计自我监督任务的常用策略,但所有现有研究都探索了手工制作的方法来破坏点云,如图1(a)所示。相反,如图1(b)所示,我们提出了一种基于深度神经网络的可学习变换,它通过对点云的一部分应用非线性变换来破坏点云。通过对抗训练,网络能够学习连续的非线性变换,生成高度丰富和复杂的点云,同时保留语义信息。通过从这些局部变换的点云重建原始点云,编码器可以学习提取源域和目标域数据的局部特征。

主要贡献总结如下:

- 我们提出了一种新的点云可学习变换,并构造了一个可学习的点云破坏-重建自监督任务。与现有的手工制作的自监督任务相比,我们的方法可以学习更多可转移的跨域特征,以减少分布差异。据我们所知,这项工作是点云处理和更广泛的CV领域的第一个可学习的自我监督任务。

- 我们将提出的可学习自监督任务应用于点云UDA中,并提出了一种多区域破坏策略。破坏不同区域的点云,然后重建原始点云,鼓励UDA体系结构中的编码器关注局部特征,这有利于域自适应。

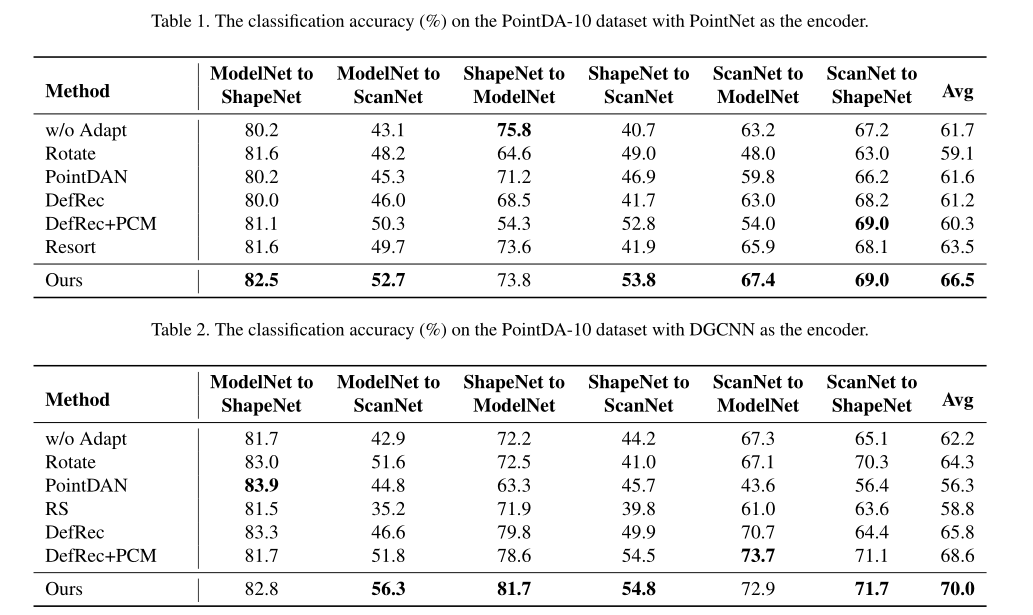

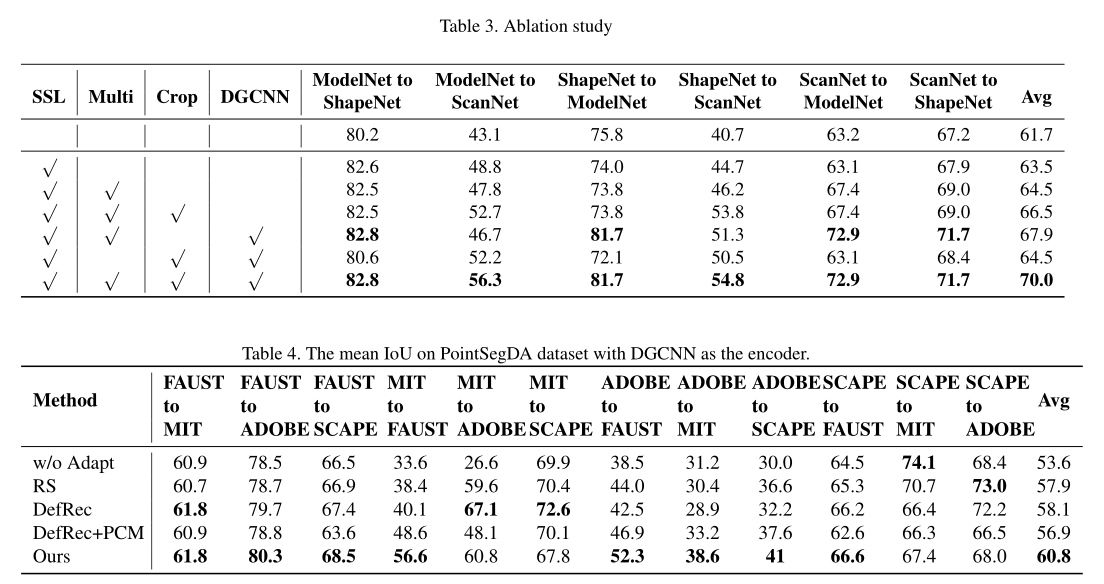

- 该方法分别在PointDA-10和PointSegDA数据集上用于点云分类和分割UDA进行了评估,并在这两项任务上实现了最新的性能。

2.相关工作

2.1.点云的域自适应

域适应是迁移学习的一个分支,在UDA中,源域和目标域任务相同,但两个域的数据分布不同。同时,我们只有源域数据的标签。UDA的目标是训练可直接用于目标域数据的模型。

大多数用于2D图像的通用DA方法仅执行全局特征对齐,而没有利用局部几何信息,这阻碍了它们在3D点云上的应用。两种利用点云数据局部信息的方法。一种是同时对齐局部和全局特征,另一种是利用自监督学习的强大特征提取能力来捕获更有效的局部信息。PointDAN属于第一种类型,它在多个尺度上联合对齐源域和目标域的全局和局部特征,但在PointDA-10上的性能不是很好。在第二种类型中,应用自监督任务来捕获丰富的局部和全局特征。自监督学习在促进DA方面的有效性已在2D图像中得到证明,并已用于点云UDA。通过为点云UDA引入了一个破坏-重建自监督辅助任务,通过用从各向同性高斯分布中采样的新点替换几个随机选择的区域来进行破坏。研究表明,在点云UDA中整合自监督任务是有效的。在这项工作中,我们遵循这条工作路线,并提出了一个新的自监督任务,以更好地适应领域。

2.2.点云的自监督学习

自监督学习利用从数据本身生成的伪标签来训练学习模型。最近,关于点云自监督学习的研究已经有了一系列的工作,大多集中在提出新的自监督辅助任务来提高主要任务的性能。有几种策略通常用于设计自监督任务。第一种策略是训练神经网络来学习一些特征,这些特征也可以直接从点云中计算出来。第二种策略是先破坏点云,然后训练神经网络进行重建。提出了与网络体系结构无关的自监督任务,在该任务中,网络被训练来重建其部分被随机重新排列的点云。例如,通过模拟实际应用中的噪声数据和遮挡来构建自监督重建任务,该任务通过用从高斯分布采样的新点云替换原始点云的随机选择区域,然后重建原始点云来完成。第三种策略是在对比学习的基础上设计自监督任务。例如,将每个点云分割成两个部分,并通过预测这两个部分是否属于同一对象来构建对比学习。利用不同的模态(包括图像、点云、网格和来自不同视角的图像)对同一3D对象进行训练,以区分由相同对象构造的正对和由不同对象构造的负对,从而使模型学习模态和视图不变特征。在所有这些研究中,自监督任务都是手工制作的,而在本文中,我们提出了第一个可学习的自监督任务,并在点云UDA中表现出了优越的性能。

3.方法

在这一部分中,我们首先介绍了点云UDA的问题描述和基于自监督任务的UDA框架。然后,详细说明了本文提出的点云破坏-重建自监督任务,该任务通过一个可学习的非线性变换来破坏点云。最后,我们提出了一种多区域破坏策略来提取更多可转移的区域不变特征。请注意,问题的表述和方法是以点云分类为主要任务的,并且该思想可以很容易地扩展到点云分割。

3.1.问题表述

在用于点云分类的UDA中,我们有一个源域

S

=

{

(

x

i

s

,

y

i

s

)

}

i

=

1

n

s

S=\{(x^s_i,y^s_i)\}^{n_s}_{i=1}

S={(xis?,yis?)}i=1ns??,其中

n

s

n_s

ns?是带标签的点云,一个目标域

T

=

{

x

j

t

}

j

=

1

n

t

T=\{x^t_j\}^{n_t}_{j=1}

T={xjt?}j=1nt??,

n

t

n_t

nt?是不带标签的点云。源域中每个点都有标签。目标域的类与源域的类相同,但目标域

x

j

t

x^t_j

xjt?是没有标记的。目的是训练一个泛化能力强的分类网络,对目标域点云进行分类。

3.2.基于自监督辅助任务的UDA框架

利用UDA的自监督任务的体系结构可以总结为图2(a)所示的框架,该框架也在本研究中使用。该框架由一个点云分类的主任务网络 f m a i n f_{main} fmain?和一个用于自监督辅助任务的辅助网络 f a u x f_{aux} faux?构成,其中 f m a i n f_{main} fmain?和 f a u x f_{aux} faux?都有各自的头部 f h _ m a i n f_{h\_main} fh_main?和 f h _ a u x f_{h\_aux} fh_aux?,但共享相同的编码器 f e n c f_{enc} fenc?。网络 f m a i n f_{main} fmain?由主任务损失 L m a i n L_{main} Lmain?训练, L m a i n L_{main} Lmain?定义为预测标签 y ^ s \hat{y}^s y^?s与源域上对应真实标签 y s y_s ys?的交叉熵。对于辅助网络,源域数据 x s x^s xs和目标域数据 x t x^t xt都被用于自监督学习。

- 首先,原始点云 x s x^s xs和 x t x^t xt 由函数 φ \varphi φ处理,它们用于辅助自监督任务的伪标签 p s , p t p^s,p^t ps,pt由原始数据和 φ \varphi φ生成。

- 然后,以有监督的方式训练辅助网络,输入为 φ ( x s ) , φ ( x t ) \varphi(x^s),\varphi(x^t) φ(xs),φ(xt)和对应的标签 p s , p t p^s,p^t ps,pt。

训练辅助网络的损失表示为

L

a

u

x

L_{aux}

Laux?。因此,最终的优化目标是:

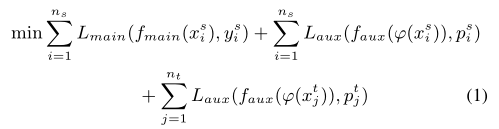

其中,第一项是源域数据上的主任务loss,第二项和第三项分别是源域数据和目标域数据上的自监督辅助任务的loss。

在上述体系结构中,执行辅助任务的目的是令编码器学习目标域的可转移特征,这是通过训练编码器从源域和目标域数据中提取特征来实现的。此外,与全局要素相比,局部要素往往更容易在不同的点云数据集中传输。例如,飞机的整体形状在不同的数据集中差异很大,但机翼之间的差异相对较小,因此设计的自我监督任务应该鼓励编码器专注于局部特征。对部分点云进行变换,迫使编码器从剩余的点云分量中提取局部特征来执行点云重建任务。类似地,构造的3D难题也使编码器能够注意局部特征。遵循这一思想,我们提出了一种可学习的自监督任务,使编码器更关注局部区域而不是整个点云。

3.3.使用可学习变换的自监督任务

许多点云上的自监督任务依赖于手工制作的点云变换,不同的变换将导致编码器学习不同的特征。然而,手工制作的转换是有限且不灵活的,这可能会限制训练编码器的有效性。在这一部分中,我们提出了一种基于深度神经网络的可学习变换

φ

\varphi

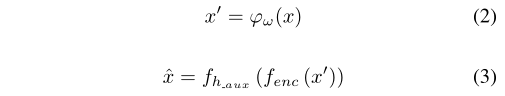

φ,如图2(b)所示。

我们构造了一个由

w

w

w参数化的转换网络

φ

w

\varphi_w

φw?来转换原始点云x到

x

′

x'

x′。通过辅助网络

f

a

u

x

f_{aux}

faux?从

x

′

x'

x′重建原始点云,重建的点云表示为

x

^

\hat{x}

x^:

转换网络

φ

w

\varphi_w

φw?的目标是最大化原始点云和变换点云之间的倒角距离(越大表示两组点云区别较大),辅助重建网络包括共享编码器

f

e

n

c

f_{enc}

fenc?和辅助头

f

h

_

a

u

x

f_{h\_aux}

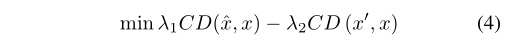

fh_aux?,其目标是最小化重建点云和原始点云之间的倒角距离。因此,公式(3)中辅助自监督任务的优化目标变为:

其中

λ

1

,

λ

2

\lambda_1,\lambda_2

λ1?,λ2?是超参数,CD表示两个点云之间的倒角距离。通过转换网络

φ

w

\varphi_w

φw?和重建网络

f

e

n

c

?

f

h

_

a

u

x

f_{enc} \cdot f_{h\_aux}

fenc??fh_aux?。这种端到端的方式可以使

φ

w

\varphi_w

φw?学习到一个非线性的、连续的变换。同时,编码器还将学习更稳健的特征,从变换后的点云重建原始点云,从而提高学习特征的可移植性和编码器的领域适应性。

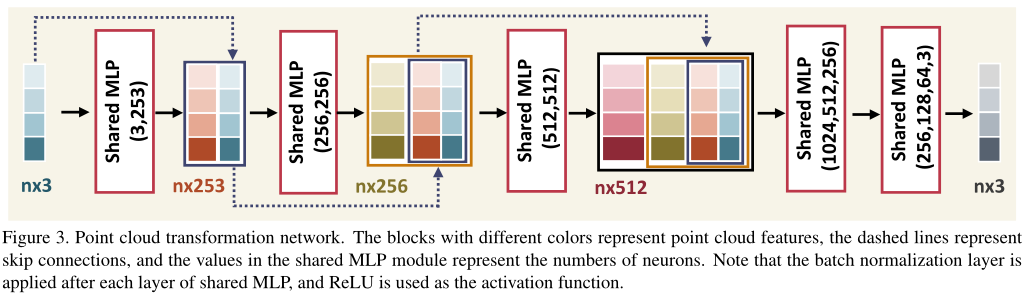

转换网络由具有共享参数的多个MLP层组成,如图3所示。跨所有点共享参数可确保输入点云中的相邻点在转换后获得相似的输出,从而学习转换是连续的,并保持点云的全局语义信息。公式(4)不会直接输出点云的坐标,我们通过点云转换网络输出每个点的位移,并通过一个移位比例超参数α来控制位移的比例,如下所示:

3.4.多区域转换

实验表明,对整个点云进行变换会使重建原始点云变得非常困难,这可能是由于变换过程中丢失了大部分的局部和上下文信息。为了避免这个问题,我们在提出的可学习变换网络的基础上,引入了一种多区域局部点云变换策略。

如图2?所示,我们对点云采用局部变换,因此编码器可以从变换区域和未变换区域学习特征。对于一个点云,使用多个共享参数的变换网络

φ

w

\varphi_w

φw?对不同随机位置的部分点云进行变换,得到同一对象的多个不同变换后的点云,然后利用相同的重建网络

f

e

n

c

?

f

h

_

a

u

x

f_{enc} \cdot f_{h\_aux}

fenc??fh_aux?从变换后的点云重建原始点云。该策略便于编码器为重建任务从对象的不同部分提取特征。

4.实验

5.总结

为了解决点云的UDA问题,我们提出了一种新的可学习的自监督任务,帮助自适应神经网络提取可转移的特征。具体地说,我们提出了一种可学习的点云变换,并将其应用于点云破坏-重建的自监督辅助任务中,并将其应用于具有多任务学习结构的UDA框架中。我们训练共用一个编码器的主任务网络和辅助任务网络,使编码器提取出可高度转移到目标域的特征。我们进一步提出了一种多区域转换策略,使网络聚焦于更具可传递性的局部特征。在点云分类UDA基准PointDA-10和点云分割UDA基准PointSegDA上实现了最新的性能。我们认为所提出的可学习的自我监督任务可以应用于其他的自我监督学习和半监督学习研究中。