PyTorch ʵ������ѧϰFedAvg (���)

��ʼ���ڶ���������,�ְ�֮ǰ����FedAvg�Ĵ��뿴��һ�顣����ѧϰ���Ѱ���

1. ����

����һ��FedAvg

FedAvg��һ�ֲַ�ʽ���,��������û�ͬʱѵ��һ������ѧϰģ�͡���ѵ�������в�����Ҫ�ϴ��κ�˽�е����ݵ��������������û�����ѵ���������ݵõ�����ģ��,���ķ����������Ȩ�ۺϱ���ģ��,�õ�ȫ��ģ��,�������ֵ��������յõ�һ�������ڼ���ʽ����ѧϰ�����ģ��,��Ч�ؽ����˴�ͳ����ѧϰԴ���ݾۺϴ�����������˽���ա�

(1) �����û��û��ӷ�����������ģ�Ͳ���,���±���ģ�Ͳ���,���б��ػ���ѧϰѵ����

(2) ������û���ͨ����������ݶ��½����ϸ���ģ�͵ľ���,���ﵽԤ���ı���ѵ������ʱ,������ѵ�����ģ�Ͳ����ϴ���������С�

(3) ����������ȡ�û��豸,�����ձ����û��ϴ���ģ�Ͳ����ݶȽ��оۺϡ���ʾ�����ģ�Ͳ����ݶȾۺ�,����˽��������û�ģ�Ͳ����ݶȼ�Ȩƽ��������һ�־ۺϺ�ģ�Ͳ������,����ȫ��ģ�Ͳ�������ۺϺ��ģ�Ͳ����ش��������û��豸,Ȼ�����ִ�в���1�������ظ�ִ����������ֱ��ͨѶ�����ﵽt��

2. ��������

parser = argparse.ArgumentParser(formatter_class=argparse.ArgumentDefaultsHelpFormatter, description="FedAvg")

parser.add_argument('-g', '--gpu', type=str, default='0', help='gpu id to use(e.g. 0,1,2,3)')

# �ͻ��˵�����

parser.add_argument('-nc', '--num_of_clients', type=int, default=100, help='numer of the clients')

# �����ѡ�Ŀͻ��˵�����

parser.add_argument('-cf', '--cfraction', type=float, default=0.1, help='C fraction, 0 means 1 client, 1 means total clients')

# ѵ������(�ͻ��˸��´���)

parser.add_argument('-E', '--epoch', type=int, default=5, help='local train epoch')

# batchsize��С

parser.add_argument('-B', '--batchsize', type=int, default=10, help='local train batch size')

# ģ������

parser.add_argument('-mn', '--model_name', type=str, default='mnist_cnn', help='the model to train')

# ѧϰ��

parser.add_argument('-lr', "--learning_rate", type=float, default=0.01, help="learning rate, \

use value from origin paper as default")

parser.add_argument('-dataset',"--dataset",type=str,default="mnist",help="��Ҫѵ�������ݼ�")

# ģ����֤Ƶ��(ͨ��Ƶ��)

parser.add_argument('-vf', "--val_freq", type=int, default=5, help="model validation frequency(of communications)")

parser.add_argument('-sf', '--save_freq', type=int, default=20, help='global model save frequency(of communication)')

#n um_comm ��ʾͨ�Ŵ���,�˴�����Ϊ1k

parser.add_argument('-ncomm', '--num_comm', type=int, default=1000, help='number of communications')

parser.add_argument('-sp', '--save_path', type=str, default='./checkpoints', help='the saving path of checkpoints')

parser.add_argument('-iid', '--IID', type=int, default=0, help='the way to allocate data to clients')

��˵��һ��,��Ҫ���õIJ���

| ���� | ˵�� | ��ע |

|---|---|---|

| �Cgpu | ����gpu | |

| �Cnum_of_clients | ���ÿͻ����豸������ | |

| �Ccfraction | �����ѡ�ͻ��˵�����(Ĭ��ֵ��0.1) | ���ͻ��˴ﵽһ������֮��,����ѧϰ�Կͻ��˽��г����ۺϡ� |

| �Cepoch | �ͻ��˱���ѵ���Ĵ��� | Ĭ��ֵ5 |

| �Cbatchsize | �ͻ��˱���ѵ����batchsize��С | |

| �Cmodel_name | ����ѵ����model���� | |

| �Clearning_rate | ����ѵ����ѧϰ�� | |

| �Cdataset | ���õ����ݼ� | |

| �Cval_freq | ģ����֤Ƶ��(ͨ��Ƶ��) | ����ѵ���������֮��ͨѶ��Ƶ��(Ĭ��ֵ5��)������Cepoch ���õ�ֵ,Ӧ��ͬ�� |

| �Csave_freq | global model save frequency(of communication) | ÿ20��,�������˽�����ۺϵ�ģ�� |

| �Cnum_comm | �ͻ���������ͨѶ���ִ� | |

| �Csave_path | ���վۺ�ģ��,����ĵ�ַ | |

| �CIID | ���������Ƿ��Ƕ���ͬ�ֲ� |

3. �����ع�

Ŀ���ǽ����ݰ���, �Ƕ���ͬ�ֲ�(non-iid)������(iid)�ķ�ʽ�ع����ݽṹ, �������ع��ĺ�� ���ݱ�ǩ �� ���ݡ�

self.train_data

self.train_label

3.1 ��������

Mnist ��д�������ݼ�����60000��28*28 ����Ƭ���,һ����Ϊ10��(��0-9),ÿһ����6000����Ƭ,ѵ������60000����Ƭ,���Լ���10000����Ƭ.

train_images ��ʾѵ������ͼƬ��С��(60000, 28, 28, 1), train_labels ��ʾѵ������ǩ,��train_images һһ��Ӧ ,ͼ���С��(60000,10)

test_images ��ʾ���Լ�,���Լ���СΪ(10000,28,28,1).test_labels ��ʾ���Լ���ǩ,��С (10000, 10)

# �������ݼ�

data_dir = r'.\data\MNIST'

# data_dir = r'./data/MNIST'

# python·��ƴ��os.path.join() ·����Ϊ.\data\MNIST\train-images-idx3-ubyte.gz

train_images_path = os.path.join(data_dir, 'train-images-idx3-ubyte.gz')

train_labels_path = os.path.join(data_dir, 'train-labels-idx1-ubyte.gz')

test_images_path = os.path.join(data_dir, 't10k-images-idx3-ubyte.gz')

test_labels_path = os.path.join(data_dir, 't10k-labels-idx1-ubyte.gz')

train_images = extract_images(train_images_path)

print(train_images.shape) # (60000, 28, 28, 1) һ��60000 ��ͼƬ,ÿһ����28*28*1

train_labels = extract_labels(train_labels_path)

print(train_labels.shape) # (60000, 10)

test_images = extract_images(test_images_path)

print(test_images.shape) # (10000, 28, 28, 1)

test_labels = extract_labels(test_labels_path)

print(test_labels.shape) # (10000, 10) 10000ά

�����ݼ�ѹ����60000 * 784

�������ݼ�,���й�һ������.�������е�ÿ��λ�ö���1.0 / 255.0 ���

# ��ͼƬÿһ��ͼƬ���28*28 = 784

# reshape(60000,28*28)

train_images = train_images.reshape(train_images.shape[0], train_images.shape[1] * train_images.shape[2])

test_images = test_images.reshape(test_images.shape[0], test_images.shape[1] * test_images.shape[2])

#--------------------��һ������--------------------#

train_images = train_images.astype(np.float32)

train_images = np.multiply(train_images, 1.0 / 255.0)# �����ӦԪ��λ�����

test_images = test_images.astype(np.float32)

test_images = np.multiply(test_images, 1.0 / 255.0)

3.2 �ָ����ݼ�

˼·

һ����60000������, �ֵ�100���ͻ���

IID:

�������Ƚ����ݼ�����,Ȼ��Ϊÿ��Client����600��������

Non-IID:

�������ȸ������ݱ�ǩ�����ݼ�����(��MNIST�е����ִ�С),

Ȼ���仮��Ϊ200���СΪ300��������Ƭ,Ȼ��ָ�ÿ��Client������Ƭ��

3.2.1 IID

#һ������ Ĭ�����0,����Ϊ1 ���:[0 1 2]

# a = np.arange(3)

# һ��60000��

# numpy �е�����������ݷ���np.random.shuffle

'''

num = np.arange(20)

print(num)

# [ 0 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19]

np.random.shuffle(num)

print(num)

# [ 1 5 19 9 14 2 12 3 6 18 4 8 16 0 10 17 13 7 15 11]

'''

order = np.arange(self.train_data_size)

np.random.shuffle(order)

self.train_data = train_images[order]

self.train_label = train_labels[order]

3.2.2 Non-IID

'''

numpy.argmax(array, axis) ���ڷ���һ��numpy���������ֵ������ֵ����һ����ͬʱ���ּ������ֵʱ,���ص�һ�����ֵ������ֵ��

two_dim_array = np.array([[1, 3, 5], [0, 4, 3]])

max_index_axis0 = np.argmax(two_dim_array, axis = 0) # �� ���� ���ֵ���±�

max_index_axis1 = np.argmax(two_dim_array, axis = 1) # �� ���� ���ֵ���±�

print(max_index_axis0)

print(max_index_axis1)

# [0 1 0]

# [2 1]

'''

labels = np.argmax(train_labels, axis=1)

# �����ݱ�ǩ��������

order = np.argsort(labels)

print("��ǩ�±�����")

print(train_labels[order[0:10]])

self.train_data = train_images[order]

self.train_label = train_labels[order]

4. ��ʼ���ͻ���

��ʼ��100��Clients����������mnist,�Լ����ݷֲ���ʽ(IID)��

�ع����� (�뿴����һ����)

myClients = ClientsGroup('mnist', args['IID'], args['num_of_clients'], dev)

��������

# �õ��Ѿ������·��������

mnistDataSet = GetDataSet(self.data_set_name, self.is_iid)

test_data = torch.tensor(mnistDataSet.test_data)

test_label = torch.argmax(torch.tensor(mnistDataSet.test_label), dim=1)

# ���ز�������

self.test_data_loader = DataLoader(TensorDataset( test_data, test_label), batch_size=100, shuffle=False)

train_data = mnistDataSet.train_data

train_label = mnistDataSet.train_label

4.1���ݷ��䵽�ͻ���

Ȼ���仮��Ϊ200���СΪ300��������Ƭ,Ȼ��ָ�ÿ��Client������Ƭ

һ��200��,û���СΪ300

# 60000 /100 = 600/2 = 300

shard_size = mnistDataSet.train_data_size // self.num_of_clients // 2

# print("shard_size:"+str(shard_size))

# np.random.permutation ��������������

# np.random.permutation(60000//300=200)

shards_id = np.random.permutation(mnistDataSet.train_data_size // shard_size)

# һ��200��

# print(shards_id)

�����ͻ���,shard_id1 �� shards_id2 ����Ӧ�����ݿ�ַ����ͻ�����(������600)��

for i in range(self.num_of_clients):

## shards_id1

## shards_id2

## �����б��ֵõ�����������Ƭ

# 0 2 4 6...... ż��

shards_id1 = shards_id[i * 2]

# 0+1 = 1 2+1 = 3 .... ����

shards_id2 = shards_id[i * 2 + 1]

#

# ����shard_id1 = 10

# 10* 300 : 10*300+300

# �������Լ��ı�ǩ������ÿͻ���

data_shards1 = train_data[shards_id1 * shard_size: shards_id1 * shard_size + shard_size]

data_shards2 = train_data[shards_id2 * shard_size: shards_id2 * shard_size + shard_size]

label_shards1 = train_label[shards_id1 * shard_size: shards_id1 * shard_size + shard_size]

label_shards2 = train_label[shards_id2 * shard_size: shards_id2 * shard_size + shard_size]

#

# np.vstack �ǰ��մ�ֱ����ѵ�

# np.hstack: ��ˮƽ����(��˳��)�ѵ����鹹��һ���µ�����

'''

In[4]:

a = np.array([[1,2,3]])

a.shape

# (1, 3)

In [5]:

b = np.array([[4,5,6]])

b.shape

# (1, 3)

In [6]:

c = np.vstack((a,b)) # ������(1,3)��״�����鰴��ֱ�������

print(c)

c.shape # �����״Ϊ(2,3)

[[1 2 3]

[4 5 6]]

# (2, 3)

'''

# ���������ֵ������ݿ���жѵ�

local_data, local_label = np.vstack((data_shards1, data_shards2)), np.vstack((label_shards1, label_shards2))

local_label = np.argmax(local_label, axis=1)

# ����һ���ͻ���

someone = client(TensorDataset(torch.tensor(local_data), torch.tensor(local_label)), self.dev)

# Ϊÿһ��clients ����һ������

# client10

self.clients_set['client{}'.format(i)] = someone

5. Server

ǰ4�����������ѧϰ���������Ѿ����,��server����,��������ѧϰ����ѵ����

�������ѡȡ�ͻ���

# ÿ�����ѡȡ10��Clients

num_in_comm = int(max(args['num_of_clients'] * args['cfraction'], 1))

�õ���ǰ��ȫ��ģ��

# �õ�ȫ�ֵIJ���

global_parameters = {}

# net.state_dict() # ��ȡģ�Ͳ����Թ���

# �õ�ÿһ����ȫ���Ӳ��е�����fc1.weight

# �Լ�Ȩ��weights(tenor)

# �õ�����ÿһ����

for key, var in net.state_dict().items():

# print("key:"+str(key)+",var:"+str(var))

print("��������:"+str(var.shape))

print("������Size"+str(var.size()))

global_parameters[key] = var.clone()

5.1ѵ��

�ͻ��������˽���ͨѶ���ִ�Ϊ1000��

���ȵõ�����ѡ��10���ͻ��˵�order

# �õ�����ѡ��10���ͻ���

order = np.random.permutation(args['num_of_clients'])

print("order:")

print(len(order))

print(order)

# �õ�10���ͻ���

clients_in_comm = ['client{}'.format(i) for i in order[0:num_in_comm]]

print("�ͻ���"+str(clients_in_comm))

print(type(clients_in_comm)) # <class 'list'>

5.2 ���ؿͻ��˸���ģ��

��������ѡ�Ŀͻ��ˡ�

������ǰ��ȫ��ģ�� ���뵽�ͻ�����,�����ͻ��˵ı���ģ�͡�

�÷���Ϊ localUpdate()

5.2.1��������:

param: localEpoch ��ǰClient�ĵ�������

param: localBatchSize ��ǰClient��batchsize��С

param: Net Server������ģ��

param: LossFun ��ʧ����

param: opti �Ż�����

param: global_parmeters ��ǰͨѶ����ȫ�ֲ���

return: ���ص�ǰClient�����Լ�������ѵ���õ����µ�ģ�Ͳ���

5.2.2 ����

-

���±���ģ��

Net.load_state_dict(global_parameters, strict=True) -

���ر�������

self.train_dl = DataLoader(self.train_ds, batch_size=localBatchSize, shuffle=True) -

���б���ѵ��

for epoch in range(localEpoch): for data, label in self.train_dl: # ���ص�GPU�� data, label = data.to(self.dev), label.to(self.dev) # ģ���ϴ������� preds = Net(data) # ������ʧ���� ''' ����Ӧ�ü�¼һ��ģ�͵���ʧֵ д�뵽һ��txt�ļ��� ''' loss = lossFun(preds, label) # ���� loss.backward() # �����ݶ�,�������ݶ� opti.step() # ���ݶȹ���,��ʼ���ݶ� opti.zero_grad() -

��ر���ģ��

-

�������

def localUpdate(self, localEpoch, localBatchSize, Net, lossFun, opti, global_parameters): ''' param: localEpoch ��ǰClient�ĵ������� param: localBatchSize ��ǰClient��batchsize��С param: Net Server������ģ�� param: LossFun ��ʧ���� param: opti �Ż����� param: global_parmeters ��ǰͨѶ����ȫ�ֲ��� return: ���ص�ǰClient�����Լ�������ѵ���õ����µ�ģ�Ͳ��� ''' # ���ص�ǰͨ��������ȫ�ֲ��� # ��������ģ��,������global_parameters������ Net.load_state_dict(global_parameters, strict=True) # ����Client�������ݼ� # ���ر������� self.train_dl = DataLoader(self.train_ds, batch_size=localBatchSize, shuffle=True) # ���õ������� for epoch in range(localEpoch): for data, label in self.train_dl: # ���ص�GPU�� data, label = data.to(self.dev), label.to(self.dev) # ģ���ϴ������� preds = Net(data) # ������ʧ���� ''' ����Ӧ�ü�¼һ��ģ�͵���ʧֵ д�뵽һ��txt�ļ��� ''' loss = lossFun(preds, label) # ���� loss.backward() # �����ݶ�,�������ݶ� opti.step() # ���ݶȹ���,��ʼ���ݶ� opti.zero_grad() # ���ص�ǰClient�����Լ�������ѵ���õ����µ�ģ�Ͳ��� return Net.state_dict()

5.3 ����˾ۺ�

���ͻ����ϴ���ģ�Ͳ�������,�������

# �����е�Client���صIJ����ۼ�(���ȡƽ��ֵ)

if sum_parameters is None:

sum_parameters = {}

for key, var in local_parameters.items():

sum_parameters[key] = var.clone()

else:

for var in sum_parameters:

sum_parameters[var] = sum_parameters[var] + local_parameters[var]

FedAvg�ۺ�

���ģ�Ͳ�����ƽ��ֵ,�����·���˵�ģ�͡�

# ȡƽ��ֵ,�õ�����ͨ����Server�õ��ĸ��º��ģ�Ͳ���

for var in global_parameters:

global_parameters[var] = (sum_parameters[var] / num_in_comm)

net.load_state_dict(global_parameters, strict=True)

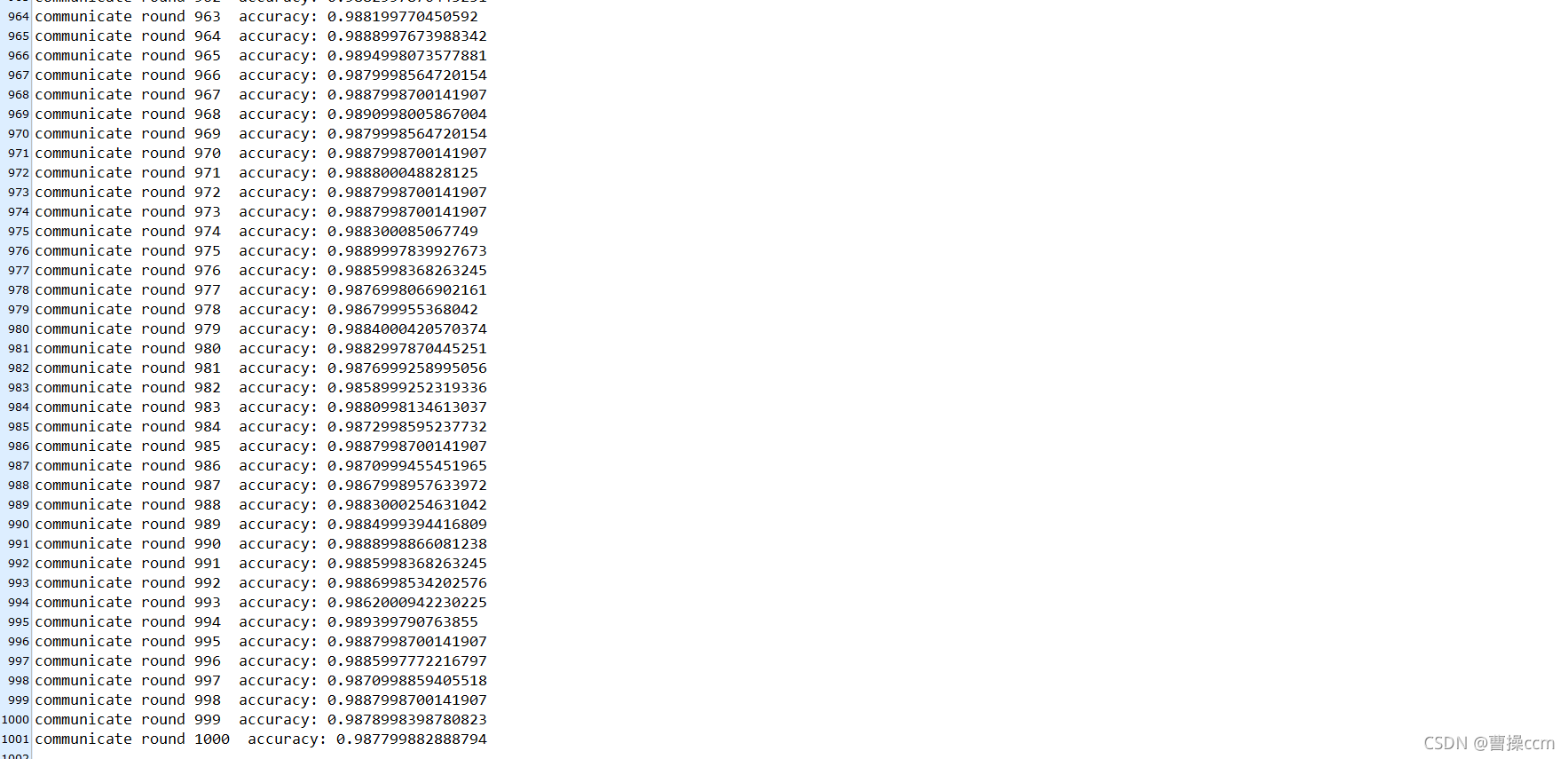

6. ���Խ��

����ͨѶ1000��֮��Ľ��

7. ����

����

-

getData.py �������ݼ�

-

server.py ѵ��

python server.py -nc 100 -cf 0.1 -E 5 -B 10 -mn mnist_cnn -ncomm 1000 -iid 0 -lr 0.01 -vf 20 -g 0

�������ص�ַ

https://download.csdn.net/download/qq_36018871/43064799

����

����:https://pan.baidu.com/s/13gOszw2TED2X6uezUxyS7w

��ȡ��:zaxf