���ĵ�ַ:https://arxiv.org/abs/2006.10141

�����ַ: https://github.com/ChandlerBang/SelfTask-GNN

0 ժҪ

GNN����ͨ��������ۺ���Ȼ������δ��ǵĽڵ�,������ۺ�����������δ��ǵĽڵ㡣

����:

- ��������ͨ��ʵ֤�о�ͼ�ϵ��������SSL��������,���������Ƕ�SSL��ʱ��Ϊ���Լ���Щ���Զ�GNN��Ч�����⡣

- �ܵ�ʵ֤�о�����̼��������,���������һ���·��� SelfTask �������ܹ��ڸ�����ʵ�������ݼ���ʵ�����Ƚ����ܵĸ��������

2 ��������

��ල�ڵ���ཫ�ڵ��Ϊ�б�ǩ�ڵ� D L = ( V L , Y L ) \mathcal{D}_L = (\mathcal{V}_L,\mathcal{Y}_L) DL?=(VL?,YL?)���ޱ�ǩ�ڵ� D U \mathcal{D}_U DU?���� f �� : V L �� Y L f_\theta:\mathcal{V}_L \rightarrow \mathcal{Y}_L f��?:VL?��YL?,���ڵ�ӳ�䵽��ǩ��,ʹ��GNN�����ƶϳ�δ������ݵ���������ල�ڵ�����Ŀ�꺯����:

min ? �� L t a s k ( �� , A , X , D L ) = �� ( v i , y i ) �� D L l ( f �� ( G ) v i , y i ) \min_\theta \mathcal{L}_{task}(\theta,A,X, \mathcal{D}_L) = \sum_{(v_i,y_i)\in \mathcal{D}_L} l(f_\theta(\mathcal{G})_{v_i},y_i) ��min?Ltask?(��,A,X,DL?)=(vi?,yi?)��DL?��?l(f��?(G)vi??,yi?)

���ǽ�ͼ����������Ҽලѧϰ������ʽ����Ϊ�ڵ���������

Ŀ���ǹ���һ���Լල��������,�����������Ӧ����ʧ L s e l f \mathcal{L}_{self} Lself?,�������������ʧ L t a s k \mathcal{L}_{task} Ltask?����ȥѧϰͼ������,���Ը��õظ����ޱ�ǩ������

3 ͼ�ϵĻ�����������

3.1 �ṹ��Ϣ

��ͼ����ȡ�Լල��Ϣ�ĵ�һ����Ȼѡ�������ݱ���Ĺ��нṹ����Ϊͼ����������ص�,�ڵ��DZ�������һ��һ����Ҫ�ķ����Ǹ����ޱ�ǩ�ڵ�ľֲ��ṹ��Ϣ,��������ͼ���������ֵĹ�ϵ,Ϊ�乹���Լල��Ϣ�����仰˵,���ڽ����Լල�ĸ�������Ľṹ��Ϣ���Է���Ϊ���ػ�ȫ�ֽṹ��Ϣ��

3.1.1 �ֲ��ṹ��Ϣ

�ֲ��ṹ�Լල��Ϣ,���ȿ��������ڽڵ㱾��,Ҳ���������ڸýڵ�������Χ�ھ��еĽṹ��ϵ������,������������ڵ����ڵ��϶���,Ҳ���������/�Աȵķ�ʽ����,�������/�Ƚ϶���ڵ����Ϣ��

���ǽ������������ھֲ��ṹ��SSL��������Ĵ���������

-

NodeProperty(�ڵ�����)

������������,����ּ��Ԥ��ͼ��ÿ���ڵ������,�����ǵĶȡ��ֲ��ڵ���Ҫ�Ժ;ֲ�����ϵ����������������Ŀ����Ϊ��(��һ��)����GNN����ѧϰ���Ż��ľ�������֮��,��ѧϰ�ֲ��ṹ��Ϣ�������Լල�������ʧ

L s e l f ( �� �� , A , X , D U ) = 1 �O D U �O �� v i �� D U ( f �� �� ( G ) v i ? d i ) 2 \mathcal{L}_{self}(\theta',A,X,\mathcal{D}_U) = \frac {1} {|\mathcal{D}_U|} \sum_{v_i \in \mathcal{D}_U}(f_{\theta'}(\mathcal{G})_{v_i} - d_i)^2 Lself?(����,A,X,DU?)=�ODU?�O1?vi?��DU?��?(f����?(G)vi???di?)2

- f �� �� f_{\theta'} f����?:Ԥ��ڵ��

-

EdgeMask(���ڱ�)

���ڱ�Ե��������,����Ѱ��չ�������ڵ����ڵ㱾�������Ҽල,���ǻ���ͼ�������ڵ�֮�������,�ɶԵؽ������Ҽල�����������������һЩ��,Ȼ��Ҫ��ģ���ؽ������εıߡ�Ȼ��,����� SSL ����������Ԥ������ڵ��֮���Ƿ�������ӡ���ʧ����Ϊ:

L s e l f ( �� �� , A , X , D U ) = 1 �O M e �O �� ( v i , v j ) �� M e l ( f w ( �O f �� �� ( G ) v i ? f �� �� ( G ) v j �O ) , 1 ) + 1 �O M �� e �O �� ( v i , v j ) �� M �� e l ( f w ( �O f �� �� ( G ) v i ? f �� �� ( G ) v j �O ) , 1 ) \mathcal{L}_{self}(\theta',A,X,\mathcal{D}_U) = \frac {1} {|\mathcal{M}_e|} \sum_{(v_i,v_j) \in \mathcal{M}_e} l(f_w(|f_{\theta'}(\mathcal{G})_{v_i} - f_{\theta'}(\mathcal{G})_{v_j}|),1) + \frac {1} {|\overline{\mathcal{M}}_e|} \sum_{(v_i,v_j) \in \overline{\mathcal{M}}_e} l(f_w(|f_{\theta'}(\mathcal{G})_{v_i} - f_{\theta'}(\mathcal{G})_{v_j}|),1) Lself?(����,A,X,DU?)=�OMe?�O1?(vi?,vj?)��Me?��?l(fw?(�Of����?(G)vi???f����?(G)vj??�O),1)+�OMe?�O1?(vi?,vj?)��Me?��?l(fw?(�Of����?(G)vi???f����?(G)vj??�O),1)

3.1.2 ȫ�ֽṹ��Ϣ

�����ڵ��ȫ���Լල��Ϣ�������ڽڵ㱾���������������ľֲ�ling��ju,���һ��������ͼ�нڵ��λ�á���ֲ��ӽ�����,���ǻ�������������д����Ե� SSL �������,����һ�����������ڵ�֮���ȫ�ֳɶԱȽ�,��һ�����Ե����ڵ������ͼ��ȫ�ֶ�λ��

-

PairwiseDistance

��������ּ���ܹ�����/Ԥ�ⲻͬ�ڵ��֮��ľ��롣����ĺ�����ʽ��:�Ƿ���ͬһ���С����Ի�PageRank�ȼ���ڵ����ƶȵ���·Ԥ�ⷽ�����ڱ�����,ѡ��ʹ�����·��Ϊ�ڵ�֮�����ĺ����������ȼ������нڵ�Ե����·�����Ƚ����Ȱ�1,2,3,������Ϊ���ࡣ

��ѡ��������ԭ��:

- ��Ҫ����ļ�������������ʵ�ʵĽڵ�Ե����·������

- �ϳ��ijɶԾ�����ܻ�������,ʹ�ñ��������

- �������нڵ���Ҫ�ļ���ɱ��ϸ�

SSL��ʧ������Ϊ���������:

L self? ( �� �� , A , X , D U ) = 1 �O S �O �� ( v i , v j ) �� S ? ( f w ( �O f �� �� ( G ) v i ? f �� �� ( G ) v j �O ) , C p i j ) \mathcal{L}_{\text {self }}\left(\theta^{\prime}, \mathbf{A}, \mathbf{X}, \mathcal{D}_{U}\right)=\quad \frac{1}{|\mathcal{S}|} \sum_{\left(v_{i}, v_{j}\right) \in \mathcal{S}} \ell\left(f_{w}\left(\left|f_{\theta^{\prime}}(\mathcal{G})_{v_{i}}-f_{\theta^{\prime}}(\mathcal{G})_{v_{j}}\right|\right), C_{p_{i j}}\right) Lself??(����,A,X,DU?)=�OS�O1?(vi?,vj?)��S��??(fw?(�O�O?f����?(G)vi???f����?(G)vj??�O�O?),Cpij??)

- C p i j C_{p_{ij}} Cpij??:���� p i j p_{ij} pij?��Ӧ�ķ���

-

Distance2Clusters:

ͨ��Ԥ���ޱ�ǩ�Ľڵ㵽Ԥ���ľ���ľ�����̽��ȫ�ֽṹ��Ϣ��ѧϰÿ���ڵ��ȫ��λ������������Ҫ�ڵ���㵽ͼ��ÿ���ڵ�ľ���,ֻ��Ҫ���㵽�����ľ������ĵľ��뼴�ɡ�����Ӧ��METI�㷨��ͼ����Ϊk�ࡣ��ÿ�������ǽ��߶Ƚڵ���Ϊ��������,��Ϊ c j c_j cj?��ʹ������ d i d_i di?�е� j j j��ֵ��¼�ڵ� v i v_i vi?���� j j j��ľ������ĵľ��롣�������Ŀ����Ż�������Ա�ʾΪһ����Ԫ�ع�����:

L self? ( �� �� , A , X , D U ) = 1 �O D U �O �� v i �� D U �� f �� �� ( G ) v i ? d i �� 2 \mathcal{L}_{\text {self }}\left(\theta^{\prime}, \mathbf{A}, \mathbf{X}, \mathcal{D}_{U}\right)=\frac{1}{\left|\mathcal{D}_{U}\right|} \sum_{v_{i} \in \mathcal{D}_{U}}\left\|f_{\theta^{\prime}}(\mathcal{G})_{v_{i}}-\mathbf{d}_{i}\right\|^{2} Lself??(����,A,X,DU?)=�ODU?�O1?vi?��DU?��?��f����?(G)vi???di?��2

3.2 ������Ϣ

������Ϣ����Ĺؼ����ǰ���ָ��GNN,��ȷ���ڵ�/����������Ϣ��ijЩ���������Ҽල�Ļ������Եĸ�������֮�����ڽڵ�Ƕ���С�

-

**AttributeMask:**��EdgeMask����,���������һЩ����֮���ؽ���Щ����

L self? ( �� �� , A , X , D U ) = 1 �O M a �O �� v i �� M a �� f �� �� ( G ) v i ? x i �� 2 \mathcal{L}_{\text {self }}\left(\theta^{\prime}, \mathbf{A}, \mathbf{X}, \mathcal{D}_{U}\right)=\frac{1}{\left|\mathcal{M}_{a}\right|} \sum_{v_{i} \in \mathcal{M}_{a}}\left\|f_{\theta^{\prime}}(\mathcal{G})_{v_{i}}-\mathbf{x}_{i}\right\|^{2} Lself??(����,A,X,DU?)=�OMa?�O1?vi?��Ma?��?��f����?(G)vi???xi?��2

������ʵ�е����ݼ����Ǹ�άϡ���,������Ӧ��AttributeMask֮ǰ,��ʹ��PCA����ý�ά��������

-

PairwiseAttrSim: �����������ԵĽڵ����������Ե�SSL�����������ڴֳɶ������Խӽ���0,���ǿ�����һ�²������ԡ�

- ������ T s \mathcal{T}_s Ts?�� T d \mathcal{T}_d Td?��ʾ����������ƶȺͲ����ƶȵĽڵ�Լ���,����Ϊ:

T s = { ( v i , v j ) �O s i j ?in?top-K?of? { s i k } k = 1 N \ { s i i } , ? v i �� V U } T d = { ( v i , v j ) �O s i j ?in?bottom-K?of? { s i k } k = 1 N \ { s i i } , ? v i �� V U } \begin{aligned} \mathcal{T}_{s} &=\left\{\left(v_{i}, v_{j}\right) \mid s_{i j} \text { in top-K of }\left\{s_{i k}\right\}_{k=1}^{N} \backslash\left\{s_{i i}\right\}, \forall v_{i} \in \mathcal{V}_{U}\right\} \\ \mathcal{T}_{d} &=\left\{\left(v_{i}, v_{j}\right) \mid s_{i j} \text { in bottom-K of }\left\{s_{i k}\right\}_{k=1}^{N} \backslash\left\{s_{i i}\right\}, \forall v_{i} \in \mathcal{V}_{U}\right\} \end{aligned} Ts?Td??={(vi?,vj?)�Osij??in?top-K?of?{sik?}k=1N?\{sii?},?vi?��VU?}={(vi?,vj?)�Osij??in?bottom-K?of?{sik?}k=1N?\{sii?},?vi?��VU?}?

- s i j s_{ij} sij?:���������ڵ�֮���������,�����������ƶ�

���ǿ��Խ��ع�������ʽ��Ϊ:

L self? ( �� �� , A , X , D U ) = 1 �O T �O �� ( v i , v j ) �� T �� f w ( �O f �� �� ( G ) v i ? f �� �� ( G ) v j �O ) ? s i j �� 2 \mathcal{L}_{\text {self }}\left(\theta^{\prime}, \mathbf{A}, \mathbf{X}, \mathcal{D}_{U}\right)=\frac{1}{|\mathcal{T}|} \sum_{\left(v_{i}, v_{j}\right) \in \mathcal{T}}\left\|f_{w}\left(\left|f_{\theta^{\prime}}(\mathcal{G})_{v_{i}}-f_{\theta^{\prime}}(\mathcal{G})_{v_{j}}\right|\right)-s_{i j}\right\|^{2} Lself??(����,A,X,DU?)=�OT�O1?(vi?,vj?)��T��?����?fw?(�O�O?f����?(G)vi???f����?(G)vj??�O�O?)?sij?����?2

4 Preliminary Analysis

�ڱ�����,������������ֽ���Щ��������ϲ���GNN�еIJ���,������ѵ��������ѵ��,Ȼ��ʵ֤�����˸��������GNN��Ӱ�졣

4.1 ����ѵ��

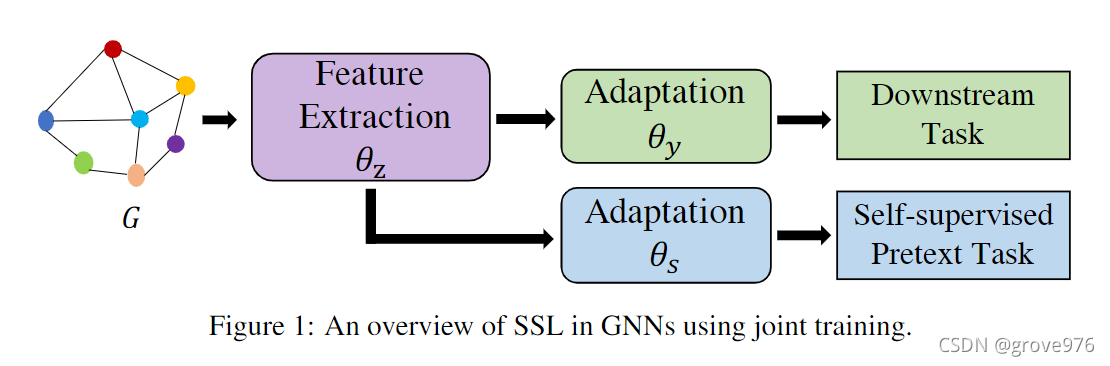

��ͼ������������Ҽලѧϰ��һ����Ȼ˼·������ѵ����Ӧ����ʧ�����ǵ�Ŀ����ͬʱ�Ż��Լල��ʧ L s e l f \mathcal{L}_{self} Lself?�ͼල��ʧ L t a s k \mathcal{L}_{task} Ltask?.

���Է�Ϊ������:

- ������ȡ����:������ͼ�Ͻ���������ȡ,�����Ƕ���ͼ������

- f �� z ( G ) �� Z f_{\theta_{z}}(\mathcal{G}) \rightarrow Z f��z??(G)��Z��ʾ������ȡ������,���� Z Z Z�ǽڵ��Ƕ��, z i = f �� z ( G ) v i z_i = f_{\theta_z}(\mathcal{G})_{v_i} zi?=f��z??(G)vi??

- ����������Լල�����������Ӧ����:������ͼ����������Բ�

- f �� y ( z i ) �� y ^ i f_{\theta_{y}}(z_i) \rightarrow \hat{y}_i f��y??(zi?)��y^?i?��ʾ����������,���ڵ� v i v_i vi?��Ƕ�� z i z_i zi?ӳ�䵽Ԥ������ y ^ i \hat{y}_i y^?i?

�Լල�ĸ���������Ա��ƶ�Ϊ��ͬ��������ȡ�� f �� z f_{\theta_z} f��z??��һ������������� f �� s f_{\theta_s} f��s??���������Ŀ����Զ���Ϊ

min ? �� , �� �� L t a s k ( �� , A , X , D L ) + �� L s e l f ( �� �� , A , X , D U ) \min_{\theta, \theta'} \mathcal{L}_{task}(\theta, A, X, \mathcal{D}_L) + \lambda \mathcal{L}_{self}(\theta', A, X, \mathcal{D}_U) ��,����min?Ltask?(��,A,X,DL?)+��Lself?(����,A,X,DU?)

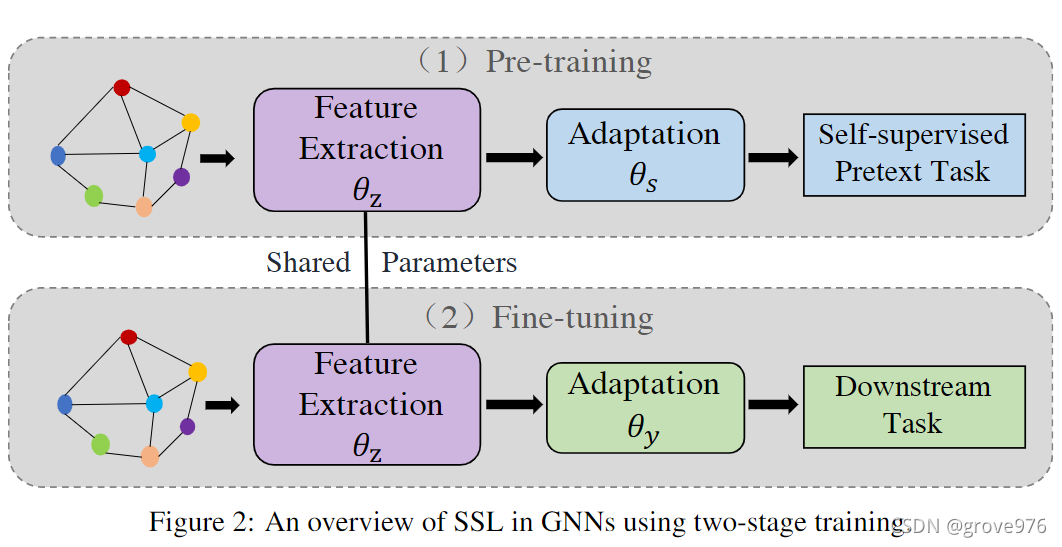

4.2 ����ѵ��

- �Լල����������ѵ��

- ����������

������ѵ������,�Լලģ����һ��������ȡģ�� f �� z ( G ) f_{\theta_z}(\mathcal{G}) f��z??(G)��һ������Ӧģ�� f �� s ( G ) f_{\theta_s}(\mathcal{G}) f��s??(G)���,��Щģ����Ż������������ء����Լලģ����ȫѵ����,�ٿ�ʼѵ����������ģ�͡���������ģ��Ҳ��һ������Ӧģ�� f �� y ( G ) f_{\theta_y}(\mathcal{G}) f��y??(G),����������ȡģ�����Լලģ�� f �� z ( G ) f_{\theta_z}(\mathcal{G}) f��z??(G)������������ͼ��ʾ,����Ϊ��������Ԥѵ���Լලģ��,Ȼ��ʹ���Լලģ�͵�������ȡģ����Ϊ��������ij�ʼ������ʼ�������Ϊ��������̶�������������

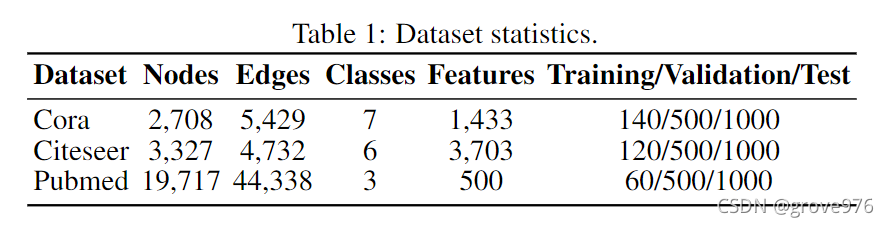

4.3 ʵ֤�о�

���ݻ����ĸ�����������˹㷺��ʵ��,�˽���ЩSSL��Ϣ��GNN��Ч,��Щ���Կ��Ը��õ�ΪGNN����SSL,����һ������SSL�ܹ�����GNN��ԭ��

-

Strategies for Two-stage Training

��������ѵ��,�ٳ�ʼ��������ȡ����,���ǿ��Զ�����й̶�����,�Ա���нڵ���ࡣ�����о���Ԥѵ��ģ�ͺͽڵ����ģ�͵ĸ��ּܹ�,��������ʾ��

- ��2GC+1Linear��:ʹ������GCN����������ȡ,ʹ��һ�����Բ��������Ӧ

- ��2GC��:һ������������ȡ��GCN����һ����������Ӧ��GCN

- �� "Finetune Strategy "һ����,"Fix "�� "Tune all "��Ӧ���������ֲ���,���ǻ�������û�о���SSLԤѵ���Ľڵ��������,��Ϊ�����ֲ���

- ���е�ʵ�鶼����PairwiseDistance�����½��е�,�ڴ���������,��Tune all���IJ���ʵ�����������

-

SSL for GNNs

-

Joint Training vs. Two-stage Training

���ǹ۲쵽,��Ȼ����ѵ���ܹ��Ľ� vanilla GCN ģ��,������ѵ���ڴ�����������������ѵ�������,���ǵ�ʵ֤��������,����ѵ���ǽ� SSL �� GNN ���ɵĸ��ò���,����������ѵ����

-

What SSL Works for GNNs

�ӱ� 3 ��,���ǿ������ȹ۲쵽,��õ�����������һ������ SSL ������������ʵ�֡����ǵ�ʵ֤��������ر���,��ͼ���������������Ҽල��Ϣ��һ������ǰ;�ķ���,���Խ�һ�����ͼ�ṹ���ݵ����ѧϰ�����ܡ�����,���ǹ۲쵽�����Լල�ĸ��������ڸ��ƽڵ������й㷺��Ч�á�

- ���������ݼ���,������õķ����Ǵ�ȫ�ֽṹ��Ϣ�����ĸ�������

- ����ȷ��AttributeMask��������GCN-PCA���,��Ϊ���Ƕ���������PCA��ΪԤ�������������ٽڵ�����/���Ե�ά�ȡ�

- ���Ƿ��� NodeProperty��EdgeMask �� AttributeMask �Ľ������������ԭʼ GCN,��Ϊ���ܲ���ʼ��С�� 0.3%�����֮��,���� PairwiseDistance��Distance2Cluster �� PairwiseAttrSims ���ڵ�ȫ�����Ҽල�ɹ������������

-

Why SSL Works for GNNs

���Ƿ���ʹ����ȫ�ֽṹ��һЩ���Ҽල�ɶԵijɶ�������Ϣ���Ժܺõر������á���������֮ǰ�ᵽ��,���ڽڵ�����GCN����Ȼ�İ�ල��,���Ѿ�̽����δ��ǵĽڵ㡣

���GCN����ѧϰһ���Լල,GCN�Ľڵ��ʾӦ�ñ�����������Ϣ,���,��������Ӧ�Ľ�������ϱ�ԭʼ�ڵ㹦�ܸ��õر�����ܲ�����ͼ3��ʾ��

ѡ�������д����ԵĽ������EdgeMask��NodeProperty ��PairwiseDistance ��˵��,��Ϊ����������¿��Թ۲쵽���Ƶ�ģʽ��EdgeMaskon Pubmed �����ܲ����С��ԭ������� Pubmed ��ԭʼ�����Ծֲ����ӷdz����д�����,��Ϊԭʼ������ EdgeMask �����Ͽ��Դﵽ 80% ���ϵ�ȷ�ʡ��෴,���������ݼ���,PariwiseDisancetask�����ܲ����൱С��

-