logistic�ع�

һ�����Ż��㷨��ع����

���Ż��㷨������:�������������ܶ����Ż�����,�������ôA�ߵ�B��ʱ���,�����ȵ��ϲ��������ò�,�ɼ����Ż��������Ǻܴ�ġ�

�ع�:����������һЩ���ݵ�,������һ��ֱ�߶���Щ��������,�����Ϲ��̾ͳ����ع顣

����logistic�ع��һ�����

- �ռ�����:�������ⷽʽ�ռ����ݡ�

- ������:��������Ϊ��ֵ��,��ý���Ԥ����Ϊ�ṹ�����ݸ�ʽ��

- ��������:�������ⷽ�������ݽ��з�����

- ѵ���㷨:��ʱ�佫����ѵ��,ѵ����Ŀ����Ϊ���ҵ���ѵķ���ع�ϵ����

- �����㷨:һ��ѵ���������,���ཫ��ܿ졣

- ʹ���㷨:����,������Ҫ����һЩ����,������ת���ɶ�Ӧ�Ľṹ����ֵ;����,����ѵ���õĻع�ϵ���Ϳ��Զ���Щ��ֵ���мĻع�����,�ж����������ĸ����;����֮��,���ǾͿ�����������������һЩ��������������

�������Իع���������Իع�

���Իع�ģ�ͺͶ������Իع�ģ����Ϊ��ȷ���������Ż���������ѻع�ϵ����

���Իع�

����ģ�͵�һ����ʽΪ:

f

(

x

)

=

w

1

x

1

+

w

2

x

2

+

.

.

.

+

w

d

x

d

+

b

f ( x )= w_{1}x_{}1+w_{2}x_{2}+...+w_{d}x_{d} + b

f(x)=w1?x?1+w2?x2?+...+wd?xd?+b

����x=(x1, x2, ��, xd)����dά��������������,���� xi�� x �ڵ� i �������ϵ�ȡֵ��

���Իع��Ŀ��:ѧϰһ������ģ���Ծ�����ȷ��Ԥ��ʵֵ������:

f

(

x

)

=

w

x

i

+

b

f(x)=wx_{i}+b

f(x)=wxi?+b

ʹ��

f

(

x

i

)

?

y

i

f(x_{i})\simeq y_{i}

f(xi?)?yi?

�������Իع�

��

y

=

g

(

x

)

=

e

z

y=g(x)=e^{z}

y=g(x)=ez,z=wx+b,���������,�Ϳ��Եõ��������Իع�ģ��:

l

n

y

=

w

x

+

b

lny=wx+b

lny=wx+b

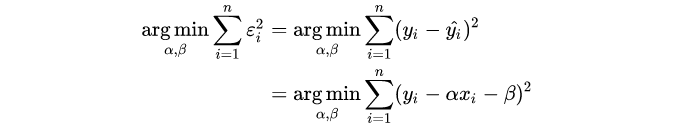

�ġ���С���˷�

��������,ʹ�����Իع�ģ����Ԥ��������ֵ,�����б�Ȼ�����ܰٷְ�������ֵ�غ�,�ʴ�,����������С���˷���Լ��:�ع�ֱ��Ӧ����ȫ���۲�ֵ���Ӧ�Ļع����ֵ�����ƽ������С������С���˷�������,�Ƶ���������:

�塢sigmoid����

������Ҫ�ĺ���Ӧ����,�ܽ������е�����Ȼ��Ԥ����������,��������������ֻ��0��1.��λԾǨ��������������һ��,������Ҳ��һ������:����Ծ���ϴ�0˲����Ծ��1,���˲����ʱ���Ѵ�������sigmoid������������ס�sigmoid�����Ĺ�ʽ����:

��

(

x

)

=

1

1

+

e

?

x

\sigma (x)=\frac{1}{1+e^{-x}}

��(x)=1+e?x1?

��x=0ʱ,sigmoid����ֵΪ0.5,����x��������С,sigmoid�����ֱ�������0��1,�Ѿ��ܽӽ�ԾǨ�����ˡ����,Ϊ��ʵ��logistic������,���ǿ�����ÿ�������϶�����һ���ع�ϵ��,Ȼ������еĽ�����,��������뵽sigmoid������,����0.5��ֵ����Ϊ1,С�������Ϊ0.�����ͽ����Իع�ģ�ͺ�sigmoid�����������һ��

���ڵ���������:��ѻع�ϵ���Ƕ���?

�����ݶ�������

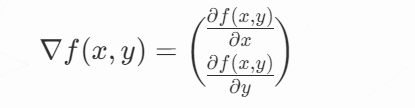

�ݶ����������ڵ�˼����:Ҫ�ҵ�ij���������ֵ,��õķ��������Ÿú������ݶȷ���̽Ѱ������ݶȼ�Ϊ �� \triangledown ��,����f(x,y)���ݶ�����ʽ��ʾ:

����ݶ���ζ��Ҫ��x�ķ����ƶ�

?

f

(

x

,

y

)

?

x

\frac{\partial f(x,y)}{\partial x}

?x?f(x,y)?,��y�ķ����ƶ�

?

f

(

x

,

y

)

?

y

\frac{\partial f(x,y)}{\partial y}

?y?f(x,y)?��

�ݶ������㷨����ÿ��������¹����ƶ��ķ���p0��ʼ,������õ���ݶ�,���������ݶ��ƶ�����һ��p1����p1��,�ݶ��ٴα����¼���,�����µ��ݶȷ����ƶ���p2.���ѭ������,ֱ������ֹͣ����������������,�ݶ��������DZ�֤������ѡȡ����ѵ��ƶ�����

�ݶ������㷨�ĵ�����ʽ����:

w

:

=

w

+

��

��

w

f

(

w

)

w:=w+\alpha \bigtriangledown w f(w)

w:=w+����wf(w)

�ߡ�ѵ���㷨

def loadDataSet(): # ��testSet�ļ�����ȡ,ǰ����Ϊ����x1��x2,���һ��Ϊ����ǩ

dataMat = []

labelMat = []

fr = open("testSet.txt")

for line in fr.readlines():

lineArr = line.strip().split()

dataMat.append([1.0, float(lineArr[0]), float(lineArr[1])])

labelMat.append(int(lineArr[2]))

return dataMat, labelMat

def sigmoid(inX): # ���ຯ��

return 1.0 / (1 + exp(-inX))

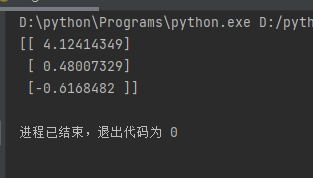

def gradAscent(dataMatIn, classLabels): # �ݶ�����Ѱ����Ѳ���w

dataMatrix = mat(dataMatIn)

labelMat = mat(classLabels).transpose() # ����ǩ����ת��

m, n = shape(dataMatrix)

alpha = 0.001 # ����

maxCycles = 500 # ��������

weights = ones((n, 1))

for k in range(maxCycles):

h = sigmoid(dataMatrix * weights) # sigmoid���������Ԥ��ֵ

error = (labelMat - h) # ������������Ԥ�����IJ�ֵ

weights = weights + alpha * dataMatrix.transpose() * error #�ݶ�������ʽ,��100*3��dataMatrixת�ú���100*1��error���

return weights # ���ػع�ϵ��

���н��Ϊϵ������:

�ˡ��������߽߱�

def plotBestFit(weights): # �������ݼ���logistic�ع�������ֱ��

dataMat, labelMat =loadDataSet()

dataArr=array(dataMat)

n=shape(dataArr)[0]

xcord1=[]

ycord1=[]

xcord2=[]

ycord2=[]

for i in range(n):

if int(labelMat[i])==1:

xcord1.append(dataArr[i,1])

ycord1.append(dataArr[i,2])

else:

xcord2.append(dataArr[i,1])

ycord2.append(dataArr[i,2])

fig=plt.figure() # �����Զ���ͼ��

ax=fig.add_subplot(111) # ����ͼ����

ax.scatter(xcord1,ycord1,s=30,c="red",marker="s") # ����ɢ��ͼ

ax.scatter(xcord2,ycord2,s=30,c="green")

x=arange(-3.0,3.0,0.1) # �����Ȳ�����

y=(-weights[0]-weights[1]*x)/weights[2]

ax.plot(x,y)

plt.xlabel("X1")

plt.ylabel("X2")

plt.show()

�š�����ݶ������㷨���Ľ�

def stocGradAscent(dataMatrix,classLabels): # ����ݶ������㷨

m,n=shape(dataMatrix)

alpha=0.01

weights=ones(n)

for i in range(m):

h=sigmoid(sum(dataMatrix[i]*weights))

error=classLabels[i]-h

weights=weights+alpha*error*dataMatrix[i]

return weights

���Է���gradAscent������stocGradAscent�������ݶ������㷨������,��������ǰ�ߵ�error�������������,��������ֵ,���Һ���û�о���ת���Ĺ��̡�

��ϳ�����ֱ��Ҳ�������ݶ�������Ч��������,�����ڵ��������IJ�ࡣ

�Ľ�������ݶ������㷨

def stocGradAscent1(dataMatrix,classLabels,numIter=1500): # �Ľ�������ݶ������㷨

m,n=shape(dataMatrix)

weights=ones(n)

for j in range(numIter):

dataIndex=list(range(m))

for i in range(m):

alpha=4/(1.0+j+i)+0.01

randIndex=int(random.uniform(0, len(dataIndex)))

h=sigmoid(sum(dataMatrix[randIndex]*weights))

error=classLabels[randIndex]-h

weights=weights+alpha*error*dataMatrix[randIndex]

del(dataIndex[randIndex])

return weights

- �Ľ�����㷨��ÿ�ε����IJ�������Ϊ���ŵ����������ϼ�С��

- ����ͨ�����ѡȡ���������»ع�ϵ�������ַ��������������ԵIJ�����

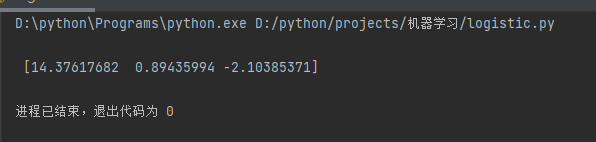

ʮ��logistic�ع�Ԥ�ⲡ��������

ѵ������:

��������:

�������:

def classifyVector(inX,weights): # ����0��1

prob=sigmoid(sum(inX*weights))

if prob >0.5:

return 1.0

else:

return 0.0

def colicTest(): # logistic������Ժ���

frTrain=open("horseColicTraining.txt")

frTest=open("horseColicTest.txt")

trainingSet=[]

trainingLabels=[]

for line in frTrain.readlines():

currLine=line.strip().split("\t")

lineArr=[]

for i in range(21):

lineArr.append(float(currLine[i]))

trainingSet.append(lineArr)

trainingLabels.append(float(currLine[21]))

trainWeights=stocGradAscent1(array(trainingSet),trainingLabels,500)

errorCount=0

numTestVec=0.0

for line in frTest.readlines():

numTestVec+=1.0

currLine=line.strip().split("\t")

lineArr=[]

for i in range(21):

lineArr.append(float(currLine[i]))

if int(classifyVector(array(lineArr),trainWeights)!=int(currLine[21])):

errorCount+=1

errorRate=float(errorCount)/numTestVec

print("the error rate of this test is: %f" %errorRate)

return errorRate

def multiTest():

numTests=10

errorSum=0.0

for k in range(numTests):

errorSum+=colicTest()

print("after %d iterations the average error rate is: %f" %(numTests,errorSum/float(numTests)))

�ڸ��ĵ���������ƽ��������û�����Ա仯,������ij�ε����п��Կ��������ʽ��͵�20%�������

�ܽ�

logistic�ع���з�����ŵ��Ǵ��۲���,���������ʵ�֡�������Ƿ���,���Է��ྫ�Ⱥ��ѽ�����,�Ҷ����ݵ�Ԥ��������,��Ҫ������������,��չ������������ʱ,����һ���ܴ�����⡣