����дĿ¼����

����ѧϰ��Ҫ��

https://blog.csdn.net/qq_35240204/article/details/106864541

�����Իع顱��ͼѧ��һ������ģ���Ծ�����ȷ��Ԥ�� ʵֵ������

������ѧϰ��Ԫ���Իع� �� ��Ԫ���Իع�

һԪ���Իع�

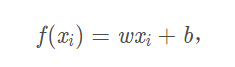

ģ��

һԪ���Իع�������ͼѧ��ģ��

�������

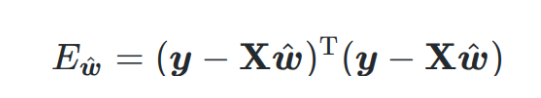

�������Eб����ʽ�ǻع�������õĵ����ܶ���,������Ҫ���ľ�����ͼ�þ��������С��

��С���˷�

��ô���ھ��������С��������ģ�����ķ������ǡ���С���˷�����

��ʵ��,��С���˷������������Իع�,��С���˷���������������ϡ�

����������ֻ�������Իع�

ȷ����ʧ����(����)

���,����һԪ���Իع�,���ǵ�Ŀ�ľͺ�����ˡ�

����ϣ���ҵ�һ��Ŀ�꺯��,

��ô��Ҫ�ҵ����Ŀ�꺯��,���Ǿ���Ҫ������С���˷����w��b

���������Ȳ�������ô֤������,�������

���w��b(�Ż��㷨)

���ڡ����������С����������ģ�����ķ����ͳ�Ϊ��С���˷���

���w��b����ʹ����С���Ĺ���,��Ϊ���Իع�ģ�͵���С���ˡ��������ơ�

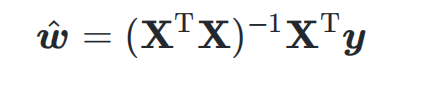

��ʵ��,��E����w��b��ƫ������Ϊ0��ʱ��,���ǵõ�w��b�����Ž�

���,��������

(1)����E��δ֪��w��ƫ�����Ͷ�δ֪��b��ƫ����

(2)��������ƫ����Ϊ0,���w��b�����Ž�ı�ʽ��

(1)

(2)

����,���Ǿ������w��b,��ѧ����ģ���е�δ֪����

Ҳ��ȷ���� ģ��

Ϊʲô��ô��w��b

ʲô������

��������Ҫע��,��ѧ�ϵ����������������������岻ͬ

�ݶ�(��Ԫ������һ����)

Hession(����)����(��Ԫ�����Ķ�����)

��Ԫ�����������ж�

��Ԫ���Իع�

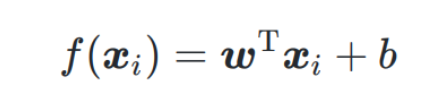

ģ��

���ճ�������,���ݼ� D �е�����һ����d������������

��Ԫ���Իع���ͼѧ��ģ��:

����

���Ƶ�,������С���˷�������b���й���,�õ��������

���غ�b

�������������غ�b,

���ս��

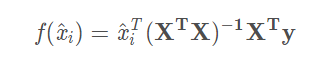

���,ѧ��ģ��

�������ʻع�

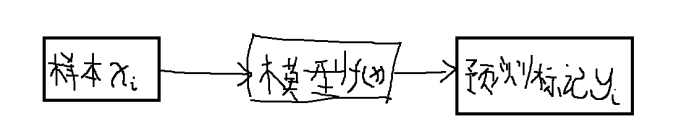

ʹ������ģ�ͽ��лع�ѧϰ,����ѧ����ģ��f(��)

��ͼ��֪,����һ������x,���Իع�ģ��f(x)֮����Ԥ����

��ô����������ôѧ��ģ��:

��ʵ��,������Ҫ��һ�������������������������ʵ���?�����Իع�ģ�͵�Ԥ��ֵ��ϵ������

��ͼ��ʾ��

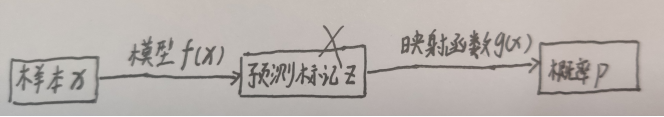

��ô��ô��ϵ������

��ͼ��ʾ

����,���Իع�ģ�Ͳ�����Ԥ��ֵZ��ʵ��,���ڶ�����������,��������y��{0,1}�����Ǿ���Ҫ�����ʵ��ת��Ϊ

0����1.

���ת��: �������ȿ����˵�λ��Ծ���������䲻����ǰ����Ҫ�������:��������

���,����ϣ��Ѱ�ҽ��Ƶ�λ��Ծ����(unit-step function)���������(surrogate function)��

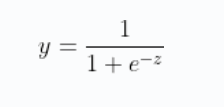

�����ҵ���һ�֡�Sigmoid������:�������ʺ���

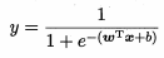

���,������ͼѧ�õ�ģ�;ͱ�Ϊ��

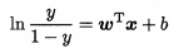

Ҳ���Ա仯Ϊ

�����y��ʾ����x��Ϊ����(ȡ1)�ĸ���

1-y��ʾ����x��Ϊ����(ȡ0)�ĸ���

���Ժ��㷨

������غ�b?

��һ��:ͨ����������Ȼ����(maximum likelihood method)�õ��˦غ�b����ʧ����

�ڶ���:�����Ż�����,�������ֵ�Ż��㷨���ݶ��½���(gradient descent method)��ţ�ٷ�(Newton method)�ȶ�����������Ž�;

��������(Linear Discriminant Analysis�CLDA)

˼��:���ڸ�����ѵ��������D,��ͼ������ͶӰ��һ��ֱ����,ʹ��ͬ��������ͶӰ�㾡���ܽӽ�������������ͶӰ�㾡����Զ�롣

�ڶ�����������ʱ,����ͶӰ��ͬ����������,�ٸ���ͶӰ��λ���ж��������

��ʧ����(����)

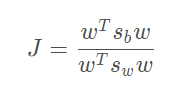

�ھ�����ʧ�����Ƶ�֮��,�õ���ʧ����,Ҳ����LDA���Ż���Ŀ��(���J)

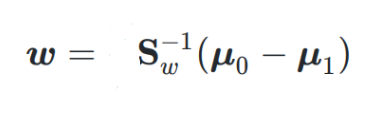

����(�㷨)

�㷨:�����ʧ����,ȷ������ģ�͡�

��������/�Ż���������ʹ�õ����������ճ˻���

ͨ���������ճ˻����������

������Сֵ��

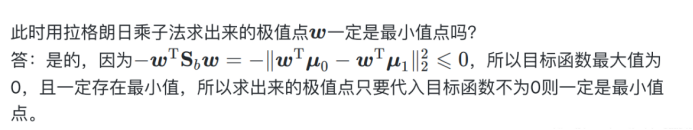

����֪��,ʹ���������ճ˻��������Ľ���Ǽ�ֵ�㡣��ô������Ϊʲô�����������˵����Сֵ�㡣