��ϵ�в��Ͱ���6��ר��,�ֱ�Ϊ:���Զ���ʻ���������������Զ���ʻ����ƽ̨���������������Զ���ʻ������λ�����������Զ���ʻ����������֪�������Զ���ʻ������������ơ������Զ���ʻϵͳ��Ƽ�Ӧ�á�,���߲����Զ���ʻ�����ר��,ֻ��һ����̽���Զ���ʻ·�ϵ�С��,��ϵ�д�����δ�Ķ���,Ҳ�DZ��Ķ����ܽ��˼��,��ӭ��λС���,��λ��ţ������������������,��������С����������,лл!

��ר���ǹ��ڡ��Զ���ʻ����������֪���鼮�ıʼ�

3.����������������

3.1 ����

ʹ��ȫ����ǰ�����紦��ͼ�����������:

- ��������:��������ͼ������Ϊ1000��1000����,��ȫ����ǰ��������,��һ�����ز��ÿ����Ԫ������㶼��1000000�������������,��Ӧ1000000��Ȩ�ز���;�����������RGB��ɫͼ,����3000000������;���Ҫ�õ����õ�Ч��,�ټӼ������ز�,������ģ�������������;

- �ֲ�����������:��Ȼͼ���е�������оֲ�����������,��:�߶����š�ƽ�ơ���ת�Ȳ�����Ӱ����������Ϣ;ȫ����ǰ�����������ȡ��Щ�ֲ���������,һ����Ҫ������ǿ���������;

�������������:

- ����������(Convolutional Neural Network,CNN)��һ�־���ϡ�����ӡ�Ȩֵ���������������ǰ��������;

- ������������������ѧ�ϸ���Ұ(receptive field)�Ļ������;����Ұ��Ҫָ�������Ӿ�����ϵͳ��һЩ��Ԫ������,����Ԫֻ��������֧��Ĵ̼������ڵ��ź�;

- LeCun��1989�꽫�����㷨����������,�����˾���������;

- ������������һ�����ɾ����㡢�ػ����ȫ���Ӳ㽻����Ӷ��ɵ�ǰ��������,ʹ�÷����㷨����ѵ��;

- �����������������ṹ������:ϡ�����ӡ�Ȩֵ��������ת������;

- �������������ó�����ͼ�����Ƶ����,��:ͼ����ࡢ����ʶ������ʶ��ͼ��ָ�������;

3.2 �����ĸ���

- �����

��������ֶ��巽ʽ:������ʽ�ͼ��η�ʽ��- ��������:���ڶ�ά�ռ��ڵ���������

u

,

v

��

R

n

u,v\in{R^n}

u,v��Rn,����

u

=

[

u

1

,

u

2

,

.

.

.

,

u

n

]

,

v

=

[

v

1

,

v

2

,

.

.

.

,

v

n

]

u=[u_1,u_2,...,u_n],v=[v_1,v_2,...,v_n]

u=[u1?,u2?,...,un?],v=[v1?,v2?,...,vn?],

u

u

u��

v

v

v�ĵ������:

u ? v = �� i = 1 n u i v i = u 1 v 1 + u 2 v 2 + . . . + u n v n u��v=\sum^n_{i=1}u_iv_i=u_1v_1+u_2v_2+...+u_nv_n u?v=i=1��n?ui?vi?=u1?v1?+u2?v2?+...+un?vn? - ���ζ���:���ڶ�ά�ռ��ڵ���������

u

,

v

��

R

n

u,v\in{R^n}

u,v��Rn,���С�ֱ��ʾΪ

�O

u

�O

,

�O

v

�O

|u|,|v|

�Ou�O,�Ov�O,���ǵļн�Ϊ

��

(

0

��

��

��

��

)

\theta(0��\theta��\pi)

��(0��������),

u

u

u��

v

v

v�ĵ������:

u ? v = �O u �O �O v �O cos ? �� u��v=|u||v|\cos\theta u?v=�Ou�O�Ov�Ocos��

����:һ������ u u u����һ������ v v v�����ϵķ����ij��Ⱥ� v v v��������˵õ���ֵ;����, u u u�� v v v�ϵķ����ij��ȳ�Ϊ u u u�� v v v�ϵ�ͶӰ;

- ��������:���ڶ�ά�ռ��ڵ���������

u

,

v

��

R

n

u,v\in{R^n}

u,v��Rn,����

u

=

[

u

1

,

u

2

,

.

.

.

,

u

n

]

,

v

=

[

v

1

,

v

2

,

.

.

.

,

v

n

]

u=[u_1,u_2,...,u_n],v=[v_1,v_2,...,v_n]

u=[u1?,u2?,...,un?],v=[v1?,v2?,...,vn?],

u

u

u��

v

v

v�ĵ������:

- ������

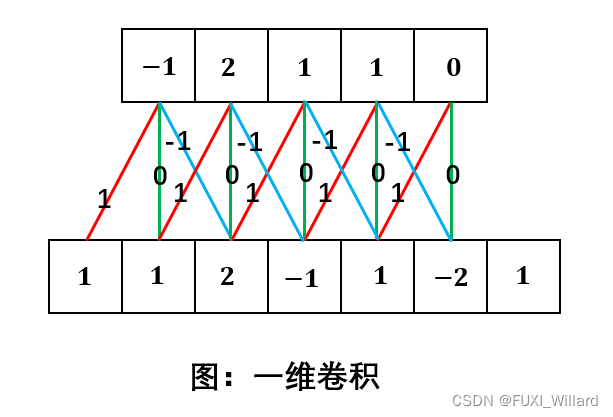

- һά������

����һ���źŷ�����ÿ��ʱ�� t t t����һ���ź� x t x_t xt?,����Ϣ˥����Ϊ f k f_k fk?,���� k ? 1 k-1 k?1��ʱ�䲽����,��ϢΪԭ���� f k f_k fk?��;���� f 1 = 1 , f 2 = 1 / 2 , f 3 = 1 / 4 f_1=1,f_2=1/2,f_3=1/4 f1?=1,f2?=1/2,f3?=1/4,��ô��ʱ�� t t t�յ����ź� y t y_t yt?Ϊ��ǰʱ�̲�������Ϣ����ǰʱ���ӳ���Ϣ�ĵ���:

y t = 1 �� x t + 1 / 2 �� x t ? 1 + 1 / 4 �� x t ? 2 = f 1 �� x t + f 2 �� x t ? 1 + f 3 �� x t ? 2 = �� k = 1 3 f k ? x t ? k + 1 y_t=1\times{x_t}+1/2\times{x_{t-1}}+1/4\times{x_{t-2}}=f_1\times{x_t}+f_2\times{x_{t-1}}+f_3\times{x_{t-2}}=\sum^3_{k=1}f_k��x_{t-k+1} yt?=1��xt?+1/2��xt?1?+1/4��xt?2?=f1?��xt?+f2?��xt?1?+f3?��xt?2?=k=1��3?fk??xt?k+1?

f 1 , f 2 , f 3 , . . . f_1,f_2,f_3,... f1?,f2?,f3?,...��Ϊ�˲���(filter),���ѧϰ�г�Ϊ������(convolution kernel);

��������� W = [ w 1 , w 2 , . . . , w m ] W=[w_1,w_2,...,w_m] W=[w1?,w2?,...,wm?]��СΪ m m m,��һ���ź����� X = [ x 1 , x 2 , . . . , x n ] X=[x_1,x_2,...,x_n] X=[x1?,x2?,...,xn?]�ľ�����Ϊ: Y = W ? X , �� �� : y t = �� k = 1 m w k ? x n ? k + 1 , ? �� ʾ �� �� �� �� Y=W\ast{X},����:y_t=\sum^m_{k=1}w_k\cdot{x_{n-k+1}},\ast��ʾ�������� Y=W?X,����:yt?=k=1��m?wk??xn?k+1?,?��ʾ��������

һ����˵,�����˴�С m m mԶС���ź����г��� n n n;

һά����ʵ��:

ע:��������Ϊ����,���ӱ��ϵ�����ΪȨ��,��������Ϊ [ 1 , 0 , ? 1 ] [1,0,-1] [1,0,?1],��������Ϊ���;

�����;���,�� f ( x ) , g ( x ) f(x),g(x) f(x),g(x)�������ɻ�����,���������Ϊ

( f ? g ) ( n ) = �� ? �� �� f ( �� ) g ( n ? �� ) d �� (f\ast{g})(n)=\int^{\infty}_{-\infty}f(\tau)g(n-\tau)d\tau (f?g)(n)=��?����?f(��)g(n?��)d�� - ������.

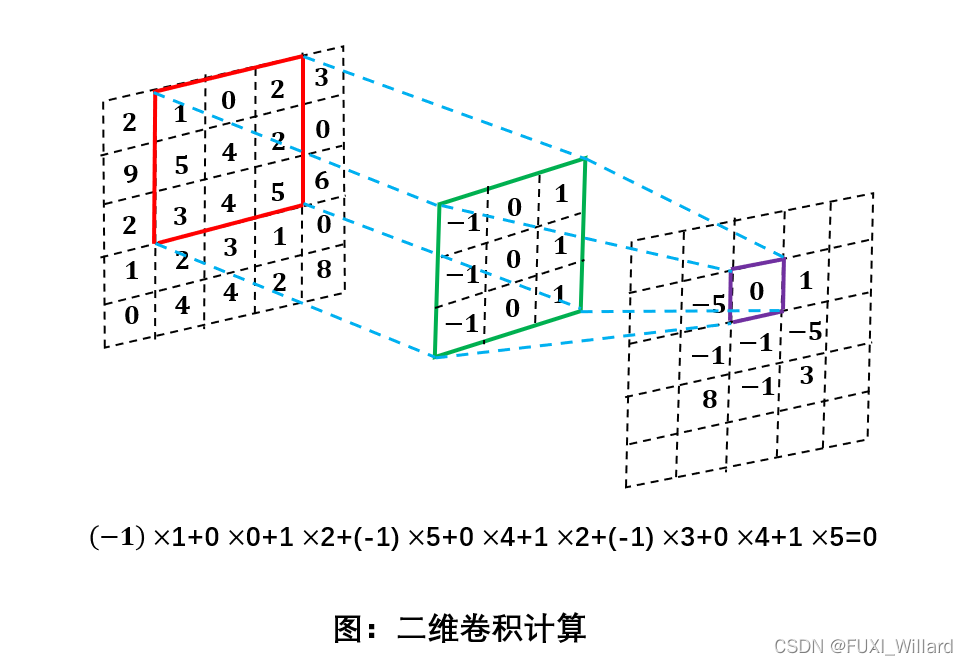

����һ��ͼ�� X �� R M �� N X\in{R^{M\times{N}}} X��RM��N�;����� W �� R m �� n W\in{R^{m\times{n}}} W��Rm��n,�����Ϊ:

y i j = �� u = 1 m �� v = 1 n w u v ? x i ? u + 1 , j ? v + 1 y_{ij}=\sum^m_{u=1}\sum^n_{v=1}w_{uv}\cdot{x_{i-u+1,j-v+1}} yij?=u=1��m?v=1��n?wuv??xi?u+1,j?v+1?

���������������뺯����ÿһ��λ�ý��м�Ȩ�ۼ�,�����˾��Ƕ�Ӧ���뺯����ÿ��λ���ϵ�Ȩ������(һά)��Ȩ�ؾ���(��ά);

- һά������

- �����ͻ���ء�

- ���о�������ʱ,Ҫ�Ѿ����˷�ת,�ڲ�ͬλ�ú���ͬ��С�����������;

- �����(cross-correlation)��һ������������������Եĺ���,ͨ���û������ڵĵ������ʵ��;

- ����һ��ͼ��

X

��

R

M

��

N

X\in{R^{M\times{N}}}

X��RM��N�;�����

W

��

R

m

��

n

W\in{R^{m\times{n}}}

W��Rm��n,�以���Ϊ:

y i j = �� u = 1 m �� v = 1 n w u v ? x i + u ? 1 , j + v ? 1 y_{ij}=\sum^m_{u=1}\sum^n_{v=1}w_{uv}\cdot{x_{i+u-1,j+v-1}} yij?=u=1��m?v=1��n?wuv??xi+u?1,j+v?1? - �����ͻ���ص��������ھ������Ƿ�ת;����������,����������������ȡ,�������Ƿ�ת��û��ʲôӰ��;

- ����ز���ʹ�÷��� ? \otimes ?��ʾ,������ʽ����: Y = W ? X Y=W\otimes{X} Y=W?X;

- ������Ӧ�á�

- Ȩֵ������

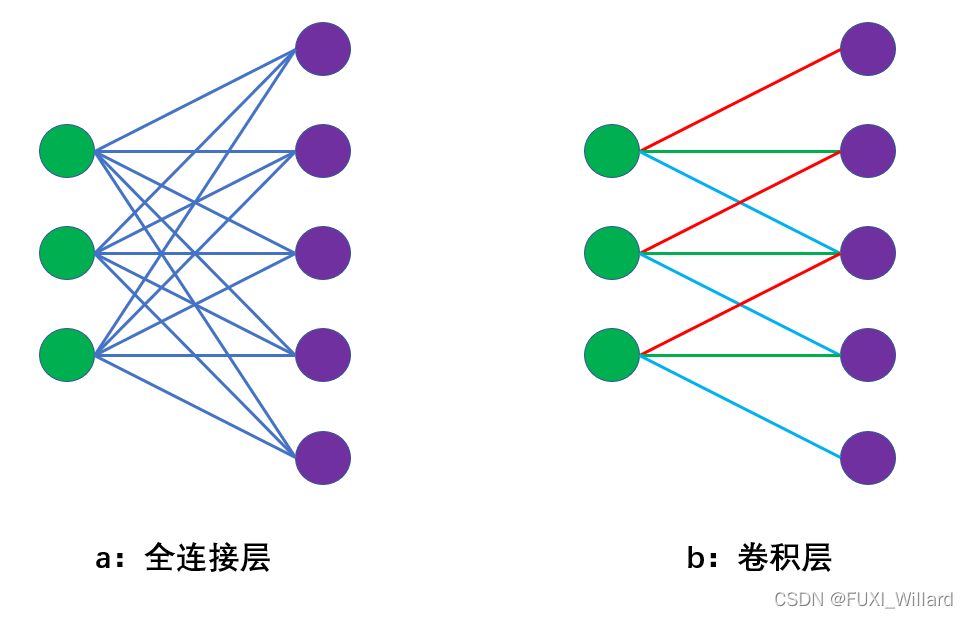

��һ��ͼ����о���ʱ,�����˽���һ����ͼ���ÿ������,����ͬһ����������������,���ڲ�ͬ������,����ͬһ��������,�������Ǿ����˴�С;�������������������,���ڲ�������,��ʹͼ�����һ����ƽ�Ʋ���,һ������ʶ�������,��Ϊ"ƽ�Ʋ�����"; - ϡ�����ӡ�

����ͼ��������,ͼ�������������,�ֲ���Ϣ����Ϲ��ɸ���������״;һ����˵,ÿһ�����ص��ڿռ��Ϻ���Χ�����ص��ǽ�����ϵ��,����Զ�����ص�����Խ�С;�����ھ�����ĵ� l l l��,ÿһ����Ԫ���͵� l ? 1 l-1 l?1���������Ԫ����,����һ��ȫ��������,��������������Ϊ n ( l ) �� n ( l ? 1 ) n^{(l)}\times{n^{(l-1)}} n(l)��n(l?1);��ʹ��ϡ�����ӷ�ʽ,����һ�� m �� m m\times{m} m��m( m m mһ��Ϊ3��5)�ľ����˶��������о�������,��� l l l��ÿ����Ԫ��ֻ�;������ڵ�Ԫ����,����һ���ֲ���������,������Ϊ n ( l ) �� m n^{(l)}\times{m} n(l)��m��

- ��˾�����

ÿ����������һ��������ȡ��,��ʹ��Sobel������ȡͼ���Ե,��ֻ��һ��������,ֻ����ȡһ������,ʹ�ö��������,�Զ�˾����Ӳ�ͬ�Ƕ��������ȡͼ������;ÿ����������Ӧ����һ������ͼ,��ͼ��������IJ�ͬͨ��(channel),��˾�����Ϊ��ͨ������;

- Ȩֵ������