8.1 �����뼯��

���ϸ���Ӧ�úͶ���ͬ,

�ٺ�ָ����ѧϰ���ķ������Ӧ��С��������,�Զ���������Ϊ��,����ָ���

?

\epsilon

?<0.5

�ڲ�ָͬ����,����ѧϰ��֮��Ӧ����������,��������ѧϰ��������

������������������:

�ٸ���ѧϰ��Խ��Խ��,�ܽ��ͼ��ɴ�����

��

?

��

\epsilon\neq

?��?= 0.5

8.2 Boosting

8.2.1Boosting����

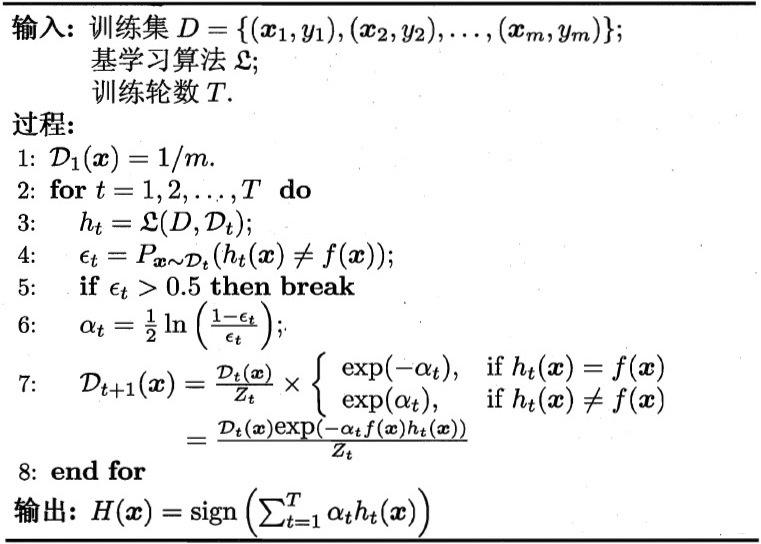

Boosting��һ��ɽ���ѧϰ������Ϊǿѧϰ�����㷨,�����㷨�Ĺ�����������:�ȴӳ�ʼѵ����ѵ����һ����ѧϰ��,�ٸ��ݻ�ѧϰ���ı��ֶ�ѵ�������ֲ����е���,ʹ����ǰ��ѧϰ��������ѵ�������ں����ܵ������ע,Ȼ����ڵ�����������ֲ���ѵ����һ����ѧϰ��;����ظ�����,ֱ����ѧϰ������Ŀ�ﵽ����ָ����ָT,���ս���T����ѧϰ�����м�Ȩ��ϡ�

8.2.2AdaBoost�㷨

Boosting���������Ĵ�����AdaBoost,����������ͼ��ʾ,����

y

i

��

{

?

1

,

1

}

,

f

y_i\in\{-1,1\},f

yi?��{?1,1},f����ֵ������

AdaBoost�㷨�ж����Ƶ���ʽ,�Ƚ�����������ǻ��ڡ�����ģ�͡�,����ѧϰ���������

H

(

x

)

=

��

t

=

1

T

a

t

h

t

(

x

)

H(x)=\sum_{t=1}^{T}a_th_t(x)

H(x)=t=1��T?at?ht?(x)

����С��ָ����ʧ����

?

exp

?

(

H

�O

D

)

=

E

x

��

D

[

e

?

f

(

x

)

H

(

x

)

]

\ell_{\exp}(H|D)=\mathbb{E}_{x\thicksim D}[e^{-f(x)H(x)}]

?exp?(H�OD)=Ex��D?[e?f(x)H(x)]

��

H

(

x

)

H(x)

H(x)��ָ����ʧ������С��,������ʧ���������ƫ��

?

?

exp

?

(

H

�O

D

)

?

H

(

x

)

=

1

2

l

n

P

(

f

(

x

)

=

1

�O

x

)

P

(

f

(

x

)

=

?

1

�O

x

)

,

\frac{\partial\ell_{\exp}(H|D)}{\partial H(x)}=\frac{1}{2}ln\frac{P(f(x)=1|x)}{P(f(x)=-1|x)},

?H(x)??exp?(H�OD)?=21?lnP(f(x)=?1�Ox)P(f(x)=1�Ox)?,���,��

s

i

g

n

(

H

(

x

)

)

=

s

i

g

n

(

1

2

l

n

P

(

f

(

x

)

=

1

�O

x

)

P

(

f

(

x

)

=

?

1

�O

x

)

)

=

arg?max

?

y

��

{

?

1

,

1

}

P

(

f

(

x

)

=

y

�O

x

)

sign(H(x))=sign(\frac{1}{2}ln\frac{P(f(x)=1|x)}{P(f(x)=-1|x)}) \\ =\argmax_{y \in\{-1,1\}}P(f(x)=y|x)

sign(H(x))=sign(21?lnP(f(x)=?1�Ox)P(f(x)=1�Ox)?)=y��{?1,1}argmax?P(f(x)=y�Ox)

����ζ��sign(H(x))�ﵽ�˱�Ҷ˹���Ŵ�����,����֮,��ָ����ʧ������С��������������Ҳ����С��;��˵��ָ����ʧ�����Ƿ�������ԭ��0/1��ʧ������һ�µ������ʧ���������������������и��õ���ѧ����,������������������,���������������0/1��ʧ��������Ϊ�Ż�Ŀ�ꡣ

��AdaBoost�㷨��,��һ����������

h

1

h_1

h1?��ͨ��ֱ�ӽ���ѧϰ�㷨���ڳ�ʼ���ݷֲ�����;�˺����������

h

t

h_t

ht?��

a

t

a_t

at?,����������

h

t

h_t

ht?���ڷֲ�

D

t

D_t

Dt?������,�û���������Ȩ��

a

t

a_t

at?Ӧʹ��

a

t

h

t

a_th_t

at?ht?��С��ָ����ʧ������

?

exp

?

(

a

t

h

t

�O

D

t

)

=

E

x

��

D

t

[

e

?

f

(

x

)

a

t

h

t

(

x

)

]

=

e

?

a

t

(

1

?

?

t

)

+

e

a

t

?

t

\ell_{\exp}(a_th_t|D_t)=\mathbb{E}_{x\thicksim D_t}[e^{-f(x)a_th_t(x)}]\\ =e^{-a_t}(1-\epsilon_t)+e^{a_t}\epsilon_t

?exp?(at?ht?�ODt?)=Ex��Dt??[e?f(x)at?ht?(x)]=e?at?(1??t?)+eat??t?

����

?

t

=

P

x

��

D

t

(

h

t

(

x

)

��

f

(

x

)

)

.

\epsilon_t=P_{x\thicksim D_t}(h_t(x)\neq f(x)).

?t?=Px��Dt??(ht?(x)��?=f(x)).����ָ����ʧ�����ĵ���

?

?

exp

?

(

a

t

h

t

�O

D

t

)

?

a

t

=

?

e

?

a

t

(

1

?

?

T

)

+

e

a

t

?

t

\frac{\partial\ell_{\exp}(a_th_t|D_t)}{\partial a_t}=-e^{-a_t}(1-\epsilon_T)+e^{a_t}\epsilon_t

?at???exp?(at?ht?�ODt?)?=?e?at?(1??T?)+eat??t?

����Ϊ��ɵ�

a

t

=

1

2

l

n

(

1

?

?

t

?

t

)

a_t=\frac{1}{2}ln(\frac{1-\epsilon_t}{\epsilon_t})

at?=21?ln(?t?1??t??)

��ǡ���㷨ͼ�е����еķ�����Ȩ�ظ��¹�ʽ��

AdaBoost�㷨�ڻ��

H

t

?

1

H_{t-1}

Ht?1?֮�������ֲ������е���,ʹ��һ�ֵĻ�ѧϰ��

h

t

h_t

ht?�ܾ���

H

t

?

1

H_{t-1}

Ht?1?��һЩ����.�����

h

t

h_t

ht?�ܾ���

H

t

?

1

H_{t-1}

Ht?1?��ȫ������,����С��

?

exp

?

(

H

t

?

1

+

h

t

�O

D

)

=

E

x

��

D

t

[

e

?

f

(

x

)

(

H

t

?

1

(

x

)

+

h

t

(

x

)

)

]

=

E

x

��

D

t

[

e

?

f

(

x

)

H

t

?

1

(

x

)

e

?

f

(

x

)

h

t

(

x

)

]

\ell_{\exp}(H_{t-1}+h_t|D)=\mathbb{E}_{x\thicksim D_t}[e^{-f(x)(H_{t-1}(x)+h_t(x))}]\\=\mathbb{E}_{x\thicksim D_t}[e^{-f(x)H_{t-1}(x)}e^{-f(x)h_t(x)}]

?exp?(Ht?1?+ht?�OD)=Ex��Dt??[e?f(x)(Ht?1?(x)+ht?(x))]=Ex��Dt??[e?f(x)Ht?1?(x)e?f(x)ht?(x)]

ע�

f

2

(

x

)

=

h

t

2

(

x

)

=

1

f^2(x)=h_t^2(x)=1

f2(x)=ht2?(x)=1��ʽ����

e

?

f

(

x

)

h

t

(

x

)

e^{-f(x)h_t(x)}

e?f(x)ht?(x)��̩��չ������Ϊ

?

exp

?

(

H

t

?

1

+

h

t

�O

D

)

=

E

x

��

D

t

[

e

?

f

(

x

)

H

t

?

1

(

x

)

(

1

?

f

(

x

)

h

t

(

x

)

+

f

2

(

x

)

h

t

2

(

x

)

2

)

]

=

E

x

��

D

t

[

e

?

f

(

x

)

H

t

?

1

(

x

)

(

1

?

f

(

x

)

h

t

(

x

)

+

1

2

)

]

\ell_{\exp}(H_{t-1}+h_t|D)\\=\mathbb{E}_{x\thicksim D_t}[e^{-f(x)H_{t-1}(x)}(1-f(x)h_t(x)+\frac{f^2(x)h_t^2(x)}{2})]\\ =\mathbb{E}_{x\thicksim D_t}[e^{-f(x)H_{t-1}(x)}(1-f(x)h_t(x)+\frac{1}{2})]

?exp?(Ht?1?+ht?�OD)=Ex��Dt??[e?f(x)Ht?1?(x)(1?f(x)ht?(x)+2f2(x)ht2?(x)?)]=Ex��Dt??[e?f(x)Ht?1?(x)(1?f(x)ht?(x)+21?)]

����,����Ļ�ѧϰ��

h

t

(

x

)

=

arg?max

?

h

?

exp

?

(

H

t

?

1

+

h

�O

D

)

=

arg?min

?

h

E

x

��

D

[

e

?

f

(

x

)

H

t

?

1

(

x

)

(

1

?

f

(

x

)

h

(

x

)

+

1

2

)

]

=

arg?max

?

h

E

x

��

D

[

e

?

f

(

x

)

H

t

?

1

(

x

)

f

(

x

)

h

(

x

)

]

=

arg?max

?

h

E

x

��

D

[

e

?

f

(

x

)

H

t

?

1

(

x

)

E

x

��

D

[

e

?

f

(

x

)

H

t

?

1

(

x

)

]

f

(

x

)

h

(

x

)

]

h_t(x)=\argmax_h\ell_{\exp}(H_{t-1}+h|D)\\ =\argmin_h\mathbb{E}_{x\thicksim D}[e^{-f(x)H_{t-1}(x)}(1-f(x)h(x)+\frac{1}{2})]\\ =\argmax_h\mathbb{E}_{x\thicksim D}[e^{-f(x)H_{t-1}(x)}f(x)h(x)]\\ =\argmax_h\mathbb{E}_{x\thicksim D}[\frac{e^{-f(x)H_{t-1}(x)}}{\mathbb{E}_{x\thicksim D}[e^{-f(x)H_{t-1}(x)}]}f(x)h(x)]

ht?(x)=hargmax??exp?(Ht?1?+h�OD)=hargmin?Ex��D?[e?f(x)Ht?1?(x)(1?f(x)h(x)+21?)]=hargmax?Ex��D?[e?f(x)Ht?1?(x)f(x)h(x)]=hargmax?Ex��D?[Ex��D?[e?f(x)Ht?1?(x)]e?f(x)Ht?1?(x)?f(x)h(x)]

ע�

E

x

��

D

[

e

?

f

(

x

)

H

t

?

1

(

x

)

]

\mathbb{E}_{x\thicksim D}[e^{-f(x)H_{t-1}(x)}]

Ex��D?[e?f(x)Ht?1?(x)]��һ����������

D

t

D_t

Dt?��ʾһ���ֲ�

D

t

(

x

)

=

D

(

x

)

e

?

f

(

x

)

H

t

?

1

(

x

)

E

x

��

D

[

e

?

f

(

x

)

H

t

?

1

(

x

)

]

D_t(x)=\frac{D(x)e^{-f(x)H_{t-1}(x)}}{\mathbb{E}_{x\thicksim D}[e^{-f(x)H_{t-1}(x)}]}

Dt?(x)=Ex��D?[e?f(x)Ht?1?(x)]D(x)e?f(x)Ht?1?(x)?�������ѧ�����Ķ�����ȼ�����

h

t

(

x

)

=

arg?max

?

h

E

x

��

D

[

e

?

f

(

x

)

H

t

?

1

(

x

)

E

x

��

D

[

e

?

f

(

x

)

H

t

?

1

(

x

)

]

f

(

x

)

h

(

x

)

]

=

arg?max

?

h

E

x

��

D

[

f

(

x

)

h

(

x

)

]

h_t(x)=\argmax_h\mathbb{E}_{x\thicksim D}[\frac{e^{-f(x)H_{t-1}(x)}}{\mathbb{E}_{x\thicksim D}[e^{-f(x)H_{t-1}(x)}]}f(x)h(x)]\\ =\argmax_h\mathbb{E}_{x\thicksim D}[f(x)h(x)]

ht?(x)=hargmax?Ex��D?[Ex��D?[e?f(x)Ht?1?(x)]e?f(x)Ht?1?(x)?f(x)h(x)]=hargmax?Ex��D?[f(x)h(x)]

��

f

(

x

)

,

h

(

x

)

��

{

?

1

,

+

1

}

f(x),h(x)\in\{-1,+1\}

f(x),h(x)��{?1,+1},��

f

(

x

)

h

(

x

)

=

1

?

2

��

(

f

(

x

)

��

h

(

x

)

)

f(x)h(x)=1-2��(f(x)\neq h(x))

f(x)h(x)=1?2��(f(x)��?=h(x))

�������ѧϰ��

h

t

(

x

)

=

arg?max

?

h

E

x

��

D

[

��

(

f

(

x

)

��

h

(

x

)

]

h_t(x)=\argmax_h\mathbb{E}_{x\thicksim D}[��(f(x)\neq h(x)]

ht?(x)=hargmax?Ex��D?[��(f(x)��?=h(x)]

�ɴ˿ɼ�,�����

h

t

h_t

ht?���ڷֲ�

D

t

D_t

Dt?����С������������������������ڷֲ�

D

t

D_t

Dt?��ѵ��,�����

D

t

D_t

Dt?�ķ������ӦС��0.5,����һ���̶������ơ��в�ƽ�����˼�롣���ǵ�

D

t

D_t

Dt?��

D

t

+

1

D_{t+1}

Dt+1?�Ĺ�ϵ��

D

t

+

1

=

D

(

x

)

e

?

f

(

x

)

H

t

(

x

)

E

x

��

D

[

e

?

f

(

x

)

H

t

(

x

)

]

=

D

(

x

)

e

?

f

(

x

)

H

t

?

1

(

x

)

e

?

f

(

x

)

a

t

h

t

(

x

)

E

x

��

D

[

e

?

f

(

x

)

H

t

(

x

)

]

=

D

t

(

x

)

e

?

f

(

x

)

a

t

h

t

(

x

)

E

x

��

D

[

e

?

f

(

x

)

H

t

?

1

(

x

)

]

E

x

��

D

[

e

?

f

(

x

)

H

t

(

x

)

]

D_{t+1}=\frac{D(x)e^{-f(x)H_{t}(x)}}{\mathbb{E}_{x\thicksim D}[e^{-f(x)H_{t}(x)}]}\\ =\frac{D(x)e^{-f(x)H_{t-1}(x)}e^{-f(x)a_th_t(x)}}{\mathbb{E}_{x\thicksim D}[e^{-f(x)H_{t}(x)}]}\\ =D_t(x)e^{-f(x)a_th_t(x)}\frac{\mathbb{E}_{x\thicksim D}[e^{-f(x)H_{t-1}(x)}]}{\mathbb{E}_{x\thicksim D}[e^{-f(x)H_{t}(x)}]}

Dt+1?=Ex��D?[e?f(x)Ht?(x)]D(x)e?f(x)Ht?(x)?=Ex��D?[e?f(x)Ht?(x)]D(x)e?f(x)Ht?1?(x)e?f(x)at?ht?(x)?=Dt?(x)e?f(x)at?ht?(x)Ex��D?[e?f(x)Ht?(x)]Ex��D?[e?f(x)Ht?1?(x)]?

��ǡ��ͼ���㷨�����е������ֲ����¹�ʽ��

����,���Ǵӻ��ڼ���ģ�͵���ʽ�Ż�ָ����ʧ�����ĽǶ��Ƶ�����AdaBoost�㷨��

?��������Դ����־��������ѧϰ��(������),�������Լ�������д����ƪ�ʼ�,���д���ӭָ��

?