1. Abstract

??�ֹ������������������ѵ�ʱ��;����Ǿ��,���ƶ����ܹ�����(Neural Architecture Search,NAS)�����ķ�չ,��ʵ���Զ�����ơ�Ȼ��,NAS�㷨�����ٶ����ҳɱ�����;������Ҫѵ�������ĺ�ѡ����,�Ա�Ϊ���������ṩ��Ϣ����������ܹ�������ij�ʼ״̬����Ԥ����ѵ���ľ���,��һ����Ϳ��Եõ����⡣

??���������,���߲�����δ��ѵ�������������ݵ�֮��ļ����ص�,����������ܹ�������Ч��������ѵ�����ܵĶ��������߽����ַ������ϵ�һ�����㷨��,���㷨���������ڼ��������ڵ���GPU������ǿ�������,�������κ�ѵ��,����NAS-Bench-101��NAS-Bench-201��NATS Bench��NDS(Network Design Spaces)����֤������Ч�ԡ�

??����,���ߵ��㷨�ܹ���30s����NAS-Bench-201�����ռ�������������Ϊ92.81%������,�ȴ�ͳNAS�������˼�����������

??Paper:https://arxiv.org/abs/2006.04647

??Code:https://github.com/BayesWatch/nas-without-training

2. Background

Time | Paper | Author | Method | [Dis]advantages |

|---|---|---|---|---|

2017 | Neural architecture search with reinforcement learning | Zoph & Le | ����ʹ��RNN�����������ɺ�ѡ����,���Ժ�ѡ�������ѵ��,ʹ��ǿ��ѧϰ���¿�����,����������ɵĺ�ѡ��������� | ������ÿ�ε�����ṹ��Ҫ����ѵ��,�ɱ��ϸ�,����ʹ��800��GPU��CIFAR10���ݼ���ѵ����28��;ȱ�������,���ջ�õ������ǹ̶���,������չ,�����������ƶ��豸���������ݼ� |

2018 | Learning transferable architectures for scalable image recognition | Zoph et al. | ����Ԫ��������,�������������ܹ�������������������һ������Ԫ��һ����Ԫ(�ϲ���)����CIFAR10����,Ȼ��������ImageNet����ĸ�������ĵ�Ԫ�� | �������ϸ������,��Ԫ����Ը���Ԥ����е���;500��GPUѵ����4�� |

2018 | Efficient neural architecture search via parameter sharing | Pham et al. | ������ѡ���繲��Ȩ��,�Ա��������ѵ�� | �����������ļ���ɱ�,ʹ�õ���GPU��CIFAR10���ݼ��������˰��� |

2020 | Evaluating the search phase of neural architecture search | Yu et al. | ֤���˹���Ȩ�ط��������˶��������ṹ������,ʹ���������Ϊһ�ּ�����Ч��NAS���� | / |

??����һЩ��ҵ����˵,NAS��Ȼ��������Ӳ����֪������,�ܹ�����(������Ϊ��λ)ִ��NAS���dz�����,�ڸ�������,ÿ���豸������ͨ����Ҫ����������

Time | Paper | Author | Method | [Dis]advantages |

|---|---|---|---|---|

2019 | FBNet: Hardwareaware efficient convnet design via differentiable neural architecture search | Wu et al. | / | / |

2019 | MnasNet: Platform-aware neural architecture search for mobile | Tan et al. | / | / |

??����NAS�㷨��Ч�Ե���Ҫ�ϰ��������ռ�(���п�������ļ���)̫��,�������꾡��������������ܼ������õ�benchmarks:

| Benchmarks | Introduction |

|---|---|

NAS-Bench 101 | ����423624��������,��CIFAR10���ݼ��Ͼ�����108��epoch��ѵ��,ʹ�������ֲ�ͬ�ij�ʼ�� |

NAS-Bench 201 | ����15625��������,CIFAR10/CIFAR100/ImageNet-16-120���ݼ���ѵ���˶�� |

NATS-Bench | �����������ռ�:���������ռ�NATS-Bench TSS,����15625��������,Ҳ����NAS-Bench 201;��С�����ռ�NATS-Bench SSS,����32768��������,��Щ����֮���cellsͨ������ͬ�� |

3. Method

3.1 score

??���ߵ�Ŀ�������һ�ַ���,�ڳ�ʼ��ʱ������ܹ���������,�Ա�ʾ������ѵ���ľ���,�����Ϳ���ʹ�óɱ������ļ��㷽��������NAS�㷨�а����ѵ�����衣

??����һ�������������Ե�Ԫ(rectified linear units, RELU)��������,���ǿ�����ÿ���ÿ��RELU��Ԫ��ȷ��һ�����ڸõ�Ԫ��δ����(ֵΪ��,��˳�����)�����Ѽ���(�����������,��ֵ����һ)�Ķ�����ָ�ꡣ�̶���Щָ�����,�����������������Ӿֲ�����,������ͨ����ɢ����ÿ�����ϵ�����ӳ��(the linear maps)�������У����Ԫ(the binary rectification units)��˶���á�

??mini-batch data

X

=

{

x

i

}

i

=

1

N

X = \{x_i\}_{i=1}^N

X={xi?}i=1N?����ͨ��������ӳ��Ϊ

f

(

x

i

)

f(x_i)

f(xi?),

f

f

f��

x

x

x��RELU��Ԫ��ָʾ�����γ�һ��������������(the linear region)�Ķ�������

c

i

c_i

ci?������������������Ķ�������Խ����,����ѧϰ������Щ�����Խ������ս��,���������������ͬ�Ķ�������ʱ,����λ���������ͬ����������,����ر����Է��롣�෴,�����뱻�ܺõ�����ʱ,ѧϰӦ�ø����ס���ͼ���ӻ���ReLU��Ԫ�Ķ����Ƽ������Ӧ����������:

??����,1. ÿ��ReLU�ڵ�

A

i

A_i

Ai?��������Ϊ��������(>0)�ͷǼ�������,���ǽ�����������Ϊ1,�Ǽ���������Ϊ0;2. ��ÿ���ڵ�

A

i

A_i

Ai?������ļ���ͷǼ��������ཻ,������ͬ����ģʽ������ռ�(input space)�����ǹ��ߵ�(co-linear);3. ��һ���ReLU�ڵ�

B

B

B���ռ��һ������Ϊ��������ͷǼ�������;4. �����ڵ��ϵ�ÿ����������������ǰ�������ReLU�ڵ�ļ���ģʽΨһ���塣

??�����ú�������(Hamming distance)

d

H

(

c

i

,

c

j

)

d_H(c_i, c_j)

dH?(ci?,cj?)��������������(δѵ������������������)�IJ����Ƴ̶�(Ҳ����˵�������Գ̶�),��˿���ͨ������˾���(kernel matrix)

K

H

K_H

KH?����������С�������ݵĶ�������֮��Ķ�Ӧ��ϵ:

K

H

=

(

N

A

?

d

H

(

c

1

,

c

1

)

��

N

A

?

d

H

(

c

1

,

c

N

)

?

?

?

N

A

?

d

H

(

c

N

,

c

1

)

��

N

A

?

d

H

(

c

N

,

c

N

)

)

K_H = \begin{pmatrix} N_A-d_H(c_1, c_1) & \dots & N_A-d_H(c_1, c_N) \\ \vdots & \ddots & \vdots \\ N_A-d_H(c_N, c_1) & \dots & N_A-d_H(c_N, c_N) \end{pmatrix}

KH?=????NA??dH?(c1?,c1?)?NA??dH?(cN?,c1?)?��?��?NA??dH?(c1?,cN?)?NA??dH?(cN?,cN?)???????����,

N

A

N_A

NA?��������RELU��Ԫ������,

N

N

N��mini-batch�Ĵ�С,������128��

??��һ��������Щ��Ť,�˾��� K H K_H KH?�������Dz�ͬ��������������Գ̶�,�����Գ̶�Խ��, K H K_H KH?Խ�ӽ��ڶԽ��ߡ�

??������������н��ٵķǶԽ�Ԫ�غͽϸߵ�������(����ͼ),����������һ�۲�����Ԥ��δ��ѵ�����������������,����ʹ�����¹�ʽ������ģ�͵�����:

s

=

l

o

g

�O

K

H

�O

s=log |K_H|

s=log�OKH?�O??

K

H

K_H

KH?Խ�ӽ��ڶԽ���(���ֻ�жԽ���,Ҳ����������Խ��,����������Խ��),

s

s

sԽ��,��ʾѵ�����ģ�;��ȸ��ߡ�

??�ٸ�������:

????���� K H = ( a b c d ) K_H = \begin{pmatrix} a & b \\ c & d \end{pmatrix} KH?=(ac?bd?),�� �O K H �O = �O a b c d �O = a d ? b c |K_H| = \begin{vmatrix} a & b \\ c & d \end{vmatrix}=ad-bc �OKH?�O=�O�O�O�O?ac?bd?�O�O�O�O?=ad?bc,��b=c=0ʱ, �O K H �O |K_H| �OKH?�O�����ֵ,�� K H = ( a 0 0 d ) K_H = \begin{pmatrix} a & 0 \\ 0 & d \end{pmatrix} KH?=(a0?0d?),��ʱ K H K_H KH?��һ���ԽǾ���,Ҳ����ֻ�����Խ���Ԫ����ֵ,����λ�þ�Ϊ0����ʱ�� K H K_H KH?��ʾ�������Գ̶����,��Ӧ�� s c o r e score score��ߡ�

??��ͼ��ʾ����NAS-Bench-201��δѵ��������ṹ��Ӧ�ĺ˾���,�����mini-batch sizeΪ128������Щͼ�е�

K

H

K_H

KH?��һ��,�Ա�Խ�����ĿΪ1,Ȼ��������յ�CIFAR10��֤���Ƚ�

K

H

K_H

KH?����Ϊ�С��ϰ���������нϸߵ�������,��������,���ȵ�;��dz�����������Ժ�С,ģ�͵ľ��ȸ�,˵��ģ���ܹ��ܺõ�����ͼ�������,��˿���ʹ��

K

H

K_H

KH?��Ԥ��δ��ѵ�����������������,�������κ�ѵ����

??

Hamming����:��Ӧ������λ��ͬ��λ�õ���Ŀ

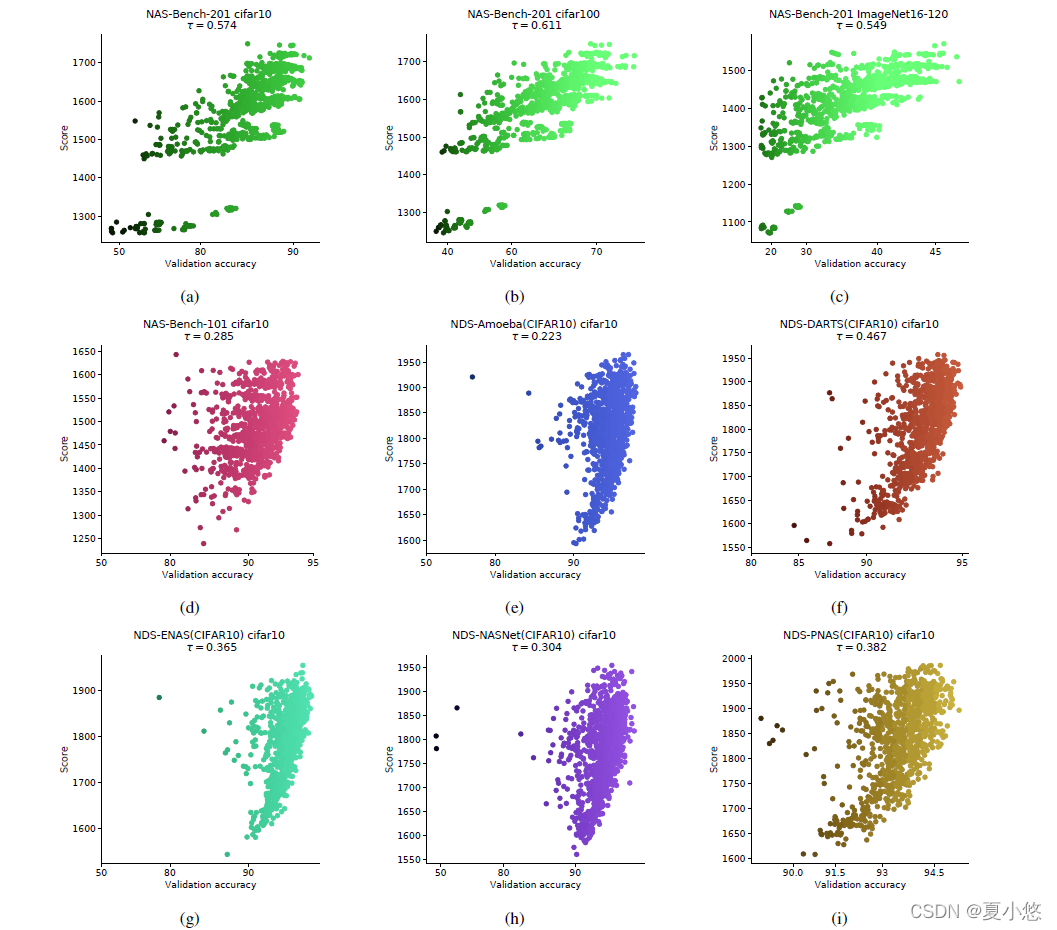

??Ϊ��˵��score��ģ�;��ȵĹ�ϵ,���߶Ա��˸������ռ��ڸ����ݼ��ϵ�score��ģ�͵ľ���(�������1000������),���Կ���ģ�͵ľ�����score��һ�������Թ�ϵ,��������ͼ:

??����, �� \tau ����ʾ

Kendallϵ����

3.2 NASWOT

??���������һ��NASWOT(Neural Architecture Search without Training)�㷨(����ͼ),����ʹ����������Ϊ������,���Ǵ������ռ����������һ����ѡ����,Ȼ��ʹ��score������δ��ѵ����״̬�¶���������֡�

3.3 AREA

??���������score����ֱ�Ӳ������е�NAS�㷨��,Ϊ��֤����һ��,������REA(Regularised EA)�Ͻ����˸ı�,��֮ΪAREA(Assisted-REA)��AREA�������һ�������Ⱥ��(populationΪ20,REAΪ10),��ʹ��scoreΪREA�㷨ѡ���ʼȺ��,�����㷨����:

4. Experiments

??����ʹ����CIFAR-10��CIFAR-100��ImageNet-16-120���ݼ���NAS-Bench-201�����ռ��϶Է�Ȩ�ع�����Ȩ�ع�������ѵ�����ַ��������˶Ա�,�������������ٶ�,��������������ģ�;���,�����ܶ�������������,�����������ٶ�,��������NAS�㷨���˼�������������������ͼ:

??����,������CIFAR-10���ݼ���,���Լ����㷨������NAS�㷨������ʱ��;���������һ����ֱ�۵ıȽ�,��������ͼ:

5. Core code

??���ݴ���,���ߵĺ˾����������Ϊһ����������,��ʾ�������ݵ����Ƴ̶ȡ�

# �˾���kernel matrix

inp = inp.view(inp.size(0), -1)

x = (inp > 0).float()

K = x @ x.t()

K2 = (1.-x) @ (1.-x.t())

network.K = network.K + K.cpu().numpy() + K2.cpu().numpy()

"""K��ʾ�˶�����������ͬλ�õĸ���,network.K��ʾ������������Ķ�����������ͬλ�õĸ���,Ҳ�������ƶ�"""

??Ϊ�˷���չʾ,����С��Ҳ���˾�������˿��ӻ�����,��������:

import numpy as np

import matplotlib.pyplot as plt

from matplotlib import cm, colors

def plot_confusion_matrix(data, title, cmap):

data_max = data.max()

data_min = data.min()

data = (data - data_min) / (data_max - data_min)

plt.imshow(data, interpolation='nearest', cmap=cmap)

plt.title(title)

plt.colorbar(cm.ScalarMappable(cmap=cmap))

if __name__ == '__main__':

data = np.random.randn(128, 1000)

x = np.zeros(shape=data.shape)

x[data > 0] = 1

k1 = x @ x.T

k2 = (1 - x) @ (1 - x.T)

k = k1 + k2

cmap = colors.LinearSegmentedColormap.from_list('cmap', ['#FFFFFF', '#A12741'], 256)

plot_confusion_matrix(data=k, title="kernel matrix", cmap=cmap)

# plt.savefig('kernel-matrix.png')

plt.show()

??����Դ����ʵ�ʵĺ˾���,��������˿��ӻ�����,Ч������:

??score�ļ���Ҳ�ܼ�,ʹ����numpy.linalg��������:

def hooklogdet(K, labels=None):

# ��������ʽ�ķ��ź���Ȼ����

s, ld = np.linalg.slogdet(K)

return ld

??Kendallϵ��

��

\tau

���ļ���:

from scipy import stats

tau, p = stats.kendalltau(accs_[:max(i-numnan, 1)], scores_[:max(i-numnan, 1)])

??�����л�������Jacobian����ʽ,��û�õ�:

def get_batch_jacobian(net, x, target, device, args=None):

net.zero_grad()

x.requires_grad_(True)

y, out = net(x)

y.backward(torch.ones_like(y))

jacob = x.grad.detach()

return jacob, target.detach(), y.detach(), out.detach()

??

Jacobian����ʽ,���ſɱ�����ʽ,���Ͻ���˵�����ɺ�����һ��ƫ����ɵķ���