����

���š����Ҳ��ܴ����,�ҾͲ�����������˼��,��ϵ�����»���ڴ�Python�Լ�NumPy���㴴���Լ������ѧϰ���,�ÿ������PyTorch��ʵ���Զ���

Ҫ�����������ѧϰ,���㿪ʼ�����ľ���dz���Ҫ,���Լ���������ĽǶȳ���,�����������ⲿ�걸�Ŀ��ǰ����,ʵ��������Ҫ��ģ�͡���ϵ�����µ���ּ����ͨ�������Ĺ���,�ô����ʵ�������ѧϰ�ײ�ʵ��,�����ǽ���һ����������

��ϵ�����������Ź��ں�:JavaNLP

��ƪ������,�����˽������Իع顣���ľ���ͨ��metagradʵ�����Իع顣

ʵ��ģ�ͻ���

class Module:

'''

����ģ�͵Ļ���

'''

def parameters(self) -> List[Parameter]:

parameters = []

for name, value in inspect.getmembers(self):

if isinstance(value, Parameter):

parameters.append(value)

elif isinstance(value, Module):

parameters.extend(value.parameters())

return parameters

def zero_grad(self):

for p in self.parameters():

p.zero_grad()

def __call__(self, *args, **kwargs):

return self.forward(*args, **kwargs)

def forward(self, *args, **kwargs) -> Tensor:

raise NotImplementedError

����PyTorch,����Ҳʵ��һ��ģ�͵Ļ���,���д��һЩͨ�÷������������ϡ���Ҫʵ�����ݶ����㷽����

����Parameter�Ķ�������:

class Parameter(Tensor):

def __init__(self, data: Union[Arrayable, Tensor]) -> None:

if isinstance(data, Tensor):

data = data.data

# Parameter������Ҫ�����ݶȵ�

super().__init__(data, requires_grad=True)

ParameterĬ����Ҫ�����ݶ�,��Module��parameters()����������Parameter���ȡģ�͵����в�����

ʵ�����Իع�

class Linear(Module):

r"""

�Ը���������������Ա任: :math:`y=xA^T + b`

Args:

in_features: ÿ�����������Ĵ�С

out_features: ÿ����������Ĵ�С

bias: �Ƿ���ƫ��,Ĭ�� ``True``

Shape:

- Input: `(*, H_in)` ���� `*` ��ʾ����ά��,����none,���� `H_{in} = in_features`

- Output: :math:`(*, H_out)` �������һ��ά����,����ά�ȵ���״����������ͬ,����H_out = out_features`

Attributes:

weight: ��ѧϰ��Ȩ��,��״Ϊ `(out_features, in_features)`.

bias: ��ѧϰ��ƫ��,��״ `(out_features)`.

"""

def __init__(self, in_features: int, out_features: int, bias: bool = True) -> None:

self.in_features = in_features

self.out_features = out_features

self.weight = Parameter(Tensor.empty((out_features, in_features)))

if bias:

self.bias = Parameter(Tensor.zeros(out_features))

else:

self.bias = None

self.reset_parameters()

def reset_parameters(self) -> None:

self.weight.assign(np.random.randn(self.out_features, self.in_features))

def forward(self, input: Tensor) -> Tensor:

x = input @ self.weight.T

if self.bias is not None:

x = x + self.bias

return x

�����ǵ����Իع�ģ�ͼ̳�Module,ͬʱ����Ȩ�غ�ƫ�ô�С���������ֻ��Ҫʵ��ǰ���㷨,�����ͽ������ǵ��Զ�����ȥ��ɡ�

����,���ǵ����Իع�ģ�;�ʵ������ˡ���Ϊ�����ǵ�ģ���ܹ�ѧϰ,������Ҫ������ʧ������

ʵ����ʧ����

class _Loss(Module):

'''

��ʧ�Ļ���

'''

reduction: str # none | mean | sum

def __init__(self, reduction: str = "mean") -> None:

self.reduction = reduction

�ο���PyTorch,�ۺϷ���֧�־�ֵ����͡�

ʵ�־������

class MSELoss(_Loss):

def __init__(self, reduction: str = "mean") -> None:

'''

�������

'''

super().__init__(reduction)

def forward(self, input: Tensor, target: Tensor) -> Tensor:

assert input.size == target.size, f"Using a target size ({target.size}) that is different to the input size " \

f"({input.size}). This will likely lead to incorrect results due to " \

f"broadcasting. Please ensure they have the same size."

errors = (input - target) ** 2

if self.reduction == "mean":

loss = errors.sum(keepdims=False) / len(input)

elif self.reduction == "sum":

loss = errors.sum(keepdims=False)

else:

loss = errors

return loss

�����input��ʵ��ģ�͵����,target��ʵ�����

������ʧ������,���ǻ���Ҫ�Ż����������в����Ż���

ʵ���Ż�����

class Optimizer:

def __init__(self, params: List[Parameter]) -> None:

self.params = params

def zero_grad(self) -> None:

for p in self.params:

p.zero_grad()

def step(self) -> None:

raise NotImplementedError

��������ʵ�����Ż������Ļ��ࡣ�������ʵ������ݶ��½���(SGD)��

ʵ������ݶ��½���

class SGD(Optimizer):

'''

����ݶ��½�

'''

def __init__(self, params: List[Parameter], lr: float = 1e-3) -> None:

super().__init__(params)

self.lr = lr

def step(self) -> None:

for p in self.params:

p -= p.grad * self.lr

lr��ѧϰ��,ÿ�ε���step()������в������¡�

���Իع�ʵ��

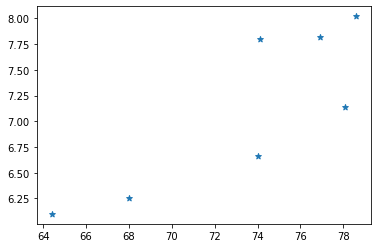

���ǻ�����ƪ�����вɼ�����������ɽ���ٽ������ڶ��ַ��۵�����Ϊ��:

# ���

areas = [64.4, 68, 74.1, 74., 76.9, 78.1, 78.6]

# �����ۼ�

prices = [6.1, 6.25, 7.8, 6.66, 7.82, 7.14, 8.02]

�����ȿ���������Ƽ�(������ָ���� ��λ:��/�O)֮��Ĺ�ϵ��

����ȥ�ƺ���һ�������Թ�ϵ����������Ŀ����������,ʵ����������ʱ���ῼ�Ƿ��䡢������ھ��롢С���ܱ���������������С���̻�������ȡ�

�������dz���ͨ����һ��ֱ��,ʹ�ø�ֱ�߾����ܺ�ÿ�������ľ�����̡�

# !pip install git+https://github.com/nlp-greyfoss/metagrad.git --upgrade

from metagrad.loss import MSELoss

from metagrad.module import Linear

from metagrad.optim import SGD

from metagrad.tensor import Tensor

model = Linear(1, 1)

optimizer = SGD(model.parameters(), lr=1e-1)

loss = MSELoss()

# ���

areas = [64.4, 68, 74.1, 74., 76.9, 78.1, 78.6]

# �����ۼ�

prices = [6.1, 6.25, 7.8, 6.66, 7.82, 7.14, 8.02]

X = Tensor(areas).reshape((-1, 1))

y = Tensor(prices).reshape((-1, 1))

epochs = 100

losses = []

for epoch in range(epochs):

l = loss(model(X), y)

optimizer.zero_grad()

l.backward()

optimizer.step()

epoch_loss = l.data

losses.append(epoch_loss)

print(f'epoch {epoch + 1}, loss {float(epoch_loss):f}')

�������ͨ�������Լ���metagradʵ�ֵ����Իع�ѧϰ����,�Dz��ǿ���ȥ����ζ�ˡ�

���:

epoch 1, loss 198.071304

epoch 2, loss 232059248.000000

epoch 3, loss 272126879727616.000000

epoch 4, loss 319112649512125988864.000000

epoch 5, loss 374211056107641585692311552.000000

epoch 6, loss 438822818730812850430760481456128.000000

epoch 7, loss inf

...

��ô��ʧ����������!?

Ī��,����ֻ��һ������,�������������������ٲ�ͬ�����⡣��ʱ,����ʾһ������AI����ʦ�ļ����ˡ�

��ʧ̫��,�������ݶ�̫����,����ֱ�ӽ�ѧϰ�ʵ�С��

optimizer = SGD(model.parameters(), lr=1e-4)

������ѧϰ��Ϊ1e-4:

epoch 1, loss 21798.214844

epoch 2, loss 153.602646

epoch 3, loss 1.260477

epoch 4, loss 0.188241

epoch 5, loss 0.180694

epoch 6, loss 0.180641

epoch 7, loss 0.180641

epoch 8, loss 0.180641

epoch 9, loss 0.180641

epoch 10, loss 0.180641

epoch 11, loss 0.180641

epoch 12, loss 0.180640

...

epoch 99, loss 0.180638

epoch 100, loss 0.180638

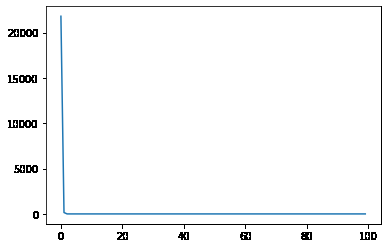

��������Կ���,��4�ε�����,��ʧ��һֱ������,���ǿ�һ��ѧϰ������:

���ǿ��Դ�ӡ���õ��IJ���:

> w, b = model.weight.data.item(),model.bias.data.item()

> print(f'w: {w}, b:{b}')

w: 0.09660441144108287, b:0.026999891111711846

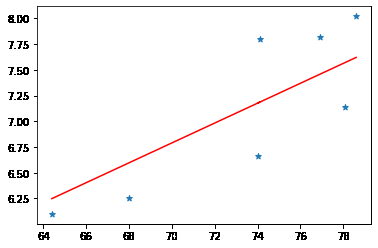

Ȼ�����Իع���ϵ�ֱ��:

����ȥ������,�����Ҫ�Ļ�,��������ֱ������ķ��ӡ�

�����������ѵ������,�õ�������ʧΪ 0.18 0.18 0.18,�����ܷ�ʹ���ٴν�����?

һ�ַ������ռ����������,��һ�ַ������������е�ά�ȡ����ǻ���һ������ά��û�����á���������ӽ�����

# ���

> areas = [64.4, 68, 74.1, 74., 76.9, 78.1, 78.6]

# ����

> ages = [31, 21, 19, 24, 17, 16, 17]

> X = np.stack([areas, ages]).T

> print(X)

array([[64.4, 31. ],

[68. , 21. ],

[74.1, 19. ],

[74. , 24. ],

[76.9, 17. ],

[78.1, 16. ],

[78.6, 17. ]])

��1�������,��2���Ƿ���,ÿ�����ݴ���һ��������

�������Ǹ�д��������Իع����,�ٴ�ѵ��һ�����Իع�ģ��:

model = Linear(2, 1) # in_features: 2 out_features: 1

optimizer = SGD(model.parameters(), lr=1e-4)

loss = MSELoss()

# ���

areas = [64.4, 68, 74.1, 74., 76.9, 78.1, 78.6]

# ����

ages = [31, 21, 19, 24, 17, 16, 17]

X = np.stack([areas, ages]).T

# �����ۼ�

prices = [6.1, 6.25, 7.8, 6.66, 7.82, 7.14, 8.02]

X = Tensor(X)

y = Tensor(prices).reshape((-1, 1))

epochs = 1000

losses = []

for epoch in range(epochs):

l = loss(model(X), y)

optimizer.zero_grad()

l.backward()

optimizer.step()

epoch_loss = l.data

losses.append(epoch_loss)

if (epoch+1) % 20 == 0:

print(f'epoch {epoch + 1}, loss {float(epoch_loss):f}')

���:

epoch 20, loss 10.742877

epoch 40, loss 8.136241

epoch 60, loss 6.171517

epoch 80, loss 4.690628

epoch 100, loss 3.574423

epoch 120, loss 2.733095

epoch 140, loss 2.098954

epoch 160, loss 1.620976

epoch 180, loss 1.260706

epoch 200, loss 0.989156

epoch 220, loss 0.784478

epoch 240, loss 0.630204

epoch 260, loss 0.513921

epoch 280, loss 0.426275

...

epoch 1000, loss 0.158022

���Ϸ�����Ϣ,���տ���ʹ��ʧ�½��� 0.15 0.15 0.15����������һ�´�ʱ��Ȩ�غ�ƫ��:

> w, b = model.weight.data,model.bias.data.item()

> print(f'w: {w}, b:{b}')

w: [[ 0.10354146 -0.02362296]], b:-0.00232952055510911

���Կ���,����������Ӧ��Ȩ��Ϊ ? 0.023 -0.023 ?0.023,����˵����Խ��,���ӵļ�ֵ��ԽС,��һ��ϵ����ѧ���˵ġ�

���ǵ�ѵ������7������,�������̫����,������ռ����������,һ�����Ի�ø��õ�Ч����

��������

������������ϴ����˳���Ա�������վ��ȥ��,��ַ: 👉 https://github.com/nlp-greyfoss/metagrad

�ܽ�

��������ͨ��metagradʵ�������Իع�,�Լ�һЩ���������ƪ�������Ǿ���ѧϰ���ع顣