ǰ��

??����һ�ݹ��ڸ�֪��ģ�͵Ľ���,��֪����Ϊ������Ļ���,����Ҫ�̶��ǿ����֪�ġ���֪������������Ļ���ѧϰ�㷨,��ʵ�ֵ��Ѷ�ȴ���Ǻܴ�֪������һ�������б�ģ��,����ͨ������ռ��������ʵ������Ϊ����������������֪���ַ�Ϊԭʼ��ʽ�Ͷ�ż��ʽ,������Ҫ��ϸ����ԭʼ��ʽ��

һ����֪��ģ��

??��֪��,��һ��ר�Ž�����Կɷ���������Է������������ع���һƪ������,�������ҵ�һ�����ʵ�ֱ��,�Ӷ��ܹ������������ݡ������е�˼���뱾����ѧ�ĸ�֪�������Ƶ�,ֻ�������ع���һ������ģ��,�������õ��������Ϊ1�ĸ����Ƕ���,Ȼ���ʴ���0.5����������Ϊ���1,������С��0.5����������Ϊ���2,�������ǻ��õ���Sigmoid�������ڸ�֪��ģ����,����ͬ����Ҳ���ҵ�һ��ֱ��,ʹ�ø�ֱ���ܹ������Ľ�������������������Ҫ�õ�������ĸ������,���ԳƸ�֪��Ϊһ���б�ģ�͡�

��ô��������ܸ���һ��ֱ���ܹ�������������жϳ�����?

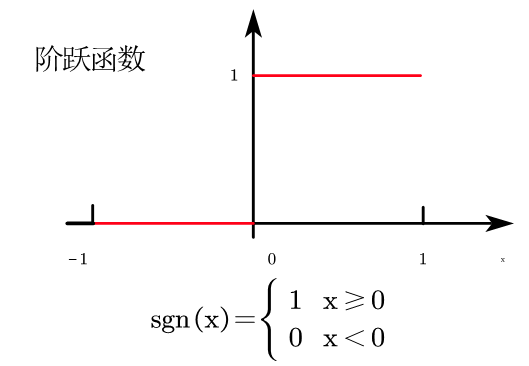

�������Ҫ����һ���µĺ���:��Ծ������

��Ծ��������ʽ����:

s

n

g

(

x

)

=

{

1

x

��

0

0

x

<

0

sng(x)=\begin{cases} 1 & x \ge0 \\ 0 & x<0 \\ \end{cases}

sng(x)={10?x��0x<0?

��Ծ������ͼ������:

����ǽ�Ծ������ͼ��,����Ҫ�ҵ���֪����ģ������:

f

(

x

)

=

s

g

n

(

w

?

x

+

b

)

f(x)=sgn(w\cdot x+b)

f(x)=sgn(w?x+b)

??

w

w

w��

b

b

bΪ��֪��ģ�Ͳ���,

w

w

w����Ȩֵ,

b

b

b����ƫ��,

w

?

x

w\cdot x

w?x�����ڻ������ǵ��������ͨ�����������ݼ��ҵ����ʵIJ���

w

w

w��

b

b

b,ע��,��֪�����������һ�������Կɷ����ݼ�,���������Բ��ɷ����ݼ��ĸ�֪����������ġ�

������֪��ѧϰ����

??��Ȼ�Ѿ�֪����֪����ģ����ʲô����,��ô���Ǹ����������ģ�͵ı���ʽ��?�����ع���,�Ѽ�����Ȼ������Ϊ��ʧ�������Ż�ģ��,��ô�ڱ����и���ʲô������Ϊ��ʧ������?��֪������ʧ������ʵ��Ҫ������˼·,һ����������ĸ�����Ϊ��ʧ����,����������ĸ������Dz��� w w w�� b b b�������ɵ�����,�����Ż�����ô��һ�����Ծ����������㵽��ƽ����ܾ�����Ϊ��ʧ������

1.��ʧ����

??�����֪��ģ�͵ij�ƽ�溯��Ϊ

w

?

x

+

b

w\cdot x+b

w?x+b,��ô������������ĵ�

i

i

i,��������

x

i

x_i

xi?����ƽ��ľ�����Ա�ʾΪ:

�O

w

?

x

+

b

�O

��

w

��

\frac{\left|w\cdot x+b\right|}{\left\|{w}\right\|}

��w���Ow?x+b�O?

����

��

w

��

\left\|{w}\right\|

��w����ʾ

w

w

w�Ķ�������

??���������ĵ�,����õ���ʵ����1��,��

y

i

=

1

y_i=1

yi?=1,����ͨ����֪��ģ��ѧϰ�õ�

w

?

x

i

+

b

<

0

w\cdot x_i+b<0

w?xi?+b<0,���Ƕ��ڷ������ĵ���˵:

y

i

(

w

?

x

i

+

b

)

<

0

y_i(w\cdot x_i+b)<0

yi?(w?xi?+b)<0

�������ʽ�����������ʵ

y

i

=

1

y_i=1

yi?=1����

y

i

=

?

1

y_i=-1

yi?=?1����������������õġ�

��һ���õ�:

?

y

i

(

w

?

x

i

+

b

)

>

0

-y_i(w\cdot x_i+b)>0

?yi?(w?xi?+b)>0

Ҳ�dz����ġ�������ǿ��Եõ�,������

x

i

x_i

xi?����ƽ��ľ���Ϊ:

?

1

��

w

��

y

i

(

w

?

x

i

+

b

)

-\frac{1}{\left\|{w}\right\|}y_i(w\cdot x_i+b)

?��w��1?yi?(w?xi?+b)

����ÿ�ε��������з������ĵ㲻ֹһ��,������������ĵ㼯��Ϊ

M

M

M,��õ����з������ĵ㵽��ƽ����ܾ���Ϊ:

?

1

��

w

��

��

x

i

��

M

y

i

(

w

?

x

i

+

b

)

-\frac{1}{\left\|{w}\right\|} \sum\limits_{x_i\in M} { y_i(w\cdot x_i+b)}

?��w��1?xi?��M��?yi?(w?xi?+b)

������

1

��

w

��

\frac{1}{\left\|{w}\right\|}

��w��1?,���ܵõ���֪��ѧϰ����ʧ������

??�������Կ���,�����ʧ������ֵӦ���ǷǸ���,���ǿ�����Ϊ������ʧ������Сʱ,��Ӧ�IJ���

w

w

w��

b

b

b�������ŵġ�

�ݶ��½����Ż�����

??����һ���������Ƶ�����֪������ʧ����,��һ����Ҫ�Ը�֪������ʧ���������Ż�,��ѧģ������:

min ? w , b L ( w , b ) = ? �� x i �� M y i ( w ? x i + b ) \min\limits_{w,b}L(w,b)=-\sum\limits_{x_i\in M}{y_i(w\cdot x_i+b)} w,bmin?L(w,b)=?xi?��M��?yi?(w?xi?+b)

����

M

M

MΪ������ļ��ϡ�

??��֪��ѧϰ�㷨��ͨ�������������,��������е㶼��������ȷ,ѧϰֹͣ��ʵ�ֹ��̲��õ�������ݶ��½��������������ʼ������

w

0

w_0

w0?��

b

0

b_0

b0?,Ȼ�����ݶ��½������ϵؼ�С��Ŀ�꺯��,����������ݶ��½���,�������ݶ��½���ֻ��Ҫѡȡһ������������ݶ��½�����ʵ�ֹ����п��Խ���whileѭ��,ÿ��whileѭ����ʹ��forѭ����������������,������������������ʱ,ֱ�Ӿ�ʹ���������������������ݶ��½�,Ȼ������forѭ��,���forѭ�����������������δ����������,������whileѭ��,ѧϰ������

��Ȼ��ʹ���ݶ��½������Ż�����,��ô����������ʧ����

L

(

w

,

b

)

L(w,b)

L(w,b)���ݶ�:

?

w

L

(

w

,

b

)

=

?

��

x

i

��

M

y

i

x

i

\nabla_wL(w,b)=-\sum\limits_{x_i\in M}{y_ix_i}

?w?L(w,b)=?xi?��M��?yi?xi?

?

b

L

(

w

,

b

)

=

?

��

x

i

��

M

y

i

\nabla_b L(w,b)=-\sum\limits_{x_i\in M}{y_i}

?b?L(w,b)=?xi?��M��?yi?

������ѡ��һ�������������

(

x

i

,

y

i

)

(x_i,y_i)

(xi?,yi?),��

w

,

b

w,b

w,b�����:

w

��

w

+

��

y

i

x

i

w \leftarrow w + \eta {y_i}{x_i}

w��w+��yi?xi?

b

��

b

+

��

y

i

b \leftarrow b + \eta {y_i}

b��b+��yi?

ʽ���е�

��

\eta

���Dz���,�ֳ�Ϊѧϰ��(�ݶ��½����н��ܹ�),�������ǾͿ��Բ��ϵ�����ʧ����

L

(

w

,

b

)

L(w,b)

L(w,b),ֱ�����е������㶼��������ȷ,��ʱ����ʧ����ֵӦ��Ϊ0��

�����㷨ʵ��

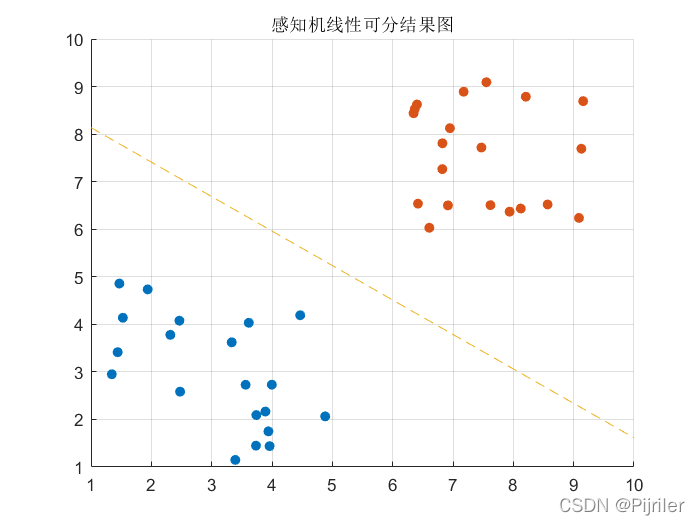

??���ڸ�֪��ģ�����Ķ������Կɷ�����,���������Բ���Matlabʵ�ָ�֪���㷨��

��������:

%% ��֪��

clc,clear

tic

% �����ʼ������

random = unifrnd(1,5,40,2);

X = [random(1:20,:);random(21:40,:)+5];

scatter(X(1:20,1),X(1:20,2),'o','filled')

hold on

scatter(X(21:40,1),X(21:40,2),'o','filled')

y = [zeros(20,1)-1;ones(20,1)]; % y��ǩ

learn_rate = 0.01; % ����ѧϰ��

% ��֪���������Է���

w = [0,0];b = 0; % ��ʼ������

while flag ~= length(X)

flag = 0;

for i =1:length(X) % ��������������

if y(i)*(w*X(i,:)'+b) <= 0 % �����������ڷ�������

w = w + learn_rate * y(i) * X(i,:); % ���²���

b = b + learn_rate * y(i); % ���²���

break; % ����ѭ��

else

flag = flag + 1;

end

end

end

% ������ӻ�

k = -w(1)/w(2); % ���

b = -b/w(2); % ��ϵ��

n = 1:1:10;

m = k*n+b;

hold on

plot(n,m,'--')

toc

�������:

??���Է���,��֪�������ս����ʵ����һ��ֱ��,����ֱ�߿�����ȫ���������Կɷ����ݽ��з���,���������ʼֵѡȡ��ͬʱ,��֪����ѧϰ���Ҳ�Dz�һ����,�����кܶ���ֱ�ߡ�

�ܽ�

??��֪��ģ�ͼ���,����ģ���ڽ�����Բ��ɷ�����ʱ���Ե�����Щ,����������Բ��ɷ����ݵķ�������,���Բ���֧��������SVM����⡣