1. Luong attention机制:Attention原理简析

Attention机制总是这样三个步骤的框架:

每个方式的不同在于每一个步骤内用到的计算方式。

2. LSTM机制: LSTM这一篇就够了

3. 神经网络:

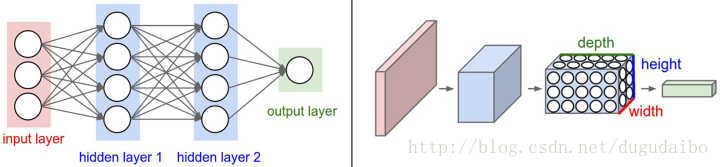

(1) 全连接神经网络(DNN):

一个DNN结构只有一个输入层,一个输出层,输入层和输出层之间的都是隐藏层。

每一层神经网络有若干神经元,层与层之间神经元相互连接,层内神经元互不连接,而且下一层神经元连接上一层所有的神经元。

隐藏层比较多(>2)的神经网络叫做深度神经网络(DNN的网络层数不包括输入层)。

DropOut:

参考链接:全连接网络DNN

(2)卷积神经网络(CNN):

与DNN不同:上一层每个神经元不再和下一层每个神经元都连接。

卷积神经网络主要由这几类层构成:输入层、卷积层,ReLU层、池化(Pooling)层和全连接层(全连接层和常规神经网络中的一样)。

通常在连续的卷积层之间会周期性地插入一个池化层。它的作用是逐渐降低数据体的空间尺寸,这样的话就能减少网络中参数的数量,使得计算资源耗费变少,也能有效控制过拟合。汇聚层使用 MAX 操作,对输入数据体的每一个深度切片独立进行操作,改变它的空间尺寸。

最常见的形式是汇聚层使用尺寸2x2的滤波器,以步长为2来对每个深度切片进行降采样,将其中75%的激活信息都丢掉。每个MAX操作是从4个数字中取最大值(也就是在深度切片中某个2x2的区域),深度保持不变。

参考链接:卷积神经网络(CNN)详解

(3)循环神经网络(RNN:Recurrent Neural Network)

神经网络可以当做是能够拟合任意函数的黑盒子,只要训练数据足够,给定特定的x,就能得到希望的y。

相比于DNN和CNN:前两者的输出y至于当下的x有关,RNN当下输出的y与现在的x、之前的经验x都有关系。

(4)对RNN优化,改进短期记忆问题――>LSTM机制

LSTM 的核心概念在于细胞状态以及“门”结构。 细胞状态相当于信息传输的路径,让信息能在序列连中传递下去。你可以将其看作网络的“记忆”。理论上讲,细胞状态能够将序列处理过程中的相关信息一直传递下去。

因此,即使是较早时间步长的信息也能携带到较后时间步长的细胞中来,这克服了短时记忆的影响。信息的添加和移除我们通过“门”结构来实现,“门”结构在训练过程中会去学习该保存或遗忘哪些信息。

门结构中包含着 sigmoid 激活函数。Sigmoid 激活函数与 tanh 函数类似,不同之处在于 sigmoid 是把值压缩到 0~1 之间而不是 -1~1 之间。 这样的设置有助于更新或忘记信息,因为任何数乘以 0 都得 0,这部分信息就会剔除掉。同样的,任何数乘以 1 都得到它本身,这部分信息就会完美地保存下来。这样网络就能了解哪些数据是需要遗忘,哪些数据是需要保存。

LSTM 有三种类型的门结构:遗忘门、输入门和输出门。

- 遗忘门: 决定应丢弃或保留哪些信息。来自前一个隐藏状态的信息和当前输入的信息同时传递到 sigmoid 函数中去,输出值介于 0 和 1 之间,越接近 0 意味着越应该丢弃,越接近 1 意味着越应该保留。

- 输入门: 用于更新细胞状态。首先将前一层隐藏状态的信息和当前输入的信息传递到 sigmoid 函数中去。将值调整到 0~1 之间来决定要更新哪些信息。0 表示不重要,1 表示重要。

- 输出门: 用来确定下一个隐藏状态的值,隐藏状态包含了先前输入的信息。首先,我们将前一个隐藏状态和当前输入传递到 sigmoid 函数中,然后将新得到的细胞状态传递给 tanh 函数。

最后将 tanh 的输出与 sigmoid 的输出相乘,以确定隐藏状态应携带的信息。再将隐藏状态作为当前细胞的输出,把新的细胞状态和新的隐藏状态传递到下一个时间步长中去。

其次还要将前一层隐藏状态的信息和当前输入的信息传递到 tanh 函数中去,创造一个新的侯选值向量。最后将 sigmoid 的输出值与 tanh 的输出值相乘,sigmoid 的输出值将决定 tanh 的输出值中哪些信息是重要且需要保留下来的。

参考链接:LSTM这一篇就够了

(5) 递归神经网络(RNN:Recursive Neural Network)

- 因为神经网络的输入层单元个数是固定的,因此必须用循环或者递归的方式来处理长度可变的输入。

循环神经网络实现了前者,通过将长度不定的输入分割为等长度的小块,然后再依次的输入到网络中,从而实现了神经网络对变长输入的处理。

一个典型的例子是,当我们处理一句话的时候,我们可以把一句话看作是词组成的序列,然后,每次向循环神经网络输入一个词,如此循环直至整句话输入完毕,循环神经网络将产生对应的输出。

如此,我们就能处理任意长度的句子了。

“两个外语学院的学生。”

这句话有歧义,不同的语法解析树则对应了不同的意思:

(1)一个是『两个外语学院的/学生』,也就是学生可能有许多,但他们来自于两所外语学校;

(2)另一个是『两个/外语学院的学生』,也就是只有两个学生,他们是外语学院的。

为了能够让模型区分出两个不同的意思,我们的模型必须能够按照树结构去处理信息,而不是序列,这就是递归神经网络的作用。

- 递归神经网络可以把一个树/图结构信息编码为一个向量,也就是把信息映射到一个语义向量空间中。

这个语义向量空间满足某类性质,比如语义相似的向量距离更近。也就是说,如果两句话(尽管内容不同)它的意思是相似的,那么把它们分别编码后的两个向量的距离也相近;反之,如果两句话的意思截然不同,那么编码后向量的距离则很远。

参考链接:零基础入门深度学习(7):递归神经网络

4. 激活函数:(sigmoid函数和tanh函数)

激活函数的作用是为了增加神经网络模型的非线性。

否则没有激活函数的每层都相当于矩阵相乘。就算你叠加了若干层之后,无非还是个矩阵相乘罢了。所以没有非线性结构的话,根本就算不上什么神经网络。

5.注意力机制:

(1) 自注意力机制 能够学习到当前词和句中先前词之前的关联性。

(2)”柔性“ vs ”刚性“是如何定义注意力的另一种方式――基于注意力是否需要处整篇图片还是仅仅局部一小块:

- 柔性注意力:对齐权重通过源图片所有的”patch“进行学习映射。

Pro: 模型是平滑且可导的

Con: 当输入图片很大时,训练代价很高 - 刚性注意力:每次仅选取图片中一个”patch“

Pro: 在inference阶段计算量更小

Con: 模型是不可导的,需要更复杂的技术手段――如降低方差(variance reduction)或者强化学习去训练

(3)全局注意力和柔性注意力很相似;局部注意力是”柔性“和”刚性“的糅合――相对于刚性,改进使其可导:模型首先预测当前目标词的粗略对齐位置,然后在这个源输入的位置上应用一个中心窗口框住,计算上下文向量。