ѧϰ���:

?🌱 ��ʱ10��,ѧϰ�˲����ݶȡ��ӻ������ʼ,��Gradient��PG (REINFORCE��Q Actor-Critic��Advantage Actor-Critic)��Natural PG��TRPO��PPO?�ݽ�ѧϰ

🌱 ��1���µ�ѧϰ,����RL������ǰ��DL (ƫ�ض�ij��dataset��һ���õ�NN structure) ��̫һ��,�����������Ƶ�,���漰����ѧ����

🌱 ���ij��ֵ���ѧ����,�����������Ƶ�ÿһ��,�⻨���Һܶ�ʱ�䡣�����淢��������Ҫ,�����ڴ�NPG��TRPOʱ

🌱 ȫ�Ĺ�1.3w��,��������д�ʼǡ������������,��ӭָ��

������ɫ:

🌟 ѭ��,�� Gradient �� Policy Gradient?�� Natural Policy Gradient �� TRPO �� PPO �ݽ�ʽ��ϰ,��ʵ����

🌟 �Ӹ�����ϸ��,����һҶ��Ŀ����дTRPOʱ,�����ܽ�����Ŀ�꺯�����ݶȸ��� (����NPG) ������ĸĽ�,�������ϸ���Ƶ�,���TRPO���� "Trust Region Algorithm" ����������

🌟 ���漰������ѧ�����дע��,����������ƫ�������������ݶȡ����ʷֲ�����Ϣ����ѧ���������Ρ�KL divergence���ء���Ϣ����Fisher����Hessian����Jacobi����Lagrange Multiplier Method��Importance Sampling��MM�㷨��Conjugate Gradient��Trust Region��30����ѧ����

🌟 ������д�ʼ�,������

🌟 ǰ������:ǿ��ѧϰ���űʼ� | UCL silver RL | UC Berkely cs285

Ŀ¼:

🌻?Gradient

🌴?����Policy Objective Function

🌵?MC Policy Gradient (REINFORCE)

🌵?Q Actor-Critic Policy Gradient

🌵?Advantage Actor-Critic Policy Gradient

🌻?TRPO

🌵?Ŀ�꺯��

🌵?�ݶȸ���

🌻?PPO

🌴?PPO1:Adaptive KL Penalty Coefficient

🌵?����

🌵?α����

🌴?PPO2:Clipped Surrogate Objective

🌵?����

🌵?α����

Gradient

��һϵ�з������ǻ����ݶȵġ���ϰ���ݶȸ���,��д����

Poliy Gradient

����Policy Objective Function

����,����һ�²���Ŀ�꺯��

���Policy Gradient

��ô��Policy Objective Function��һ��Policy Gradient:

�Ƶ�����������Ĺ�ʽ��,���ֶ����ж�����ʹ��ͬһ����Ȩ (����trajectory��reward),����Ȼ�����ʡ�

��ζ�ÿ�����������ò�ͬ�ļ�Ȩ��?

����Ȼ���뵽,����ʹ�ôӴ˶���֮���reward (�����������ɵĺ���ж��),��������trajectory��reward(�����ж����ۼ�������Ч���ж��),�����REINFORCE��˼����,����

MC Policy Gradient (REINFORCE)

REINFORCE�㷨��α��������:

Q Actor-Critic Policy Gradient

?REINFORCE�㷨Ҳ�е�����,����Ƚϴ�,����������ƫ��������:

�Ƚ�һ��ʹ��MC������REINFORCE�㷨��ʹ��TD������Q Actor-Critic�㷨,����ͼ:

Advantage Actor-Critic Policy Gradient

Q Actor-Critic���ܴ�������һ������:

����������ʱ,�еĶ������ܲ��ᱻȡ��������ʱ�������������Ķ�����Q�������ġ�

�����Ļ�,������Q��Ȩ��,���������Ķ����ĸ����ڵ����л�����,δ���������Ķ����ĸ����ڵ����лή��(��Ϊ���ʺ�Ϊ1)��

�Ⲣ��������Exploration,����δ���������Ķ����ı���δ�ز��á�

����,������Ҫ "��" �Ľ���,�� "��Ժ�",ֱ�ӵ�˼·��������baseline��Ϊ "��" �� "����" �Ļ���

��Ͳ�����Advantage Function (���ƺ���) �ĸ���,,�����V(s)���ǻ���

ֱ��������һ��,Q����״̬s�¶���a�ĺû�,V��״̬s�ĺû� (��ʵV(s)������Q(s,a)������)��

��ô���Q>V,����˵��ǰ������ʹ��ǰ״̬����,������Ǻõġ����Q<V,����˵��ǰ����ʹ�õ�ǰ״̬����,������Dz�ġ�

��ʹ��A��Ȩ����ʱ,���A>0,�������������Ժõ�,��ö����ĸ����ڵ����лᱻ���;���A<0,�������������Բ��,��ö����ĸ����ڵ����лᱻ���͡�

����,һ�㽫Q��V��ʾ����ʾVʱ,����ʹ��TD��MC��������,һ��ʹ��TD����,TD(0)��n-step TD�����ԡ�

��TD(0)��,,��

����,S'ΪS�ĺ��״̬

��n-step TD��,,��

����,S'ΪS�ĺ��״̬

��Advantage Actor-Critic�㷨�IJ����ݶȱ�ʾΪ,

����Policy Gradient������ʽ

��ô����ܽ�һ�������ݶȼ���,һ������ݶ������¼��ֱ�����ʽ:

?��"��"��ԭ�����ò�����������,���������������ʾֱ����"="������

��ʵ֮ǰһֱ�е��ɻ�,���ר�J(��)��ʾ�����ݶ�,���Ǩ�log��(a|s)�Dz����ݶȡ���������������,��J(��)��ʵ���Ǩ�log��(a|s)����Ȩ�ذ�,��Ҫ�Ļ��Ǩ�log��(a|s)��ʾ�����IJ������·���

һ���ܽ�ø�ȫ���:

ͼȡ��?GAE����?��?

Natural Policy Gradient

1998 - Armani - Why Natural Gradient?

1998 - Armani - Natural Gradient Works Efficiently in Learning

2002 - Kakade - A Natural Policy Gradient

�����ݶ��½���,�����Ż�����:

���������ʽ�ĺ�����������һ���ײ���ʵ:J(��)�ı仯���Ͳ����仯����ͬһ��Euclid�ռ��ж�����

Ϊʲô����˵��?��Ϊ��J(��)�Ǧȵı仯��,���仯��������

�����仯����Ȼ��Euclid�ռ��ж���,�����ںܶ�������,J(��)�ı仯�������ʺ���ŷ�Ͽռ��ж��������統ģ��Ϊ,�����ʷֲ�ģ�͡�

��ʱ,�ֲ������������仯

�����Ǹ������Ա仯�ĺ���������

��(a|s) ����һ�ָ��ʷֲ�ģ��,������log��(a|s)ʱ��,��ŷ�Ͽռ��е�"�仯��"�ĸ���,��ʹ��ŷʽ��������仯,����ʾ�½��ķ���̫����,��Ҫ��һ�ָ������Ա仯�������ı�������

Ϊʲô˵��(a|s) ��һ�ָ��ʷֲ�ģ��?

����stochastic policy,ָstate�¿��Բ�ȡ��ͬaction�������������ʱ�ʾ,��������ڸ�state�²�ȡ��ͬaction�ĸ��ʡ������stochastic policy,��Vanilla/Nature PG,REINFORCE,Natural Actor-Critic.

ΪʲôҪ���������?��һ������,������ (agent) վ�������ſ�(state),���ж�����ǰ�ߵĸ�����0.7,���/��/���ߵĸ��ʸ���0.1,��ôpolicy�����ѡ���ҽ�������action(���ʴ�ı�ѡ���Ŀ����Դ�)������agent���������ƶ�����

������κ����ֲ���

�ĸ������Ծ���?

����Ϣ������,���Խ����ʷֲ�ģ��ȫ����Ϊ�����ռ��е�һ����������,����ʹ��KL-divergence�������ֲ��ĸ������Ծ���,��ʱFisher Information Matrix���������ε�Riemann������

����仰�ļ�������(��Ϣ����ѧ���������Ρ�KL-divergence��Fisher Information Matrix)����һ��:

��Ϣ����ѧ��һ���������λ��߸���һ�������������о����ʷֲ���ѧ�ơ���Ҫ��˼������Fisher information��Ϊ������������һ����������,���ʷֲ���parameter�������������,Ҳ��˵����������ο����Ǹ����ܶȺ������ڵĿռ�

���� (Manifold) ������Ϊ��һ��Լ����ij�� (һά���ά) �������п���״̬�ļ���,�������� Nʵ�������ĵ㼯�ϡ��Ӿֲ�(��ÿ���������)����,���κ�ŷ�Ͽռ�û��ʲô��ͬ,�����εľֲ�����ŷʽ�ռ����ʡ����Ǵ���������,���ο�����ij��"����"�Ŀռ�,��"ƽֱ"��ŷ�Ͽռ䲢����ͬ��

����,�������ε�һ������(��������Ӻú�Ʒһ�¾ֲ���������ƽֱ��ŷ�Ͽռ�,ȫ�ֿ���������,��仰��ʲô��˼),�����ϵ�����һ������ά����һ�������Ρ�

��ʵ��Manifold�����,manifold = many fold,�����ɺܶ����Ƭ�湹�ɡ���Ҳ���Կ����ܶ��Բ����ɵ�ѽ,���Դ��ּ��νǶ�,���������ص���chart�Ĺ⻬���� (��������κ�һ��С�ľֲ�������ŷ����¿ռ�,��Ϊһ��chart)��

��ŷ�Ͽռ���,�����ľ���Ϊ,

����������������,�����ľ�����"����"(��ȻҪ����ŷ�Ͽռ��еľ���)������Ϊ

������,

��һ�������α�����㶨��ĶԳ���������,��ΪRiemann����,���������Ծ���Ԫ�Ľ�����������Riemann�����������γ�Ϊ��������(Riemann Manifold)

��������,���Բο���?���?,���?���ӡ����������Ҳ���˺þ�,��Ҫ�������⡣

������չ:

���λ���һ��������˼�ĵ�,���������ŷ�Ͽռ�� "��ά",�����ͱ�ʾ�IJ�������:

��һ���㼯��,ÿ���㶼��10��ʵ������,�ܷѱ�ī,���Ըı�������,��ÿһ����ֻ��9��ʵ��������?�������,�ͽ�������9ά�� һ���㼯��,��Ϳ��Խ�����ά��?

ѡһ��, ��ע��������100���ڵ�,����Щ����9��ʵ������������Ա�ʾ�����Ͻ�,�ǵ��Զ,���Ǿ�˵��Щ����Խ���9ά�� Զ����ѡ1��,��ע���ڵ�,�ٲ�����άһ�Ρ���˶�κ�,ԭ���Ϸֽ�ɶ���Ӽ��ϲ���ÿһ������ά,���Ǿ�˵ԭ���Ͽ��Խ���9ά��

�ٸ�����,��ŷʽ�ռ���,����һ����,

,Ҫ������ӵķ���ʽ���������ռ���,����һ����,R=r���ˡ��Dz��Ǿͼ���?�о����ο��Լ�һЩ���ӵ���ѧ����ɡ�

�ٲ�һ������˼�ĵ�,�����ռ��е�Natural Gradient�Ǹ������صġ���ŷ�Ͽռ��е�Gradient�Ǹ�����ϵѡȡ�йص�,ʹ�ü�������������ݶȺ���������ϵ��������ݶȲ�����ͬ������Ҳ������NN��gradient vanish����,���NN��Natural Gradient Descent��û�����⡣

KL-divergence��ʵ��������ذ��������ض��첻?�����ؾ���������Ƶ�������,�����ǰѳ�����ȥ���˶��ѡ�

��Ϣ��

,p(x_0)����x_0�����ĸ��ʡ���Ϣ����ȷ���Գɷ��ȡ�����,˵"����������",ȷ���Ժܸ�,��Ϣ����С�����������˵"���������",ȷ���Ե���,��Ϣ������,��Ϊ��ʱ��Ҫȥ������Ԥ����������ʲô�������ۺ϶��꾭���ж�������Ԥ��Ԥ�������

�ؾ�����Ϣ��������,

������ֱ���ΪKL-divergence��"�����",�����ں����������ʷֲ�����Բ��졣

,����q��p�ж�����ML��,һ��p����ʵ��,q�ǽ���ֵ,������q�ж�ƽ�p���ǿ�ģ����ϵúò��á�

�������չ����,

,ȥ��ǰ��ij�����,����������ǽ���������

������

Fisher Information Matrix (��ѩ��Ϣ����):��������������Ϣ�����١����Fisher�ܴ�,˵���۲�����Я��ģ�Ͳ������Ƶ���Ϣ���ܴ�,˵���ܽ��������Ƶø�ȷ,�������������Fisher������Ϊscore function (log likelihood�ĵ���)�ķ���,��

,Ҳ������Ϊlog likelihood��Hessian����������ĸ�ֵ,��

,������ѧ���忴�����Fisher scoring:��Hessian����Fisher����,��Ϊ��ʱ��Fisher�������һЩ������

����

�ٿ�����Hessian:

��ʵ�ٲ�Hessian�����ʱ��,��˳��������Jacobi����(���Ǹ�����ûʲô��ϵ):

���ʷֲ���һ�������ռ�,KLɢ���Ǹ÷ֲ��ռ�Ķ���,��FIM�����˸÷ֲ��ռ�ľֲ�����

KL-div�ܹ����õغ����������Լ�ľ��롣ʹ��KL-div�Բ��Խ���Լ��,�ܹ�ʹ����������֮�䲻Ҫ���̫��ͨ��KLԼ��,����˴�ͳ�ݶ��㷨�е�"ѧϰ��"��"�ݶȷ���"(���Կռ��ϵ�) �����⡣

KL-div����Natural Policy Gradient������Ҫ����TRPO��PPO��������������Ҫ�����á���Ҫ��������

��ʹ��KL-div����Լ��ʱ,���Թ涨,���涨�������Եĸ��ʷֲ�֮�����Ϊ��(һ������),�����е�ʽԼ����

��Ȼ,����ʽԼ��Ҳ���ԡ���������Ҫ�����KKT������ͬ���ˡ�

ʹ��Lagrange���ӷ�,��KL-divԼ������Ŀ�꺯��,������Ż�������

����,

����,G(��)��Fisher Information Matrix,��

�������ճ��ӷ��ǽ�Լ���������뵽Ŀ�꺯����,ֱ�Ӷ�Ŀ�꺯���������ˡ�

������ô�Ƶ���

,���������д�ˡ���ϸ���Կ�?���,���Ƕ�KL-div����̩�ն�������ʵ��

�����������ճ��ӷ�����:

������

������,

�õ�:?

Ҫ��ֵ,���������

���,��

�˲���Ҫ,���ϵ�������������ȡ����Ҫ���Ƿ���!

��Dz�������ѱ䶯����Ϊ,��������Ȼ�ݶ�Natural Gradient��

�ٻ���һ��,Natural Gradient��ʵ���ǶԲ��Լ�����KL-divԼ������������ݶȷ���

��ʹ��Natural Gradient�IJ������·���Ϊ:

,

����,,G(��)��Fisher����(����������Ҳϲ����F����I����Fisher����)

������ݶ�����,������ǼӺ���

���ڦ����:

Ϊʲô���ݶȵĸ��·����б����˦����ѧϰ����?����KL-div�Ѿ����������շ�ת����Ŀ�귽������?��ʵ��Ҳ���ɻ�

�ҵ�������,�����ȵı仯������ŷ�Ͽռ��ж�����,J(��)�ı仯�����������ռ��ж����ġ�Ҳ����parameter space��policy space������һ���ռ䡣ѧϰ�ʦ�����parameter�ռ��еĶ���,��G^{-1}��policy space�ռ��еĶ��������������Ҳ����KL-div��������ġ������Ǽ�һ��"˫�ر���"�����

���ߴ�����һ���Ƕ�,Natural Gradient������ŷ�Ͽռ���,��ʵ���������һ��"����",ֻ�����������ȴ�ͳgradient��ʾ�ø���,����ʱ"����"����Ҫ����"����"��

����Ҳ��������ɦ���һ��Ȩ�ذ�

Natural PG �������ռ���������steepest ascent direction,��ʹ��FIM�����λ����,��һ�ֲ��Լ����ĸ��õĶ�����ʽ��

����ڴ�ͳPG�ĶԳ��Φ��������С��������߾��Ҳ���,NPG���������ڳ���,�������������ƽ����

����TRPO��NPG�Ļ�����,������IS����Ŀ�꺯��,һ�β���������ڸ��²���,�����sample efficiency

TRPO

2015 - John Schulman - Trust Region Policy Optimization

TRPO���ĸ���

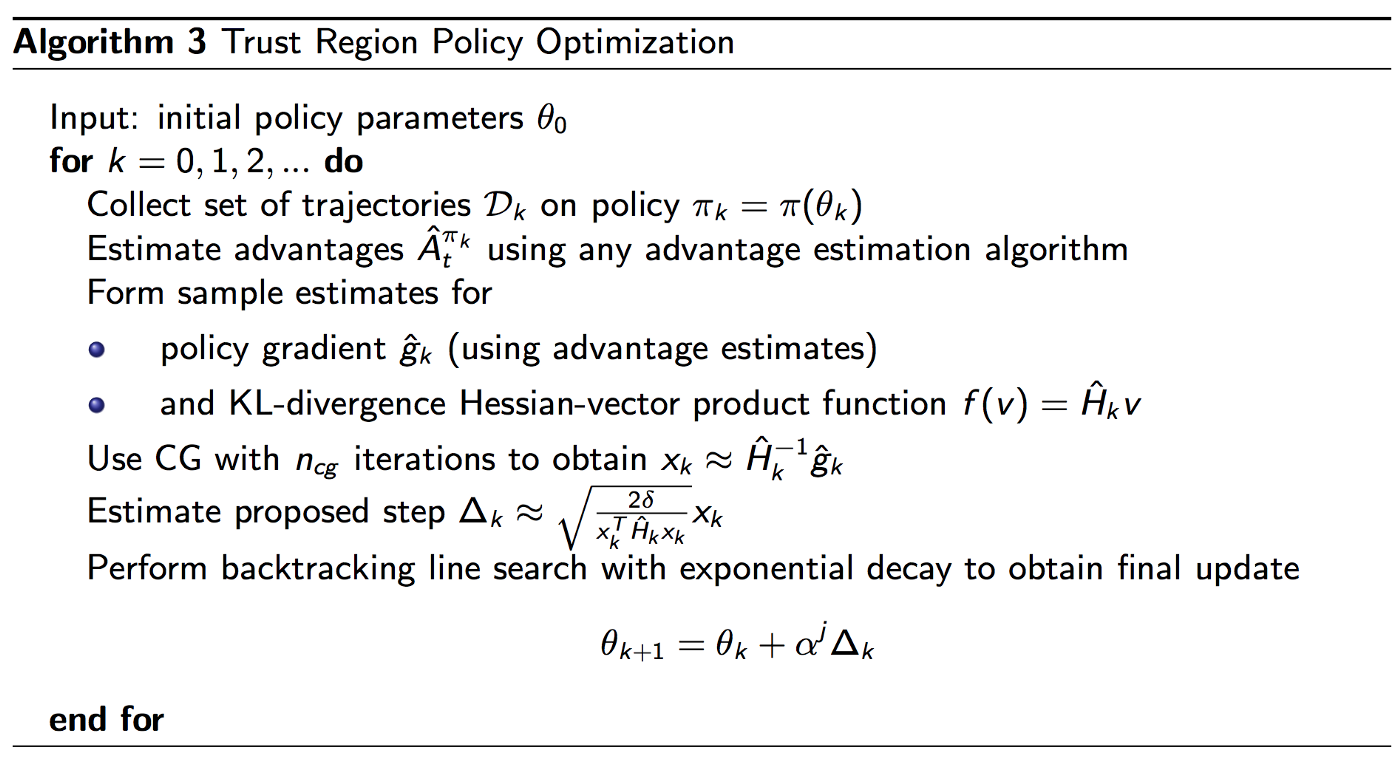

TRPO (Trust Region Policy Optimization),������������Ż���

TRPO�ֱ���Ŀ�꺯�����ݶȸ������������˸Ľ�

�ݶȸ��·���ĸĽ�

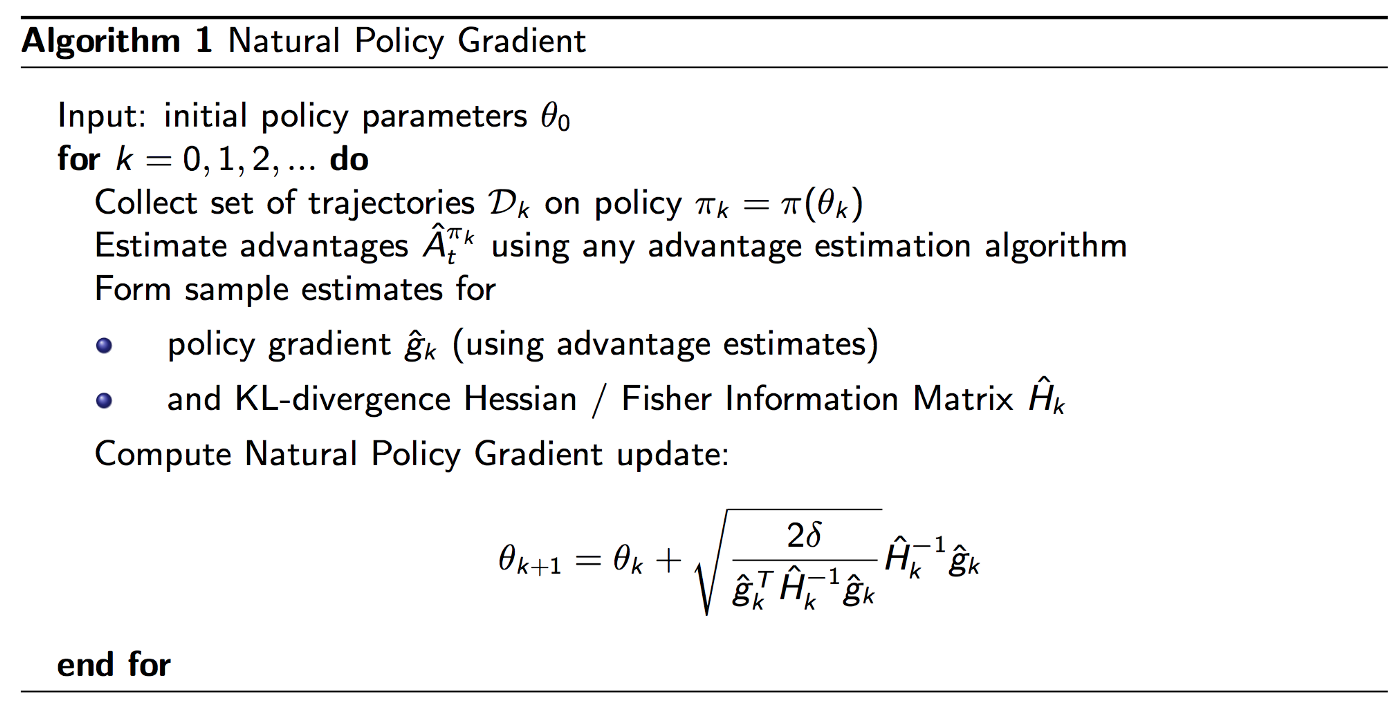

TRPO����Natural Policy Gradient (����KL divergenceԼ��policy,����policy���ҵ���),������������Ľ�:

��һ��,Ϊ������⸴�ӵ�Fisher/Hessian������,ʹ����conjugate gradient

�ڶ���,��ѧϰ������ ��^j?* NPGԭʼ��ѧϰ��,����(0,1),�ɴ���С��������ʹĿ�꺯������0 (�����ε������ϴκ�),�ҷ���KL divergence?����С����jֵ (��ֹ̩��չ�����������)

����ԭ�Ľ���,"TRPO is related to prior methods(e.g.natural policy gradient) but make several changes,most notably by using a fixed KL divergence rather than a fixed penalty coeffificient"?

Ŀ�꺯������ĸĽ�

��Ŀ�꺯��������Importance Sampling,������sample efficiency (ԭ��ÿ�β������ֻ�ܸ�i����һ���ݶȾͰ������ӵ�������IS��,���Զ��ʹ�æ�'�����õ����ݸ��¦�,��ʹ��һ�����ݽ��ж��gradient ascent)��

����һ������˼����,���߽��µ�expeted disconted reward�����������,���ɵ�reward+ijһ���֡�˼����,���,���������,"ijһ����"��Ϊ��,��reward�ǵ���������,��ÿ�β��Զ���֮ǰ�ĺá�

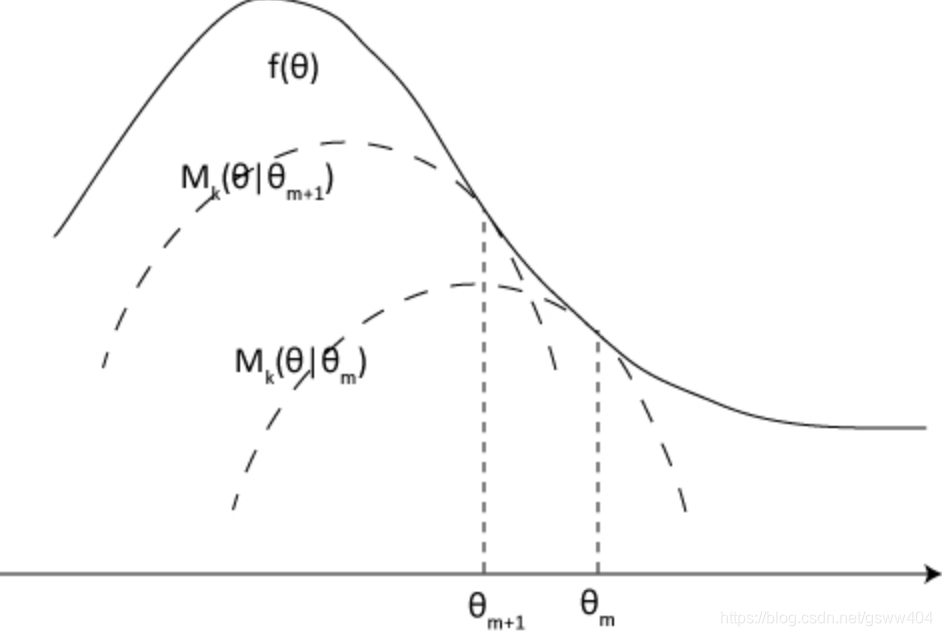

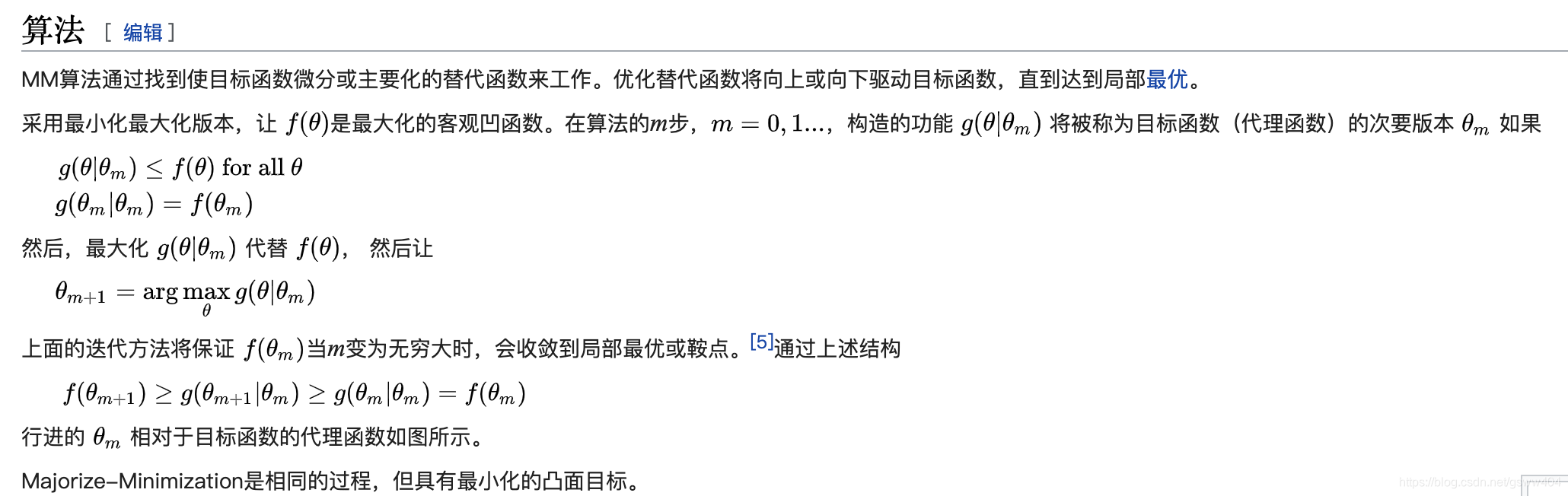

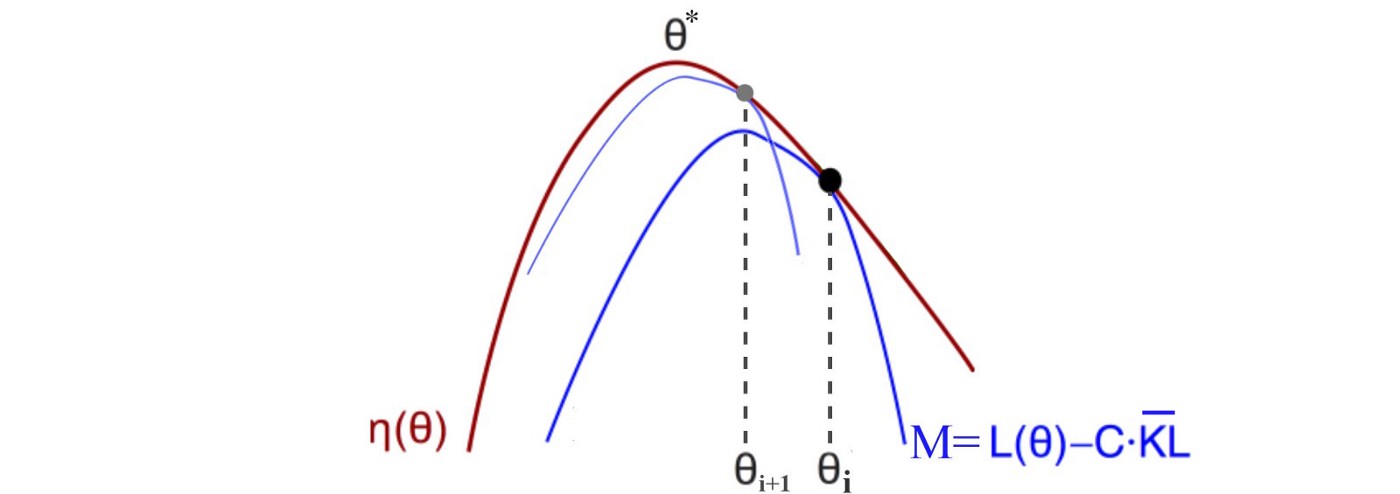

��֮���һ�������,���Ƶ�surrogate function�Ĺ�����,����ʹ����MM�㷨,������Ŀ�꺯�����½���Ϊsurrogate function

ע��,һ��Ҫ��ǰ���Natural Policy Gradient�������˽���ܿ�TRPO,�������ijЩϸ�ڴ����Ի���ΪTRPO�������в�û�ж���Ȼ�ݶ��кܶ�ƪ���Ľ���,����Ҫ������Ȼ�ݶȵ�����֪ʶ,�����ж�TRPO

TRPO�Ƶ�ϸ��

��ô��TRPO������ϸ������һ��

Ŀ�꺯��

���Ƶ���Ŀ�꺯��

����˵TRPO����������������е��ɻ�ġ���ԭ�ĵ�ʱ��,����˵�Ĵ����˼�����ʹ��deterministic policy�Ļ�,ȷʵ�ܱ�֤��������,��Ϊ

,ֻҪ��һ��state-action�Ե�Advantage Function����0,�ͻ�ѡ����(��Ȼ�������0�Ķ�Ļ���ѡ����),��Ϊdeterminstic policy��̰���ġ����ǵ���AdvantageΪ0,������action����һ������,�������ɹ�,ֹͣ�ˡ�������˵,��Ϊ"unavoidable estimation and approximation error",Ҳ���ܳ���

��������о�����Ϊ�����ͽ�ģ��̫ȷ��?���Ǹ�stochastic policy�й�ϵ?

��֮,ʵ����,��һ���ܱ�֤�²��Ե�reward���ɲ��Ե�rewardһ������0,����˵���ܱ�֤һֱ�����������������ߵ�ȷ�����뵥��������˼�������Ŀ�꺯����(�����Ǵ���ʻ�һֱ��������,ż���½�?�����е��ɻ�)

����ʵ����trust region algorithm��ͼ,ȡ��?��ƪ?,�������õ����

MM (Minorize-Maximization)

MM�㷨��һ�������Ż�,��������������,�Ա��ҵ����ǵ����ֵ����Сֵ,ȡ����������Ż����������С����MM���������㷨,����������ι����Ż��㷨��

Importance Sampling��Ҫ�Բ���:

?����,�����賿�������,���������,�����Ӱ�

ps:�����ﻹ��һ��,��˵KL div��max̫������,��sampling��ƽ���ˡ����ﲻ�ӽ�ȥ��,ֻ����ϸ��,���ǹؼ���,�´���Ƶ�˼·

����,Ŀ�꺯���Ƶ�������!����Ϳ��Լ���natural gradient,Ȼ���ݶ������ˡ�����һpart�����ݶȸ���˼·һ����

(���Ǻ���α������,�����õ�advantage value)

��ʵ��Ӧ����,��������ƽ��ֵ��ʾ����,�������ᵽ�����ֲ�������:

����vine sampling�е�rollout,��ƪ?���͵�������������vine sampling��,"trunk" �ǻغϸ��µ�,�� "brank" �ǵ������µ�

"The vine method gives much better estimates of the advantage values. But the vine method must perform far more calls to the simulator for each these advantage estimates."

"The vine method requires us to generate multiple trajectories from each state in the rollout set ,which limits this algorithm to setting where the system can be reset to an arbitrary state. In contrast,the single path algorithm requires no state reset?and can be directly implemented on a physical system."

�ݶȸ���

�����������ݶȵĸ��·���

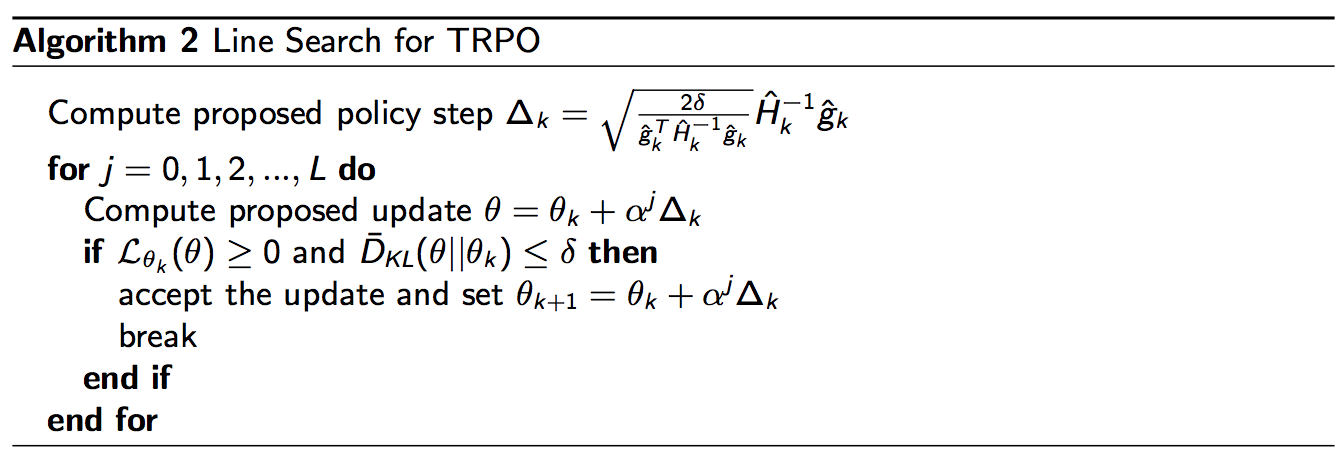

���Ȱ���Natural Policy Gradient���Ƶ�����,���ǵõ����¸��·���:

��ΪĿ�꺯���������reward,�������ݶ�����Ŷ

TRPO��������Ľ�

��һ,ʹ��conjugate gradient (CG) ������⸴�ӵ�Hessian / Fisher����������

CG (�����ݶȷ�):

��ͼ,��ͨ���ݶ������������dz���ȫ�����Ž�ǰ����,�м���ܻ�����ݶȵ������������Ŀ�꺯���Ƕ��κ���,���ǿ���ʹ�ù����ݶȷ��������ֵ�����������������������,������������Dz����ĸ�����

ps:CG��Ŀ�꺯���Ƕ����ͺ�����������һ������Ժ���,����ͨ��̩�ն�������תΪ���ƶ�����

�����ڸ�¼C��ϸ������CG,����ʵ��ó���ѵ�������Ϊ10�ȡ���ϸϸ�ڼ�����

��ƪ?������������

������ƪ�������ù����ݶȷ�������Ż����⡷:?

���,TRPO��ѧϰ�ʻ��� ��^j * NPGԭʼ��ѧϰ��,����(0,1),j��{0,1,2...},�ɴ���С����������С��jʹ������"improvement of the surrogate objective and satisfaction of the KL divergence constraint".

���ָ��������^j��ͼ��ֱ������һ����仰����˼:

�Ӵ���С����ʹ��Ŀ�꺯������������KL div����Сj,��ʱ���^j���,��ʵ������ԭ����NPGѧϰ��ǰ����˸�(0,1)��ϵ��,���Ǽ�ϣ������������ϣ����Ҫ��NPG�ı�̫��,������"���"�����1��ϵ��,ʹNPG�������䡣

�����ڸ�¼C������line search�����е�ʹ��,ϸ�ڼ�����

"Starting with the maximal value of the step length ��(��NPG�������ԭʼѧϰ��)" in the previous paragraph,we shrink �� exponentially (ָ����,����^j) until the objective improves.

"With this line search,the algorithm occasionally computes large steps that cause a catastrophic degradation of performance"

�о�line search����trust region�����ð�,ͨ�����������������TRPO��KL div�ŵ�Լ������dzͷ��������

����Natrual Gradient Algorithm��TRPO��α����Ա���:

TRPO��KL div������Լ������,���dzͷ���,ԭ���Ǧĺõ�,C���õ���̫���忴?��ƪ,��ƪ?��Ҳ�ᵽ����һ��

����TRPO����ϸ��α����:

Trust Region

����,����ܽ���Trust Region Policy Optimization�е� "Trust Region" �� "Trust Region Algorithm"?(��ֵ�Ż�����ľ����㷨)

������ʲô�� "Trust Reigon"

����ʲô��Trust Region,�ٿ��� Trust Region Algorithm��������

��������,"approximation" �� "maximization"��

����һ��TRPO����������,���������ѭ�������,�����Է�Ϊ������,Ȼ������:

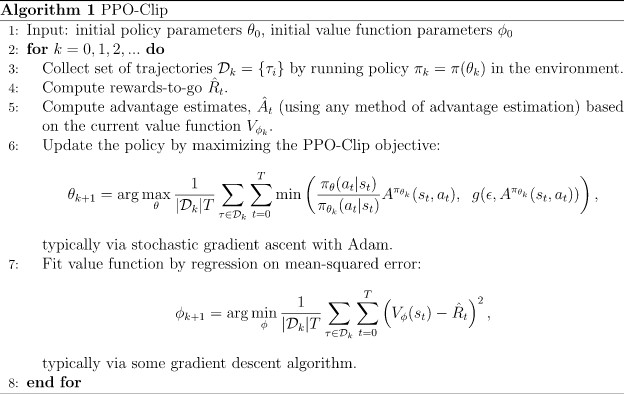

PPO

2017 - John Schulman - Proximal Policy Optimization Algorithms

PPO���ĸ���

PPOͬ����OpenAI����Ʒ,����TRPO��һ�����ߡ�PPO������TRPO�ĺ���˼��,������IS���sample efficiency��Լ���������Լ���첻Ҫ����

�������TRPO,PPO�����������ⷽʽ,�����˼��㸴�Ӷ�,��ʵ�ʹ������õø���

�ڹ���������,һ���ֱ����,��С��������DQN��Ϊbaseline (�����Ͽ졢����ѵ��),�ϴϸ��ӵ�������PPO��Ϊbaseline (Ч���Ϻ�)

PPO������version,�������������ֻ����������,PPO1��PPO2

PPO1:TRPO֮���Խ�KL div�ŵ�Լ������dzͷ�����,������Ϊ�������ѵ���PPO1��KL div�ŵ�Լ������,����Ӧ�ض�̬����KLǰ�IJ���,����Ϊ "Adaptive KL Penalty Coefficient"

PPO2:PPO2ͬ����ʹ�������Լ���첻Ҫ����,����δʹ��KLԼ��,����ͨ��clip,���������¾ɲ��Ա�ֵ�ķ�Χ

ʵ����,PPO2��Ч��ǿ��PPO1

��ʵ��NPG��TRPO�Ļ�����,PPO�ͺܺ������ˡ�PPO��TRPO��ͬ�IJ��ֽ���������

PPO1:Adaptive KL Penalty Coefficient

"The theory justifying TRPO actually suggests using a penalty instead of a constraint".����ΪȨ�ئ����Ե���������,TRPOû��ѡ��KL div��Ϊ�ͷ���ŵ�Ŀ�꺯�����������Լ������,���ǽ�KL div��Ϊhard constraint����

��PPO1��KL div�ŵ�Լ������:

��ôKL divǰ���Ȩ�����������?

"Experiments show that it is not sufficient to simply choose a fixed penalty cofficient �� and optimize the penalized objective with SGD.Additional modifications are required��.���趨һ��Ȩ��ֵ����ʵ���б��ֲ���

����PPO1��ʹ��������Ӧ����Ȩ�ئµķ���

����

����������һ���ɽ��ܵ�KL div���ֵ???�Ϳɽ��ܵ�KL div��Сֵ?

���һ���Ż����,KL div̫��,��˵������ijͷ���??û�з�������,�������

���һ���Ż����,KL div̫С,��˵������ijͷ�����Ч��̫ǿ��,����ֻ�Ż��˺�һ��,�ⲻ��������Ҫ��,���С��

��ʱ,��С��;

ʱ,�����

���

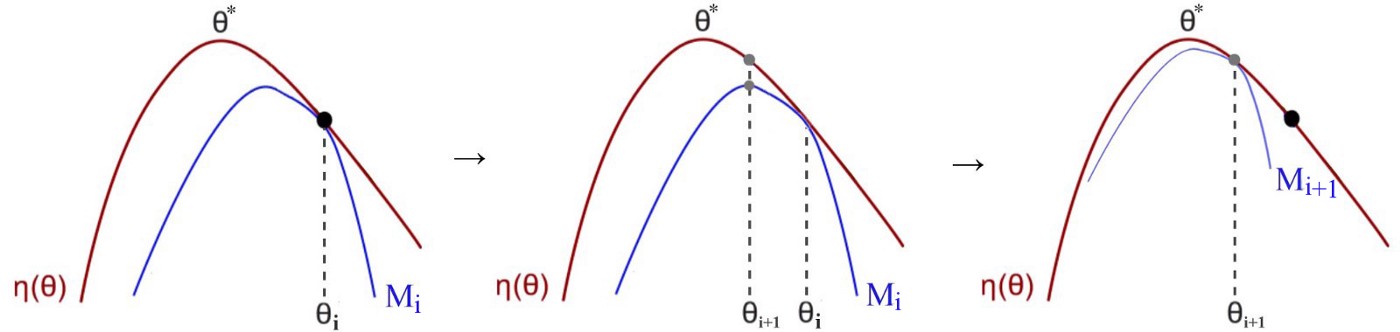

PPO2:Clipped Surrogate Objective

���ȶ������¾ɲ��Լ�ı�ֵr(��),��Lд��

����

PPO2��main objectiveΪ:

min����:������ʽ�Ӽ�ȡ��Сֵ

clip����:

�����=2,��clip����Ϊ,

����<0.8,�����0.8;��

>1.2,�����1.2;��

��[0.8,1.2],�ü�,�վ����

�����ͱ�֤���¾ɲ��Եı�ֵ������ [0.8,1.2] ��,���������Բ��������̫��

PPO����һ���Ż������Ƶ���ʽ,���TRPO�еĶ����Ż�,ʹ��CLIP���渴�ӵ�KL div����,ͬ��ʹ���������Լ���첻̫��

PPO2��Ƶú�����Ļ���һ��,������clip���������

���������İ������������ "��Ժ�" ��ʱ��,

>0;��������� "��Բ�" ��ʱ��,

<0

��ô�ٴ�����min�������,�ͻ�������������˼��Ч��:

ʵ��̫����,�Ҿ��Լ����û���,��IJ���������ͼ,��min��A��������

�ļ���ͦ������,���Ǹ����������������ͼ��ɫ��̫һ��,A<0ʱ��������Ҳû��������ע�����:?

?����,

����ɫ����,

����ɫ���ߡ���ɫ����minȡ�IJ���ȡ����A������

ֱ��������,��A>0,����state-action����Ժõ�,��ϣ���������state-action�ĸ���,�����ֲ�������̫����̫��,��ǰ��������̫��,��������������ô���1+��

��A<0,����state-action����Բ��,��ϣ����С���state-action�ø���,�����ֲ��ܼ�С̫��ʹ��̫С,��ǰ��������̫��,���������������С��1-��

���һЩ��������,PPO2����objective:

?��quared-error,��ʾΪ

,S��entropy bonus

����entropy bonus:

"If using a neural network architecture that shares parameters between the policy and value function, we must use a loss function that combines the policy surrogate and a value function error term. This objective can further be augmented by adding an entropy bonus to ensure sufficient exploration, as suggested in past work [Wil92; Mni+16]"

����,����advantage value�õ���GAE (Generalized Advantage Estimator):

���

PPO�㷨�Ĵ�������,ֻ��Ҫ��VPG����������С�ĸĶ�,����Ŀ�꺯������,����ÿ�θ���ʱ�Ը�objective����ݶ���������

ACѵ������:

ÿ�ֵ�����,���п�N��Actor (��') �뻷������,����N������ΪT��trajectory,�����ռ�NT������

ʹ��GAE����advantage value,��action probabilityһ�����buffer

��buffer�в���M (Minibatch Size)������,ѵ��K��epoch (K��ʵ��һ���������ô���)

OpenAI baseline�е�һ��������,K = 3,Minibatch Size = NT / 4,��һ�ֵ�����,ͨ��?SGD,��������12��