аДдкЧАУц:жЎЧАбЇЯАЕФЖМЪЧМђЕЅЕФдЄВтЮЪЬт,ЩцМАЕФКЏЪ§ЪЧвЛЮЌЯпадКЏЪ§,дкБОНкФкШнжа,вЊПЊЪМНщЩмЩдЮЂИДдгвЛЕуЕФЩёОЭјТчСЫ,ВЮЪ§wВЛдйЪЧ1Иі,ЖјЪЧКмЖрИі!

1 ЬнЖШЯТНЕв§Шы

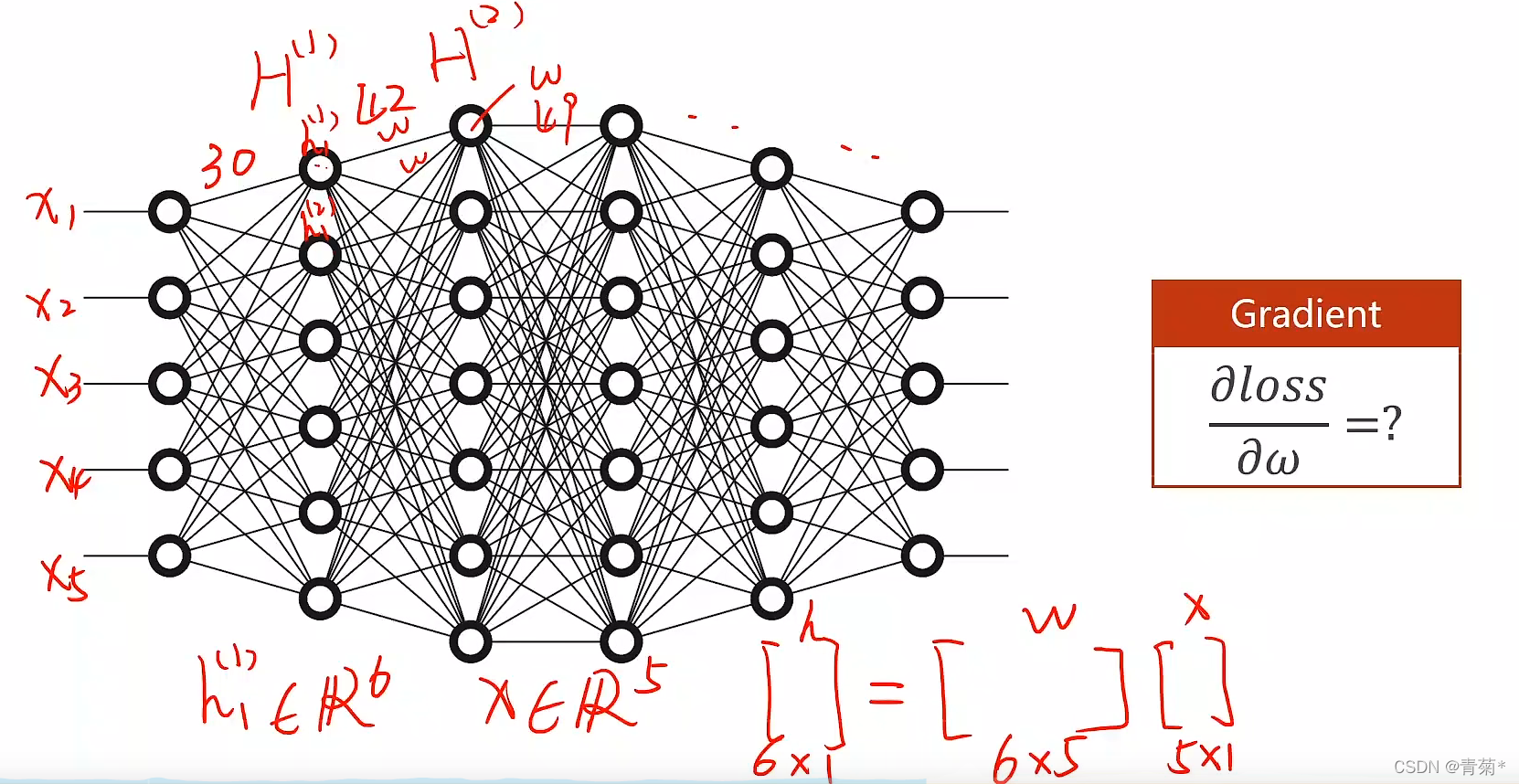

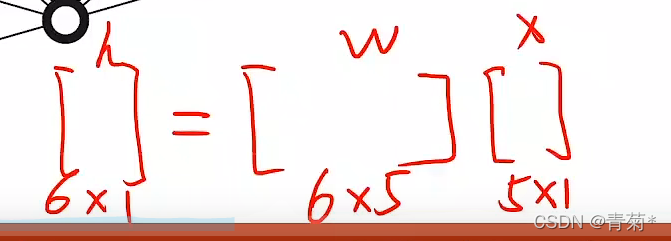

- дкЕквЛСаЕФЮхИідВШІКЭСљИідВШІжЎМф,ЮвУЧПЩвдПДЕНга30ЬѕЯпЁЃЕквЛСаЕФЮхИідВШІБэЪО51ЕФЪфШыx,ЕкЖўСаБэЪОЕквЛВуЕФ61ЪфГі,ФЧУДжаМф

- КмЯдШЛЪЧвЛИі6*5ЕФШЈжиОиеѓЁЃвВОЭЪЧЫЕ,етРявЛЙВга30ИіВЮЪ§ЁЃ

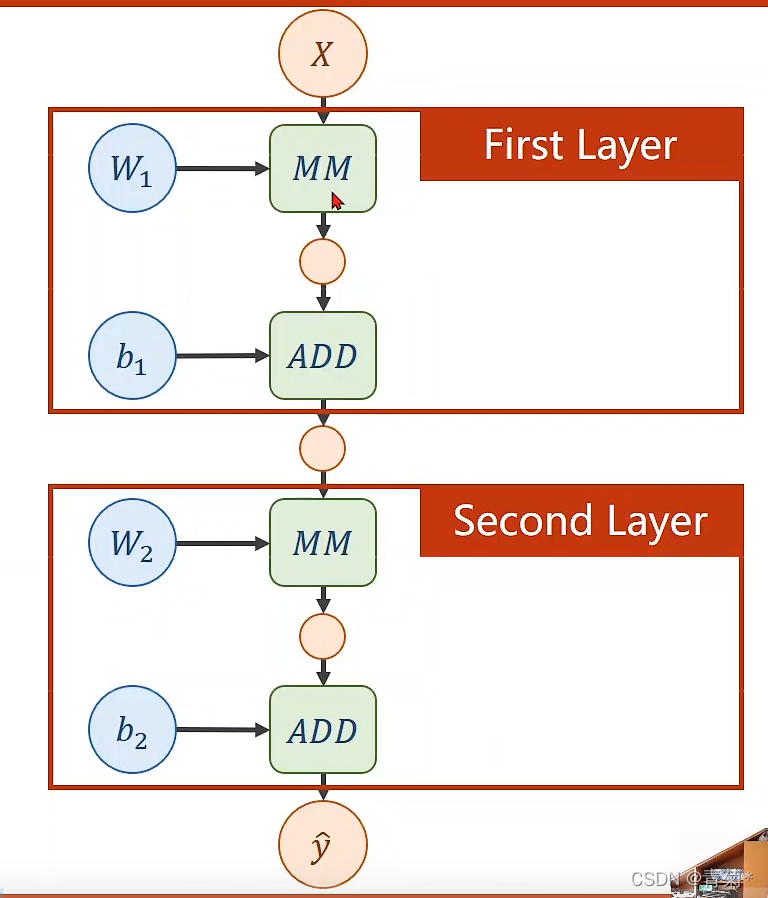

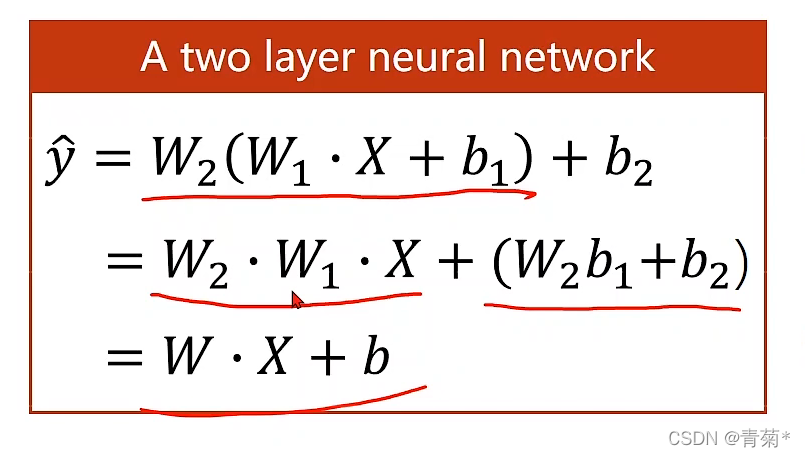

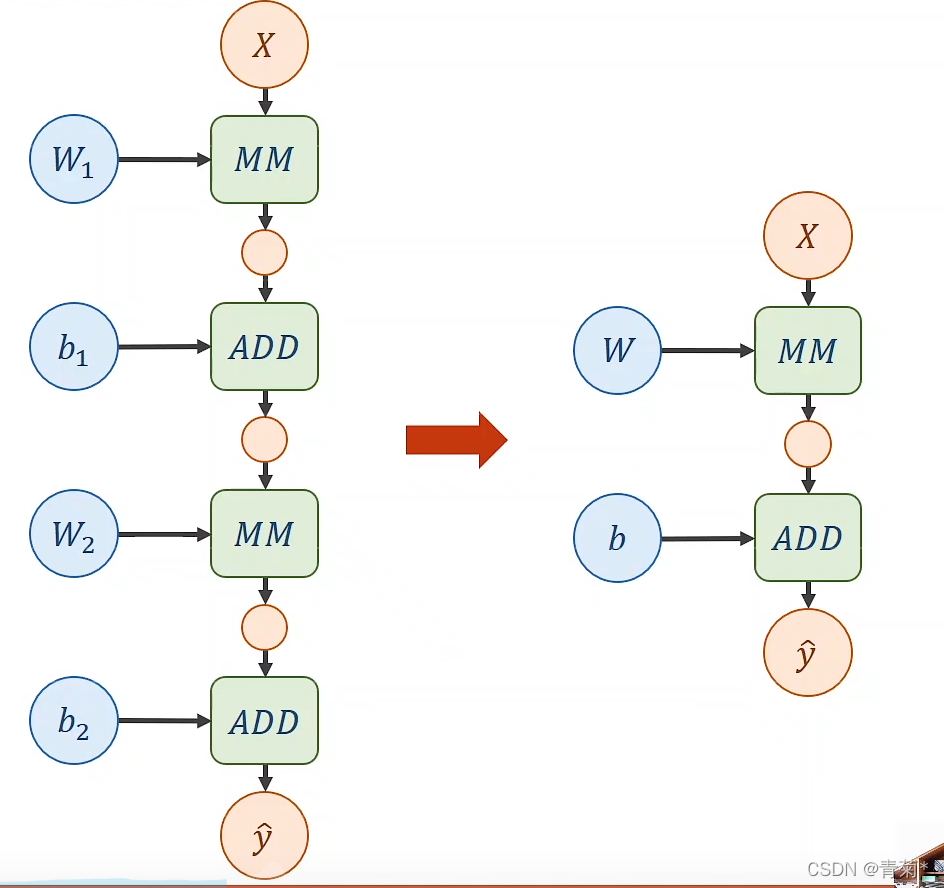

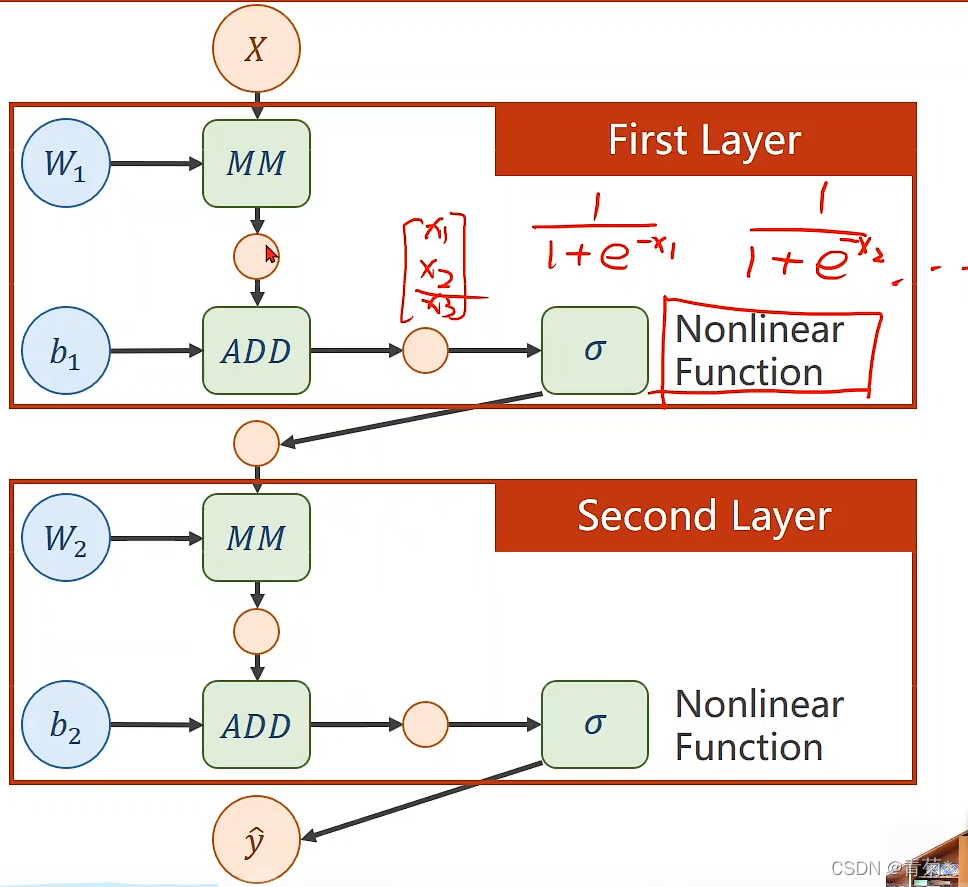

ЪЧЗёФмзіетбљвЛИіЫуЗЈ,НЋећИіЭјТчПДГЩвЛИіМЦЫуЭМ,ПЩвддкМЦЫуЭМЩЯДЋВЅЬнЖШ,зюКѓИљОнСДЪНЗЈдђАбЬнЖШЧѓГіРД,етжжЫуЗЈФи,ОЭПЩвдГЦжЎЮЊЗДЯђДЋВЅЫуЗЈЁЃ

2 МЦЫуЭМ

- Цфжа,MMБэЪООиеѓГЫЗЈЁЃ

- ЕЋЪЧ,ЖдгкетбљЕФСНВужБНгЪфШыЪфГіЕФЭјТчВуРДЫЕ,АДееЩЯЭМЕФЗНЪНПЩвдНјааЛЏМђ,ВЂзюжеПЩвдЛЏМђЕУЕНвЛИіЯпадВуЁЃ(Ыљвд,етСНВуЭъШЋУЛгавтвх,ЦфЪЕОЭЪЧЯрЕБгквЛВу)

- вђДЫ,ЮвУЧОЭвЊдкЕквЛВуНсЪјжЎКѓ,МгвЛИіЗЧЯпадЕФКЏЪ§ЁЃШчЯТЭМЫљЪОЁЃ

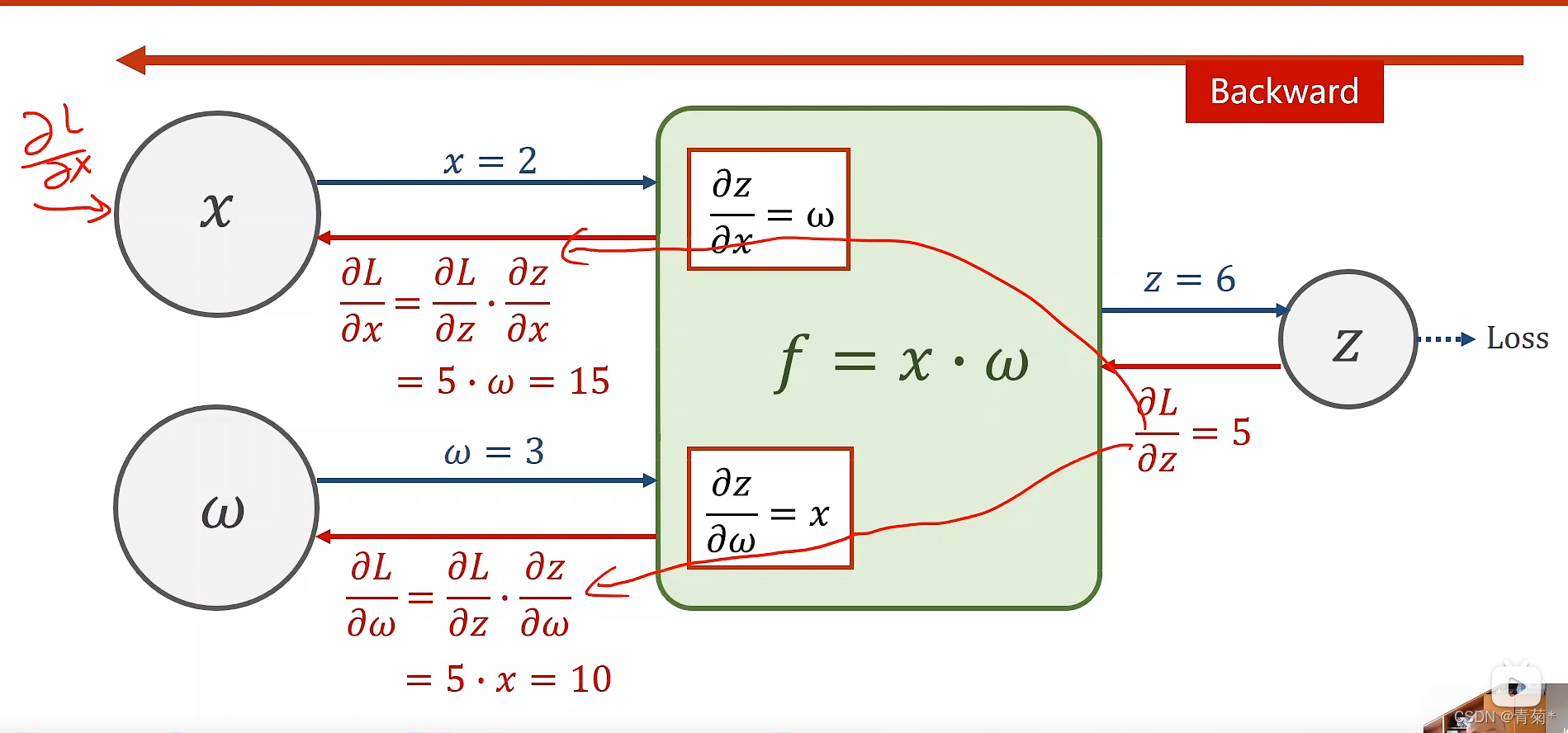

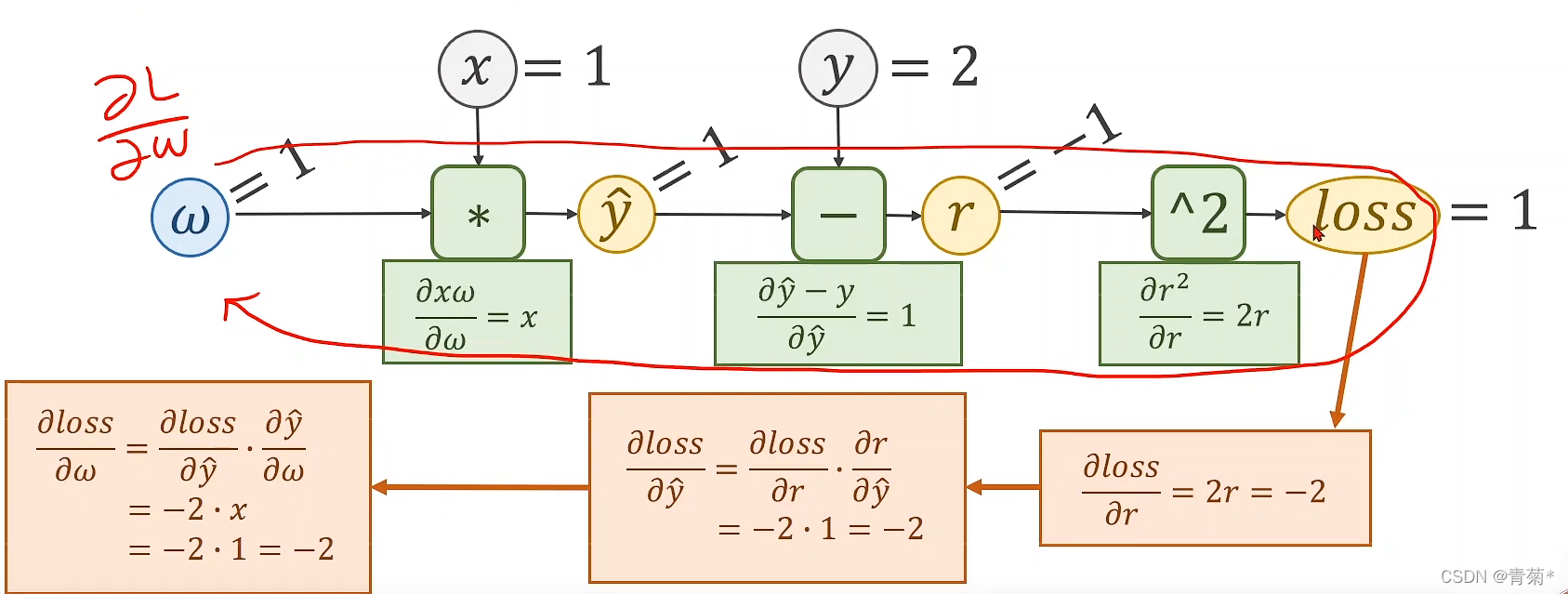

3 СДЪНЧѓЕМ

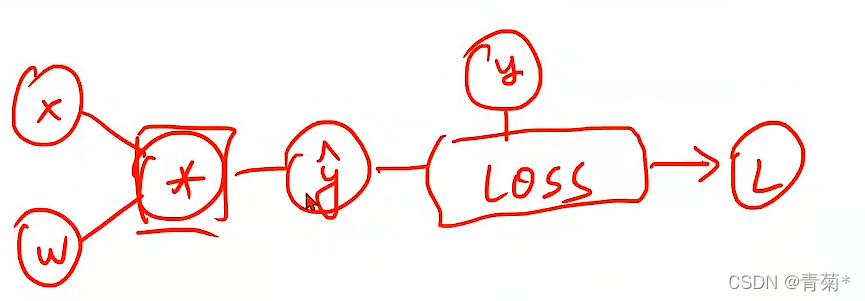

- ЧАЯђДЋВЅЕФЙ§ГЬКмКУРэНт,ОЭЪЧ f = w ? x f=w*x f=w?x,ЫуlossЕФЙ§ГЬетРяЪЁТдЁЃ

- ЗДЯђДЋВЅФи,ОЭЪЧдкЫуГіlossжЎКѓ,ашвЊЧѓГіlossЖдzЕФЕМЪ§,ШЛКѓдкЫуГіfЕФЪБКђ,МЧТМЯТzЖдxЕФЕМЪ§КЭxЖдwЕФЕМЪ§,ШЛКѓдкЭљЧА,ИљОнСДЪНЗЈдђЕУЕНlossЖдxЕФЕМЪ§КЭlossЖдwЕФЕМЪ§!

ЕМЪ§ЪЧДцДЂдкБфСПжаЕФ,ВЛЪЧМЦЫуФЃПщжаЕФ

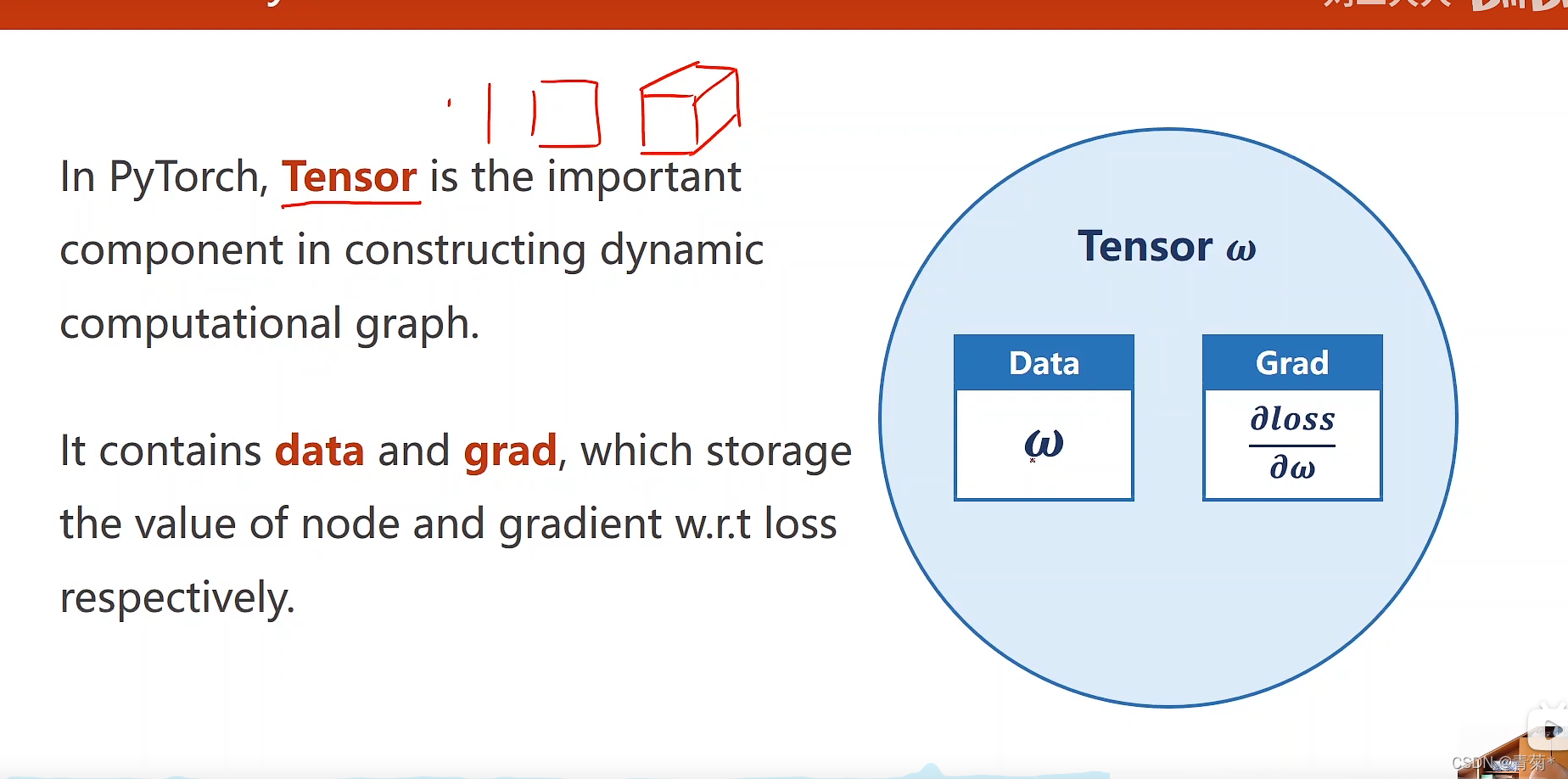

4 PyTorchжаЕФTensor

- TensorгаСНИіЪ§ОнГЩдБ,dataКЭGradЁЃ

4.1 ДњТыЦЌЖЮбЇЯА

import torch

w = torch.Tensor([1.0])

w.requires_grad = True

- wЪЧвЛИіВЮЪ§,етРяЫцЛњГѕЪМЛЏЮЊ1.0,ЪЧвЛИі0ЮЌЕФГЃСПЁЃ

- ВЂЧввЊЧѓЫќШЅМЦЫуЬнЖШ(grad)ЁОвЛАуЪЧФЌШЯВЛМЦЫуЕФЁП

def forward(x):

return x * w

- forwardКЏЪ§зїгУ:Ъ§ГЫЁЃwЪЧTensorЯђСП,xВЛЧхГўЪЧЗёЪЧTensor,етРядкМЦЫуЪБОЭЛсЖдКЏЪ§зівЛИіЧПжЦРраЭзЊЛЛЁЃ

def loss(x, y):

y_pred = forward(x)

return (y_pred - y) ** 2

- етИіМЦЫуlossЕФЙ§ГЬ,вЊФмЙЛгУМЦЫуЭМШЅБэЪОГіРДЁЃ

for epoch in range(100):

for x, y in zip(x_data, y_data):

l = loss(x, y)

l.backward() # .grad ЛсРлЛ§Ъ§ОнЕФ

print(

w.grad.data.zero_() # дкИќаТжЎКѓ,ашвЊАбЬнЖШЪ§ОнЧхСу

еХСПЪЧВЛФмжБНгШЅНјааМгЗЈМЦЫуЕФ,TensorзіМгЗЈЛсЩњГЩМЦЫуЭМ,ЕМжТФкДцЯћКФЁЃвЛЖЈвЊМгЩЯ .item

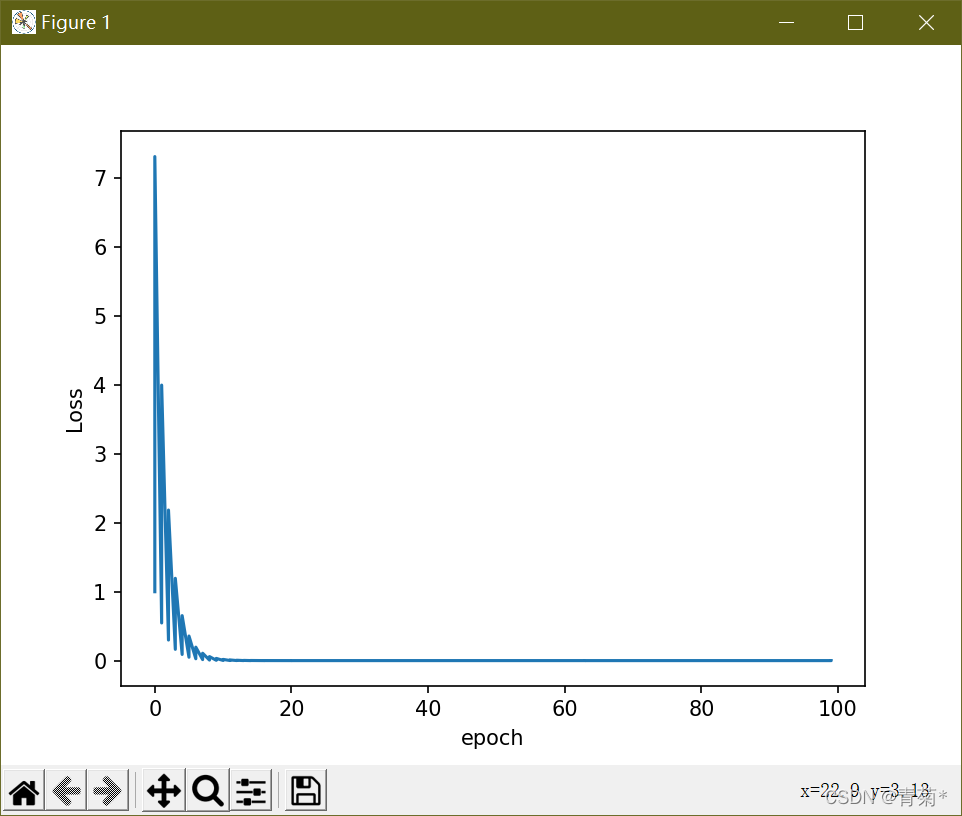

5 ећЬхДњТы

- ПЩвдШЋВПИДжЦеГЬљЕН.pyЮФМўжа,ПЩвджБНгдЫаа

import torch

import matplotlib.pyplot as plt

x_data = [1.0, 2.0, 3.0]

y_data = [2.0, 4.0, 6.0]

w = torch.Tensor([1.0])

w.requires_grad = True

def forward(x):

return w * x

def loss(x, y):

y_pred = forward(x)

return (y_pred - y) ** 2

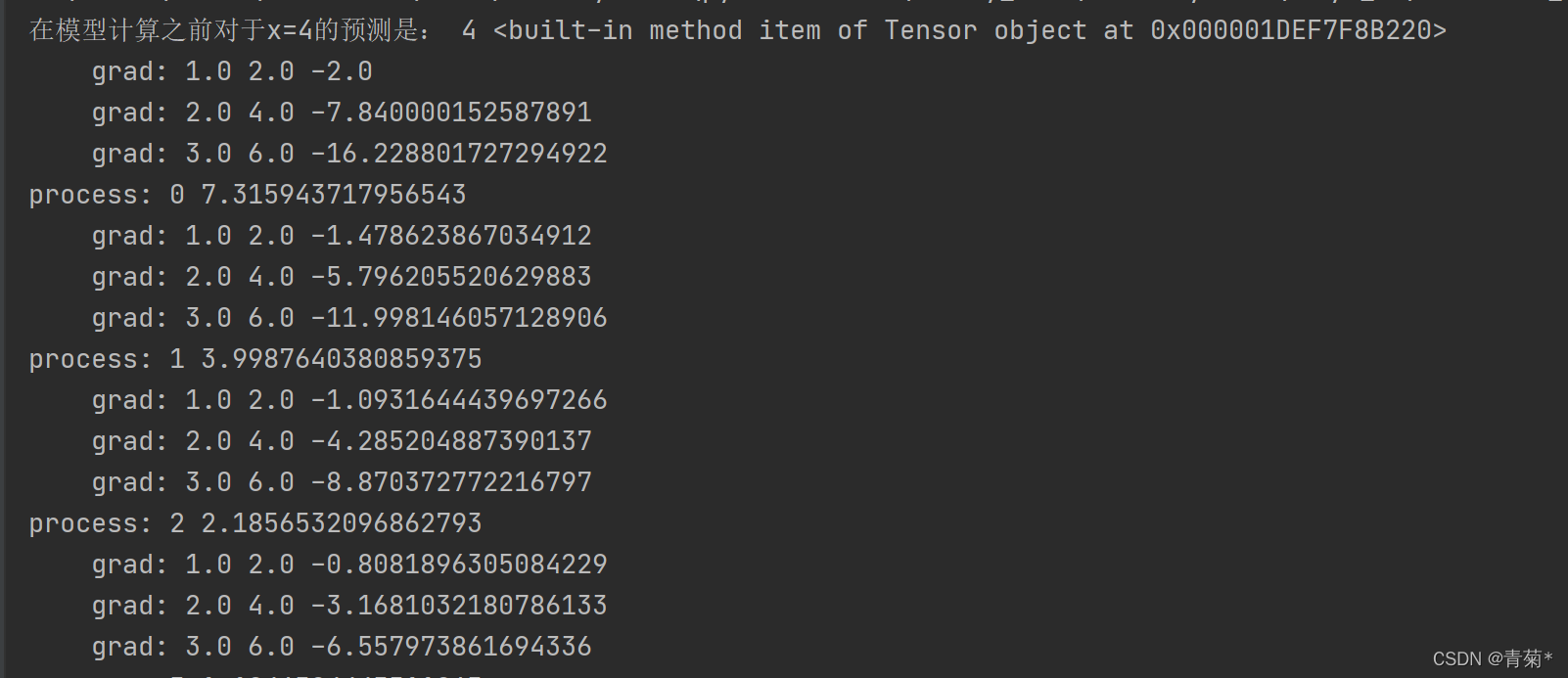

print("дкФЃаЭМЦЫужЎЧАЖдгкx=4ЕФдЄВтЪЧ:", 4, forward(4).item)

epoch_list = []

loss_list = []

for epoch in range(100):

for x, y in zip(x_data, y_data):

l = loss(x, y)

l.backward()

print('\tgrad:', x, y, w.grad.item())

w.data = w.data - 0.01 * w.grad.data

w.grad.data.zero_()

epoch_list.append(epoch)

loss_list.append(l.item())

print("process:", epoch, l.item())

print("дкФЃаЭМЦЫужЎКѓЖдгкx=4ЕФдЄВтЪЧ:", 4, forward(4).item())

plt.plot(epoch_list, loss_list)

plt.ylabel('Loss')

plt.xlabel('epoch')

plt.show()

бЇЯАзЪСЯ:СѕЖўДѓШЫ