参考链接和文献:

https://jalammar.github.io/illustrated-transformer/

https://blog.csdn.net/qq_28168421/article/details/120340360

1. transformer的宏观结构解析

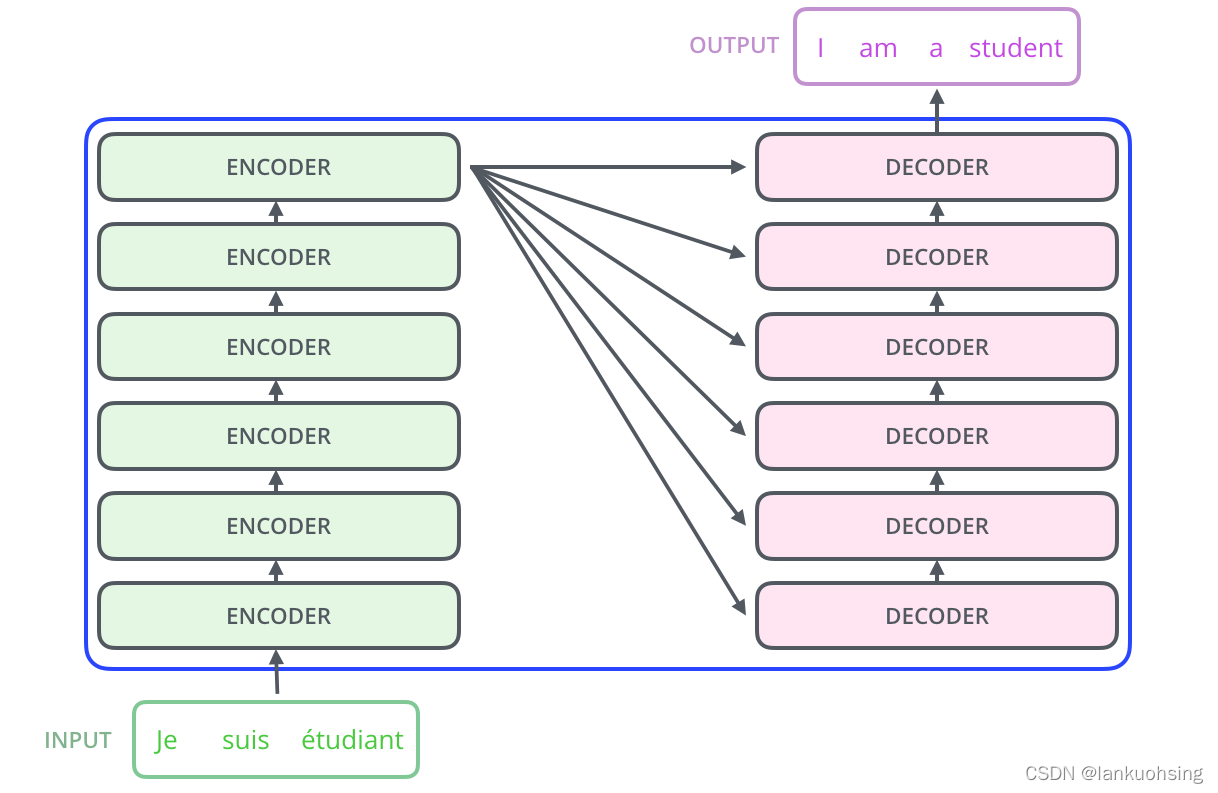

transformer的一种典型的seq2seq结构,常用于序列到序列的应用中。以机器翻译为例,最顶层的视图为:

将结构放大一些,可以看到是input流经encoder部分再流经decoder部分最后得到output:

而encoder部分是由6层encoder组成,decoder部分也是由6层decoder组成,最后一层encoder会影响每一层decoder的输入:

每层encoder的结构都是相同的,由一层self-attention和一层全连接(一下简称fc)层组成:

其中self-attention能够使得在编码某个词时,看到并结合句子里面每个词的信息。self-attention的原理解释见https://blog.csdn.net/THUChina/article/details/108611559

decoder部分也有类似与encoder中的self-attention层和fc层,但是在这两者之间还有一个encoder-decoder attention层,用于获取原始输入句子中的相关部分。如下图所示:

2. 数据的流动

2.1. Encoder部分

对于一个序列(比如一个句子),首先要对序列中的每个元素(例如每个词)进行embedding,得到一个embedding向量(具体embedding的方法见后文):

在transformer里面,默认每个词的embedding向量的维度是512维。也即每个词会得到一个512维的向量表示。

于是self-attention的输入就是一个包含多个词的embedding向量(用x表示)的list。输入可以限制一个最长长度,通常是训练集里面最长的句子长度。而self-attention的输出也是一个list,里面包含了每个词经过该层self-attention后的representation vector(用z表示):

然后每个词的z向量,又经过一层全连接层。

此外,分别对每个encoder层中的self-attention层和fc层的输入和输出通过残差层连接,并且对输出再做一个layernorm。也即每个子层的输出可以表示为:

L

a

y

e

r

N

o

r

m

(

x

+

S

u

b

L

a

y

e

r

(

x

)

)

LayerNorm(x+SubLayer(x))

LayerNorm(x+SubLayer(x))。其中

x

x

x代表该子层的输入,

S

u

b

L

a

y

e

r

SubLayer

SubLayer代表该子层原始的实现函数(self-attention或者fc):

同时,为了方便残差连接的实现,每个encoder层的输入输出维度保持一致(512维),这样就不需要在残差连接里面对

x

x

x进行升维或者降维。

2.2. Decoder部分

注意,在Encoder部分中,无论输入序列中元素个数有多少,前向过程都是只进行一次并行地推理,这也是self-attention相比RNN/LSTM的优势;而Decoder部分中,必须进行串行地循环推理,逐个生成新的输出元素(单词)。

注意,decoder层的第一个self-attention的计算过程,与encoder层中的self-attention的计算过程(query,key,value的计算都是依赖于上一层的输出,具体计算过程参见https://blog.csdn.net/THUChina/article/details/108611559 ),而第二个self-attention中的key和value来自encoder的输出计算得到,query来自上一个子层的输出计算得到。可以这么形象地理解,第二个self-attention层的功能是利用解码器已经预测出的信息作为query,去编码器提取的各种特征中,查找相关信息并融合到当前特征中,来完成预测。