�����LSTM�Ż�,�����Դ������ʲ��ȶ�,�뿴һ��LSTM���Դ�ռ�����,������һͨ,����һ�������Ŀ�Դ����,��¼����һ�¡�

��������Ŀ��ַ:https://github.com/Oldpan/Pytorch-Memory-Utils

����Ҳ������д�IJ���:https://oldpan.me/archives/pytorch-gpu-memory-usage-track

����������python�ļ�modelsize_estimate.py?��?gpu_mem_track.py,��Ҫ�Ƚ��������ļ����Ƶ��Լ��Ĵ��빤��Ŀ¼��

����Ҳ������ʹ��ʾ��,����:

import torch

from torchvision import models

from gpu_mem_track import MemTracker

device = torch.device('cuda:0')

gpu_tracker = MemTracker() # define a GPU tracker

gpu_tracker.track() # run function between the code line where uses GPU

cnn = models.vgg19(pretrained=True).features.to(device).eval()

gpu_tracker.track() # run function between the code line where uses GPU

dummy_tensor_1 = torch.randn(30, 3, 512, 512).float().to(device) # 30*3*512*512*4/1024/1024 = 90.00M

dummy_tensor_2 = torch.randn(40, 3, 512, 512).float().to(device) # 40*3*512*512*4/1024/1024 = 120.00M

dummy_tensor_3 = torch.randn(60, 3, 512, 512).float().to(device) # 60*3*512*512*4/1024/1024 = 180.00M

gpu_tracker.track()

dummy_tensor_4 = torch.randn(120, 3, 512, 512).float().to(device) # 120*3*512*512*4/1024/1024 = 360.00M

dummy_tensor_5 = torch.randn(80, 3, 512, 512).float().to(device) # 80*3*512*512*4/1024/1024 = 240.00M

gpu_tracker.track()

dummy_tensor_4 = dummy_tensor_4.cpu()

dummy_tensor_2 = dummy_tensor_2.cpu()

gpu_tracker.clear_cache() # or torch.cuda.empty_cache()

gpu_tracker.track()ʹ��Ҳ�ܼ�,������Ҫ�鿴�Դ����ô������������gpu_tracker.track()����

gpu_tracker.track()

cnn = models.vgg19(pretrained=True).to(device) # ����VGG19ģ�Ͳ��ҽ�����ת���Դ���

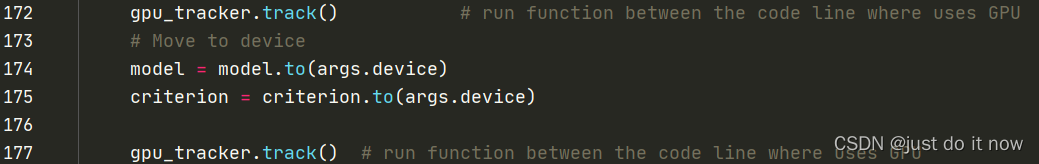

gpu_tracker.track()?Ȼ����Է��ֳ������й����е��Դ�仯(��һ��������ǰ���Դ�,���һ�����������Դ�)

At __main__ <module>: line 13 Total Used Memory:472.2 Mb

+ | 1 * Size:(128, 64, 3, 3) | Memory: 0.2949 M | <class 'torch.nn.parameter.Parameter'>

+ | 1 * Size:(256, 128, 3, 3) | Memory: 1.1796 M | <class 'torch.nn.parameter.Parameter'>

+ | 1 * Size:(64, 64, 3, 3) | Memory: 0.1474 M | <class 'torch.nn.parameter.Parameter'>

+ | 2 * Size:(4096,) | Memory: 0.0327 M | <class 'torch.nn.parameter.Parameter'>

+ | 1 * Size:(512, 256, 3, 3) | Memory: 4.7185 M | <class 'torch.nn.parameter.Parameter'>

+ | 2 * Size:(128,) | Memory: 0.0010 M | <class 'torch.nn.parameter.Parameter'>

+ | 1 * Size:(1000, 4096) | Memory: 16.384 M | <class 'torch.nn.parameter.Parameter'>

+ | 6 * Size:(512,) | Memory: 0.0122 M | <class 'torch.nn.parameter.Parameter'>

+ | 1 * Size:(64, 3, 3, 3) | Memory: 0.0069 M | <class 'torch.nn.parameter.Parameter'>

+ | 1 * Size:(4096, 25088) | Memory: 411.04 M | <class 'torch.nn.parameter.Parameter'>

+ | 1 * Size:(4096, 4096) | Memory: 67.108 M | <class 'torch.nn.parameter.Parameter'>

+ | 5 * Size:(512, 512, 3, 3) | Memory: 47.185 M | <class 'torch.nn.parameter.Parameter'>

+ | 2 * Size:(64,) | Memory: 0.0005 M | <class 'torch.nn.parameter.Parameter'>

+ | 3 * Size:(256,) | Memory: 0.0030 M | <class 'torch.nn.parameter.Parameter'>

+ | 1 * Size:(128, 128, 3, 3) | Memory: 0.5898 M | <class 'torch.nn.parameter.Parameter'>

+ | 2 * Size:(256, 256, 3, 3) | Memory: 4.7185 M | <class 'torch.nn.parameter.Parameter'>

+ | 1 * Size:(1000,) | Memory: 0.004 M | <class 'torch.nn.parameter.Parameter'>

At __main__ <module>: line 15 Total Used Memory:1387.5 Mb1387.5 �C 472.2 = 915.3 MB,���Դ�ռ�����,��Ϥvgg19 ��ͬѧӦ�ÿ�����,vgg19���в��Ȩ�ؼ����������548M,����ȴ����915.3M,�������ӡ�ı����ӡ��Tensor-MemoryҲ��������������Ҳ���551.8Mb,��ԭʼģ�ʹ�С�Ƚ�һ��,�������δ�ӡ�IJ�ֵΪʲôҪ����ô����?

���߷�����ԭ��:Pytorch�ڿ�ʼ���г���ʱ��Ҫ������Դ濪��,���ֶ�����Դ濪��������ʵ��ʹ�õ�ģ��Ȩ���Դ��С��

��ſ������⡣

�������ҵ�ʱ��,ģ����˫��LSTM:

��ӡ��Ϣ����:

At train-mul.py line 172: main Total Tensor Used Memory:0.0 Mb Total Allocated Memory:0.0 Mb

+ | 2 * Size:(180, 60) | Memory: 0.0823 M | <class 'torch.nn.parameter.Parameter'> | torch.float32

+ | 1 * Size:(352504, 300) | Memory: 403.40 M | <class 'torch.nn.parameter.Parameter'> | torch.float32

+ | 4 * Size:(240,) | Memory: 0.0036 M | <class 'torch.nn.parameter.Parameter'> | torch.float32

+ | 4 * Size:(180,) | Memory: 0.0027 M | <class 'torch.nn.parameter.Parameter'> | torch.float32

+ | 1 * Size:(11, 120) | Memory: 0.0050 M | <class 'torch.nn.parameter.Parameter'> | torch.float32

+ | 2 * Size:(180, 160) | Memory: 0.2197 M | <class 'torch.nn.parameter.Parameter'> | torch.float32

+ | 2 * Size:(1, 256) | Memory: 0.0019 M | <class 'torch.nn.parameter.Parameter'> | torch.float32

+ | 2 * Size:(240, 80) | Memory: 0.1464 M | <class 'torch.nn.parameter.Parameter'> | torch.float32

+ | 2 * Size:(256,) | Memory: 0.0019 M | <class 'torch.nn.parameter.Parameter'> | torch.float32

+ | 1 * Size:(256, 160) | Memory: 0.1562 M | <class 'torch.nn.parameter.Parameter'> | torch.float32

+ | 1 * Size:(11,) | Memory: 4.1961 M | <class 'torch.nn.parameter.Parameter'> | torch.float32

+ | 2 * Size:(240, 300) | Memory: 0.5493 M | <class 'torch.nn.parameter.Parameter'> | torch.float32

+ | 1 * Size:(256, 120) | Memory: 0.1171 M | <class 'torch.nn.parameter.Parameter'> | torch.float32

At train-mul.py line 177: main Total Tensor Used Memory:404.7 Mb Total Allocated Memory:405.3 Mb

����tensor��Ӵ����408.88M,����:

![]()

?���δ�ӡ��ֵ��405.3M-0M=405.3M

�����,���β�ֵ��tensor memory���Ҫ��,��˵Ҫ��һЩ����,ԭ����