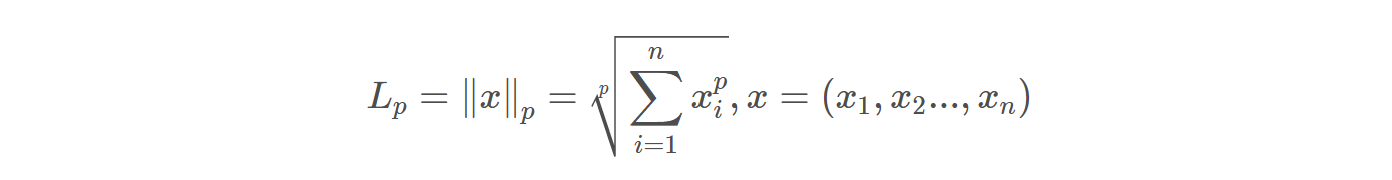

L-0����:����ͳ�������з���Ԫ�صĸ�����

L-1����:����������Ԫ�صľ���ֵ֮�͡�

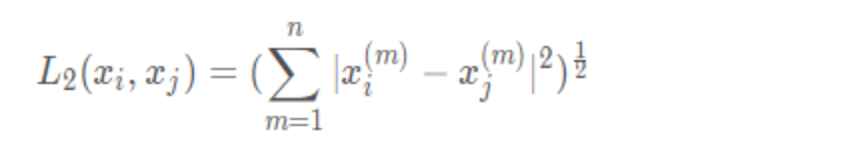

L-2����:ŷʽ���롣

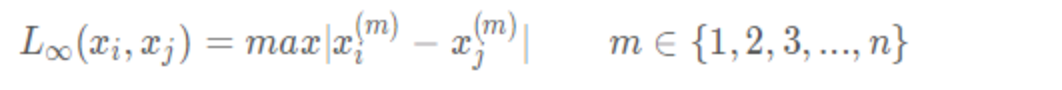

L-����:���������е����ֵ��

��Ҳ������������

1-����:

�U

x

�U

1

=

��

x

1

��

+

��

x

2

��

+

��

+

��

x

n

��

�Ux�U_1=��x^1��+��x^2��+��+��x^n��

�Ux�U1?=��x1��+��x2��+��+��xn��

2-����:

�U

x

�U

2

=

(

��

x

1

��

2

+

��

x

2

��

2

+

��

+

��

x

n

��

2

)

2

�Ux�U_2=\sqrt[2]{(��x^1��^2+��x^2��^2+��+��x^n��^2)}

�Ux�U2?=2(��x1��2+��x2��2+��+��xn��2)?

��-����:

�U

x

�U

��

=

m

a

x

(

��

x

1

��

,

��

x

2

��

,

��

,

��

x

n

��

)

�Ux�U_��=max(��x^1��,��x^2��,��,��x^n��)

�Ux�U��?=max(��x1��,��x2��,��,��xn��)

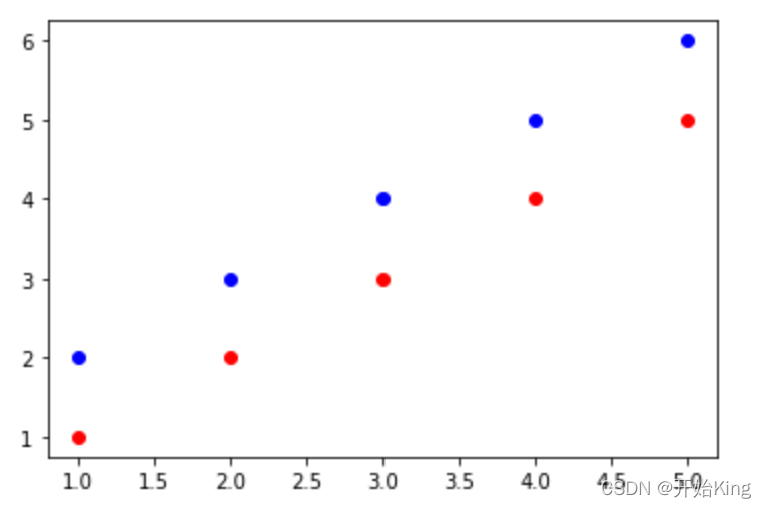

������������A=(3,4,5)��B=(6,1,1)˭��?

�ö�����

A

2

=

50

2

,

B

2

=

38

2

,

A

>

B

\sqrt[2]{A}=\sqrt[2]{50},\sqrt[2]{B}=\sqrt[2]{38},A>B

2A?=250?,2B?=238?,A>B

���������������Ƚ�:

||B||=6>||A||=5,���Բ�ͬ�Ķ����������ݵĴ�С��ϵ���ܻᷢ���仯

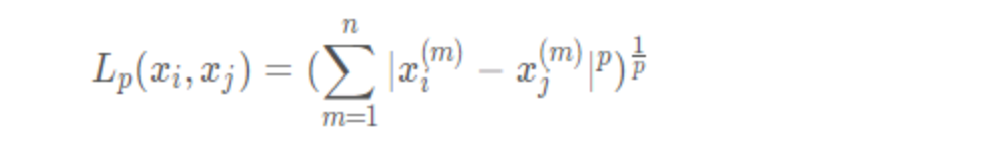

���濴��������KNN�㷨�е�ʹ��,һ���KNN�㷨ʹ��ŷ�Ͼ�����Ϊ�������,�������ַ�ʽֻ���������������δص����,����������������Ͳ��ʺ�ŷʽ����

��˿��ܻ�ѡ�ò�ͬ�ľ��붨��

��˿��ܻ�ѡ�ò�ͬ�ľ��붨��

1 �ɿɷ�˹������

��

��

p

?

1

����p\geqslant1

����p?1

��

��

p

?

1

����p\geqslant1

����p?1

2 �����پ���

p

=

1

p=1

p=1

3 ŷʽ����

p

=

2

p=2

p=2

3 ŷʽ����

p

=

2

p=2

p=2

4 �б�ѩ�����

p

=

��

p=\infty

p=��

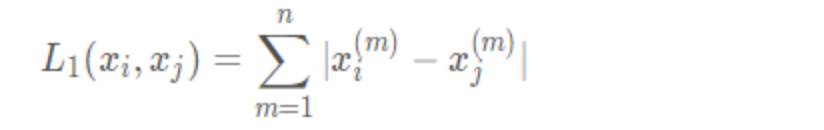

x

m

��

ʾ

��

��

x

��

m

��

��

��

,

x

i

��

ʾ

��

i

��

��

��

,

x

i

m

��

ʾ

��

i

��

��

��

��

��

m

��

��

��

x^m��ʾ����x��m������,x_i��ʾ��i������,x_i^m��ʾ��i�������ĵ�m������

xm��ʾ����x��m������,xi?��ʾ��i������,xim?��ʾ��i����������m������