1.Mutual Information����

����Ϣ����Ϣ�����������������������֮��������̶ȵ�һ������

2.��Ϣ�۵Ļ�������

-

��Ϣ��: �Ƕ�ij��ʱ�䷢���ĸ��ʵĶ���,ͨ������һ���¼������ĸ���Խ��,������¼���������Ϣ��Խ������ʵ������,Խϡ�������(�����ĸ���С)��������Ϣ��Խ����ũ�����һ������������Ϣ���Ĺ�ʽ:

l o g 1 p = ? l o g p log\frac{1}{p}=-logp logp1?=?logp -

��(entropy): ����һ��ϵͳ���ȶ��̶ȡ���ʵ����һ��ϵͳ���б�����Ϣ�����������߾�ֵ����ɢ���� ��ʽΪ:

H ( X ) = �� x �� X P ( x ) ? l o g 1 P ( x ) = ? �� x �� X P ( x ) l o g P ( x ) = ? E l o g P ( X ) H(X)=\sum_{x \in X} P(x) \cdot log \frac{1}{P(x)}=-\sum_{x\in X}P(x) logP(x)= -ElogP(X) H(X)=x��X��?P(x)?logP(x)1?=?x��X��?P(x)logP(x)=?ElogP(X)

P ( x ) P(x) P(x)��ʾ�¼� X X XΪ x x x�����ĸ��ʡ����һ��ϵͳԽ��,��������������(�������Ϊ1�����,��ô��Ӧ����Ϊ1,��ô��Ӧ����Ϣ��Ϊ0),��ʱ����Ϣ�ؽ�С����������,��ʱ������������ĸ����ܶȺ���,��ʽΪ:

H ( X ) = �� P ( x ) ? l o g 1 P ( x ) d x H(X)=\int P(x) \cdot log \frac{1}{P(x)}dx H(X)=��P(x)?logP(x)1?dx -

������(joint entropy): ������ϱ�������,Ҳ���ǽ��صĶ����ƹ㵽������ķ�Χ��

H ( X , Y ) = �� x �� X �� y �� Y P ( x , y ) ? l o g 1 P ( x , y ) = ? �� x �� X �� y �� Y P ( x , y ) l o g P ( x , y ) = ? E l o g P ( X , Y ) H(X,Y)=\sum_{x \in X} \sum_{y \in Y}P(x,y) \cdot log \frac{1}{P(x,y)}=-\sum_{x \in X} \sum_{y \in Y}P(x,y) logP(x,y)= -ElogP(X,Y) H(X,Y)=x��X��?y��Y��?P(x,y)?logP(x,y)1?=?x��X��?y��Y��?P(x,y)logP(x,y)=?ElogP(X,Y) -

������(conditional entropy): һ����������ڸ����������,ϵͳ���ء�

H ( Y �O X ) = �� x �� X P ( x ) H ( Y �O X = x ) = �� x �� X P ( x ) [ �� y �� Y P ( y �O x ) l o g 1 P ( y �O x ) ] = �� x �� X �� y �� Y P ( x ) P ( y �O x ) l o g 1 P ( y �O x ) = ? E l o g P ( Y �O X ) H(Y|X)=\sum_{x\in X}P(x)H(Y|X=x)=\sum_{x\in X}P(x)[\sum_{y\in Y}P(y|x)log\frac{1}{P(y|x)}]=\sum_{x \in X} \sum_{y \in Y}P(x)P(y|x)log\frac{1}{P(y|x)}=-ElogP(Y|X) H(Y�OX)=x��X��?P(x)H(Y�OX=x)=x��X��?P(x)[y��Y��?P(y�Ox)logP(y�Ox)1?]=x��X��?y��Y��?P(x)P(y�Ox)logP(y�Ox)1?=?ElogP(Y�OX)�����ؾ��Ǽ����ڸ�����һ��������,��ϵͳ��Ϣ��������

-

�����(relative entropy): Ҳ������KLɢ��(Kullback-Leibler divergence)�������ǻ����һ�������ĸ��ʷֲ�ʱ,һ�����ǻ���һ�ֽ����Ҽķֲ������档����ؾ����������������ֲ�����ͬһ�������IJ��������

D K L ( p �O �O q ) = �� i p ( x i ) ? [ l o g 1 q ( x i ) ? l o g 1 p ( x i ) ] = �� i p ( x i ) ? l o g p ( x i ) q ( x i ) D_{KL}(p||q)=\sum_i p(x_i) \cdot[log\frac{1}{q(x_i)}-log \frac{1}{p(x_i)}]=\sum_i p(x_i) \cdot log\frac{p(x_i)}{q(x_i)} DKL?(p�O�Oq)=i��?p(xi?)?[logq(xi?)1??logp(xi?)1?]=i��?p(xi?)?logq(xi?)p(xi?)? -

������(cross entropy): Ҳ���������������ֲ�֮��IJ����ԡ�

H C E ( p , q ) = �� i p ( x i ) ? l o g 1 q ( x i ) H_{CE}(p,q)=\sum_i p(x_i) \cdot log \frac{1}{q(x_i)} HCE?(p,q)=i��?p(xi?)?logq(xi?)1?

��Ȼ������������صĵ�һ����,��Ϊ��ͨ���������������֪?,���ڶ������dz���,��ʱ�����غ��������һ�����Թ�ϵ,�ڿ��Ǽ������������,��������ͨ�������ⲿ�ֽ����������� -

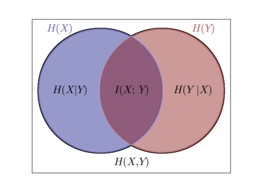

����Ϣ(Mutual Information): ����ͼ,����Ϣ���ǽ���IJ��֡������ص���������,��:

H ( X �O Y ) = H ( X ) + H ( Y �O X ) = H ( Y ) + H ( X �O Y ) H(X|Y)=H(X)+H(Y|X)=H(Y)+H(X|Y) H(X�OY)=H(X)+H(Y�OX)=H(Y)+H(X�OY).���,

H ( X ) ? H ( X �O Y ) = H ( Y ) ? H ( Y �O X ) H(X)-H(X|Y) = H(Y)-H(Y|X) H(X)?H(X�OY)=H(Y)?H(Y�OX)

��������X��Y�Ļ���Ϣ,���� I ( X �O Y ) I(X|Y) I(X�OY).�����صĶ������չ���õ�:

I ( X , Y ) = H ( X ) ? H ( X �O Y ) = H ( X ) + H ( Y ) ? H ( X , Y ) = �� x p ( x ) l o g 1 p ( x ) + �� y p ( y ) l o g 1 p ( y ) ? �� x , y p ( x , y ) l o g p ( x , y ) p ( x ) p ( y ) I(X,Y) = H(X)-H(X|Y)=H(X)+H(Y)-H(X,Y)=\sum_x p(x) log \frac{1}{p(x)}+\sum_y p(y) log \frac{1}{p(y)} -\sum_{x,y} p(x,y) log \frac{p(x,y)}{p(x)p(y)} I(X,Y)=H(X)?H(X�OY)=H(X)+H(Y)?H(X,Y)=x��?p(x)logp(x)1?+y��?p(y)logp(y)1??x,y��?p(x,y)logp(x)p(y)p(x,y)?