HyperTransformer: A Textural and Spectral Feature Fusion Transformer for Pansharpening

HyperTransformer:融合纹理和光谱特征的Transformer用于全色锐化?

from CVPR2022

Code

Abstract

全色锐化致力于将高分辨率的全色图像(PAN)与低分辨率的光谱图像(LR-HSI)融合在一起,生成高光谱高分辨率的增强的图像。现有的全色锐化方法忽略了借助注意力机制将HR的纹理特征从PAN图迁移到HSI图,导致空间变形、光谱变形等问题。本文提出一种新的基于注意力机制的全色锐化方法――HyperTransformer,其中LR-HAI和PAN图像分别作为Transformerde query和key。HyperTransformer包含3部分,分别是PAN和HSI的空间-光谱特征提取模块、多头注意力模块和空间-光谱融合模块。这样可以有效学习PAN和HSI的空间和光谱的长程依赖,从而提升空间和光谱质量。此外,HyperTransformer可以跨越多个空间尺度从而进一步提升性能。在3个广泛使用的数据集上的结果表明Hyper Transformer在基于空间和光谱的方法上取得了最优的结果。

Section I Introduction

高光谱全色锐化旨在将PAN图的空间细节迁移至LR-HSI图像来增强低分辨率超光谱图像的空间信息,同时还能保留LR-HSI的光谱特性。近期关于HR全色瑞华的研究大大提升了HSI图像中的光谱和纹理信息,有助于提升遥感成像、快速发现其中潜在的现象。HR全色锐化有助于解决一系列要赶任务,如目标识别、变化监测、场景分析和分类等。?

早期HS锐化主要利用内容替换(Component substitution)、多分辨率解析(MRI)、贝叶斯变换和变分等方法将PAN图的空间信息转换到LR-HSI图中,但是这些传统的方法通常会带来空间和光谱信息的变形,主要因为无法对先验知识进行好的建模、无法贴近传感器的特点、先验假设与问题并不匹配、并且依赖手工特性。

?近期,深度卷积神经网络(ConvNets)在HS全色锐化中展现出优异的性能,可以较好的提取图像特征。但是目前SOTA的方法同行直接将PAN图的纹理和光谱迁移到LR-HSI图中,比如Fig 1(a)展示了直接将图中网络作为backbone,学习从HR-HSI和PAN到LR-HSI的映射函数,但是本文认为PAN图直接与数百个LR图像的光谱信息链接会使得纹理和光谱特征融合变得困难、不连续。

?此外由于纹理-光耦信息混合的不合理,可能会带来锐化HSI图像的高光谱和空间几遍。Fig 1(b)则研究了将PAN图与HR-HSI图再特征域进行相连。可以看到使用了两个独立的卷积网络从PAN图中提取HR纹理特征和从LR-HSI图中提取光谱特征,然而也仅仅通过二者相加进行特征融合,没有任何注意力机制加以引导。

?本文认为这种方法没有有效利用HR-HSI和PAN图中特征的空间依赖性以及纹理-光谱特征的长程细节,仅仅依赖网络传播的纹理光谱特性。虽然卷积操作在深层网络中能够恰当的融合纹理特征,凡是无法在全局视野上调整每个像素值,这只能算局部的锐化。

?

本文受启发于Transformer在SR方面的研究,本文提出一种新的HyperTransformer用于融合纹理和光谱特征的Transformer用于HS全色锐化,参见Fig 1?。与传统的锐化方法相比,本文基于注意力机制提取PAN和LR-HSI之间的特征交叉注意力,发现更为相似的纹理-光谱特征进行融合,这极大的提升了HSI能获取的光谱和空间质量。

本文的HyperTransformer总共包含三大模块,分别是FE-PAN和FE-HSI用于提取PAN和HSI的图像特征以及一个纹理-光谱融合模块TSFF。本文将PAN和LR-HSI作为注意力机制中的Q-K-V来计算LR-HSI图中相似的文本和光谱特征表述,然后将计算出来的特征与LR-HSI图像特征融合,用于HSI锐化。进一步为了提升锐化效果本文还引入了两个新的损失项,分别是广泛采用的迁移感知损失和L1损失。

本文的工作总结如下:?

1)本文提出的HyperTransformer用于HS全色锐化并且达到了SOTA结果。据我们所知这是首个将Transformer融合引入HS锐化任务的工作。?

(2)本文提出一种新的多尺度特征融合机制,使得网络可以有效捕获多尺度、具有长程依赖的特征,从而有效融合不同尺度的PAN图和HSI图的特征。?

3)本文还提出两种新的HS锐化损失项,分别是合成的感知损失和迁移感知损失,使yperTransformer可以学习到更强大的PAN和HSI中的图像特征。

Section II Relarted Work

Classical approaches

传统的锐化方法主要可分为四类:内容补充(CS)、多分辨率 分析(MRA)、混合算法和贝叶斯变换。基于CS的方法首先会把LR-HSI图像分成光谱部分和空间部分,然后将空间部分替换为PAN图的,然后通过逆变换变换会原始空间。广泛采用的算法有Gram-Schmit,GS-adaptive,PCA等。

?基于MRA的方法会将空间特征注入到LR-HSI中,代表方法有基于平滑滤波的强度调制SFIM和高通滤波的调制MGH等。考虑到CS和MRA二者的局限性,又提出了二者混合的算法,如引导的PCA方法等。基于贝叶斯的方法有贝叶斯融合、系数BF和CNMF等。

ConvNet based approaches

鉴于卷积神经网络强大的特这栋提取能力在锐化方面取得了一定的进展,比如Masi等人首次提出将PAN的上采样图与LR-HS作为输入送入卷积神经网络。受到ResNet在超分任务中的广泛应用,[44]提出一种DRPNN来学习HSI和上采样HSI图像之间的残差图像。Dian等人提出的DHSIS是一种深度图画方法,将卷积网络学到的先验知识集成到LR-HSI和PAN图特的特征融合中。近期也有将注意力机制引入到HS锐化总,来学习PAN和LR-HSI图像中的远程依赖关系,代表工作是DHP-DARN,比其他SOTA方法获得了更好的融合性能。但是上述基于注意力的方法没有使用LR-HSI,PAN↑↓和PAN图的特征作为Q-K-V来探讨对纹理-光谱特征融合过程的关注。本文就聚焦于这一过程。

???

Section III Method

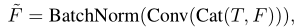

Fig 2展示了HyperTransformer的整体框架,p,p↑↓、y↑分别代表PAN,PAN下采样、PAN上采样和LR-HSI图上采样的如,上采样和下采样通过双线性三次插值获得,因为实验证明这样带来的空间和光谱变形比较小。PAN图会上采样或下采样从而与LR-HSI图像适配,HyperTransformer会将上述四个作为输入,然后输出高级的纹理特征和频谱相似特征,计作F。

????整个网络包含四个部分,分别是PAN特征和HSI图像的特征提取模块FE-PAN,FE-HSI以及特征注意力模块、和一个纹理-光谱特征融合模块。

Part 1 Feature Extractor for PAN and LR-HSI

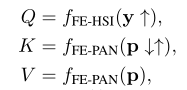

首先本文设计两个独立的特征提取模块来提取PAN图和LR-HSI图的纹理和光谱信息,搭建了VGG类的网络结构,这样可以精确的学习二者之间的相互信息,FEs的输出决定了Q-K-V,其中PAN图作为K-V,HSI的输出作为Q?

?????

Part 2 HE Texture Transfer through Mulit-Head Feature-Attention(MHFA)

特征注意力旨在识别出LR-HSI图中频谱相似、纹理优越的特征表示,将他们进一步用于主干网络进行全色锐化。本文使用了多头注意力而不是单头注意力,主要为了在更多子空间进行特征提取。因此MHFA会首先通过N个全连接层,将Q-K-V的每个特征映射到N个全局描述符。然后为每一个特征描述符并行计算软注意力,最后将输出特征连接起来,通过线性层映射回原来的特征空间。MHFA可以有效提取PAN和LR-HSI之间的空间依赖关系和PAN中的长程依赖。

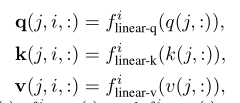

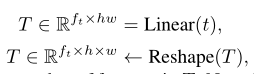

Obtaining a set of N global feature descripts

?首先将Q-K-Vreshape到2Dtensor,即将WXH展平成hw的序列,然后使用N个线性全连接层将q-k-v转换成N个全局描述符,整个过程描述为:

Feature Cross-Correlation Embedding(FCCE)

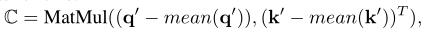

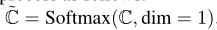

??随后进一步计算Q-K之间的互相关矩阵。为了可以并行计算N个全局特征描述符,会现将Q-K-V的前两个维度在dim1,2展平,然后计算:

主要描述了q(LR-HSI)与所有key(PAN)之间的相关性,计算的结果经过softmax成输出。?Multi-Head Feature-Attention(MHFSA)?最后计算N各全局描述符的软注意力并进行reshape:

Part 3 Texture-Spectural Feature Fusion(TSFF)

使用3X3卷积+BN进行特征融合

Part 4 Multi-Scale Feature Fusion(MSFF)

卷积网络的锐化方法只会将PAN提取的纹理特征在HR层次进行融合,本文的HyperTransformer则进行了多尺度的融合,具体参见Fig 3.可以看到主要进行了三层次的融合:?

(1)LR-HSI空间信息?

(2)LR-HSI两倍上采样?

(3)目标的高分辨率尺度

?注入HR纹理知识有助于弥补PAN和LR-HSI图像多尺度跨特征空间上的信息缺失,从而提成HSI图像的空间和光谱质量。

?

Part 5 Loss Function

本文使用了组合函数进行网络的训练。

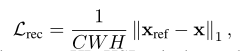

?Reconstruction Loss?

?首先重建损失函数使用的是L1损失,计算的是目标HR-HSI和预测的HR-HSI之间的差距?VGG perceptual loss?VGG感知损失函数已被证明在RGB域的超分辨率任务中可以用来提升视觉质量。

?感知损失主要是增强预测图与目标如特征空间的相似性,本文首先在预训练VGG网络上得到预测图和目标如,然后利用RGB的高斯近似光谱响应区间合成给定HSI的RGB图像,然后计算感知损失:

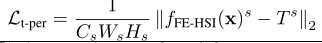

Transfer Perceptual loss?

?q迁移感知损失函数主要为了限制预测的HSI图像与HyperTransformer传输的纹理特征的相似性,这样可以确保HR纹理特征传输过程更有效。

?

最终的损失函数表述为:

Section IV Experiments

Part 1 Dataset and Performance Metrics

本文使用三个公开的HSI数据集,分别是:Pavia Center,Botswana,Chikusei?

? ?分别创建102x160x160,145x120x120,128x256x256作为HSI参考图像,然后依据Wald’s protocol生成PAN图和LR-HSI图?评估指标方面本文使用交叉相关性(CC)、谱角映射(SAM),均方根误差(RMSE),重建信噪比(PSNR),ERGAS和峰值信噪比(PSNR)

Part 2 Results and Discussion

为了说明HyperTransformer的有效性,本文与目前的SOTA卷积网路进行了对比,传统的方法有:PCA,GFPCA,BF,BFS,SFIM,GS,GSA,MGH,CNMF,MG,HySure等。

卷积网络有HyperPNN,PanNet,DHP-DARN,SIPSA,GPPNN,DIP-HyperKite。?

Quantitative results

?Table 1展示了定量分析结果,可以看到HyperTransformer在性能上大幅优于传统算法和卷积算法,在三个数据集上分别达到了以下精度: ~0.9/26.9/32.6/29.4/13.3%,?~0.3/19.2/11.9/14.0/3.2%, ~0.6/12.7/13.6/13.8/4.1%?

?

Qualitative results

??Table 2展示了定性分析结果,从数据集中随机选择一副测试图像,展现合成的HSI RGB图像、重建HSI和参考HSI图像之间的MAE图像。虽然合成的RGB 各种方法看起来差异比较小,但是从MAE图像可以看出对比结果,HyperTransformer的误差是最小的,充分说明了HyperTransformer提取细节特征的有效性。

Part 3 Ablation Studies

消融实验的结果参见Fig 4-5,首先将没有使用注意力的作为基线结果,即不使用MHFA,直接将纹理特征T作为PAN的特征,获得的指标是CC/SAM/RMSE/ERGAS/PSNR by ~1.5/21/35/29/13%。

Fig 4展示了合成的RGB图和MAE图,可以看到HyperTransformer光谱图上MAE明显减少,说明有效捕获了PAN图和LR-HSI的远程和跨空间的特征依赖性。

?Number of global descriptors N?

?Table 3和Fig 5展示了逐渐增加global descriptors的效果,可以看到随着N数目的增加效果有显著提升,但当N=16之后就饱和了,因此本文设置N=16

?

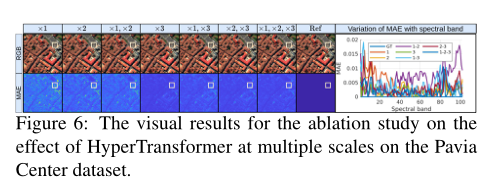

Multi-scale featre fusion?

??前文讨论过,传统的卷积锐化方法通常只在单一尺度进行PAN图和LR-HSI图像的特征融合,本文则在三种尺度上注入了PAN的纹理特征,即LR-HSI空间分辨率的×1、×2和×4。为了证明在多个空间尺度上使用超变压器的有效性,我们进行了消融研究,结果如Table 4和Fig6所示。在表4中,B/L对应于在任何空间尺度上都没有将PAN特征注入到主干上的情况(即没有PAN图像的锐化)。从Table4可以看出,当我们将PAN特征注入到主干时,全景HSI的质量有所提高,当我们在HR尺度(即×4)将PAN特征注入到主干时,性能显著改善。此外,从Table4的最后一行可以看出,当我们在所有三个空间尺度上使用HyperTransformer时,可以观察到最佳的锐化性能.

??

实验观察到在所有尺度上使用HyperTransformer时,性能为CC/SAM/RMSE/ERGAS/PSNR:~0.3/3.7/11.2/9.0/2.1%。

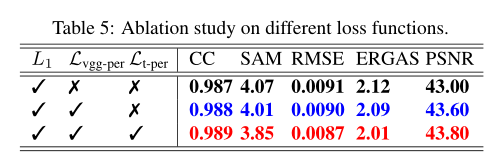

Fig 6展示了合成的RGB图像、MAE图和测试图随机选择的一个区域的MAE随光谱波段的变化。以上观察结果表明,多尺度特征融合方法优于传统的单尺度特征融合方法。?VGG perceptual loss and Transfer perceptual loss

?Table 5展示了每一项损失函数是如何提升HSI图像锐化质量的,可以看到VGG Loss和L1 loss带来的提升分别是:0.1/1.5/1.1/1.4/1.4%和0.1/4.0/3.3/3.8/0.5%?

?

Section V limitations and Future Work

从MAE图像结果可以看到在UV和IR波段有相对较高的MAE值,可能是由于PAN图中缺少对应的特征,因此需要进一步研究。

Section VI Conclusion

本文提出一种新的融合了纹理-光谱特征的HyperTransformer用于HS锐化,其中纹理特征来自PAN图,光谱特征来自LR-HSI图。HyperTransformer分别包含PAN和LR-HSI的特征提取模块、多头注意力模块来捕获长程依赖和交叉依赖,以及纹理-光谱特征融合部分。实验结果显示HyperTransformer可以有效融合多尺度的纹理和光谱信息,在三个数据集上均达到了SOTA。