������ѧ��Ȼ���Դ���(ʮһ)���� ����

����;���

| ���� | ���� | |

|---|---|---|

| ���� | �����ݷֳɴ� | ���Ѿ�����õ�������ѵ���ó�Ŀ�꺯��,�������ݷŵ��Ѿ��ֺõ����� |

| ѧϰ���� | �ලѧϰ | �мලѧϰ |

| �����㷨 | K-means,DBSCAN ,��ξ���,������ | ������,��Ҷ˹,���ع� |

| �㷨��� | ����������ȷ��,��һ���ܹ���ӳ���ݵ���ʵ����,ͬ���ľ���,���ڲ�ͬ������,���ܺ�Ҳ���ܻ� | ��������ȷ����,����������ǿ۵�,������ҵ����㷨������� |

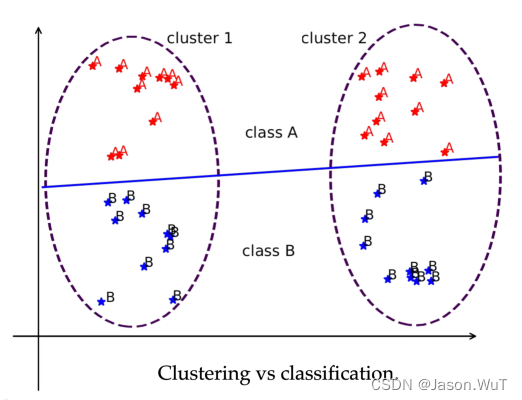

����(�ලѧϰ)

- ����Ҫ�ֹ���ע��ѵ������

- �ĵ������е��ʶ�����ͬ�ȵ���Ҫ��

- ���ѱ�֤�̶�����������

����(�мලѧϰ)

- ��Ҫ�ֹ���ע��ѵ������

- ���ڷ���������ѡ��Ҫ�ĵ���

- ʹ��ģ�Ͳ���������ռ仮��

Support Vector Machine(SVM)

Linear separability(���Կɷ���)

��ƽ��:��ά�����ռ��е�������״

- 2ά�ռ�:��

- 3ά�ռ�:��

- ��ά�ռ�:��ƽ��

���Կɷ�:��ǵ���г�ƽ��������߽�

���Է�����:ȷ�Ժ�����֮���ƽ��

- ֧��������

- ��֪��

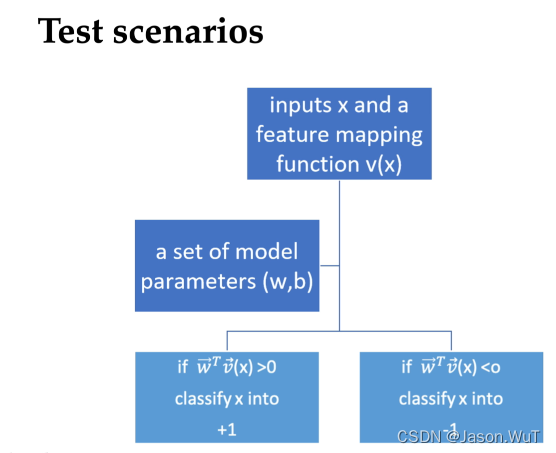

SVMģ�͵Ķ���

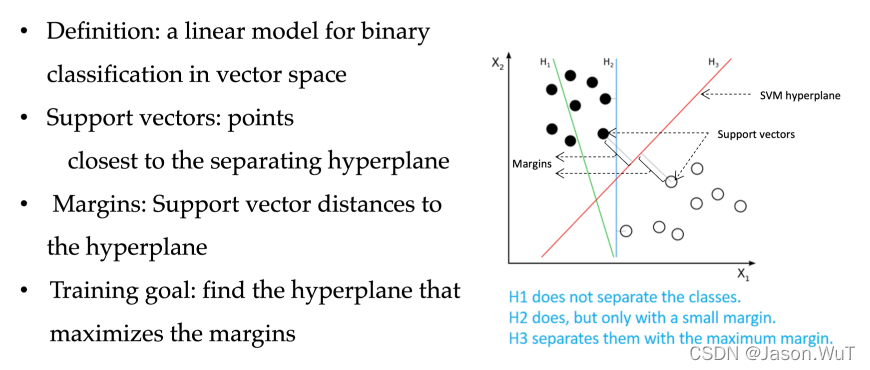

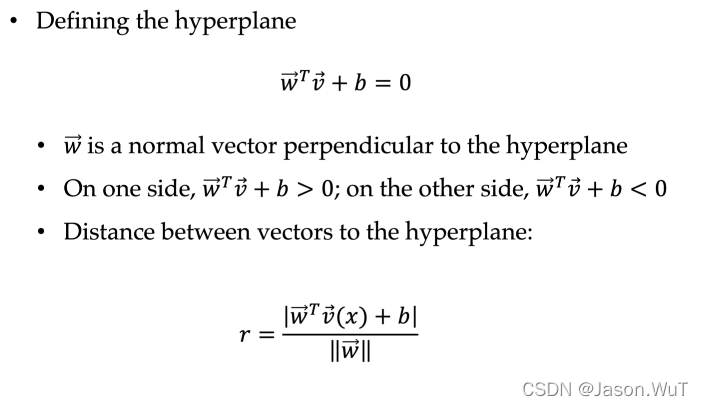

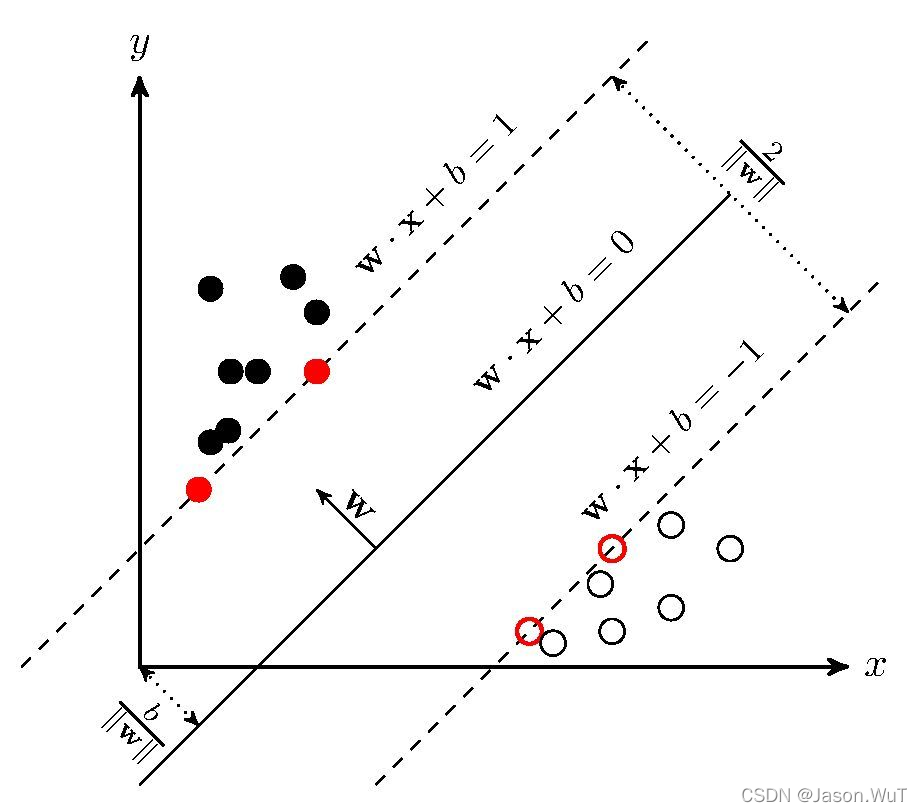

����:�����ռ��ж�Ԫ���������ģ��

֧�������Ķ���:�������ij�ƽ������ı�ǵ�

����Ķ���:֧�������볬ƽ��֮��ľ���

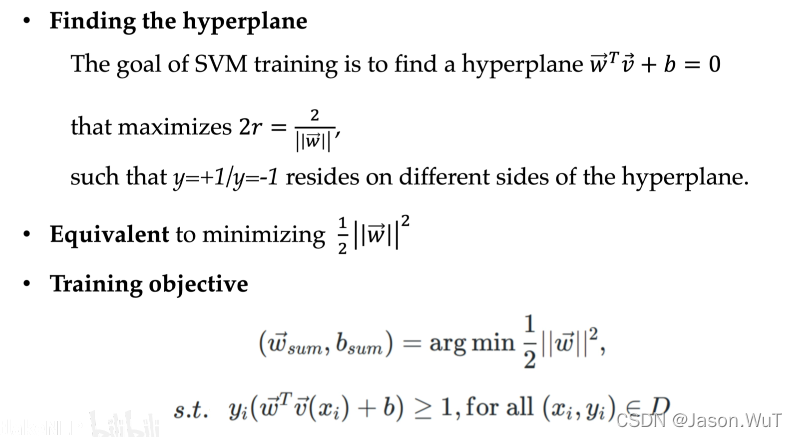

ѵ��Ŀ��:Ѱ�������ij�ƽ��

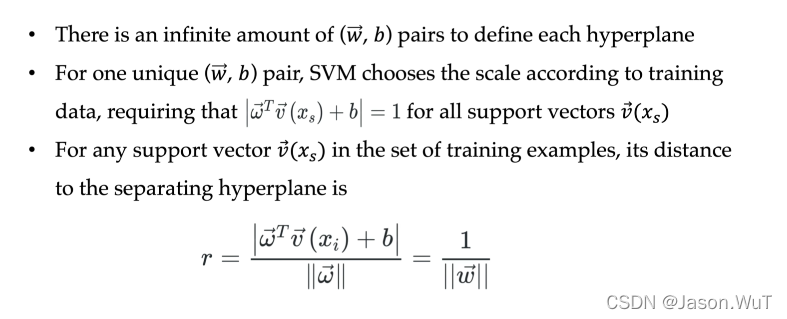

SVM��ģ

�����κ�һ��֧����������,SVMҪ��

�O

w

?

T

v

?

(

x

i

)

+

b

�O

=

1

|\vec{w}^T\vec{v}(x_i)+b| = 1

�OwTv(xi?)+b�O=1,��������ʹ�����ü��

Լ������������������:�����κ�һ��ѵ����������,������ƽ��ľ��붼Ҫ���ڵ��ڱʾ���

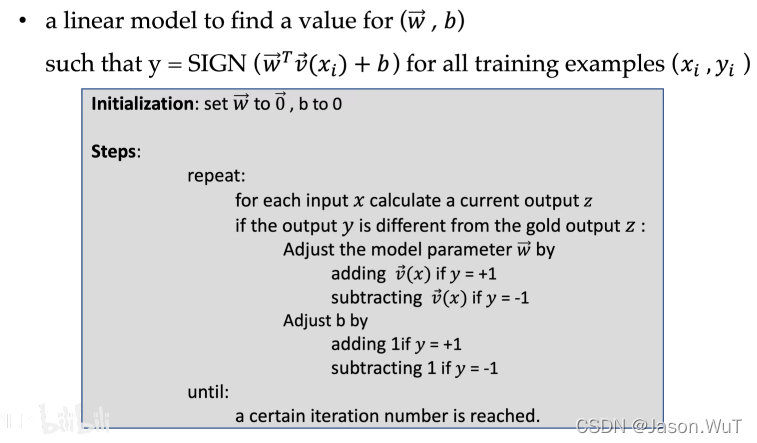

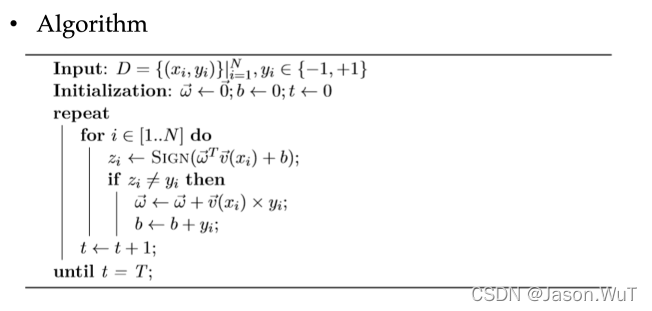

Perceptron(��֪��)

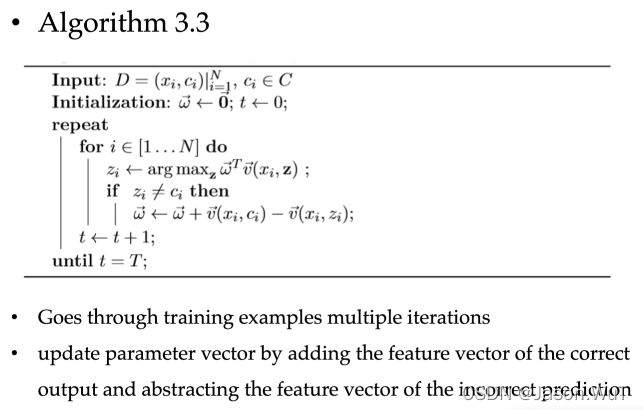

The perceptron algorithm

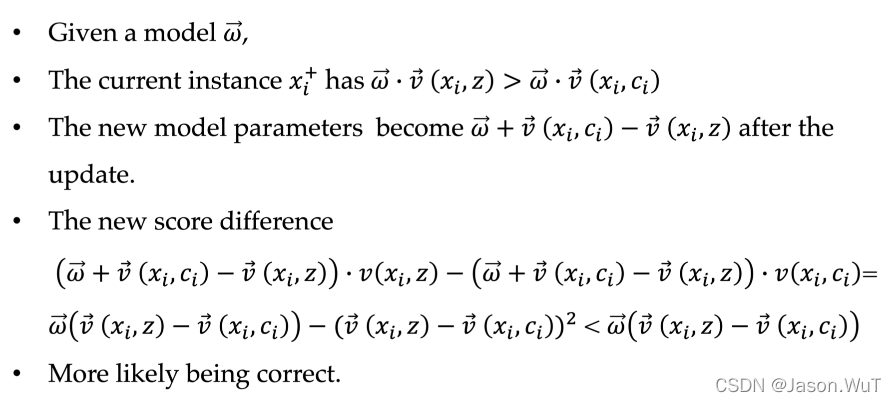

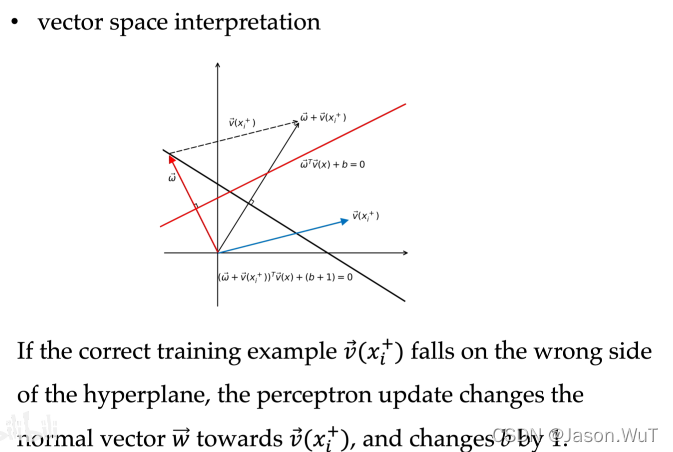

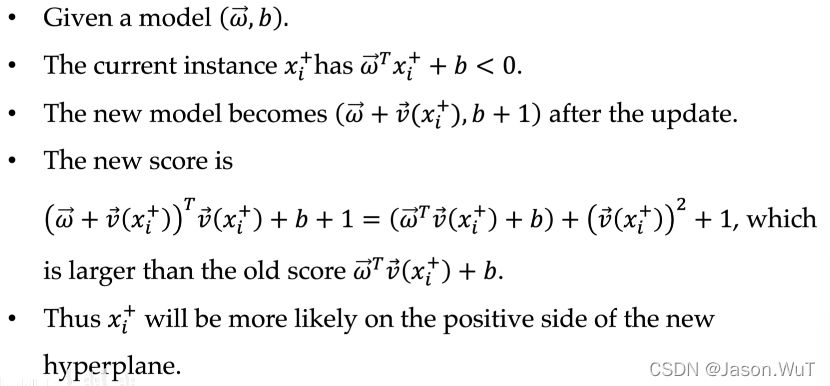

Perceptron update

Numerical Interpretation(��������)

SVM��֪������

Batch learning���������ѵ����������ѵ����,�����ѧϰ

Online learning�Ƕ�ÿ�������������²���

���������

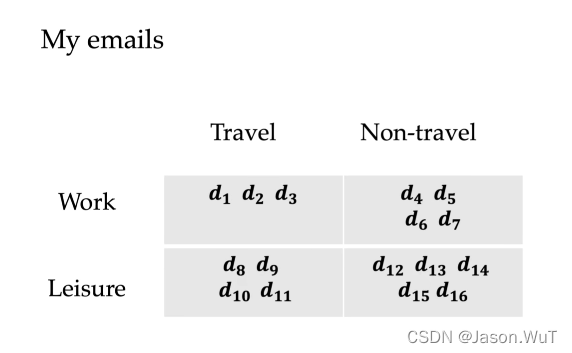

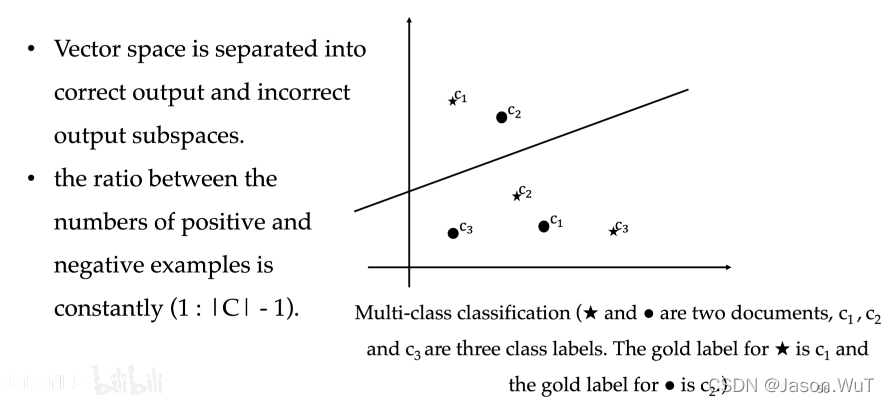

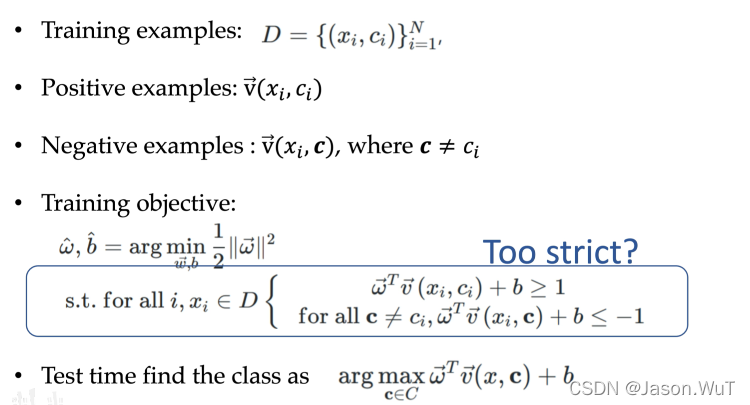

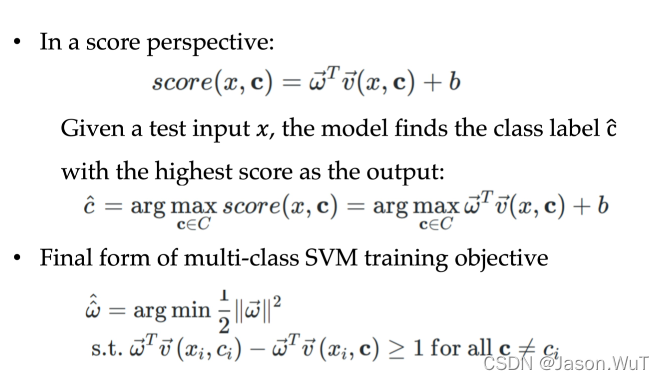

��ΰѶ���������Ӧ�õ������������?

����˼·:

- �����������ֳ�1���������

- ���ÿһ��couple,ѵ��һ��������,�ж�����������һ��

��������������

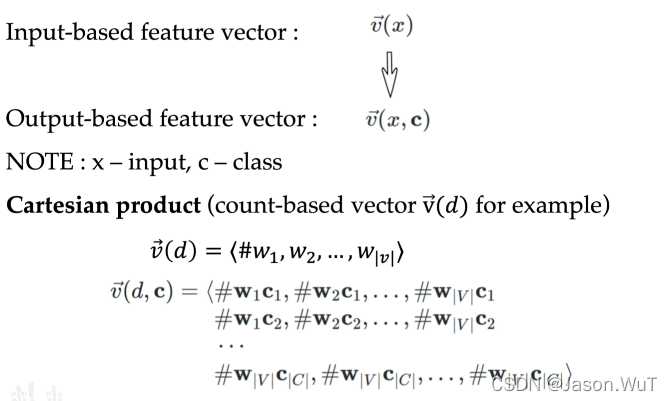

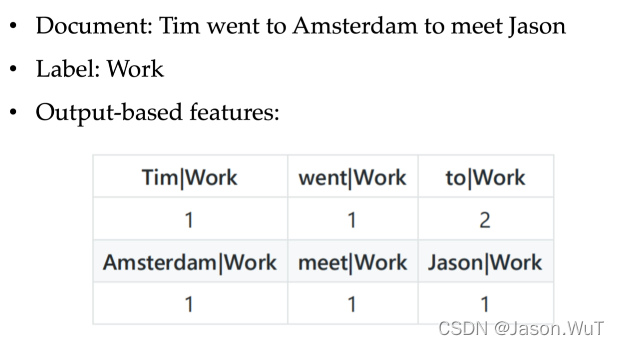

Output-based features

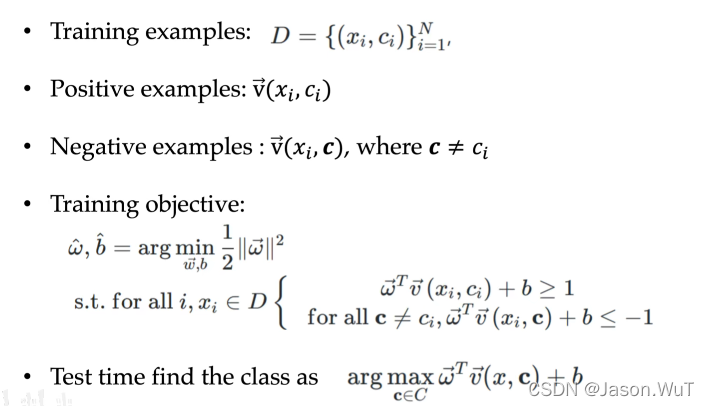

Multi-class SVM

Multi-class perceptron