正如您所料,通过依赖高级 API,我们可以更简洁地实现 MLP。

import torch

from torch import nn

from d2l import torch as d2l

4.3.1 模型

与我们简洁的 softmax 回归实现(第 3.7 节)相比,唯一的区别是我们添加了两个全连接层(之前,我们添加了一个)。第一个是我们的隐藏层,它包含 256 个隐藏单元并应用 ReLU 激活函数。第二个是我们的输出层。

net = nn.Sequential(nn.Flatten(),

nn.Linear(784, 256),

nn.ReLU(),

nn.Linear(256, 10))

def init_weights(m):

if type(m) == nn.Linear:

nn.init.normal_(m.weight, std=0.01)

net.apply(init_weights);

训练循环与我们实现 softmax 回归时完全相同。这种模块化使我们能够将有关模型架构的问题与正交考虑分开。

batch_size, lr, num_epochs = 256, 0.1, 10

loss = nn.CrossEntropyLoss(reduction='none')

trainer = torch.optim.SGD(net.parameters(), lr=lr)

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size)

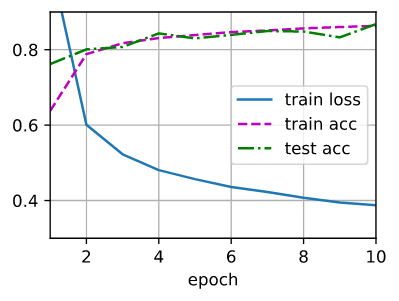

d2l.train_ch3(net, train_iter, test_iter, loss, num_epochs, trainer)

4.3.2. 概括

-

使用高级 API,我们可以更简洁地实现 MLP。

-

对于相同的分类问题,MLP 的实现与 softmax 回归的实现相同,只是增加了带有激活函数的隐藏层。

4.3.3. 练习

-

- 尝试添加不同数量的隐藏层(您也可以修改学习率)。什么设置效果最好?

-

- 尝试不同的激活函数。哪一个效果最好?

-

- 尝试不同的方案来初始化权重。什么方法效果最好?

参考

https://d2l.ai/chapter_multilayer-perceptrons/mlp-concise.html