���ر�Ҷ˹

1��ʲô�����ر�Ҷ˹�㷨

(1)��������:���ر�Ҷ˹ = �����ء�+��Ҷ˹

����:�ٶ�����֮�䶼������������(�������������Ƚϳ���,����ʹ�þ���ʵ��˵��)

��Ҷ˹:��Ҷ˹����

p

(

y

�O

x

)

=

p

(

x

�O

y

)

?

p

(

y

)

p

(

x

)

֤

��

:

p

(

x

,

y

)

=

p

(

x

�O

y

)

?

p

(

y

)

=

p

(

y

�O

x

)

?

p

(

x

)

��

��

��

:

p

(

y

�O

x

)

=

p

(

x

�O

y

)

?

p

(

y

)

p

(

x

)

p(y|x) = \frac{p(x|y)*p(y)}{p(x)} \\֤��:p(x,y) = p(x|y)*p(y) = p(y|x)*p(x)\\�����:p(y|x) = \frac{p(x|y)*p(y)}{p(x)}

p(y�Ox)=p(x)p(x�Oy)?p(y)?֤��:p(x,y)=p(x�Oy)?p(y)=p(y�Ox)?p(x)������:p(y�Ox)=p(x)p(x�Oy)?p(y)?

˵��:

1)p(y|x):�������

2)p(x|y):��Ȼ����

3)p(y):�������

4)p(x):�������ݵ���������

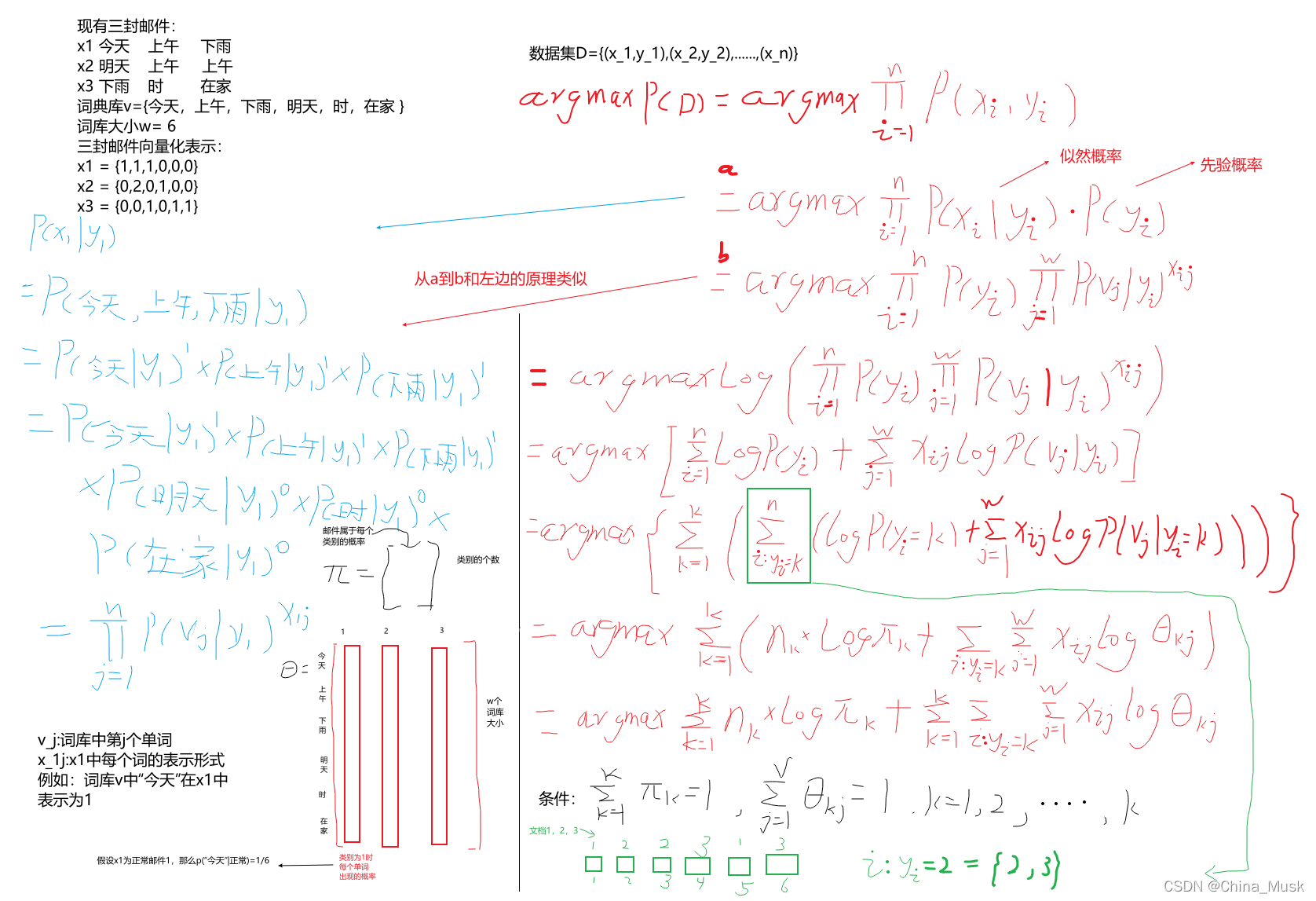

(2)�ٷ�����:���ر�Ҷ˹����(NBC)������Ҷ˹����Ϊ�������Ҽ�����������֮��������ķ���,��ͨ���Ѹ�����ѵ����,��������֮�������Ϊǰ�����,ѧϰ�����뵽��������ϸ��ʷֲ�,�ٻ���ѧϰ����ģ��,����X���ʹ�ú�������������Y��(�����ڰٶȰٿ�)

2�����ر�Ҷ˹��Ӧ��

1)�����ı�����������,���������ʼ��ķ���,�ı��������,��з���

2)����ʶ��

3)ͼ��ʶ��

3��ʹ�����ر�Ҷ˹�������ʼ����з���

������һ�������ʵ�����������ر�Ҷ˹ģ��,�ܹ���ֱ�۵��������ر�Ҷ˹ģ��

3.1�����ر�Ҷ˹�������ʼ��������������

1)ͳ�Ƴ�ÿһ�����ʶ�һ���ʼ���Ϊ�����ʼ��������ʼ��ĸ���

2)����Щͳ�ƵĽ����һ���µ��ʼ���Ԥ��

3.2��ʵ��

1)��:�������ʼ�,�����������ʼ�,�������ʼ�,�ʼ��г����ˡ�����,����Ʒ��,�����ǡ�,����桰,���⡰�ȴʡ����Ƿֱ�ͳ����Щ�ʳ����������ʼ��еĸ���,�����������ʼ��еĸ���

�������ʼ����С�����,����Ʒ��,�����ǡ�,����桰,���⡰�ʵĸ���Ϊ

p

(

��

��

�O

��

��

��

��

)

=

1

80

p

(

��

Ʒ

�O

��

��

��

��

)

=

1

60

p

(

��

��

�O

��

��

��

��

)

=

1

60

p

(

��

��

�O

��

��

��

��

)

=

1

48

p

(

��

�O

��

��

��

��

)

=

1

80

p

(

��

��

)

=

2

3

(

��

��

:

��

��

��

��

��

��

��

��

��

��

��

��

;

��

ĸ

:

��

��

��

��

��

)

\begin{aligned} p(����|�����ʼ�)&=\frac{1}{80}\\p(��Ʒ|�����ʼ�)&=\frac{1}{60}\\p(����|�����ʼ�)&=\frac{1}{60}\\p(���|�����ʼ�)&=\frac{1}{48}\\p(��|�����ʼ�)&=\frac{1}{80}\\p(����)&=\frac{2}{3}\quad (����:�����ʼ��������ʼ��ĸ���;��ĸ:�ʼ�������) \end{aligned}

p(�����O��������)p(��Ʒ�O��������)p(�����O��������)p(�����O��������)p(���O��������)p(����)?=801?=601?=601?=481?=801?=32?(����:������������������������;��ĸ:����������)?

�����ʼ����С�����,����Ʒ��,�����ǡ�,����桰,���⡰�ʵĸ���Ϊ

p

(

��

��

�O

��

��

��

��

)

=

7

120

p

(

��

Ʒ

�O

��

��

��

��

)

=

1

30

p

(

��

��

�O

��

��

��

��

)

=

1

40

p

(

��

��

�O

��

��

��

��

)

=

1

30

p

(

��

�O

��

��

��

��

)

=

0

p

(

��

��

)

=

2

3

(

��

��

:

��

��

��

��

��

��

��

��

��

��

��

��

;

��

ĸ

:

��

��

��

��

��

)

\begin{aligned} p(����|�����ʼ�)&=\frac{7}{120}\\p(��Ʒ|�����ʼ�)&=\frac{1}{30}\\p(����|�����ʼ�)&=\frac{1}{40}\\p(���|�����ʼ�)&=\frac{1}{30}\\p(��|�����ʼ�)&=0\\p(����)&=\frac{2}{3}\quad (����:�����ʼ��������ʼ��ĸ���;��ĸ:�ʼ�������) \end{aligned}

p(�����O��������)p(��Ʒ�O��������)p(�����O��������)p(�����O��������)p(���O��������)p(����)?=1207?=301?=401?=301?=0=32?(����:������������������������;��ĸ:����������)?

�յ����µ�һ���ʼ�E(������Ʒ�ⲻ�ǹ��),���������ʼ����������ʼ�?

p

(

E

�O

��

��

��

��

)

=

p

(

��

��

,

��

Ʒ

,

��

,

��

��

,

��

��

�O

��

��

��

��

)

?

p

(

��

��

��

��

)

p

(

��

��

��

��

)

=

p

(

��

��

�O

��

��

��

��

)

?

p

(

��

Ʒ

�O

��

��

��

��

)

?

p

(

��

�O

��

��

��

��

)

?

p

(

��

��

�O

��

��

��

��

)

?

p

(

��

��

�O

��

��

��

��

)

?

p

(

��

��

��

��

)

p

(

��

��

��

��

)

(

��

��

��

��

��

��

��

��

��

��

ת

��

��

��

��

��

��

��

,

ǰ

��

��

��

һ

��

ʼ

��

��

��

��

��

��

��

��

,

��

��

û

��

��

��

��

��

,

��

ʽ

��

��

��

��

��

��

��

)

=

1

80

?

1

60

?

1

80

?

1

60

?

1

48

?

2

3

p

(

��

��

��

��

)

p

(

E

�O

��

��

��

��

)

=

p

(

��

��

,

��

Ʒ

,

��

,

��

��

,

��

��

�O

��

��

��

��

)

?

p

(

��

��

��

��

)

p

(

��

��

��

��

)

=

p

(

��

��

�O

��

��

��

��

)

?

p

(

��

Ʒ

�O

��

��

��

��

)

?

p

(

��

�O

��

��

��

��

)

?

p

(

��

��

�O

��

��

��

��

)

?

p

(

��

��

�O

��

��

��

��

)

?

p

(

��

��

��

��

)

p

(

��

��

��

��

)

=

7

120

?

1

30

?

0

?

1

40

?

1

30

?

1

3

p

(

��

��

��

��

)

\begin{aligned} p(E|�����ʼ�) &= \frac{p(����,��Ʒ,��,����,���|�����ʼ�)*p(�����ʼ�)}{p(�ʼ�����)}\\ &=\frac{p(����|�����ʼ�)*p(��Ʒ|�����ʼ�)*p(��|�����ʼ�)*p(����|�����ʼ�)*p(���|�����ʼ�)*p(�����ʼ�)}{p(�ʼ�����)} {\quad(���������ǰ����ϸ���ת��������������,ǰ�����һ��ʼ���ᵽ�ġ����ء�,���û���������,��ʽ�Dz��ܻ��Ⱥŵ�)}\\ &=\frac{\frac{1}{80}*\frac{1}{60}*\frac{1}{80}*\frac{1}{60}*\frac{1}{48}*\frac{2}{3}}{p(�ʼ�����)}\\ p(E|�����ʼ�) &= \frac{p(����,��Ʒ,��,����,���|�����ʼ�)*p(�����ʼ�)}{p(�ʼ�����)}\\ &=\frac{p(����|�����ʼ�)*p(��Ʒ|�����ʼ�)*p(��|�����ʼ�)*p(����|�����ʼ�)*p(���|�����ʼ�)*p(�����ʼ�)}{p(�ʼ�����)} \\ &=\frac{\frac{7}{120}*\frac{1}{30}*0*\frac{1}{40}*\frac{1}{30}*\frac{1}{3}}{p(�ʼ�����)} \end{aligned}

p(E�O��������)p(E�O��������)?=p(��������)p(����,��Ʒ,��,����,�����O��������)?p(��������)?=p(��������)p(�����O��������)?p(��Ʒ�O��������)?p(���O��������)?p(�����O��������)?p(�����O��������)?p(��������)?(��������������������ת��������������,ǰ������һ��ʼ����������������,����û����������,��ʽ��������������)=p(��������)801??601??801??601??481??32??=p(��������)p(����,��Ʒ,��,����,�����O��������)?p(��������)?=p(��������)p(�����O��������)?p(��Ʒ�O��������)?p(���O��������)?p(�����O��������)?p(�����O��������)?p(��������)?=p(��������)1207??301??0?401??301??31???

ͨ������ļ���,���ǿ��Կ�����ĸ��ͬ�������P(E|�����ʼ�)���Դ���P(E|�����ʼ�)=0,�����Ϊ������ۺ�����?�����Dz�������,ԭ���ǻ����ʼ�����ij�������ʼ��Ĺؼ���,������ʼ�����һ���������ʼ�,ͬ�������ʼ�Ҳ�����,�����������������������ij���ؼ��ʵ���������Ϊ0,��ν�����������?�𰸾��Dz���ƽ��

2)ʲô��ƽ��?��˵�ϻ�ֱ���Ϲ�ʽ

p

(

w

�O

y

=

c

)

=

��

��

��

��

��

��

��

w

��

��

��

��

��

+

1

��

��

Ϊ

c

��

��

��

��

��

��

��

��

��

��

��

��

��

��

+

v

v

:

��

��

��

��

С

p(w|y=c)=\frac{���Ͽ��еĵ���w���ֵĴ���+1}{���Ϊc�����Ͽ��а������еĵ��ʸ���+v}\\v:�ʵ�Ĵ�С

p(w�Oy=c)=����Ϊc����������������������������+v��������������w����������+1?v:��������С

�����ĸΪʲôҪ��v(�ʵ�Ĵ�С)?

��:Ϊ����ÿһ���ʵ����������������Ϊ1,������һ���ʿ�v=[a,b,c,d,��]T(T:ת��),

��p(a|y=c)+p(b|y=c)+p(c|y=c)+p(d|y=c)+�� = 1

3)������һ���µ�����:

�������ʼ�,����8����

(1)��� ���� ��Ϣ

(2)���� ��Ʒ

(3)��Ϣ ��� ����

�������ʼ�,���� 6����

(1)����

(2)��Ϣ ��� �ʼ�

(3)���� ��Ϣ

���ʼ�:S = ���� ��Ʒ ��� ���� ��Ʒ

���ʼ�S�������ʼ����������ʼ�?

�����ʿ�v={���,����,��Ϣ,����,��Ʒ,����,����,���,�ʼ�}

��������n=9

p

(

��

��

�O

��

��

��

��

)

=

0

+

1

6

+

9

p

(

��

��

�O

��

��

��

��

)

=

0

+

1

6

+

9

p

(

��

Ϣ

�O

��

��

��

��

)

=

2

+

1

6

+

9

p

(

��

��

�O

��

��

��

��

)

=

1

+

1

6

+

9

p

(

��

Ʒ

�O

��

��

��

��

)

=

0

+

1

6

+

9

p

(

��

��

�O

��

��

��

��

)

=

0

+

1

6

+

9

p

(

��

��

�O

��

��

��

��

)

=

1

+

1

6

+

9

p

(

��

��

�O

��

��

��

��

)

=

1

+

1

6

+

9

p

(

��

��

�O

��

��

��

��

)

=

1

+

1

6

+

9

p

(

��

��

��

��

)

=

1

2

\begin{aligned} p(���|�����ʼ�)&=\frac{0+1}{6+9}\\p(����|�����ʼ�)&=\frac{0+1}{6+9}\\p(��Ϣ|�����ʼ�)&=\frac{2+1}{6+9}\\p(����|�����ʼ�)&=\frac{1+1}{6+9}\\p(��Ʒ|�����ʼ�)&=\frac{0+1}{6+9}\\p(����|�����ʼ�)&=\frac{0+1}{6+9}\\p(����|�����ʼ�)&=\frac{1+1}{6+9}\\p(���|�����ʼ�)&=\frac{1+1}{6+9}\\p(�ʼ�|�����ʼ�)&=\frac{1+1}{6+9}\\p(�����ʼ�)=\frac{1}{2} \end{aligned}

p(�����O��������)p(�����O��������)p(��Ϣ�O��������)p(�����O��������)p(��Ʒ�O��������)p(�����O��������)p(�����O��������)p(�����O��������)p(�����O��������)p(��������)=21??=6+90+1?=6+90+1?=6+92+1?=6+91+1?=6+90+1?=6+90+1?=6+91+1?=6+91+1?=6+91+1??

p ( �� �� �O �� �� �� �� ) = 2 + 1 8 + 9 p ( �� �� �O �� �� �� �� ) = 1 + 1 8 + 9 p ( �� Ϣ �O �� �� �� �� ) = 2 + 1 8 + 9 p ( �� �� �O �� �� �� �� ) = 1 + 1 8 + 9 p ( �� Ʒ �O �� �� �� �� ) = 1 + 1 8 + 9 p ( �� �� �O �� �� �� �� ) = 1 + 1 8 + 9 p ( �� �� �O �� �� �� �� ) = 0 + 1 8 + 9 p ( �� �� �O �� �� �� �� ) = 0 + 1 8 + 9 p ( �� �� �O �� �� �� �� ) = 0 + 1 8 + 9 p ( �� �� �� �� ) = 1 2 \begin{aligned} p(���|�����ʼ�)&=\frac{2+1}{8+9}\\p(����|�����ʼ�)&=\frac{1+1}{8+9}\\p(��Ϣ|�����ʼ�)&=\frac{2+1}{8+9}\\p(����|�����ʼ�)&=\frac{1+1}{8+9}\\p(��Ʒ|�����ʼ�)&=\frac{1+1}{8+9}\\p(����|�����ʼ�)&=\frac{1+1}{8+9}\\p(����|�����ʼ�)&=\frac{0+1}{8+9}\\p(���|�����ʼ�)&=\frac{0+1}{8+9}\\p(�ʼ�|�����ʼ�)&=\frac{0+1}{8+9}\\p(�����ʼ�)=\frac{1}{2} \end{aligned} p(�����O��������)p(�����O��������)p(��Ϣ�O��������)p(�����O��������)p(��Ʒ�O��������)p(�����O��������)p(�����O��������)p(�����O��������)p(�����O��������)p(��������)=21??=8+92+1?=8+91+1?=8+92+1?=8+91+1?=8+91+1?=8+91+1?=8+90+1?=8+90+1?=8+90+1??

����������ʿ���ÿ���ʵ���������,ʹ�ü�1ƽ����,��ĸ�Ӵʿ�Ĵ�Сn=9,ʹP(v|�����ʼ�)=1;P(v|�����ʼ�)=1,���ԼӼӿ�!

p

(

S

�O

��

��

��

��

)

=

p

(

��

��

,

��

Ʒ

,

��

��

,

��

��

,

��

Ʒ

�O

��

��

��

��

)

?

p

(

��

��

��

��

)

p

(

��

��

��

��

)

=

p

(

��

��

�O

��

��

��

��

)

?

p

(

��

Ʒ

�O

��

��

��

��

)

?

p

(

��

��

�O

��

��

��

��

)

?

p

(

��

��

�O

��

��

��

��

)

?

p

(

��

Ʒ

�O

��

��

��

��

)

?

p

(

��

��

��

��

)

p

(

��

��

��

��

)

=

2

15

?

1

15

?

1

15

?

1

15

?

1

15

?

1

2

p

(

��

��

��

��

)

p

(

S

�O

��

��

��

��

)

=

p

(

��

��

,

��

Ʒ

,

��

��

,

��

��

,

��

Ʒ

�O

��

��

��

��

)

?

p

(

��

��

��

��

)

p

(

��

��

��

��

)

=

p

(

��

��

�O

��

��

��

��

)

?

p

(

��

Ʒ

�O

��

��

��

��

)

?

p

(

��

��

�O

��

��

��

��

)

?

p

(

��

��

�O

��

��

��

��

)

?

p

(

��

Ʒ

�O

��

��

��

��

)

?

p

(

��

��

��

��

)

p

(

��

��

��

��

)

=

2

17

?

2

17

?

3

17

?

2

17

?

2

17

?

1

2

p

(

��

��

��

��

)

\begin{aligned} p(S|�����ʼ�)&=\frac{p(����,��Ʒ,���,����,��Ʒ|�����ʼ�)*p(�����ʼ�)}{p(�ʼ�����)}\\ &=\frac{p(����|�����ʼ�)*p(��Ʒ|�����ʼ�)*p(���|�����ʼ�)*p(����|�����ʼ�)*p(��Ʒ|�����ʼ�)*p(�����ʼ�)}{p(�ʼ�����)}\\ &=\frac{\frac{2}{15}*\frac{1}{15}*\frac{1}{15}*\frac{1}{15}*\frac{1}{15}*\frac{1}{2}}{p(�ʼ�����)}\\ p(S|�����ʼ�)&=\frac{p(����,��Ʒ,���,����,��Ʒ|�����ʼ�)*p(�����ʼ�)}{p(�ʼ�����)}\\ &=\frac{p(����|�����ʼ�)*p(��Ʒ|�����ʼ�)*p(���|�����ʼ�)*p(����|�����ʼ�)*p(��Ʒ|�����ʼ�)*p(�����ʼ�)}{p(�ʼ�����)}\\ &=\frac{\frac{2}{17}*\frac{2}{17}*\frac{3}{17}*\frac{2}{17}*\frac{2}{17}*\frac{1}{2}}{p(�ʼ�����)} \end{aligned}

p(S�O��������)p(S�O��������)?=p(��������)p(����,��Ʒ,����,����,��Ʒ�O��������)?p(��������)?=p(��������)p(�����O��������)?p(��Ʒ�O��������)?p(�����O��������)?p(�����O��������)?p(��Ʒ�O��������)?p(��������)?=p(��������)152??151??151??151??151??21??=p(��������)p(����,��Ʒ,����,����,��Ʒ�O��������)?p(��������)?=p(��������)p(�����O��������)?p(��Ʒ�O��������)?p(�����O��������)?p(�����O��������)?p(��Ʒ�O��������)?p(��������)?=p(��������)172??172??173??172??172??21???

������ǵó�:

��Ϊp(S|�����ʼ�)<p(S|�����ʼ�),����SΪ�����ʼ��Ŀ����Ի����

**Tips:���ǿ��Կ���������������������ʷdz�С,�ڼ���������׳��֡����������,Ϊ�˱�����������Ǽ���log,����log(p1 p2 p3) = logp1+logp2+log3,�ҾͲ���������������!

4�����ر�Ҷ˹�������Ȼ����

4.1��Ԥ��֪ʶ

1)�����Ȼ����:

�����Ȼ�ĺ���:����δ֪����Ϊ��,��֪������ΪD,�����Ȼ����ͨ�����P(D|��)�����δ֪������

�����Ȼ���Ƶ���ϸ�����������ع�һ����������ϸ����,�Ͳ�������

2)�������������Ż�

����Լ���������Ż�:

��

1.

��

f

(

x

)

=

x

2

?

2

x

?

3

��

��

С

ֵ

��

:

f

��

(

x

)

=

2

x

?

2

��

f

��

(

x

)

=

0

��

x

=

1

\begin{aligned} ��1.��f(x) = x^2 - 2x - 3����Сֵ\\ ��:f^{'}(x) = 2x - 2 \\ ��f^{'}(x)=0\\��x=1 \end{aligned}

��1.��f(x)=x2?2x?3����Сֵ��:f��(x)=2x?2��f��(x)=0��x=1?

�ڴ�Լ���������Ż�-�������ճͷ���

��

f

(

x

,

y

)

=

x

+

y

��

��

��

ֵ

,

��

��

��

��

��

��

x

2

+

y

2

=

1

��

:

��

x

2

+

y

2

=

1

��

x

2

+

y

2

?

1

=

0

��

f

(

x

,

y

,

��

)

=

x

+

y

+

��

(

x

2

+

y

2

?

1

)

{

f

x

��

(

x

,

y

,

��

)

=

1

+

2

��

x

=

0

f

y

��

(

x

,

y

,

��

)

=

1

+

2

��

y

=

0

f

��

��

(

x

,

y

,

��

)

=

x

2

+

y

2

?

1

=

0

��

:

{

��

1

=

2

2

x

1

=

?

2

2

y

1

=

?

2

2

{

��

2

=

?

2

2

x

2

=

2

2

y

2

=

2

2

��

��

:

��

��

f

(

x

,

y

)

=

x

+

y

��

��

��

ֵ

Ϊ

{

��

2

=

?

2

2

x

2

=

2

2

y

2

=

2

2

��f(x,y)=x+y�����ֵ,���и�������x^{2}+y^2 = 1\\��:��x^2+y^2 = 1 \\��x^2+y^2 - 1 =0 \\ ��f(x,y,\lambda) = x + y + \lambda{(x^2+y^2 - 1)}\\ \begin{cases} f^{'}_x(x,y,\lambda) = 1+2\lambda{x}=0 \\ f^{'}_y(x,y,\lambda) = 1+2\lambda{y}=0 \\ f^{'}_{\lambda}(x,y,\lambda) = x^2+y^2-1=0 \end{cases}\\ ��: \begin{cases} \lambda_{1} = \frac{\sqrt{2}}{2} \\ x_1 = -\frac{\sqrt{2}}{2} \\ y_1 = -\frac{\sqrt{2}}{2}\\ \end{cases}\quad \begin{cases} \lambda_{2} = -\frac{\sqrt{2}}{2} \\ x_2 = \frac{\sqrt{2}}{2} \\ y_2 = \frac{\sqrt{2}}{2}\\ \end{cases}\\ ����:����f(x,y)=x+y����ֵΪ\\ \begin{cases} \lambda_{2} = -\frac{\sqrt{2}}{2} \\ x_2 = \frac{\sqrt{2}}{2} \\ y_2 = \frac{\sqrt{2}}{2}\\ \end{cases}

��f(x,y)=x+y������ֵ,������������x2+y2=1��:��x2+y2=1��x2+y2?1=0��f(x,y,��)=x+y+��(x2+y2?1)??????fx��?(x,y,��)=1+2��x=0fy��?(x,y,��)=1+2��y=0f����?(x,y,��)=x2+y2?1=0?��:??????��1?=22??x1?=?22??y1?=?22?????????��2?=?22??x2?=22??y2?=22???����:����f(x,y)=x+y������ֵΪ??????��2?=?22??x2?=22??y2?=22???

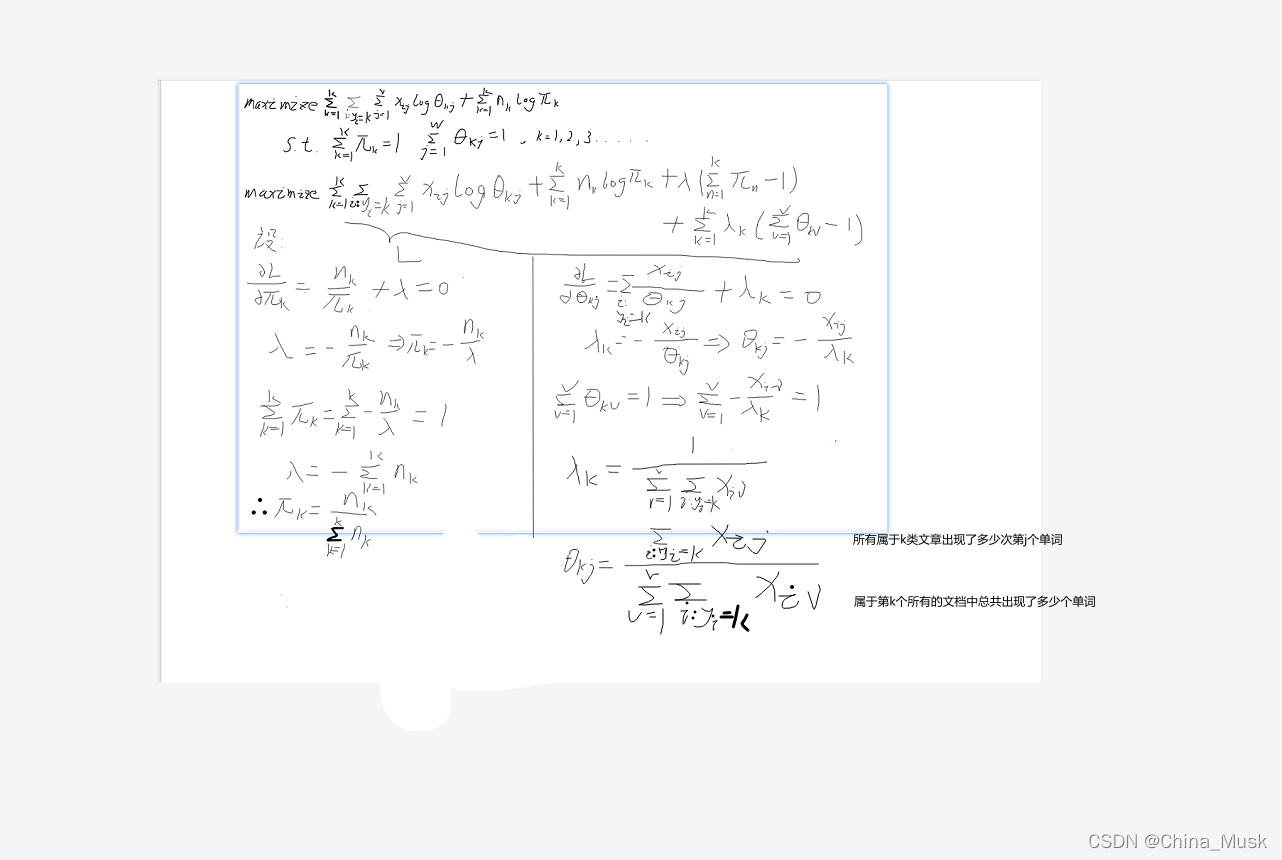

4.2���õ����ر�Ҷ˹��Ŀ�꺯��

4.3����Ŀ�꺯�������