Note: 本文收集transformer领域的较流行的综述文章,将认为比较重要的内容整理在一起,用于学习和提供思路。

1.谷歌:Efficient Transformers: A Survey(2020年9月)

2.华为、北大:A Survey on Visual Transformer(2020年12月)

3.复旦大学邱锡鹏组综述:A Survey of Transformers(2021年6月15日)

该篇综述以transformer结构变形为重点,分析了Module-level、Arc-level、PTM等结构和方法,给出了明确清晰的变形思路和路径。

随着transfomer的成功,各种基于原始transfomrer的变形不断被提出,作者将其归纳为3个方面:

- 模型效率:由于原始self-attention模块的计算复杂度和内存要求,在长序列情况下应用transformer是一个挑战,提升方法包括轻量化模型(如稀疏注意力变形)和分而治之的方法。

- 模型泛化:因为transformer是一个灵活的结构,在输入数据的几乎不作任何结构偏置的假设,这导致在小数据集上训练困难,容易过拟合。提升方法包括引入结构偏置或者正则化,在大规模数据上无监督训练等。

- 模型适应:主要为了将transformer用于特定的下游任务和应用。

attention-module

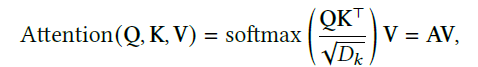

这里关注一下softmax函数,

D

k

\sqrt{D_{k}}

Dk??的作用是为了缓解softmax函数的梯度消失问题。

依据Q,K,V ,transformer中有三种类型的注意力:self-attention(基本module)、masked self-attention(序列上下文位置信息,只依赖于之前信息,预测未来的信息)、Cross-attention(encoder与decoder之间的信息传递)。

Model usage

- Encoder-Decoder :引入全部transformer结构,常用于序列到序列建模。

- Encoder only:只使用编码器,编码器的输出用作输入序列的表示。这通常用于分类或序列标签问题。

- Decoder only:仅使用解码器,encoder-decoder cross attention 也被移除。这通常用于序列生成,例如语言建模。

Model analysis

hidden-dimension :D

Sequence length: T

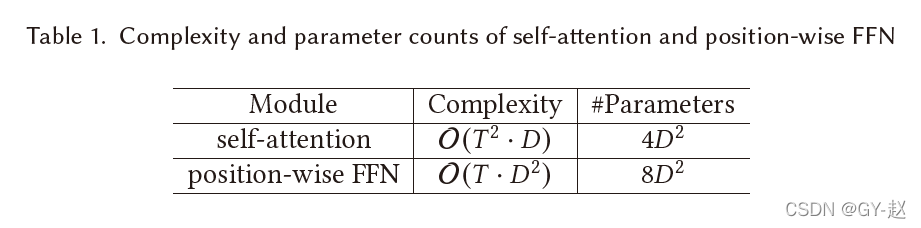

可见随着序列长度的增加,self-attention 的计算复杂度

O

(

T

2

?

D

)

O(T^{2}\cdot D)

O(T2?D)将快速上升,因此对于长序列计算来说,transformer仍面临挑战。

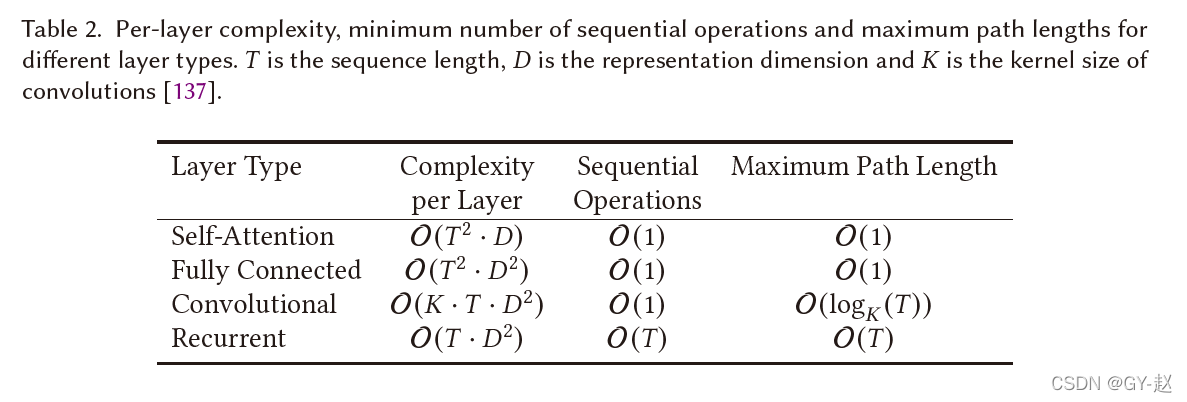

transformer结构与其它结构计算复杂度比较

self-attention的advantages:

- 它与全连接层具有相同的最大路径长度,因此适合于远程依赖关系建模。与全连接层相比,在处理可变长度输入时更具参数效率和灵活性。

- 由于卷积层的感受野有限,人们通常需要通过堆叠一个深层网络来获得全局感受野。另一方面,恒定的最大路径长度能够让self-attention 建模具有固定layers数量的长距离依赖。

- 固定的序列操作和最大路径长度使得self-attention比RNN网络更具并行性,更适合长距离建模。

inductive bias

transformer经常用来和CNN与RNN比较。众所周知,CNN利用共享的局部核函数施加平移不变性和局部性(局部权值共享)的归纳偏差,类似的,RNN通过其马尔可夫结构携带时间不变性和局部性的归纳偏差。Transformer结构对于数据的结构信息几乎不作任何假设,这使得trnasformer成为一种灵活、通用的体系结构,同时带来的负面影响就是在小数据集上容易过拟合。

另一种密切相关的网络类型是带有消息传递的图神经网络(GNNs)[149]。Transformer可以被看作是在一个完整的有向图(带有自循环)上定义的GNN,其中每个输入都是图中的一个节点。Transformer和GNNs之间的关键区别在于,Transformer没有引入关于输入数据结构的先验知识――Transformer中的消息传递过程完全依赖于内容的相似性度量。

TAXONOMY OF TRANSFORMERS

大量transformer模型变形已经被提出,主要可以分为以下三个方面:

- 结构修改

- 预训练模型PTM(pre-training model)

- 应用

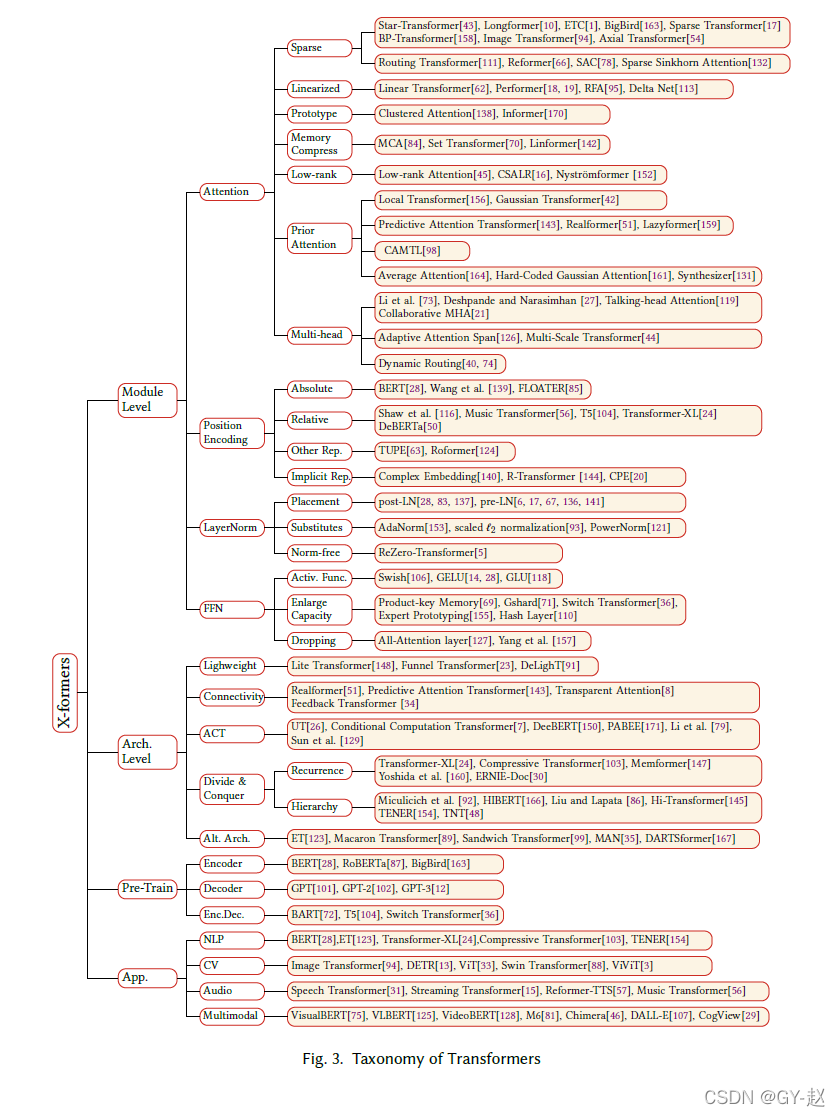

不同颜色对应不同的模块,左边是module的修改变形,中间是transformer结构,右边是三个方面对用的变形。

分类结构图

这篇文章主要关注结构方面的修改。

attention

self-attention 在transformer中扮演重要角色,但是在实际应用中仍然面临两个挑战:

- 复杂度。计算复杂度在长序列的情况下与序列长度平方正比。

- 结构先验。self-attention对输入没有假设任何结构化偏置,即使是顺序信息也是从训练集中学习得到,因此容易在小数据集上过拟合。

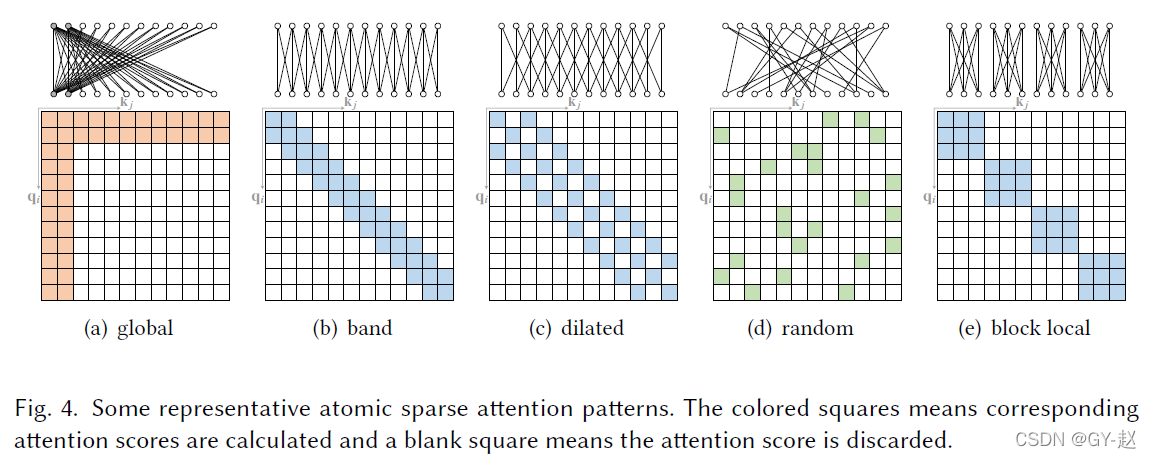

对应的提升方法可以分为以下几个方向: - Spase attention

由5种原子稀疏注意力模式互相组合而成,图中彩色部分为实际连接部分,对应q与k,上下两部分的图一一对应,图(b)、(c)是类似的,(d)是随机选取一些node。

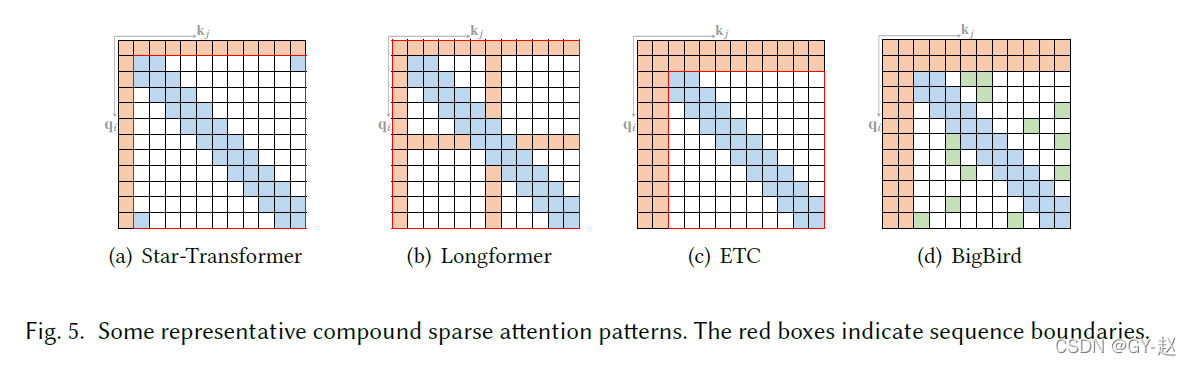

下图是原子稀疏注意力模式的组合形成的一些表征模式。

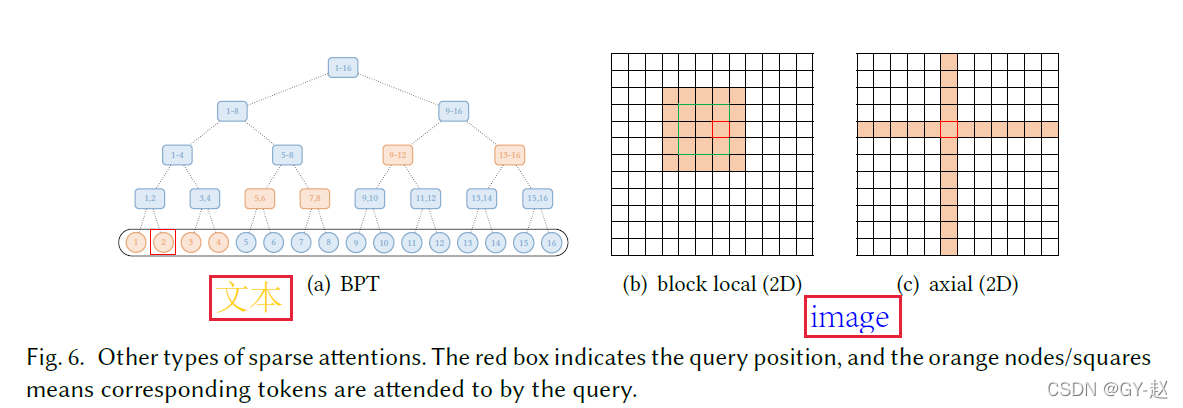

针对特定数据类型提出的稀疏性注意力模型。

-

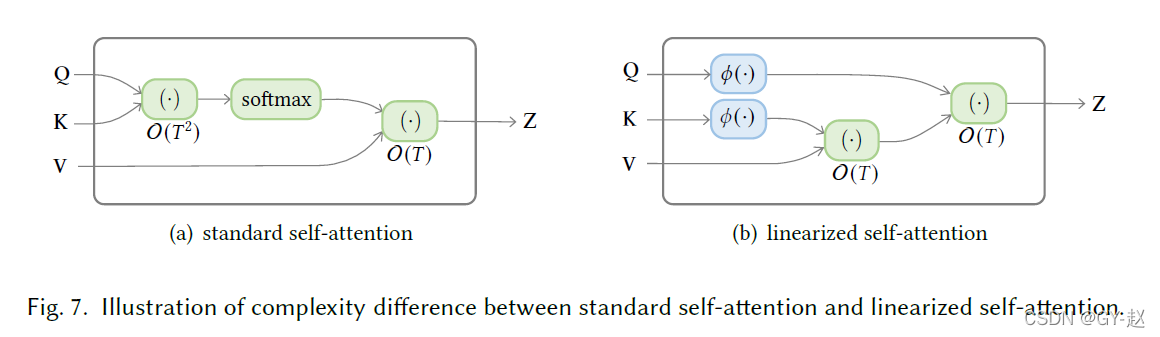

Lineariaed attention

将softmax非线性函数用特征映射函数 ? ( ? ) \phi(\cdot) ?(?)的内积来代替以降低计算复杂度。

即 使 用 ? ( Q ) ? ( K ) T 代 替 e x p ( Q k T ) 使用\phi(Q)\phi(K)^T 代替exp(Qk^{T}) 使用?(Q)?(K)T代替exp(QkT),这里的 ? \phi ?就是机器学习中的核函数

-

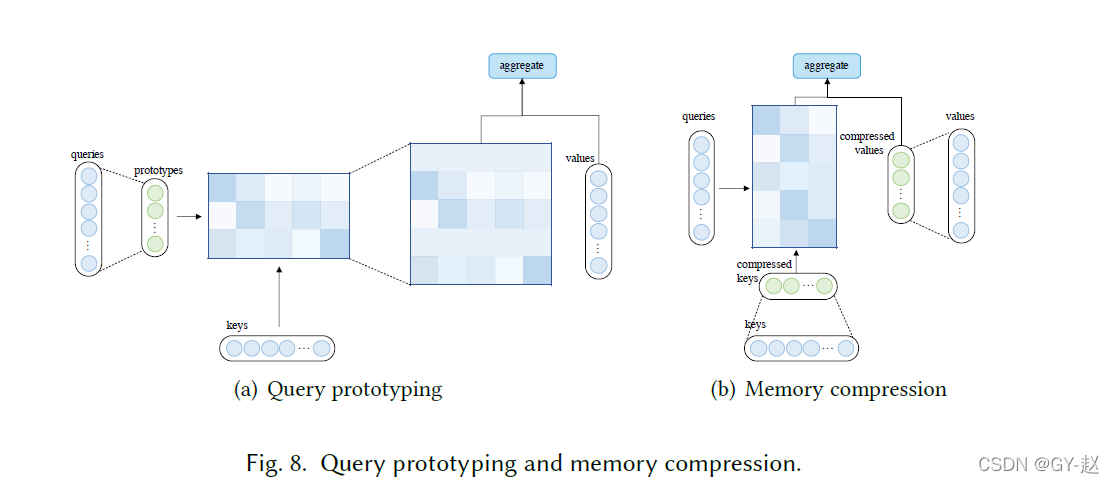

Prototype and memeory Compression.

除了稀疏注意力和基于核的线性attention,也可以通过减少query或者key-value对的的数目来减少attention 的复杂度,分别提出了query prototyping 、memory compression两种方法。

-

Low-rank self-attention

一些研究分析报告self-attention 矩阵A通常是低秩的(local-rank)。这里有两重含义:

- 低秩属性可以参数化显示建模-----注意力矩阵的rank小于序列长度这一事实表明,对于输入序列较短的场景,设置 D k > T D_k>T Dk?>T不仅导致参数量过多,而且导致过拟合。因此限制 D k D_k Dk?的维度,明确将 建模低秩属性作为inductive bias 是合理的。

- self-attention 矩阵可以使用低秩矩阵近似代替-----最相关的一种方法是核矩阵的低秩近似。

-

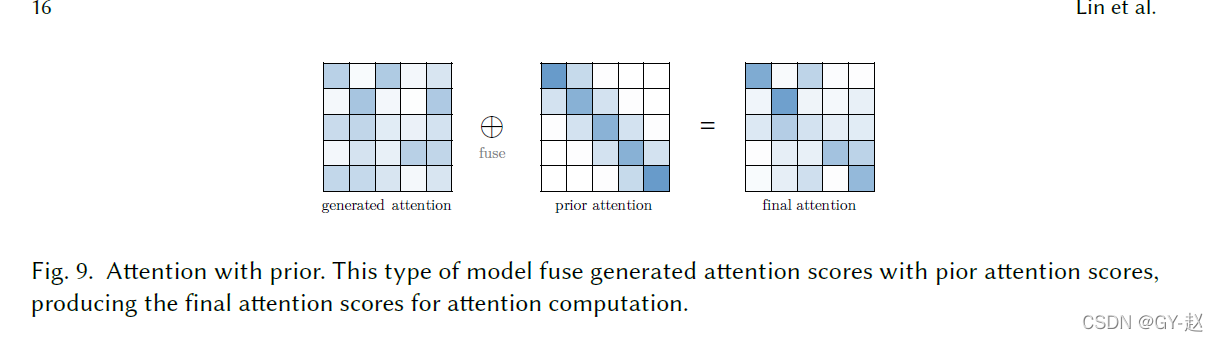

Attention with prior

注意力机制通常以向量加权和的方式输出一个期望值,其中权重是对values的注意力分布。通常分布是由输入数据产生的,但是也可以从其他来源产生,也就是先验。先验注意力分布可以作为原始数据分布的补充或替换,将这种形式称为attention with prior,如下图所示。在很多例子中,在大多数情况下,两种注意力分布的融合可以通过在应用softmax之前计算与先验和生成的注意力相对应的分数的加权和来实现。

-

Improved Multi-Head attention

多头注意是一种在不同位置共同关注不同表征子空间信息的能力。然而,没有任何机制可以保证不同的注意头确实捕捉到不同的特征。

使用多头注意的一个基本动机是允许模型共同关注来自不同位置的不同表征子空间的信息。然而,在vanilla Transformer中,没有明确的机制来保证注意头之间的不同行为,也没有任何机制让注意头相互作用。一系列工作致力于通过引入更复杂的机制来改进多头机制,这些机制可以引导不同注意头的行为或允许不同注意头之间的交互。

未来方向:

- 理论分析。transformer在大规模数据集的情况下表现要比CNN和RNN更好,数据集越大,性能越高,同时,transformer关于数据结构几乎没有任何先验假设,因此比起CNN和RNN更灵活。然而,理论上的原因还不清楚。

- 更好的全局交互机制。transformer的一大优点就是使用注意力机制在输入数据中的节点建模全局依赖。然而,许多研究表明,对于大部分节点,full attention 不是必须的。在某种程度上,不加区分地计算所有节点的attention是低效的。因此,在有效建模全局互动方面仍有很大的改进空间。一方面,self-attention可以看作是一个具有动态连接权值的全连接神经网络,通过动态路由聚合非局部信息,因此,其他动态路由机制是值得探索的替代方法。另一方面,全局交互也可以由其他类型的神经网络建模,例如记忆增强模型。

- 对于多模态数据的统一框架。在许多应用场景中,集成多模态可以提高模型性能,通用AI也需要各种跨模态语义关系。transformer在文本、图像、语音、视频都取得了巨大的成功,因此有机会构建一个统一模型。

4.中科院、东南大学、联想公司 :A Survey of Visual Transformers(2021年11月)

5.清华、南开:Attention Mechanisms in Computer Vision:A Survey(2021年11月)

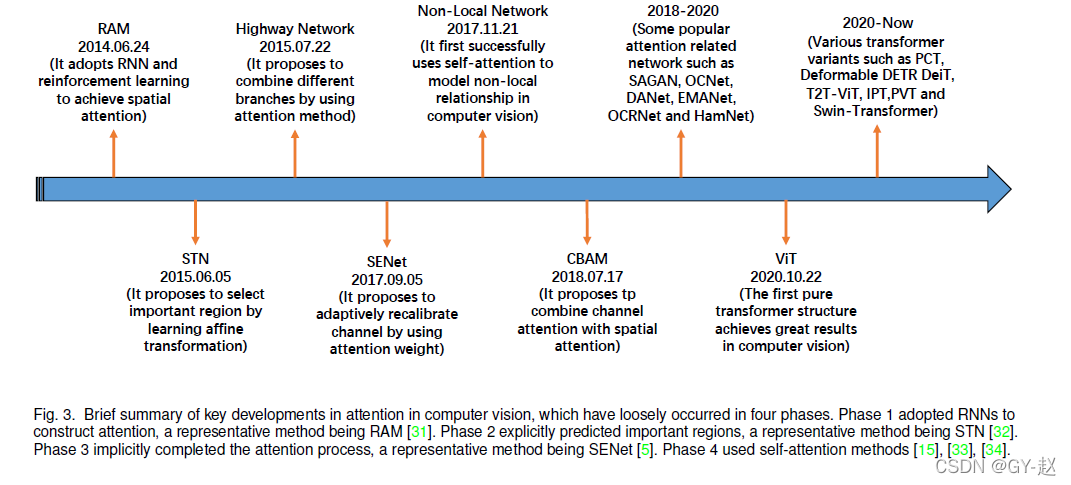

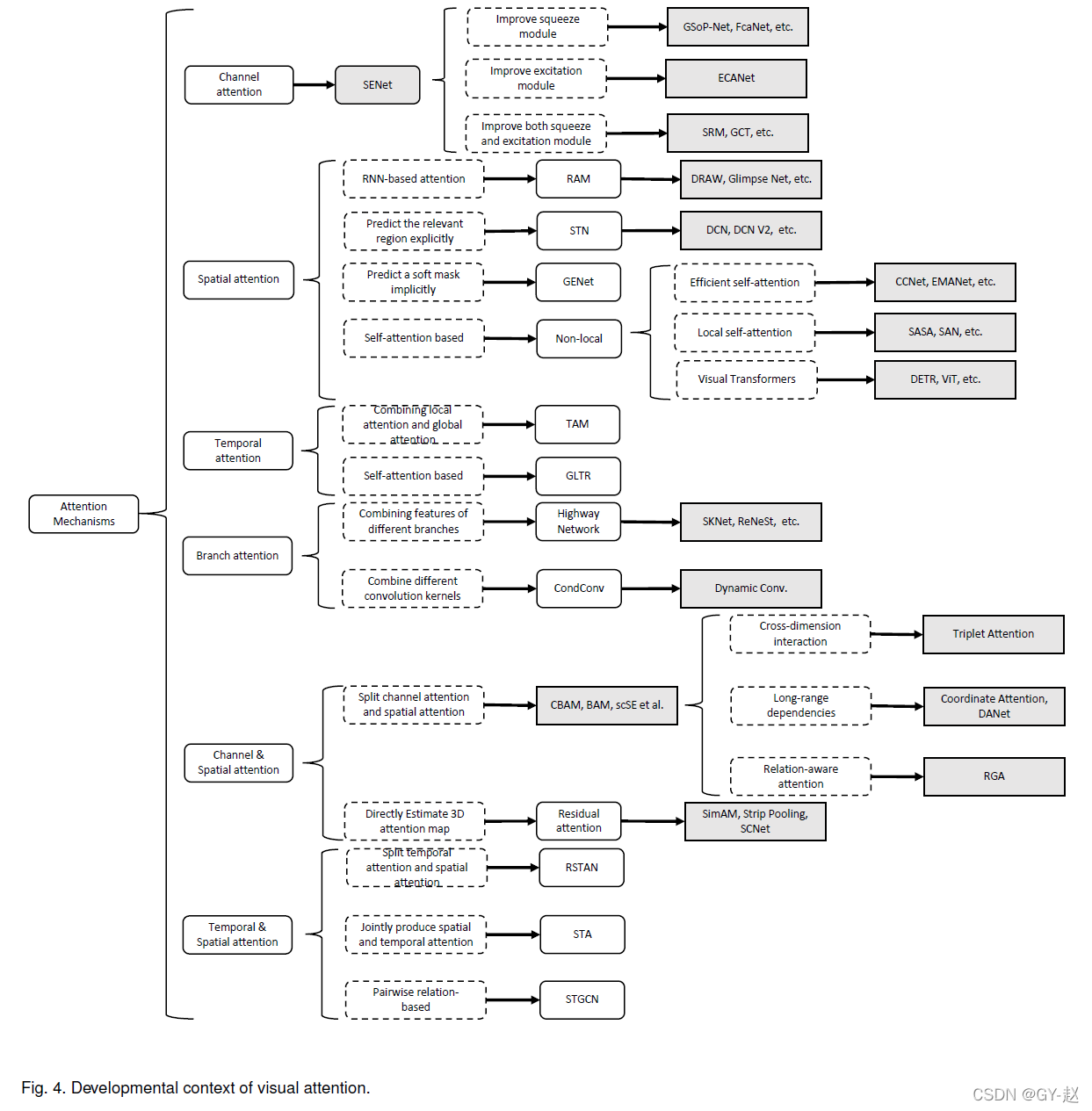

该篇综述关注注意力机制的发展,从attention的角度叙述模型发展。

人类可以轻易在复杂场景中找到感兴趣的目标,受此启发,将注意力机制引入计算机视觉领域,目的是为了模仿人类视觉系统。注意机制在许多视觉任务中取得了巨大的成功,包括图像分类、目标检测、语义分割、视频理解、图像生成、三维视觉、多模态任务和自监督学习。在这项调查中,我们全面回顾了计算机视觉中的各种注意机制,并根据data domain 而不是application对它们进行分类,如通道注意、空间注意、时间注意和分支注意;相关存储库https://github.com/MenghaoGuo/Awesome-Vision-Attentions致力于收集相关工作。论文还提出了注意机制研究的未来方向。

人类视觉系统中的注意力机制可以视为一个动态选择的过程,通过对输入重要性进行自适应的加权来实现。

General form

日常生活中,人类看见一个场景,将快速聚焦于一个感兴趣的判别区域,并可以快速处理,以上过程可以写为一个注意力通用形式,** a t t e n t i o n = f ( g ( x ) , x ) attention=f(g(x),x) attention=f(g(x),x)**这里g(x)产生注意力,对应于有关判别区域的处理过程。f(g(x),x)表示基于attention g(x)处理输入x,这与处理重要区域以及获取信息时一致的。

通过以上定义,可以将现有的所有注意力公式表示为以上形式,以self-attention以及squeeze-and-excitation(SE) attention 为例,对于self-attention

对于SE,

channel attention

channel attention 自适应地重新校准每个通道的权重,可以将其视为一个对象选择过程,从而确定要注意的内容(what to pay attention to )。SENet 首次提出了channel attention。根据图4顺序进行了说明

spatial attention

空间注意力可以看作是一种自适应的空间区域选择机制:where to pay attention。根据图4顺序进行了说明

Temporal attention

时间注意力可以看作是一种动态的时间选择机制,决定when to attention ,因此通常用于视频处理。根据图4顺序进行了说明

Branch attention

分支注意力可以被看作是一种动态的分支选择机制:which to pay attention,与多分支结构一起使用。

Channel & Spatial Attention

通道与空间注意力结合了通道注意力和空间注意力的优点。它自适应地选择重要对象和区域,The residual attention network 开创了channel&spatial attention 领域,强调了信息特征在空间和通道维度上的重要性。它采用自下而上的结构,由几个卷积组成,生成一个3D(高度、宽度、通道)attention map。然而,它有很高的计算成本和有限的应用领域。

为了利用全局空间信息,之后的工作引入了global average pooling 增强了特征识别,同时解耦通道注意力和空间注意力提升了计算效率。其它工作将self-attention应用于channel&spatial 注意力探索两两之间的交互。还有工作使用空间注意力机制扩大感受野。

Spatial & Temporal Attention

时空注意力结合了空间和时间注意力的优点能够自适应选择重点区域和关键帧。一些工作分计算时间注意力和空间注意力,也有一些联合生成时空attention maps。

future Direction

-

注意力机制的充分必要条件。一开始说的attention注意力公式是一个必要条件而不是一个充分条件,例如 GooleNet 可以用上述公式表示,但它不属于attention机制。为所有attention机制找到一个充分必要条件是困难的,但是仍然值得探索,可以进一步推进对于注意力机制的理解。

-

通用注意力block

截至目前,对于特定任务需要设计一种特定的注意力机制,这需要付出相当大的努力去探索潜在的注意力方法。例如,channel attention对于图像分类来说是一个好的选择,然而spatial attention更适合于密集预测任务例如语义分割和目标检测。通道注意力聚焦于what to pay attention ,spatial attention 考虑where to pay attention ,基于以上这些观测,作者鼓励人们思考是否存在一种通用attention block 可以利用所有attention机制。例如,软选择机制(分支注意)可以根据所承担的特定任务在通道注意、空间注意和时间注意之间进行选择。 -

特征化和可解释性。注意力机制是受人类视觉系统启发,是朝着可解释性计算机视觉系统目标的重要一步。通常,基于注意力的模型通过绘制attentnion map来理解。然而,这只能给人一种直观的感觉,而不是精确的理解。然而,安全性或安全性很重要的应用,如医疗诊断和自动驾驶系统,通常有更严格的要求。在这些领域,需要更好地描述方法的工作方式,包括故障模式。开发具有特征性和可解释性的注意力模型可以使它们更广泛地适用。

-

sparse activation。作者通过VIT模型可视化一些attention map获得了一直的结论 ,attention机制可以产生稀疏激活。这个现象给了我们灵感:稀疏激活可以在深度神经网络取得更优异得性能。值得注意的是,稀疏激活与人类的认知是相似的,这些激励着我们去探索哪种结构可以模仿人类视觉系统。

-

基于attention的预训练模型。大规模基于attention的预训练模型已经在NLP和CV领域取得成功,由于他们可以适应各种输入的能力,基于attention的模型可以处理unseen objects ,很自然的迁移预训练权重到各种任务。我们认为结合预训练和attention 模型可以有进一步提高:训练方法、模型结构、预训练任务和数据规模都值得探索。

-

优化。SGD和Adam很适合优化CNN网络,对于视觉transformer,AdamW表现更好。CNN和transformer明显是不同的两种模型,不同的优化方法可能有不同的效果,探索新的attention-based优化方法是值得的。

-

部署。CNN有简单、统一的结构是的它们容易部署在各种不同的硬件设备上,然而,基于复杂多变的attention的模型很难优化、部署在边缘设备上。但是attention模型表现要比CNN更好,因此这也是值得探索的一个方面。

6.华为:A Survey on Vision Transformer(2022年年2月)

该篇综述从应用场景角度对transformer模型进行review,介绍了各种有关backbone的transformer模型,high/mid-level vision ,low-level vision ,and video tasks,同时简单介绍了有效的transformer方法。

按照应用场景将transformer分类:

Vision transformer

基于transformer模型的应用,包括图像分类、high/mid-level vision,low-level vision and video processing.简单总结self-attention机制与模型压缩在高效transformer中的应用。

除了CNN,transformer也可以作为图像分类的backbone。Wu等人将ResNet作为一个baseline,并使用视觉transformer来代替卷积的最后阶段。具体来说,他们应用卷积层来提取低级特征,然后将其输入视觉transformer。对于vision transformer,他们使用tokenizer(标记器)将像素分组为少量视觉标记,每个标记代表图像中的一个语义概念。这些视觉标记直接用于图像分类,transformer用于模拟标记之间的关系。如图4所示,这些作品可以分 为pure transformer,以及将CNN和transformer相结合。我们在表2和图6中总结了这些模型的结果,以展示backbone的发展。除了监督学习,视觉transformer还探索了自监督学习。