��TensorFlowʵ�����Իع�ʵ��

ʵ��Ŀ��:

ͨ������ʵ����ѧ���˽�TensorFlow��������������ѵ��ģ�͵Ļ���˼��,����TensorFlowʵ�����Իع�����̺ͷ���,��ѧ��ʹ��tensorboard graph����ͼ�λ��ķ�ʽ�鿴�ͼ���Լ�����Ƶ�������ģ�͡�

ʵ�������豸������:

��װ��Python���л����ĵ��ԡ�

ʵ������

һ.TensorFlow������װ

1.��anaconda prompt���ڽ��а�װ(anaconda3)����½�һ�������,֮���ڻ����в�����װ(Ĭ�ϻ�����base)

conda create -n tf2 python=3.6.5

�����½���һ����Ϊtf2,����python�汾��3.6.5��һ������(python�汾��Ҫ�����Լ��İ汾��ƥ��)��

���ij������:conda activate ��������

2.����ոմ�����tf2����:

conda activate tf2

3.��װTensorFlow2.4.0

pip install tensorflow-cpu==2.4.0

���߾���װ pip install tensorflow-cpu==2.4.0 -i https://pypi.tuna.tsinghua.edu.cn/simple

��������е��,Ҫ��֤���ܶ������������ⰲװ�����İ�,��Щ���ڻ���ѧϰ��Ҳ�ᾭ���õ���������ֺ���,�ٰ�װһ�Ρ�ֱ������successfull installed ��,�����Ѿ��ɹ���װ����tensorflow������ͼ��2.5.0�汾��װ�ɹ�ʾ��ͼ:

4.֮����ʹ��pycharm��������,����Ҫ�ٰ�װTensorFlow,���û�������

��.����TensorFlow�������Իع�ʵ��

����һ���� y = 3x + 2 ���ɵ����ݼ�(x, y),�������Իع�ģ�� h(x) = wx + b,Ԥ��� w = 3 �� b = 2��

ʵ��Ҫ��:

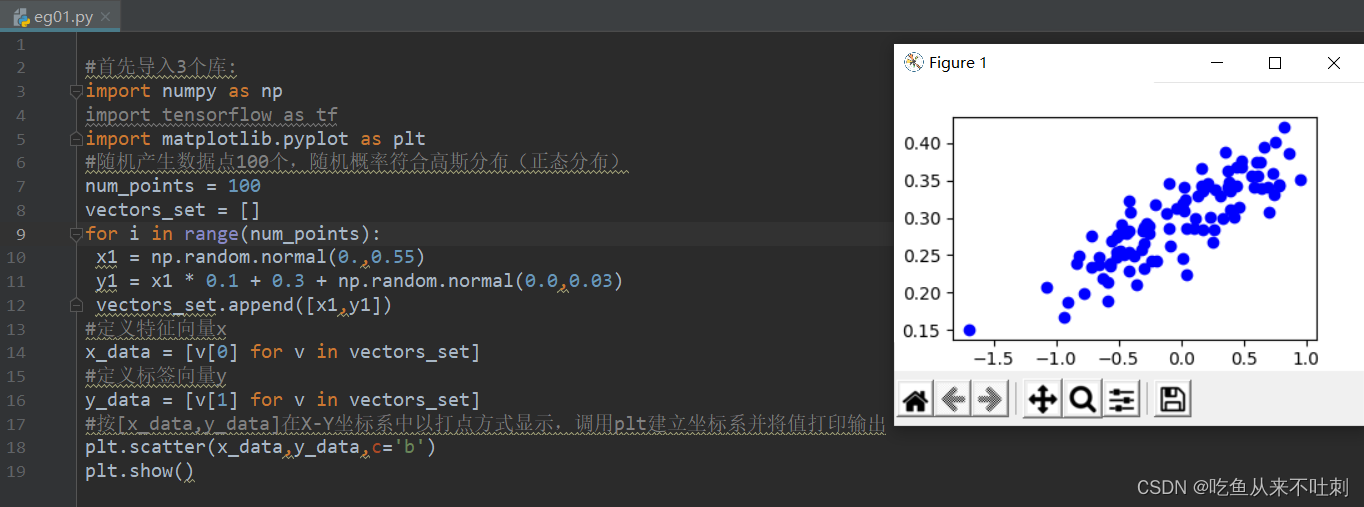

1 ������ϵ����ݼ�

���ݼ�ֻ����һ����������,ע���������Ҫ�����˹�ֲ���ʹ����numpy��matplotlib�⡣numpy��Python��һ����Դ��ֵ��ѧ�����,�������洢�ʹ������;���matplotlib �� Python �Ļ�ͼ��,������ numpy һ��ʹ��,�ṩ��һ����Ч�� MatLab ��Դ�������

���������:

#���ȵ���3����:

import numpy as np

import tensorflow as tf

import matplotlib.pyplot as plt

#����������ݵ�100��,������ʷ��ϸ�˹�ֲ�(��̬�ֲ�)

num_points = 100

vectors_set = []

for i in range(num_points):

x1 = np.random.normal(0.,0.55)

y1 = x1 * 0.1 + 0.3 + np.random.normal(0.0,0.03)

vectors_set.append([x1,y1])

#������������x

x_data = [v[0] for v in vectors_set]

#�����ǩ����y

y_data = [v[1] for v in vectors_set]

#��[x_data,y_data]��X-Y����ϵ���Դ�㷽ʽ��ʾ,����plt��������ϵ����ֵ��ӡ���

plt.scatter(x_data,y_data,c='b')

plt.show()

���������ݷֲ�������ʾ:

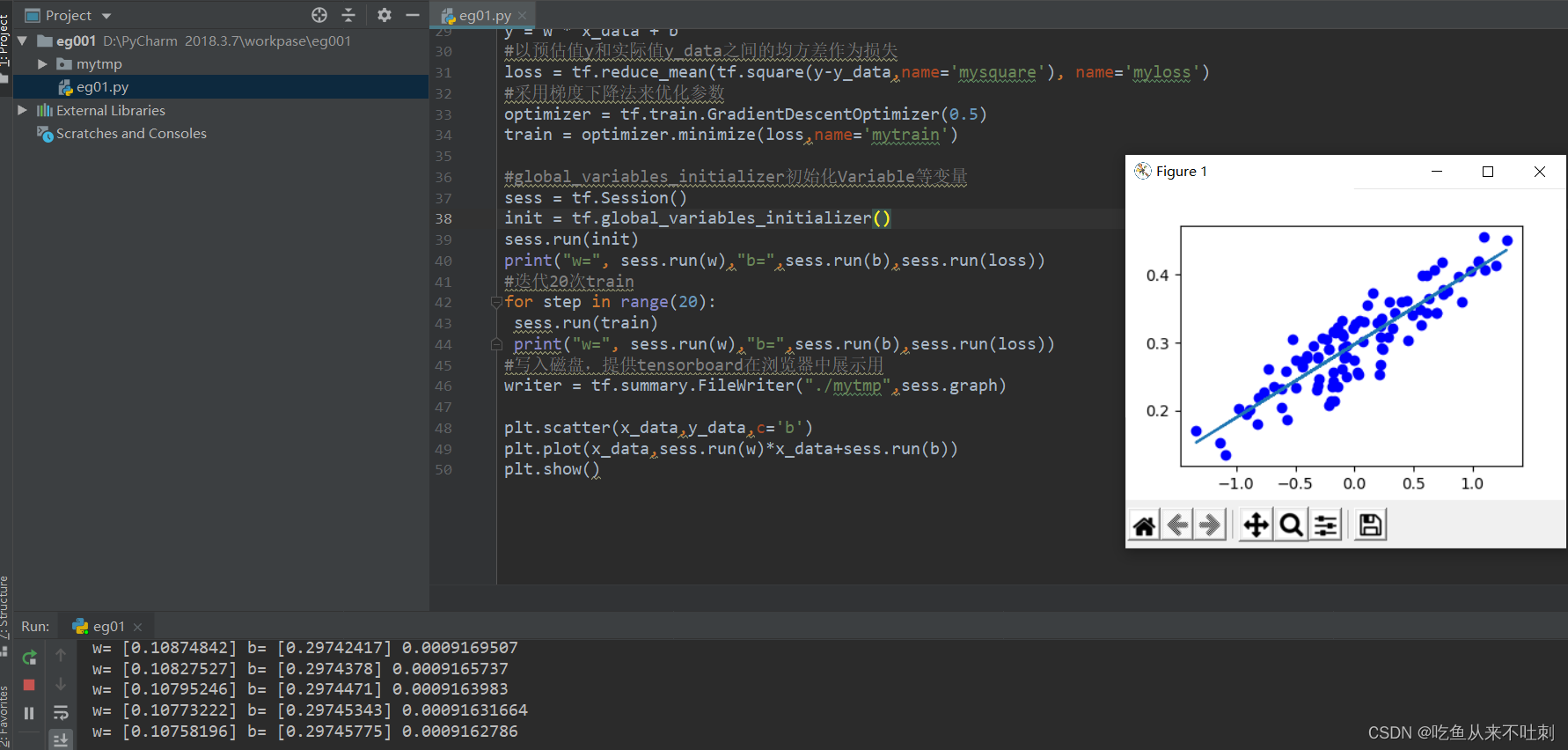

2 �������Իع��Graph

#����TensorFlow�������w��b,Ϊ��ͼ����ʾ��Ҫ,�ֱ�������myw��myb

w = tf.Variable(tf.random_uniform([1],-1.,1.),name='myw')

b = tf.Variable(tf.zeros([1]),name='myb')

#�������������w��b,������������������������x_data,��������ó�Ԥ��ֵ

y = w * x_data + b

#��Ԥ��ֵy��ʵ��ֵy_data֮��ľ�������Ϊ��ʧ

loss = tf.reduce_mean(tf.square(y-y_data,name='mysquare'), name='myloss')

#�����ݶ��½������Ż�����

optimizer = tf.train.GradientDescentOptimizer(0.5)

train = optimizer.minimize(loss,name='mytrain')

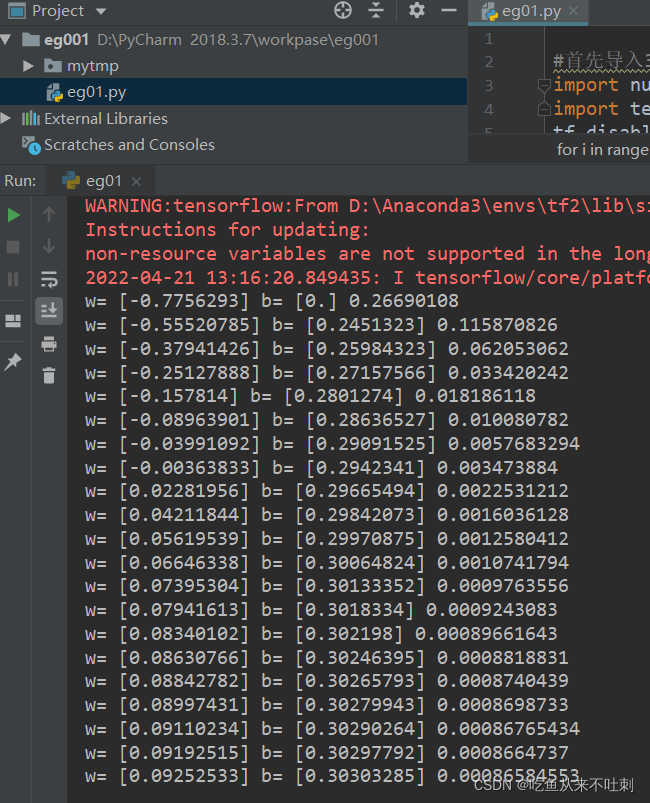

3 ��Session�����й����õ�Graph

#global_variables_initializer��ʼ��Variable�ȱ���

sess = tf.Session()

init = tf.global_variables_initializer()

sess.run(init)

print("w=", sess.run(w),"b=",sess.run(b),sess.run(loss))

#����20��train

for step in range(20):

sess.run(train)

print("w=", sess.run(w),"b=",sess.run(b),sess.run(loss))

#д�����,�ṩtensorboard���������չʾ��

writer = tf.summary.FileWriter("./mytmp",sess.graph)

��ӡ��w��b,��ʧֵ�ı仯���,���Կ�����ʧֵ��0.24����0.0008.

4 �����������

plt.scatter(x_data,y_data,c='b')

plt.plot(x_data,sess.run(w)*x_data+sess.run(b))

plt.show()

��ͼ:

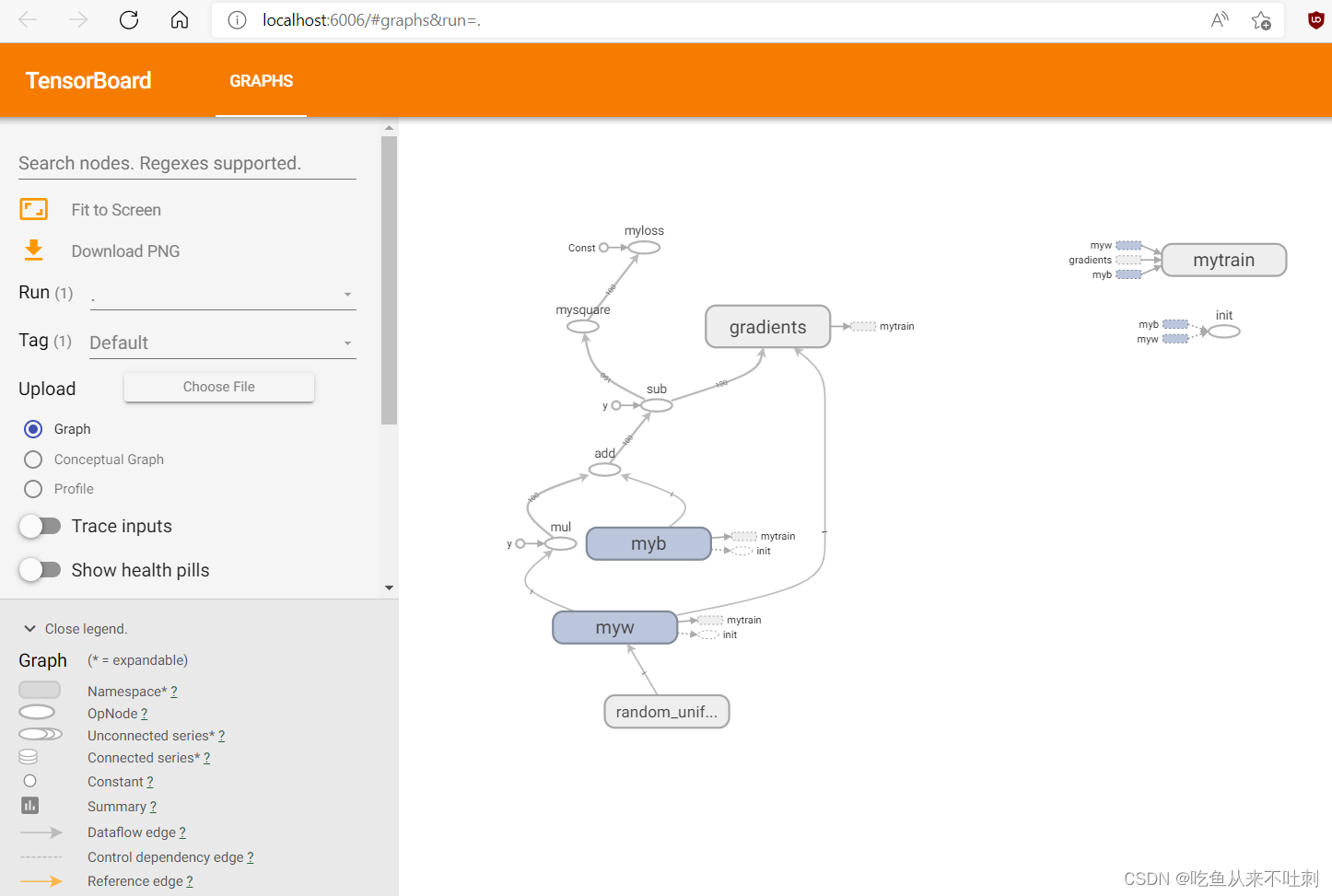

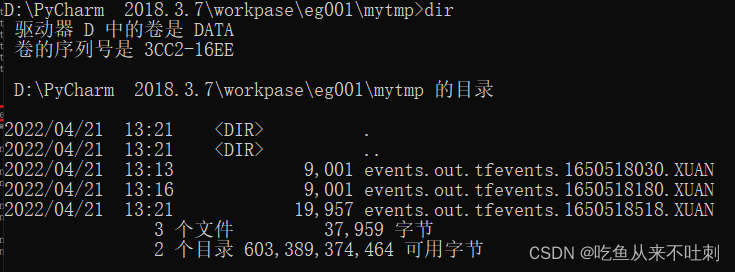

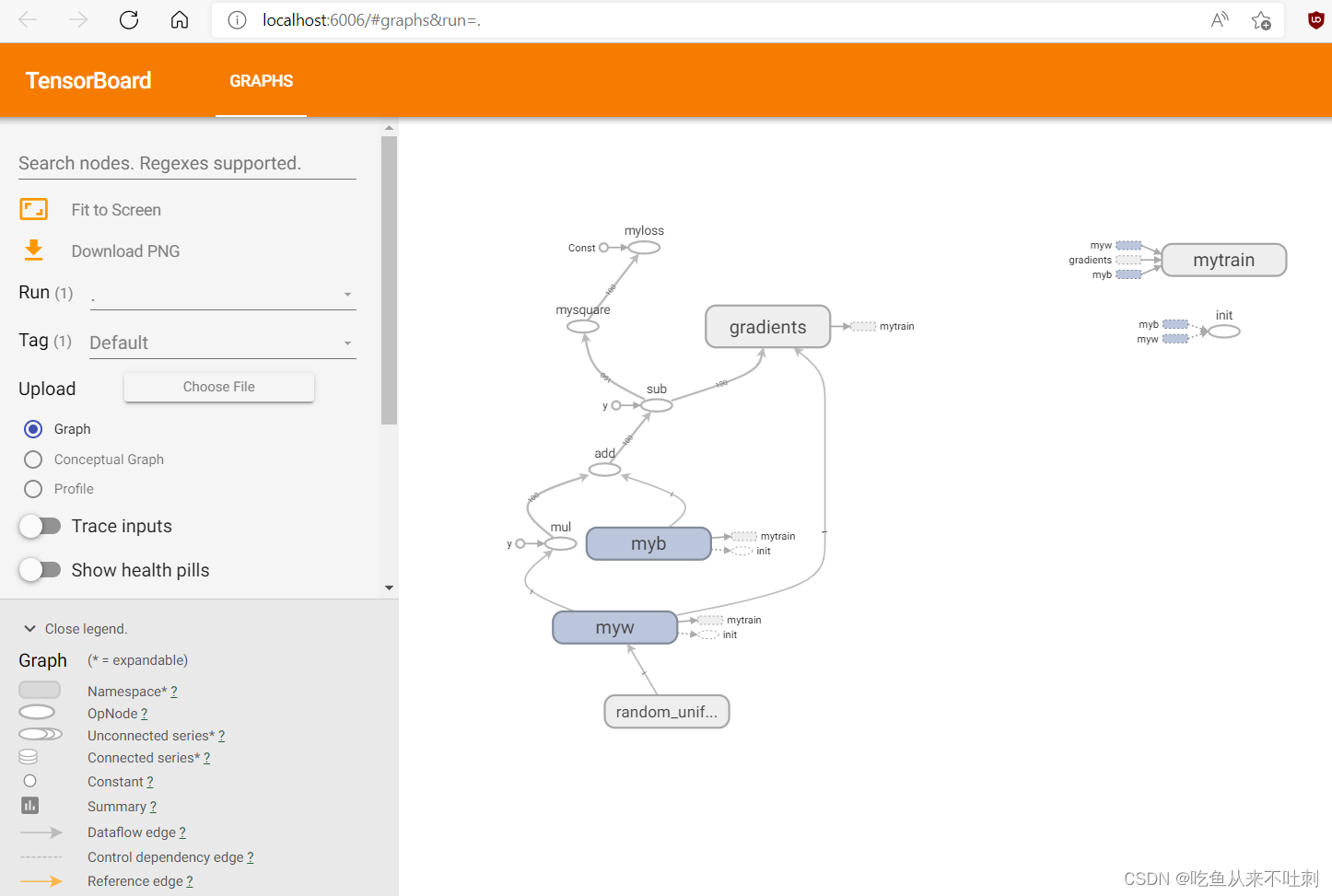

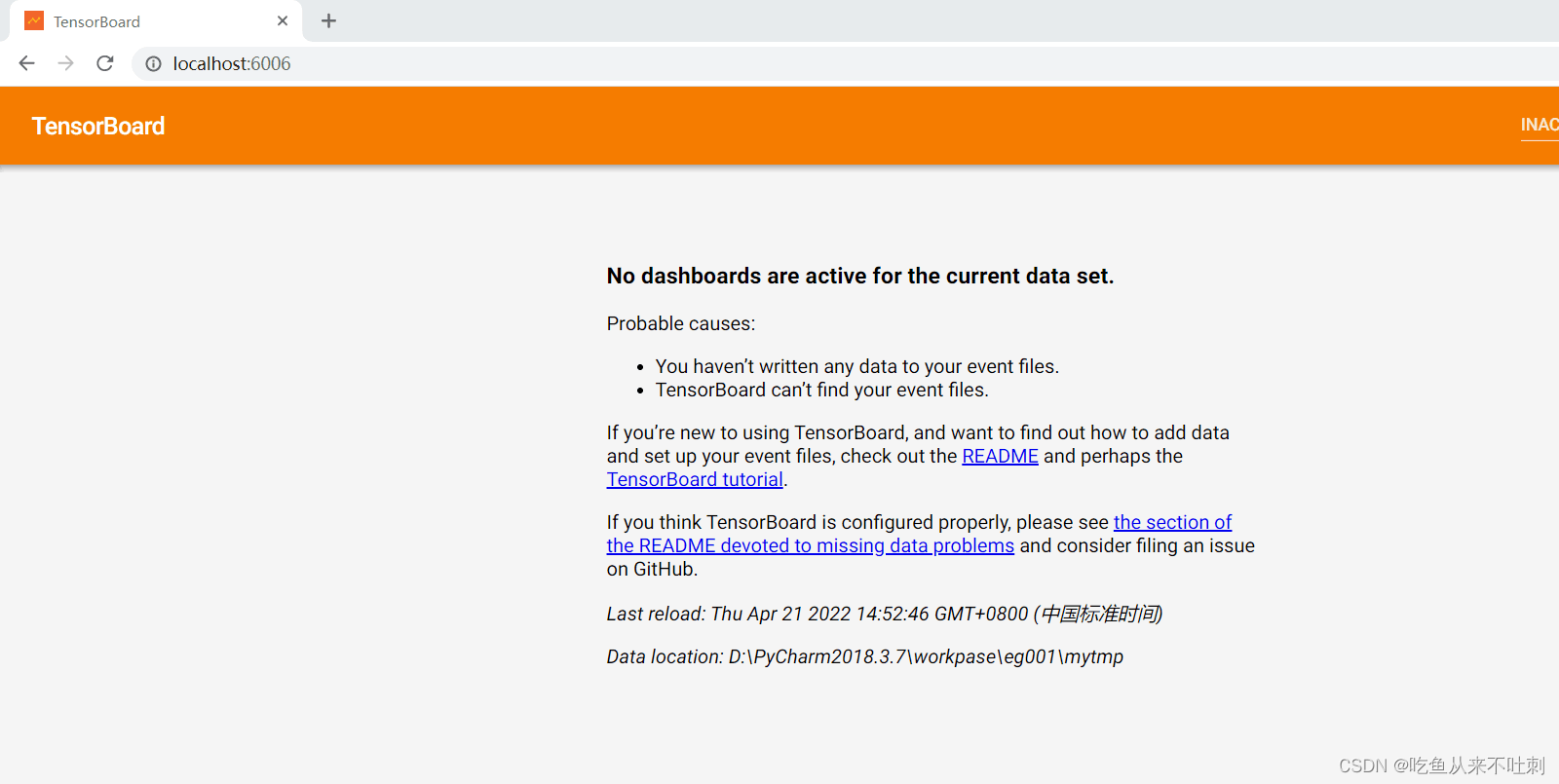

5 tensorboardչʾ�������graph

������ij�����������:writer = tf.summary.FileWriter("./mytmp",sess.graph)

���иĴ����Ϳ��Խ�����������ڵ���Ϣд�뵽./mytmp Ŀ¼��(��Ŀ¼��ǰ�潨���ij�����һ��Ŀ¼)����cmd��ͨ����cd Ŀ¼���л�����Ŀ¼��,���롰dir��������ʾ��Ŀ¼�¸ղ����е���־�ļ�,�������tensorboard --logdir=D:\PyCharm2018.3.7\workpase\eg001\mytmp,�س����к������ʾ��Ϣ,��Ϣ���һ���г��֡�TensorBoard 2.0.2 at http://localhost:6006/ (Press CTRL+C to quit)��,��chrome�����,���������ַ�������� http://localhost:6006,�ͻ�չʾ�ղų�����Ƶ��������ͼ����ʾ������ͼ��ʾ:

ʵ���¼�Լ�ʵ������������������Լ��������:

1.���������

tensorflow��ʾû��random_uniformģ��

����취:tf2.0���������,��tf.random.uniform����

2.���������

TensorFlow2.0�汾���г���

����취:

import tensorflow as tf

��Ϊ

import tensorflow.compat.v1 as tf

tf.disable_v2_behavior()

tf.disable_v2_behavior():�˺��������ڳ���ʼʱ����(�ڴ���������ͼ�λ������ṹ֮ǰ,�Լ��ڳ�ʼ���豸֮ǰ)������TensorFlow 1.x��2.x֮�����в�ͬ��ȫ����Ϊ�л�ΪԤ����1.x��Ϊ,��������2.x�汾��

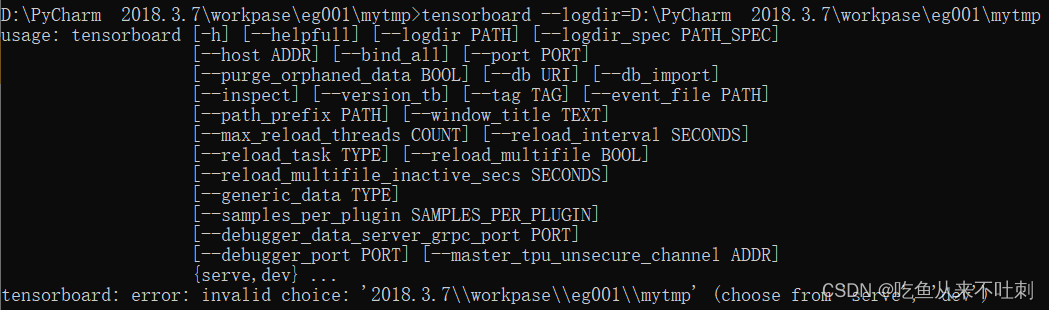

3.��ʽ����

�Ȳ鿴tensorboard��װλ��,����ʹ�õ���Anaconda3,������Anaconda3�µ�����tensorflow,Ѱ������Scripts�ļ��²�����û��tensorboard.exe�ļ�,������ڵĻ��Ǿ���û������tensorboard����������

�������֮���ֳ�������,

�������֮���ֳ�������,

·���в����пո�,ɾ���ͺ���

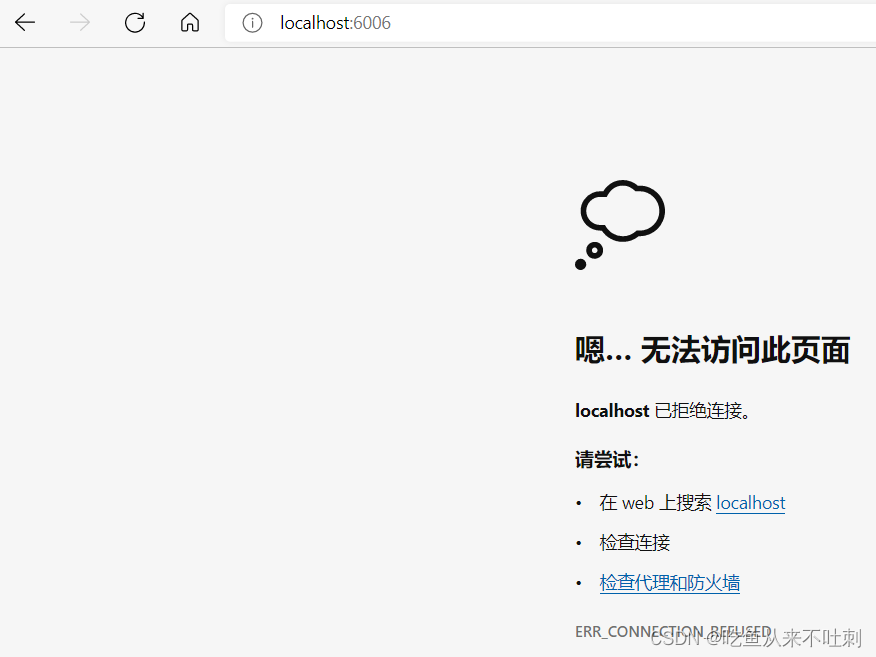

4.ҳ�汨��

����http://localhost:6006�ᱨ��

���������û�����Ϊ localhost (Win10ϵͳ�����û�����(�ĺ���Ҫ��������),���DZ���,(���ַ�������û����,���ᵼ�º�����������,���������ʹ��,��Ϊ����ʹ�ù�,�˴�������¼�����)

��pycharm���ٴγ���:(�ص�cmd������!!!�ݹ۲�,�������Ҫ��������һ���µļ���ͼ,һ��Ҫ��ԭ����cmd�����д��ڹر�,���ظ���������,��Ȼ�Ľ���Ȼ����һ������ͼ��)

��pycharm�IJ˵���,ѡ��View�CTool Windows�CTerminal

Ȼ��ִ��:

tensorboard --logdir=mytmp

����ҳ��֮��,ִ�гɹ�!!!